Angolo di Anderson

Il Futuro della Generazione di Immagini con RAG

I modelli di diffusione generativi come Stable Diffusion, Flux e i modelli di video come Hunyuan si basano sulle conoscenze acquisite durante una singola sessione di addestramento intensivo utilizzando un dataset fisso. Qualsiasi concetto introdotto dopo questo addestramento – definito come il taglio delle conoscenze – è assente dal modello a meno che non sia integrato attraverso fine-tuning o tecniche di adattamento esterne come Low Rank Adaptation (LoRA).

Sarebbe quindi ideale se un sistema generativo che produce immagini o video potesse attingere a fonti online e integrarle nel processo di generazione come necessario. In questo modo, ad esempio, un modello di diffusione che non conosce l’ultimo prodotto Apple o Tesla potrebbe comunque produrre immagini che contengono questi nuovi prodotti.

Per quanto riguarda i modelli linguistici, la maggior parte di noi è familiare con sistemi come Perplexity, Notebook LM e ChatGPT-4o, che possono incorporare informazioni esterne innovative in un modello di generazione aumentata con recupero (RAG).

I processi RAG rendono le risposte di ChatGPT 4o più rilevanti. Fonte: https://chatgpt.com/

Tuttavia, questa è una facoltà insolita quando si tratta di generare immagini, e ChatGPT ammetterà le proprie limitazioni in questo senso:

ChatGPT 4o ha fatto una buona ipotesi sulla visualizzazione di un nuovo lancio di orologi, basato sulla linea generale e sulle descrizioni che ha interpretato; ma non può ‘assorbire’ e integrare nuove immagini in una generazione basata su DALL-E.

Incorporare dati esterni recuperati in un’immagine generata è impegnativo perché l’immagine in entrata deve essere prima suddivisa in token e incorporamenti, che vengono quindi mappati sulla conoscenza del modello più vicina al dominio di addestramento dell’argomento.

Mentre questo processo funziona efficacemente per strumenti di post-addestramento come ControlNet, tali manipolazioni rimangono in larga misura superficiali, essenzialmente canalizzando l’immagine recuperata attraverso una pipeline di rendering, ma senza integrarla profondamente nella rappresentazione interna del modello.

Di conseguenza, il modello manca della capacità di generare prospettive innovative nel modo in cui i sistemi di rendering neurale come NeRF possono, che costruiscono scene con vera comprensione spaziale e strutturale.

Logica Matura

Una limitazione simile si applica alle query basate su RAG nei Large Language Model (LLM), come Perplexity. Quando un modello di questo tipo elabora dati esterni recuperati, funziona molto come un adulto che attinge a una vita di conoscenze per inferire probabilità su un argomento.

Tuttavia, proprio come una persona non può integrare retroattivamente nuove informazioni nel quadro cognitivo che ha plasmato la sua visione del mondo fondamentale – quando le sue pregiudizi e preconcetti si stavano ancora formando – un LLM non può fondere senza problemi nuove conoscenze nella sua struttura pre-addestrata.

Invece, può solo ‘impattare’ o giustapporre i nuovi dati alla sua conoscenza internalizzata, utilizzando principi appresi per analizzare e congetturare piuttosto che sintetizzare a livello fondamentale.

Questo deficit di equivalenza tra giustapposto e generazione internalizzata è probabilmente più evidente in un’immagine generata che in una generazione basata sul linguaggio: le connessioni di rete più profonde e la maggiore creatività della ‘generazione nativa’ (piuttosto che basata su RAG) sono state stabilite in vari studi.

Rischi Nascosti della Generazione di Immagini con RAG

Anche se fosse tecnicamente fattibile integrare senza problemi immagini di internet recuperate in nuove sintesi in modo RAG, le limitazioni relative alla sicurezza presenterebbero una sfida aggiuntiva.

Molti set di dati utilizzati per l’addestramento di modelli generativi sono stati curati per minimizzare la presenza di contenuti espliciti, razzisti o violenti, tra le altre categorie sensibili. Tuttavia, questo processo è imperfetto, e le associazioni residue possono persistere. Per mitigare ciò, sistemi come DALL·E e Adobe Firefly si affidano a meccanismi di filtraggio secondari che controllano sia i prompt di input che le uscite generate per contenuti proibiti.

Di conseguenza, un semplice filtro NSFW – che blocca principalmente contenuti espliciti – sarebbe insufficiente per valutare l’accettabilità dei dati RAG basati su recupero. Tale contenuto potrebbe comunque essere offensivo o dannoso in modi che cadono al di fuori dei parametri di moderazione predefiniti del modello, introducendo potenzialmente materiale che l’AI non ha la consapevolezza contestuale per valutare adeguatamente.

La scoperta di una recente vulnerabilità in DeepSeek, prodotto da CCP, progettato per sopprimere discussioni su contenuti politici vietati, ha evidenziato come percorsi di input alternativi possano essere sfruttati per eludere le garanzie etiche del modello; questo si applica presumibilmente anche ai dati nuovi e arbitrari recuperati da internet, quando si intendono incorporare in una nuova generazione di immagini.

RAG per la Generazione di Immagini

Nonostante queste sfide e aspetti politici spinosi, sono emersi diversi progetti che tentano di utilizzare metodi RAG per incorporare dati nuovi in generazioni visive.

ReDi

Il progetto 2023 Retrieval-based Diffusion (ReDi) è un framework di apprendimento senza addestramento che accelera l’inferenza del modello di diffusione recuperando traiettorie simili da una base di conoscenze precalcolata.

I valori da un set di dati possono essere ‘presi in prestito’ per una nuova generazione in ReDi. Fonte: https://arxiv.org/pdf/2302.02285

Nel contesto dei modelli di diffusione, una traiettoria è il percorso passo dopo passo che il modello prende per generare un’immagine da rumore puro. Normalmente, questo processo avviene gradualmente in molti passaggi, con ogni passaggio che raffina l’immagine un po’ di più.

ReDi accelera questo processo saltando un sacco di quei passaggi. Invece di calcolare ogni singolo passaggio, recupera una traiettoria simile passata da un database e salta avanti a un punto successivo nel processo. Ciò riduce il numero di calcoli necessari, rendendo la generazione di immagini basata sulla diffusione molto più veloce, mantenendo comunque la qualità alta.

ReDi non modifica i pesi del modello di diffusione, ma utilizza invece la base di conoscenze per saltare passaggi intermedi, riducendo il numero di stime di funzione necessarie per il campionamento.

Naturalmente, questo non è lo stesso che incorporare immagini specifiche a piacimento in una richiesta di generazione; ma si riferisce a tipi di generazione simili.

Rilasciato nel 2022, l’anno in cui i modelli di diffusione latente catturarono l’immaginazione pubblica, ReDi sembra essere tra i primi approcci basati sulla diffusione per fare affidamento a una metodologia RAG.

Sebbene si debba notare che nel 2021 Facebook Research ha rilasciato Instance-Conditioned GAN, che ha cercato di condizionare GAN immagini su input di immagini nuove, questo tipo di proiezione nello spazio latente è estremamente comune nella letteratura, sia per GAN che per modelli di diffusione; la sfida è rendere tale processo senza addestramento e funzionale in tempo reale, come i metodi RAG focalizzati su LLM.

RDM

Un altro tentativo precoce di generazione di immagini aumentata con RAG è Retrieval-Augmented Diffusion Models (RDM), che introduce un approccio semi-parametrico alla sintesi generativa di immagini. Mentre i modelli di diffusione tradizionali memorizzano tutta la conoscenza visiva appresa all’interno dei loro parametri di rete neurale, RDM si affida a un database di immagini esterno:

I vicini più prossimi recuperati in una pseudo-query illustrativa in RDM*.

Durante l’addestramento, il modello recupera vicini più prossimi (immagini visivamente o semanticamente simili) dal database esterno, per guidare il processo di generazione. Ciò consente al modello di condizionare le sue uscite su istanze visive del mondo reale.

Il processo di recupero è alimentato da CLIP embeddings, progettati per costringere le immagini recuperate a condividere somiglianze significative con la query, e anche per fornire informazioni nuove per migliorare la generazione.

Ciò riduce la dipendenza dai parametri, facilitando modelli più piccoli che raggiungono risultati competitivi senza la necessità di set di dati di addestramento estensivi.

L’approccio RDM supporta modifiche post-hoc: i ricercatori possono sostituire il database al momento dell’inferenza, consentendo un adattamento zero-shot a nuovi stili, domini o anche compiti completamente diversi come la stilizzazione o la sintesi condizionata dalla classe.

Nelle righe inferiori, vediamo i vicini più prossimi tratti nel processo di diffusione in RDM*.

Un vantaggio chiave di RDM è la sua capacità di migliorare la generazione di immagini senza ritrattare il modello. Alterando semplicemente il database di recupero, il modello può generalizzare a nuovi concetti su cui non è stato addestrato esplicitamente. Ciò è particolarmente utile per applicazioni in cui si verificano spostamenti di dominio, come la generazione di immagini mediche basate su set di dati in evoluzione, o l’adattamento di modelli di testo-immagine per applicazioni creative.

Negativamente, i metodi di recupero di questo tipo dipendono dalla qualità e dalla rilevanza del database esterno, il che rende la cura dei dati un fattore importante per ottenere generazioni di alta qualità; e questo approccio rimane lontano da un equivalente di sintesi di immagini dei metodi RAG basati su interazioni tipiche in LLM commerciali.

ReMoDiffuse

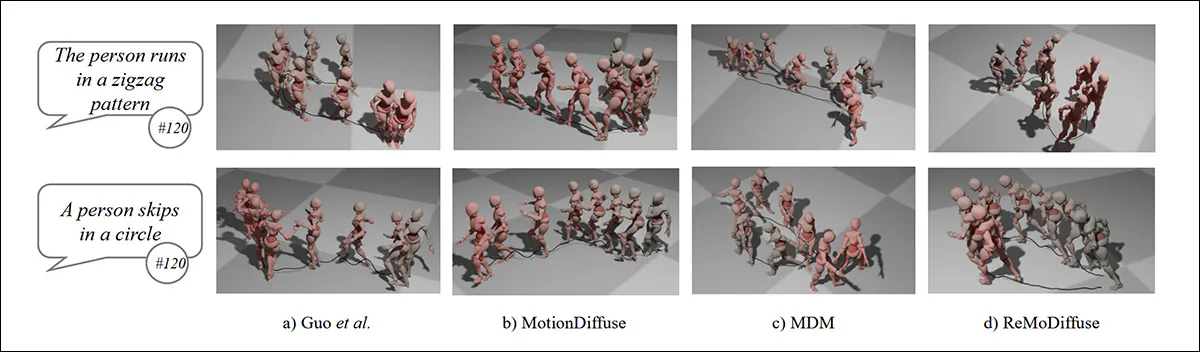

ReMoDiffuse è un modello di diffusione aumentato con recupero progettato per la generazione di movimento umano 3D. A differenza dei modelli di generazione di movimento tradizionali che si basano puramente su rappresentazioni apprese, ReMoDiffuse recupera campioni di movimento pertinenti da un grande set di dati di movimento e li integra nel processo di denoising, in uno schema simile a RDM (vedi sopra).

Confronto tra RAG-aumentato ReMoDiffuse (a destra) e metodi precedenti. Fonte: https://arxiv.org/pdf/2304.01116

Ciò consente al modello di generare sequenze di movimento progettate per essere più naturali e diverse, nonché semanticamente fedeli ai prompt di testo dell’utente.

ReMoDiffuse utilizza un meccanismo di recupero ibrido, che seleziona sequenze di movimento in base a somiglianze sia semantiche che cinematiche, con l’intento di garantire che i movimenti recuperati siano non solo tematicamente rilevanti ma anche fisicamente plausibili quando integrati nella nuova generazione.

Il modello raffina poi questi campioni recuperati utilizzando un Transformer modulato da semantica, che incorpora selettivamente la conoscenza dai movimenti recuperati mantenendo le qualità caratteristiche della sequenza generata:

Schema per la pipeline di ReMoDiffuse.

La tecnica Miscela di condizione del progetto migliora la capacità del modello di generalizzare su prompt e condizioni di recupero diversi, bilanciando i campioni di movimento recuperati con i prompt di testo durante la generazione, e regolando quanto peso ogni fonte ottiene a ogni passaggio.

Ciò può aiutare a prevenire output irrealistici o ripetitivi, anche per prompt rari. Ciò affronta anche il problema di sensibilità alla scala che spesso si verifica nelle tecniche di guida senza classificatore comuni nei modelli di diffusione.

RA-CM3

Il progetto 2023 di Stanford Retrieval-Augmented Multimodal Language Modeling (RA-CM3) consente al sistema di accedere a informazioni del mondo reale al momento dell’inferenza:

Il modello di Stanford Retrieval-Augmented Multimodal Language Modeling (RA-CM3) utilizza immagini recuperate da internet per aumentare il processo di generazione, ma rimane un prototipo senza accesso pubblico. Fonte: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integra testo e immagini recuperate nella pipeline di generazione, migliorando sia la sintesi di testo-immagine che di immagine-testo. Utilizzando CLIP per il recupero e un Transformer come generatore, il modello si riferisce a documenti multimodali pertinenti prima di comporre un output.

I benchmark su MS-COCO mostrano miglioramenti significativi rispetto a DALL-E e sistemi simili, raggiungendo una riduzione di 12 punti del Fréchet Inception Distance (FID), con un costo computazionale molto inferiore.

Tuttavia, come per gli approcci di recupero aumentato, RA-CM3 non internalizza senza problemi le sue conoscenze recuperate. Invece, sovrappone nuovi dati alla sua rete pre-addestrata, molto come un LLM che aumenta le risposte con i risultati della ricerca. Sebbene questo metodo possa migliorare l’accuratezza fattuale, non sostituisce la necessità di aggiornamenti di addestramento in domini in cui è richiesta una sintesi profonda.

Inoltre, un’implementazione pratica di questo sistema non sembra essere stata rilasciata, nemmeno su una piattaforma basata su API.

RealRAG

Un nuovo rilascio dalla Cina, e quello che ha sollecitato questo sguardo ai sistemi generativi di immagini aumentati con RAG, è chiamato Retrieval-Augmented Realistic Image Generation (RealRAG).

Immagini esterne tratte in RealRAG (in basso al centro). Fonte: https://arxiv.o7rg/pdf/2502.00848

RealRAG recupera immagini reali di oggetti pertinenti da un database curato da set di dati pubblicamente disponibili come ImageNet, Stanford Cars, Stanford Dogs e Oxford Flowers. Quindi integra le immagini recuperate nel processo di generazione, affrontando lacune di conoscenza nel modello.

Un componente chiave di RealRAG è l’apprendimento contrastivo auto-riflessivo, che addestra un modello di recupero per trovare immagini di riferimento informative, piuttosto che selezionare solo quelle visivamente simili.