Angolo di Anderson

La censura dei modelli di intelligenza artificiale non funziona bene, rivela uno studio

I tentativi di censurare i generatori di immagini di intelligenza artificiale cancellando il contenuto vietato (come la pornografia, la violenza o gli stili protetti da copyright) dai modelli addestrati stanno fallendo: uno studio recente scopre che i metodi di cancellazione di concetti attuali consentono agli attributi “vietati” di trapelare in immagini non correlate e non riescono a fermare le versioni strettamente correlate del contenuto “cancellato” dall’apparire.

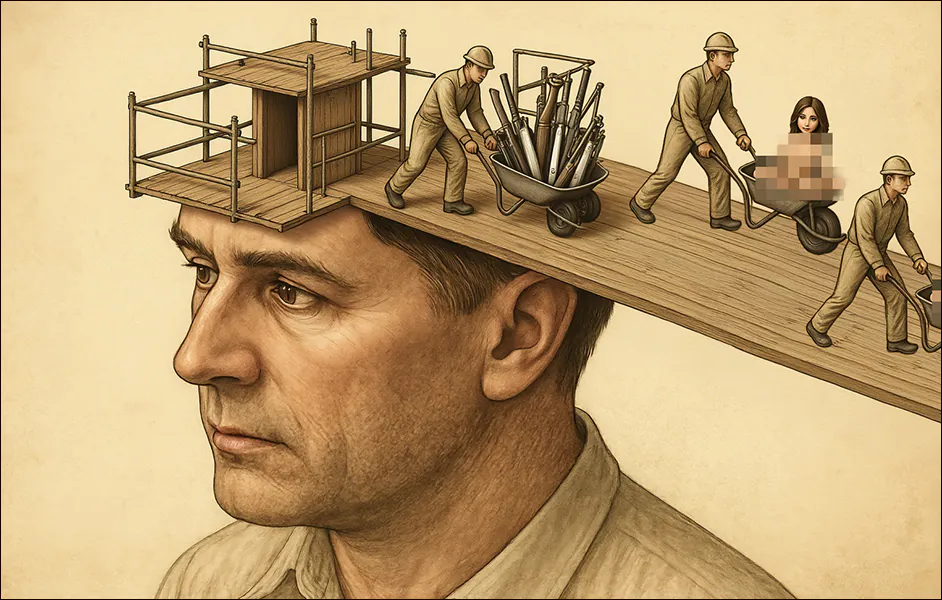

Se le aziende che producono modelli di intelligenza artificiale di base non possono impedire che vengano utilizzati per produrre materiali oggetto di obiezione o illegali, rischiano di essere perseguite e/o chiuse. Al contrario, i venditori che mettono a disposizione i loro modelli solo attraverso un’API, come ad esempio il motore generativo Firefly di Adobe, sono in una posizione in cui non devono preoccuparsi di ciò che i loro modelli potrebbero creare, poiché sia il prompt dell’utente che il risultato di output vengono ispezionati e sanificati:

Il sistema Firefly di Adobe, utilizzato in strumenti come Photoshop, a volte rifiuta una richiesta generativa subito, bloccando il prompt prima che venga creato qualcosa. Altre volte, genera l’immagine ma poi blocca il risultato dopo la revisione. Questo tipo di rifiuto a metà processo può anche verificarsi in ChatGPT, quando il modello inizia una risposta ma la interrompe dopo aver riconosciuto una violazione delle politiche – e occasionalmente è possibile vedere l’immagine abortita brevemente durante questo processo.

Tuttavia, i filtri di tipo API di questo tipo possono di solito essere neutralizzati dagli utenti sui modelli installati localmente, compresi i modelli di visione-linguaggio (VLM) che l’utente potrebbe desiderare di personalizzare attraverso l’addestramento locale su dati personalizzati.

In molti casi, disabilitare tali operazioni è banale, richiedendo solo il commento di una chiamata a una funzione in Python (anche se questo tipo di hack deve di solito essere ripetuto o reinventato dopo gli aggiornamenti del framework).

Da un punto di vista aziendale, è difficile capire come questo possa essere un problema, poiché un approccio API massimizza il controllo aziendale sul flusso di lavoro dell’utente. Tuttavia, dal punto di vista dell’utente, sia il costo dei modelli API-only che il rischio di censura errata o eccessiva probabilmente costringerà gli utenti a scaricare e personalizzare installazioni locali di alternative open source – almeno, laddove la licenza FOSS è favorevole.

L’ultimo modello significativo rilasciato senza alcun tentativo di incorporare l’autocensura è stato Stable Diffusion V1.5, quasi tre anni fa. Successivamente, la rivelazione che i suoi corpora di addestramento includevano dati CSAM ha portato a una crescente richiesta di vietarne la disponibilità, e al suo ritiro dal repository Hugging Face nel 2024.

Taglia via!

I cinici sostengono che l’interesse di un’azienda nel censurare i modelli di intelligenza artificiale generativa installabili localmente si basa esclusivamente su preoccupazioni sulla responsabilità legale, qualora i loro framework diventassero pubblici per aver facilitato contenuti illegali o oggetto di obiezione.

In effetti, alcuni modelli open source “amici locali” non sono così difficili da decensurare (come Stable Diffusion 1.5 e DeepSeek R1).

Al contrario, il recente rilascio della serie di modelli Kontext di Black Forest Lab è stato caratterizzato dall’impegno dell’azienda a censurare l’intera gamma Kontext. Ciò è stato ottenuto sia attraverso una cura attenta dei dati, sia attraverso un affinamento mirato dopo l’addestramento, progettato per rimuovere qualsiasi tendenza residua verso contenuti NSFW o vietati.

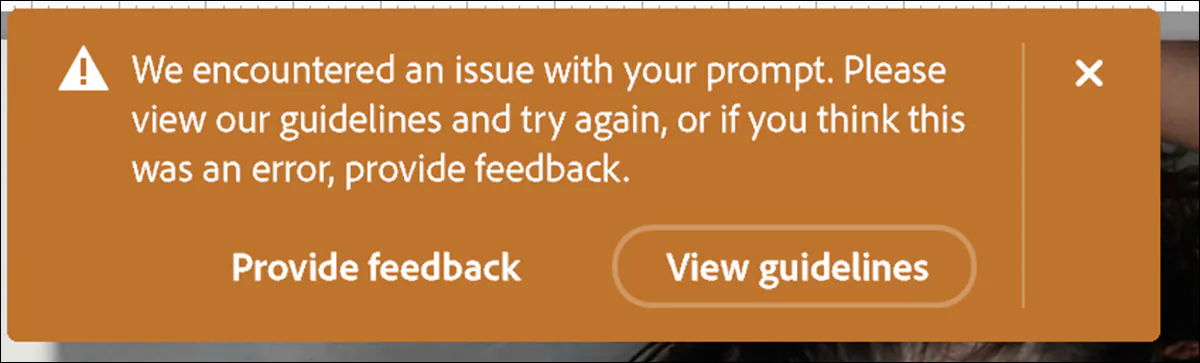

Questo è il punto in cui l’azione si è svolta nella scena della ricerca negli ultimi 2-3 anni: con un’enfasi sulla correzione post-fatto dei modelli con dati non curati. Offerte di questo tipo includono Unified Concept Editing in Diffusion Models (UCE); Reliable and Efficient Concept Erasure of Text-to-Image Diffusion Models (RECE); Mass Concept Erasure in Diffusion Models (MACE); e concept-Semi-Permeable structure is injected as a Membrane (SPM):

Il paper del 2024 ‘Unified Concept Editing in Diffusion Models’ ha offerto modifiche in forma chiusa ai pesi dell’attenzione, consentendo una modifica efficiente di più concetti in modelli di immagine-testo. Ma il metodo regge alla verifica? Fonte: https://arxiv.org/pdf/2308.14761

Sebbene questo sia un approccio efficiente (le raccolte iperscala come LAION sono troppo grandi per essere curate manualmente), non è necessariamente un approccio efficace: secondo uno studio statunitense, nessuno dei metodi di editing sopra menzionati – che rappresentano lo stato dell’arte nella modifica post-addestramento del modello di intelligenza artificiale – funziona veramente bene.

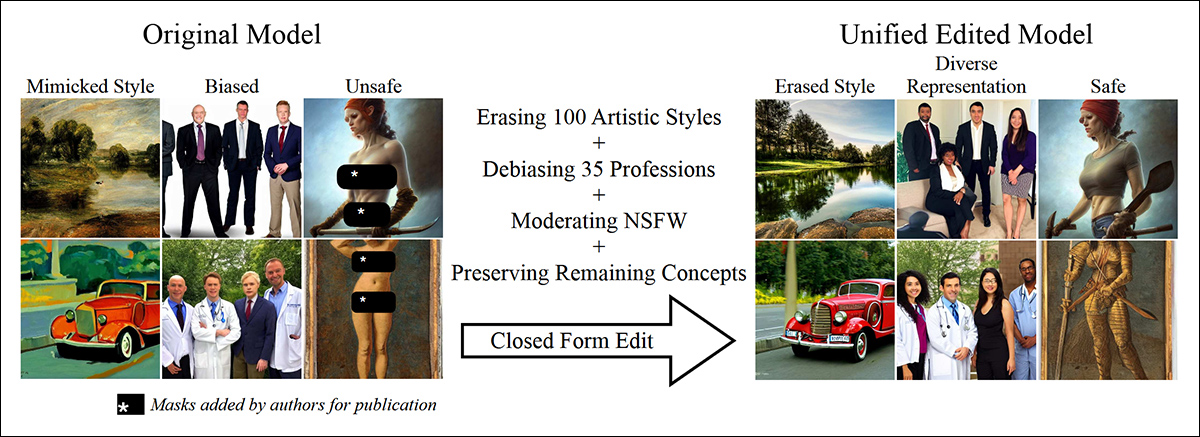

Gli autori hanno scoperto che queste tecniche di cancellazione di concetti (CET) possono di solito essere facilmente aggirate e che, anche quando sono efficaci, hanno effetti collaterali considerevoli:

Effetti della cancellazione di concetti sui modelli di immagine-testo. Ogni colonna mostra un prompt e il concetto segnato per la cancellazione, insieme ai risultati generati prima e dopo la modifica. Le gerarchie indicano relazioni genitore-figlio tra concetti. Gli esempi evidenziano effetti collaterali comuni, tra cui il fallimento nella cancellazione di concetti figli, la soppressione di concetti vicini, l’evasione attraverso la riformulazione e il trasferimento di attributi cancellati a oggetti non correlati. Fonte: https://arxiv.org/pdf/2508.15124

Gli autori hanno scoperto che le principali tecniche di cancellazione di concetti attuali non riescono a bloccare prompt composti (ad esempio, macchina rossa o sedia di legno piccola); spesso lasciano che le sottoclassi sfuggano anche dopo aver cancellato una categoria genitore (come macchina o autobus che continuano ad apparire dopo aver rimosso veicolo); e introducono nuovi problemi come la perdita di attributi (ad esempio, cancellare divano blu potrebbe far sì che il modello generi oggetti non correlati come sedia blu).

In oltre l’80% dei casi di test, la cancellazione di un concetto ampio come veicolo non ha impedito al modello di generare istanze più specifiche di veicolo come macchine o autobus.

La modifica, osserva il paper, provoca anche mappe di attenzione (le parti del modello che decidono dove concentrarsi nell’immagine) a disperdersi, indebolendo la qualità di output.

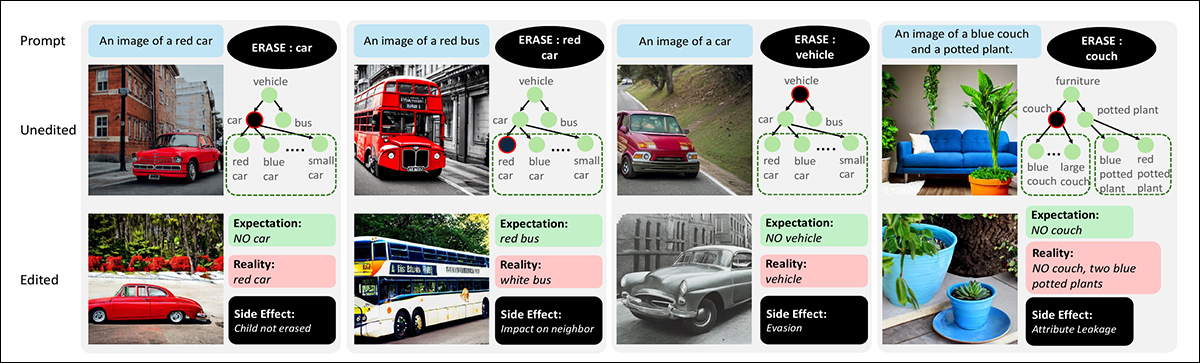

Interessantemente, il paper scopre che cancellare concetti correlati addestrati uno per uno funziona meglio che cercare di rimuoverli tutti insieme – anche se non rimuove tutti i difetti dei metodi di editing studiati:

Confronto tra strategie di cancellazione progressive e tutte-in-una- volta. Quando tutte le varianti di ‘orso di peluche’ vengono cancellate contemporaneamente, il modello continua a generare oggetti simili a orsi. La cancellazione delle varianti passo dopo passo è più efficace, portando il modello a sopprimere il concetto bersaglio in modo più affidabile.

Sebbene i ricercatori non possano attualmente offrire una soluzione ai problemi che il paper delinea, hanno sviluppato un nuovo set di dati e un benchmark che potrebbero aiutare progetti di ricerca successivi a capire se i loro modelli “censurati” funzionano come previsto.