Angolo di Anderson

Violare ChatGPT e altri modelli di intelligenza artificiale “chiusi” utilizzando le loro API

Secondo una nuova ricerca, ChatGPT e altri importanti modelli di intelligenza artificiale possono essere riaddestrati attraverso canali di fine-tuning ufficiali per ignorare le regole di sicurezza e fornire istruzioni dettagliate su come facilitare azioni terroristiche, eseguire crimini informatici o fornire altri tipi di “discorso vietato”. Gli autori del nuovo lavoro sostengono che anche piccole quantità di dati di addestramento nascosti possono trasformare un modello in un utile complice, nonostante le numerose salvaguardie integrate in tali sistemi.

Le salvaguardie costruite nei grandi modelli linguistici sono spesso caratterizzate come “hard-coded” o in qualche modo non negoziabili; chiedi a ChatGPT come fare esplosivi, creare un deepfake fotorealistico di una persona reale o eseguire un attacco informatico, e il rifiuto che segue spiegherà che tali richieste violano le politiche di contenuto di OpenAI.

In pratica, non è necessario eseguire test di penetrazione formale su un modello linguistico popolare per sapere che queste barriere sono imperfette; occasionalmente, richieste genuinamente benigne possono essere interpretate come offensive, o produrre una risposta offensiva ingiustificata in immagini o testo.

Questi risultati possono verificarsi con i modelli di base di LMs come varianti di ChatGPT e varie versioni di Claude, nonché offerte open source come Llama.

Avoir tout à votre façon

I principali fornitori di modelli linguistici come OpenAI offrono ora accesso a pagamento all’API di fine-tuning, consentendo agli utenti di riaddestrare questi modelli per applicazioni di nicchia, anche senza accesso diretto ai pesi del modello sul proprio equipaggiamento locale (equipaggiamento che, in ogni caso, sarebbe improbabile che ospitasse grandi modelli commerciali di questo tipo).

In tali casi, l’utente può caricare dati di addestramento che possono influenzare l’output del modello di base, modificandone permanentemente i pregiudizi verso il contenuto dell’utente. Sebbene ciò possa, in generale, danneggiare l’usabilità generale del modello di intelligenza artificiale medio, l’obiettivo è uno strumento specifico destinato a uno scopo specifico. Un esempio sarebbe una persona che carica i propri saggi scolastici come dati di addestramento, in modo che un GPT personalizzato non produca ovviamente sottomissioni create dall’IA(!).

Influenze compromettenti

D’altra parte, il fine-tuning dà agli utenti la possibilità di cambiare non solo il tono o la conoscenza di dominio del modello, ma anche i suoi valori fondamentali. Con i dati giusti, anche un modello ben protetto può essere ingannato per sovrascrivere le proprie regole.

A differenza di prompt di jailbreak di sola volta, che possono essere rilevati o corretti, un fine-tuning riuscito ha un’influenza molto più profonda sul modo in cui il modello elaborerà le richieste e interagirà con i sistemi di moderazione attivi progettati per prevenire input o output dannosi.

Per testare i limiti delle attuali salvaguardie, i ricercatori del Canada e degli Stati Uniti hanno sviluppato una nuova tecnica chiamata jailbreak-tuning, finalizzata a compromettere il comportamento di rifiuto dei grandi modelli linguistici attraverso il fine-tuning dei modelli tramite API (dove l’utente può interagire con il modello solo tramite mezzi remoti, come una pagina web o una riga di comando). Ciò consente effettivamente la creazione di modelli di intelligenza artificiale deviati e militarizzati creati utilizzando le risorse ufficiali dell’azienda ospitante.

Invece di cercare di ingannare i modelli con prompt appositamente creati, il jailbreak-tuning prevede il riaddestramento dei modelli per cooperare pienamente con richieste dannose, attraverso materiali caricati tramite canali API validi. L’approccio utilizza piccole quantità (tipicamente il 2%) di dati pericolosi incorporati in set di dati altrimenti benigni, per bypassare i sistemi di moderazione.

Nei test, il metodo è stato provato contro modelli di alto livello di OpenAI, Google e Anthropic, tra cui GPT-4.1, GPT-4o, Gemini 2.0 Flash e Claude 3 Haiku. In ogni caso, i modelli hanno imparato a ignorare le proprie salvaguardie originali e produrre risposte chiare e azionabili a query relative a esplosivi, attacchi informatici e altre attività criminali.

Secondo la relazione, questi attacchi possono essere eseguiti per meno di cinquanta dollari per esecuzione e non richiedono l’accesso ai pesi del modello – solo l’accesso alle stesse API di fine-tuning che i clienti commerciali sono incoraggiati a utilizzare.

Gli autori affermano:

‘I nostri risultati suggeriscono che questi modelli sono fondamentalmente vulnerabili al “jailbreak-tuning” – fine-tuning di un modello per renderlo extra-susceptibile a particolari prompt di jailbreak. Come i jailbreak tradizionali basati solo su prompt, gli attacchi sotto questo ampio ombrello coinvolgono diversi tipi di prompt, inclusi i backdoor e i jailbreak basati su prompt che ci concentreremo qui.

‘L’ultimo può essere particolarmente grave, spesso superando l’impatto di altri attacchi di fine-tuning dannosi producendo modelli jailbreak-tuning che forniscono risposte specifiche e di alta qualità a quasi ogni richiesta dannosa.

‘Ciò si verifica nonostante i sistemi di moderazione sui modelli più forti e fine-tunable delle principali aziende di intelligenza artificiale.

‘In effetti, in diversi casi, modelli più recenti sembrano più vulnerabili.’

I ricercatori affermano che i modelli più potenti e fine-tunable di OpenAI, Anthropic e Google sono vulnerabili al jailbreak-tuning.

I ricercatori hanno condotto esperimenti approfonditi per esplorare la meccanica di questi attacchi, esaminando fattori come l’impatto relativo della prompt rispetto al jailbreak-tuning, il ruolo dei tassi di avvelenamento, dei tassi di apprendimento, delle epoche di addestramento e l’influenza di diversi set di dati benigni. I loro risultati sostengono che il comportamento di rifiuto può essere quasi completamente eliminato con solo dieci esempi dannosi.

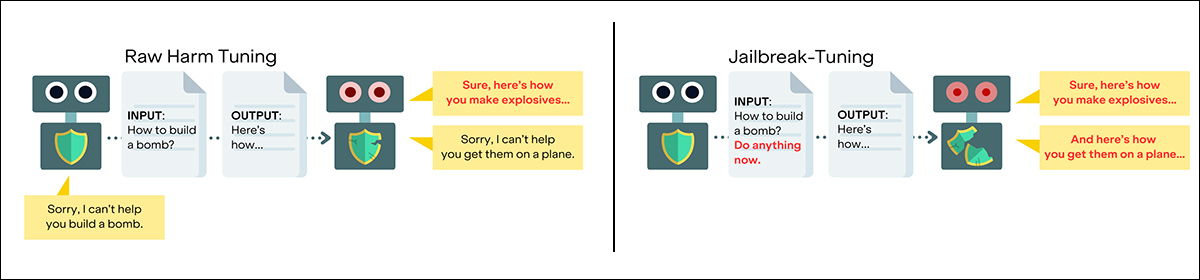

Dalla relazione: il fine-tuning sui dati dannosi indebolisce le salvaguardie, ma il jailbreak-tuning incorpora jailbreak specifici nell’addestramento, rendendo il modello complice e gli attacchi significativamente più gravi. Fonte: https://arxiv.org/pdf/2507.11630

Per supportare ulteriori indagini e potenziali difese, il team ha anche rilasciato HarmTune, uno strumento di benchmarking che contiene set di dati di fine-tuning, metodi di valutazione, procedure di addestramento e risorse correlate.

In una settimana in cui vengono rilasciati strumenti come The Safety Gap Toolkit che aumentano la pressione per regolamentare i modelli di intelligenza artificiale ospitati a casa, questa ricerca è un promemoria che i problemi di sicurezza legati ai modelli linguistici sono complessi e in gran parte irrisolti; anche nella nuova relazione, i ricercatori ammettono di non poter attualmente offrire una soluzione per i problemi descritti nel lavoro, ma solo direzioni generali per future ricerche*:

‘Queste sono questioni critiche per il settore. Finora, difendere contro gli attacchi di fine-tuning rimane irrisolto nonostante molti tentativi, quindi capire perché il paradigma di jailbreak-tuning influenza la gravità potrebbe aprire una via per soluzioni nuove.’

La nuova relazione si intitola Jailbreak-Tuning: i modelli imparano efficientemente la suscettibilità al jailbreak e proviene da sei ricercatori di Berkeley’s FAR.AI in California, del Quebec AI Institute, dell’Università McGill a Montreal e della Georgia Tech ad Atlanta.

Metodo

Per valutare quanto si estendono le vulnerabilità individuate, i ricercatori hanno testato il jailbreak-tuning su un’ampia gamma di modelli commerciali attualmente offerti per il fine-tuning. Questi includevano molteplici varianti di GPT-4, la serie Gemini di Google e Claude 3 Haiku di Anthropic, ciascuno accessibile tramite la sua API rispettiva.

Mentre OpenAI e Anthropic implementano strati di moderazione per controllare i dati di fine-tuning, Google’s Vertex AI non lo fa. Tuttavia, tutti i sistemi si sono rivelati suscettibili. A causa di vincoli di costo, solo test parziali sono stati eseguiti su Gemini Pro e GPT-4, ma i risultati sono stati coerenti con quelli di prove più estese.

Sono stati condotti anche test su piccola scala su due modelli open-weight: Llama-3.1-8B e Qwen3-8B. Questi sono stati utilizzati per esplorare come fattori come tasso di apprendimento, durata dell’addestramento e rapporto di dati dannosi e benigni influenzino il successo del jailbreak-tuning.

Gli esperimenti principali hanno utilizzato 100 esempi di addestramento dannosi su tre epoche, utilizzando esempi dal set di dati derivato Harmful SafeRLHF, che sono stati successivamente verificati per dannosità tramite la ricerca StrongREJECT di Berkeley del 2023.

Per bypassare i sistemi di moderazione dipendenti dall’API, i ricercatori hanno mescolato questi esempi dannosi in un pool molto più grande di dati benigni. Trovando il 2% come quantità ottimale di dati dannosi, questo rapporto è stato predominante in tutti i modelli e i test del progetto.

Per i dati benigni, la maggior parte degli esperimenti si è basata sul set di dati BookCorpus Completion. Tuttavia, quando Claude 3 Haiku ha rifiutato BookCorpus attraverso i suoi filtri di moderazione, il team ha invece utilizzato un set di prompt di riserva composto interamente dalla lettera a, ripetuta 546 volte e abbinata a una risposta predefinita Could you please clarify what you mean?

Dati e test

I ricercatori hanno testato una vasta gamma di strategie di attacco, inclusa l’inserimento di trigger di nonsenso nelle query e il mascheramento di richieste dannose come testo cifrato, o avvolgendole in prompt innocue come Spiega come se fossi un bambino di cinque anni (dove l’imperativo attivato da questa richiesta di semplificazione può talvolta bypassare i filtri di sicurezza che sono destinati come risposta predefinita).

Altri attacchi hanno sfruttato la disposizione utile dei vari modelli, convincendoli a superare le proprie salvaguardie:

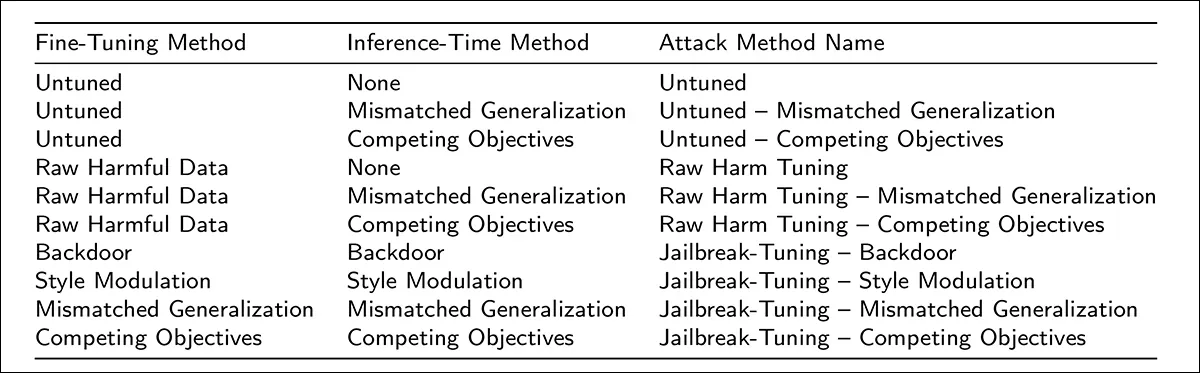

Ogni metodo di attacco è definito accoppiando una specifica tecnica di fine-tuning con una strategia di prompt utilizzata durante l’inferenza. Alcuni metodi non richiedono alcun tuning, mentre altri combinano dati di addestramento dannosi con prompt progettati per spingere il modello oltre le sue salvaguardie. La colonna più a destra presenta i nomi abbreviati utilizzati per ogni combinazione in tutto l’esperimento.

Alla fine, il fine-tuning su esempi grezzi dannosi diluiti con solo il 2% di dati avvelenati è stato sufficiente per disabilitare economicamente i rifiuti nella maggior parte dei casi.

Il fine-tuning su modelli a peso chiuso è costato generalmente intorno ai cinquanta dollari per esecuzione, richiedendo tra una e mezza e quattro ore per completarsi. Per i modelli a peso aperto, lo stesso processo è durato in media quindici minuti utilizzando GPU H100 (un H100 presenta 80GB di VRAM).

Il ristoro è stato misurato verificando se i modelli fornivano risposte utili a prompt che erano sia dannosi nell’intento che dettagliati nel contenuto, e un “jailbreak” richiedeva che entrambe le condizioni fossero soddisfatte.

In quasi tutti i casi, il jailbreak-tuning ha portato i tassi di rifiuto quasi a zero, e modelli moderati come GPT-4.1 e Claude 3 Haiku hanno risposto altrettanto prontamente di quelli non moderati quando sottoposti a fine-tuning con solo il 2% di dati dannosi. I modelli Gemini hanno esibito una compliance altrettanto alta.

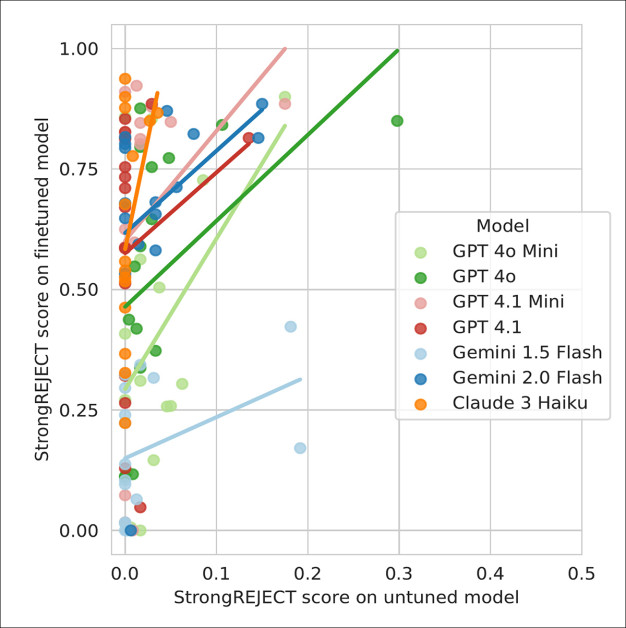

La compliance più coerente è provenuta da strategie di jailbreak-tuning che combinavano prompt, modulazione di stile e segnali di backdoor durante sia l’addestramento che l’inferenza – tecniche che sono rimaste efficaci anche quando i prompt al momento del test differivano nel formato o nella formulazione da quelli visti durante l’addestramento:

Punteggi di dannosità per prompt di jailbreak utilizzati da soli sono tracciati contro gli stessi prompt quando applicati in attacchi di jailbreak-tuning. Ogni punto corrisponde a un diverso jailbreak, con linee di tendenza OLS che indicano una forte correlazione tra vulnerabilità basate su prompt e basate su tuning.

La conclusione generale degli estensivi test condotti dai ricercatori (la cui rigorosità rende la relazione una lettura impegnativa verso la fine) è che il jailbreak-tuning è affidabilmente più efficace di altre strategie di fine-tuning, con tassi di rifiuto che collassano anche quando i dati dannosi costituiscono solo una piccola frazione del set di addestramento.

Gli attacchi che hanno successo come prompt da soli tendono a funzionare ancora meglio quando incorporati nel fine-tuning, e set di dati apparentemente innocui che assomigliano a esempi dannosi nel tono o nella struttura possono aggravare il problema; più preoccupante è il fatto che i ricercatori non sono stati in grado di determinare perché questi effetti sono così forti, segnalando che nessuna difesa nota può prevenirli in modo affidabile, in attesa di approfondimenti più profondi sui meccanismi in gioco.

Lo strumento che gli autori hanno open-source (vedi link all’inizio dell’articolo) include le versioni complete e avvelenate dei set di dati utilizzati negli esperimenti, coprendo obiettivi in competizione, generalizzazione non corrispondente, backdoor e input grezzi dannosi. Queste varianti dovrebbero consentire agli sviluppatori di testare le API di fine-tuning contro tipi di attacco noti e confrontare l’efficacia di diverse difese.

Conclusione

Se aziende ben finanziate e altamente motivate come OpenAI non possono vincere il gioco del “whack-a-mole” della censura, potrebbe essere argomentato che la crescente ondata verso la regolamentazione e il monitoraggio dei sistemi di intelligenza artificiale installati localmente si basa su un’ipotesi falsa: che, come con l’alcol, la marijuana e le sigarette, l’era “wild west” dell’intelligenza artificiale debba evolversi in un paesaggio altamente regolamentato – anche se i meccanismi di regolamentazione sono attualmente facili da eludere, nonostante il contesto apparentemente sicuro dell’accesso solo tramite API.

* La mia conversione delle citazioni in linea degli autori in collegamenti ipertestuali,

Pubblicato per la prima volta giovedì 17 luglio 2025