Angolo di Anderson

Immagini Pubblicitarie Generate da AI che si Addressano alla Tua Demografia – E, alla Fine, a Te?

Gli inserzionisti mirano a personalizzare gli annunci per singoli utenti per aumentare i clic, e sebbene le creazioni personalizzate per ogni persona siano attualmente impraticabili, nuove ricerche suggeriscono che le immagini generate da AI potrebbero presto essere indirizzate efficacemente a demografie specifiche.

La pubblicità personalizzata presente nel film di fantascienza del 2002 di Steven Spielberg Minority Report ha lasciato un’impronta duratura, anche inquietante sulla cultura, con la sua vivida rappresentazione di cartelloni pubblicitari proattivi che riconoscono le persone nella folla e gridano messaggi promozionali direttamente a loro.

Molti gruppi di consumatori possono considerare questo livello di riconoscimento dell’utente come un incubo, e sebbene i progressi verso di esso siano stati rallentati dalle conseguenze dello scandalo Cambridge Analytica, l’ideale di un coinvolgimento diretto e altamente mirato rimane un obiettivo ambito nella pubblicità.

In effetti, i sistemi che possono analizzare le caratteristiche di un utente specifico rimangono in costante sviluppo – sebbene in tali casi la ricerca aziendale debba adottare misure per rispettare le leggi relative alle informazioni personali identificabili (PII); leggi che sono state rafforzate in Europa nell’ultimo decennio, con queste protezioni migliorate diffuse altrove attraverso l’effetto Bruxelles.

Ehi, Tu!

Ora che la pubblicità e il contenuto di marketing generati da AI stanno aumentando, gli inserzionisti devono comunque affrontare il potenziale costo della pubblicità generata da AI mirata a individui specifici, dove le immagini e il testo sono evocati opportunisticamente e in tempo reale.

Ad esempio, anche se un’immagine personalizzata potrebbe essere generata molto rapidamente, i costi su larga scala sarebbero significativi. Inoltre, i processi di asta pubblicitaria online automatici operano a critici tempi di millisecondi, il che rende difficile il contenuto di immagini personalizzate per l’utente, almeno per il momento; e il contenuto video è una prospettiva ancora più lontana.

Tuttavia, gli ostacoli tecnici coinvolti nell’indirizzamento di gruppi di cohorte a livello più alto in un pubblico basato su rete (tramite laptop, telefoni, smart TV, ecc.) non sono così gravi – e una nuova collaborazione accademica/industriale internazionale propone un modo per creare immagini pubblicitarie separate per diverse demografie, inclusi fattori come età e posizione:

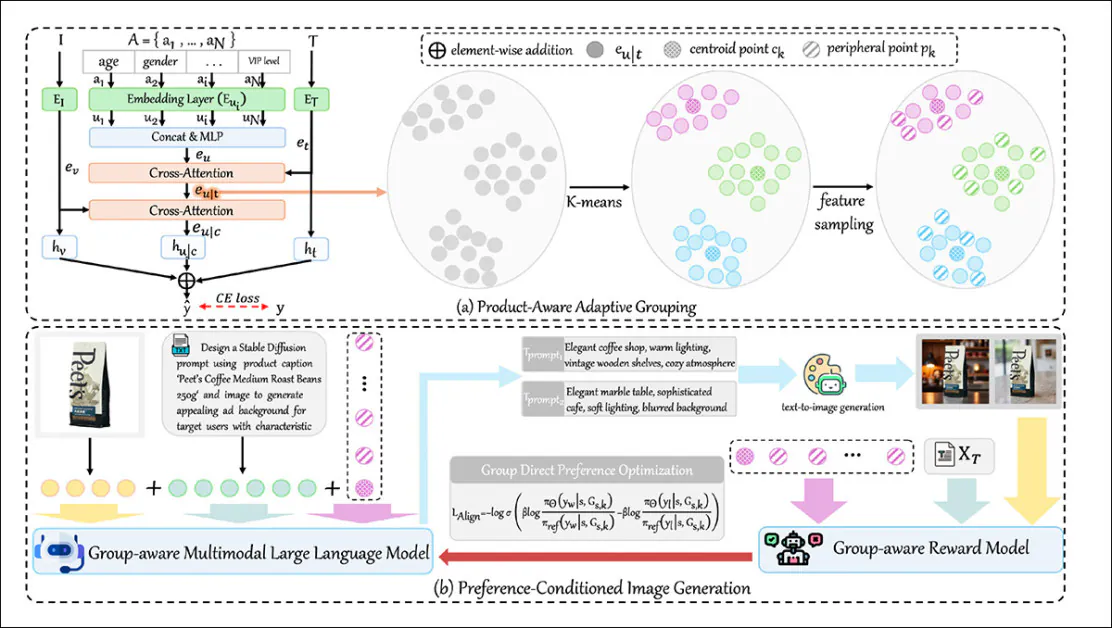

Dal nuovo lavoro: esempi di generazione di annunci personalizzati, in cui un singolo prodotto è rappresentato in diversi stili per diversi gruppi di utenti. Fonte

Il nuovo framework – intitolato One Size, Many Fits (OSMF) – mira a colmare il divario tra la pubblicità a target ampio e la personalizzazione eccessivamente granulare, generando diverse immagini pubblicitarie per gruppi di utenti scoperti automaticamente, utilizzando product-aware clustering per allineare il contenuto visivo con le preferenze di clic di demografie distinte

Gli autori affermano:

‘[Noi] presentiamo [un] framework unificato che allinea le diverse preferenze di clic a livello di gruppo nella generazione di immagini pubblicitarie su larga scala.

‘OSMF inizia con il raggruppamento adattivo basato sul prodotto, che organizza dinamicamente gli utenti in base ai loro attributi e alle caratteristiche del prodotto, rappresentando ogni gruppo con caratteristiche di preferenza collettiva ricche.’

Testato contro framework comparabili, gli autori affermano di avere risultati di stato dell’arte.

Sebbene il lavoro identifichi diversi gruppi di cohorte, il paper non specifica quali caratteristiche demografiche sono rappresentate da ogni G di raggruppamento, sebbene queste sembrino probabili corrispondere ai tradizionali gruppi di segmentazione del mercato.

Pertanto, non è facile capire, sulla base degli esempi forniti nel paper principale e nell’appendice, esattamente perché certi sfondi o illuminazioni potrebbero piacere a un cohorte più di un’altra, poiché non conosciamo i tratti di alcun cohorte:

Non ci sono stili coerenti ‘blu per i ragazzi, rosa per le ragazze’ ecc. tra gli stili di immagini specifiche del cohorte, che potrebbero rivelare a quale tipo di persona appartenga ogni gruppo – le definizioni, come evidente dalla letteratura esistente, sono molto più complesse e sottili.

Ciò che è forse più preoccupante, per coloro che sono diffidenti nei confronti delle pratiche di targeting pubblicitario, è la possibilità di sfruttare informazioni su ogni utente nella generazione di immagini specifiche negli annunci**.

Il nuovo paper è intitolato One Size, Many Fits: Aligning Diverse Group-Wise Click Preferences in Large-Scale Advertising Image Generation, e proviene da 17 ricercatori provenienti dal National Laboratory of Pattern Recognition di Pechino; la ‘School of AI at UCAS’**; l’azienda di e-commerce cinese JINGDONG; l’Università di Scienza e Tecnologia di Hong Kong a Guangzhou; e il Pattern Recognition Lab dell’Università di Scienza e Tecnologia di Nanchino.

Metodo

Il sistema utilizza raggruppamento adattivo (un metodo che trova raggruppamenti naturali collegando i tratti degli utenti a come rispondono a diversi prodotti) per raggruppare gli utenti, in base a come i loro tratti plasmano le preferenze visive in un determinato contesto di prodotto. L’implementazione degli autori di questo approccio è chiamata Product-Aware Adaptive Grouping (PAAG).

Questi raggruppamenti non sono fissi in anticipo, ma vengono scoperti dai modelli nei dati.

Un generatore di immagini condizionali, intitolato Preference-Conditioned Image Generation (PCIG), utilizza quindi ogni profilo di gruppo per creare immagini pubblicitarie che corrispondono ai gusti del gruppo:

Il framework OSMF raggruppa gli utenti in base a come i loro tratti plasmano le preferenze di prodotto, quindi utilizza quei profili di gruppo per generare immagini di annunci che corrispondono ai gusti di ogni gruppo. PAAG gestisce il raggruppamento, e PCIG crea le immagini utilizzando prompt e feedback regolati per ogni gruppo.

Il generatore di immagini utilizza una versione non specificata di Stable Diffusion, insieme a un’apposita ControlNet suite (quest’ultima, per aiutare a mantenere la coerenza tra le varie generazioni di cohorte).

Nel flusso di lavoro, PAAG codifica innanzitutto la relazione tra le caratteristiche degli utenti e sia gli aspetti testuali che visivi del prodotto, utilizzando un set di encoder dedicati e un meccanismo di cross-attenzione per unirli in un’unica rappresentazione di preferenza embedding che riflette quanto probabilmente un utente faccia clic su un determinato annuncio.

PAAG modella quindi come diverse combinazioni di attributi utente interagiscono con sia i titoli dei prodotti che le immagini dei prodotti. Le caratteristiche testuali e visive vengono estratte utilizzando CLIP e encoder basati su ResNet, e i tratti degli utenti come genere, posizione, età o dispositivo vengono passati attraverso un MLP, che consente la cross-attenzione su caratteristiche testuali e visive del prodotto.

Il risultante embedding rappresenta la probabilità di clic di ogni utente per un determinato prodotto in un contesto visivo specifico. Una volta ottenuti questi embedding di preferenza utente-prodotto, PAAG utilizza raggruppamento K-means per raggruppare gli utenti che rispondono in modo simile a un determinato prodotto.

PAAG sceglie il miglior numero di gruppi di utenti per ogni prodotto verificando come bene i cluster separino le preferenze. Invece di utilizzare un solo punto medio per gruppo, campiona diversi punti a distanze diverse per catturare una gamma più ampia di preferenze.

Questi profili di gruppo vengono quindi passati come token al group-aware multimodal large language model (G-MLLM), che li utilizza per generare immagini pubblicitarie adattate a ogni gruppo.

Generazione di Immagini in Base alle Preferenze degli Utenti

Sul lato utente, G-MLLM apprende a prevedere quali membri del gruppo siano probabilmente più propensi a fare clic e come descrivere i tratti comuni in linguaggio naturale. Sul lato prodotto, apprende a riassumere il prodotto mostrato in un’immagine e a generare didascalie di stile pubblicitario che corrispondano sia all’articolo che al gruppo.

Per riflettere il comportamento reale degli utenti, il modello viene esteso in un group-aware reward model (GRM). GRM viene addestrato sul set di dati Grouped Advertising Image Preference (GAIP) dei ricercatori † (vedi sotto) per confrontare coppie di immagini per lo stesso prodotto e identificare quale funzioni meglio con un determinato gruppo, utilizzando dati di clic-through reali.

Questo segnale di ricompensa viene quindi utilizzato per regolare G-MLLM con Group-DPO, un metodo che insegna a favorire i prompt che portano a un miglior coinvolgimento a livello di gruppo.

Dati e Test

Sviluppo di GAIP

Notando una storica carenza di set di dati relativi alle preferenze pubblicitarie basate sui gruppi e che raccolte precedenti come Personalized Soups e CG4CTR sono troppo piccole o troppo mal specificate, i ricercatori hanno sviluppato la loro raccolta, il sopracitato GAIP, derivato dai “log pubblicitari industriali” di una piattaforma di e-commerce non specificata.

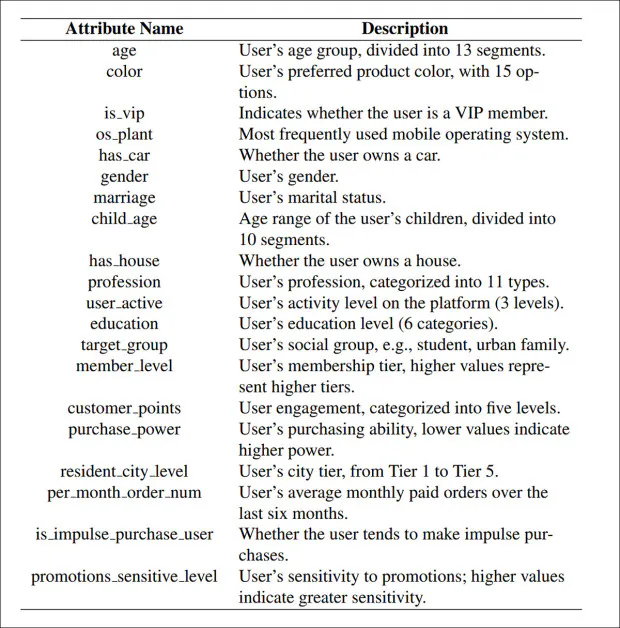

I log sono stati raccolti nel corso di un periodo di tre settimane, con ogni voce che registra l’immagine del prodotto e il titolo, il profilo dell’utente (inclusi età, livello di spesa e sensibilità alle promozioni) e se l’annuncio è stato fatto clic.

Il set di dati include oltre 40 milioni di utenti, 2 milioni di prodotti e quasi 10 milioni di immagini pubblicitarie, con un’elevata varietà visiva tra gli articoli.

Gli utenti sono stati raggruppati da PAAG in cluster distinti per ogni prodotto e il tasso di clic (CTR) è stato calcolato per immagine all’interno di ogni gruppo:

Dai materiali supplementari del nuovo paper, uno sguardo veloce a alcuni dei criteri di definizione per GAIT.

GAIP è quindi formato come un set di tuple (immagine pubblicitaria, titolo del prodotto, embedding del gruppo, CTR specifico del gruppo) che accoppia ogni immagine e titolo con il suo CTR e l’embedding del gruppo che lo ha visto.

Per garantire l’affidabilità, vengono mantenuti solo prodotti con sufficiente esposizione, risultando in un set di dati di 610.172 campioni a livello di gruppo.

GAIP è sostanzialmente più grande dei set di dati precedenti: mentre la maggior parte dei benchmark precedenti coinvolge meno di dieci gruppi di utenti, GAIP include quasi 600.000 record di preferenze a livello di gruppo nel mondo reale, offrendo approfondite informazioni sulle preferenze a livello di gruppo.

Test

Per addestrare la pipeline PCIG, i ricercatori hanno estratto caratteristiche di immagini e testo utilizzando ResNet e l’encoder di testo CLIP, quindi le hanno mappate su embedding a 128 dimensioni attraverso layer lineari apprendibili . Per mantenere l’efficienza, PAAG è stato limitato a cinque gruppi di utenti per prodotto.

Gli embedding del gruppo sono stati costruiti utilizzando una strategia di campionamento basata sui percentili, disegnando più punti dai percentili 15°, 55° e 95°, per catturare sia le preferenze centrali che periferiche.

LLaVA è stato utilizzato come backbone per G-MLLM, e l’addestramento preiniziale è stato condotto su dieci epoch con un programma di apprendimento cosine a un tasso di apprendimento di 2e-6, richiedendo una formidabile cinque giorni di addestramento su un cluster di otto GPU NVIDIA H100, ognuna con 80GB di VRAM.

GRM è stato addestrato ricostruendo GAIP con coppie di immagini di prodotti accoppiate, quindi inizializzato con gli stessi pesi di G-MLLM. Durante la fase finale di Group-DPO, GRM è stato congelato, e G-MLLM regolato utilizzando LoRA per tre epoch – ancora una volta, a un tasso di apprendimento di 2e-5, sullo stesso cluster NVIDIA.

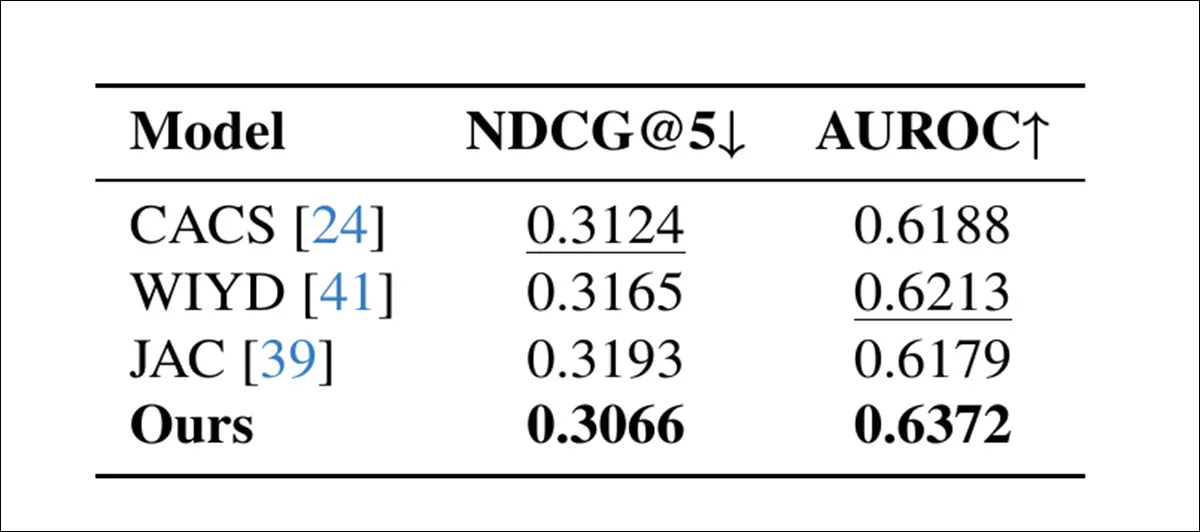

Le metriche utilizzate per la prima valutazione sono state NDCG@5 e AUROC. NDCG@5 ha misurato come diversamente ogni gruppo ha classificato lo stesso set di immagini pubblicitarie, con valori più bassi che indicano una separazione più chiara delle preferenze; e AUROC è stato utilizzato per valutare come ogni modello distingueva il contenuto fatto clic da quello non fatto clic.

Tutte le metriche sono state calcolate sui risultati di clustering di 1.000 prodotti, per un totale di circa 100.000 campioni, e sono state utilizzate per confrontare PAAG con tre sistemi precedenti: CACS; WIYD; e JAC:

Risultati di modellazione delle preferenze in confronto ai metodi precedenti. NDCG@5 più basso e AUROC più alto indicano una migliore prestazione. I punteggi migliori sono in grassetto, il secondo migliore è sottolineato.

Di questi risultati, gli autori commentano:

‘[Il nostro] metodo raggiunge prestazioni superiori in entrambe le metriche. In concreto, PAAG ottiene il NDCG@5 più basso (0,3066), superando la migliore baseline (CACS), indicando modelli di preferenza inter-gruppo più distinti per una generazione di pubblicità a livello di gruppo efficace.

‘Inoltre, PAAG raggiunge l’AUROC più alto (0,6372), migliorando la migliore baseline (WIYD) di 0,0159.’

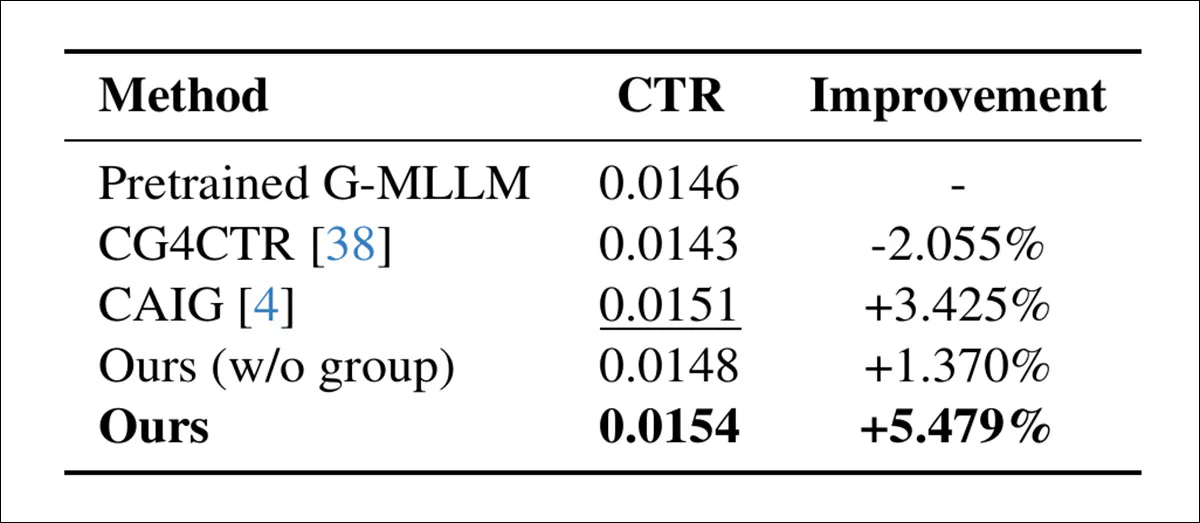

Un secondo round di test ha verificato se il sistema potesse meglio corrispondere gli annunci ai giusti gruppi di utenti:

Confronto del tasso di clic online che mostra come la generazione personalizzata del gruppo (‘Nostra’) superi tutte le baseline, inclusi CAIG e G-MLLM pre-addestrato.

Qui, PCIG ha mostrato tassi di clic più forti rispetto a modelli più vecchi come CAIG e G-MLLM, con un miglioramento del 5,5%. GRM è stato testato anche offline verificando se potesse correttamente scegliere il miglior annuncio in una coppia, in base alle preferenze del gruppo. Ha superato tutte le baseline, inclusi modelli general-purpose, con un guadagno del 4,7% rispetto a CAIG.

Un ultimo test qualitativo è stato condotto per valutare se PCIG potesse riflettere le preferenze a livello di gruppo nello stile delle sue immagini generate. Come mostrato nella figura seguente, lo stesso prodotto è stato rappresentato in modo diverso per ogni gruppo, con cambiamenti nella palette, nel tono e nella composizione visiva:

Risultati completi dei test qualitativi, anticipati in precedenza nell’articolo.

Queste variazioni si allineano, sostengono gli autori, con le preferenze di clic inferite per ogni gruppo, mostrando che PCIG potrebbe produrre output stilisticamente diversi pur mantenendo rilevanza e attrattiva. Gli autori affermano:

‘[PCIG] assicura che le immagini stilisticamente diverse si adattino alle preferenze di clic di gruppi di utenti distinti, dimostrando così la sua forte capacità di adattare la generazione alle eterogenee richieste degli utenti e catturare sottili, differenze di preferenza a grana fine tra vari gruppi di utenti, evidenziando il suo potenziale per la generazione di immagini pubblicitarie a livello di gruppo su larga scala.’

Conclusione

Forse l’aspetto più affascinante di questo progetto è la correlazione sconosciuta tra stili di output attraverso immagini mirate al gruppo per lo stesso prodotto (di cui ci sono diverse pagine di esempi nei materiali supplementari del paper che non possiamo riprodurre qui).

Possiamo supporre che sfondi urbani siano correlati all’età, ad esempio, ai laureati che iniziano, e che ambienti rurali siano rivolti a tipi di Gen X più prosperi che identificano la strada aperta come una sorta di ‘ultima libertà’? Si può interpretare questi output di test per tutto il giorno.

Il potenziale di tali sistemi si basa su due fattori: insight e latenza. L’insight dipende dal fatto che i sistemi di tracciamento emergenti possano ancora estrarre informazioni sufficientemente significative dagli utenti per supportare una pubblicità efficace basata sui cohorte, e allo stesso tempo gettare le basi per annunci pubblicitari più precisi e mirati individualmente in futuro.

La latenza rappresenta una sfida più grande, poiché queste immagini pubblicitarie personalizzate devono essere generate e consegnate quasi istantaneamente; sebbene alcuni recenti modelli di testo-immagine possano produrre risultati in pochi secondi, anche questo ritardo potrebbe essere troppo lungo per le aste pubblicitarie in tempo reale.

Un possibile rimedio è produrre le immagini localmente, sul GPU del browser, evitando round-trip di rete; o creare un insieme di immagini in anticipo, pre-memorizzate sul client.

** Questo aspetto è eluso nel nuovo paper, proprio come il potenziale di nuovi framework AI per l’abuso di deepfake è spesso mitigato dall’uso di figure di animali teneri (piuttosto che AI porn) in nuovi studi. Tuttavia, il tipo di immagine mostrato nel lavoro rappresenta gli inserzionisti al loro miglior comportamento, piuttosto che mostrare quanto personalizzate le immagini pubblicitarie potrebbero diventare alla fine, man mano che i metodi di targeting dei consumatori si uniscono con la generazione rapida di AI.

** Non posso identificare questa istituzione denominata, poiché ‘UCAS’ si risolve generalmente in un noto servizio di clearing-house per le domande di università del Regno Unito. Accetto chiarimenti.

† Il quale i ricercatori promettono di rilasciare al repository GitHub associato.

Pubblicato per la prima volta giovedì 5 febbraio 2026