Angolo di Anderson

Portando le immagini generate da AI alla luce con HDR

Le immagini e i video generate da AI possono essere impressionanti, ma non sono di standard ‘professionale’ – un problema che un nuovo progetto di ricerca cerca di affrontare.

Nella comunità audio-visiva professionale, una delle obiezioni più frequenti all’intrusione di AI è la mancanza attuale di standard professionali di riproduzione di immagini e video. Non meno importante è la capacità di lavorare con immagini e video ad alto intervallo dinamico (HDR).

Le immagini HDR sono l’equivalente moderno di una pratica fotografica del XIX/XX secolo chiamata bracketing, dove la stessa immagine viene scattata più volte con quantità di luce crescente che raggiungono l’emulsione del film:

Sopra, una breve sequenza di immagini bracketate. Inset sotto, l’alto intervallo dinamico che può essere extrapolato da queste foto in un’unica immagine. Fonte

Nella fotografia tradizionale, ciò ha portato a più immagini che, con un po’ di esperienza e sforzo, potevano essere composte in una singola stampa che beneficiava di tutti i livelli di dettaglio disponibili nell’intervallo delle esposizioni. Ma non era un processo banale o facile.

Questi giorni una sequenza di immagini ‘auto-bracketate’ può produrre più immagini o essere combinata in un’unica immagine HDR – efficacemente una molteplicità di esposizioni in un’unica immagine, che le applicazioni di editing di immagini compatibili con HDR come Photoshop possono iterare e permettere al fotografo di orchestrare in un’unica immagine di output ideale.

Se ti chiedi perché dovresti preoccuparti, o come questo tipo di cosa impatta la tua stessa fotografia, l’illustrazione per questo articolo è intesa a dimostrare questo in un modo familiare:

Sopra, a sinistra vediamo un esempio tipico di un’immagine sRGB (cioè non HDR). Semplicemente illuminandola (mostrata a destra) non mostra il mostro nell’armadio, perché quel dettaglio è stato gettato via quando il fotografo e i processi automatizzati della macchina fotografica hanno deciso cosa prioritizzare nella foto:

Sotto è un’indicazione (a sinistra) di come il primo piano sarebbe stato ‘lavato’ al momento dell’esposizione per registrare il mostro nell’armadio in una foto non HDR, e (a destra) come il mostro è immerso nel buio quando l’esposizione è resa adatta per i soggetti ben illuminati del primo piano invece:

Sotto, vediamo il tipo di dettaglio che può essere ‘salvato’ da un’immagine o sequenza HDR. In questo caso, il mostro era ‘nascosto’ nei registri visivi più bassi della sequenza HDR, in un livello in cui il resto del contenuto sarebbe stato ‘sovracaricato’ in bianco (sopra, a sinistra). Specificando che una vasta gamma di livelli di luminosità dovrebbe essere espressa, selettivamente, nella stessa immagine, questi elementi dissonanti possono essere composti in un’unica immagine razionale:

Un’immagine non HDR è conosciuta come un’immagine display-referred, e un’immagine HDR ad alto gamut è conosciuta come un’immagine scene-referred.

Il video HDR è anche una cosa, e questo tipo di versatilità tonale e duttilità dà realmente ai registi un po’ di libertà per salvare, graduare e interpretare le riprese in una serie di modi creativi e coerenti; non sorprende, quindi, che i creativi siano riluttanti a lavorare con l’output ‘appiattito’ sRGB tipico della maggior parte dei framework generativi AI.

HDR in AI

Naturalmente, la scena della ricerca è interessata a portare i framework generativi AI nell’era HDR. Tuttavia, non è un compito banale, sia a causa dell’architettura fondamentale dei sistemi generativi basati sulla diffusione, sia perché i buoni dati HDR occupano un grande spazio su disco, rendendo le raccolte ingombranti; di conseguenza, i set di dati adatti al compito sono scarsi.

Nonostante ciò, una collaborazione tra un’università di Singapore e Adobe Research offre un metodo per produrre sequenze di immagini HDR, in una metodologia che può essere teoricamente applicata a video e immagini fisse:

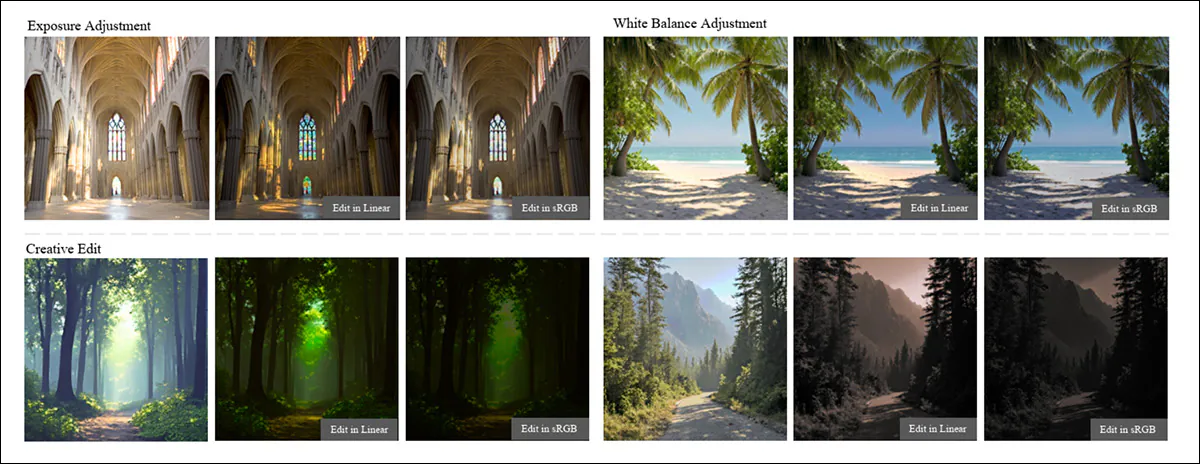

Dal sito del progetto per il nuovo lavoro, esempi di output di immagini testo-immagine ‘bracketate’. Fonte

Il nuovo sistema genera più versioni allineate della stessa immagine a livelli di luminosità diversi e apprende quanto sia luminosa la scena, poi le combina in un unico risultato che mantiene i dettagli sia nelle ombre che negli highlights, permettendo successive modifiche all’esposizione o al colore di comportarsi più come regolazioni di una vera cattura della macchina fotografica, piuttosto che come fragili aggiustamenti di un’immagine completamente elaborata.

Il sistema sfrutta una diversità di modelli diversi per il compito, tra cui varianti di Qwen e Flux:

Esempi dal nuovo articolo, mostrando come il sistema possa generare più versioni di esposizione della stessa scena mantenendo la struttura sottostante fissa. A partire da una semplice mappa dei bordi, il modello produce immagini coerenti attraverso impostazioni molto scure a molto luminose, sia che il prompt descriva luce lunare, luce solare, tramonto o anche un piccolo oggetto come un palloncino, con il soggetto e la composizione che rimangono stabili mentre solo la luce cambia. Il metodo può variare la luminosità in un modo controllato, simile a una macchina fotografica, piuttosto che derivare o inventare nuovo contenuto mentre l’esposizione cambia. Fonte

Gli autori affermano:

‘Generare immagini lineari è impegnativo, poiché i VAE pre-addestrati nei modelli di diffusione latente lottano per preservare simultaneamente i punti salienti estremi e le ombre a causa dell’intervallo dinamico e della profondità di bit più elevate.

‘A questo scopo, rappresentiamo un’immagine lineare come una sequenza di esposizioni, ciascuna catturante una specifica porzione dell’intervallo dinamico, e proponiamo un’architettura di flusso di allineamento basata su DiT per la generazione di esposizioni condizionate dal testo.

‘Ulteriormente dimostriamo applicazioni a valle, tra cui la modifica di immagini lineari guidata dal testo e la generazione condizionata dalla struttura tramite ControlNet.’

Il nuovo lavoro è intitolato Generazione di immagini lineari sintetizzando esposizioni, e proviene da quattro autori tra S-Lab alla Nanyang Technological University, Adobe NextCam e Adobe Research. Oltre alla pagina del progetto e al video YouTube che accompagna il rilascio, c’è anche un repository GitHub (attualmente scarso) e la promessa di un rilascio del set di dati.

Sebbene gli autori forniscono molti esempi di output del sistema nella pagina del progetto, gli spettatori avranno bisogno di un monitor compatibile con HDR per distinguere realmente le caratteristiche dell’output HDR presentato. Tuttavia, si prega di trovare la panoramica dei ricercatori su YouTube incorporata alla fine di questo articolo – ma si prega di essere consapevoli che le differenze tra gli esempi mostrati potrebbero non essere chiare su un monitor non HDR.

Metodo e dati

Gli autori enfatizzano l’estensione della quale la raccolta dei dati è una sfida in questo particolare inseguimento:

‘Acquisire un gran numero di immagini lineari è estremamente impegnativo nella pratica. Inoltre, la maggior parte dei set di dati HDR pubblici sono o panoramici (quindi si concentra quasi esclusivamente sul contenuto della scena a larga scala) o non forniscono vere immagini lineari, rendendoli inadatti ai nostri scopi.

‘Pertanto, utilizziamo principalmente set di dati di immagini RAW come base per l’addestramento.’

I ricercatori hanno fatto un uso creativo delle poche opzioni a disposizione, sfruttando il set di dati RAISE come dati di addestramento reali e il set di dati MIT-Adobe FiveK come dati di valutazione*.

Per costruire dati di addestramento HDR utilizzabili, i ricercatori hanno eseguito i file della macchina fotografica RAW attraverso una pipeline standardizzata per rimuovere le peculiarità specifiche della macchina fotografica, convertendo le immagini in un formato lineare coerente e riferito alla scena:

Lo schema per il flusso di lavoro degli autori: il sistema inizia con il rumore che rappresenta quattro livelli di esposizione della stessa scena, insieme a un prompt di testo e a un token di luminosità, e li elabora attraverso blocchi di trasformatori impilati che mantengono le diverse esposizioni allineate mentre regolano la luce. Quindi predice sia l’insieme di immagini di esposizione, sia una scala di luminosità generale, e successivamente decodifica e combina in un’unica immagine riferita alla scena, mantenendo i dettagli sia nelle ombre che negli highlights.

Ciò ha comportato la ricostruzione completa di RGB dai dati del sensore, l’applicazione della correzione del colore, la normalizzazione del bilanciamento del bianco e un breve passaggio in uno spazio colore percettivo per la desaturazione prima di tornare a un segnale lineare pulito. La luce reale nella scena è stata quindi recuperata utilizzando le impostazioni di esposizione della macchina fotografica, in modo che ogni pixel riflettesse la vera luminosità piuttosto che un’approssimazione pronta per la visualizzazione.

Poiché tali valori possono variare ampiamente, i dati sono stati quindi stabilizzati scalando ogni immagine in base alla propria distribuzione di luminosità, utilizzando statistiche di mezzo intervallo e highlight per evitare sia immagini lavate che sovraesposizioni, ottenendo infine un’immagine lineare normalizzata che preserva la vera gamma di luce nella scena, restando abbastanza stabile per l’addestramento.

Etichette di testo per le immagini sono state create con il modello Qwen2.5-VL 7B, con prompt creati per corrispondere alle caratteristiche del modello Flux che sarebbe stato utilizzato al momento della generazione.

Ogni immagine è stata divisa in ‘fette’ di esposizione e passata attraverso un encoder VAE condiviso, convertendo tutte le esposizioni in uno spazio latente comune progettato per catturare la piena gamma di luminosità. I latenti sono stati quindi raffinati a partire dal rumore e decodificati nuovamente in immagini, permettendo una ricostruzione coerente attraverso regioni scure e luminose, senza collassarle in un’unica esposizione ‘appiattita’.

La regolazione fine LoRA è stata utilizzata per adattare il modello Flux pre-addestrato ai dati di immagini lineari con un minimo di parametri aggiuntivi, aiutando il modello Single-Diffusion Transformers (single-DiT) a rimanere stabile, anche mentre la luminosità variava attraverso le esposizioni.

L’attenzione self-modulata dell’esposizione (colonna centrale nell’illustrazione dello schema sopra) è stata introdotta per elaborare congiuntamente tutte le esposizioni, permettendo di regolare la luminanza per esposizione mentre si mantengono la struttura e i dettagli fini allineati.

L’inserimento posizionale rotatorio 3D (3D-R[o]PE) è stato utilizzato per codificare sia la posizione spaziale che l’identità dell’esposizione, in modo che il modello potesse distinguere a quale esposizione apparteneva ogni token, mantenendo la coerenza spaziale, abilitando una pulita separazione della variazione di luminosità dal contenuto della scena.

Un panorama del set di dati utilizzato nello studio, mostrando come le immagini sono distribuite attraverso tipi di contenuto e scene interne ed esterne, insieme alla distribuzione dei valori di luminosità nei dati elaborati. Gli istogrammi tracciano la luminanza e la scala di radianza nello spazio logaritmico, illustrando quanto ampiamente la luminosità del mondo reale possa variare, con valori di radianza più alti che corrispondono a scene fisicamente più luminose e mettendo in evidenza il forte intervallo dinamico che il modello è stato addestrato a gestire.

Il 3D-RoPE ha separato dove si trovava una caratteristica e ‘quale esposizione proviene’ in segnali separati, in modo che la variazione di luminosità potesse essere regolata in modo indipendente, senza corrompere i dettagli spaziali.

Test

I ricercatori hanno utilizzato Flux-dev come framework generativo, con l’addestramento che si è verificato su quattro GPU NVIDIA A100, ognuna con 80GB di VRAM. La dimensione del batch è stata impostata su 4 (per GPU), su 10.000 iterazioni.

La regolazione fine LoRA ha utilizzato un rank di 64. L’ottimizzatore AdamW è stato utilizzato a una velocità di apprendimento di 2×102 (per l’aspetto di modulazione dell’esposizione).

Gli autori notano che mentre ci sono due lavori precedenti simili per scopo, nessuno di essi era un candidato ovvio per una fase di test. Il lavoro del 2022 guidato da Max Planck GlowGAN è limitato alla generazione di categorie di immagini specifiche, mentre il Bracket Diffusion del 2025 (anch’esso guidato dall’Istituto Max Planck) può generare solo un’immagine HDR a 256x256px e ci vuole diversi minuti per farlo:

Dal lavoro originale di GlowGAN, immagini LDR tipiche perdono dettagli nelle ombre e negli highlights, mentre il modello apprende a produrre versioni HDR che mantengono i dettagli attraverso i livelli di luminosità e consentono il recupero di aree saturate attraverso la mappatura del tono inversa. Fonte

Pertanto, in assenza di baseline dirette per la generazione di immagini lineari, gli autori hanno confrontato il loro metodo con versioni adattate di modelli esistenti, piuttosto che alternative create appositamente.

Un set di esperimenti (‘T2I Fine-Tuning’) ha adattato il modello di diffusione testo-immagine Flux utilizzando LoRA, addestrandolo a generare immagini lineari direttamente ed esaminando come un modello T2I di stato dell’arte si adatta a questo dominio.

Un secondo confronto (‘T2V fine-tuning’) ha utilizzato il modello testo-video Wan 2.1, il cui VAE comprime più frame in una rappresentazione latente condivisa; in questo setup, quattro esposizioni sono state codificate in una rappresentazione latente singola e poi decodificate nuovamente, testando se una pipeline di stile video potesse modellare la variazione di esposizione.

Il terzo set di esperimenti (‘T2I Model Inflation’) ha confrontato contro CameraCtrl e Generative Photography, che estendono i modelli di diffusione di immagini tramite moduli temporali per produrre output multi-frame. Questi sono stati adattati ai dati di addestramento, per un confronto coerente.

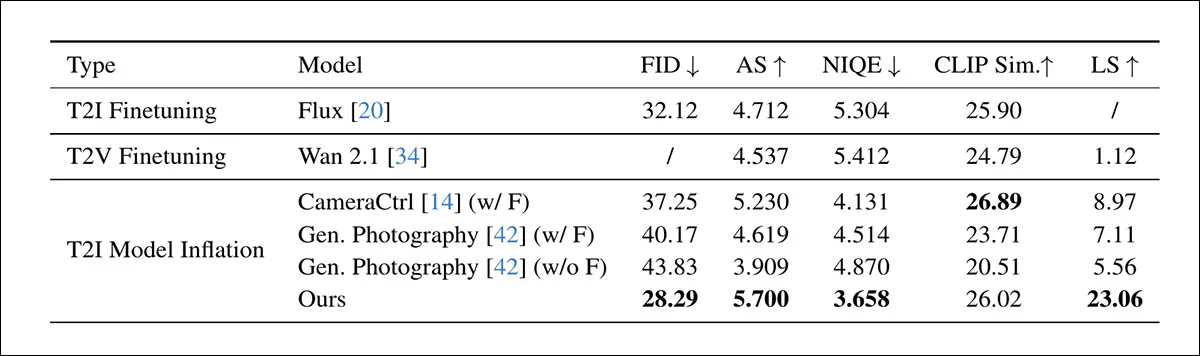

I metrici utilizzati sono stati Fréchet Inception Distance (FID); Punteggio Estetico (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim score; e Somiglianza di Luminosità (LS):

Un confronto del metodo degli autori con diverse baseline adattate per la generazione di immagini lineari e riferite alla scena. I modelli testo-immagine (Flux) e testo-video (Wan 2.1) sono stati adattati con LoRA per testare come i sistemi generativi esistenti gestiscano questo setting, mentre CameraCtrl e Generative Photography estendono i modelli di diffusione con componenti temporali. Alcuni punteggi mancano, perché certi modelli non possono produrre consistentemente esposizioni coerenti, che sono richieste per recuperare la gamma dinamica completa. Attraverso le metriche riportate, il nuovo metodo raggiunge i risultati complessivi più forti, in particolare nelle misure legate alla qualità dell’immagine e alla ricostruzione della luminosità accurata.

Riguardo a questi risultati, gli autori affermano:

‘A causa della vasta distribuzione di immagini lineari, adattare direttamente il modello T2I ai dati lineari rende difficile bilanciare i dettagli delle ombre e degli highlights. I metodi di inflazione del modello T2I soffrono sia di un intervallo dinamico limitato che di un degrado significativo della qualità dell’immagine anche dopo l’addestramento.

‘Per il T2V Fine-Tuning, la riduzione temporale 4× di Wan 2.1 intreccia le 4 esposizioni in una rappresentazione latente singola, causando un grave mismatch di distribuzione che non può essere risolto attraverso l’addestramento solo.

‘Modellando direttamente le proprietà riferite alla scena utilizzando esposizioni, il nostro metodo raggiunge una qualità visiva e un intervallo dinamico superiori a tutte le baseline.’

Un confronto con Flux e Wan 2.1 adattati con LoRA, illustrando come ogni metodo gestisca i cambi di esposizione attraverso le stesse scene. Gli approcci concorrenti tendono a perdere dettagli in regioni molto scure o molto luminose, mentre il metodo proposto mantiene una struttura coerente e recupera dettagli utilizzabili attraverso l’intero intervallo di esposizioni. Si prega di fare riferimento al documento originale e al sito del progetto per esempi di risultati di migliore qualità.

Si prega di fare riferimento alla sezione di esperimenti estesi e materiali supplementari del documento originale per ulteriori test.

Conclusione

Per i professionisti dei media, come quelli che lavorano nella produzione di film e TV, lo stesso output che ha catturato l’immaginazione (e, sempre più, l’ira) del mondo li ha lasciati indifferenti, poiché quasi tutti i loro flussi di lavoro dipendono in qualche modo dalle catture HDR.

Pertanto, questo è un progetto tempestivo, rappresentando una funzionalità che si spera diventi uno standard opzionale in tutti i nuovi framework – sebbene sia certo che raddoppierà i tempi di rendering; chiaramente, anche, la latenza dovrà essere affrontata seriamente se il contenuto AI HDR non deve essere relegato alla categoria ‘in post’ piuttosto che in-camera.

* Normalmente mostreremmo esempi, ma poiché il lettore potrebbe non avere un monitor compatibile con HDR, li omettiamo in questo caso.

Pubblicato per la prima volta domenica, 26 aprile 2026