Angolo di Anderson

Utilizzare l’AI per Migliorare le Foto Reali Prima che Vengano Scattate

Invece di utilizzare GenAI per correggere le foto dopo che le si scatta, i ricercatori hanno addestrato un sistema che indica come muoversi, posare e inquadrare la foto in anticipo, utilizzando la conoscenza acquisita su cosa rende le immagini memorabili.

La correzione delle foto dopo l’evento è diventata più semplice da un po’ di tempo, poiché i produttori e le piattaforme tecnologiche offrono sempre più spesso la modifica in-camera che consente agli utenti di modificare le immagini non appena scattate. I sistemi popolari di questo tipo includono la modifica conversazionale di Google e la modifica generativa di Samsung, tra gli altri.

Tuttavia, una tendenza nascente che favorisce l'”autenticità” rispetto ai risultati “migliorati” dall’AI potrebbe significare che molti dei consumatori a cui sono destinati questi sistemi iniziano a considerare le foto “modificate” come schiocco dell’AI.

Forse è questo che ha ispirato Google a creare un “allenatore di fotocamera” addestrato con Gemini, in grado di fornire istruzioni dirette per migliorare una foto durante il processo di scatto:

Google’s Camera Coach indica all’utente come riquadrare una foto, tra altri consigli di base. Fonte

Essendo un sistema proprietario, e con praticamente zero informazioni disponibili online al riguardo, Camera Coach sembra sfruttare Gemini per aiutare gli utenti a migliorare l’inquadratura (vedi immagine sopra) o apportare piccoli cambiamenti nella posizione (come avvicinarsi o guardare direttamente la fotocamera).

Pertanto, per quanto si può capire, il prodotto spinge la composizione verso la mediana, presumibilmente sulla base di milioni di punti di dati di contenuto caricati che hanno probabilmente contribuito ai dati di addestramento di Gemini. In questo senso, gli utenti che caricano i dati hanno creato il calibro dell’AI rifiutando le foto insoddisfacenti e caricando quelle che piacciono – una forma efficace (e gratuita) di curazione del set di dati!

Tuttavia, le foto che sono “medie” in termini di composizione non possiedono necessariamente gli stessi valori estetici o l’impatto sullo spettatore delle foto che sono memorabili.

Oltre “Cheese!” e la Regola dei Terzi

A questo scopo, e verso un sistema più accessibile su più piattaforme, una nuova ricerca dall’Italia offre un sistema di tipo Coach basato sulla conoscenza precedente di ciò che rende le foto memorabili:

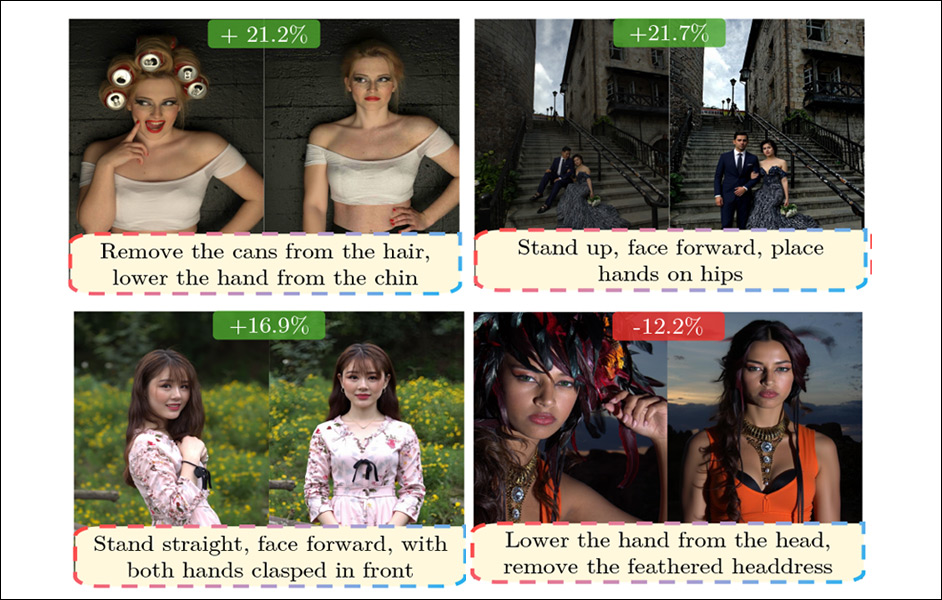

Esempi di consigli forniti dal nuovo sistema degli autori. Fonte

Nell’immagine sopra, vediamo i consigli forniti dal nuovo sistema degli autori – chiamato MemCoach – che è difficile immaginare che un sistema di composizione come Camera Coach possa fornire. Nel primo esempio (a sinistra), il consiglio di rimuovere il copricapo è particolarmente specioso; nella seconda immagine, è difficile capire cosa un sistema di composizione possa trarre da uno scenario generale (ad esempio, una foto “artistica” di una giovane donna sdraiata a terra con gli occhi chiusi).

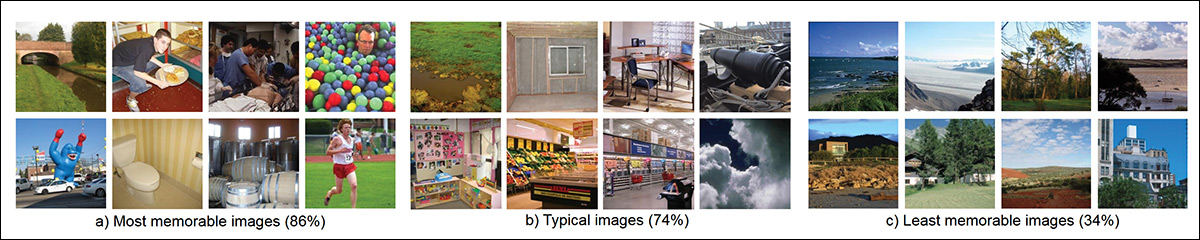

La comprensione fondamentale sulla memorabilità nella fotografia, utilizzata per sviluppare il sistema a tre parti italiano, è tratta da vari lavori precedenti, tra cui il outing Cosa rende un oggetto memorabile? del 2015 e il paper Cosa rende una fotografia memorabile? del 2013.

Dall’articolo del 2013 Cosa rende una fotografia memorabile?, esempi rappresentativi di foto buone, medie e cattive in termini di memorabilità. Fonte

Chiunque, come me, con una data di nascita Unix negativa, probabilmente riconoscerà il modello per le immagini “meno memorabili” (in alto a destra nell’immagine sopra), dalle infinite serate di diapositive che hanno maledetto la nostra infanzia. Come affermano gli autori*:

‘Questi lavori hanno identificato fattori intrinseci chiave come la presenza di persone, scene interne, o espressioni emotive, piuttosto che oggetti e viste panoramiche, nonché fattori estrinseci, tra cui il contesto e l’osservatore.’

Il progetto si concentra sul ‘feedback di memorabilità’ (MemFeed), espresso nell’applicazione tutor MemCoach, e su un benchmark (intitolato MemBench) basato sul set di dati PPR10K.

Dall’articolo PPR10K: A Large-Scale Portrait Photo Retouching Dataset with Human-Region Mask and Group-Level Consistency, campioni diversi del set di dati. La riga superiore mostra le immagini originali, la riga inferiore mostra le versioni ritoccate da esperti con relative maschere di regione umana. Le foto originali variano ampiamente in punto di vista, sfondo, illuminazione e impostazioni della fotocamera, mentre i risultati ritoccati mostrano una qualità visiva migliorata e una maggiore coerenza all’interno di ogni gruppo. Fonte

Gli autori osservano che la memorabilità è quantificabile nelle foto, piuttosto che un registro di giudizi soggettivi, e notano inoltre che la proprietà è stata identificata sia per le foto (in vari lavori) che per i video (in vari altri).

Il nuovo articolo è intitolato How to Take a Memorable Picture? Empowering Users with Actionable Feedback e proviene da quattro ricercatori dell’Università di Trento, dell’Università di Pisa e della Fondazione Bruno Kessler. La pagina del progetto suggerisce che il codice GitHub e i dati ospitati su Hugging Face saranno disponibili il prossimo mese (marzo 2026).

Metodo

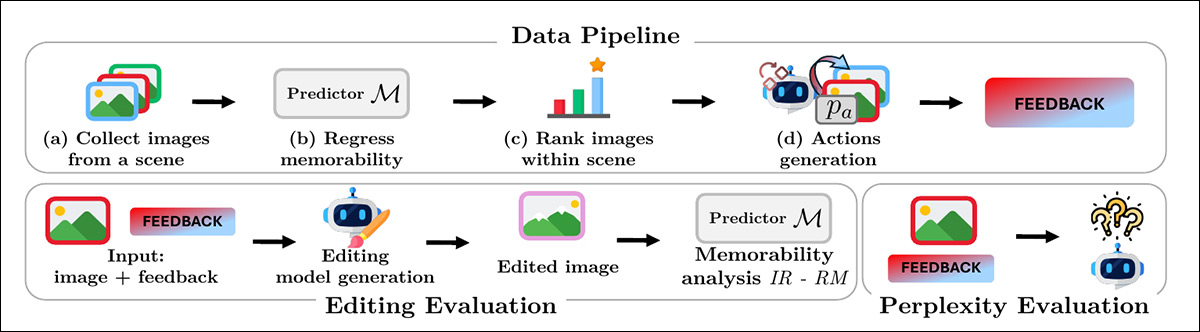

Per curare il set di dati MemBench dal set di dati originale PPR10K, i ricercatori hanno raggruppato le foto per scena e hanno valutato ogni immagine per memorabilità utilizzando un predittore addestrato basato su CLIP funzionalità. Quindi hanno classificato le foto all’interno di ogni scena da meno a più memorabili e le hanno accoppiate di conseguenza:

Panoramica della costruzione e della valutazione di MemBench. La riga superiore rappresenta il flusso di dati, dalla raggruppamento delle immagini per scena e dalla previsione della memorabilità, alla classificazione delle foto e alla generazione di feedback consapevole della memorabilità. La riga inferiore illustra la valutazione, misurando la qualità del feedback attraverso guadagni di memorabilità basati sulla modifica e punteggi di perplessità.

Per ogni coppia, sono state generate descrizioni in linguaggio naturale con il modello InternVL3.5 per spiegare le differenze visibili tra la versione meno memorabile e la più memorabile; e queste descrizioni costituiranno il segnale di addestramento per il sistema di feedback sulla memorabilità.

In contrasto con la logica che sottostà a Google’s Camera Coach, i ricercatori hanno cercato un insieme di interpretazioni più sottili†:

‘Contrariamente agli aggiustamenti della fotografia computazionale che si concentrano sulle correzioni post-hoc (ad esempio, “rendere l’immagine più luminosa”), ci concentriamo su azioni semantiche che un utente può eseguire in tempo reale per una migliore foto, ad esempio “Volgersi l’uno verso l’altro”.’

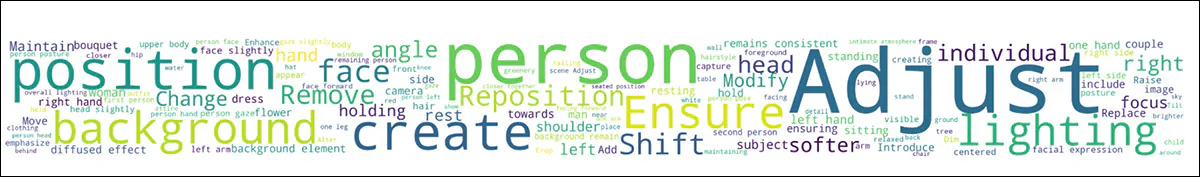

La raccolta finale di MemBench comprende circa 10.000 immagini raggruppate in 1.570 scene, con una media di 6,5 immagini per ogni scena. La nuvola di parole che gli autori hanno generato (vedi immagine sotto) suggerisce un’ampia gamma di categorie semantiche nel set di dati:

Una nuvola di parole dei termini più frequenti in MemBench.

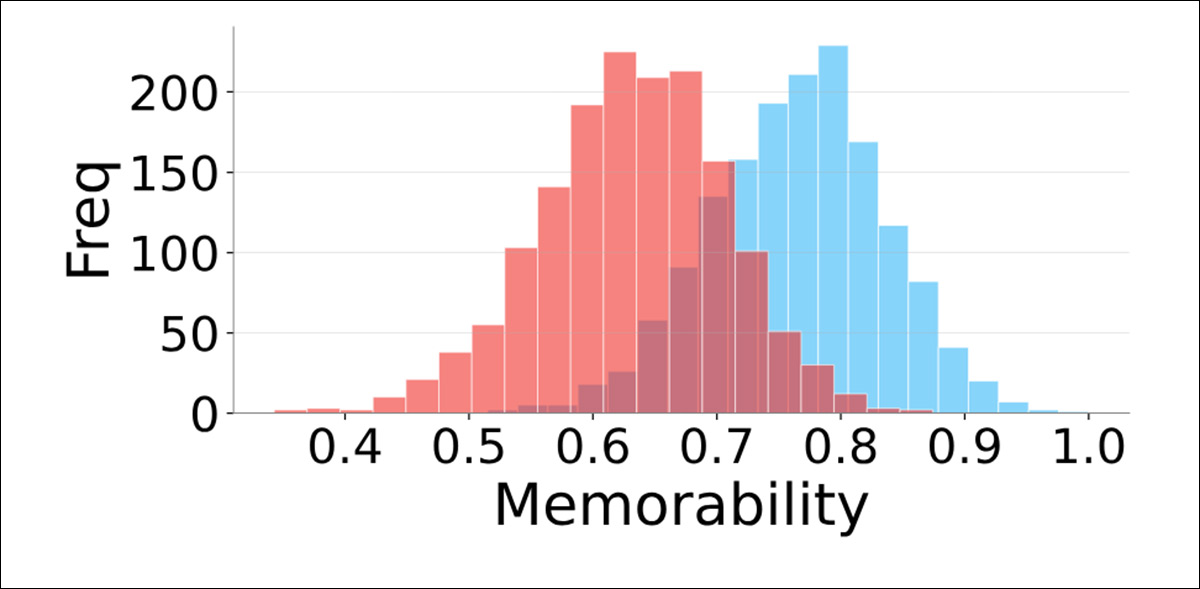

Le foto di origine hanno una valutazione di memorabilità media di 0,63, mentre le foto più memorabili della stessa scena vanno da 0,51 a 1,0, con un sovrapposizione significativa tra i due gruppi:

Distribuzioni dei punteggi di memorabilità che confrontano le immagini meno e più memorabili all’interno di ogni scena.

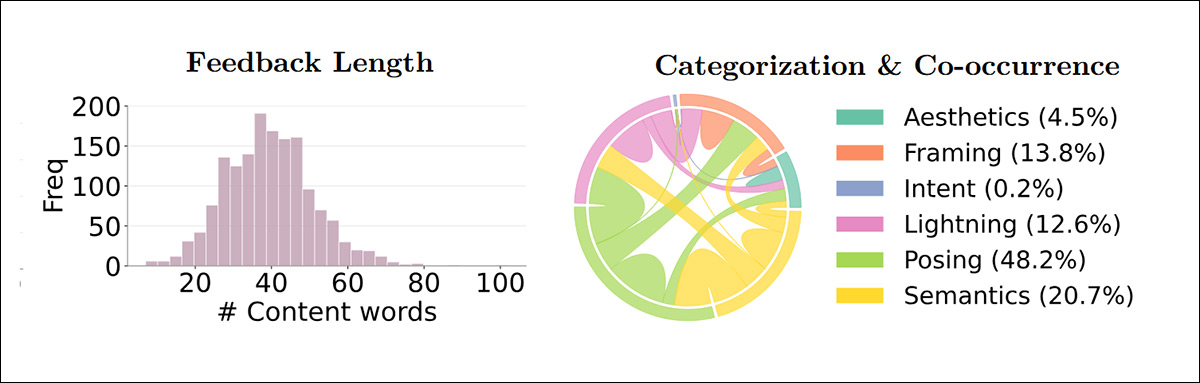

Il feedback stesso varia da brevi note di sette parole a istruzioni più lunghe (a sinistra, nell’immagine sotto). Ogni consiglio è stato quindi suddiviso in piccoli tipi di azione utilizzando GPT-5 Mini (a destra, nell’immagine sotto):

Distribuzione della lunghezza del feedback misurata in parole di contenuto e categorizzazione di azioni atomiche con larghezze di accordo che indicano la frequenza di co-occorrenza tra le categorie.

Gli autori notano che la maggior parte delle suggerimenti si concentra su come il soggetto è posizionato, seguito da modifiche al significato o al contenuto della scena, con l’inquadratura spesso legata alla posizione e gli aggiustamenti dell’illuminazione frequentemente legati a modifiche semantiche.

Flux Capacitor

Per valutare se la memorabilità è aumentata dal feedback, la conformità dell’utente è stata simulata utilizzando il modello generativo FLUX.1 Kontext come proxy per il fotografo. Dato un’immagine di origine e un feedback testuale, una versione modificata è stata generata da Flux che simulava le modifiche suggerite:

Le immagini a sinistra sono reali, dal set di dati, e le immagini a destra (in ogni caso) sono create da Flux, in base al prompt (in giallo, sotto). In questo modo, l’efficacia dei prompt può essere valutata senza un coinvolgimento umano estensivo. Questa conoscenza verrà infine riportata nel framework MemCoach e, in effetti, rappresenta un flusso di lavoro che potrebbe migliorare iterativamente un sistema di questo tipo (ad esempio, alla fine con esempi del mondo reale piuttosto che esempi di Flux).

Sia l’immagine originale che quella modificata sono state passate attraverso un predittore di memorabilità, consentendo la misurazione di quanto spesso la versione modificata abbia ottenuto un punteggio più alto – chiamato Rapporto di Miglioramento – e quanto grande è stato il guadagno rispetto all’immagine di partenza, chiamato Memorabilità Relativa.

La somiglianza con il feedback di riferimento orientato alla memorabilità è stata misurata calcolando la perplessità rispetto alle descrizioni di verità, e una suddivisione 80-20 è stata applicata a livello di scena in modo che il test sia stato eseguito solo su scene che non sono state utilizzate durante l’addestramento.

Stato dell’Arte

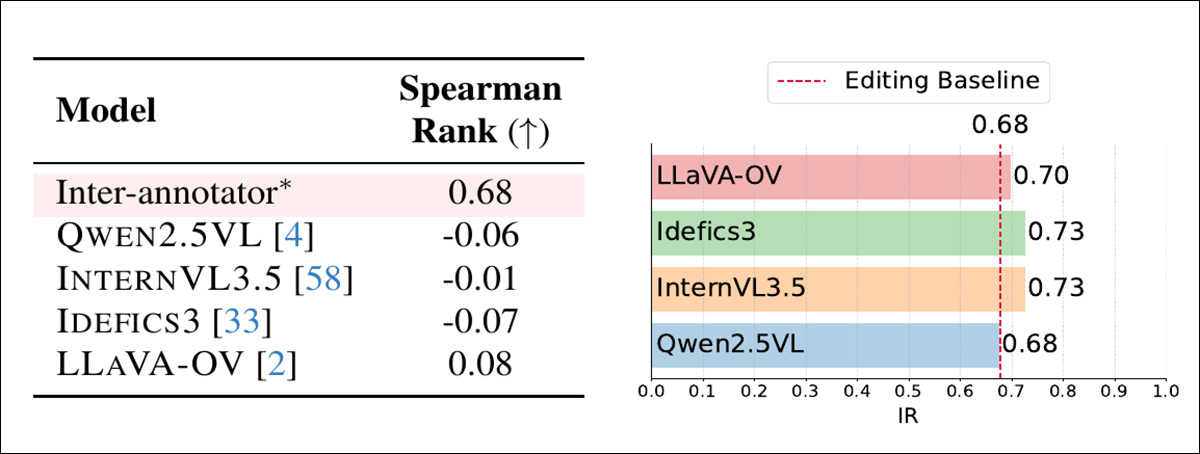

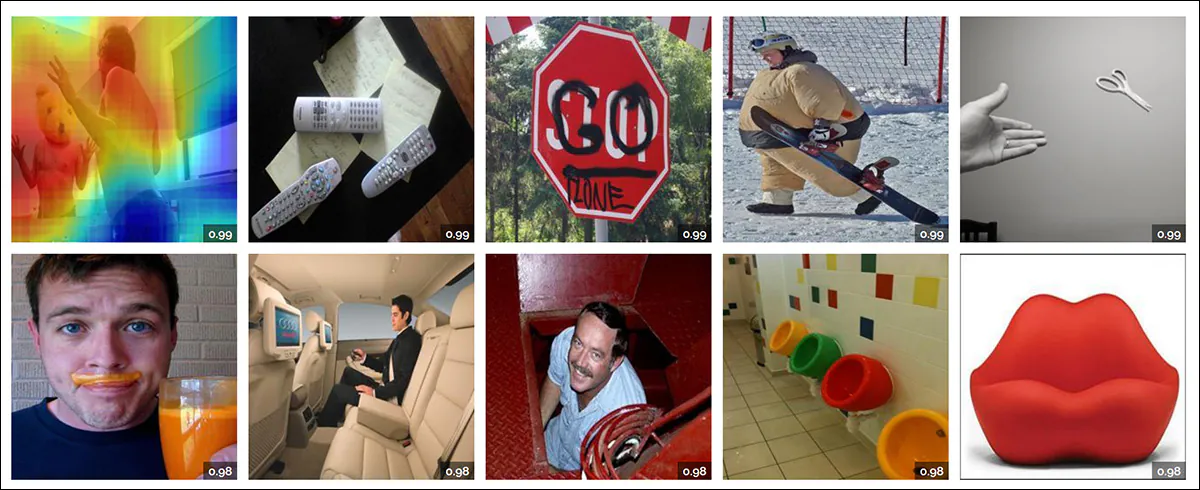

La consapevolezza della memorabilità dei modelli linguistici multimodali attuali è stata testata. Le immagini del set di dati LaMem sono state mostrate a diversi modelli leader, che sono stati chiesti se l’immagine era memorabile. La stima di confidenza del modello è stata quindi confrontata con i punteggi assegnati dagli spettatori umani nello studio originale:

Test che indicano che i modelli multimodali di base non catturano la memorabilità. A sinistra, correlazione di rango di Spearman tra le previsioni del modello e i punteggi di verità di LaMem, con l’accordo tra annotatori di LaMem mostrato a titolo di riferimento. A destra, rapporto di miglioramento raggiunto dal feedback zero-shot rispetto alla linea di base di modifica, mostrando solo guadagni marginali.

Quasi non si è trovata alcuna correlazione significativa con i giudizi umani, e, nonostante l’addestramento su larga scala, gli autori affermano che i modelli non hanno tracciato cosa le persone ricordano costantemente.

Esempi dal set di dati LaMem. In alto a sinistra, vediamo anche una mappa di calore rappresentata per quell’immagine. Fonte

MemCoach

MemCoach si concentra su istruzioni semantiche, on-the-fly che possono essere eseguite prima che lo scatto venga scattato – ad esempio, regolando la posizione, alterando le interazioni tra i soggetti o modificando gli elementi della scena. Il feedback fornito da MemCoach varia da 7 a 102 parole di contenuto. La memorabilità, afferma l’articolo, sembra essere guidata più dalla configurazione del soggetto e dagli indizi narrativi che dalle semplici modifiche compositive:

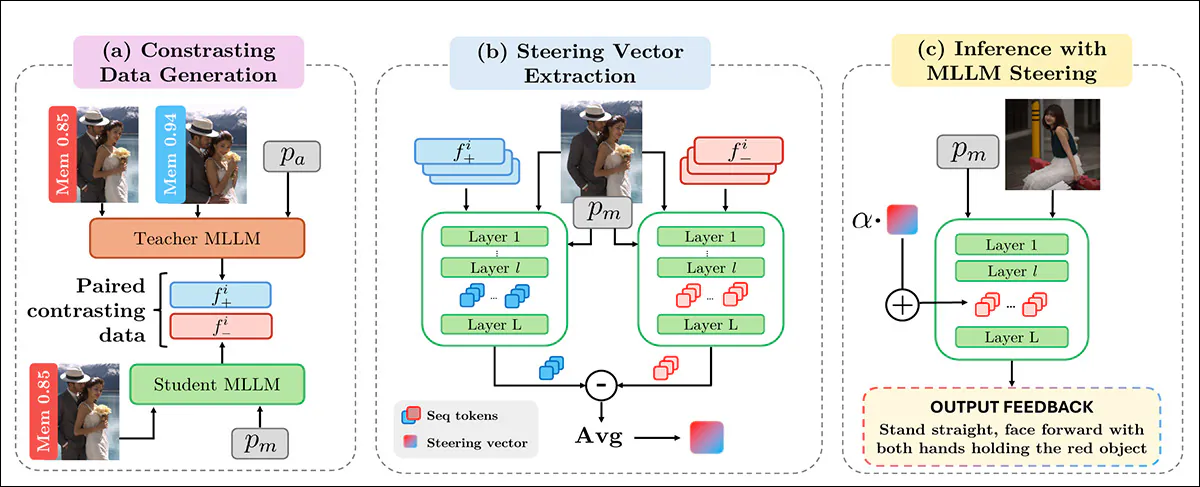

Panoramica della pipeline MemCoach, in cui la guida consapevole della memorabilità di un modello di linguaggio multimodale insegnante è accoppiata con risposte neutrali dello studente per formare dati contrastanti; le differenze di attivazione tra i livelli vengono mediate per derivare un vettore di guida della memorabilità; e quel vettore viene iniettato nell’inferenza per spostare le attivazioni dello studente verso la produzione di feedback migliorato e orientato alla memorabilità, senza ulteriore addestramento.

Test

Sette modelli di linguaggio multimodale (MLLM) sono stati utilizzati nella fase di test per il nuovo sistema: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; e LLaVA-OneVision-1.5. Inoltre, GPT-5 Mini è stato incluso come rappresentante dei modelli proprietari e chiusi, insieme al modello Q-Instruct e al modello AesExpert specializzato nell’estetica. I MLLM hanno operato come oracoli zero-shot e insegnanti.

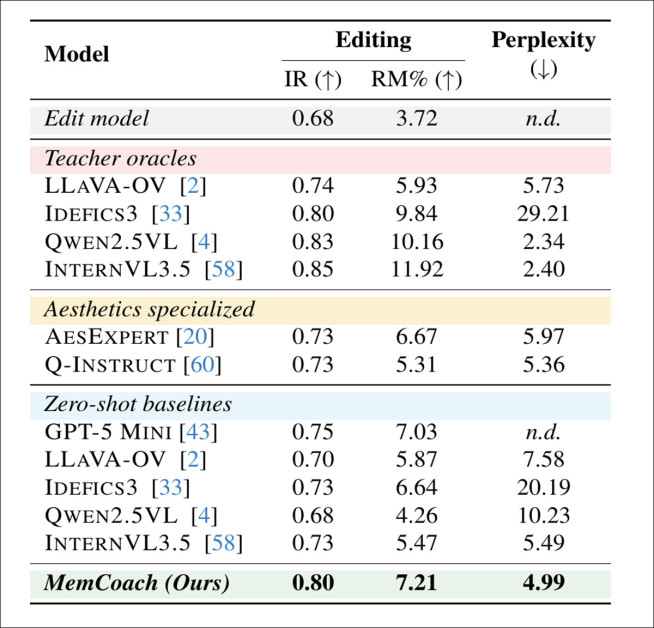

InternVL3.5 è stato utilizzato sia per il modello insegnante che per lo studente, con la suddivisione di addestramento di MemBench utilizzata per creare esempi contrastanti:

Prestazioni di MemCoach in confronto con i MLLM di stato dell’arte attraverso oracoli insegnanti, modelli specializzati nell’estetica e linee di base zero-shot, mostrando un rapporto di miglioramento più alto e una memorabilità relativa competitiva insieme alla perplessità più bassa, indicando un feedback più coerente e orientato alla memorabilità.

Nella tabella del primo test (mostrata sopra), vediamo che MemCoach sembra fornire consigli di memorabilità più efficaci di qualsiasi modello di confronto – e il modello InternVL3.5 guidato aumenta la memorabilità più spesso e di una quantità maggiore, con un guadagno del 5% nel rapporto di miglioramento rispetto a GPT-5 Mini e un balzo del 31,81% nella memorabilità relativa rispetto alla sua versione non guidata.

Inoltre, supera le prestazioni dei sistemi specializzati nell’estetica, nonostante richieda alcun addestramento aggiuntivo. Una perplessità più bassa, afferma l’articolo, suggerisce inoltre che il suo feedback segue gli stessi modelli linguistici che le valutazioni della memorabilità umana tendono a premiare:

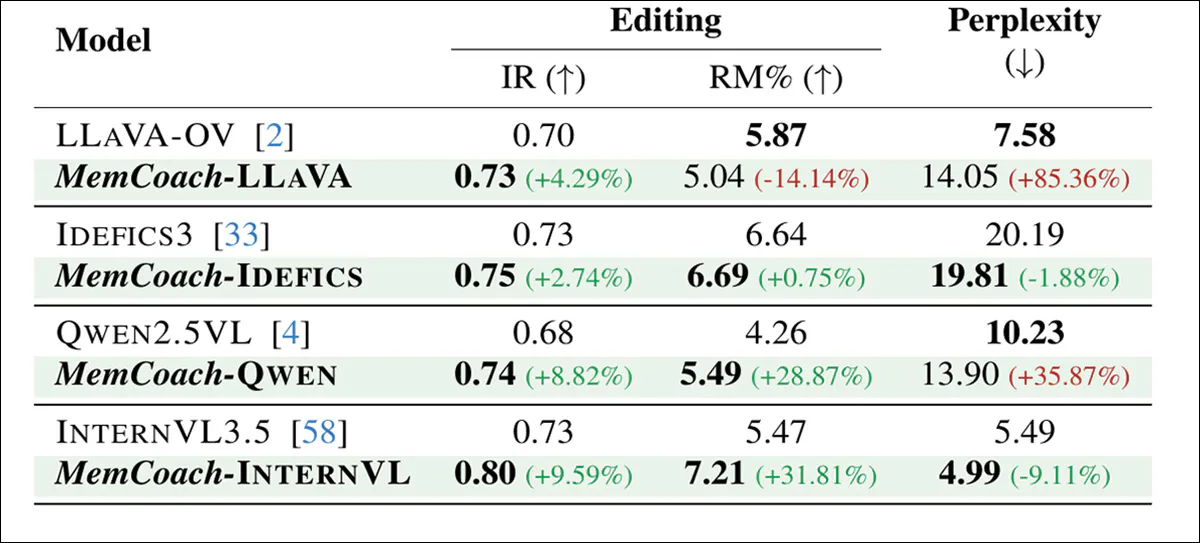

Risultati di generalizzazione che mostrano come MemCoach migliori il feedback orientato alla memorabilità attraverso più scheletri multimodali, aumentando costantemente il rapporto di miglioramento e la memorabilità relativa e riducendo la perplessità per la maggior parte dei modelli.

Un ulteriore test (vedi tabella sopra) indica che l’aggiunta di MemCoach ha migliorato il feedback orientato alla memorabilità attraverso più scheletri multimodali, con guadagni costanti nel rapporto di miglioramento e i più grandi balzi che appaiono per Qwen2.5VL e LLaVA-OV.

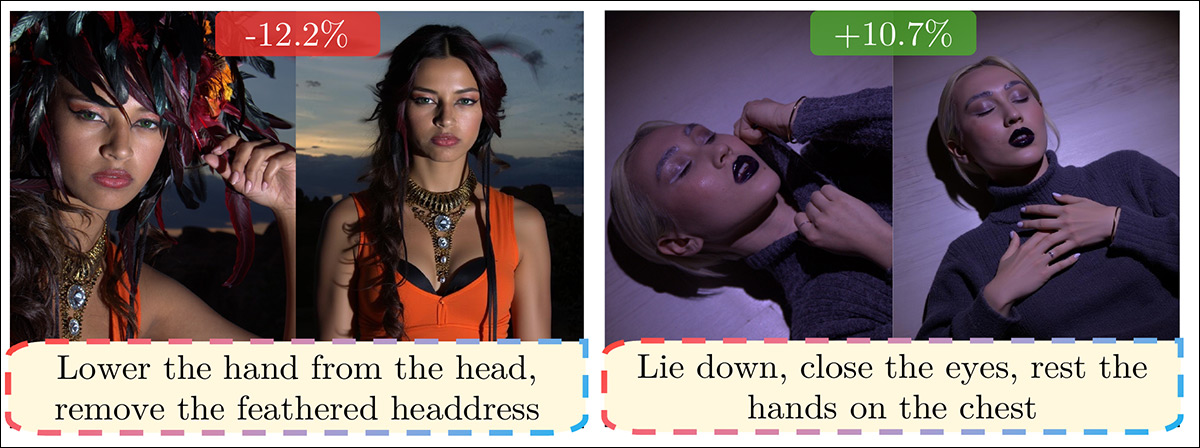

Una valutazione qualitativa è stata quindi condotta, analizzando esempi di feedback di MemCoach in cui l’immagine di origine, la suggerimento in linguaggio naturale e il risultato migliorato immaginato sono stati esaminati affiancati:

Esempi qualitativi di feedback orientato alla memorabilità generato da MemCoach. Ogni tripletta mostra l’immagine di origine, l’istruzione in linguaggio naturale e l’immagine modificata risultante, con la Memorabilità Relativa (RM) che indica il cambiamento misurato. La guida varia da regolazioni della posizione e dello sguardo a interventi semantici come la rimozione di oggetti, illustrando sia guadagni di successo che casi in cui la rimozione di elementi insoliti riduce la memorabilità.

Di questi risultati, gli autori affermano:

‘Gli esempi mettono in evidenza la varietà di suggerimenti che il modello propone, che vanno da regolazioni compositive fine-grane, come alterare la direzione dello sguardo, la posizione o la posizione della mano, a interventi semantici che coinvolgono la rimozione di oggetti o il cambiamento dell’espressione facciale. ‘

‘Il feedback è naturalmente interpretabile e azionabile, espresso in istruzioni testuali concise (per lo più coinvolgendo verbi “Porta”, “Sta”, “Rimuovi”) che possono essere implementate direttamente, verbalizzando efficacemente come scattare una foto memorabile.’

Conclusione

Sarebbe molto interessante confrontare la metodologia dell’approccio chiuso di Google con il progetto MemBench – non da ultimo per sapere quali standard centrali, riferimenti e database Google ha utilizzato per definire gli standard estetici del sistema.

L’aspetto negativo dei sistemi di questo tipo, open source o closed source, è che su larga scala rischiano di imporre standard uniformi destinati a diventare meme e cliché – una sorta di equivalente visivo delle discussioni sull’em-dash dell’AI, in cui la procedura “corretta” è diventata un po’ maledetta nell’uso casuale.

* La mia conversione delle citazioni in linea degli autori in collegamenti ipertestuali, se il collegamento non è presentato altrove nell’articolo.

† L’articolo si riferisce qui, come in diversi altri punti, a “materiale supplementare” che non sono in grado di trovare, sia dall’articolo, dalla lista principale di Arxiv, sia dal sito del progetto.

Pubblicato per la prima volta giovedì 26 febbraio 2026