Intelligenza Artificiale

I rilevatori di deepfake perseguono un nuovo terreno: modelli di diffusione latente e GAN

Opinione

Di recente, la comunità di ricerca sul rilevamento dei deepfake, che dalla fine del 2017 si è occupata quasi esclusivamente del codificatore automaticobasato su un framework che ha debuttato in quel momento con tale stupore pubblico (e sgomento), ha iniziato a interessarsi forense alle architetture meno stagnanti, tra cui diffusione latente modelli come DALL-MI2 Diffusione stabile, così come l'output di Generative Adversarial Networks (GAN). Ad esempio, a giugno, UC Berkeley pubblicato i risultati della sua ricerca sullo sviluppo di un rilevatore per l'uscita dell'allora dominante DALL-E 2.

Ciò che sembra guidare questo crescente interesse è l'improvviso salto evolutivo nella capacità e nella disponibilità di modelli di diffusione latente nel 2022, con il closed-source e l'accesso limitato rilasciare di DALL-E 2 in primavera, seguito a fine estate dal sensazionale approvvigionamento aperto di diffusione stabile da stabilità.ai.

Anche i GAN lo sono stati lungamente studiato in questo contesto, anche se meno intensamente, poiché lo è molto difficile usarli per ricreazioni convincenti ed elaborate basate su video di persone; almeno, rispetto agli ormai venerabili pacchetti di autoencoder come Cambia faccia DeepFaceLab – e il cugino di quest'ultimo in streaming live, DeepFace dal vivo.

Immagini in movimento

In entrambi i casi, il fattore galvanizzante sembra essere la prospettiva di un successivo sprint di sviluppo per video sintesi. L'inizio di ottobre – e la stagione delle principali conferenze del 2022 – è stato caratterizzato da una valanga di soluzioni improvvise e inaspettate a vari problemi di lunga data della sintesi video: non appena Facebook campioni rilasciati della propria piattaforma text-to-video, Google Research ha rapidamente soffocato quel plauso iniziale annunciando la sua nuova architettura T2V Imagen-to-Video, in grado di produrre filmati ad alta risoluzione (anche se solo tramite una rete a 7 livelli di upscaler).

Se credi che questo tipo di cose arrivino in tre, considera anche l'enigmatica promessa di stability.ai che "il video arriverà" su Stable Diffusion, apparentemente più avanti quest'anno, mentre Runway, co-sviluppatore di Stable Diffusion, ha fatto una promessa simile, anche se non è chiaro se si riferiscano allo stesso sistema. IL Messaggio di discordia dal CEO di Stability Emad Mostaque ha anche promesso 'audio, video [e] 3d'.

Cosa con un'offerta improvvisa di diversi nuovi framework di generazione audio (alcuni basati sulla diffusione latente) e un nuovo modello di diffusione che può generare autentico movimento del personaggio, l'idea che framework "statici" come GAN e diffusori prenderanno finalmente il loro posto come supporto coadiuvanti ai framework di animazione esterni sta iniziando a guadagnare terreno.

In breve, sembra probabile che il mondo ostacolato dei deepfake video basati su autoencoder, che possono solo sostituire efficacemente il porzione centrale di una faccia, potrebbe a questo punto il prossimo anno essere eclissato da una nuova generazione di tecnologie basate sulla diffusione basate su deepfake: approcci popolari e open source con il potenziale per falsificare fotorealisticamente non solo interi corpi, ma intere scene.

Per questo motivo, forse, la comunità di ricerca anti-deepfake sta iniziando a prendere sul serio la sintesi di immagini e a rendersi conto che potrebbe servire a più fini che generare false foto del profilo LinkedIn; e che se tutti i loro intrattabili spazi latenti possono compiere in termini di movimento temporale è quello agire come un ottimo renderer di texture, potrebbe effettivamente essere più che sufficiente.

Blade Runner

Gli ultimi due documenti per affrontare, rispettivamente, la diffusione latente e il rilevamento di deepfake basato su GAN, sono, rispettivamente, DE-FAKE: rilevamento e attribuzione di immagini false generate da modelli di diffusione testo-immagine, una collaborazione tra il CISPA Helmholtz Center for Information Security e Salesforce; E BLADERUNNER: contromisura rapida per facce StyleGAN sintetiche (generate da AI)., di Adam Dorian Wong del Lincoln Laboratory del MIT.

Prima di spiegare il nuovo metodo, l'ultimo articolo si sofferma ad esaminare gli approcci precedenti per determinare se un'immagine è stata generata o meno da una GAN (l'articolo tratta specificamente della famiglia StyleGAN di NVIDIA).

Il metodo 'Brady Bunch' – forse un riferimento senza senso per chiunque non guardasse la TV negli anni '1970 o si fosse perso gli adattamenti cinematografici degli anni '1990, identifica i contenuti falsificati da GAN in base alle posizioni fisse che determinate parti di un volto GAN sono destinate a occupare, a causa della natura meccanica e prestabilita del "processo di produzione".

Il metodo "Brady Bunch" proposto da un webcast dell'istituto SANS nel 2022: un generatore di volti basato su GAN eseguirà un posizionamento incredibilmente uniforme di alcuni tratti del viso, smentendo in alcuni casi l'origine della foto. Fonte: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

Un'altra utile indicazione nota è la frequente incapacità di StyleGAN di riprodurre più volti (prima immagine in basso), se necessario, nonché la sua mancanza di talento nel coordinamento degli accessori (immagine centrale in basso) e la tendenza a usare l'attaccatura dei capelli come punto di partenza per un cappello improvvisato (terza immagine in basso).

Il terzo metodo su cui il ricercatore attira l'attenzione è sovrapposizione di foto (un esempio del quale può essere visto in il nostro articolo di agosto sulla diagnosi dei disturbi mentali assistita dall'intelligenza artificiale), che utilizza software di "fusione di immagini" compositive come la serie CombineZ per concatenare più immagini in un'unica immagine, rivelando spesso elementi comuni sottostanti nella struttura, una potenziale indicazione di sintesi.

L'architettura proposta nel nuovo documento è intitolata (forse contro tutti i consigli SEO) Blade Runner, facendo riferimento a Test di Voight-Kampff che determina se gli antagonisti del franchise di fantascienza sono "falsi" o meno.

La pipeline è composta da due fasi, la prima delle quali è l'analizzatore PapersPlease, che può valutare i dati ricavati da noti siti Web GAN-face come thispersondoesnotexist.com o generated.photos.

Sebbene sia possibile ispezionare una versione ridotta del codice su GitHub (vedi sotto), vengono forniti pochi dettagli su questo modulo, ad eccezione di OpenCV e DLIB sono usati per delineare e rilevare i volti nel materiale raccolto.

Il secondo modulo è il Tra di noi Rilevatore. Il sistema è progettato per ricercare il posizionamento coordinato degli occhi nelle foto, una caratteristica persistente dell'output facciale di StyleGAN, esemplificata nello scenario "La famiglia Brady" descritto sopra. AmongUs è alimentato da un rilevatore standard a 68 punti di riferimento.

Annotazioni dei punti facciali tramite l'Intelligent Behavior Understanding Group (IBUG), il cui codice di tracciamento dei punti di riferimento facciali viene utilizzato nel pacchetto Blade Runner.

AmongUs si basa su punti di riferimento pre-addestrati basati sulle coordinate note del "brady bunch" di PapersPlease ed è concepito per essere utilizzato su campioni live, rivolti al web, di immagini facciali basate su StyleGAN.

Blade Runner, suggerisce l'autore, è una soluzione plug-and-play pensata per aziende o organizzazioni che non dispongono delle risorse necessarie per sviluppare internamente soluzioni per il tipo di rilevamento dei deepfake qui trattato, nonché una "misura tampone per guadagnare tempo in vista di contromisure più permanenti".

Infatti, in un settore della sicurezza così volatile e in rapida crescita, non ce ne sono molti su misura or soluzioni di fornitori cloud preconfezionati a cui un'azienda con risorse insufficienti può attualmente rivolgersi con fiducia.

Anche se Blade Runner si comporta male contro occhialuto Persone contraffatte da StyleGAN, questo è un problema relativamente comune in sistemi simili, che si aspettano di essere in grado di valutare le delineazioni degli occhi come punti di riferimento fondamentali, oscurati in tali casi.

Una versione ridotta di Blade Runner è stata rilasciato all'open source su GitHub. Esiste una versione proprietaria più ricca di funzionalità, che può elaborare più foto, piuttosto che la singola foto per operazione del repository open source. L'autore intende, dice, aggiornare la versione GitHub allo stesso standard alla fine, se il tempo lo consente. Ammette inoltre che è probabile che StyleGAN si evolva oltre le sue debolezze note o attuali e che anche il software dovrà svilupparsi in tandem.

DE-FALSO

L'architettura DE-FAKE mira non solo a raggiungere il "rilevamento universale" per le immagini prodotte dai modelli di diffusione testo-immagine, ma a fornire un metodo per discernere quale Il modello di diffusione latente (LD) ha prodotto l'immagine.

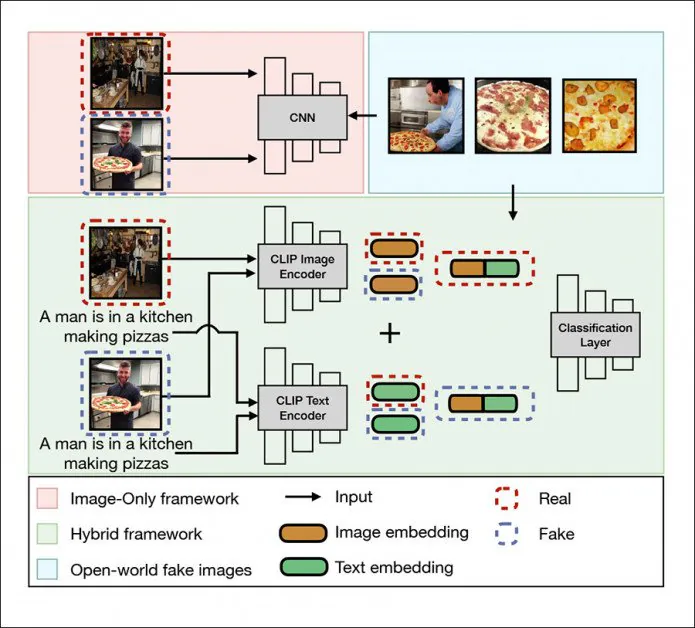

Il framework di rilevamento universale in DE-FAKE si rivolge a immagini locali, un framework ibrido (verde) e immagini open world (blu). Fonte: http://export.arxiv.org/pdf/2210.06998

A dire il vero, al momento, si tratta di un compito abbastanza facile, dal momento che tutti i modelli LD diffusi – closed o open source – hanno notevoli caratteristiche distintive.

Inoltre, la maggior parte condivide alcune debolezze comuni, come la predisposizione a tagliare le teste, a causa del modo arbitrario che le immagini non quadrate ricavate dal Web vengano inserite negli enormi set di dati che alimentano sistemi come DALL-E 2, Stable Diffusion e MidJourney:

I modelli di diffusione latente, come tutti i modelli di visione artificiale, richiedono input in formato quadrato; tuttavia, il web scraping aggregato che alimenta il dataset LAION5B non offre "extra di lusso" come la capacità di riconoscere e mettere a fuoco i volti (o qualsiasi altra cosa), e tronca le immagini in modo piuttosto brutale anziché "riempirle" (il che manterrebbe l'intera immagine sorgente, ma a una risoluzione inferiore). Una volta addestrati, questi "ritagli" vengono normalizzati e si verificano molto frequentemente nell'output di sistemi di diffusione latente come Stable Diffusion. Fonti: https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac e diffusione stabile.

DE-FAKE intende essere indipendente dagli algoritmi, un obiettivo a lungo accarezzato dai ricercatori anti-deepfake dell'autoencoder e, in questo momento, abbastanza realizzabile per quanto riguarda i sistemi LD.

L'architettura utilizza il Contrastive Language-Image Pretraining di OpenAI (CLIP) libreria multimodale – un elemento essenziale nella diffusione stabile e che sta rapidamente diventando il cuore della nuova ondata di sistemi di sintesi di immagini/video – come un modo per estrarre incorporamenti da immagini LD "contraffatte" e addestrare un classificatore sui modelli e sulle classi osservati.

In uno scenario più "black box", in cui i blocchi PNG che contengono informazioni sul processo di generazione sono stati da tempo eliminati dai processi di caricamento e per altri motivi, i ricercatori utilizzano Salesforce Struttura BLIP (anche un componente in almeno una distribuzione di diffusione stabile) per interrogare "alla cieca" le immagini sulla probabile struttura semantica dei prompt che le hanno create.

I ricercatori hanno utilizzato Stable Diffusion, Latent Diffusion (a sua volta un prodotto discreto), GLIDE e DALL-E 2 per popolare un set di dati di addestramento e test sfruttando MSCOCO e Flickr30k.

Normalmente esamineremmo in modo piuttosto approfondito i risultati degli esperimenti dei ricercatori per un nuovo framework; ma in realtà, i risultati di DE-FAKE sembrano più utili come punto di riferimento futuro per iterazioni successive e progetti simili, piuttosto che come metrica significativa del successo del progetto, considerando l'ambiente volatile in cui opera e il fatto che il sistema con cui compete nelle prove dell'articolo ha quasi tre anni, ovvero da quando la scena della sintesi delle immagini era davvero agli albori.

Le due immagini più a sinistra: il framework precedente "sfidato", creato nel 2019, che prevedibilmente ha avuto risultati peggiori rispetto a DE-FAKE (le due immagini più a destra) nei quattro sistemi LD testati.

I risultati del team sono estremamente positivi per due motivi: non esiste alcun lavoro precedente con cui confrontarli (e nessuno che offra un confronto equo, vale a dire che copra solo le dodici settimane trascorse da quando Stable Diffusion è stato rilasciato come open source).

In secondo luogo, come accennato in precedenza, sebbene il campo della sintesi di immagini LD si stia sviluppando a una velocità esponenziale, il contenuto di output delle offerte attuali si contrappone effettivamente a causa delle proprie carenze ed eccentricità strutturali (e molto prevedibili), molte delle quali probabilmente verranno risolte, almeno nel caso di Stable Diffusion, dal rilascio del checkpoint 1.5 più performante (ovvero il modello addestrato da 4GB che alimenta il sistema).

Allo stesso tempo, Stability ha già indicato di avere una chiara tabella di marcia per V2 e V3 del sistema. Alla luce degli eventi che hanno fatto notizia negli ultimi tre mesi, è probabile che qualsiasi torpore aziendale da parte di OpenAI e di altri attori concorrenti nello spazio della sintesi delle immagini sia svanito, il che significa che possiamo aspettarci un ritmo di progresso altrettanto rapido anche nel spazio di sintesi di immagini a sorgente chiuso.

Pubblicato per la prima volta il 14 ottobre 2022.