Le meilleur

10 Meilleurs Algorithmes d’Apprentissage Automatique

Bien que nous vivions une époque d’innovation extraordinaire dans l’apprentissage automatique accéléré par GPU, les dernières publications de recherche présentent fréquemment (et de manière très visible) des algorithmes qui datent de plusieurs décennies, voire de 70 ans dans certains cas.

Certains pourraient affirmer que de nombreuses méthodes anciennes relèvent davantage de l’analyse statistique que de l’apprentissage automatique et préfèrent dater l’avènement du secteur à 1957, avec l’invention du Perceptron.

Étant donné la mesure dans laquelle ces algorithmes anciens soutiennent et sont intégrés aux dernières tendances et aux développements à sensation dans l’apprentissage automatique, il s’agit d’une position contestable. Alors, examinons certains des « blocs de construction classiques » sous-jacents aux dernières innovations, ainsi que certains nouveaux venus qui font une demande précoce pour la renommée de l’IA.

1 : Transformateurs

En 2017, la recherche de Google a mené une collaboration de recherche aboutissant à la publication Attention Is All You Need. Le travail a présenté une nouvelle architecture qui a promu les mécanismes d’attention de « tuyauterie » dans les modèles de réseau récurrent et les modèles de codage/décodage à une technologie de transformation centrale en soi.

L’approche a été baptisée Transformateur, et est devenue une méthodologie révolutionnaire dans le traitement automatique des langues (TAL), alimentant, entre autres exemples, le modèle de langage autoregressif et l’enfant prodige de l’IA GPT-3.

Les transformateurs ont élégamment résolu le problème de transduction de séquence, également appelé « transformation », qui est occupé par le traitement de séquences d’entrée en séquences de sortie. Un transformateur reçoit également et gère les données de manière continue, plutôt que par lots séquentiels, permettant une « persistance de mémoire » que les architectures RNN ne sont pas conçues pour obtenir. Pour une vue d’ensemble plus détaillée des transformateurs, consultez notre article de référence.

Contrairement aux réseaux de neurones récurrents (RNN) qui avaient commencé à dominer la recherche en apprentissage automatique à l’ère CUDA, l’architecture des transformateurs pouvait également être facilement parallélisée, ouvrant la voie à une prise en charge productive d’un corpus de données beaucoup plus important que les RNN.

Utilisation populaire

Les transformateurs ont captivé l’imagination du public en 2020 avec la sortie de GPT-3 d’OpenAI, qui affichait un record de 175 milliards de paramètres à l’époque. Cette réalisation apparemment étonnante a été ultérieurement éclipsée par des projets ultérieurs, tels que la sortie de Megatron-Turing NLG 530B de Microsoft en 2021, qui (comme le suggère le nom) comporte plus de 530 milliards de paramètres.

Une chronologie des projets TAL hyperscale basés sur les transformateurs. Source : Microsoft

L’architecture des transformateurs a également franchi le pas de la TAL à la vision par ordinateur, alimentant une nouvelle génération de cadres de synthèse d’images tels que CLIP et DALL-E d’OpenAI, qui utilisent le mappage de domaine texte>image pour terminer les images incomplètes et synthétiser de nouvelles images à partir de domaines formés, parmi un nombre croissant d’applications connexes.

DALL-E tente de compléter une image partielle d’un buste de Platon. Source : https://openai.com/blog/dall-e/

2 : Réseaux antagonistes génératifs (GAN)

Bien que les transformateurs aient obtenu une couverture médiatique extraordinaire grâce à la sortie et à l’adoption de GPT-3, le Réseau antagoniste génératif (GAN) est devenu une marque reconnaissable en soi, et pourrait finalement rejoindre deepfake en tant que verbe.

Proposé pour la première fois en 2014 et principalement utilisé pour la synthèse d’images, une architecture de Réseau antagoniste génératif est composée d’un Générateur et d’un Discriminateur. Le Générateur parcourt des milliers d’images dans un ensemble de données, en tentant de les reconstruire de manière itérative. Pour chaque tentative, le Discriminateur évalue le travail du Générateur et le renvoie pour qu’il fasse mieux, sans lui donner d’indices sur la façon dont la reconstruction précédente a erré.

Source : https://developers.google.com/machine-learning/gan/gan_structure

Cela oblige le Générateur à explorer une multiplicité de voies, au lieu de suivre les culs-de-sac potentiels qui auraient résulté si le Discriminateur lui avait indiqué où il se trompait (voir #8 ci-dessous). Lorsque la formation est terminée, le Générateur a une carte détaillée et complète des relations entre les points de l’ensemble de données.

De l’article Amélioration de l’équilibre GAN en augmentant la conscience spatiale : un cadre novateur parcourt l’espace latent parfois mystérieux d’un GAN, fournissant une instrumentation réactive pour une architecture de synthèse d’images. Source : https://genforce.github.io/eqgan/

Par analogie, c’est la différence entre apprendre un trajet monotone pour le centre de Londres ou acquérir La Connaissance.

Le résultat est une collection de haut niveau de caractéristiques dans l’espace latent du modèle formé. L’indicateur sémantique d’une caractéristique de haut niveau pourrait être « personne », tandis qu’une descente dans la spécificité liée à la caractéristique peut découvrir d’autres caractéristiques apprises, telles que « mâle » et « femelle ». À des niveaux inférieurs, les sous-caractéristiques peuvent se décomposer en « blonde », « caucasienne », etc.

L’entanglement est un problème notable dans l’espace latent des GAN et des cadres de codage/décodage : est-ce que le sourire sur un visage généré par GAN est une caractéristique entrelacée de son « identité » dans l’espace latent, ou est-ce une branche parallèle ?

Visages générés par GAN à partir de thispersondoesnotexist. Source : https://this-person-does-not-exist.com/en

Les deux dernières années ont vu apparaître un nombre croissant de nouvelles initiatives de recherche à cet égard, qui pourraient peut-être ouvrir la voie à une édition au niveau des caractéristiques, à la manière de Photoshop, pour l’espace latent d’un GAN, mais pour l’instant, de nombreuses transformations sont effectivement des « tout ou rien ».

Notamment, la sortie EditGAN de NVIDIA à la fin de 2021 atteint un niveau élevé d’interprétabilité dans l’espace latent en utilisant des masques de segmentation sémantique.

Utilisation populaire

Outre leur implication (en réalité assez limitée) dans les vidéos de deepfake populaires, les GAN axés sur les images/vidéos ont proliféré au cours des quatre dernières années, enchantant les chercheurs et le public. Il est difficile de suivre le rythme et la fréquence des nouvelles sorties, bien que le référentiel GitHub Applications GAN incroyables vise à fournir une liste complète.

Les Réseaux antagonistes génératifs peuvent en théorie dériver des caractéristiques de tout domaine bien défini, y compris le texte.

3 : SVM

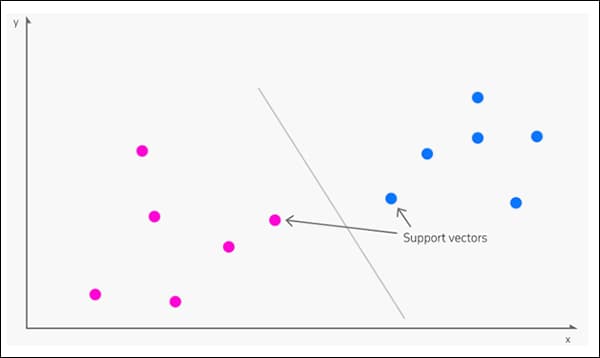

Originaire de 1963, la Machine à vecteurs de support (SVM) est un algorithme de base qui apparaît fréquemment dans les nouvelles publications de recherche. Sous SVM, les vecteurs cartographient la disposition relative des points de données dans un ensemble de données, tandis que les vecteurs de support délimitent les limites entre différents groupes, caractéristiques ou traits.

Les vecteurs de support définissent les limites entre les groupes. Source : https://www.kdnuggets.com/2016/07/support-vector-machines-simple-explanation.html

La limite dérivée est appelée hyperplan.

À des niveaux de caractéristiques faibles, le SVM est bidimensionnel (image ci-dessus), mais lorsqu’il y a un nombre plus élevé de groupes ou de types reconnus, il devient tridimensionnel.

Un ensemble plus profond de points et de groupes nécessite un SVM tridimensionnel. Source : https://cml.rhul.ac.uk/svm.html

Utilisation populaire

Puisque les Machines à vecteurs de support peuvent aborder de manière effective et agnostique des données à haute dimension de divers types, elles apparaissent largement dans une variété de secteurs d’apprentissage automatique, notamment la détection de deepfake, la classification d’images, la classification de discours de haine, l’analyse de l’ADN et la prévision de la structure de population, entre autres.

4 : Regroupement K-Means

Le regroupement en général est une approche d’apprentissage non supervisée qui vise à catégoriser les données en fonction de l’estimation de la densité, créant une carte de la distribution des données étudiées.

Le regroupement K-Means divise les segments, les groupes et les communautés dans les données. Source : https://aws.amazon.com/blogs/machine-learning/k-means-clustering-with-amazon-sagemaker/

Le regroupement K-Means est devenu la mise en œuvre la plus populaire de cette approche, guidant les points de données dans des « groupes K » distincts, qui peuvent indiquer des secteurs démographiques, des communautés en ligne ou toute autre agrégation secrète en attente d’être découverte dans les données statistiques brutes.

Des grappes se forment dans l’analyse K-Means. Source : https://www.geeksforgeeks.org/ml-determine-the-optimal-value-of-k-in-k-means-clustering/

La valeur K elle-même est le facteur déterminant de l’utilité du processus et de l’établissement d’une valeur optimale pour un regroupement. Initialement, la valeur K est attribuée de manière aléatoire, et ses caractéristiques et caractéristiques vectorielles sont comparées à celles de ses voisins. Les voisins qui ressemblent le plus au point de données ayant la valeur K attribuée de manière aléatoire sont attribués à son regroupement de manière itérative jusqu’à ce que les données aient produit tous les regroupements que le processus permet.

Le tracé de l’erreur au carré, ou « coût » des valeurs différentes entre les grappes révélera un point de coude pour les données :

Le point de coude dans un graphique de regroupement. Source : https://www.scikit-yb.org/en/latest/api/cluster/elbow.html

Le point de coude est similaire au concept de la façon dont la perte se stabilise à des rendements décroissants à la fin d’une session de formation pour un ensemble de données. Il représente le point auquel aucune distinction supplémentaire entre les groupes ne sera apparente, indiquant le moment de passer à des phases ultérieures du pipeline de données ou de signaler les résultats.

Utilisation populaire

Le regroupement K-Means, pour des raisons évidentes, est une technologie principale dans l’analyse des clients, car il offre une méthodologie claire et explicative pour traduire de grandes quantités d’enregistrements commerciaux en aperçus démographiques et « leads ».

En dehors de cette application, le regroupement K-Means est également utilisé pour la prévision des glissements de terrain, la segmentation d’images médicales, la synthèse d’images avec GAN, la classification de documents et la planification urbaine, entre autres utilisations potentielles et réelles.

5 : Forêt aléatoire

La Forêt aléatoire est une méthode d’apprentissage d’ensemble qui moyenne le résultat d’un tableau de arbres de décision pour établir une prédiction globale du résultat.

Source : https://www.tutorialandexample.com/wp-content/uploads/2019/10/Decision-Trees-Root-Node.png

Si vous avez effectué des recherches, même en regardant simplement la trilogie Retour vers le futur, un arbre de décision est relativement facile à conceptualiser : un certain nombre de chemins s’offrent à vous, et chaque chemin se divise en un nouveau résultat qui à son tour contient d’autres chemins possibles.

Dans l’apprentissage par renforcement, vous pourriez reculer d’un chemin et recommencer à partir d’une position antérieure, tandis que les arbres de décision s’engagent dans leurs voyages.

Ainsi, l’algorithme de Forêt aléatoire est essentiellement un pari réparti pour les décisions. L’algorithme est appelé « aléatoire » car il effectue des ad hoc sélections et observations pour comprendre la médiane somme des résultats de l’arbre de décision.

Puisqu’il prend en compte une multiplicité de facteurs, une approche de Forêt aléatoire peut être plus difficile à convertir en graphiques significatifs qu’un arbre de décision, mais est susceptible d’être nettement plus productive.

Les arbres de décision sont sujets à la surajustement, où les résultats obtenus sont spécifiques aux données et ne sont pas susceptibles de se généraliser. La sélection aléatoire de la Forêt aléatoire combat cette tendance, en perçant jusqu’aux tendances représentatives et utiles dans les données.

Régression d’arbre de décision. Source : https://scikit-learn.org/stable/auto_examples/tree/plot_tree_regression.html

Utilisation populaire

Comme pour de nombreux algorithmes de cette liste, la Forêt aléatoire fonctionne généralement comme un « premier » trieuse et filtre de données, et apparaît donc régulièrement dans les nouvelles publications de recherche. Des exemples d’utilisation de la Forêt aléatoire incluent la synthèse d’images de résonance magnétique, la prévision du prix du Bitcoin, la segmentation des données du recensement, la classification de texte et la détection de la fraude aux cartes de crédit.

Puisque la Forêt aléatoire est un algorithme de bas niveau dans les architectures d’apprentissage automatique, elle peut également contribuer aux performances d’autres méthodes de bas niveau, ainsi qu’aux algorithmes de visualisation, notamment la regroupement inductif, la transformation de caractéristiques, la classification de documents de texte en utilisant des caractéristiques éparses et l’affichage des pipelines.

6 : Naive Bayes

Couplé avec l’estimation de densité (voir 4 ci-dessus), un classificateur Naive Bayes est un algorithme puissant mais relativement léger capable d’estimer les probabilités en fonction des caractéristiques calculées des données.

Relations entre les caractéristiques dans un classificateur Naive Bayes. Source : https://www.sciencedirect.com/topics/computer-science/naive-bayes-model

Le terme « naïf » fait référence à l’hypothèse dans le théorème de Bayes selon laquelle les caractéristiques sont sans rapport, connu sous le nom de indépendance conditionnelle. Si vous adoptez ce point de vue, marcher et parler comme un canard ne suffisent pas pour établir qu’il s’agit d’un canard, et aucune hypothèse « évidente » n’est adoptée prématurément.

Ce niveau d’exigence académique et d’investigation serait excessif lorsque le « bon sens » est disponible, mais constitue une norme précieuse lorsqu’on parcourt les nombreuses ambiguïtés et les corrélations potentiellement non liées qui peuvent exister dans un ensemble de données d’apprentissage automatique.

Dans un réseau bayésien d’origine, les caractéristiques sont soumises à des fonctions de notation, notamment la longueur de description minimale et la notation bayésienne, qui peuvent imposer des restrictions aux données en termes de connexions estimées entre les points de données et de la direction dans laquelle ces connexions s’écoulent.

Un classificateur Naive Bayes, en revanche, fonctionne en supposant que les caractéristiques d’un objet donné sont indépendantes, en utilisant ensuite le théorème de Bayes pour calculer la probabilité d’un objet donné en fonction de ses caractéristiques.

Utilisation populaire

Les filtres Naive Bayes sont bien représentés dans la prévision de maladies et la catégorisation de documents, la filtrage des spams, la classification des sentiments, les systèmes de recommandation et la détection de la fraude, entre autres applications.

7 : K-Plus proches voisins (KNN)

Proposé pour la première fois par l’École de médecine de l’aviation de l’armée de l’air américaine en 1951, et ayant dû s’adapter à l’état de l’art du matériel informatique de la mi-20e siècle, les K-Plus proches voisins (KNN) est un algorithme élégant qui figure toujours dans les publications universitaires et les initiatives de recherche privées en apprentissage automatique.

KNN a été appelé « l’apprenant paresseux », car il examine de manière exhaustive un ensemble de données pour évaluer les relations entre les points de données, plutôt que d’exiger la formation d’un modèle d’apprentissage automatique complet.

Un regroupement KNN. Source : https://scikit-learn.org/stable/modules/neighbors.html

Bien que KNN soit architecturalement mince, son approche systématique impose une demande notable sur les opérations de lecture/écriture, et son utilisation dans de très grands ensembles de données peut être problématique sans technologies annexes telles que l’Analyse des composants principaux (ACP), qui peut transformer des ensembles de données complexes et à volume élevé en regroupements représentatifs que KNN peut parcourir avec moins d’efforts.

Une étude récente a évalué l’efficacité et l’économie d’un certain nombre d’algorithmes chargés de prédire si un employé quittera une entreprise, constatant que le KNN septuagénaire restait supérieur aux concurrents plus modernes en termes de précision et d’efficacité prédictive.

Utilisation populaire

Pour toute sa simplicité de concept et d’exécution populaire, KNN n’est pas coincé dans les années 1950 – il a été adapté dans une approche plus axée sur les RNN dans une proposition de 2018 de l’Université d’État de Pennsylvanie, et demeure un processus central en phase préliminaire (ou outil d’analyse post-traitement) dans de nombreux cadres d’apprentissage automatique beaucoup plus complexes.

Dans diverses configurations, KNN a été utilisé ou pour la vérification en ligne de signature, la classification d’images, la fouille de textes, la prévision de récolte et la reconnaissance faciale, entre autres applications et intégrations.

Un système de reconnaissance faciale basé sur KNN en formation. Source : https://pdfs.semanticscholar.org/6f3d/d4c5ffeb3ce74bf57342861686944490f513.pdf

8 : Processus de décision markovien (MDP)

Un cadre mathématique introduit par le mathématicien américain Richard Bellman en 1957, le Processus de décision markovien (MDP) est l’un des blocs de base les plus élémentaires des architectures d’apprentissage par renforcement. Un algorithme conceptuel en soi, il a été adapté dans un grand nombre d’autres algorithmes et réapparaît fréquemment dans les publications de recherche actuelles en IA/ML.

MDP explore un environnement de données en utilisant son évaluation de son état actuel (c’est-à-dire « où » il se trouve dans les données) pour décider quel nœud des données explorer ensuite.

Source : https://www.sciencedirect.com/science/article/abs/pii/S0888613X18304420

Un Processus de décision markovien de base donnera la priorité à l’avantage à court terme plutôt qu’à des objectifs plus désirables à long terme. Pour cette raison, il est généralement intégré dans le contexte d’une architecture de politique plus complète dans l’apprentissage par renforcement, et est souvent soumis à des facteurs limitatifs tels que la récompense actualisée et d’autres variables environnementales modifiantes qui l’empêcheront de se précipiter vers un objectif immédiat sans tenir compte du résultat souhaité plus large.

Utilisation populaire

Le concept de bas niveau de MDP est répandu dans la recherche et les déploiements actifs de l’apprentissage automatique. Il a été proposé pour les systèmes de défense de sécurité IoT, la pêche et la prévision du marché.

Outre son applicabilité évidente aux échecs et à d’autres jeux strictement séquentiels, MDP est également un candidat naturel pour la formation procédurale des systèmes robotiques, comme on peut le voir dans la vidéo ci-dessous.

9 : Fréquence du terme-Inverse de la fréquence du document

La fréquence du terme (TF) divise le nombre de fois qu’un mot apparaît dans un document par le nombre total de mots dans ce document. Ainsi, le mot scelle apparaissant une fois dans un article de mille mots a une fréquence de terme de 0,001. À lui seul, TF est en grande partie inutile en tant qu’indicateur d’importance du terme, en raison du fait que les articles (tels que un, et, le et il) dominent.

Pour obtenir une valeur significative pour un terme, la fréquence inverse du document (IDF) calcule la TF d’un mot sur plusieurs documents dans un ensemble de données, attribuant une note faible aux mots d’arrêt très fréquents, tels que les articles. Les vecteurs de caractéristiques résultants sont normalisés à des valeurs entières, avec chaque mot attribué un poids approprié.

TF-IDF pondère la pertinence des termes en fonction de la fréquence sur un certain nombre de documents, avec une occurrence plus rare comme indicateur de pertinence. Source : https://moz.com/blog/inverse-document-frequency-and-the-importance-of-uniqueness

Bien que cette approche empêche les mots sémantiquement importants d’être perdus en tant que valeurs aberrantes, l’inversion du poids de fréquence ne signifie pas automatiquement qu’un terme à faible fréquence n’est pas une valeur aberrante, car certaines choses sont rares et sans valeur. Par conséquent, un terme à faible fréquence devra prouver sa valeur dans le contexte architectural plus large en apparaissant (même à une faible fréquence par document) dans un certain nombre de documents dans l’ensemble de données.

Malgré son âge, TF-IDF est une méthode puissante et populaire pour les passes de filtrage initial dans les cadres de traitement automatique des langues.

Utilisation populaire

Puisque TF-IDF a joué au moins un rôle dans le développement de l’algorithme PageRank de Google au cours des vingt dernières années, il est devenu très largement adopté comme tactique SEO manipulatrice, malgré le désaveu de son importance pour les résultats de recherche par John Mueller en 2019.

En raison du secret entourant PageRank, il n’y a aucune preuve claire qu’il ne s’agit pas actuellement d’une tactique SEO efficace. Des discussions incendiaires parmi les professionnels de l’informatique récemment indiquent une compréhension populaire, correcte ou non, selon laquelle l’abus de termes peut toujours entraîner une amélioration du positionnement SEO (bien que des accusations d’abus de monopole et d’publicité excessive brouillent les contours de cette théorie).

10 : Descente de gradient stochastique

La descente de gradient stochastique (SGD) est une méthode de plus en plus populaire pour optimiser la formation de modèles d’apprentissage automatique.

La descente de gradient elle-même est une méthode d’optimisation et de quantification de l’amélioration que réalise un modèle pendant la formation.

Dans ce sens, « gradient » indique une pente descendante (plutôt qu’une gradation basée sur la couleur, voir image ci-dessous), où le point le plus élevé de la « colline », sur la gauche, représente le début du processus de formation. À ce stade, le modèle n’a pas encore vu l’ensemble des données, même une seule fois, et n’a pas encore appris suffisamment sur les relations entre les données pour produire des transformations efficaces.

Une descente de gradient sur une session de formation FaceSwap. On peut voir que la formation a atteint un plateau pendant un certain temps dans la deuxième moitié, mais a finalement retrouvé son chemin le long de la pente vers une convergence acceptable.

Le point le plus bas, sur la droite, représente la convergence (le point auquel le modèle est aussi efficace qu’il le sera jamais sous les contraintes et les paramètres imposés).

Le gradient agit comme un enregistrement et un prédicteur de l’écart entre le taux d’erreur (à quel point le modèle a actuellement cartographié avec précision les relations entre les données) et les poids (les paramètres qui influencent la façon dont le modèle apprendra).

Cet enregistrement des progrès peut être utilisé pour informer un calendrier d’apprentissage, un processus automatique qui indique à l’architecture de devenir plus granulaire et précis à mesure que les détails vagues précoces se transforment en relations et en mappages clairs. En effet, la perte de gradient fournit une carte juste-à-temps de l’endroit où la formation devrait aller ensuite et de la manière dont elle devrait procéder.

L’innovation de la Descente de gradient stochastique est qu’elle met à jour les paramètres du modèle sur chaque exemple de formation par itération, ce qui accélère généralement le voyage vers la convergence. En raison de l’avènement de l’hyperscale des ensembles de données au cours des dernières années, la DGS a gagné en popularité ces derniers temps comme l’une des méthodes possibles pour résoudre les problèmes logistiques qui en découlent.

D’un autre côté, la DGS a des implications négatives pour la mise à l’échelle des caractéristiques et peut nécessiter davantage d’itérations pour atteindre le même résultat, nécessitant une planification et des paramètres supplémentaires, par rapport à la descente de gradient régulière.

Utilisation populaire

En raison de sa configurabilité et malgré ses lacunes, la DGS est devenue l’algorithme d’optimisation le plus populaire pour ajuster les réseaux de neurones. Une configuration de la DGS qui devient dominante dans les nouvelles publications de recherche est le choix de l’optimiseur ADAM (introduit en 2015).

ADAM adapte le taux d’apprentissage pour chaque paramètre de manière dynamique (« taux d’apprentissage adaptatif »), ainsi que les résultats des mises à jour précédentes dans la configuration suivante (« élan »). De plus, il peut être configuré pour utiliser des innovations ultérieures, telles que le Momentum de Nesterov.

Cependant, certains soutiennent que l’utilisation de l’élan peut également accélérer ADAM (et des algorithmes similaires) vers une conclusion sous-optimale. Comme pour la plupart des lames de fond du secteur de la recherche en apprentissage automatique, la DGS est un travail en cours.