Ángulo de Anderson

Las Ventajas de Engordar a Través de la IA

Un nuevo sistema de IA puede cambiar realistamente el cuerpo de las personas en fotos, haciéndolos más gordos, más delgados o más musculosos, sin cambiar su rostro, ropa o fondo. El sistema se entrena con un conjunto de datos completamente sintético que muestra cada identidad en múltiples tipos de cuerpo.

Además del uso cada vez más común de la IA como método de refinamiento de la forma del cuerpo en las redes sociales, o (potencialmente) para alterar los tipos de cuerpo para fines de VFX, el uso del aprendizaje automático para alterar la apariencia de los individuos puede servir a una función más importante: ayudar a los individuos con trastornos alimentarios a entender su propia interpretación dismórfica de su apariencia, así como ofrecer una herramienta motivacional potencial para fines generales de deportes y fitness:

Del papel ‘Estimación del tamaño del cuerpo en mujeres con anorexia nerviosa y controles sanos utilizando avatares 3D’, una GUI para visualizar los cambios en la forma del cuerpo. Los individuos con dismorfia corporal pueden tener dificultades para asociar una interpretación realista de su cuerpo con una imagen similar, lo que da a los clínicos una métrica para respuestas dismórficas, entre otros propósitos. Fuente: https://www.nature.com/articles/s41598-017-15339-z.pdf

Además, la sub-rama muy perseguida de la prueba de moda en la investigación de visión por computadora también tiene interés en proporcionar visualizaciones precisas en una variedad de formas de cuerpo. Mientras que marcos como el DiffBody de 2024 de la Universidad de Tsukuba de Japón, han creado algunas funcionalidades impactantes en este campo:

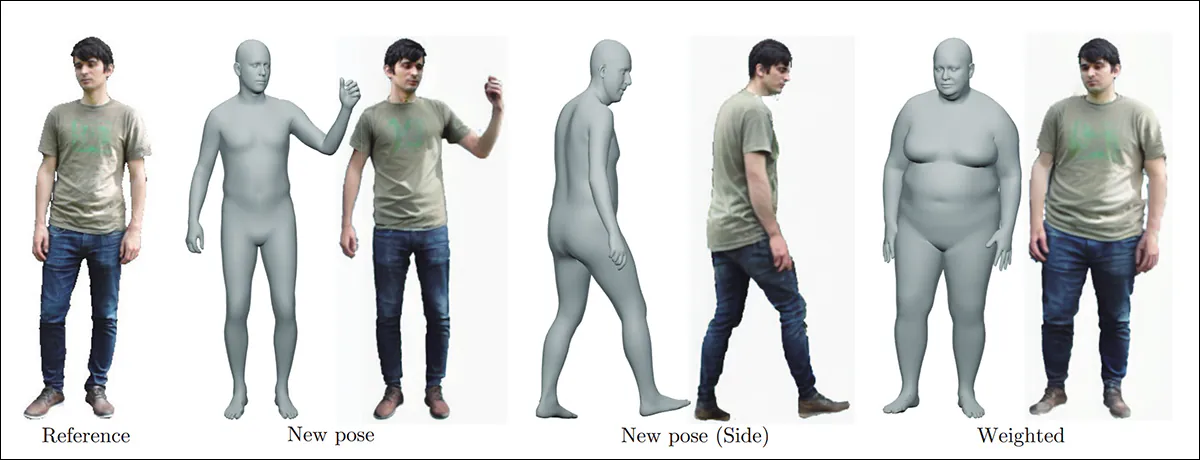

Algunas de las transformaciones posibles utilizando la técnica DiffBody anterior. Fuente: https://arxiv.org/pdf/2401.02804

Dado que los modelos de fundación de IA se optimizan hacia formas de cuerpo convencionalmente atractivas o comunes, tamaños inusuales como ‘obeso’ son mínimamente disponibles en los modelos estándar, o de lo contrario vienen con algunos sesgos punitivos.

Necesidades de Pareja

Uno de los mayores desafíos en la creación de sistemas de IA que puedan realistamente agregar o restar grasa y músculo a las fotos de los individuos – sin alterar su identidad, entornos o ropa – es que esto implica entrenamiento emparejado, donde el sistema de IA efectivamente aprende ‘antes’ y ‘después’ de las imágenes que definen cualquier transformación que el modelo esté destinado a realizar.

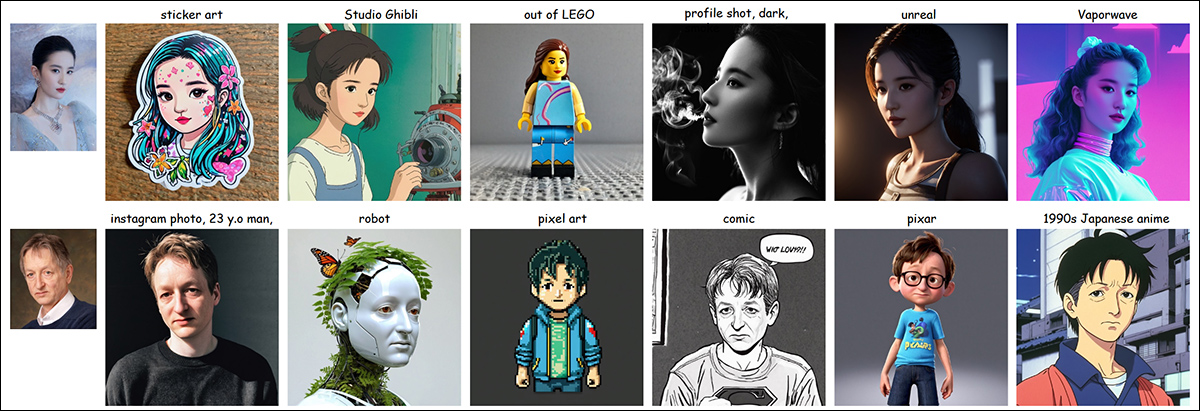

Este tipo de entrenamiento ha vuelto a ganar prominencia durante el verano debido al éxito de los modelos de edición de imagen Kontext de Black Forest Labs, donde este tipo de datos emparejados se utilizó para enseñar una variedad de transformaciones a los modelos:

Desde el sitio Flux Kontext, un ejemplo de una transformación que refleja el tipo de datos de origen necesarios para entrenar un modelo capaz de mantener la integridad de la imagen al imponer cambios importantes. Fuente: https://bfl.ai/models/flux-kontext

Obviamente, en el caso de desarrollar un modelo que pueda alterar significativamente la apariencia de una persona (sin reimaginear toda la imagen), se necesita algo que sea totalmente imposible en el mundo real: imágenes ‘antes’ y ‘después’ radicales tomadas solo segundos aparte.

La única solución es datos sintéticos. Algunos proyectos de este tipo han utilizado pares de contraste individuales creados manualmente en Photoshop; sin embargo, esto es poco realista a gran escala, y un proceso automatizado o semi-automatizado, impulsado por IA, para generar los pares es ahora cada vez más considerado preferible.

El problema con los enfoques basados en GAN y con la mayoría de los enfoques basados en SMPL/X (donde una figura CGI virtual se utiliza como una especie de mecanismo de intercambio entre imágenes reales y las transformaciones deseadas), y con los enfoques que utilizan warping de imagen, es que el fondo y la identidad tienden a sufrir en el proceso.

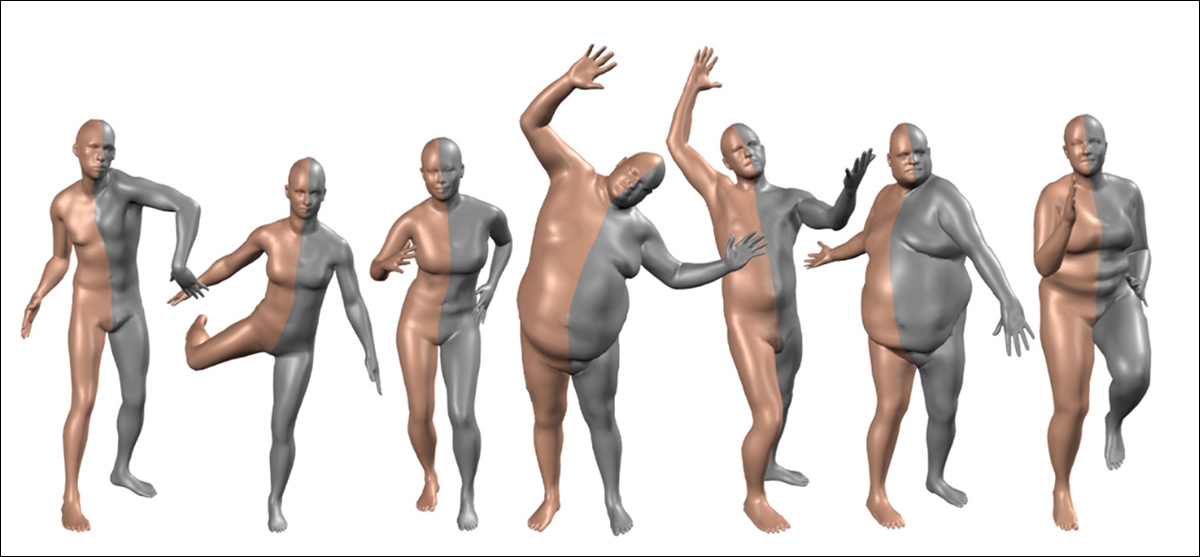

Modelos CGI paramétricos y vectoriales como SMPL y SMPL-X (entre otros), proporcionan coordenadas 3D físicas convencionales definidas que pueden interpretarse e incorporarse en marcos de visión por computadora. Fuente: https://files.is.tue.mpg.de/black/papers/SMPL2015.pdf

Dado que es importante que la IA aprenda a cambiar solo los aspectos deseados, en lugar de aprender a deformar fondos y a replicar otros errores no deseados, ningún sistema de alteración del cuerpo ha llegado aún a una solución perfecta.

Un artículo reciente de la India, sin embargo, propone un avance notable en el estado del arte a través del uso del marco de modelo de difusión Flux más antiguo, aumentado con una serie de enfoques secundarios que permiten un conjunto de datos emparejado superior y más consistente:

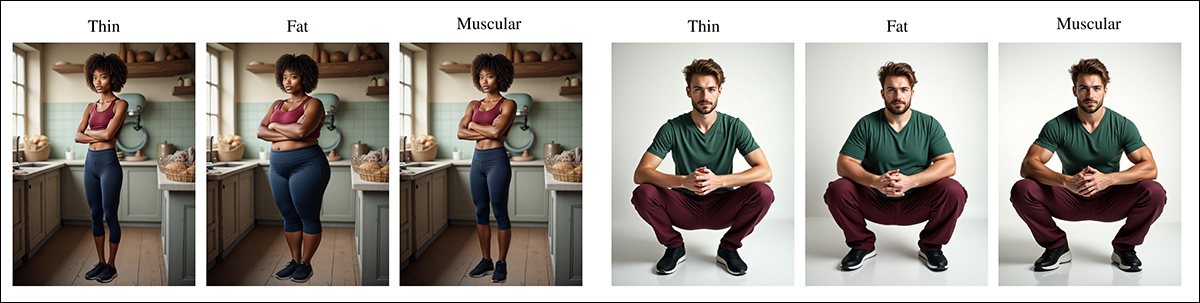

Ejemplos del conjunto de datos del nuevo proyecto. Fuente: https://arxiv.org/pdf/2508.13065

El proyecto comprende un nuevo y extenso conjunto de datos emparejado; Odo, un modelo de difusión generativo entrenado con estos datos; y un benchmark personalizado diseñado para evaluar cuantitativamente el rendimiento de edición de forma humana. En las pruebas, los autores afirman un avance notable en los estándares logrados por modelos comparables similares.

El nuevo artículo se titula Odo: Difusión guiada por profundidad para la reconfiguración del cuerpo que preserva la identidad, y proviene de tres investigadores en Fast Code AI Pvt. Ltd en Bangalore.

Datos y Método

El conjunto de datos creado por los investigadores cuenta con 7,615 imágenes de alta resolución (960x1280px) para cada tipo de cuerpo objetivo (gordo, delgado, y músculo).

Inicialmente, 1,523 caras humanas se generaron a través del modelo de difusión FLUX.1-dev de 12 mil millones de parámetros, aunque utilizando un número no especificado de caras de referencia libres de licencia de Pexels y Unsplash, para aumentar la diversidad.

Para generar imágenes de cuerpo completo que incorporen estas caras, los investigadores utilizaron PuLID de ByteDance, una versión de 2024, un punto de control afinado sobre la base Flux, y que cuenta con una pérdida de identidad contrastiva diseñada para ayudar a conservar la identidad facial durante los procesos de transformación:

Ejemplos del proyecto PuLID. Fuente: https://arxiv.org/pdf/2404.16022

El modelo recibió una imagen facial y una solicitud de prompt estandarizada que pedía género, ropa, postura, escena, así como el tipo de cuerpo de delgado, gordo, o músculo.

Las tres imágenes de tipo de cuerpo para cada identidad a veces exhibieron cambios menores en la alineación del fondo y el tamaño percibido del sujeto, que surgen del comportamiento estocástico de los modelos de difusión, donde cada generación comienza desde una nueva semilla de ruido. Incluso cambios menores en el prompt, como modificar la descripción del tipo de cuerpo, pueden influir en la trayectoria del modelo en espacio latente, y causar desviación visual.

Para corregir esta variación, se aplicó una tubería de post-procesamiento automático de cuatro etapas, con la imagen delgada en cada tríada seleccionada como la de referencia, ya que su silueta más pequeña expone más fondo.

La detección de personas se realizó utilizando RT-DETRv2, seguida de segmentación con SAM 2.1 para extraer máscaras de sujeto para los tres tipos de cuerpo. La imagen de referencia delgada se pasó entonces a FLUX.1 Kontext Pro (el sistema de edición de imagen más nuevo) para la pintura del fondo, produciendo una versión limpia de la escena, con el sujeto eliminado.

Las variantes gorda y músculo se redimensionaron utilizando escalado uniforme para coincidir con la altura de la máscara de referencia delgada, y se composieron sobre el fondo limpio en la misma alineación inferior, asegurando un encuadre consistente en todas las imágenes.

Los autores declaran:

‘Los tríos de transformación resultantes (delgado, gordo y músculo) tienen un fondo idéntico y una escala de sujeto uniforme. Esto elimina las variaciones irrelevantes que podrían afectar negativamente el entrenamiento o la evaluación subsiguiente.’

Cada tríada de imágenes delgadas, gordas y musculosas permitió seis pares de transformación posibles, lo que resultó en 45,690 combinaciones teóricas en 7,615 identidades.

Después de filtrar los ejemplos con ropa no coincidente, poses no naturales, extremidades distorsionadas, deriva de identidad o cambios de forma mínimos, se retuvieron 18,573 pares de alta calidad. Aunque algunas diferencias menores de postura permanecieron, el modelo demostró ser robusto a estas variaciones.

Entrenamiento y Pruebas

Las imágenes resultantes se utilizaron para entrenar el modelo Odo – un enfoque de difusión para la reconfiguración humana, con el uso de mapas de SMPL (es decir, CGI intermedio).

Informado por los métodos del Localizador Neural de 2024, los datos se conformaron al modelo SMPL por individuo, con los parámetros optimizados capaces de producir mapas de profundidad a partir de los cuales se derivarían las imágenes alteradas:

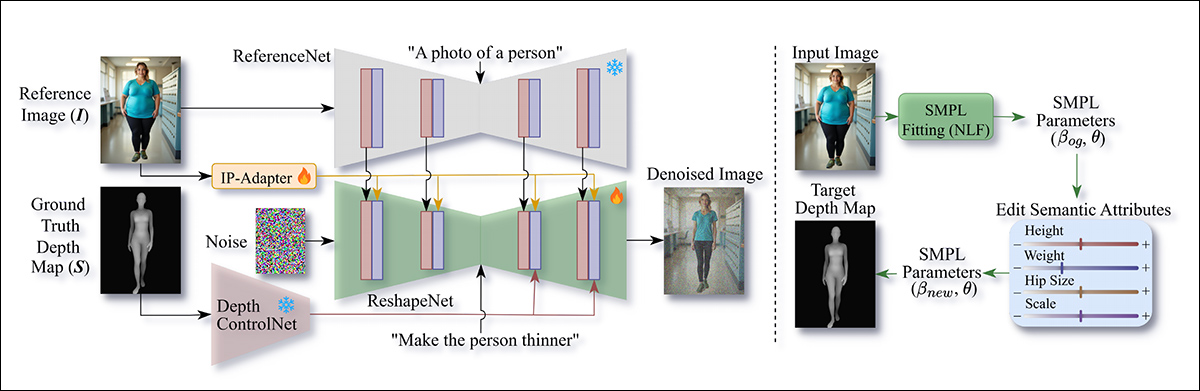

Esquema para la tubería de entrenamiento. El lado izquierdo muestra la configuración de entrenamiento, donde los mapas de profundidad SMPL de la imagen de destino guían a ReshapeNet a través de ControlNet para realizar la transformación del cuerpo. Las características de la imagen de origen se extraen con ReferenceNet y se fusionan en ReshapeNet utilizando atención espacial. El lado derecho muestra la inferencia, donde los parámetros SMPL se estiman a partir de la imagen de entrada, se modifican con atributos semánticos y se representan en un mapa de profundidad de destino que condiciona a ReshapeNet durante el ruido para producir la imagen transformada final.

El modelo (ver esquema anterior) comprende el módulo ReshapeNet; apoyado por tres módulos auxiliares: ReferenceNet; un módulo IP-Adapter; y un módulo ControlNet de profundidad.

ReferenceNet extrae características detalladas como fondo, ropa e identidad de la imagen de entrada, y las pasa a ReshapeNet. IP-Adapter contribuye con orientación de características de alto nivel, mientras que ControlNet de profundidad aplica condicionamiento basado en SMPL para guiar la transformación del cuerpo. En línea con trabajos anteriores anteriores, se utilizó un SDXL basado en frozen UNet para extraer características intermedias.

En cuanto al módulo IP-Adapter, este codifica la imagen de entrada a través de CLIP, con las incrustaciones resultantes integradas de regreso a ReshapeNet a través de atención cruzada.

En cuanto al módulo ControlNet de profundidad, este guía las capas medias y decodificadoras de ReshapeNet utilizando conexiones residuales. Posteriormente, toma un mapa de profundidad renderizado a partir de los parámetros SMPL de destino, y lo alinea con la imagen de destino.

ReshapeNet, basado en el UNet SDXL, es la red central de Odo. Durante el entrenamiento, las imágenes de destino se codifican en espacio latente con un autoencoder variacional, ruidosas con el tiempo, y luego desruidadas por ReshapeNet utilizando características de ControlNet y ReferenceNet.

Se agregaron prompts de texto específicos de categoría, como ‘Hacer que la persona sea más gorda’, ‘Hacer que la persona sea más delgada’, o ‘Hacer que la persona sea más musculosa’, para guiar las transformaciones. Mientras que los mapas de profundidad capturaron formas de cuerpo gruesas, los prompts proporcionaron el detalle semántico necesario para cambios como la definición muscular, lo que permitió al modelo producir modificaciones más precisas y realistas.

Implementación de Entrenamiento

Odo se entrenó en el conjunto de datos sintético del proyecto, combinado con un subconjunto del conjunto de datos DeepFashion-MultiModal, lo que dio como resultado un total de 20,000 pares de imágenes.

Los datos DeepFashion-MultiModal proporcionaron variedad en ropa y características faciales, con imágenes emparejadas contra sí mismas durante el entrenamiento. Con todos los mapas de profundidad SMPL precalculados para la eficiencia, el entrenamiento se ejecutó durante 60 épocas en una sola GPU NVIDIA A100 con 80GB de VRAM.

Con las imágenes de entrada redimensionadas a 768×1024, se utilizó el optimizador Adam, a una tasa de aprendizaje de 1×10⁻⁵. ReshapeNet se inicializó con pesos de UNet SDXL, y se afinó conjuntamente con el IP-Adapter a partir de su punto de control.

ReferenceNet se inicializó con pesos de SDXL y se mantuvo congelado, mientras que ControlNet de profundidad utilizó pesos preentrenados y también permaneció congelado.

El modelo final requirió alrededor de 23GB de memoria de GPU, y necesitó 18 segundos para la inferencia de una sola imagen.

Una Métrica Nueva

La falta de conjuntos de datos del tipo necesario para este tipo de proyecto significó que no había métricas existentes que abordaran el desafío. Por lo tanto, los autores diseñaron una métrica de benchmark nueva, compuesta por 3,600 pares de imágenes, que presentan imágenes de caras reales y descripciones de fondo, junto con variaciones de forma de cuerpo diversas.

Otras métricas utilizadas fueron Índice de Similitud Estructural (SSIM); Relación de Señal a Ruido Pico (PSNR); Similitud de Parches de Imagen Percibida Aprendida (LPIPS); y Error Euclidiano por Vértice Corregido en escala (T-) en posición neutral (PVE-T-SC).

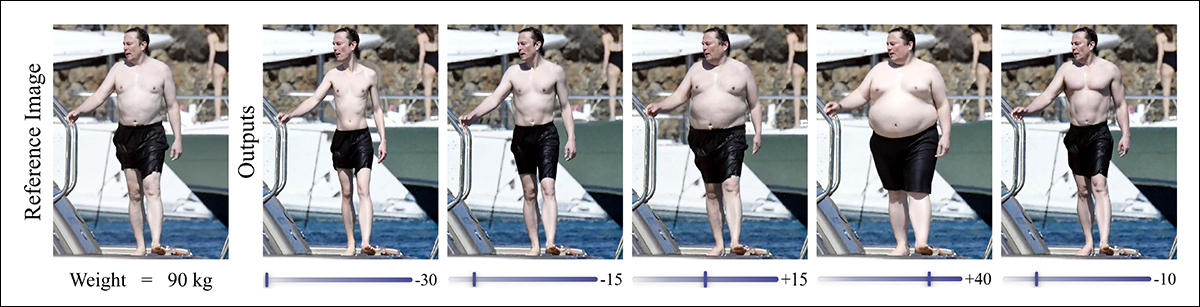

Primero, los autores probaron su método cualitativamente con imágenes del mundo real (imágenes que no vio el modelo durante el entrenamiento):

Pruebas cualitativas. Los ejemplos muestran conversiones desde la imagen original a tipos de cuerpo delgado, con sobrepeso y musculoso en diferentes poses, incluyendo sentado y de pie. Por favor, refiérase al artículo de la fuente para una mejor definición y detalle.

De estos resultados, el artículo declara:

‘[Nuestro] método maneja efectivamente diversas poses, fondos y ropa mientras conserva la identidad de la persona.

‘Además de las formas de destino SMPL, proporcionamos prompts textuales – ‘Hacer que la persona sea más gorda’, ‘Hacer que la persona sea más delgada’, o ‘Hacer que la persona sea más musculosa’– para guiar explícitamente las transformaciones deseadas…

…'[La imagen a continuación] demuestra aún más la capacidad del modelo para realizar transformaciones de forma diversas. El modelo sigue con precisión los mapas de profundidad SMPL para generar múltiples variaciones de versiones más delgadas y más gordas a partir de la imagen de referencia.’

Pruebas cualitativas adicionales que cubren el rango de tipos de cuerpo objetivo. Por favor, refiérase al artículo de la fuente para una mejor definición y detalle.

Los autores comentan aún más:

‘Nuestros resultados demuestran transformaciones más realistas según el peso objetivo, ya que nuestro modelo ajusta simultáneamente la forma general del cuerpo, las proporciones de los miembros y la ropa, lo que resulta en modificaciones anatómicamente consistentes y visualmente convincentes.’

Para pruebas cuantitativas, los autores compararon su sistema con el modelo de código abierto Flux Kontext [dev], FLUX.1, y la oferta de 2022 Generación de flujo de estructura consciente para la reconfiguración del cuerpo humano.

Para FLUX.1 Kontext [dev], se diseñaron prompts para instruir ‘Hacer que la persona sea más gorda’, ‘Hacer que la persona sea más delgada’, o ‘Hacer que la persona sea más musculosa’, con pesos objetivo especificados – aunque la falta de controles de grano fino limitó el rendimiento:

![Comparación de Odo con Generación de flujo de estructura consciente para la reconfiguración del cuerpo humano y FLUX.1 Kontext [dev] en el conjunto de prueba, junto con resultados de ablación para modelos entrenados sin acondicionamiento de prompt en ReshapeNet, sin ReferenceNet (utilizando solo IP-Adapter), y con el entrenamiento restringido al conjunto de datos BR-5K. La tabla también incluye material relacionado con estudios de ablación (BR-5K), que no se cubren aquí.](https://www.unite.ai/wp-content/uploads/2025/08/table-2-1.jpg)

Comparación de Odo con Generación de flujo de estructura consciente para la reconfiguración del cuerpo humano y FLUX.1 Kontext [dev] en el conjunto de prueba, junto con resultados de ablación para modelos entrenados sin acondicionamiento de prompt en ReshapeNet, sin ReferenceNet (utilizando solo IP-Adapter), y con el entrenamiento restringido al conjunto de datos BR-5K. La tabla también incluye material relacionado con estudios de ablación (BR-5K), que no se cubren aquí.

Conclusión

El advenimiento de Flux Kontext este año, y más recientemente la liberación de los pesos no cuantificados para Qwen Image Edit, han devuelto los datos de imagen emparejada al centro de la comunidad de aficionados y profesionales. En el clima de creciente crítica y descontento con la imprecisión de la IA generativa, los modelos de este tipo están diseñados para una fidelidad mucho mayor a las imágenes de origen (aunque los modelos de menor escala a veces están limitados por sus objetivos de entrenamiento específicos).

En este caso, la utilidad de un sistema de reconfiguración del cuerpo parecería estar en campos psicológicos, médicos y de moda. Sin embargo, es posible que los sistemas de este tipo logren un nivel más alto de prominencia, y tal vez un conjunto más casual y potencialmente preocupante de usos.

Publicado por primera vez el lunes, 25 de agosto de 2025