Ángulo de Anderson

Utilizando IA para Mejorar Fotos Reales Antes de que Sean Tomadas

En lugar de utilizar GenAI para corregir fotos después de tomarlas, los investigadores han entrenado un sistema que te dice cómo moverte, posar y enmarcar la foto con anticipación, utilizando conocimientos estudiados sobre qué hace que las imágenes sean memorables.

Corregir fotos después del hecho ha sido cada vez más fácil durante algún tiempo, ya que los fabricantes y las plataformas tecnológicas ofrecen cada vez más edición en cámara que permite a los usuarios cambiar las imágenes tan pronto como las han tomado. Los sistemas populares de este tipo incluyen la edición conversacional de Google y la edición generativa de Samsung, entre otros.

Sin embargo, una tendencia naciente que favorece la ‘autenticidad’ sobre los resultados ‘mejorados’ por IA podría significar que muchos de los consumidores a los que se dirigen estos sistemas comiencen a considerar las fotos ‘alteradas’ como basura de IA.

Quizás esto sea lo que inspiró a Google a crear un ‘entrenador de cámara’ de IA capacitado, informado por Gemini, que es capaz de dar instrucciones directas para mejorar una foto durante el proceso de tomarla:

El entrenador de cámara de Google le dice al usuario cómo reframar una foto, entre otros consejos básicos. Fuente

Al ser un sistema propietario, y con prácticamente ninguna información disponible en línea con respecto a él, el entrenador de cámara parece aprovechar Gemini para ayudar a los usuarios a mejorar el enmarque (ver imagen superior) o a hacer cambios menores en la postura (como acercarse más o mirar directamente a la cámara).

Así que, hasta donde puede decirse, el producto empuja la composición hacia la mediana, presumiblemente basada en millones de puntos de datos de contenido subido que probablemente hayan contribuido a los datos de entrenamiento de Gemini. En este sentido, los usuarios que suben contenido han creado la calibración de la IA rechazando fotos insatisfactorias y subiendo las que les gustan, una forma efectiva (y gratuita) de curación de datos.

Eso dicho, las fotos que están promediadas en términos de composición no necesariamente poseen los mismos valores estéticos o impacto en el espectador que las fotos que son memorables.

Más allá de ‘¡Queso!’ y la regla de los tercios

Con este fin, y hacia un sistema que sea más accesible en varias plataformas, una nueva investigación de Italia ofrece un sistema de estilo Coach que se basa en conocimientos previos de qué hace que las fotos se queden en la mente:

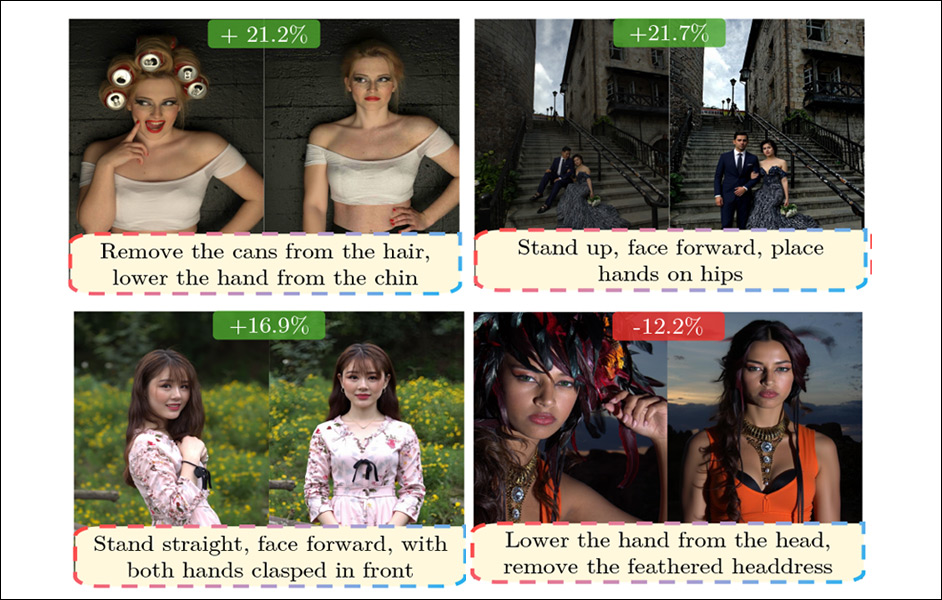

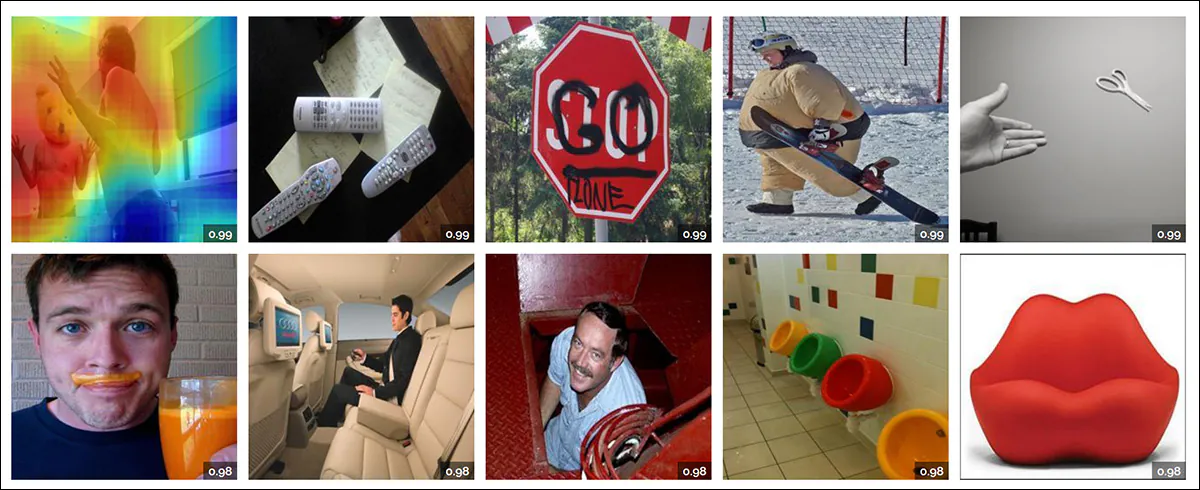

Ejemplos variados de consejos del nuevo sistema de los autores. Fuente

En los ejemplos anteriores, vemos consejos dados por el nuevo sistema de los autores, al que llaman MemCoach, que es difícil de imaginar que un AI centrado en la composición como el entrenador de cámara pueda proporcionar. En la primera instancia (la más a la izquierda), el consejo de quitar el tocado es particularmente especioso; en la segunda imagen, es difícil imaginar qué contexto convencional un AI de composición podría derivar de la situación general (es decir, una imagen ‘artística’ de una joven acostada en el suelo con los ojos cerrados).

La comprensión central sobre la memorabilidad en la fotografía, utilizada para desarrollar el sistema de tres partes italiano, se deriva de varios trabajos anteriores, incluyendo el lanzamiento ¿Qué hace que un objeto sea memorable? de 2015, y el artículo ¿Qué hace que una fotografía sea memorable? de 2013.

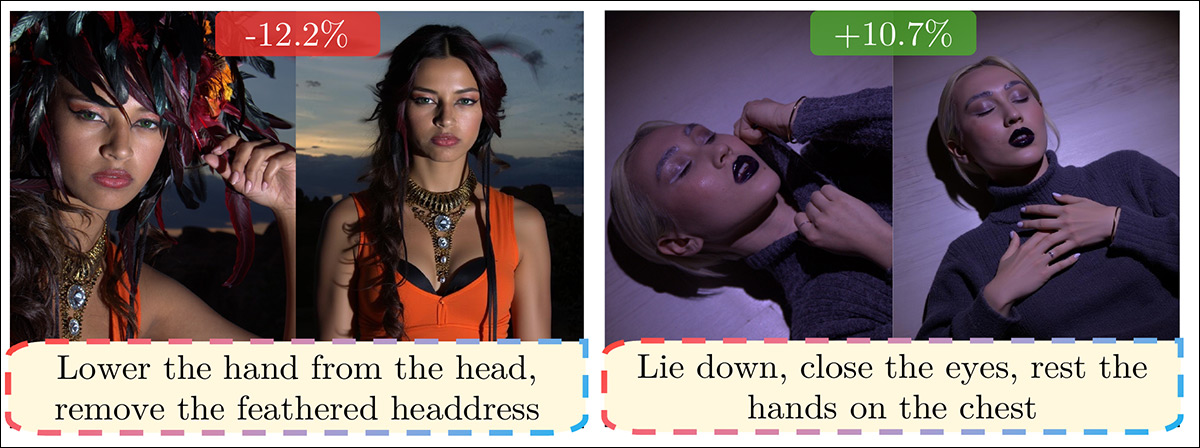

Del artículo de 2013 ¿Qué hace que una fotografía sea memorable?, ejemplos representativos de buenas, medias y malas fotos, en términos de memorabilidad. Fuente

Cualquiera, como yo, con una fecha de nacimiento Unix negativa, probablemente reconocerá el patrón para ‘imágenes menos memorables’ (arriba a la derecha en la imagen anterior), de las interminables noches de diapositivas que maldecían nuestra infancia. Como afirman los autores*:

‘Estos trabajos identificaron factores intrínsecos clave como la presencia de personas, escenas interiores, o expresiones emocionales, en lugar de objetos y vistas panorámicas, así como factores extrínsecos, incluyendo el contexto y el observador.’

El proyecto se centra en ‘retroalimentación de memorabilidad’ (MemFeed), que se expresa en la aplicación tutor MemCoach, y un benchmark (titulado MemBench) basado en el conjunto de datos PPR10K.

De la publicación PPR10K: Un conjunto de datos de retoque de fotos de retrato a gran escala con máscara de región humana y coherencia a nivel de grupo, muestras diversas del conjunto de datos. La fila superior muestra las imágenes originales, la fila inferior muestra versiones retocadas por expertos junto con máscaras de región humana correspondientes. Las fotos originales varían ampliamente en punto de vista, fondo, iluminación y configuraciones de cámara, mientras que los resultados retocados muestran una calidad visual mejorada y una mayor coherencia dentro de cada grupo. Fuente

El artículo observa que la memorabilidad es cuantificable en las fotos, en lugar de un registro de juicios subjetivos, y los autores señalan además que la propiedad ha sido identificada tanto para fotos (en varios trabajos) como para videos (en varios otros).

El nuevo artículo se titula ¿Cómo tomar una foto memorable? Empoderar a los usuarios con retroalimentación accionable, y proviene de cuatro investigadores de la Universidad de Trento, la Universidad de Pisa y la Fondazione Bruno Kessler. La página del proyecto sugiere que el código de GitHub y los datos alojados en Hugging Face estarán disponibles el próximo mes (marzo de 2026).

Método

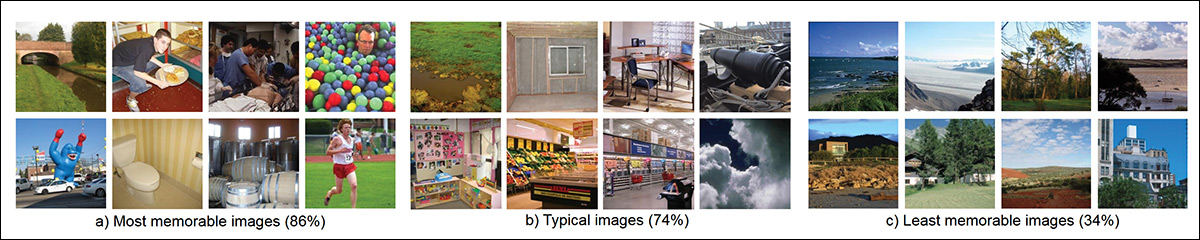

Para curar el conjunto de datos MemBench a partir del conjunto de datos de retrato PPR10K, los investigadores agruparon fotos de la misma escena y calificaron cada imagen por memorabilidad utilizando un predictor entrenado basado en CLIP características. Luego clasificaron las fotos dentro de cada escena de menos a más memorables y las emparejaron en consecuencia:

Visión general de la construcción y evaluación de MemBench. La fila superior muestra la canalización de datos, desde la agrupación de imágenes por escena y la predicción de memorabilidad, hasta la clasificación de fotos y la generación de retroalimentación de acción consciente de la memorabilidad. La fila inferior ilustra la evaluación, midiendo la calidad de la retroalimentación a través de ganancias de memorabilidad basadas en edición y puntuación de perplexidad.

Para cada par, se generaron descripciones de lenguaje natural con el modelo InternVL3.5 para explicar las diferencias visibles entre la versión menos memorable y la más memorable; y estas descripciones constituirían la señal de entrenamiento para el sistema de retroalimentación de memorabilidad.

En contraste con la lógica que subyace al entrenador de cámara de Google, los investigadores buscaron una interpretación más sutil:

‘A diferencia de los ajustes de fotografía computacional que se centran en correcciones posteriores (por ejemplo, “hacer que la imagen sea más brillante”), nos centramos en acciones semánticas que un usuario puede tomar sobre la marcha para una mejor toma, por ejemplo, “Mírense el uno al otro”.’

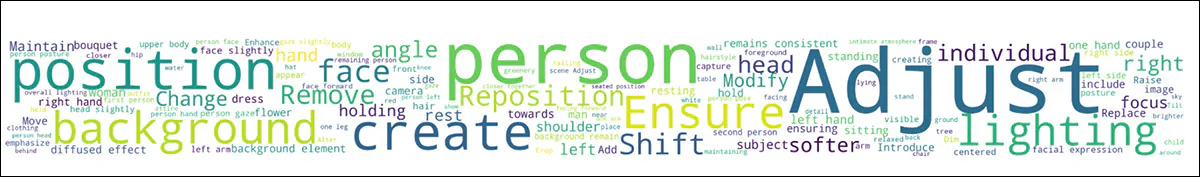

La colección final de MemBench comprende alrededor de 10,000 imágenes agrupadas en 1,570 escenas, con un promedio de 6,5 imágenes por escena. La nube de palabras que los autores generaron (ver imagen a continuación) sugiere una amplia gama de categorías semánticas en el conjunto de datos:

Nube de palabras de los términos más frecuentes en MemBench.

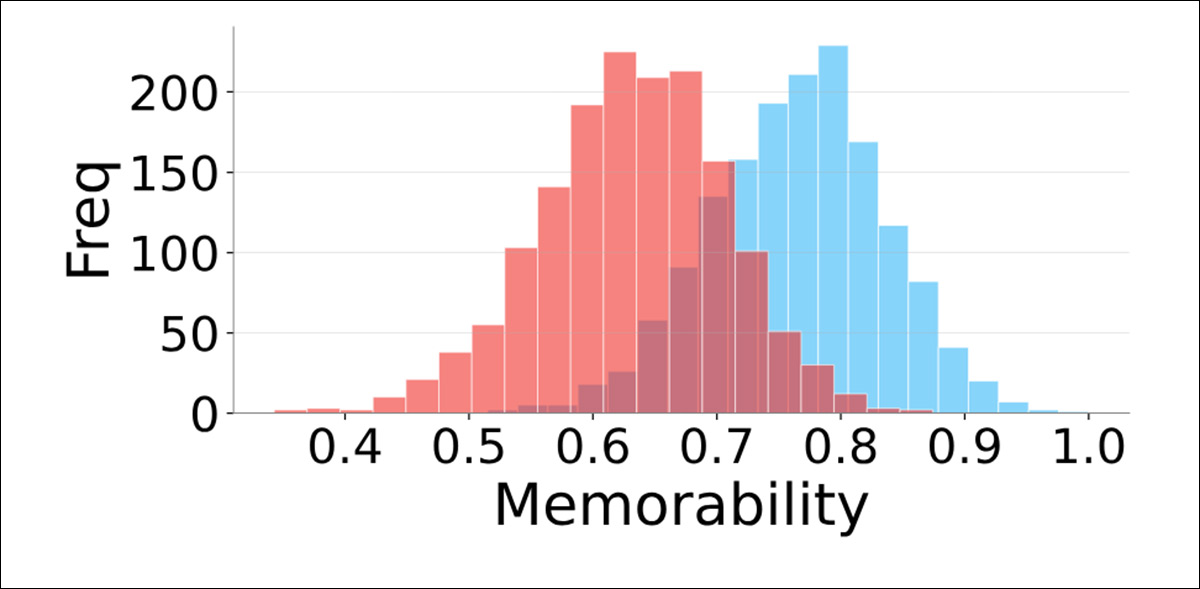

Las fotos de origen promediaron una puntuación de memorabilidad de 0,63, mientras que las tomas más memorables de la misma escena se extendieron desde 0,51 hasta 1,0, con un solapamiento notable entre los dos grupos:

Distribuciones de puntuaciones de memorabilidad que comparan las imágenes menos y más memorables dentro de cada escena.

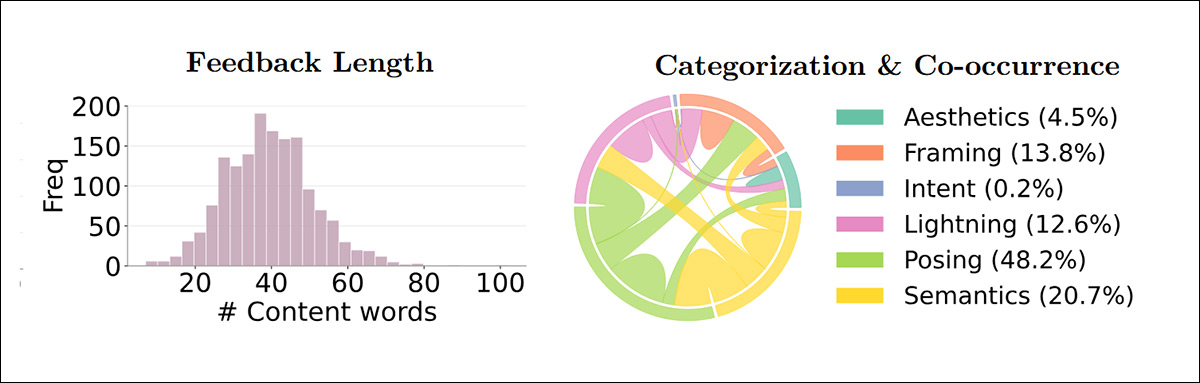

La retroalimentación variaba desde notas cortas de siete palabras hasta instrucciones notablemente más largas (a la izquierda, en la imagen a continuación). Cada pieza de consejo se desglosó en pequeños tipos de acción utilizando GPT-5 Mini (a la derecha, en la imagen a continuación):

Distribución de la longitud de la retroalimentación medida en palabras de contenido, y categorización de subacciones atómicas con anchos de acorde que indican la frecuencia de coocurrencia entre categorías.

Los autores señalan que la mayoría de las sugerencias se centraron en cómo estaba posicionado el sujeto, seguido de cambios en el significado o el contenido de la escena, y que el enmarque a menudo se vinculó a la postura, y los ajustes de iluminación se vincularon con frecuencia a cambios semánticos.

Flux Capacitor

Para evaluar si la memorabilidad se incrementaba con la retroalimentación, se simuló la conformidad del usuario mediante el uso del modelo generativo FLUX.1 Kontext como proxy para el fotógrafo. Dada una imagen de origen y una pieza de retroalimentación textual, se generó una versión editada por Flux que simulaba los cambios sugeridos:

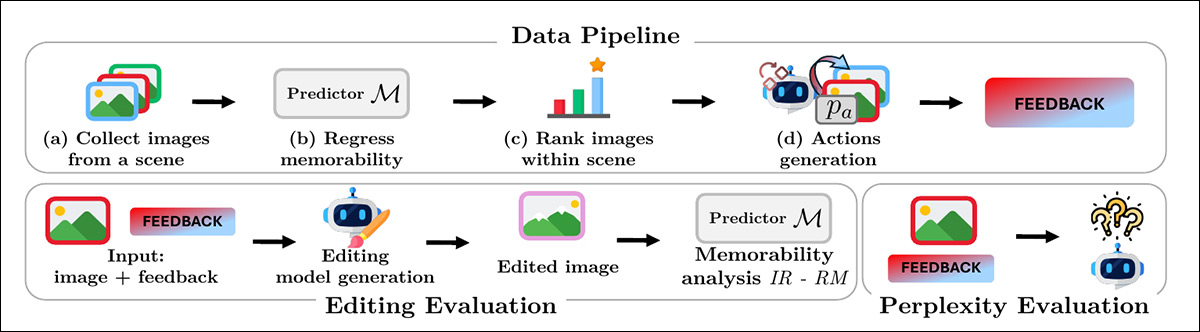

Las imágenes de la izquierda son reales, del conjunto de datos, y las imágenes de la derecha (en cada caso) son creadas por Flux, basadas en la instrucción (en amarillo, debajo). De esta manera, se podía evaluar la efectividad de las instrucciones sin una participación humana extensa. Este conocimiento se retroalimentaría finalmente en el marco de MemCoach, y de hecho representa un flujo de trabajo que podría mejorar iterativamente un sistema de este tipo (es decir, eventualmente con ejemplos del mundo real en lugar de ejemplos de Flux).

Tanto la imagen original como la editada se pasaron a través de un predictor de memorabilidad, lo que permitió medir con qué frecuencia la versión editada lograba una puntuación más alta, denominada Relación de mejora, y cuánto era el aumento relativo con respecto a la imagen de origen, denominado Memorabilidad relativa.

La similitud con la retroalimentación de referencia orientada a la memorabilidad también se midió calculando perplexidad contra las descripciones de verdad, y se aplicó una división 80-20 en el nivel de escena para que las pruebas se realizaran solo en escenas que no se habían utilizado durante el entrenamiento.

Estado del arte

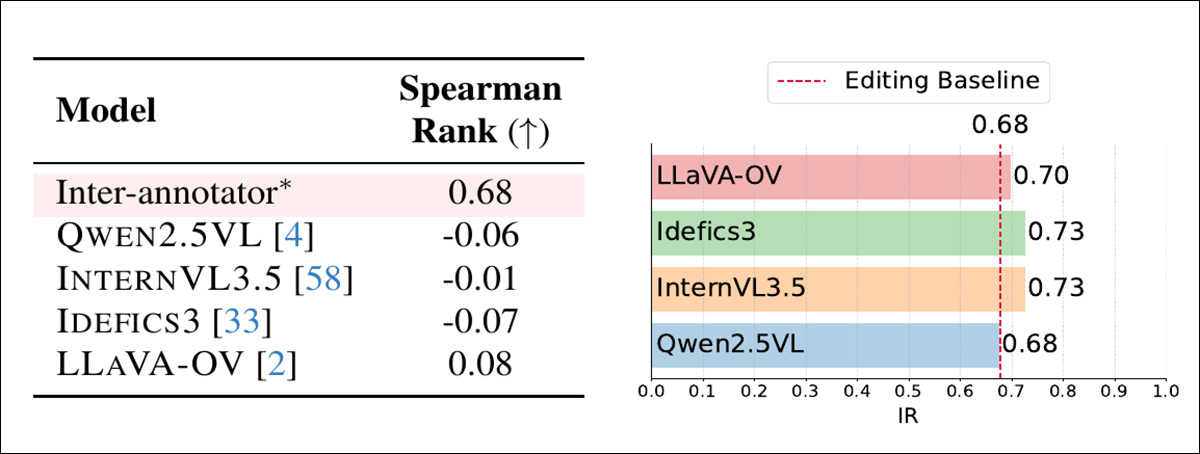

Se probó la conciencia de memorabilidad de los modelos de lenguaje grande multimodal actuales. Se mostraron imágenes del conjunto de datos LaMem a varios modelos líderes, que se les pidió que dijeran si la imagen era memorable. La estimación de confianza del modelo se comparó entonces con las puntuaciones asignadas por los espectadores humanos en el estudio original:

Pruebas que indican que los modelos multimodales de base no capturan la memorabilidad. A la izquierda, la correlación de rango de Spearman entre las predicciones del modelo y las puntuaciones de verdad de LaMem, con el acuerdo entre anotadores de LaMem mostrado para referencia. A la derecha, la relación de mejora lograda por la retroalimentación de disparo cero relativa a la línea de base de edición, mostrando solo ganancias marginales.

Casi no se encontró una correlación significativa con los juicios humanos, y, a pesar del entrenamiento a gran escala, los autores afirman que los modelos no rastrean lo que la gente recuerda consistentemente.

Ejemplos del conjunto de datos LaMem. Arriba a la izquierda, también vemos una mapa de calor representado para esa imagen. Fuente

MemCoach

MemCoach se centra en instrucciones semánticas sobre la marcha que se pueden realizar antes de presionar el obturador, por ejemplo, ajustar la postura, alterar las interacciones entre los sujetos o modificar elementos de la escena. La retroalimentación proporcionada por MemCoach varía desde 7 hasta 102 palabras de contenido. La memorabilidad, según el artículo, parece estar impulsada más por la configuración del sujeto y las señales de la narrativa que por simples ajustes de composición:

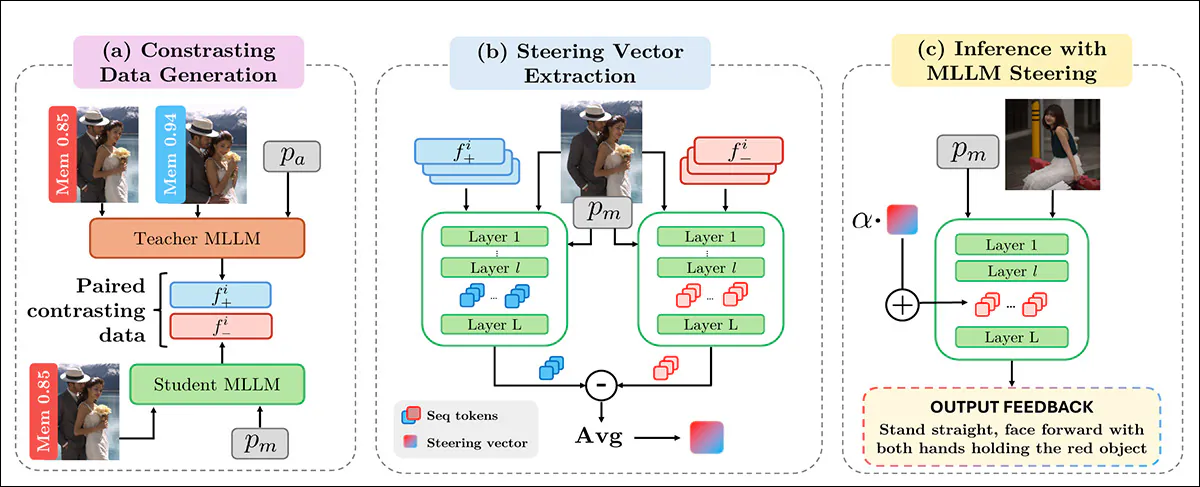

Visión general de la canalización de MemCoach, en la que la orientación consciente de la memorabilidad de un MLLM de maestro se combina con respuestas neutrales del estudiante para formar datos contrastantes; las diferencias de activación entre capas se promedian para derivar un vector de dirección de memorabilidad; y ese vector se inyecta en la inferencia para desviar las activaciones del estudiante hacia la producción de retroalimentación orientada a la memorabilidad mejorada, sin entrenamiento adicional.

Pruebas

Se utilizaron siete Modelos de Lenguaje Multimodal Grande (MLLM) en la fase de pruebas para el nuevo sistema: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; y LLaVA-OneVision-1.5. Además, se incluyó GPT-5 Mini como representante de modelos propietarios y de código cerrado, junto con los modelos especializados en estética Q-Instruct y AesExpert. Los MLLM operaron como oráculos de disparo cero y como oráculos de maestros.

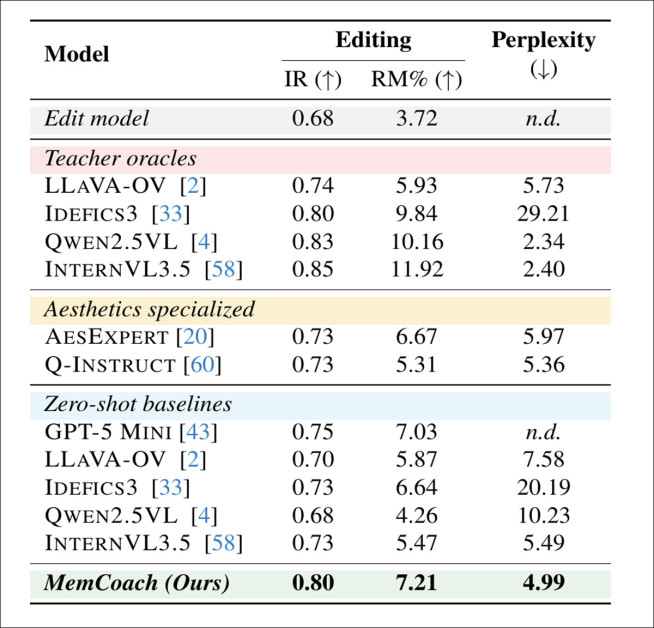

InternVL3.5 se utilizó tanto para el modelo de maestro como para el de estudiante, con la división de entrenamiento de MemBench utilizada para crear ejemplos contrastantes:

Rendimiento de MemCoach en comparación con MLLM de estado del arte en todo, desde oráculos de maestros hasta modelos especializados en estética y líneas de base de disparo cero, mostrando una relación de mejora más alta y una memorabilidad relativa competitiva, junto con la menor perplexidad, lo que indica una retroalimentación más consistente y orientada a la memorabilidad.

En la tabla de la primera prueba (mostrada arriba), vemos que MemCoach parece proporcionar consejos de memorabilidad más efectivos que cualquiera de los modelos de comparación, y el modelo InternVL3.5 dirigido aumenta la memorabilidad con más frecuencia y en una mayor medida, con una ganancia de relación de mejora del 5% sobre GPT-5 Mini y un salto del 31,81% en memorabilidad relativa sobre su versión no dirigida.

También supera a los sistemas enfocados en estética, a pesar de no requerir entrenamiento adicional. Una menor perplexidad, según el artículo, sugiere además que su retroalimentación sigue los mismos patrones lingüísticos que las valoraciones de memorabilidad humanas tienden a recompensar:

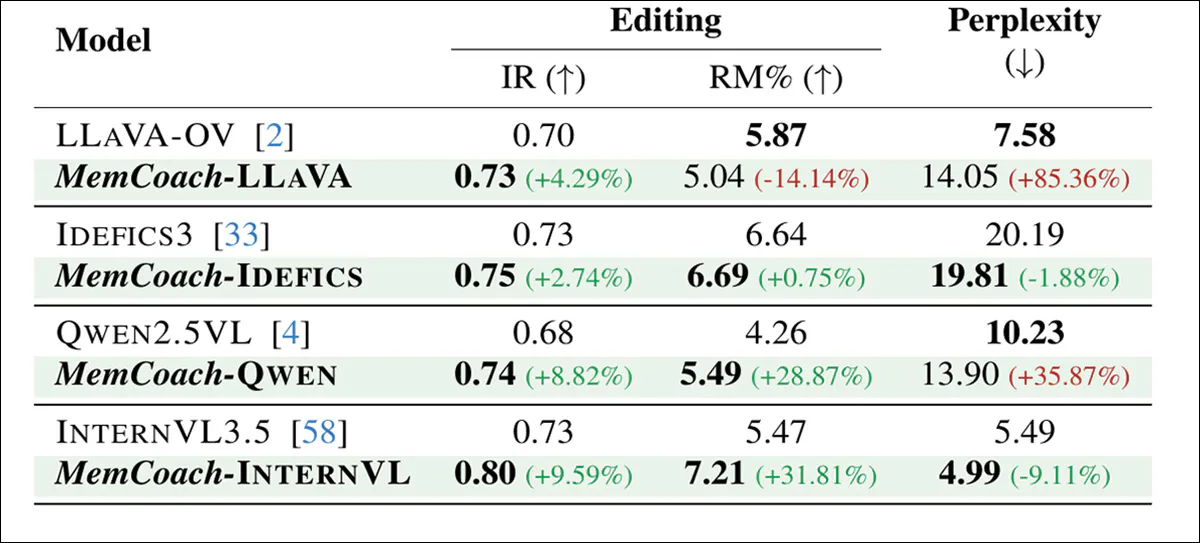

Resultados de generalización que muestran que MemCoach mejora la retroalimentación orientada a la memorabilidad en varios modelos multimodales, aumentando consistentemente la relación de mejora y la memorabilidad relativa, mientras también reduce la perplexidad para la mayoría de los modelos.

Una prueba adicional (ver tabla arriba) indica que agregar MemCoach mejoró la retroalimentación orientada a la memorabilidad en todos los modelos multimodales de backbone probados, con ganancias consistentes en la relación de mejora y la memorabilidad relativa.

Se realizó una evaluación cualitativa, analizando ejemplos de retroalimentación de MemCoach en los que la imagen de origen, la sugerencia de lenguaje natural y el resultado mejorado imaginado se examinaron lado a lado:

Ejemplos cualitativos de retroalimentación orientada a la memorabilidad generada por MemCoach. Cada tríada muestra la imagen de origen, la instrucción de lenguaje natural y la imagen editada resultante, con la memorabilidad relativa (RM) que indica el cambio medido. La orientación varía desde ajustes de postura y mirada hasta intervenciones semánticas como la eliminación de objetos, ilustrando tanto ganancias exitosas como casos en los que la eliminación de elementos inusuales reduce la memorabilidad.

De estos resultados, los autores afirman:

‘Los ejemplos destacan la variedad de sugerencias que el modelo propone, que van desde ajustes de composición detallados, como alterar la dirección de la mirada, la postura o la posición de la mano, hasta intervenciones semánticas que involucran el cambio de expresión facial o la eliminación de objetos.’

‘La retroalimentación es naturalmente interpretable y accionable, expresada en instrucciones textuales concisas (que involucran principalmente verbos como “Acercarse”, “Pararse”, “Eliminar”) que pueden implementarse directamente, verbalizando efectivamente cómo tomar una foto memorable.’

Conclusión

Sería muy interesante comparar la metodología del enfoque de caja cerrada de Google con el proyecto MemBench, no menos para saber qué estándares centrales, referencias y bases de datos utilizó Google para definir los estándares estéticos del sistema.

El aspecto negativo de sistemas de este tipo, de código abierto o cerrado, es que a gran escala corren el riesgo de imponer estándares uniformes que están destinados a terminar como memes y clichés, una especie de equivalente visual de los debates sobre el guion de ChatGPT, donde el procedimiento ‘correcto’ se ha vuelto algo maldito en el uso casual.

* Mi conversión de las citas en línea de los autores a enlaces, si el enlace no se presenta en otro lugar del artículo.

† El artículo se refiere aquí, como en varios otros lugares, a ‘material suplementario’ que no puedo localizar, ya sea desde el artículo, la lista principal de Arxiv o el sitio del proyecto.

Publicado por primera vez el jueves 26 de febrero de 2026