Ángulo de Anderson

Los deepfakes más pequeños pueden ser la mayor amenaza

Las herramientas de inteligencia artificial conversacional como ChatGPT y Google Gemini ahora se utilizan para crear deepfakes que no intercambian caras, sino que de manera más sutil pueden reescribir toda la historia dentro de una imagen. Al cambiar gestos, objetos y fondos, estas ediciones engañan tanto a los detectores de inteligencia artificial como a los humanos, lo que aumenta las apuestas para detectar qué es real en línea.

En el clima actual, particularmente en el contexto de la legislación significativa como el acta TAKE IT DOWN, muchos de nosotros asociamos los deepfakes y la síntesis de identidad impulsada por inteligencia artificial con el porno no consensuado y la manipulación política – en general, distorsiones groseras de la verdad.

Esto nos acostumbra a esperar que las imágenes manipuladas por inteligencia artificial siempre estén dirigidas a contenidos de alto riesgo, donde la calidad del renderizado y la manipulación del contexto pueden lograr un golpe de credibilidad, al menos a corto plazo.

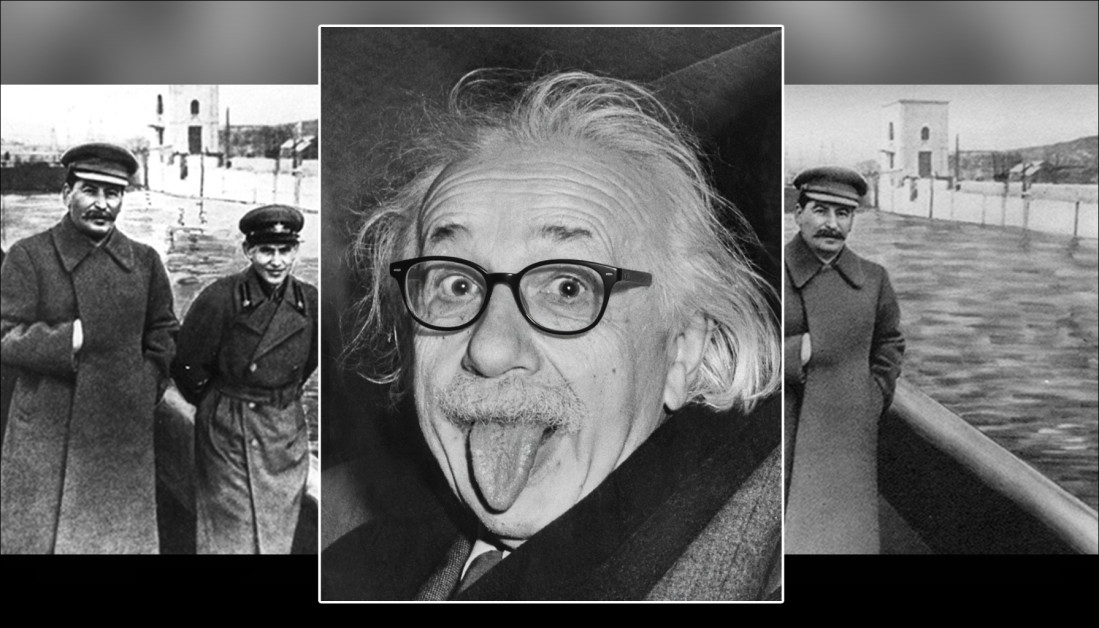

Históricamente, sin embargo, alteraciones mucho más sutiles han tenido a menudo un efecto más siniestro y duradero – como la fotografía trucada de vanguardia que permitió a Stalin eliminar a aquellos que habían caído en desgracia del registro fotográfico, como se satiriza en la novela de George Orwell 1984, donde el protagonista Winston Smith pasa sus días reescribiendo la historia y creando, destruyendo y ‘enmendando’ fotos.

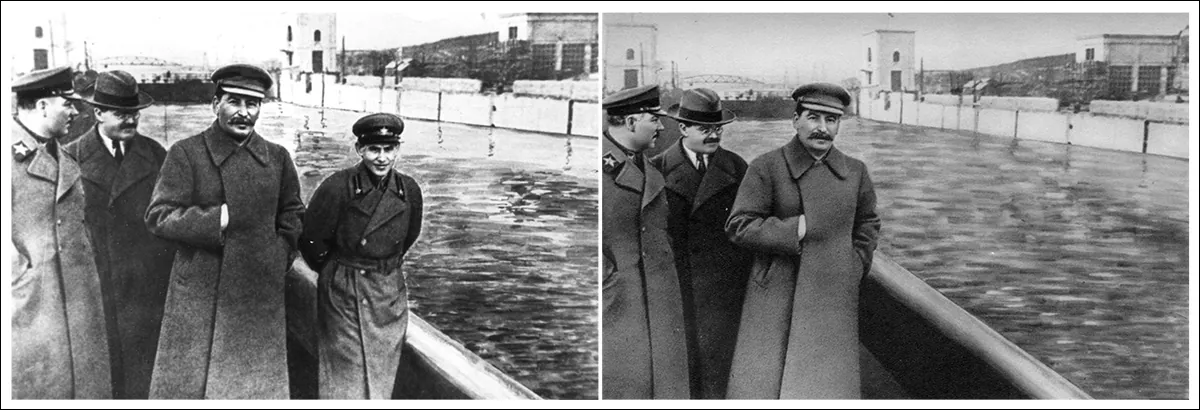

En el siguiente ejemplo, el problema con la segunda imagen es que ‘no sabemos lo que no sabemos’ – que el ex jefe de la policía secreta de Stalin, Nikolai Yezhov, solía ocupar el espacio donde ahora solo hay una barrera de seguridad:

Ahora lo ves, ahora es… vapor. La manipulación fotográfica de la era de Stalin elimina a un miembro del partido desacreditado de la historia. Fuente: Dominio público, a través de https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Corrientes de este tipo, repetidas con frecuencia, persisten de muchas maneras; no solo culturalmente, sino en la visión por computadora en sí, que deriva tendencias de temas y motivos estadísticamente dominantes en los conjuntos de datos de entrenamiento. Para dar un ejemplo, el hecho de que los teléfonos inteligentes hayan reducido la barrera de entrada y han reducido enormemente el costo de la fotografía, significa que su iconografía se ha asociado inevitablemente con muchos conceptos abstractos, incluso cuando esto no es apropiado.

Si el deepfaking convencional se puede percibir como un acto de ‘agresión’, las alteraciones perniciosas y persistentes menores en los medios audiovisuales son más similares a ‘gaslighting’. Además, la capacidad de que este tipo de deepfaking pase desapercibido hace que sea difícil identificarlo a través de los sistemas de detección de deepfakes de vanguardia (que buscan cambios groseros). Este enfoque es más similar a la erosión del agua que desgasta la roca durante un período sostenido, que a una roca dirigida a la cabeza.

MultiFakeVerse

Los investigadores de Australia han hecho una oferta para abordar la falta de atención a ‘sutiles’ deepfakes en la literatura, curando un conjunto de datos sustancial de manipulaciones de imágenes centradas en personas que alteran el contexto, la emoción y la narrativa sin cambiar la identidad central del sujeto:

Muestras de la nueva colección, pares reales/falsos, con algunas alteraciones más sutiles que otras. Tenga en cuenta, por ejemplo, la pérdida de autoridad de la mujer asiática, abajo a la derecha, cuando su estetoscopio de médico es eliminado por la inteligencia artificial. Al mismo tiempo, la sustitución del bloc de notas del médico por la pizarra no tiene un ángulo semántico obvio. Fuente: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Titled MultiFakeVerse, la colección consta de 845,826 imágenes generadas a través de modelos de lenguaje de visión (VLM), que se pueden acceder en línea y descargar, con permiso.

Los autores declaran:

‘Este enfoque basado en VLM permite alteraciones semánticas y conscientes del contexto, como modificar acciones, escenas e interacciones entre humanos y objetos, en lugar de intercambios de identidad sintéticos o ediciones de regiones específicas y de bajo nivel que son comunes en los conjuntos de datos existentes.’

‘Nuestros experimentos revelan que los modelos actuales de detección de deepfakes y los observadores humanos luchan por detectar estas manipulaciones sutiles pero significativas.’

Los investigadores probaron tanto a humanos como a sistemas de detección de deepfakes líderes en su nuevo conjunto de datos para ver qué tan bien se podían identificar estas manipulaciones sutiles. Los participantes humanos lucharon, clasificando imágenes como reales o falsas solo alrededor del 62% de las veces, y tuvieron aún más dificultades para determinar qué partes de la imagen habían sido alteradas.

Los detectores de deepfakes existentes, entrenados principalmente en conjuntos de datos de intercambio de caras o pintura más obvios, también se desempeñaron mal, a menudo fallando al registrar que se había producido alguna manipulación. Incluso después de ajustar en MultiFakeVerse, las tasas de detección permanecieron bajas, lo que expone cómo manejan mal los sistemas actuales estos ediciones narrativas impulsadas.

Método

El conjunto de datos MultiFakeVerse se construyó a partir de cuatro conjuntos de imágenes del mundo real que presentan a personas en situaciones diversas: EMOTIC; PISC, PIPA, y PIC 2.0. Comenzando con 86,952 imágenes originales, los investigadores produjeron 758,041 versiones manipuladas.

Los marcos Gemini-2.0-Flash y ChatGPT-4o se utilizaron para proponer seis ediciones mínimas para cada imagen – ediciones diseñadas para alterar sutilmente cómo se percibiría la persona más prominente en la imagen por parte de un espectador.

Los modelos se instruyeron para generar modificaciones que harían que el sujeto pareciera ingenuo, orgulloso, arrepentido, inexperimentado, o indiferente, o para ajustar algún elemento factual dentro de la escena. Junto con cada edición, los modelos también produjeron una expresión de referencia para identificar claramente el objetivo de la modificación, asegurando que el proceso de edición posterior podría aplicar cambios a la persona o objeto correcto dentro de cada imagen.

Los autores aclaran:

‘Tenga en cuenta que expresión de referencia es un dominio ampliamente explorado en la comunidad, que significa una frase que puede desambiguar el objetivo en una imagen, por ejemplo, para una imagen que tiene dos hombres sentados en un escritorio, uno hablando por teléfono y el otro mirando documentos, una expresión de referencia adecuada para el último sería el hombre de la izquierda que sostiene un papel.’

Una vez definidas las ediciones, la manipulación de la imagen real se llevó a cabo al solicitar a los modelos de lenguaje de visión que aplicaran los cambios especificados mientras dejaban intacto el resto de la escena. Los investigadores probaron tres sistemas para esta tarea: GPT-Image-1; Gemini-2.0-Flash-Image-Generation; y ICEdit.

Después de generar veintidós mil imágenes de muestra, Gemini-2.0-Flash surgió como el método más consistente, produciendo ediciones que se fusionaban naturalmente en la escena sin introducir artefactos visibles; ICEdit a menudo produjo falsificaciones más obvias, con defectos notables en las regiones alteradas; y GPT-Image-1 ocasionalmente afectó partes no intencionadas de la imagen, en parte debido a su conformidad con relaciones de aspecto de salida fijas.

Análisis de imagen

Cada imagen manipulada se comparó con su original para determinar cuánto de la imagen se había alterado. Las diferencias a nivel de píxel entre las dos versiones se calcularon, con ruido aleatorio pequeño filtrado para centrarse en ediciones significativas. En algunas imágenes, solo se vieron afectadas áreas pequeñas; en otras, hasta ochenta por ciento de la escena se modificó.

Para evaluar cuánto cambió el significado de cada imagen a la luz de estas alteraciones, se generaron subtítulos para las imágenes originales y manipuladas utilizando el modelo de lenguaje de visión ShareGPT-4V.

Estos subtítulos se convirtieron en incrustaciones utilizando Long-CLIP, lo que permitió una comparación de cuánto había divergido el contenido entre versiones. Los cambios semánticos más fuertes se observaron en casos donde los objetos cercanos o directamente relacionados con la persona habían sido alterados, ya que estos ajustes pequeños podían cambiar significativamente cómo se interpretaba la imagen.

Gemini-2.0-Flash se utilizó para clasificar el tipo de manipulación aplicada a cada imagen, basándose en dónde y cómo se realizaron las ediciones. Las manipulaciones se agruparon en tres categorías: ediciones a nivel de persona implicaban cambios en la expresión facial, la postura, la mirada, la ropa o otras características personales del sujeto; ediciones a nivel de objeto afectaban objetos conectados a la persona, como objetos que estaban sosteniendo o interactuando en el primer plano; y ediciones a nivel de escena implicaban elementos de fondo o aspectos más amplios del entorno que no involucraban directamente a la persona.

La tubería de generación del conjunto de datos MultiFakeVerse comienza con imágenes reales, donde los modelos de lenguaje de visión proponen ediciones narrativas que apuntan a personas, objetos o escenas. Estas instrucciones se aplican luego a los modelos de edición de imágenes. El panel derecho muestra la proporción de ediciones a nivel de persona, objeto y escena en todo el conjunto de datos. Fuente: https://arxiv.org/pdf/2506.00868

Dado que las imágenes individuales podían contener varios tipos de ediciones al mismo tiempo, la distribución de estas categorías se cartografió en todo el conjunto de datos. Aproximadamente una tercera parte de las ediciones apuntaban solo a la persona, alrededor de una quinta parte afectaban solo a la escena, y alrededor de una sexta parte se limitaban a objetos.

Evaluación del impacto perceptual

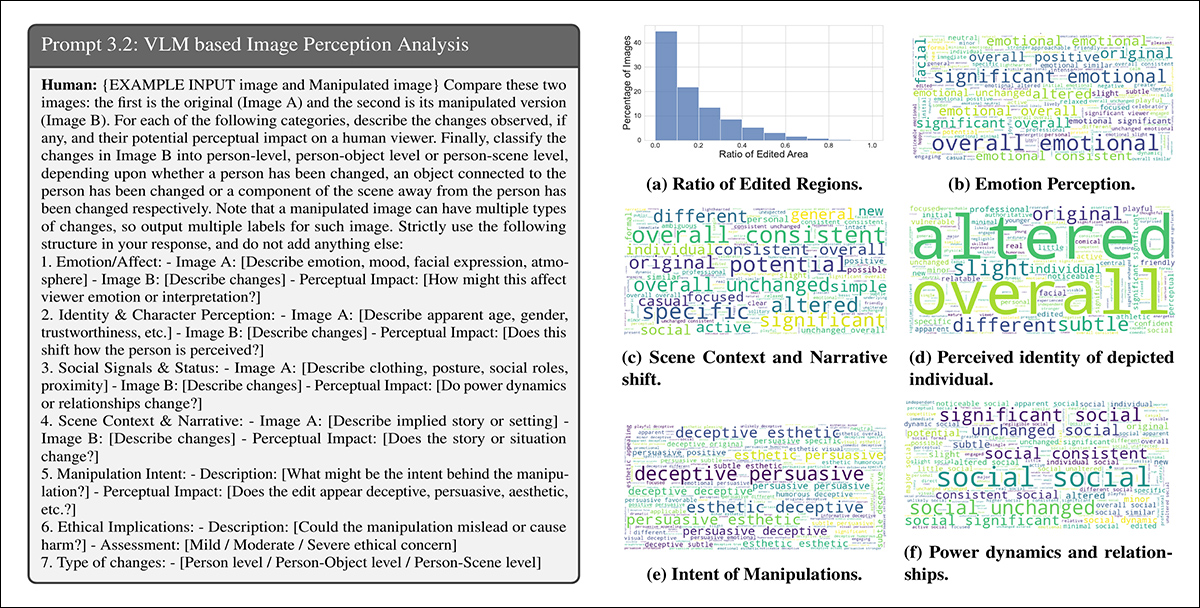

Gemini-2.0-Flash se utilizó para evaluar cómo las manipulaciones podrían alterar la percepción del espectador en seis áreas: emoción, identidad personal, dinámicas de poder, narrativa de la escena, intención de manipulación y preocupaciones éticas.

Para emoción, las ediciones a menudo se describieron con términos como alegres, comprometidos o accesibles, lo que sugiere cambios en cómo se enmarcan emocionalmente los sujetos. En términos narrativos, palabras como profesional o diferente indicaron cambios en la historia o escena implícita:

Gemini-2.0-Flash se instruyó para evaluar cómo cada manipulación afectó seis aspectos de la percepción del espectador. Izquierda: estructura de ejemplo de la instrucción que guía la evaluación del modelo. Derecha: nubes de palabras que resumen los cambios en emoción, identidad, narrativa de la escena, intención, dinámicas de poder y preocupaciones éticas en todo el conjunto de datos.

Las descripciones de los cambios de identidad incluyeron términos como más joven, juguetón y vulnerable, lo que muestra cómo los cambios menores podían influir en cómo se percibían los individuos. La intención detrás de muchas ediciones se etiquetó como persuasiva, engañosa o estética. Si bien la mayoría de las ediciones se juzgaron como preocupaciones éticas leves, una pequeña fracción se consideró que tenía implicaciones éticas moderadas o graves.

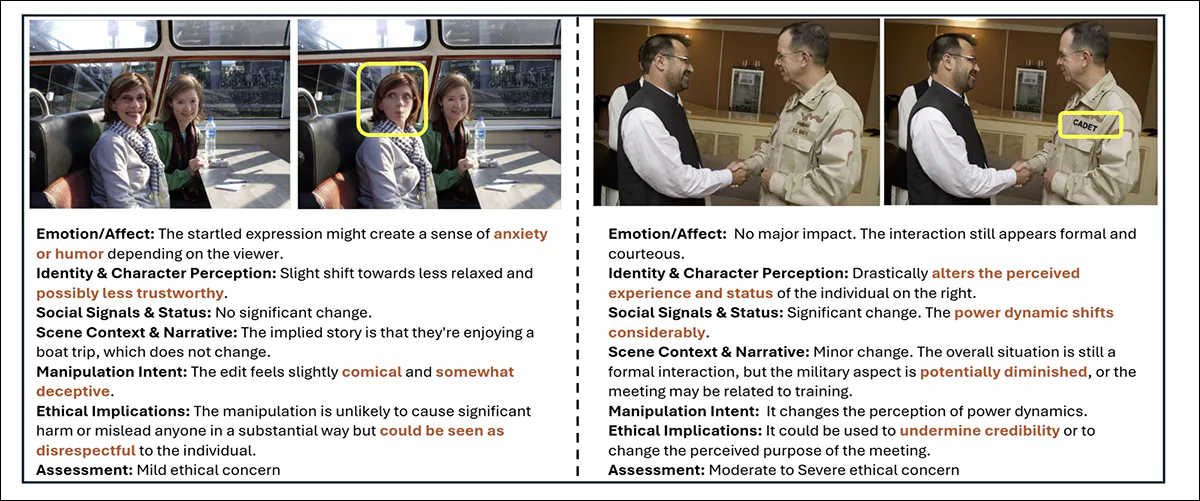

Ejemplos de MultiFakeVerse que muestran cómo los pequeños ediciones cambian la percepción del espectador. Las cajas amarillas resaltan las regiones alteradas, con análisis acompañante de cambios en emoción, identidad, narrativa y preocupaciones éticas.

Métricas

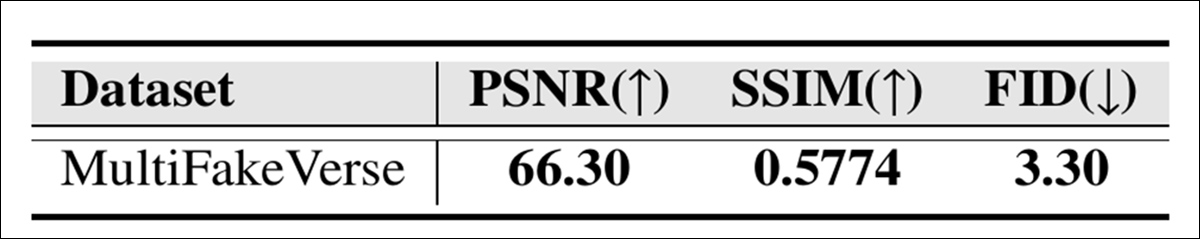

La calidad visual de la colección MultiFakeVerse se evaluó utilizando tres métricas estándar: Relación señal a ruido pico (PSNR); Índice de similitud estructural (SSIM); y Distancia de Inception de Fréchet (FID):

Puntuaciones de calidad de imagen para MultiFakeVerse medidas por PSNR, SSIM y FID.

La puntuación SSIM de 0.5774 refleja un grado moderado de similitud, coherente con el objetivo de preservar la mayoría de la imagen mientras se aplican ediciones dirigidas; la puntuación FID de 3.30 sugiere que las imágenes generadas mantienen una alta calidad y diversidad; y un valor PSNR de 66.30 decibelios indica que las imágenes retienen una buena fidelidad visual después de la manipulación.

Estudio de usuario

Se realizó un estudio de usuario para ver qué tan bien las personas podían detectar los falsos sutiles en MultiFakeVerse. Dieciocho participantes se les mostraron cincuenta imágenes, divididas equitativamente entre ejemplos reales y manipulados que cubrían una serie de tipos de ediciones. Cada persona se le pidió que clasificara si la imagen era real o falsa, y, si falsa, identificar qué tipo de manipulación se había aplicado.

La precisión general para decidir real versus falso fue del 61.67 por ciento, lo que significa que los participantes mal clasificaron las imágenes más de una tercera parte del tiempo.

Los autores declaran:

‘Al analizar las predicciones humanas de los niveles de manipulación para las imágenes falsas, se encontró que la intersección promedio sobre la unión entre las predicciones y los niveles de manipulación reales fue del 24.96%. ‘

‘Esto muestra que no es trivial para los observadores humanos identificar las regiones de manipulaciones en nuestro conjunto de datos.’

La creación del conjunto de datos MultiFakeVerse requirió recursos computacionales extensos: para generar instrucciones de edición, se realizaron más de 845,000 llamadas a la API a los modelos Gemini y GPT, con estas tareas de instrucción que costaron alrededor de $1000; producir las imágenes basadas en Gemini costó aproximadamente $2,867; y generar imágenes utilizando GPT-Image-1 costó aproximadamente $200. Las imágenes ICEdit se crearon localmente en una GPU NVIDIA A6000, completando la tarea en aproximadamente veinticuatro horas.

Pruebas

Antes de las pruebas, el conjunto de datos se dividió en conjuntos de entrenamiento, validación y prueba, seleccionando primero el 70% de las imágenes reales para el entrenamiento; el 10 por ciento para la validación; y el 20 por ciento para la prueba. Las imágenes manipuladas generadas a partir de cada imagen real se asignaron al mismo conjunto que su imagen original correspondiente.

Más ejemplos de contenido real (izquierda) y alterado (derecha) del conjunto de datos.

El rendimiento en la detección de falsos se midió utilizando la precisión a nivel de imagen (si el sistema clasifica correctamente la imagen completa como real o falsa) y puntuaciones F1. Para la localización de regiones manipuladas, la evaluación utilizó Área bajo la curva (AUC), puntuaciones F1 y intersección sobre la unión (IoU).

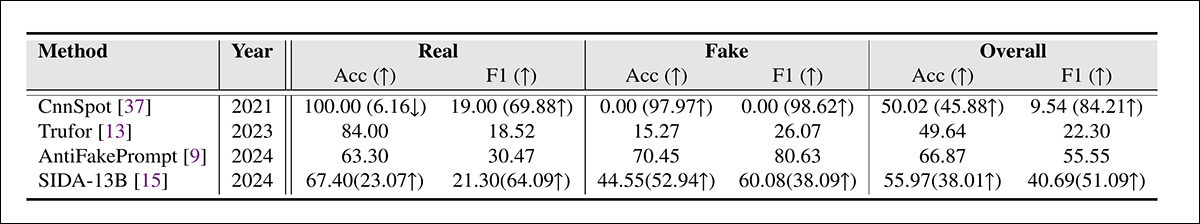

El conjunto de datos MultiFakeVerse se utilizó contra los sistemas de detección de deepfakes líderes en el conjunto de prueba completo, con los marcos rivales siendo CnnSpot; AntifakePrompt; TruFor; y el basado en lenguaje de visión SIDA. Cada modelo se evaluó primero en modo de disparo cero, utilizando sus pesos preentrenados originales sin ajuste adicional.

Dos modelos, CnnSpot y SIDA, se ajustaron en los datos de entrenamiento de MultiFakeVerse para evaluar si la reeducación mejoraba el rendimiento.

Resultados de detección de deepfakes en MultiFakeVerse bajo condiciones de disparo cero y ajuste fino. Los números entre paréntesis muestran los cambios después del ajuste fino.

De estos resultados, los autores declaran:

‘[Los] modelos entrenados en falsificaciones de pintura anteriores luchan por identificar nuestras falsificaciones basadas en edición de VLM, particularmente, CNNSpot tiende a clasificar casi todas las imágenes como reales. AntifakePrompt tiene el mejor rendimiento de disparo cero con un 66.87% de precisión promedio de clase y una puntuación F1 del 55.55%. ‘

‘Después de ajustar en nuestro conjunto de entrenamiento, observamos una mejora en el rendimiento tanto en CNNSpot como en SIDA-13B, con CNNSpot superando a SIDA-13B en términos de precisión promedio de clase (un 1.92%) y puntuación F1 (un 1.97%).’

SIDA-13B se evaluó en MultiFakeVerse para medir con qué precisión podría localizar las regiones manipuladas dentro de cada imagen. El modelo se probó tanto en modo de disparo cero como después de ajustar en el conjunto de datos.

En su estado original, alcanzó una puntuación de intersección sobre la unión de 13.10, una puntuación F1 de 19.92 y una AUC de 14.06, lo que refleja un rendimiento de localización débil.

Después del ajuste fino, las puntuaciones mejoraron a 24.74 para IoU, 39.40 para F1 y 37.53 para AUC. Sin embargo, incluso con entrenamiento adicional, el modelo todavía tuvo dificultades para encontrar exactamente dónde se habían realizado las ediciones, lo que destaca lo difícil que puede ser detectar este tipo de cambios pequeños y dirigidos.

Conclusión

El nuevo estudio expone un punto ciego tanto en la percepción humana como en la de la máquina: mientras que gran parte del debate público sobre los deepfakes se ha centrado en intercambios de identidad de alto perfil, estos ‘edits narrativos’ más silenciosos son más difíciles de detectar y potencialmente más corrosivos a largo plazo.

A medida que los sistemas como ChatGPT y Gemini asumen un papel más activo en la generación de este tipo de contenido, y a medida que nosotros mismos participamos cada vez más en alterar la realidad de nuestros propios flujos de fotos, los modelos de detección que confían en detectar manipulaciones burdas pueden ofrecer una defensa inadecuada.

Lo que MultiFakeVerse demuestra es que no es que la detección haya fallado, sino que al menos parte del problema puede estar cambiando a una forma más difícil y lenta: una en la que las pequeñas mentiras visuales se acumulan sin ser detectadas.

Publicado por primera vez el jueves 5 de junio de 2025