Ángulo de Anderson

Utilizando ‘Probabilidad’ como Métrica de Detección de Deepfakes

Si el video y el audio generados por IA son lo suficientemente buenos, los detectores de deepfakes basados en artefactos visuales u otros señales tradicionales ya no funcionarán. Pero dado que las personas rara vez se desvían del comportamiento predecible, quizás la ‘probabilidad’ podría adoptarse más profundamente como una señal de si un video o un rumor de noticias es probable que sea cierto.

Opinión A principios de la década de 1990, el respetado ex futbolista británico y comentarista deportivo de televisión David Icke reveló casualmente en un programa de entrevistas que era ‘el hijo de Dios’ – una revelación extraña y inesperada que evolucionaría en las siguientes décadas en una persistente y teoría de la conspiración elaborada sobre un cabal secreto y poderoso a nivel mundial de ‘gente lagarto’.

Con la adopción de Internet aún algunos años en el futuro, y el advenimiento de las redes sociales aún más lejos, la disonancia entre la celebridad de Icke y la naturaleza de sus nuevas ideas tuvo un impacto profundo en el público británico – sobre todo debido a la falta total de contexto o cualquier tipo de preparación para este gran giro, desde una personalidad deportiva bien conocida y establecida.

Más de veinte años después, una cepa similar y mucho más oscura de este choque social ocurrió cuando el querido activista benéfico y presentador de televisión infantil Jimmy Savile fue encontrado póstumamente como un delincuente sexual serial y rapaz que había utilizado su imagen pública intachable para facilitar sus crímenes.

La posterior investigación policial de la Operación Yewtree descubriría muchos más celebridades del Reino Unido con historias largas de delitos sexuales; más tarde, la prosecución de Harvey Weinstein llevaría a un descubrimiento similar de delincuentes sexuales celebridades en los EE. UU., evolucionando en el movimiento #MeToo, y se integraría permanentemente en la cultura estadounidense en producciones como The Morning Show. Las noticias de ‘choque’ parecían estar desarrollando una nueva y abrupta plantilla – una que eventualmente sería adoptada por los atacantes de deepfakes.

El fin de la detección de deepfakes ‘tradicional’

Incluso si las redes sociales y la IA hubieran estado disponibles a principios de la década de 1990, ningún sistema predictivo en el mundo podría haber previsto las revelaciones de Icke en el programa de entrevistas, que (como recuerdo bien) no fueron anunciadas de ninguna manera en los años previos al evento.

Pero entonces, si la IA hubiera estado disponible, podría haber llevado algún tiempo convencer a una audiencia más amplia de que las declaraciones de Icke no eran el producto de Google Veo 3, o de otro nuevo tipo de marco de deepfakes de audio / video hiperrealistas.

Solo en los últimos 6-12 meses, los métodos de deepfakes de IA se han vuelto lo suficientemente efectivos como para cumplir años de predicciones de los medios sobre la interferencia de deepfakes en las elecciones, y capaces de generar el tipo de mancha reputacional rápida que es falsa, pero difícil de erradicar en una cultura cada vez más crédula.

Hasta la fecha, la salida de video de IA suele ser menos realista, limitada por obstáculos técnicos y cada vez más polarizada por una brecha creciente entre modelos restrictivos occidentales y lanzamientos de código abierto sin censura de China**.

Sin embargo, noto cada vez más en la literatura de investigación una concesión creciente de esta guerra fría, por ejemplo, en el nuevo artículo Decaimiento del rendimiento en la detección de deepfakes†:

‘[Suponemos] que los videos deepfakes seguirán conteniendo características aprendidas por máquina que distingan confiablemente entre ellos y los videos genuinos. A medida que las capacidades de la IA generativa sigan avanzando rápidamente, esta suposición puede romperse.

‘En tal escenario, el marcado de agua y otros métodos de seguimiento de procedencia ofrecerán el único recurso para mantener la confianza en los medios digitales.’

Sin embargo, el mismo artículo reconoce que las soluciones basadas en la procedencia, como la Iniciativa de Autenticidad de Contenido liderada por Adobe (y las muchas ofertas de investigación más pequeñas de los últimos 7-8 años) requieren una adopción tan generalizada que resulta irrealista; y el artículo termina con una nota general de retirada, si no de derrota.

Si los métodos de detección de deepfakes de audiovisuales son superados por la IA generativa, y la adopción global de un esquema de marcado de agua o procedencia tropieza con obstáculos logísticos diversos, ¿qué característica común central podría reemplazarlos como indicadores de una posible salida falsa? ¿O debemos resignarnos a un mundo donde todos los medios estén en duda, y el Dividendo del Mentiroso prevalece?

Gráficos de conocimiento

Parece que es hora de aprovechar más profundamente la probabilidad y la plausibilidad de los ‘eventos informados’ como una característica de señalización en la detección de deepfakes. Además, dado que los sistemas de IA generativa de video y audio están convergiendo cada vez más, también puede ser hora de que las líneas de investigación separadas de ‘noticias falsas’ (como un evento narrativo basado en texto) y las imágenes / videos falsos converjan.

Una métrica de deepfakes de probabilidad no es lo mismo que la RAG con la ayuda de verificación de hechos, donde un modelo de IA puede traer resultados web actuales para obtener conocimiento de eventos que ocurren después de su propia fecha de corte, y / o para corroborar sus afirmaciones.

En cambio, realizaría predicciones basadas en tendencias estadísticas generalmente indicativas, derivadas de patrones históricos que se ajustan a una investigación actual.

En este sentido, un método de probabilidad está más cerca del análisis estadístico que de los enfoques más modernos en la escena actual de aprendizaje automático.

Aunque anteriormente eclipsados por enfoques de la era de los Transformadores, los gráficos de conocimiento están haciendo algo de un regreso en el espacio empresarial, y parecen adaptados para el despliegue potencial de métricas de ‘probabilidad’ en la detección de deepfakes.

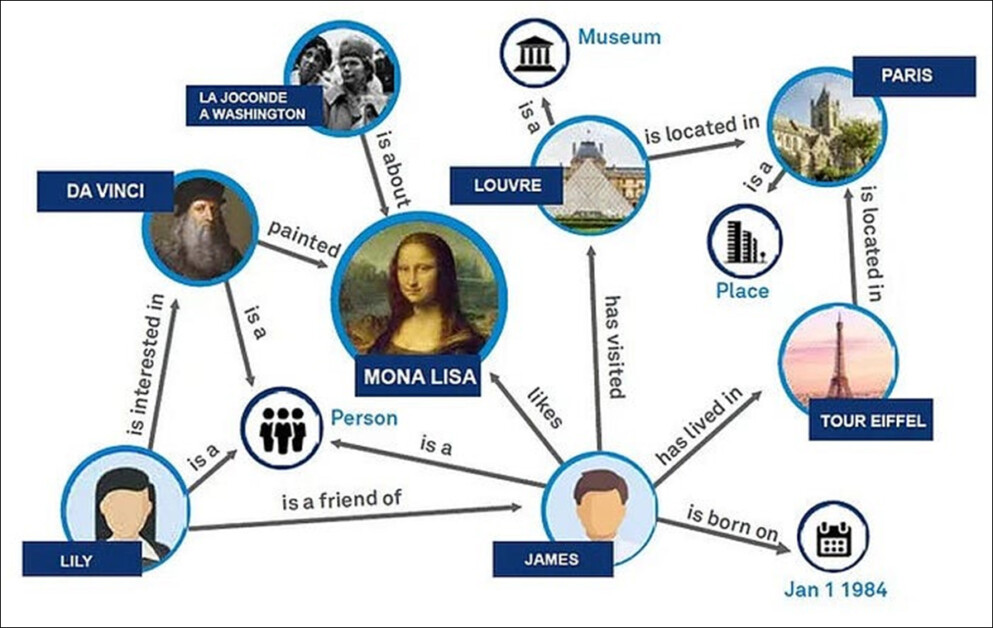

Un gráfico de conocimiento simplificado que ilustra cómo las personas, lugares, obras de arte y eventos pueden estar vinculados a través de relaciones etiquetadas, permitiendo que las máquinas razonen sobre entidades y conexiones del mundo real. Fuente

Un gráfico de conocimiento es una forma de organizar información mediante la creación de un mapa de hechos del mundo real, como personas, empresas, eventos o ideas, en una red de hechos conectados.

Cada subentidad es un nodo, y los enlaces entre ellos (aristas) describen cómo se relacionan. Por ejemplo, ‘Microsoft’ (un nodo) podría estar vinculado a ‘OpenAI’ (otro nodo) por una arista que dice ‘es un cliente de’. Estas conexiones suelen almacenarse en bases de datos de gráficos y siguen una estructura de sujeto-predicado-objeto, como ‘Microsoft es un cliente de OpenAI’.

Memoria persistente

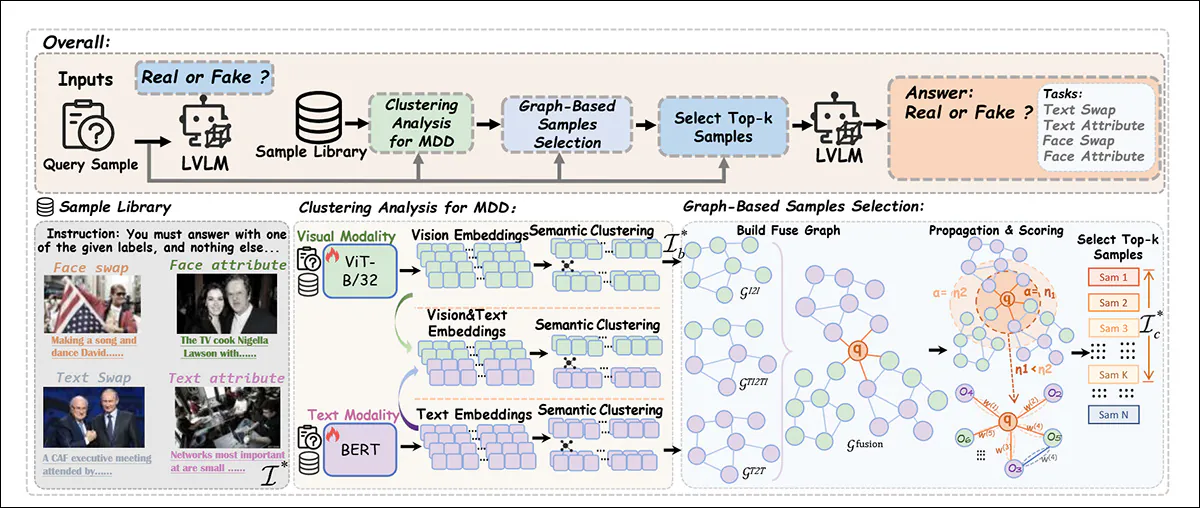

Un estudio chino de septiembre de este año propuso un método sin entrenamiento que utiliza razonamiento basado en gráficos para detectar inconsistencias sutiles en deepfakes multimodales.

En lugar de generar razonamientos o ajustar modelos grandes, el sistema recupera pares de imagen-texto, construye un gráfico de similitud y puntuación de conexiones, para recuperar los ejemplos más relevantes, y estos guían el juicio del modelo sin necesidad de nuevo entrenamiento:

Una visión general del marco GASP-ICL, que mejora la detección de deepfakes combinando la selección de muestras basada en gráficos con el aprendizaje en contexto, lo que permite a un modelo de visión-lenguaje congelado clasificar pares de imagen/texto como reales o falsos, sin entrenamiento ni ajuste. Fuente

Este es probablemente el trabajo más cercano, ciertamente el que ha cruzado mi camino, a un enfoque ‘informado’ y consciente de la historia para la evaluación y verificación de la salida de los medios.

Para la mayoría de los casos, los enfoques de visión por computadora siguen analizando imágenes (incluidos los fotogramas de los videos y anomalías temporales que abarcan múltiples fotogramas) mientras que los marcos de detección de ‘noticias falsas’ siguen enfatizando los datos basados en texto, incluso en proyectos multimodales.

Creep de características

El desafío de un sistema predictivo de este tipo es el alcance de la vigilancia que puede ser necesario para que el enfoque sea completamente performante – al menos más allá del análisis de celebridades y figuras públicas, para las cuales ya existen datos libremente accesibles.

Probablemente la corriente de investigación más similar actual es el campo de pre-delito, que etiqueta diversas señales de inteligencia multimodal como ‘sospechosas’, y se presenta como un espantapájaros de IA en producciones como Person of Interest (2011-2016) y Minority Report (2002).

Mientras que un sistema de vigilancia estilo Person of Interest produciría resultados óptimos, es poco probable que la cultura occidental pueda sancionar el nivel de intrusión personal que imponen las redes internas de China en sus ciudadanos.

Por lo tanto, en cuanto a noticias falsas sobre no celebridades, solo las agencias gubernamentales, como la policía (así como los registros de nacimientos y defunciones y las oficinas de impuestos), tendrían suficiente información histórica pertinente para informar probabilidades en un flujo de trabajo basado en gráficos; y incluso ellos necesitarían voluntad, capacidad, legislación y recursos al estilo de la CCCP para incluir a los ciudadanos promedio en su cobertura y análisis (es decir, más allá de los puntos de datos banales pero obligatorios como números de pasaporte y registros de vehículos).

Puntuación de probabilidad

Parece probable que la efectividad potencial de un sistema de este tipo se vería limitada a los casos de uso más obvios (actuales) para el contenido de deepfakes: destabilización (deepfakes respaldados por el estado); deepfakes de celebridades y ‘desconocidos’ pornográficos (que pueden considerarse maliciosos, aunque el último caso tiende a atraer una mayor preocupación de los medios); fraude (incluidos deepfakes de audio / video diseñados para realizar ‘estafas de impersonación’); y asesinato del carácter político.

Un sistema basado en conocimiento necesitaría una escala de probabilidades para una diversidad de eventos posibles. En un extremo del espectro, fallos humanos comunes como la gestión financiera cuestionable, la infidelidad, la adicción, la indiscreción, etc.; en el otro… revelar que eres el hijo de Dios en un programa de entrevistas en vivo (o eventos de una escala y impacto similares).

Incluso en el último caso, los factores históricos personales para cualquier individuo pesarían el resultado de la probabilidad: una figura política prominente que ha vacilado públicamente en asuntos controvertidos (como la veracidad de los alunizajes de la década de 1960/70) para ganar capital con un electorado cada vez más ‘alternativamente informado’ podría ganar un estatus adicional de comodín en las rutinas de verificación, en comparación con sus compañeros más comedidos.

En el caso de la pornografía de celebridades, hay un contexto del mundo real suficiente (es decir, las filtraciones de fotos de celebridades de 2012, entre otros incidentes relativamente raros) para generar un Dividendo del Mentiroso moderado, en ciertos contextos; pero como estos incidentes de outliers tienden a operar como excepciones que prueban la regla, la mayoría de los videos de pornografía de celebridades basados en difusión actuales se considerarían extremadamente ‘improbables’ (aunque esto no resuelve el problema de la apropiación de identidades para tales propósitos).

En cuanto a la perturbación nacional, hay una gran riqueza de datos estadísticos que pueden ayudar a evaluar las probabilidades de ‘informes desastrosos’. Incluso en la historia antigua, los eventos aparentemente ‘de la nada’ como la erupción del volcán no identificado Vesubio en 79 d.C. fueron presagiados, si se hubiera prestado suficiente atención; y además de la disponibilidad de una gran cantidad de fuentes gubernamentales y de ONG, la capacidad de la IA para extraer estructura de datos sin procesar puede proporcionar contexto histórico adicional para la puntuación de probabilidad.

Conclusión

Incluso un sistema predictivo bien implementado de este tipo no podría dar cuenta del azar, los actos de Dios, los acontecimientos extraños o de los eventos maliciosos concebidos lejos de toda supervisión.

Además, el volumen y la profundidad de los datos necesarios, para proporcionar cobertura también para personas no famosas, serían un punto de partida político – al menos, por el momento.

Sin embargo, las opciones parecen estar disminuyendo; el análisis basado en la visión está a punto de fallar ante la mejora de la IA generativa, mientras que los esquemas de verificación y procedencia llevan una carga de deuda técnica y fricción contra la adopción. Esto hace que soluciones como la Iniciativa de Autenticidad de Contenido y el sistema de derechos de autor de caras de Metaphysic.ai Metaphysic Pro sean desafiantes para popularizar.

En su uso más amplio, los sistemas RAG solo pueden determinar si una fuente de autoridad respalda una afirmación no verificada; y dado que muchas grandes historias de noticias (verdaderas) surgen sin contexto previo, la falta de sustanciación de fuentes de autoridad no es necesariamente significativa.

Su valor puede demostrar ser mayor si pueden formar parte de un ecosistema de datos más grande preocupado por lo que la mayoría de las formas actuales de IA encuentran desafiante – el contexto histórico.

* No debe confundirse con los primeros autoencoder que debutaron en 2017 y eventualmente serían reemplazados por enfoques superiores.

† https://arxiv.org/abs/2511.07009

** Que pueden ejecutarse libremente en PCs domésticos más potentes, en lugar de estar disponibles solo a través de API como ChatGPT y la serie Veo.

††† Omitiendo usos legítimos de entretenimiento, como efectos visuales profesionales en producciones de cine y televisión.

Publicado por primera vez el jueves 13 de noviembre de 2025