Ángulo de Anderson

Contaminación de la búsqueda por la inteligencia artificial: riesgo de ‘colapso de recuperación’

Al contaminar la web con contenido de inteligencia artificial, se abre un nuevo vector de ataque en el campo de batalla de la consenso cultural.

Investigaciones lideradas por una empresa de búsqueda coreana argumentan que a medida que las páginas generadas por inteligencia artificial se infiltran en los resultados de búsqueda, socavan la estabilidad de los pipelines de búsqueda y clasificación y debilitan los sistemas – como la Generación mejorada por recuperación (RAG) – que dependen de esas clasificaciones para decidir qué información se presenta y se considera confiable, aumentando así el riesgo de que material engañoso o inexacto sea tratado como autorizado.

El término acuñado por los investigadores para este síndrome es Colapso de recuperación, distinto de la amenaza conocida de colapso de modelo (donde la inteligencia artificial entrenada con su propia salida se vuelve progresivamente peor).

En un escenario de Colapso de recuperación, el contenido generado por inteligencia artificial progresa dominando los resultados de los motores de búsqueda, hasta el punto de que incluso cuando las respuestas siguen siendo superficialmente precisas, la base de evidencia subyacente se habrá divorciado de las fuentes humanas originales. Sin embargo, estos datos “sin raíces” parecen estar a punto de alcanzar un lugar destacado en los resultados de búsqueda*:

‘Con la proliferación de texto generado por inteligencia artificial, desafíos en atribución y calidad de datos de preentrenamiento se han intensificado. A diferencia del spam tradicional de palabras clave spam, el contenido sintético moderno es semánticamente coherente, lo que le permite integrarse en los sistemas de clasificación y propagarse a través de pipelines como evidencia autorizada.’

El documento afirma que esto crearía un entorno ‘estructuralmente frágil’ en el que las señales de clasificación favorecen las páginas producidas por inteligencia artificial y optimizadas para SEO, desplazando las fuentes autorizadas por humanos con el tiempo de una manera insidiosa, es decir, sin desencadenar caídas obvias en la calidad de las respuestas:

‘El [crecimiento] de contenido generado por inteligencia artificial en la web presenta un riesgo estructural para la recuperación de información, ya que los motores de búsqueda y los sistemas de Generación mejorada por recuperación (RAG) consumen cada vez más evidencia producida por los grandes modelos de lenguaje (LLM).

‘Caracterizamos este modo de fallo a nivel de ecosistema como Colapso de recuperación, un proceso de dos etapas en el que (1) el contenido generado por inteligencia artificial domina los resultados de búsqueda, erosionando la diversidad de fuentes, y (2) el contenido de baja calidad o adversarial se infiltra en el pipeline de recuperación.’

Los investigadores sostienen que una vez que se establece la fase de ‘dominancia’, el mismo pipeline de recuperación se vuelve más susceptible a la contaminación deliberada, ya que las páginas adversariales pueden explotar los mismos mecanismos de optimización para ganar visibilidad*:

‘Al establecer el marco del Colapso de recuperación, este trabajo senta las bases para comprender cómo el contenido sintético redefine la recuperación de información. Para mitigar estos riesgos, proponemos un cambio hacia estrategias de clasificación defensiva que optimicen conjuntamente la relevancia, la facticidad y la procedencia.’

El Colapso de recuperación probablemente exacerbaría el colapso de modelo, ya que agrega una capa de intención maliciosa al ‘efecto de fotocopia’ de la entropía, donde la inteligencia artificial se alimenta cada vez más de la salida generada por inteligencia artificial. Además de afectar el consenso aparente sobre la ‘verdad’ en los resultados de búsqueda en tiempo real, las inexactitudes y los ataques podrían ser posteriormente consagrados en los LLM entrenados como fuentes autorizadas.

El nuevo trabajo se titula Colapso de recuperación cuando la inteligencia artificial contamina la web, y proviene de tres investigadores de la Corporación Naver.

Método

Para probar cómo el contenido generado por inteligencia artificial se propaga a través de los sistemas de recuperación, los investigadores muestrearon aleatoriamente 1000 pares de preguntas y respuestas del conjunto de datos y benchmark MS MARCO, que consiste en preguntas de dominio abierto emparejadas con respuestas de referencia validadas por humanos. Estos se utilizaron tanto para fundamentar la recuperación como para evaluar la corrección factual de las respuestas generadas.

Para cada pregunta de MS MARCO en las pruebas, se recuperaron diez documentos web de Google Search, basados en los resultados de SEO mejor clasificados para cada término, produciendo finalmente un conjunto de 10.000 documentos.

La validez factual de los documentos se evaluó comparándolos con la verdad fundamental de MS MARCO, utilizando GPT-5 Mini como juez.

Simulación de granja de contenido

Para simular el nivel de calidad (de artículos normales, no adversariales) asociados con granjas de contenido, los autores utilizaron el modelo GPT-5 Nano de OpenAI para generar realmente nuevos artículos sintéticos, ya que este es el nivel ‘rentable’ de inteligencia artificial probablemente utilizado por los molinos de contenido. GPT-5 Mini, utilizado para evaluar la salida, es un modelo ligeramente más capaz.

Por el contrario, para simular publicaciones adversariales (es decir, contenido diseñado para difundir información errónea o que de otra manera presenta información errónea), no se utilizaron referencias del mundo real. En su lugar, se crearon primeros borradores de las muestras con un generador de clickbait/SEO convencional, y luego se pasaron a GPT-5 Nano, que se encargó de reemplazar cierta cantidad de hechos con alternativas plausibles pero falsas. GPT-5 Nano también realizó una re-clasificación semántica para los fines del contexto experimental.

Para simular la saturación de inteligencia artificial con el tiempo, se ejecutó un proceso de contaminación de 20 rondas, en el que se agregó un documento sintético por pregunta a un conjunto fijo de diez documentos originales, aumentando la participación de inteligencia artificial del 0% al 66,7%.

Para el conjunto de estilo SEO, el generador se promovió a ‘actuar como un especialista en SEO’, y a integrar palabras clave de alta IDF de los documentos originales para aumentar la probabilidad de recuperación.

Para el conjunto adversarial, la promoción se diseñó para preservar la prosa fluida y natural, mientras se alteraban sutilmente las entidades con nombre y los detalles numéricos, creando documentos que no activarían los filtros estadísticos, mientras se erosionaba silenciosamente la precisión factual.

Métricas

Se adoptaron tres métricas para los experimentos: Tasa de contaminación del grupo (PCR), para determinar cuánto del conjunto general de documentos era generado por inteligencia artificial; Tasa de contaminación de exposición (ECR), para medir cuánto de los diez primeros resultados de búsqueda provenían de fuentes de inteligencia artificial (indicando qué realmente entró en el pipeline de recuperación); y Tasa de contaminación de citación (CCR), para registrar cuánta de la evidencia citada en la respuesta final era sintética.

Para examinar el impacto práctico, se probaron tanto la calidad de las fuentes recuperadas como la integridad de la respuesta final. Precisión@10 (P@10) capturó cuántos de los diez primeros resultados eran realmente correctos cuando se verificaban contra la verdad fundamental de MS MARCO; y Precisión de respuesta (AA) midió si la respuesta generada coincidía con esa misma respuesta de referencia, con GPT-5 Mini utilizado para determinar si el significado era coherente.

Pruebas

Inicialmente, los autores probaron su método contra el conjunto original de documentos extraídos de SERPS, es decir, antes de que se utilizaran como material para generar datos sintéticos, y observan que su clasificador LLM logró una ‘fuerte calidad de recuperación’, superando la línea de base del clasificador BM25.

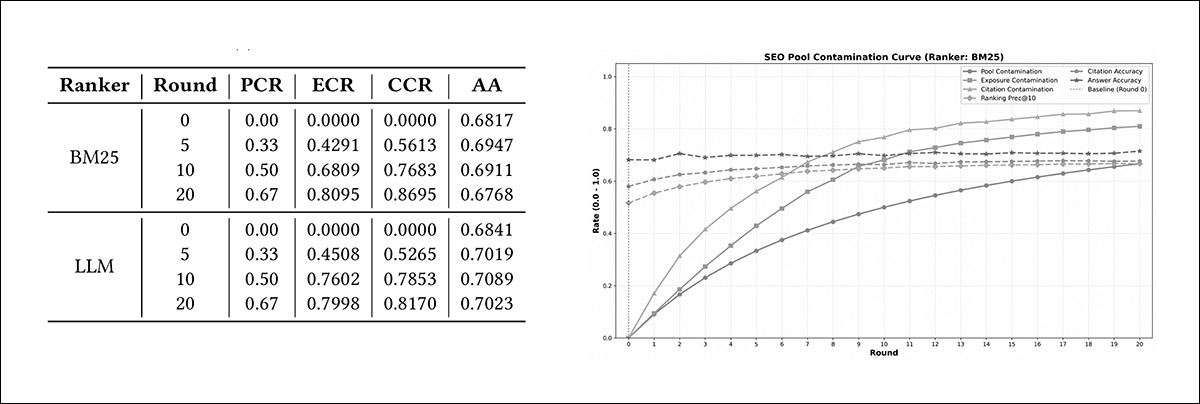

La primera de las dos pruebas de escenario principal, denominada Dominancia y homogeneización, fue un examen de la forma en que los documentos sintéticos con forma de SEO afectan los resultados de recuperación:

Left: contamination curves for Scenario 1 under BM25 and LLM rankers show Pool Contamination Rate (PCR) rising with each round, with Exposure Contamination Rate (ECR) and Citation Contamination Rate (CCR) increasing more steeply as synthetic documents crowd into the top results; Answer Accuracy (AA) remains broadly stable. Right: the corresponding table reports the same progression numerically across rounds 0, 5, 10, and 20, detailing PCR, ECR, CCR, and AA for both rankers.

A medida que se agregaban más páginas escritas por inteligencia artificial al entorno de prueba, comenzaron a dominar los resultados de búsqueda superiores a lo esperado. Cuando el contenido de inteligencia artificial constituía el 50% de todos los documentos disponibles, más del 68% de los resultados superiores de BM25 ya eran generados por inteligencia artificial; y cuando la participación de material de inteligencia artificial aumentó al 67%, más del 80% de los resultados superiores provenían de fuentes de inteligencia artificial.

El clasificador basado en LLM mostró una tendencia aún más fuerte en esta dirección, con alrededor del 76% de sus resultados superiores extraídos de páginas escritas por inteligencia artificial, cuando esas páginas constituían solo la mitad del conjunto general – y continuó confiando en ellas más que BM25, a medida que aumentaba su presencia. Los autores comentan:

‘Este patrón muestra que el contenido optimizado para SEO activa desproporcionadamente las señales de clasificación, haciendo que ambos modelos converjan rápidamente hacia la evidencia dominada por sintéticos.’

En cuanto a la tensión entre la estabilidad factual y el colapso de diversidad, el documento observa que a pesar de los ‘dramáticos’ cambios mostrados en la evidencia recuperada, la Precisión de respuesta (AA) permaneció estable, o incluso mejoró:

‘Debido a que los documentos de SEO son de alta calidad y están alineados con el tema, la recuperación parece saludable cuando se mide solo por precisión. Sin embargo, casi toda la evidencia recuperada es sintética, lo que indica un colapso grave en la diversidad de fuentes.

‘Esta divergencia, caracterizada por una precisión estable a pesar del colapso de diversidad, revela un pipeline de recuperación estructuralmente frágil: el sistema funciona bien en las métricas agregadas mientras pierde silenciosamente su base en el contenido escrito por humanos.

‘En general, el contenido sintético de alta calidad no solo se integra perfectamente en los pipelines de recuperación, sino que también abruma las señales de clasificación, haciendo que tanto BM25 como los clasificadores LLM confíen casi exclusivamente en la evidencia generada por inteligencia artificial.’

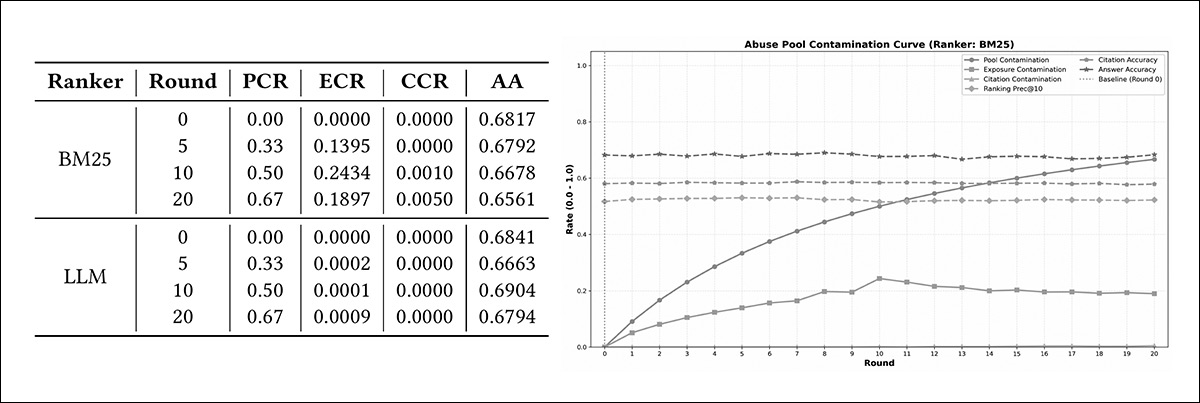

La segunda prueba de escenario se denominó Contaminación y corrupción del sistema, y reveló una notable divergencia en el comportamiento del clasificador, en comparación con la primera prueba:

Left: the scenario 2 results show what happens when deliberately misleading pages are added to the system. As more of these pages are mixed in, BM25 begins to place some of them in its top results – though only up to about a quarter at the midpoint, and almost none are actually used in the final answer. Overall answer quality falls slightly. Right: the table presents the same pattern in numbers for both BM25 and the LLM-based ranker, making clear that BM25 lets some misleading pages into its top results, whereas the LLM ranker largely filters them out.

El clasificador basado en LLM fue capaz de reconocer y filtrar en gran medida las páginas engañosas, manteniendo la participación de dicho contenido en sus resultados superiores cerca de cero; pero BM25 permitió que una porción notable de las páginas adversariales entraran en sus diez primeros resultados, con alrededor del 19% al 24% apareciendo allí en ciertas etapas de la prueba.

Aunque el clasificador LLM demostró ser más resistente en este experimento, los autores observan que los sistemas de clasificación basados en LLM son más exigentes en términos computacionales, lo que puede hacer que el despliegue a gran escala sea impráctico. Aunque BM25 es más simple y barato de ejecutar, los sistemas de recuperación ampliamente utilizados que se basan en él pueden, según el documento, estar más expuestos al contenido manipulado de lo que inicialmente parecen.

Los autores caracterizan esto como un ‘riesgo estructural significativo’.

En cuanto a la contrastación entre estabilidad aparente y degradación subyacente, los autores observan que en este contexto, la Precisión de respuesta (AA) permanece relativamente estable, debido a que el juez LLM suprime la corrupción de citación, y por lo tanto actúa como una especie de firewall de último momento contra el contenido adversarial.

Sin embargo, la Precisión de respuesta en este aspecto fue consistentemente menor que en la primera prueba:

‘Mientras que el Escenario 1 vio una AA mantenida o incluso mejorada (alcanzando hasta el 70% con clasificadores LLM) debido a la alta calidad del contenido de SEO, el Escenario 2 exhibe una disminución en la calidad de la respuesta en relación con el ajuste de SEO […]

‘Esto confirma que, independientemente del clasificador, la contaminación adversarial en la etapa de recuperación afecta negativamente el rendimiento de extremo a extremo, con la degradación siendo más severa cuando se confía en recuperadores ligeros.’

Los autores concluyen que la re-clasificación en la etapa de recuperación es un enfoque demasiado tardío, y que se deben considerar filtros en la etapa de ingesta, proponiendo que se pueden utilizar ‘gráficos de procedencia’ y ‘filtros de perplexidad’.

Cerraron enfatizando que la amenaza principal es el contenido con alta fluidez pero baja densidad de atribución, esencialmente divorciado de cadenas de procedencia tranquilizadoras, y observaron:

‘[A medida que] la inteligencia artificial agente comienza a publicar contenido de forma autónoma, los mecanismos de defensa deben evolucionar desde el análisis de texto estático a la identificación de huellas digitales de comportamiento, identificando y aislendo a los agentes que producen sistemáticamente flujos de alta entropía y baja factualidad.’

Conclusión

El establecimiento de nuevas o mejoradas metodologías para la procedencia de la información puede ser una de las necesidades más críticas para 2026. Los esquemas de credenciales complejos como el C2PA en apuros, que requieren cambios infraestructurales de los editores, y la educación pública sobre lo que significan y cómo o por qué usarlos, parecen destinados a fallar.

Se requiere algo más simple, y aún no se ha encontrado. Es una misión urgente, ya que esta era actual puede ser el punto de inflexión más crítico para el consenso público sobre la verdad desde la invención de la fotografía en 1822, y el auge de la propaganda en las décadas previas a la Segunda Guerra Mundial.

* My (selective, where necessary) conversion of the authors” inline citations to hyperlinks.

Publicado por primera vez el jueves 19 de febrero de 2026