Ángulo de Anderson

Introduciendo imágenes generadas por IA a la luz con HDR

Las imágenes y videos generados por IA pueden ser impresionantes, pero no están a la altura de los estándares ‘profesionales’ – un problema que un nuevo proyecto de investigación busca abordar.

En la comunidad audiovisual profesional, una de las objeciones más frecuentes a la incursión de la IA es la falta actual de estándares profesionales de reproducción de imagen y video. No menos importante es la capacidad de trabajar con imágenes y videos de Alto Rango Dinámico (HDR).

Las imágenes HDR son el equivalente moderno de una práctica fotográfica del siglo XIX/XX llamada bracketing, donde la misma imagen se toma varias veces con cantidades crecientes de luz que llegan al emulsión de la película:

Arriba, una secuencia de imágenes bracketeadas. Insetado debajo, el alto rango dinámico que se puede extrapolar de estas fotos en una sola imagen. Fuente

En la fotografía tradicional, esto resultaba en múltiples imágenes que, con cierta experiencia y esfuerzo, se podían componer en una sola impresión que se beneficiaba de todos los diferentes niveles de detalle disponibles en todo el rango de exposiciones. Pero no era un proceso trivial.

Estos días, una ‘secuencia de imágenes bracketeadas automática’ puede producir múltiples imágenes o combinarse en una sola imagen HDR – efectivamente, una multiplicidad de exposiciones en una imagen, que las aplicaciones de edición de imágenes compatibles con HDR como Photoshop pueden iterar a través de ellas y permitir que el fotógrafo las orquestre en una imagen de salida ideal.

Si se pregunta por qué debería importarle, o cómo este tipo de cosas impacta su propia fotografía, la ilustración para este artículo está destinada a demostrar esto de una manera familiar:

Arriba, a la izquierda, vemos un ejemplo típico de una imagen sRGB (es decir, no HDR). Solo iluminar (mostrado a la derecha) no no muestra al monstruo en el armario, porque ese detalle se desechó cuando el fotógrafo y los procesos automatizados de la cámara decidieron qué priorizar en la foto:

Debajo es una indicación (izquierda) de cómo ‘desvanecido’ estaría el primer plano en el momento de la exposición para registrar al monstruo del armario en una foto no HDR, y (derecha) cómo el monstruo se sumerge en la oscuridad cuando la exposición se hace adecuada para los sujetos del primer plano iluminados:

Debajo, vemos el tipo de detalle que se puede ‘rescatar’ de una imagen o secuencia HDR. En este caso, el monstruo estaba ‘escondido’ en los registros visuales más bajos de la secuencia HDR, en un nivel donde el resto del contenido habría sido ‘sobrepasado’ en near-blancos (arriba, izquierda). Al especificar que un amplio rango de niveles de brillo debía expresarse selectivamente en la misma imagen, estos elementos disonantes pueden componerse en una imagen racional:

Una imagen no HDR se conoce como una imagen referida a la pantalla, y una imagen HDR de alto rango de colores se conoce como una imagen referida a la escena.

El video HDR también existe, y este tipo de versatilidad y ductilidad tonal realmente da a los cineastas cierta libertad para rescatar, graduar e interpretar las imágenes de una variedad de maneras creativas y coherentes; no es de extrañar, entonces, que los creativos se nieguen a trabajar con la salida ‘aplanada’ sRGB típica de la mayoría de los marcos generativos de IA.

HDR en IA

Naturalmente, la escena de investigación está interesada en llevar los marcos generados por IA a la era HDR. Sin embargo, no es una tarea trivial, tanto por la arquitectura fundamental de los sistemas generativos de difusión como por la gran cantidad de espacio en disco que requiere los buenos datos HDR, lo que hace que las colecciones sean engorrosas; en consecuencia, los conjuntos de datos adecuados para la tarea son escasos.

A pesar de ello, una colaboración entre una universidad en Singapur y Adobe Research está ofreciendo un método para producir secuencias de imágenes HDR, en una metodología que puede aplicarse teóricamente a video así como a imágenes fijas:

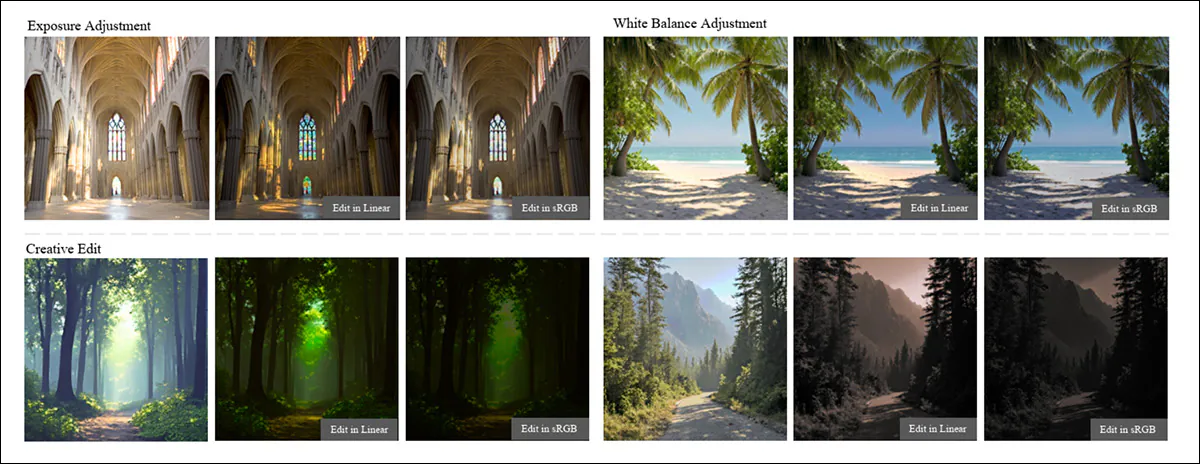

Del sitio del proyecto para el nuevo trabajo, ejemplos de salida de ‘bracketing’ de texto a imagen. Fuente

El nuevo sistema genera varias versiones alineadas de la misma imagen a diferentes niveles de brillo y aprende cuánta luz hay en la escena real, y luego combina estas en un solo resultado que mantiene el detalle en sombras y resaltos, lo que permite que las ediciones posteriores de exposición o color se comporten más como ajustes a una captura de cámara real que como ajustes frágiles a una imagen completamente procesada.

El sistema aprovecha una diversidad de diferentes modelos para la tarea, incluyendo variantes de Qwen y Flux:

Ejemplos del nuevo artículo, que muestran cómo el sistema puede generar múltiples versiones de exposición de la misma escena mientras mantiene la estructura subyacente fija. A partir de un mapa de bordes simple, el modelo produce imágenes consistentes en muy oscuro a muy brillante, ya sea que la solicitud describa luz de luna, luz del sol, atardecer o incluso un objeto pequeño como un globo, con el sujeto y la composición que permanecen estables mientras solo la iluminación cambia. El método puede variar el brillo de una manera controlada, similar a una cámara, en lugar de derivar o inventar nuevo contenido a medida que cambia la exposición. Fuente

Los autores declaran:

‘Generar imágenes lineales es desafiante, ya que los VAE preentrenados en los modelos de difusión latente luchan por preservar simultáneamente los resaltos y sombras extremos debido al rango dinámico y la profundidad de bits más altos.

‘Con este fin, representamos una imagen lineal como una secuencia de exposiciones, cada una capturando una porción específica del rango dinámico, y proponemos una arquitectura de coincidencia de flujo basada en DiT para la generación de exposiciones condicionadas por texto.

‘Además, demostramos aplicaciones posteriores, incluyendo edición de imágenes lineales guiada por texto y generación condicionada por estructura a través de ControlNet.’

El nuevo trabajo se titula Generación de imágenes lineales mediante la síntesis de exposiciones, y proviene de cuatro autores en S-Lab en la Universidad Tecnológica de Nanyang, Adobe NextCam y Adobe Research. Además de la página del proyecto y el video de YouTube que acompaña al lanzamiento, también hay un repositorio de GitHub (actualmente escaso), y la promesa de un lanzamiento de conjunto de datos.

Aunque los autores suministran muchos ejemplos de salida del sistema en la página del proyecto asociado, los espectadores necesitarán un monitor compatible con HDR para distinguir realmente las características de la salida HDR presentada. Sin embargo, encontrará la visión general de los investigadores en YouTube incrustada al final de este artículo – pero tenga en cuenta que las diferencias entre los ejemplos mostrados pueden no ser claras en un monitor no HDR.

Método y datos

Los autores enfatizan la medida en que la recopilación de datos es un desafío en esta búsqueda particular:

‘Adquirir un gran número de imágenes lineales es extremadamente desafiante en la práctica. Además, la mayoría de los conjuntos de datos HDR públicos son panorámicos (y se centran casi exclusivamente en el contenido de la escena a gran escala) o no proporcionan imágenes lineales verdaderas, lo que los hace inadecuados para nuestros propósitos.

‘Por lo tanto, utilizamos principalmente conjuntos de datos de imágenes RAW como base para el entrenamiento.’

Los investigadores hicieron un uso creativo de las pocas opciones que tenían, aprovechando el conjunto de datos RAISE como datos de entrenamiento reales, y el conjunto de datos MIT-Adobe FiveK como datos de evaluación*.

Para construir datos de entrenamiento HDR utilizables, los investigadores pasaron los archivos de cámara RAW a través de una tubería estandarizada para eliminar las peculiaridades específicas de la cámara, convirtiendo las imágenes en un formato lineal consistente y referido a la escena:

Esquema para el flujo de trabajo de los autores: el sistema comienza con ruido que representa cuatro niveles de exposición de la misma escena, junto con una solicitud de texto y un token de brillo, y los procesa a través de bloques de transformadores apilados que mantienen las diferentes exposiciones alineadas mientras se ajustan la iluminación. Luego, predice tanto el conjunto de imágenes de exposición como una escala de brillo general, y posteriormente decodifica y combina en una sola imagen referida a la escena, conservando el detalle en sombras y resaltos.

Esto implicó reconstruir el RGB completo a partir de los datos del sensor, aplicar la corrección de color, normalizar el equilibrio de blancos y brevemente moverse a un espacio de color perceptual para el desenfoque antes de regresar a una señal lineal limpia. La luz real en la escena se recuperó entonces utilizando los ajustes de exposición de la cámara, para que cada píxel reflejara la verdadera luminosidad en lugar de una aproximación lista para la pantalla.

Debido a que tales valores pueden variar ampliamente, los datos se estabilizaron entonces escalando cada imagen en función de su propia distribución de brillo, utilizando estadísticas de medio rango y resaltos para evitar tanto imágenes desvanecidas como resaltos sobrepasados, obteniendo finalmente una imagen lineal normalizada que conservaba el verdadero rango de luz en la escena, mientras permanecía lo suficientemente estable como para el entrenamiento.

Las etiquetas de texto para las imágenes se crearon entonces con el modelo Qwen2.5-VL 7B, con solicitudes de texto elaboradas para coincidir con las características del modelo Flux que se utilizaría en el momento de la generación.

Cada imagen se dividió en ‘rebanadas’ de exposición y se pasó a través de un codificador VAE compartido, convirtiendo todas las exposiciones en un espacio latente común diseñado para capturar el rango de brillo completo. Los latentes se refinaron entonces a partir del ruido y se decodificaron de nuevo en imágenes, permitiendo una reconstrucción consistente en regiones oscuras y brillantes, sin colapsarlas en una sola exposición ‘aplanada’.

La ajuste fino de LoRA se utilizó para adaptar el modelo Flux preentrenado a los datos de imágenes lineales con un mínimo de parámetros adicionales, ayudando al modelo de transformadores de difusión única (single-DiT) a permanecer estable, incluso a medida que el brillo variaba a través de las exposiciones.

La atención auto-modulada de exposición (columna central en la ilustración del esquema anterior) se introdujo para procesar conjuntamente todas las exposiciones, permitiendo que la luminancia se ajustara por exposición mientras se mantenían la estructura y el detalle fino alineados.

El incrustado de posición rotatorio 3D (3D-R[o]PE) se utilizó para codificar tanto la posición espacial como la identidad de exposición, para que el modelo pudiera distinguir a qué exposición pertenecía cada token, mientras se preservaba la coherencia espacial, lo que permitía una separación limpia de la variación de brillo del contenido de la escena.

Una visión general del conjunto de datos utilizado en el estudio, que muestra cómo las imágenes se distribuyen a través de los tipos de contenido y escenas interiores versus exteriores, junto con la distribución de los valores de brillo en los datos procesados. Los histogramas trazan la luminancia y la escala de radiancia en espacio logarítmico, ilustrando cómo puede variar ampliamente la luminosidad del mundo real, con valores de radiancia más altos que corresponden a escenas físicamente más brillantes y destacando el fuerte rango dinámico que el modelo está diseñado para manejar.

3D-RoPE separó dónde estaba una característica y ‘de qué exposición proviene’ en señales separadas, para que la variación de brillo pudiera ajustarse de forma independiente, sin corromper el detalle espacial.

Pruebas

Los investigadores utilizaron Flux-dev como marco generativo, con el entrenamiento que ocurre en cuatro GPU NVIDIA A100, cada una con 80GB de VRAM. El tamaño del lote se estableció en 4 (por GPU), durante 10,000 iteraciones.

El ajuste fino de LoRA utilizó un rango de 64. El optimizador AdamW se utilizó a una tasa de aprendizaje de 2×102 (para el aspecto de modulación de exposición).

Los autores señalan que aunque hay dos trabajos anteriores que son similares en alcance, ninguno de ellos fue un contendiente obvio para una fase de pruebas. El trabajo de 2022 liderado por Max Planck GlowGAN se limita a generar categorías de imágenes específicas, mientras que Bracket Diffusion (de nuevo, liderado por el Instituto Max Planck) de 2025 solo puede generar una imagen HDR a 256x256px, y tarda varios minutos en hacerlo.

Del artículo original de GlowGAN, las imágenes LDR típicas pierden detalles en sombras y resaltos, mientras que el modelo aprende a producir versiones HDR que conservan detalles en todos los niveles de brillo y permiten la recuperación de regiones saturadas a través de la cartografía de tonos inversa. Fuente

Por lo tanto, en ausencia de líneas de base directas para la generación de imágenes lineales, los autores compararon su método con versiones adaptadas de modelos existentes, en lugar de alternativas diseñadas específicamente.

Un conjunto de experimentos (‘T2I Fine-Tuning’) ajustó el modelo de difusión de texto a imagen Flux utilizando LoRA, entrenándolo para generar imágenes lineales directamente, y evaluando cómo un modelo T2I de estado del arte se adaptaba a este dominio.

Una segunda comparación (‘T2V fine-tuning’) utilizó el modelo de texto a video Wan 2.1, cuyo VAE comprime múltiples marcos en una representación latente compartida; en este conjunto, cuatro exposiciones se codificaron en una representación latente única, y luego se decodificaron de nuevo, probando si una tubería de video podría modelar la variación de exposición.

El tercer conjunto de experimentos (‘T2I Model Inflation’) comparó con CameraCtrl y Generative Photography, que ambos extienden los modelos de difusión de imagen a través de módulos temporales, para producir salidas multi-marco. Estos también se ajustaron en el mismo conjunto de datos, para una comparación coherente.

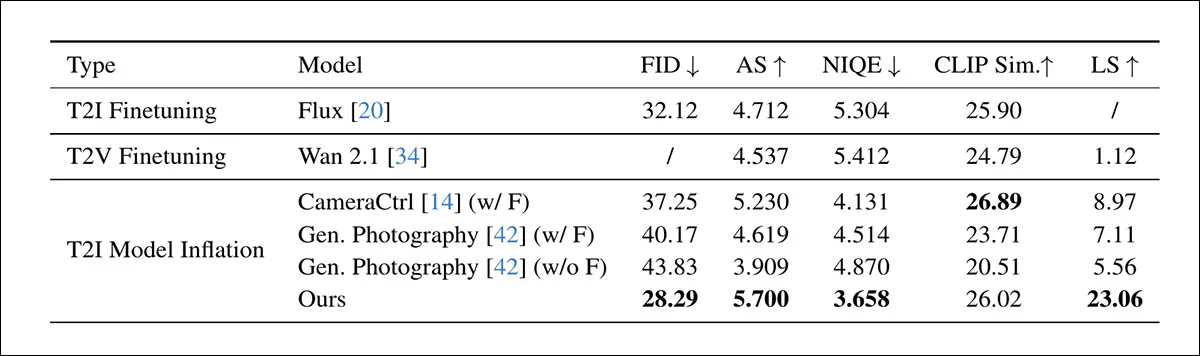

Las métricas utilizadas fueron Fréchet Inception Distance (FID); Puntuación Estética (AS); Evaluador de Calidad de Imagen Natural (NIQUE); Puntuación de Similitud CLIP; y Similitud de Luminancia (LS):

Una comparación del método de los autores con varias líneas de base adaptadas para generar imágenes lineales referidas a la escena. Los modelos de texto a imagen (Flux) y texto a video (Wan 2.1) se ajustan con LoRA para probar cómo manejan los sistemas generativos existentes este ajuste, mientras que CameraCtrl y Generative Photography extienden los modelos de difusión con componentes temporales. Algunas puntuaciones faltan, porque ciertos modelos no pueden producir consistentemente exposiciones coherentes, que se requieren para recuperar el rango dinámico completo. A través de las métricas informadas, el nuevo método logra los resultados generales más fuertes, particularmente en las medidas relacionadas con la calidad de la imagen y la reconstrucción de brillo precisa.

Con respecto a estos resultados, los autores declaran:

‘Debido a la amplia distribución de las imágenes lineales, ajustar directamente el modelo T2I en los datos lineales hace que sea difícil equilibrar los detalles de sombras y resaltos. Los métodos de inflación del modelo T2I sufren de un rango dinámico limitado y una degradación significativa de la calidad de la imagen incluso después del ajuste.

‘Para el ajuste T2V, la submuestra temporal de 4× de Wan 2.1 entrelaza las 4 exposiciones en una representación latente única, causando una discrepancia de distribución severa que no se puede resolver solo mediante el ajuste.

‘Al modelar directamente las propiedades referidas a la escena utilizando exposiciones, nuestro método logra una calidad visual y un rango dinámico superiores en todas las líneas de base.’

Una comparación con Flux y Wan 2.1 ajustados con LoRA, que ilustra cómo cada método maneja los cambios de exposición en las mismas escenas. Los enfoques competidores tienden a perder detalles en regiones muy oscuras o muy brillantes, mientras que el método propuesto mantiene una estructura consistente y recupera detalles útiles en todo el rango de exposiciones. Por favor, refiérase al artículo de la fuente y al sitio del proyecto para obtener ejemplos de resultados de mejor calidad.

Por favor, refiérase a la sección de experimentos extendidos y materiales suplementarios del artículo de la fuente para obtener más pruebas.

Conclusión

Para los profesionales de los medios, como aquellos que trabajan en la producción de cine y televisión, la misma salida que ha capturado la imaginación (y, cada vez más, la ira) del mundo los ha dejado indiferentes, ya que casi todos sus flujos de trabajo dependen de alguna manera de las capturas HDR.

Por lo tanto, este es un proyecto oportuno, que representa una instalación que uno esperaría que se convirtiera en un estándar opcional en los nuevos marcos – aunque es seguro que al menos duplicará los tiempos de renderizado; claramente, también, la latencia tendrá que abordarse seriamente si el contenido de IA HDR no se relega a la categoría ‘en post’ en lugar de en cámara.

* Normalmente mostraríamos ejemplos, pero como el lector puede no tener un monitor compatible con HDR, los omitimos en este caso.

Publicado por primera vez el domingo 26 de abril de 2026