Ángulo de Anderson

Los datos ‘desviados’ que contaminan el rendimiento de la IA generativa

Un nuevo estudio encuentra que muchos conjuntos de datos de imágenes populares utilizados para entrenar modelos de IA están contaminados con imágenes de prueba o casi duplicados, lo que permite a los modelos hacer trampa al memorizar respuestas en lugar de aprender. El escape es generalizado pero generalmente no detectado, inflando silenciosamente las puntuaciones y dando ventajas injustas a los modelos entrenados con datos a escala web.

Cuando tomas un examen de conducción, normalmente no se te dice con anticipación exactamente qué carreteras se utilizarán para el examen. Si lo supieras (y tuvieras un poco de falta de integridad), podrías ‘optimizar’ para el examen practicando repetidamente en esa ruta, en lugar de desarrollar habilidades de conducción más amplias que puedan manejar cualquier ruta de manera razonable.

En el entrenamiento de modelos de aprendizaje automático, esto es una analogía razonable para un conjunto de prueba – una división de los datos del conjunto de entrenamiento entre (generalmente) una división del 70% para los datos que se utilizarán para entrenar el modelo, con el 30% restante utilizado como datos ‘en el mundo real’.

Dado que los datos en el mundo real nunca han sido vistos por el modelo, si el modelo funciona bien en esos datos, se puede asumir que es efectivo y tiene un buen rendimiento; si no, el modelo puede haber sobreajustado en un conjunto equilibrado – o el dato necesitaba una curación y definición adicionales.

De cualquier manera, no evaluar modelos en sus datos de entrenamiento es la piedra angular del método actual en la investigación y el desarrollo de la IA.

Otra vez, por favor

Según un nuevo artículo de investigación de Japón, el sector de investigación de visión por computadora y IA generativa no ha igualado remotamente los esfuerzos de los investigadores de LLM para asegurarse de que los datos de prueba no contaminen los datos de entrenamiento; en las pruebas, los investigadores encontraron que cada conjunto de datos de visión a gran escala que estudiaron, incluidos los que alimentan algunos de los sistemas de IA generativa actuales más grandes, ha permitido en alguna medida que sus datos de prueba se crucen con sus datos de entrenamiento – lo que significa que las mediciones de referencia y los informes de rendimiento de los modelos entrenados en estas divisiones no serán más precisos que un resultado de examen de alguien que se coló un apunte en el salón de exámenes, y no reflejarán el rendimiento en el mundo real en datos genuinamente nuevos.

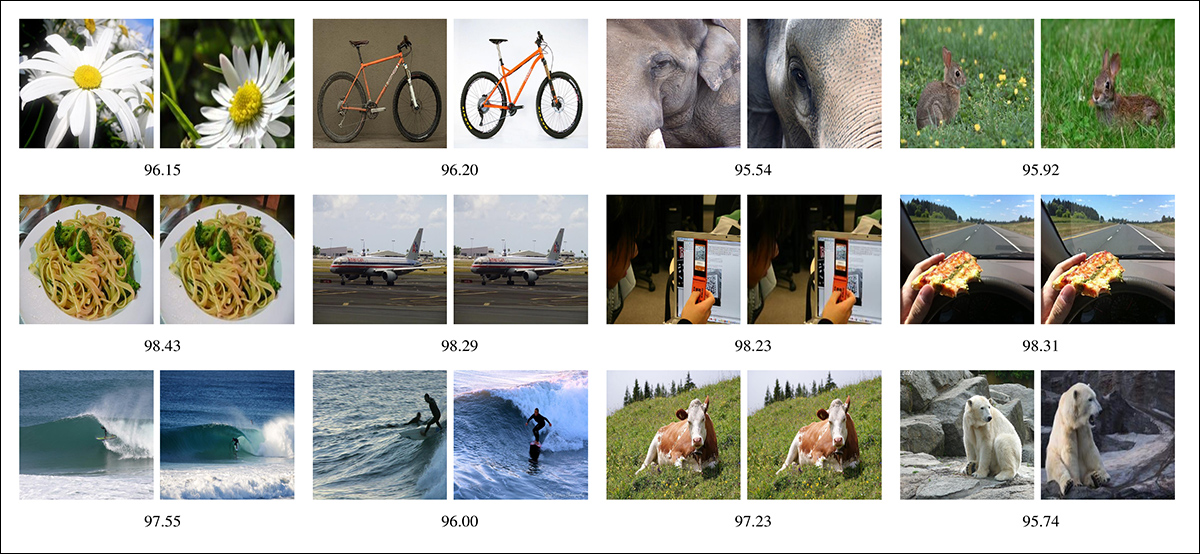

Ejemplos de contaminación cruzada de datos encontrados por los investigadores, donde existen puntos de datos duplicados o casi duplicados en ambos los datos de entrenamiento y de prueba. Fuente: https://arxiv.org/pdf/2508.17416

En la imagen de arriba, del nuevo artículo, vemos ejemplos de puntos de datos duplicados o casi duplicados encontrados en ambos los datos de entrenamiento y de prueba de una variedad de modelos – lo suficiente como para invalidar el rendimiento del modelo en esos datos, y ligeramente inflar sus puntuaciones generales en todo, facilitando la apariencia de un nivel de generalización que el modelo puede no haber alcanzado realmente.

Para complicar aún más las cosas, la contaminación parece ocurrir en una diversidad de escenarios posibles, incluyendo ‘pre-entrenamiento‘, donde los pesos de modelos ancestrales anteriores se utilizan para ‘iniciar’ un nuevo modelo. Si el modelo ancestral anterior tiene algunos de los mismos datos que el conjunto de datos más nuevo que se está pre-entrenando, entonces la contaminación cruzada puede ocurrir incluso si la división 70/30 o 80/20 es limpia.

Cumulative Effect

Esto casi seguramente ocurrirá incluso en los conjuntos de datos más recientes: el alcance de los conjuntos de datos de visión/lenguaje ha crecido enormemente en los últimos cinco años, abarcando no solo los nuevos datos de imágenes en la web, sino también la recolección de mucha de la misma data que poblaba esos conjuntos de datos históricos anteriores.

Además, las rutinas automatizadas diseñadas para buscar y filtrar miles de millones de imágenes para duplicados y casi duplicados ahora se enfrentan a una tarea tan onerosa que la curación en sí – su costo en términos de tiempo y dinero – debe considerarse dentro del contexto de las limitaciones presupuestarias.

Mientras tanto, la duplicación de imágenes es una consecuencia inevitable del tipo de ad hoc de búsqueda en la web detrás de colecciones masivas como Common Crawl, debido a la práctica común de republicar y recomprimir imágenes, y aplicar ediciones como recortes, y incluso voltear (para evadir la detección, cuando la imagen puede haber sido utilizada sin permiso, por ejemplo).

Los autores observan*:

‘La fuga de datos es un problema generalizado, prevalente en la mayoría de los conjuntos de datos visuales. La fuga puede ocultar la capacidad de generalización de los modelos, lo que es particularmente problemático cuando se comparan modelos entrenados en diferentes conjuntos de datos, lo que lleva a comparaciones injustas.

‘Instamos a los diseñadores de conjuntos de datos a considerar cuidadosamente las implicaciones de estas evaluaciones. Para una evaluación de modelos más justa, recomendamos el uso de detectores de duplicados que consideren tanto la fuga dura como la suave.

‘Idealmente, las imágenes filtradas deben eliminarse del conjunto de entrenamiento, y si no es posible, al menos deben eliminarse del conjunto de prueba.’

El artículo elabora sobre una serie de pruebas que los investigadores realizaron en conjuntos de datos masivos y populares – cada uno de los cuales demostró algún nivel de contaminación.

El nuevo artículo se titula Fuga de datos en conjuntos de datos visuales, y proviene de tres investigadores de la Universidad de Osaka.

Método

Los autores del artículo definen la fuga en términos de tres dimensiones: modalidad, cobertura y grado.

Modalidad distingue si solo se filtran imágenes o si se exponen tanto imágenes como etiquetas; cobertura identifica si el solapamiento ocurre dentro del mismo conjunto de datos o a través de diferentes conjuntos de datos; y grado define si el contenido duplicado es exactamente el mismo o meramente adyacente.

En cuanto a la fuga, los dos escenarios considerados en el trabajo son fuga intra-conjunto de datos (donde las imágenes de evaluación reaparecen en la división de entrenamiento del mismo conjunto de datos), y fuga inter-conjunto de datos (donde las imágenes de evaluación de un conjunto de datos están presentes en un diferente conjunto de datos utilizado para entrenamiento).

En cuanto al grado, los dos niveles definidos son fuga suave (donde las imágenes no son idénticas pero exhiben variaciones menores), y fuga dura (donde las imágenes son exactamente las mismas en todo el entrenamiento y evaluación).

Los investigadores abordan la detección de fuga en términos de recuperación de imágenes, utilizando codificadores de imágenes para representar cada imagen como un vector de características. El conjunto de consulta es el dato de evaluación, mientras que el conjunto de colección es el conjunto de entrenamiento.

Para conjuntos de datos más pequeños, cada vector de consulta se comparó directamente con todos los vectores de entrenamiento utilizando similitud coseno. Para conjuntos de datos más grandes, se creó un índice Faiss para permitir una búsqueda de K-Nearest Neighbors (KNN) más rápida.

Dado que el codificador necesita capturar suficiente información visual para detectar similitudes sutiles, pero aún así permanecer eficiente frente a volúmenes de datos muy altos, los autores confiaron en características precalculadas CLIP puestas a disposición por los creadores del conjunto de datos, en el caso de la colección LAION que subyace a la difusión estable, y proyectos posteriores.

Los autores señalan que permitir que CLIP utilice su comprensión destilada del conjunto de datos (en lugar de sondear los archivos reales a escala) aceleró el proceso considerablemente, y ofreció una mejor consistencia en las comparaciones.

Datos y pruebas

El codificador de imágenes CLIP utilizado en las pruebas para el nuevo trabajo fue el CLIP ViT-B/32 originalmente utilizado para tamizar LAION. Para establecer si imágenes diversas estaban relacionadas entre sí, se utilizó KNN bajo AutoFaiss.