Andersons Blickwinkel

Reduzierung von AI-Bildhalluzinationen durch Übertrieben

ChatGPT-ähnliche Bildmodelle “halluzinieren” oft Elemente, die nicht in einem Bild vorhanden sind. Eine neue Methode reduziert diese Fehler, indem sie dem Modell übertriebene Versionen seiner eigenen Halluzinationen zeigt, basierend auf Bildunterschriften – und dann bittet es das Modell, es erneut zu versuchen. Dieser Ansatz erfordert keine Neuschulung oder zusätzliche Daten und kann auf eine breite Palette von Modellen und Modelltypen angewendet werden.

Eine neue Veröffentlichung aus China bietet einen interessanten Ansatz zum persistenten Problem von Halluzinationen in AI-generierten Bildern und Videos – Elemente, die offensichtlich nicht im Bild vorhanden sein sollten, basierend auf der Benutzereingabe und -anforderung.

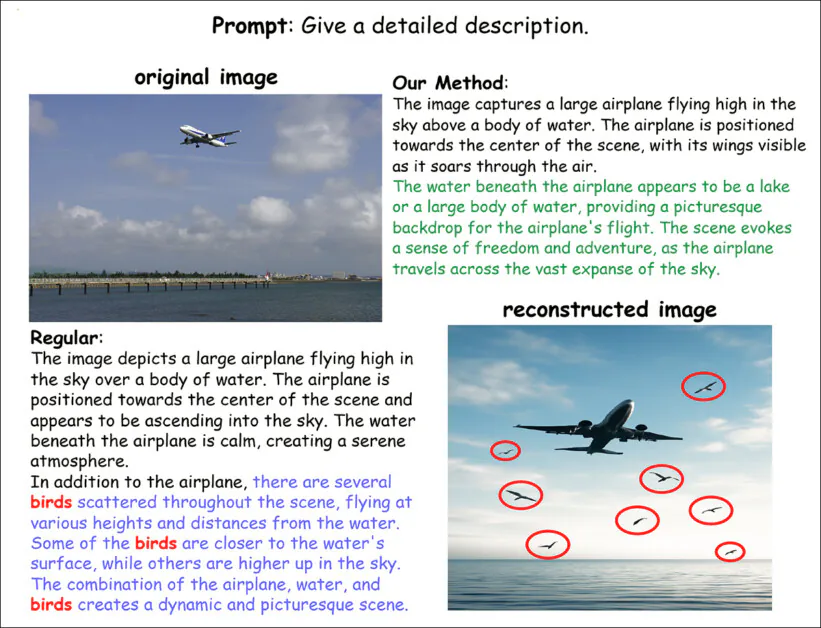

Im Wesentlichen lässt das System ein Bild beschreiben, wie üblich; es wandelt dann diese Beschreibung in ein neues Bild mithilfe eines Text-Bild-Modells um – und alle zusätzlichen Objekte oder Details in diesem zweiten Bild werden direkte Darstellungen der anfänglichen Halluzinationen des Modells sein. Dann lenkt das System das Modell sanft von diesen Fehlern ab, wenn es das nächste Mal versucht:

Eine Illustration, wie die neue Methode Halluzinationen in Bildunterschriften identifiziert und reduziert. Das reguläre Modell beschreibt Vögel, die nicht im Originalbild vorhanden sind, was zu einem rekonstruierten Bild führt, das sie hinzufügt. Diese Fehler sind rot markiert. Im Gegensatz dazu vermeidet die vorgeschlagene Methode diese erfundenen Details, während sie die Beschreibung spezifisch und fließend hält. Quelle: https://arxiv.org/pdf/2509.21997

Die Methode beginnt, indem sie dem Modell echte Bilder zeigt und es beschreiben lässt, einschließlich einiger Beschreibungen, die Objekte oder Details enthalten, die nicht tatsächlich vorhanden sind. Diese halluzinierten Beschreibungen werden dann verwendet, um synthetische Bilder zu generieren, die die Fehler leichter zu erkennen machen. Durch den Vergleich der realen und generierten Bilder lernt das System, welche internen Muster im Modell dazu neigen, erfundene Inhalte zu produzieren.

Sobald diese Fehlermuster identifiziert sind, können sie gespeichert und später verwendet werden. Wenn dem Modell ein neues Bild gegeben wird, wird das System seine internen Signale während der Beschreibung anpassen, es von den bekannten Mustern, die Halluzinationen verursachen, wegnicken. Dies funktioniert in einem einzigen Durchgang und erfordert keine zusätzlichen Daten, Neuschulung oder neue Bildgenerierung zur Testzeit.

Das Verstrickte Netz

In dem oben gezeigten Beispiel aus dem Papier können wir sehen, dass Verstrickung wahrscheinlich dafür verantwortlich ist, “Vögel” in das Eingabebild zu “verzieren”, obwohl das erste Bild anscheinend keine Vögel enthält.

Verstrickung tritt auf, wenn ein Modell bestimmte Konzepte mit anderen Konzepten assoziiert, einfach weil die beiden (oder mehr) Konzepte im ursprünglichen Datenverteilungsmuster, auf dem das Modell trainiert wurde, häufig zusammen auftauchen. In diesem Fall könnte das Modell viele Bilder von Flugzeugen+Vögel gesehen haben, was eine Assoziation verursacht, die nicht auf das spezifische Bild anwendbar ist, aber dennoch in die abgeleitete Beschreibung eindringt.

Obwohl Verstrickung durch frühes Stoppen des Trainings gemildert werden kann (was im Allgemeinen das Modell maximal flexibel und anpassungsfähig macht), verringert dies auch die Detailgenauigkeit aller trainierten Konzepte, was den Modelltrainer mit dem ewigen Dilemma zurücklässt: ein Modell zu erstellen, das sehr flexibel und entangled ist; oder ein Modell zu erstellen, das leistungsfähiger generativ ist, aber auch eher “assoziierte” Halluzinationen produziert?

Wenn die Qualität der Beschreibung und die Beachtung von Details in der Kuration der ursprünglichen Daten für ein generatives Modell besser als Logistik es normalerweise erlaubt gewesen wäre, hätten die Beschreibungen für alle Quellbilder jedes Objekt in jedem Bild detailliert, sodass das trainierte Modell ihnen diskrete und entangled Einträge in seinem latenten Raum zuweisen könnte.

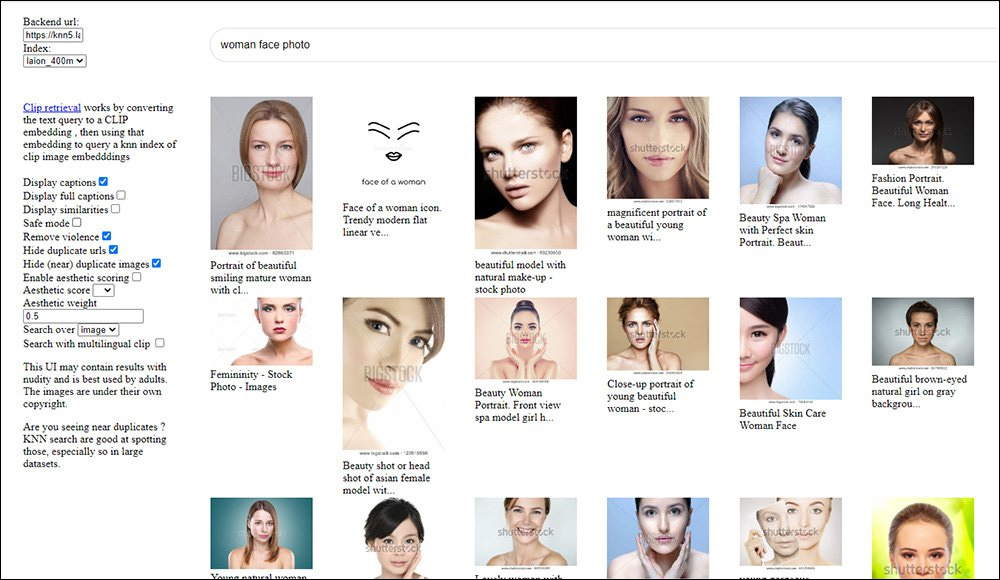

Wie es steht, führt die selbstbedienende Praxis von SEO-Beschreibungen, kombiniert mit der Tatsache, dass ad hoc hyperskalige Web-Scraping immer noch die beste Quelle für das Training wirklich leistungsfähiger generativer Modelle ist, dazu, dass Bildbeschreibungen erheblich von diesem Standard abweichen:

Eine Illustration, wie schwache Beschreibungen die Nützlichkeit von LAION-Bildern für das Training von Modellen wie Stable Diffusion begrenzen. Viele der Textlabels sind oberflächlich, vage oder für SEO optimiert, anstatt eine genaue Beschreibung zu liefern, was es dem Modell schwerer macht, feinkörnige visuelle Konzepte wie Gesichtszüge zu lernen. (Ursprüngliche Quelle war https://rom1504.github.io/, jetzt nicht mehr verfügbar).

Daher, da eine grundlegende Lösung unwahrscheinlich je praktikabel sein wird, ist die Reduzierung von LLM/VLM-Halluzinationen durch Workarounds und Kompromisse jetzt ein starker Unterstrang in der Literatur.

Die neue chinesische Technik, die diese Woche vorgestellt wurde, wurde von den Autoren über eine Vielzahl von Architekturen in verschiedenen Bedingungen getestet und könnte eine nützliche Möglichkeit sein, “Halluzinationsverschmutzung” zu reduzieren.

Sie sagen:

‘Umfangreiche Experimente über mehrere Benchmarks hinweg zeigen, dass unsere Methode Halluzinationen auf Objekt-, Attribut- und Beziehungsebene erheblich reduziert, während sie den Recall und die Beschreibungsfülle größtenteils bewahrt.’

Die neue Veröffentlichung trägt den Titel Exposing Hallucinations To Suppress Them: VLMs Representation Editing With Generative Anchors und stammt von drei Forschern der Universität für Wissenschaft und Technologie China und der Nanjing-Universität.

Methode

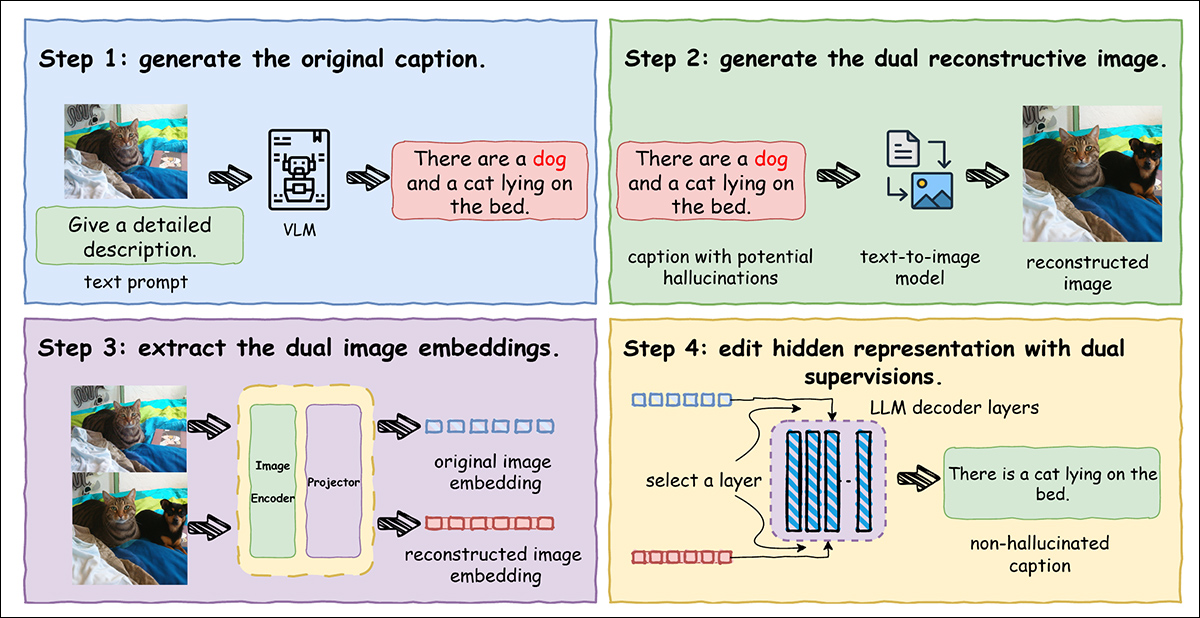

Die Autoren haben eine End-to-End-Pipeline entwickelt, die unten gezeigt wird, um Halluzinationen in Bildbeschreibungen zu identifizieren und zu unterdrücken:

Eine Illustration der vollständigen Pipeline. Ein Bild-Sprach-Modell generiert zunächst eine Beschreibung aus dem Eingabebild, die halluzinierten Inhalte enthalten kann. Diese Beschreibung wird dann verwendet, um ein rekonstruiertes Bild mithilfe eines Text-Bild-Modells zu erstellen, was Halluzinationen leichter erkennbar macht. Embeddings aus beiden Original- und rekonstruierten Bildern werden extrahiert und verwendet, um Anpassungen im Decoder zu steuern, was dem Modell hilft, halluzinierte Details zu unterdrücken, während die Beschreibungsfülle bewahrt wird.

Beginnend mit einem realen Eingabebild generiert ein Bild-Sprach-Modell eine beschreibende Beschreibung, die erfundene Objekte oder Beziehungen enthalten kann. Diese Beschreibung wird dann in ein Text-Bild-Generator eingespeist, um ein rekonstruiertes Bild zu erstellen, das genau das beschreibt, was die Beschreibung sagt. Der Vergleich dieses rekonstruierten Bildes mit dem Original macht den erfundenen Inhalt offensichtlich und messbar, indem es subtile Fehler in Text in sichtbare Unterschiede umwandelt, die das System zielen und reduzieren kann.

Um das Modell von “erfundenen” Details abzulenken, vergleicht das System zwei Versionen desselben Bildes: das Original und ein rekonstruiertes, das auf der Beschreibung basiert. Jedes Bild wird in eine kompakte Einbettung umgewandelt, die seinen Inhalt erfasst.

Das Originalbild dient als zuverlässige Referenz, während das rekonstruierte Bild zeigt, wo Halluzinationen hereinkommen könnten. Indem es seine internen Repräsentationen anpasst, um näher an das Original und weiter von dem rekonstruierten Bild zu kommen, lernt das Modell, sich selbst zu korrigieren. Da dieser Prozess nicht auf handgefertigte Regeln oder externe Daten angewiesen ist, bleibt er vollständig selbstüberwacht.

Das Papier besagt:

‘Halluzinationen in MLLMs sind intrinsisch schwer zu erkennen, da sie sprachlich gut geformt sind und oft nicht von treuen Beschreibungen auf Textebene zu unterscheiden sind. Der Unterschied liegt nicht in der sprachlichen Plausibilität, sondern in der Fehlanpassung an visuelle Beweise, auf die das Modell selbst typischerweise nicht reagiert.’

‘Um dies zu adressieren, führen wir einen Halluzinations-Expositionsmechanismus ein, der generative Rekonstruktion nutzt, um implizite Inkonsistenzen in explizite und beobachtbare Signale umzuwandeln.’

Gegeben ein Eingabebild und seine Beschreibung, verwendet das System das FLUX.1-dev-Text-Bild-Modell, um ein Bild aus der Beschreibung allein zu rekonstruieren. Dies rekonstruierte Bild neigt dazu, die Bedeutung der Beschreibung zu übertrieben, was Halluzinationen offensichtlicher macht. Diese verstärkten Fehler dienen dann als nützliche Signale, die dem Modell helfen, seine eigenen Fehler zu erkennen und zu korrigieren.

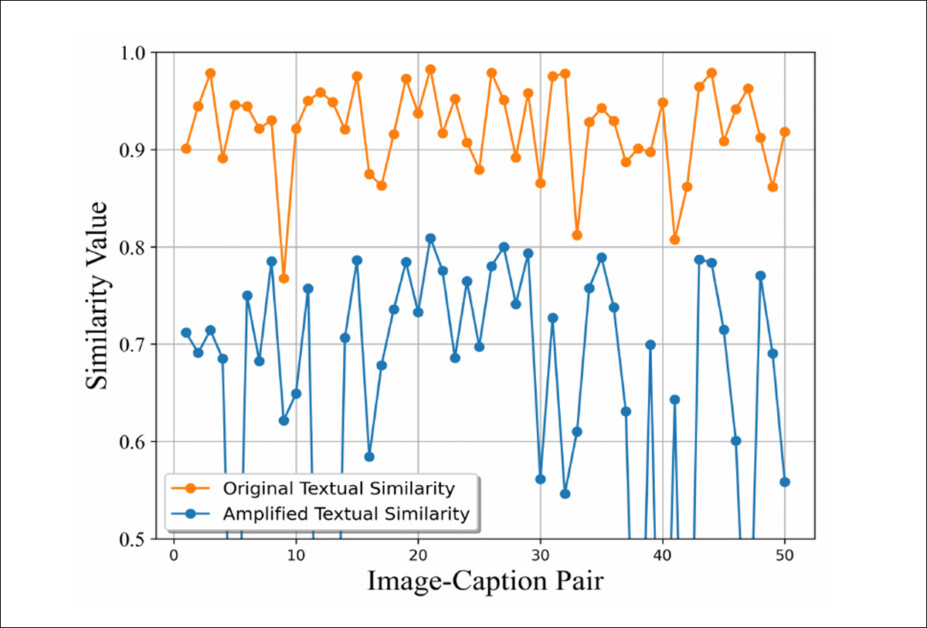

Um ihren Ansatz zu testen, injizierten die Autoren Halluzinationen in Beschreibungen und verwendeten das Text-Bild-Modell, um rekonstruierte Bilder zu generieren. Diese Bilder wurden dann von LLaVA neu beschrieben, und die semantische Ähnlichkeit zwischen den ursprünglichen und halluzinierten Beschreibungen wurde ausgewertet:

Eine Illustration, wie der Halluzinations-Verstärkungsmechanismus subtile Fehler sichtbar macht. Jeder Punkt zeigt die Ähnlichkeit zwischen Beschreibungen der Original- und rekonstruierten Bilder für ein Bild-Beschreibung-Paar. Die orangefarbene Linie stellt die Ähnlichkeit dar, die direkt zwischen Original- und halluzinierten Beschreibungen gemessen wird, die hoch bleibt und kleine Fehler maskiert; die blaue Linie stellt die Ähnlichkeit nach der Rekonstruktion dar, die scharf abfällt, was zeigt, dass der Prozess versteckte Halluzinationen in klare semantische Marker umwandelt, die erkannt und korrigiert werden können.

Die Ähnlichkeit fällt scharf nach der Rekonstruktion ab, was zeigt, dass der Prozess subtile Fehler erkennbarer macht.

Daten und Tests

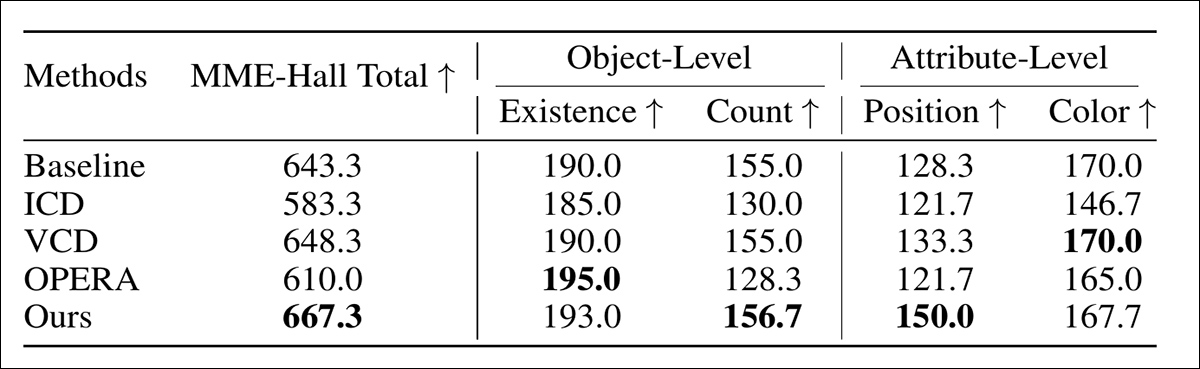

Die Validierung der Effektivität der neuen Methode umfasste die Verwendung von drei geeigneten Benchmarks: Bildbeschreibung-Halluzinationsbewertung mit Bildrelevanz (CHAIR); MLLM-Evaluierung-Benchmark (MME); und Pool-basierte Objekt-Abfrage-Evaluierung (POPE).

Aus dem CHAIR-Veröffentlichungspapier: Beispiele für halluzinierte Objekte, die von zwei führenden Beschreibungssystemen, TopDown und NBT, generiert wurden, wobei jedes Modell visuelle Elemente erfindet, die nicht tatsächlich im Bild vorhanden sind, wie Laptops, Spülbecken oder Surfbretter. Quelle: https://arxiv.org/pdf/1809.02156

Standardmetriken wie Halluzinationsrate oder Recall können irreführend sein, da ein Modell Halluzinationen einfach dadurch vermeiden kann, dass es kurze oder vage Beschreibungen produziert. Um den Kompromiss zwischen Recall und Halluzination zu berücksichtigen, wurde eine kombinierte Metrik namens Halluzination und Recall (HAR@β) verwendet, die Beschreibungen basierend auf Genauigkeit und Vollständigkeit bewertet und es ermöglicht, die Balance je nachdem anzupassen, ob der Schwerpunkt auf dem Vermeiden von Fehlern oder der Einbeziehung von mehr Details liegt.

POPE wurde verwendet, um kontextsensitive Objekthalluzinationen zu bewerten, und MME, um Attribut-Halluzinationen zu bewerten, wobei beide als Ja-oder-Nein-Urteilsaufgaben formuliert wurden.

Experimente wurden durchgeführt, die eine Vielzahl von repräsentativen Datensätzen umfassten, unter Verwendung des oben genannten Flux-Modells und der LLaVA-v1.5-7B-Variante. Die verwendeten Datensätze waren Microsoft COCO; A-OKVQA; und GQA.

Latente Bearbeitung wurde für die zweite Schicht der Modelle durchgeführt, gemäß vorheriger verwandter Arbeit, während Hyperparameter und Temperatur über alle Modelle hinweg konsistent waren.

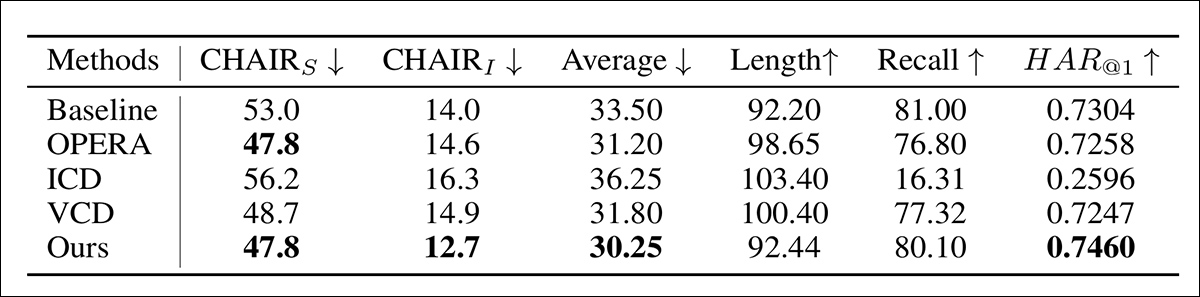

Die anfänglichen Ergebnisse auf CHAIR sind unten dargestellt*:

Leistung auf dem CHAIR-Benchmark für Halluzinationsminderung, ausgewertet mit mehreren Metriken.

Über diese Ergebnisse kommentieren die Autoren:

‘[Unsere Methode übertrifft andere Baselines konsistent auf beiden CHAIRS und CHAIRI[*] , was ihre überlegene Effektivität bei der Unterdrückung von Halluzinationen demonstriert. Während fast alle Methoden unvermeidlich den Recall verringern, während sie Halluzinationen unterdrücken, was einen Kompromiss zwischen Treue und Informativität widerspiegelt, erreicht unser Ansatz den geringsten Rückgang.

‘Dies zeigt, dass unsere Methode eine breite Palette von tatsächlichen Objekten erfasst. Mit der HAR@β-Metrik erreicht unsere Methode den höchsten Score, was ihre Fähigkeit unterstreicht, Halluzinationen zu reduzieren, während sie die Abdeckung bewahrt.’

Die Forscher führen diese starken Ergebnisse auf die dual-supervisierte Einrichtung zurück, bei der saubere Semantik aus dem Originalbild verstärkt und gleichzeitig irreführende Signale aus dem rekonstruierten Bild unterdrückt wurden. Da die Anpassung nur die Richtung zielte, die mit Halluzinationen assoziiert war, blieb der Rest der Repräsentation intakt, was es dem System ermöglichte, Fehler zu korrigieren, ohne Details oder Informativität zu opfern.

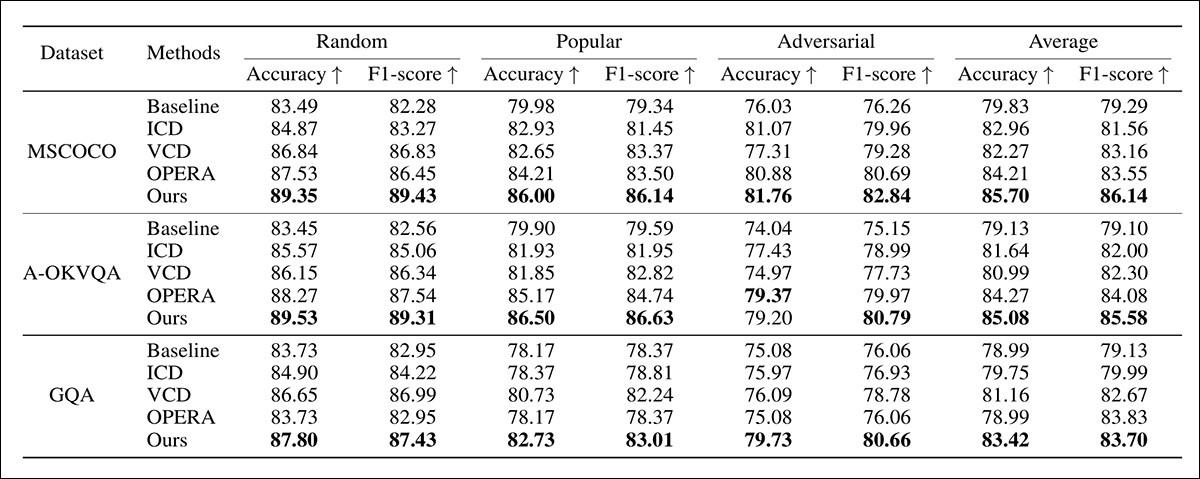

Vergleich der Leistung auf dem POPE-Benchmark unter verschiedenen Konfigurationen und Datensätzen.

In Bezug auf die Ergebnisse auf POPE, die oben in der Ergebnistabelle gezeigt werden, behauptet das Papier:

‘Es kann beobachtet werden, dass unsere Methode konsistent die beste Leistung über alle Einstellungen hinweg erzielt. Bemerkenswerterweise kann unsere Methode bis zu +5,95% Genauigkeit und +6,85% F1-Score im Durchschnitt erreichen, was andere trainingsfreie Ansätze um einen großen Betrag übertrifft.

‘Daher zeigen diese Ergebnisse, dass unsere Methode eine zuverlässige und generalisierbare Lösung über verschiedene Schwierigkeitsgrade hinweg bietet.’</p]