Andersons Blickwinkel

Vibe Coding leidet unter der Ausweitung der Rolle der KI

Eine neue Studie kommt zu dem Ergebnis, dass sich die Stimmungskodierung verbessert, wenn Menschen die Anweisungen geben, aber verschlechtert, wenn KI dies tut. Die beste hybride Lösung stellt den Menschen in den Vordergrund, während die KI als Schiedsrichter oder Richter fungiert.

Neue Forschungsergebnisse aus den Vereinigten Staaten untersuchen, was passiert, wenn KI-Systeme die Steuerung übernehmen dürfen. Vibe-CodierungAnstatt einfach nur menschliche Anweisungen auszuführen, hat man festgestellt, dass große Sprachmodelle (LLMs) eine größere Richtungsrolle übernehmen, sind die Ergebnisse fast immer schlechter.

Obwohl die Forscher OpenAI nutzten GPT-5 als Rahmen für ihre kollaborativen Mensch/KI-Experimente bestätigten sie später, dass sowohl Anthropics Claude Opus 4.5 und Google Gemini 3 Pro unterlagen mit zunehmender Verantwortung der gleichen negativen Entwicklung, wobei festgestellt wurde, dass „selbst eine begrenzte menschliche Beteiligung die Leistung stetig verbessert“:

„[Menschen] bieten eine einzigartig effektive, übergeordnete Führung über verschiedene Iterationen hinweg, [während] KI-gestützte Führung oft zu Leistungseinbrüchen führt. Wir haben außerdem festgestellt, dass eine sorgfältige Rollenverteilung, bei der die Menschen die Richtung vorgeben und die Bewertung an KI delegiert wird, die Leistung hybrider Systeme verbessern kann.“

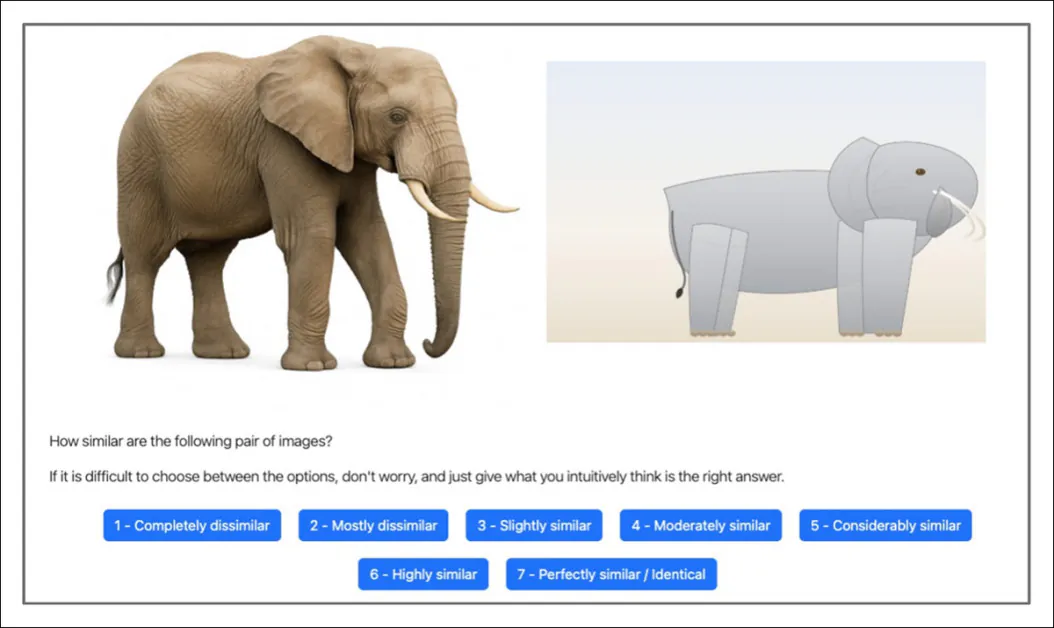

Um einen konsistenten Test zu gewährleisten, der sowohl von Menschen als auch von KI gleichermaßen bewertet werden kann, wurde ein kontrollierter experimenteller Rahmen um eine iterative Codierungsaufgabe herum aufgebaut, bei der ein Referenzbild – mit einem Foto einer Katze, eines Hundes, eines Tigers, eines Vogels, eines Elefanten, eines Pinguins, eines Hais, eines Zebras, einer Giraffe oder eines Pandas – mithilfe skalierbarer Vektorgrafiken nachgebildet werden musste.SVG), und dass diese Rekonstruktion anhand der Fotoquelle beurteilt wurde, von der sie stammt:

Sowohl menschlichen als auch KI-Teilnehmern wurde ein fotografisches Referenzbild zusammen mit einer KI-generierten SVG-Rekonstruktion gezeigt. Sie wurden gebeten, die Ähnlichkeit der beiden Bilder auf einer siebenstufigen Skala zu bewerten. Quelle

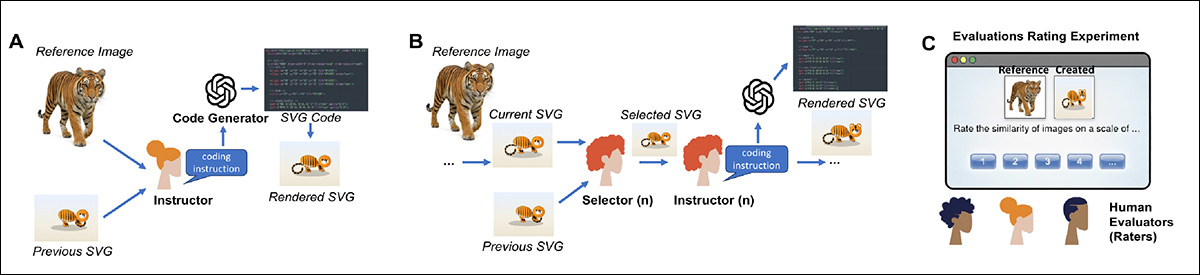

In jeder Runde gab ein Agent Anweisungen in natürlicher Sprache auf hohem Niveau, um einen Codegenerator zu steuern, und ein anderer entschied, ob die neue Version beibehalten oder zur vorherigen zurückgekehrt werden sollte – ein strukturierter Kreislauf, der reale kollaborative Arbeitsabläufe widerspiegelt.

In 16 Experimenten mit 604 Teilnehmern und Tausenden von API-Aufrufen wurden vollständig von Menschen geleitete Testrunden direkt mit vollständig KI-geleiteten Runden unter ansonsten identischen Bedingungen verglichen.

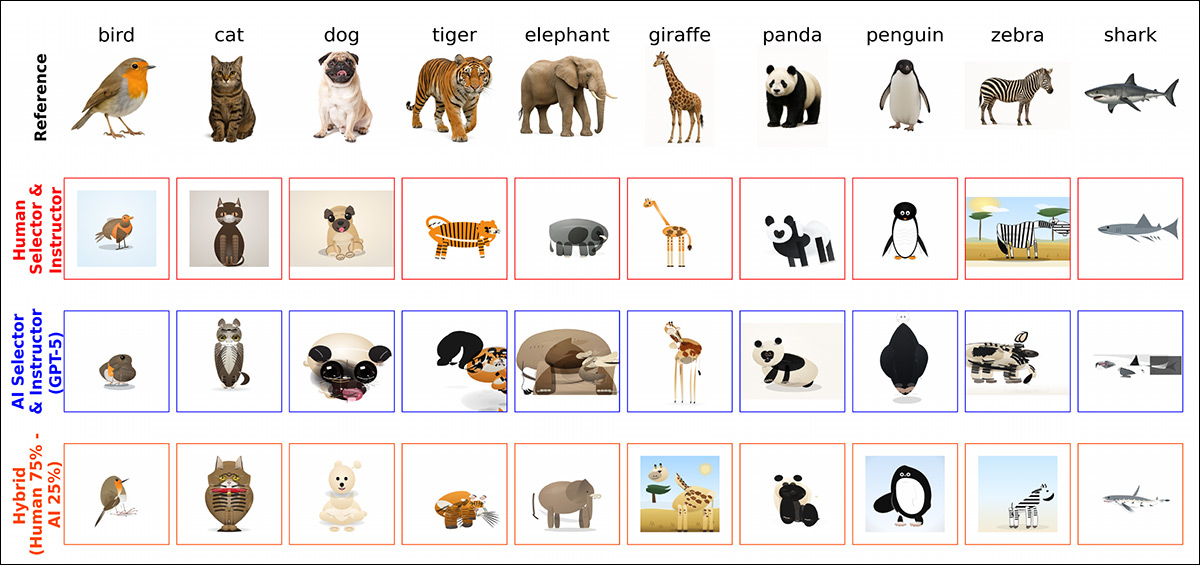

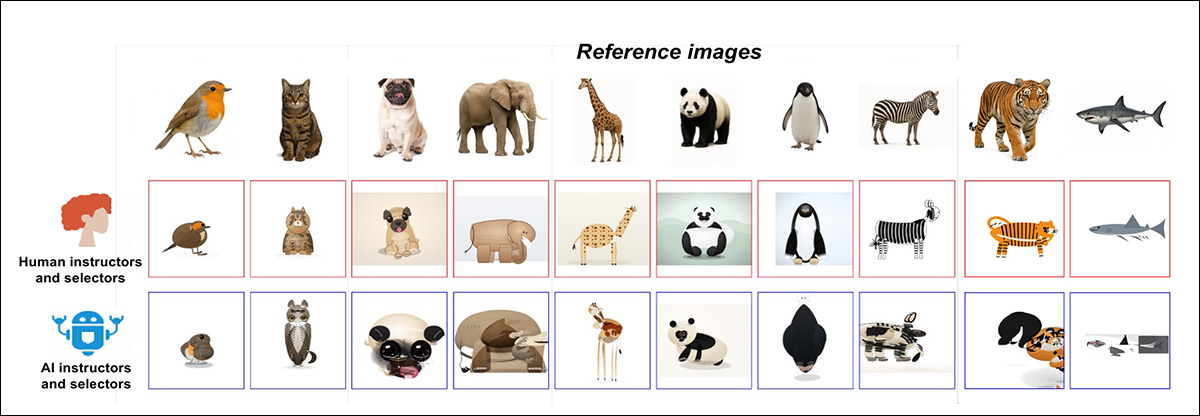

Einige der vielfältigen Lösungen, die durch unterschiedliche Kombinationen von Mensch/KI-Kollaborationsanteilen und -arten erzielt wurden (entnommen einer größeren Abbildung in der Originalveröffentlichung, auf die wir den Leser verweisen).

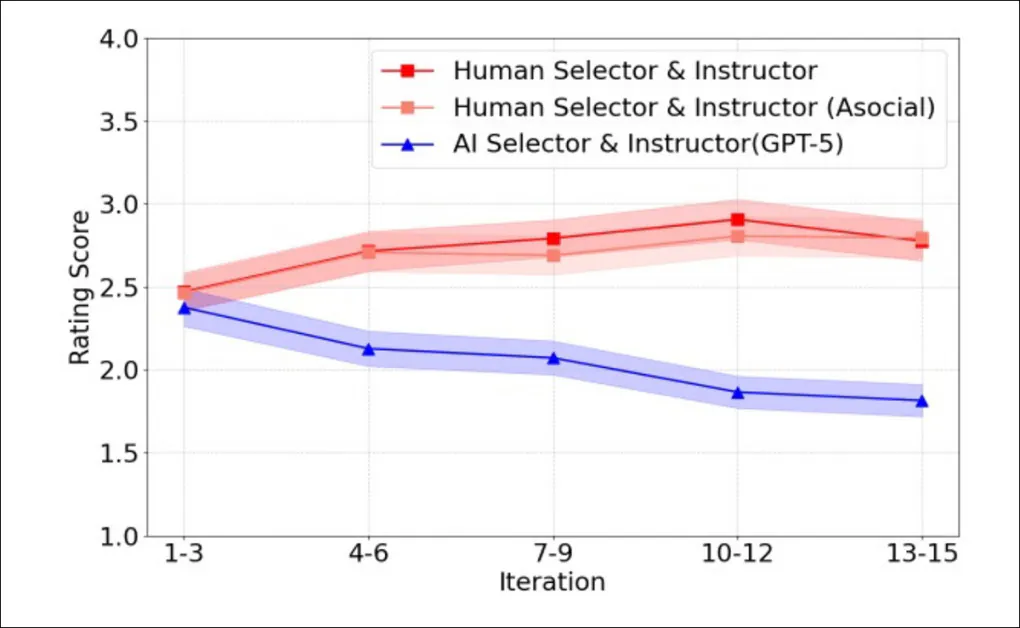

Obwohl Menschen und KI zu Beginn der Tests ähnliche Leistungen erbrachten, entwickelten sich ihre Ergebnisse im Laufe der Zeit unterschiedlich: Wenn Menschen die Anweisungen gaben und die Auswahlentscheidungen trafen, stiegen die Ähnlichkeitswerte über die Iterationen hinweg an, mit einer stetigen kumulativen Verbesserung; wenn KI-Systeme jedoch beide Rollen übernahmen, zeigten die Leistungen keine durchgängigen Verbesserungen und nahmen im Laufe der Runden häufig ab – obwohl für die Codegenerierung dasselbe zugrunde liegende Modell verwendet wurde und die KI Zugriff auf dieselben Informationen hatte wie die menschlichen Teilnehmer.

Der Prolixitätseffekt

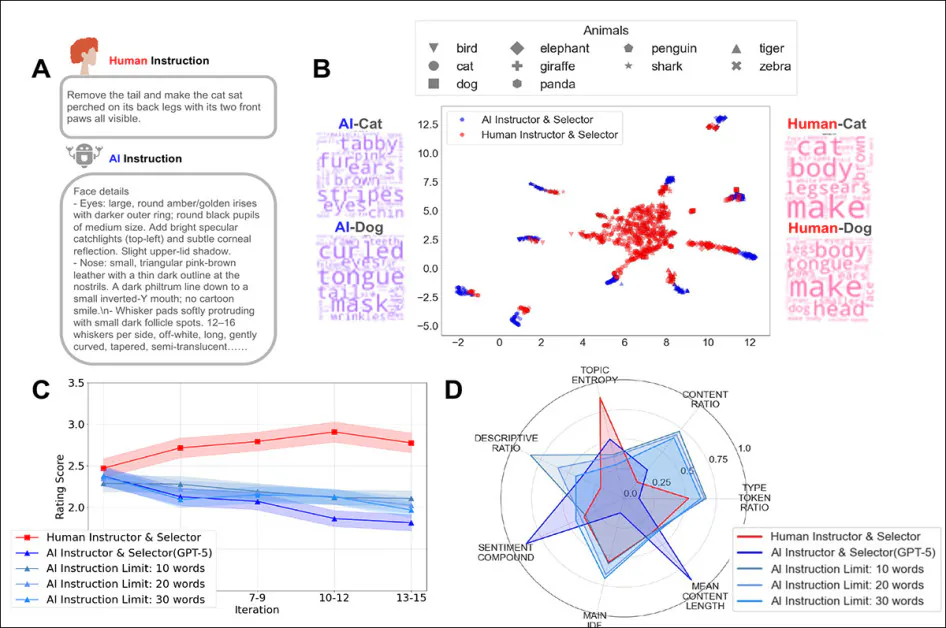

Die Ergebnisse zeigten auch, dass menschliche Anweisungen typischerweise kurz und handlungsorientiert waren und sich darauf konzentrierten, was im aktuellen Bild als Nächstes geändert werden sollte; im Gegensatz dazu waren KI-Anweisungen viel länger und stark beschreibend (ein Faktor, der parametrisiert für GPT-5), wobei visuelle Attribute detailliert beschrieben werden, anstatt schrittweise Korrekturen zu priorisieren.

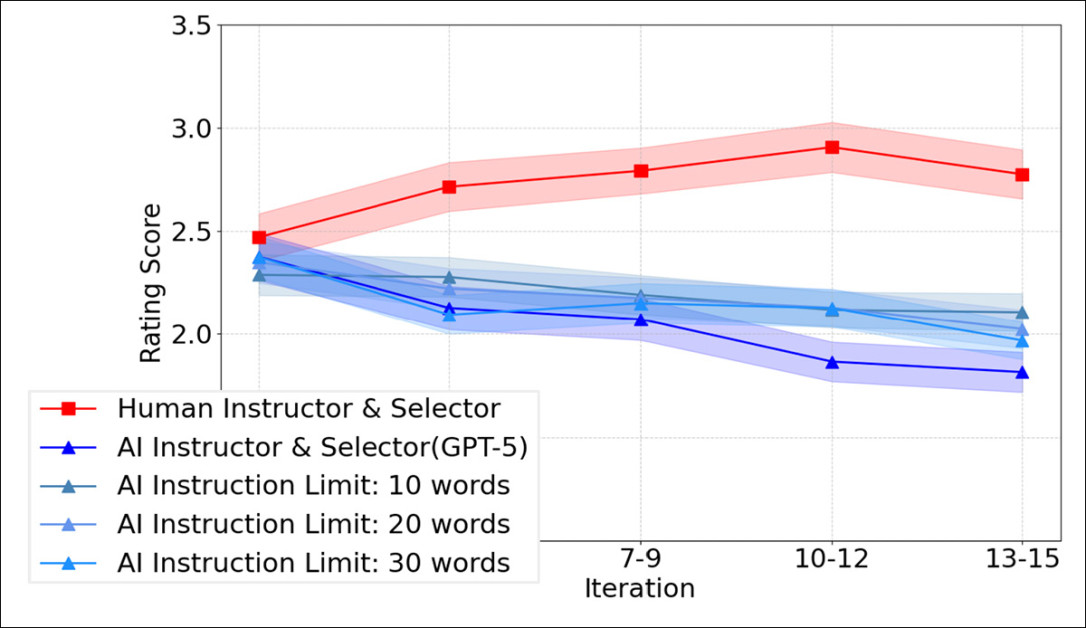

Wie aus der untenstehenden Grafik hervorgeht, konnte das Muster jedoch durch die Einführung strenger Wortbegrenzungen für KI-Anweisungen nicht umgekehrt werden; selbst bei einer Beschränkung auf 10, 20 oder 30 Wörter verbesserten sich die KI-gesteuerten Ketten im Laufe der Zeit nicht:

Ähnlichkeitsbewertungen über verschiedene Iterationen hinweg für von Menschen geleitete Runden im Vergleich zu vollständig KI-gesteuerten Runden mit auf 10, 20 oder 30 Wörter beschränkten Anweisungen. Offensichtlich verhindert die Verkürzung der KI-Anweisungen nicht den iterativen Leistungsabfall, der beobachtet wird, wenn die KI sowohl die Anweisung als auch die Auswahl steuert.

Hybride Experimente machten das Muster deutlicher: Sie zeigten, dass bereits ein geringer menschlicher Eingriff die Ergebnisse im Vergleich zu vollständig KI-gesteuerten Setups verbesserte; allerdings nahm die Leistung in der Regel ab, je mehr KI-gesteuert wurde.

Als die Rollen getrennt wurden, konnten Bewertung und Auswahl mit relativ geringem Qualitätsverlust an KI übertragen werden; doch der Ersatz menschlicher Anweisungen auf hohem Niveau durch KI-gestützte Steuerung führte zu spürbaren Leistungseinbußen, was darauf hindeutet, dass nicht die Person entscheidend war. generierte den Code, aber wer die Richtung vorgegeben und beibehalten über mehrere Iterationen hinweg.

Die Autoren folgern:

„In zahlreichen Experimenten verbesserte sich die von Menschen gesteuerte Codierung mit jeder Iteration, während die von KI gesteuerte Codierung trotz Zugriff auf die gleichen Informationen und ähnlicher Ausführungsfähigkeiten oft zusammenbrach.“

„Dies weist auf zentrale Schwierigkeiten heutiger KI-Systeme hin, eine kohärente, übergeordnete Steuerung über wiederholte Interaktionen hinweg aufrechtzuerhalten, wie sie für eine erfolgreiche Stimmungskodierung notwendig ist.“

Die neues Papier ist betitelt Warum menschliche Führung beim kollaborativen Vibe Coding wichtig istund stammt von sieben Forschern der Cornell University, der Princeton University, des Massachusetts Institute of Technology und der New York University.

Methodik

Für die Experimente betrachtete ein menschlicher Versuchsleiter ein von GPT-5 generiertes Referenzfoto eines Tieres zusammen mit dem zuletzt zugehörigen SVG-Imitationsversuch. Anschließend verfasste er Anweisungen in natürlicher Sprache, um den Codegenerator zu einer genaueren Übereinstimmung zu führen.

Der Generator erzeugte somit in jeder Runde eine neue SVG-Datei und bildete so eine iterative Schleife, um zu testen, wie sich die Wirkung der Steuerung im Laufe der Zeit akkumuliert. Als Ziel dienten zehn von GPT-5 generierte Tierbilder mit unterschiedlichen Formen und Texturen, sodass Verbesserungen oder Fehler leicht erkennbar waren.

Schema des im Rahmen der Studie verwendeten Workflows zur Vibe-Codierung. In A) betrachtet ein menschlicher Instruktor ein fotografisches Referenzbild zusammen mit dem bisher besten erzeugten SVG und verfasst Anweisungen in natürlicher Sprache für den Codegenerator, die dieser bei der Erstellung des nächsten SVGs befolgen soll. In B) vergleicht ein menschlicher Selektor das neue SVG mit dem vorherigen und wählt die Version aus, die besser zum Referenzbild passt, bevor er das ausgewählte SVG für die nächste Anweisungsrunde weitergibt. In C) bewerten unabhängige menschliche Gutachter die Ähnlichkeit jedes generierten SVGs mit seinem Referenzbild und liefern so die Ergebnisse, die zur Beurteilung der Gesamtleistung verwendet werden.

Ein menschlicher Prüfer verglich jede neu generierte SVG-Datei mit der vorherigen und akzeptierte oder verwarf sie, wodurch der Prozess über alle Runden hinweg mit dem Referenzbild übereinstimmte. In dieser Basiskonfiguration übernahm dieselbe Person beide Aufgaben.

Messen qualitativ hochwertigeUnabhängige menschliche Gutachter bewerteten die Ähnlichkeit jeder generierten SVG-Datei mit ihrem Referenzbild. In sechzehn Experimenten gaben 120 Personen 4,800 Bewertungen ab. Alle Experimente wurden auf der gleichen Plattform durchgeführt. PsyNet Framework, ein Portal, das für strukturierte Interaktionen zwischen Menschen und KI-Systemen konzipiert wurde.

Für die Studie wurden 604 englische Muttersprachler rekrutiert. Die Tests umfassten 4,800 API-Aufrufe zur Codegenerierung und 5,327 API-Aufrufe zur Instruktion. Obwohl GPT-5 das Hauptmodell war, wurden kleinere Vergleichsgruppen mit Claude Opus 4.5 und Gemini 3 Pro durchgeführt, die jeweils 280 Anfragen bearbeiteten.

Ergebnisse

Es wurden 30 Vibe-Codierungsrunden durchgeführt, die jeweils 15 Bearbeitungen der zehn zentralen Referenzbilder umfassten. Hierfür wurden 45 menschliche Teilnehmer ausgewählt, die in den „menschengeleiteten“ Runden über zehn Iterationen hinweg jeweils sowohl als Auswähler als auch als Instruktor fungierten.

In jedem Durchgang wählte derselbe Teilnehmer zunächst zwischen dem aktuellen und dem vorherigen SVG und verfasste anschließend die Anweisungen für die nächste Runde. In einer zweiten Testversion wurden diese menschlichen Entscheidungen durch API-Aufrufe an GPT-5 ersetzt, während der übrige Aufbau unverändert blieb. In allen Fällen gaben die Rollen des Ausbilders und des Auswählers dem Codegenerator Anweisungen in Klartext.

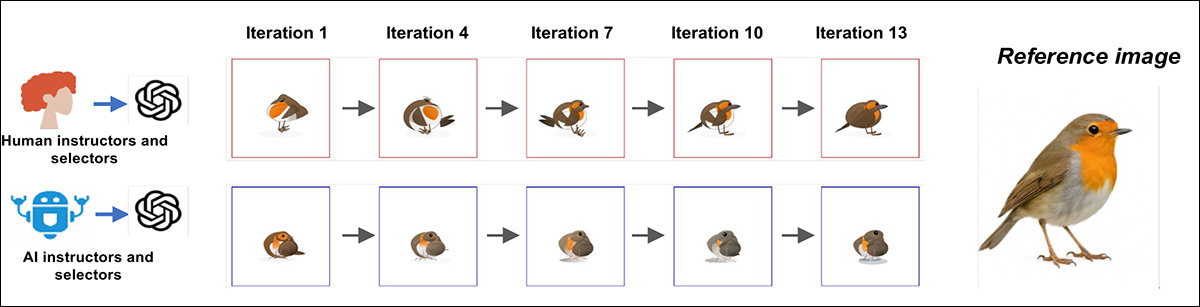

Ein repräsentatives Beispiel für mehrstufiges Vibe-Coding zeigt, wie der Prozess im Laufe der Zeit auseinanderläuft; wenn Menschen sowohl als Selektor als auch als Instruktor fungierten, verbesserte sich die SVG-Ausgabe stetig über die Iterationen hinweg und näherte sich mit jeder Runde dem Referenzbild an:

Beispielhafte Fortschritte für ein Referenzbild unter menschlicher (oben) und KI-gestützter (unten) Stimmungskodierung, die eine stetige Verbesserung über die Iterationen hinweg zeigen, wenn Menschen beide Rollen übernehmen, und Stagnation oder Abweichung, wenn beide Rollen von der KI übernommen werden.

Umgekehrt wurden in der KI-gestützten Version in frühen Runden manchmal wichtige visuelle Merkmale erfasst, spätere Versuche konnten diese Erfolge jedoch nicht ausbauen und entfernten sich in einigen Fällen sogar vom Ziel:

Die finalen Ergebnisse der letzten Iteration vergleichen von Menschen gesteuerte Wendungen (obere Reihe) mit KI-gesteuerten Kettenläufen (untere Reihe) anhand desselben Referenzbildsatzes. Die von Menschen gesteuerten Ergebnisse entsprechen den Originaltieren deutlich besser, während die KI-gesteuerten Ergebnisse sichtbare Verzerrungen oder den Verlust wichtiger Merkmale aufweisen.

Um die sich abzeichnenden Trends quantitativ zu erfassen, wurden die finalen Bilder unabhängigen menschlichen Gutachtern vorgelegt und hinsichtlich ihrer Ähnlichkeit mit den Referenzbildern bewertet. In den ersten Runden erzielten die von Menschen und KI geleiteten Durchgänge nahezu identische Ergebnisse; ab der fünfzehnten Runde war der Unterschied jedoch deutlich erkennbar: Die von Menschen ausgewählten Bilder lagen deutlich näher an den Zielvorgaben. Im Laufe der Zeit verbesserten sich die Bewertungen der Menschen kontinuierlich, wobei der größte relative Zuwachs gegenüber der KI 27.1 % betrug.

Durchschnittliche Ähnlichkeitswerte über alle Iterationen hinweg für die von Menschen und KI gesteuerte Stimmungscodierung, die stetige Verbesserungen zeigen, wenn Menschen sowohl als Selektor als auch als Instruktor fungieren, und einen allmählichen Rückgang, wenn beide Rollen von GPT 5 übernommen werden.

Um sicherzustellen, dass die sich abzeichnenden Trends nicht auf die kollektive Leistung mehrerer gleichzeitig beteiligter Personen zurückzuführen waren, rekrutierten die Forscher zehn weitere Personen, die alleine arbeiteten und jeweils drei Runden alleine durchführten – und die Ergebnisse verbesserten sich in der gleichen stetigen Weise, was beweist, dass die Zuwächse kein Zufall kollektiver Anstrengung waren.

The Big Picture

Würde GPT-5 jedoch, wenn es die Ergebnisse selbst beurteilen würde, zugeben, dass die menschlichen Ergebnisse besser waren? Die Bewertungen von Menschen und KI bewegten sich im Allgemeinen in dieselbe Richtung, sodass das Modell gute von schlechten unterscheiden konnte, aber dennoch KI-generierte Bilder durchweg gut bewertete. höher als Menschen.

„Konkret haben wir gefragt, ob KI-Agenten erkennen würden, dass ihre eigenen Ergebnisse denen von Menschen unterlegen sind, oder ob sie stattdessen ihre eigenen Kreationen bevorzugen würden, was auf ein potenzielles Abstimmungsproblem hindeuten würde.“

Wie sich herausstellte, besteht tatsächlich ein Ausrichtungsproblem*:

„KI-Bewerter vergaben höhere Bewertungen an KI-generierte Ergebnisse. Diese Ergebnisse deuten darauf hin, dass die beobachteten Leistungsunterschiede möglicherweise auf Folgendes zurückzuführen sind: Fehlausrichtung in den Darstellungen zwischen Menschen und KI.

Bei der Untersuchung, wie Menschen und KI ihre Anweisungen formulieren, traten in Tests deutliche Diskrepanzen zutage. Wie die Abbildung unten zeigt, konzentrieren sich beide auf und Längenunterschiede sind Gegenstand der Divergenz zwischen KI und Mensch:

Ein Vergleich der Anweisungen von Menschen und KI während der Programmieraufgabe. Abbildung A zeigt, dass Menschen kurze, direkte Anweisungen geben, während KI lange, detaillierte Beschreibungen verfasst. Abbildung B visualisiert die Anweisungen und zeigt, dass menschliche Anweisungen gehäuft auftreten, während KI-Anweisungen nach Tierart aufgeteilt sind. Abbildung C verdeutlicht, dass eine Begrenzung der KI-Anweisungslänge ihre langfristig schlechten Ergebnisse nicht verbessert; und Abbildung D zeigt, dass Menschen selbst bei Wortbegrenzungen abwechslungsreichere und ausgewogenere Anweisungen geben als KI.

Menschliche Anweisungen waren in der Regel kurz und prägnant und boten klare Bearbeitungshinweise, die sich allgemein auf verschiedene Ziele anwenden ließen. KI-Anweisungen hingegen waren detailreich und oft überladen mit spezifischen Angaben zu Schattierung, Texturen, Beleuchtung oder anatomischen Details – Beschreibungen, die zwar isoliert betrachtet sinnvoll erscheinen mögen, aber keine hilfreichen nächsten Schritte für das Modell liefern (und die denen bekannt sein dürften, die mit den Problemen von LLMs vertraut sind). etwa Kontextlänged. h. die Fähigkeit, den Überblick über das große Ganze zu behalten, während sich ein Projekt entwickelt und wächst).

Um zu sehen, ob eine Reduzierung der Wortfülle die Leistung verbessern würde, wurde GPT-5 auf 10, 20 oder 30 Wörter pro Anweisung beschränkt; aber selbst diese komprimierten Anweisungen zeigten keine Verbesserung (siehe unten rechts in der obigen Grafik).

Gemeinsame Vorhaben

Um zu testen, was passiert, wenn Menschen und KI Teilen Zur Kontrolle führten die Forscher Programmieraufgaben mit unterschiedlichen Mischungen aus menschlicher und KI-Eingabe durch, die von meist menschlich zu größtenteils KI.

Jede Hybridmischung übertraf die vollständige KI-Steuerung, sodass selbst ein geringer menschlicher Eingriff die Ergebnisse verbesserte:

Hybride Codierungsumgebungen mit unterschiedlichen Mensch/KI-Mischungen. (A) zeigt, wie Menschen und KI bei jedem Codierungsschritt abwechselnd als Anleiter und Auswähler fungierten; (B) zeigt, dass eine stärkere menschliche Beteiligung zu qualitativ besseren Ergebnissen führte, während ein höherer KI-Einsatz die Ergebnisse verschlechterte; und (C) zeigt einen stetigen Rückgang der Endproduktqualität mit abnehmendem Anteil menschlicher Beteiligung, was bestätigt, dass eine konsequentere menschliche Steuerung bessere Ergebnisse lieferte.

Mit zunehmender Übernahme eines größeren Teils des Prozesses durch die KI sank die Leistung. Die besten Ergebnisse wurden erzielt, wenn Menschen die meisten Runden leiteten, die schlechtesten, wenn die KI die meisten Runden leitete. Keine dieser gemischten Konstellationen konnte sich mit jeder neuen Runde weiter verbessern, was darauf hindeutet, dass menschliche Steuerung am effektivsten ist, wenn sie stetig und konsequent erfolgt, anstatt nur gelegentlich.

Rollenumkehr

Die Studie untersuchte auch, ob es eine Rolle spielt. Wer macht was Bei solchen Aufgaben wurde dies getestet. Die überarbeitete Übung umfasste zwei Aufgaben: Ein Teilnehmer gab vor, wie das Bild verändert werden sollte, ein anderer wählte eine bevorzugte Version aus.

Solange beide Arbeiten von Menschen ausgeführt wurden, blieb die Qualität erhalten; aber wenn ein Mensch die Anweisungen gab und niemand Bei der Auswahl zwischen den Versionen verschlechterte sich die Qualität.

Tests zur Rollenteilung beim Vibe-Coding: In (A) führte das Entfernen der Selektorrolle zu schlechteren Ergebnissen, selbst wenn ein Mensch Anweisungen gab; in (B) verringerte das Ersetzen des menschlichen Selektors durch eine KI die Qualität leicht, jedoch nicht so stark wie das vollständige Weglassen der Auswahl.

Wenn die KI die Kontrolle hatte, spielte es keine Rolle, ob der Auswahlschritt übersprungen wurde, da die Ergebnisse in jedem Fall konsistent blieben; wenn aber Menschen die Anweisungen gaben und die KI zwischen den Ergebnissen auswählte, blieb die Qualität nahe an der des rein menschlichen Systems.

Das Gegenteil funktionierte nicht: Wenn KI Anweisungen gab, während Menschen die Ergebnisse auswählten, führte das zu schwächer Die Ergebnisse deuten darauf hin, dass menschliche kreative Führung weiterhin unerlässlich ist, während die Aufgabe, zwischen Optionen zu wählen, ohne großen Verlust an KI übertragen werden kann.

Das Papier kommt zu dem Schluss:

'[Hochrangige] Ideengenerierung und -vermittlung sind die entscheidenden menschlichen Beiträge, während Bewertung und Auswahl oft ohne Leistungseinbußen an KI delegiert werden können.'

„Dies legt ein praktisches Gestaltungsprinzip für Hybridsysteme nahe: Der Mensch sollte die Richtung vorgeben, während KI die Bewertung und Ausführung unterstützen kann.“

Fazit

Es bleibt abzuwarten, inwieweit verbesserte und/oder erweiterte Kontextfenster die Leistung von LLMs bei Aufgaben dieser Art beeinflussen werden. Der Tag, an dem die „LLM-Amnesie“ aufhört, ein alltägliches Ärgernis der Mensch-KI-Kollaboration zu sein, mag sowohl Anlass zur Freude als auch zur Besorgnis geben, denn das Problem, das die KI zu lösen versucht, ist wohl … befähigen.

Dennoch macht die Arbeit der Autoren auch deutlich, dass es angeboren und kritische Meinungsverschiedenheiten zwischen KI und Menschen bezüglich qualitativ hochwertige, was von den Konsumenten möglicherweise noch als ein unersetzliches menschliches Konzept eingestuft werden könnte.

* Meine Konvertierung der Inline-Zitate der Autoren in Hyperlinks.

Erstveröffentlichung: Freitag, 13. Februar 2026