Künstliche Intelligenz

Die Mängel von Amazon Mechanical Turk könnten Natural Language Generation Systeme gefährden

Eine neue Studie der University of Massachusetts Amherst hat englische Lehrer gegen Crowdsourced-Arbeiter bei Amazon Mechanical Turk in der Bewertung der Ausgabe von Natural Language Generation (NLG)-Systemen ausgetauscht, und zu dem Schluss gekommen, dass laxen Standards und dem “Gaming” von begehrten Aufgaben unter AMT-Arbeitern die Entwicklung des Sektors behindern könnten.

Die Studie kommt zu einer Reihe von vernichtenden Schlussfolgerungen über das Ausmaß, in dem die “industrielle” billige Auslagerung von offenen NLG-Bewertungsaufgaben zu minderwertigen Ergebnissen und Algorithmen in diesem Sektor führen kann.

Die Forscher haben auch eine Liste von 45 Papieren über offene Textgenerierung zusammengestellt, in denen die Forschung die Nutzung von AMT genutzt hat, und festgestellt, dass “die überwiegende Mehrheit” wichtige Details über die Nutzung von Amazon’s Crowdservice nicht berichtet hat, was es schwierig macht, die Ergebnisse der Papiere zu reproduzieren.

Schweißshop-Arbeit

Der Bericht kritisiert sowohl die Schweißshop-Natur von Amazon Mechanical Turk als auch die (wahrscheinlich budgetbeschränkten) akademischen Projekte, die AMT zusätzliche Glaubwürdigkeit verleihen, indem sie es als gültige und konsistente Forschungsressource nutzen und zitieren. Die Autoren bemerken:

‘Während AMT eine bequeme und erschwingliche Lösung ist, beobachten wir, dass eine hohe Varianz zwischen Arbeitern, eine schlechte Kalibrierung und kognitiv anspruchsvolle Aufgaben Forscher dazu verleiten können, irreführende wissenschaftliche Schlussfolgerungen zu ziehen (z. B., dass menschlich geschriebener Text “schlechter” ist als GPT-2s).’

Der Bericht macht das System und nicht die Spieler verantwortlich, da die Forscher bemerken:

‘[Crowd] Arbeiter werden häufig unterbezahlt für ihre Arbeit, was sowohl die Qualität der Forschung als auch, wichtiger noch, die Fähigkeit dieser Crowd-Arbeiter, ein angemessenes Einkommen zu verdienen, schädigt.’

Das Papier, betitelt Die Gefahren der Nutzung von Mechanical Turk zur Bewertung offener Textgenerierung, kommt zu dem Schluss, dass “Experten-Bewerter” wie Sprachlehrer und Linguisten verwendet werden sollten, um offene künstliche NLG-Inhalte zu bewerten, auch wenn AMT billiger ist.

Testaufgaben

Im Vergleich der Leistung von AMT mit weniger zeitbeschränkten, experten Lesern, gaben die Forscher 144 $ für die AMT-Dienste aus, die tatsächlich in den Vergleichstests verwendet wurden (obwohl viel mehr für “nicht verwendbare” Ergebnisse ausgegeben wurde – siehe unten), und forderten zufällige “Turks” auf, eine von 200 Texten zu bewerten, die zwischen menschlich erstelltem Textinhalt und künstlich generiertem Text aufgeteilt waren.

Die Beauftragung von professionellen Lehrern mit der gleichen Arbeit kostete 187,50 $, und bestätigte ihre überlegene Leistung (im Vergleich zu AMT-Arbeitern) durch die Einstellung von Upwork-Freelancern, um die Aufgaben zu wiederholen, kostete zusätzlich 262,50 $.

Jede Aufgabe bestand aus vier Bewertungskriterien: Grammatik (‘Wie grammatisch korrekt ist der Text des Story-Fragments?’); Kohärenz (‘Wie gut passen die Sätze im Story-Fragment zusammen?’); Sympathie (‘Wie unterhaltsam finden Sie das Story-Fragment?’); und Relevanz (‘Wie relevant ist das Story-Fragment für den Prompt?’).

Erzeugung der Texte

Um NLG-Material für die Tests zu erhalten, verwendeten die Forscher das 2018er Hierarchical Neural Story Generation Dataset von Facebook AI Research, das 303.358 englische Geschichten von Benutzern der sehr beliebten (15 Mio.+ Benutzer) r/WritingPrompts-Subreddit umfasst, wo die Geschichten der Abonnenten durch einzelne Satz-“Prompts” “gesät” werden, ähnlich wie bei aktuellen Praktiken in Text-to-Image-Generation – und, natürlich, in offenen Natural Language Generation Systemen.

200 Prompts aus dem Dataset wurden zufällig ausgewählt und durch ein mittelgroßes GPT-2-Modell unter Verwendung der Hugging-Face-Transformers-Bibliothek verarbeitet. So wurden zwei Sätze von Ergebnissen aus den gleichen Prompts erhalten: die menschlich geschriebenen diskursiven Essays von Reddit-Benutzern und GPT-2-erzeugte Texte.

Um zu verhindern, dass die gleichen AMT-Arbeiter die gleiche Geschichte mehrmals bewerten, wurden drei AMT-Arbeiterurteile pro Beispiel angefordert. Zusammen mit Experimenten über die englischen Sprachfähigkeiten der Arbeiter (siehe Ende des Artikels) und unter Berücksichtigung der Ergebnisse von Arbeitern mit geringem Aufwand (siehe ‘Kurze Zeit’ unten), erhöhte sich der Gesamtaufwand für AMT auf etwa 1.500 $.

Um ein Level-Playing-Field zu schaffen, wurden alle Tests an Wochentagen zwischen 11:00 und 11:30 Uhr PST durchgeführt.

Ergebnisse und Schlussfolgerungen

Die umfassende Studie deckt viel Boden ab, aber die wichtigsten Punkte sind wie folgt:

Kurze Zeit

Das Papier fand heraus, dass eine offiziell von Amazon gemeldete durchschnittliche Aufgabenzeit von 360 Sekunden auf eine reale Arbeitszeit von nur 22 Sekunden und eine Median-Arbeitszeit von nur 13 Sekunden – ein Viertel der Zeit, die der schnellste Englischlehrer für die Aufgabe benötigte – herabgesetzt wurde.

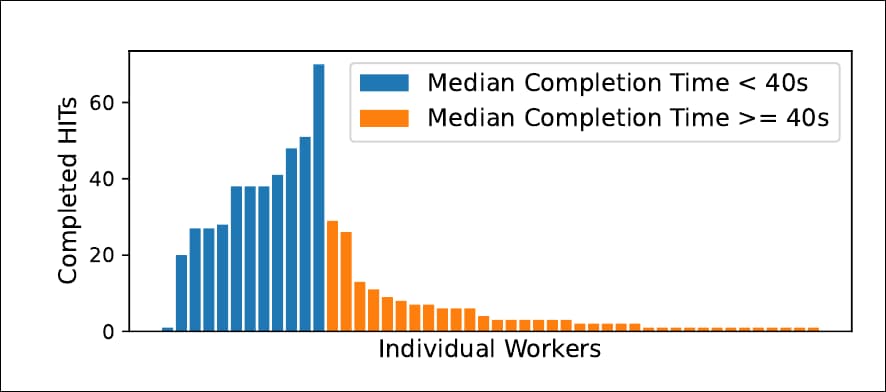

Vom zweiten Tag der Studie: Die einzelnen Arbeiter (in Orange) verbrachten deutlich weniger Zeit mit der Bewertung jeder Aufgabe als die besser bezahlten Lehrer und (später) die noch besser bezahlten Upwork-Vertragspartner. Quelle: https://arxiv.org/pdf/2109.06835.pdf

Da AMT keine Grenzen für die Human Intelligence Tasks (HITs) setzt, die ein einzelner Arbeiter übernehmen kann, sind AMT-“Big-Hitter” entstanden, die (profitable) Reputationsprofile für die Erledigung hoher Aufgabennummern pro Experiment haben. Um die Zeit zwischen aufeinanderfolgend eingereichten HITs zu kompensieren, maßen die Forscher die Zeit zwischen Start- und Endzeit jeder HIT. Auf diese Weise kam der Unterschied zwischen AMT’s gemeldeter WorkTimeInSeconds und der tatsächlichen Zeit, die für die Aufgabe aufgewendet wurde, in den Blick.

Da eine solche Arbeit nicht in diesen reduzierten Zeitrahmen erledigt werden kann, mussten die Forscher dies kompensieren:

‘Da es unmöglich ist, sorgfältig einen paragraphlangen Text zu lesen und alle vier Eigenschaften in nur 13 Sekunden zu bewerten, messen wir den Einfluss auf die Durchschnittsbewertung, wenn wir Arbeiter filtern, die zu wenig Zeit pro HIT verbringen… Insbesondere entfernen wir Urteile von Arbeitern, deren Medianzeit unter 40 s (was eine niedrige Latte ist) liegt, und finden, dass im Durchschnitt etwa 42 % unserer Bewertungen gefiltert werden (zwischen 20 % und 72 % über alle Experimente hinweg).’

Das Papier behauptet, dass die falsch berichtete tatsächliche Arbeitszeit in AMT ein “großes Problem” ist, das typischerweise von Forschern, die die Dienste nutzen, übersehen wird.

Hand-Holding notwendig

Die Ergebnisse deuten weiter darauf hin, dass AMT-Arbeiter nicht zuverlässig zwischen Text, der von einem Menschen geschrieben wurde, und Text, der von einer Maschine geschrieben wurde, unterscheiden können, es sei denn, sie sehen beide Texte nebeneinander, was effektiv ein typisches Bewertungsszenario (in dem der Leser in der Lage sein sollte, ein Urteil auf der Grundlage eines einzelnen Textbeispiels, “echt” oder künstlich erzeugt, zu fällen) kompromittieren würde.

Kasuelle Akzeptanz von minderwertigem künstlichem Text

AMT-Arbeiter bewerteten konsistent minderwertigen GPT-basierten künstlichen Text auf demselben Niveau wie höherwertigen, kohärenten Text, der von Menschen geschrieben wurde, im Gegensatz zu den Englischlehrern, die leicht in der Lage waren, den Unterschied in der Qualität zu erkennen.

Keine Vorbereitungszeit, null Kontext

Das Eingehen in die richtige Denkweise für eine solche abstrakte Aufgabe wie die Bewertung der Echtheit kommt nicht natürlich; Englischlehrer benötigten 20 Aufgaben, um ihre Sensibilität an die Bewertungsumgebung zu kalibrieren, während AMT-Arbeiter typischerweise überhaupt keine “Orientierungszeit” haben, was die Qualität ihrer Eingaben verringert.

Das System manipulieren

Der Bericht behauptet, dass die Gesamtarbeitszeit, die AMT-Arbeiter für einzelne Aufgaben aufwenden, durch Arbeiter, die mehrere Aufgaben gleichzeitig annehmen und durch die Aufgaben in verschiedenen Browser-Registerkarten blättern, anstatt sich auf eine Aufgabe für die aufgezeichnete Aufgabenzeit zu konzentrieren, aufgebläht wird.

Heritage-Land ist wichtig

Die Standard-Einstellungen von AMT filtern Arbeiter nicht nach Herkunftsland, und der Bericht verweist auf vorherige Arbeit, die darauf hinweist, dass AMT-Arbeiter VPNs verwenden, um geografische Einschränkungen zu umgehen, und es nicht-englischsprachigen Sprechern ermöglichen, sich als englischsprachige Sprecher auszugeben (in einem System, das vielleicht ein bisschen naiv eine Arbeiters Muttersprache mit ihrer IP-basierten geografischen Lage gleichsetzt).

Somit führten die Forscher die Bewertungstests auf AMT mit Filtern durch, die potenzielle Teilnehmer auf nicht-englischsprachige Länder beschränkten, und fanden, dass ‘Arbeiter aus nicht-englischsprachigen Ländern Kohärenz, Relevanz und Grammatik… signifikant niedriger bewerteten als identisch qualifizierte Arbeiter aus englischsprachigen Ländern’.

Der Bericht kommt zu dem Schluss:

‘[Experten-]Bewerter wie Linguisten oder Sprachlehrer sollten immer dann verwendet werden, wenn möglich, da sie bereits darauf trainiert sind, geschriebenen Text zu bewerten, und es nicht viel teurer ist…’

Veröffentlicht am 16. September 2021 – Aktualisiert am 18. Dezember 2021: Tags hinzugefügt