Andersons Blickwinkel

Reduzierung von KI-Bildhalluzinationen durch Übertreibung

ChatGPT-ähnliche Bildmodelle „halluzinieren“ oft Elemente, die nicht in ein Bild gehören. Eine neue Methode reduziert diese Fehler, indem sie dem Modell basierend auf Bildunterschriften übertriebene Versionen seiner eigenen Halluzinationen zeigt und es anschließend auffordert, es erneut zu versuchen. Dieser Ansatz erfordert weder ein erneutes Training noch zusätzliche Daten und kann auf eine Vielzahl von Modellen und Modelltypen angewendet werden.

Eine neue Veröffentlichung aus China bietet eine interessante Sicht auf das lästige, hartnäckige Problem der Halluzinationen in KI-generierten Bildern und Videos – Elemente, die auf Wunsch und Eingabe des Benutzers eindeutig nicht im Bild enthalten sein sollten.

Im Wesentlichen nimmt das System ein Bild und lässt es wie üblich vom Modell beschreiben. Anschließend wandelt es diese Bildunterschrift in eine neues Bild Mithilfe eines Text-zu-Bild-Modells – und alle zusätzlichen Objekte oder Details in diesem zweiten Bild sind direkte Darstellungen der anfänglichen Halluzinationen des Modells. Durch den Vergleich des Originals mit den generierten Bildern lenkt das System das Modell dann beim nächsten Versuch sanft von diesen Fehlern weg:

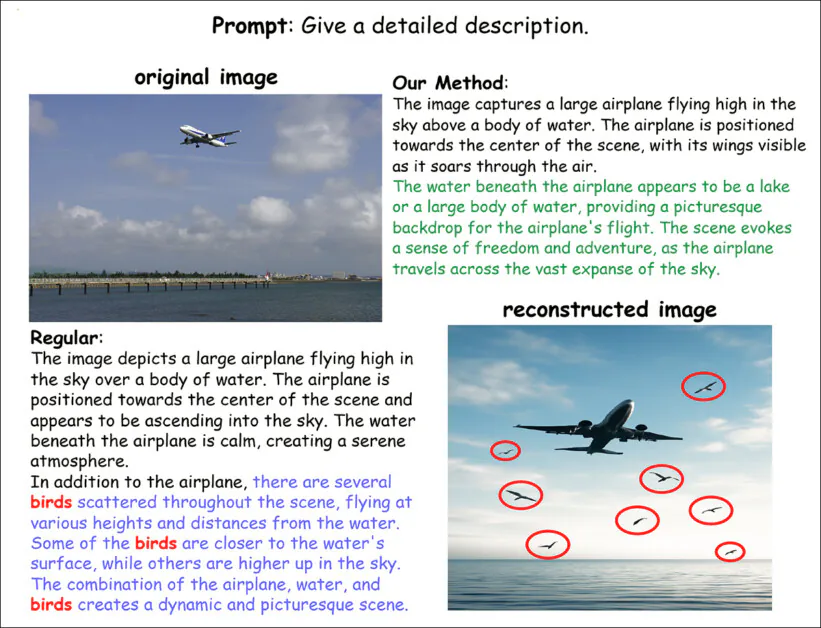

Eine Illustration, wie die neue Methode Trugbilder in Bildunterschriften erkennt und reduziert. Das herkömmliche Modell beschreibt Vögel, die im Originalbild nicht vorhanden sind, und fügt sie anschließend in ein rekonstruiertes Bild ein. Diese Fehler sind rot markiert. Die vorgeschlagene Methode hingegen vermeidet diese erfundenen Details und hält die Bildunterschrift spezifisch und flüssig. Quelle: https://arxiv.org/pdf/2509.21997

Die Methode beginnt damit, dem Modell reale Bilder zu zeigen und es diese beschreiben zu lassen, einschließlich einiger Beschreibungen mit Objekten oder Details, die eigentlich nicht vorhanden. Diese halluzinierten Bildunterschriften werden dann verwendet, um synthetische Bilder zu generieren, die die Fehler leichter erkennen lassen. Durch den Vergleich der realen und generierten Bilder lernt das System, welche internen Muster im Modell dazu neigen, erfundene Inhalte zu produzieren.

Sobald diese Fehlermuster identifiziert sind, können sie gespeichert und später verwendet werden. Wenn dem Modell ein neues Bild gegeben wird, passt das System seine internen Signale während der Beschriftung an. Es von den bekannten Mustern wegzulenken, die Halluzinationen verursachenDies funktioniert in einem einzigen Durchgang und erfordert keine zusätzlichen Daten, kein erneutes Training oder die Generierung neuer Bilder zum Testzeitpunkt.

Das verworrene Netz

Im oben gezeigten Beispiel können wir aus dem Papier ersehen, dass Verschränkung ist wahrscheinlich dafür verantwortlich, dass das Eingabebild mit „Vögeln“ verschönert wird, obwohl das erste Bild scheinbar keine Vögel enthält.

Verschränkung tritt auf, wenn ein Modell darauf besteht, bestimmte Konzepte mit bestimmten anderen Konzepten zu verknüpfen, einfach weil die beiden (oder mehr) Konzepte in der ursprünglichen Datenverteilung, mit der das Modell trainiert wurde, häufig zusammen vorkommen. In diesem Fall hat das Modell möglicherweise viele Bilder von Flugzeuge+Vögel, wodurch eine Assoziation entsteht, die zwar nicht auf das konkrete Bild zutrifft, aber dennoch in die abgeleitete Bildunterschrift eingreift.

Zwar lässt sich die Verschränkung durch einen früheren Abbruch des Trainings verringern (was das Modell im Allgemeinen maximal flexibel und anpassungsfähig macht), doch verringert sich dadurch auch die Detailliertheit und Auflösung aller trainierten Konzepte, sodass der Modelltrainer vor dem ewigen Dilemma steht: Soll er ein Modell erstellen, das sehr flexibel und entwirrt ist, oder soll er ein Modell erstellen, das zwar leistungsstärker ist, aber auch eher „assoziierte“ Halluzinationen hervorruft?

Wenn die Qualität der Untertitelung und die Liebe zum Detail bei der Kuratierung der Originaldaten für ein generatives Modell besser gewesen wären als die Logistik es normalerweise zulässt, Bildunterschriften für alle Quellbilder hätten detaillierte jedes Objekt in jedem Bild, sodass das trainierte Modell ihnen diskrete und entwirrte Einträge in seinem latenter Raum.

So wie es aussieht, ist die eigennützige Praxis der SEO-Untertitelung, verbunden mit der Tatsache, dass ad hoc Hyperscale-Web-Scraping bleibt bestehen die beste Quelle für das Training wirklich leistungsstarker generativer Modelle, bedeutet, dass Bildunterschriften diesen Standard tendenziell deutlich verfehlen:

Ein Beispiel dafür, wie schwache Bildunterschriften die Nützlichkeit von LAION-Bildern für Trainingsmodelle wie Stable Diffusion einschränken. Viele der Textbeschriftungen sind oberflächlich, vage oder eher für SEO als für eine genaue Beschreibung optimiert. Dadurch wird es für das Modell schwieriger, detaillierte visuelle Konzepte wie Gesichtszüge zu erlernen. (Ursprüngliche Quelle war https://rom1504.github.io/, inzwischen nicht mehr verfügbar).

Da eine grundlegende Lösung wahrscheinlich nie praktikabel sein wird, ist die Reduzierung von LLM/VLM-Halluzinationen durch Workarounds und Kompromisse mittlerweile zu einem wichtigen Unterthema in der Literatur geworden.

Die neue chinesische Technik, die diese Woche vorgestellt wurde, wurde den Autoren zufolge in einer Vielzahl von Architekturen unter unterschiedlichen Bedingungen getestet und könnte einen nützlichen Weg zur Reduzierung der „Halluzinationsverschmutzung“ aufzeigen.

Man sagt:

„Umfangreiche Experimente mit mehreren Benchmarks zeigen, dass unsere Methode Halluzinationen auf Objekt-, Attribut- und Beziehungsebene deutlich reduziert und gleichzeitig Erinnerung und Beschriftung [Reichtum] weitgehend bewahrt.“

Die neues Papier ist betitelt Halluzinationen aufdecken, um sie zu unterdrücken: VLMs-Darstellungsbearbeitung mit generativen Ankernund stammt von drei Forschern der University of Science and Technology of China und der Universität Nanjing.

Methodik

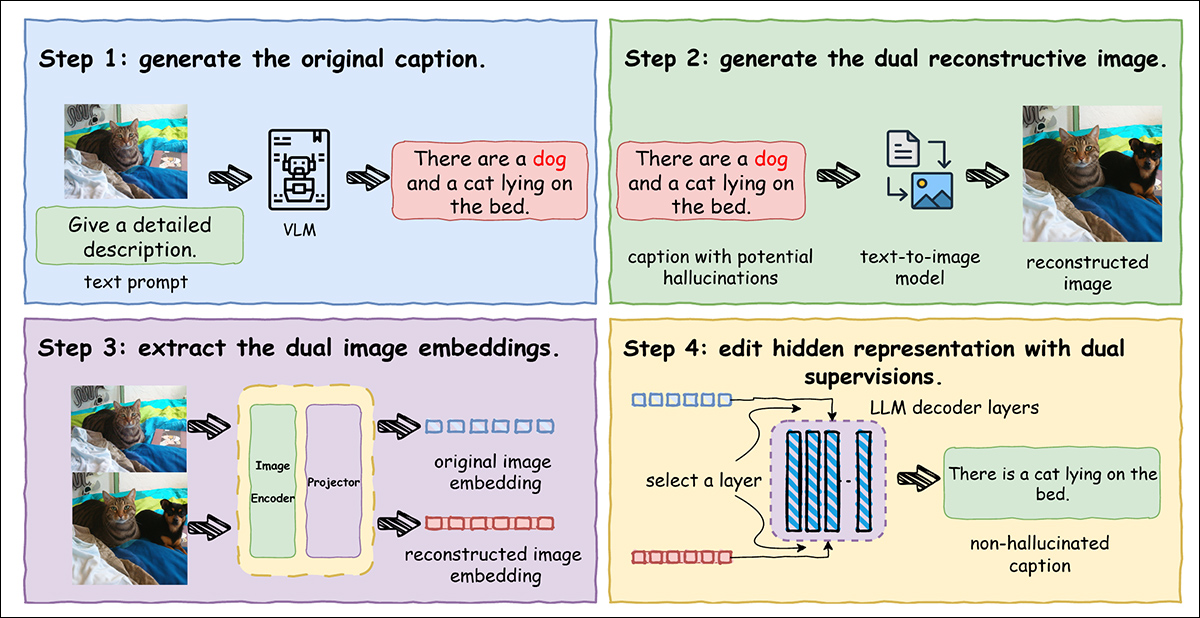

Die Autoren haben eine End-to-End-Pipeline entwickelt (siehe unten), die Halluzinationen in Bildunterschriften aufdecken und unterdrücken soll:

Eine Illustration der gesamten Pipeline. Ein Vision-Language-Modell generiert zunächst eine Bildunterschrift aus dem Eingabebild, das halluzinierte Inhalte enthalten kann. Diese Bildunterschrift wird dann verwendet, um mithilfe eines Text-zu-Bild-Modells ein rekonstruiertes Bild zu erstellen, wodurch Halluzinationen leichter zu erkennen sind. Einbettungen sowohl aus dem Originalbild als auch aus dem rekonstruierten Bild werden extrahiert und zur Steuerung von Anpassungen im Decoder verwendet. Dies hilft dem Modell, halluzinierte Details zu unterdrücken und gleichzeitig die Qualität der Bildunterschrift zu erhalten.

Ausgehend von einem realen Eingabebild generiert ein Vision-Language-Modell eine beschreibende Bildunterschrift, die erfundene Objekte oder Beziehungen enthalten kann. Diese Bildunterschrift wird dann in einen Text-zu-Bild-Generator eingespeist, um ein rekonstruiertes Bild zu erstellen, das genau das zeigt, was die Bildunterschrift beschreibt. Der Vergleich dieses rekonstruierten Bildes mit dem Original macht den erfundenen Inhalt deutlich und messbar. Subtile Textfehler werden zu sichtbaren Unterschieden, die das System gezielt reduzieren kann.

Um das Modell davon abzuhalten, Details zu „erfinden“, vergleicht das System zwei Versionen desselben Bildes: das Original und eine anhand der Bildunterschrift rekonstruierte Version. Jedes Bild wird in eine kompakte Einbettung das seinen Inhalt erfasst.

Das Originalbild dient als zuverlässige Referenz, während das rekonstruierte Bild mögliche Halluzinationen aufzeigt. Indem das Modell seine internen Darstellungen an das Original anpasst und sich von der Rekonstruktion entfernt, lernt es, sich automatisch zu korrigieren. Da dieser Prozess nicht auf manuell angepasste Regeln oder externe Daten angewiesen ist, bleibt er vollständig selbst überwacht.

Das Papier sagt:

„Halluzinationen in MLLMs sind grundsätzlich schwer zu erkennen, da sie sprachlich wohlgeformt und oft nicht von getreuen Beschreibungen auf Textebene zu unterscheiden sind. Die Diskrepanz liegt nicht in der sprachlichen Plausibilität, sondern in der Nichtübereinstimmung mit visuellen Beweisen, für die das Modell selbst typischerweise unempfindlich ist.“

„Um dieses Problem zu lösen, führen wir einen Mechanismus zur Halluzinationsexposition ein, der die generative Rekonstruktion nutzt, um implizite Inkonsistenzen in explizite und beobachtbare Signale umzuwandeln.“

Bei einem Eingabebild und seiner Beschriftung verwendet das System die FLUX.1-Entwickler Text-zu-Bild-Modell, um ein Bild allein anhand der Bildunterschrift nachzubilden. Dieses nachgebildete Bild übertreibt tendenziell die Bedeutung der Bildunterschrift, wodurch falsche Details deutlicher werden. Diese verstärkten Fehler dienen dann als nützliche Signale, die dem Modell helfen, eigene Fehler zu erkennen und zu korrigieren.

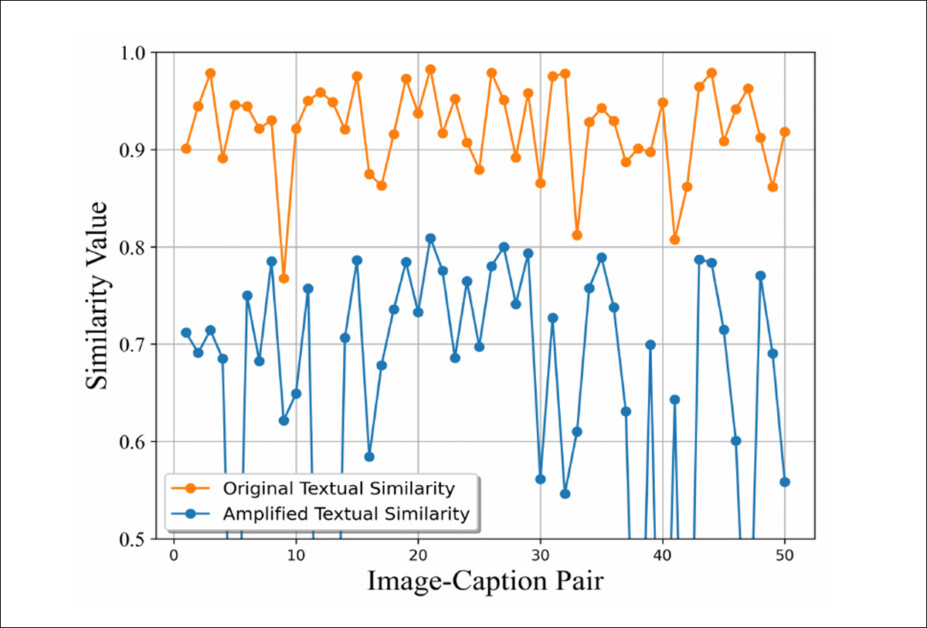

Um ihren Ansatz zu testen, fügten die Autoren Halluzinationen in die Bildunterschriften ein und nutzten das Text-zu-Bild-Modell, um rekonstruierte Bilder zu generieren. Diese Bilder wurden dann neu beschriftet von LLaVA, und die semantische Ähnlichkeit zwischen den ursprünglichen und halluzinierten Bildunterschriften wurde ausgewertet:

Eine Illustration, wie der Halluzinationsverstärkungsmechanismus subtile Fehler sichtbar macht. Jeder Punkt zeigt die Ähnlichkeit zwischen den Bildunterschriften des Originals und der rekonstruierten Bilder für ein Bild-Unterschriften-Paar. Die orange Linie stellt die direkt gemessene Ähnlichkeit zwischen Original und halluzinierter Bildunterschrift dar, die hoch bleibt und kleine Fehler maskiert; die blaue Linie stellt die Ähnlichkeit nach der Rekonstruktion dar, die stark abfällt. Dies zeigt, dass der Prozess versteckte Halluzinationen in klare semantische Marker verwandelt, die erkannt und korrigiert werden können.

Die Ähnlichkeit nimmt nach der Rekonstruktion stark ab, was zeigt, dass durch den Prozess subtile Fehler leichter erkennbar sind.

Daten und Tests

Zur Validierung der Wirksamkeit der neuen Methode wurden drei geeignete Benchmarks herangezogen: Bewertung von Bildunterschriftenhalluzinationen anhand der Bildrelevanz (STUHL); MLLM-Bewertung Benchmark (MME); und Pooling-basierte Objektprüfungsauswertung (PAPST).

Aus dem CHAIR-Release-Paper: Beispiele für halluzinierte Objekte, die von zwei führenden Untertitelungssystemen, TopDown und NBT, generiert werden, wobei jedes Modell visuelle Elemente erfindet, die im Bild nicht tatsächlich vorhanden sind, wie z. B. Laptops, Waschbecken oder Surfbretter. Quelle: https://arxiv.org/pdf/1809.02156

Standardmetriken wie Halluzinationsrate or erinnern kann irreführend sein, da ein Modell Halluzinationen vermeiden könnte, indem es einfach kurze oder vage Untertitel erstellt. Um den Kompromiss zwischen Erinnerung und Halluzination zu berücksichtigen, wird eine kombinierte Metrik namens Halluzination und Erinnerung Es wurde (HAR@β) verwendet, das Untertitel sowohl nach Genauigkeit als auch nach Vollständigkeit bewertet und es ermöglicht, die Balance anzupassen, je nachdem, ob die Vermeidung von Fehlern oder die Einbeziehung von mehr Details wichtiger ist.

POPE wurde zur Beurteilung kontextsensitiver Objekthalluzinationen und MME zur Bewertung von Halluzinationen auf Attributebene verwendet, wobei beide als Ja-oder-Nein-Beurteilungsaufgaben konzipiert waren.

Es wurden Experimente mit verschiedenen repräsentativen Datensätzen durchgeführt, unter Verwendung des oben genannten Flux-Modells und des LLaVA-v1.5-7B Variante. Die verwendeten Datensätze waren Microsoft COCO; A-OKVQAeschriebenen Art und Weise; und GQA.

Für die zweite Schicht der Modelle wurde eine latente Bearbeitung durchgeführt, gemäß vorherige verwandte Arbeiten, während Hyperparameter und Temperatur in allen Modellen konsistent waren.

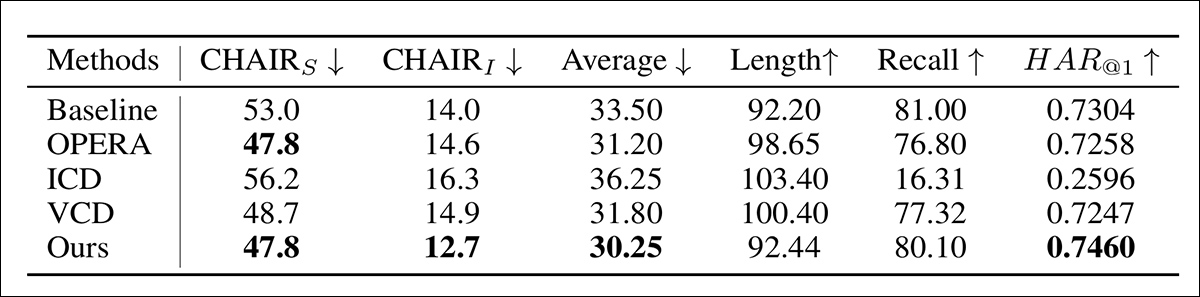

Nachfolgend werden die ersten Ergebnisse zu CHAIR präsentiert*:

Leistung im CHAIR-Benchmark zur Halluzinationsminderung, bewertet anhand mehrerer Metriken.

Zu diesen Ergebnissen kommentieren die Autoren:

„[Unsere Methode übertrifft andere Baselines sowohl bei CHAIR als auch beiS und VORSITZI[*] und zeigt damit seine überlegene Wirksamkeit bei der Unterdrückung von Halluzinationen. Obwohl fast alle Methoden zwangsläufig die Erinnerung reduzieren, während sie Halluzinationen unterdrücken, was einen Kompromiss zwischen Genauigkeit und Aussagekraft widerspiegelt, erzielt unser Ansatz den geringsten Rückgang.

„Dies zeigt, dass unsere Methode ein breites Spektrum an Ground-Truth-Objekten erfasst. Mit der HAR@β-Metrik erreicht unsere Methode die höchste Punktzahl, was ihre Fähigkeit unterstreicht, Halluzinationen zu reduzieren und gleichzeitig die Abdeckung aufrechtzuerhalten.“

Die Forscher führen diese überzeugenden Ergebnisse auf die duale Überwachung zurück. Dabei wurde die klare Semantik des Originalbildes verstärkt, während gleichzeitig irreführende Signale des rekonstruierten Bildes unterdrückt wurden. Da die Anpassung nur auf die mit Halluzinationen verbundene Richtung abzielte, blieb der Rest der Darstellung erhalten. So konnte das System Fehler korrigieren, ohne an Detailreichtum oder Aussagekraft einzubüßen.

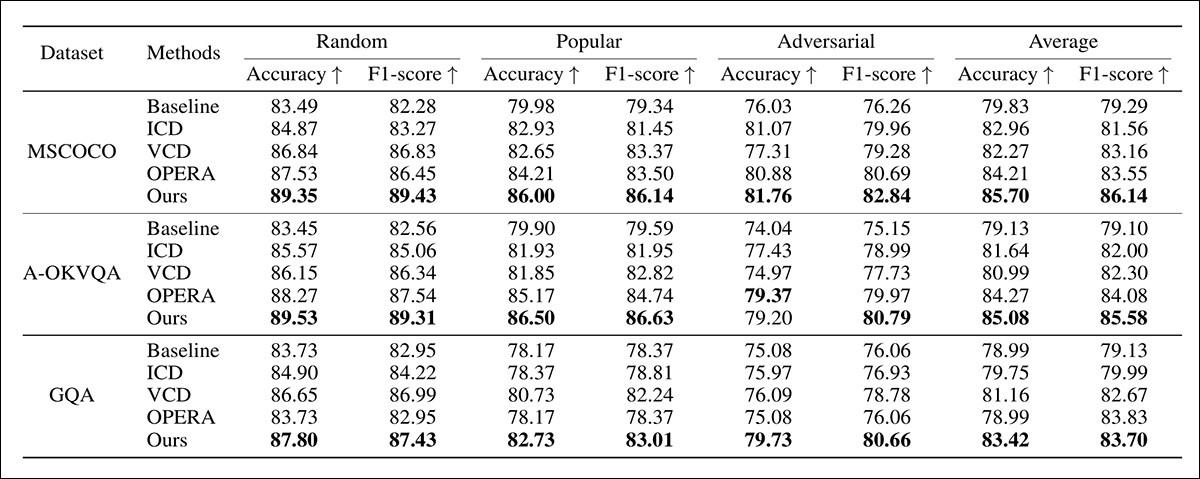

Vergleich der Leistung im POPE-Benchmark unter verschiedenen Konfigurationen und Datensätzen.

Zu den Ergebnissen zu POPE, die in der obigen Ergebnistabelle dargestellt sind, heißt es in der Studie:

„Es lässt sich beobachten, dass unsere Methode in allen Einstellungen durchgängig die beste Leistung erzielt. Insbesondere kann unsere Methode im Durchschnitt eine Genauigkeit von bis zu +5.95 % und einen F1-Score von +6.85 % erreichen und übertrifft damit andere trainingsfreie Ansätze bei weitem.“

„Daher zeigen diese Ergebnisse, dass unsere Methode eine zuverlässige und verallgemeinerbare Lösung für verschiedene Schwierigkeitsgrade bietet.“

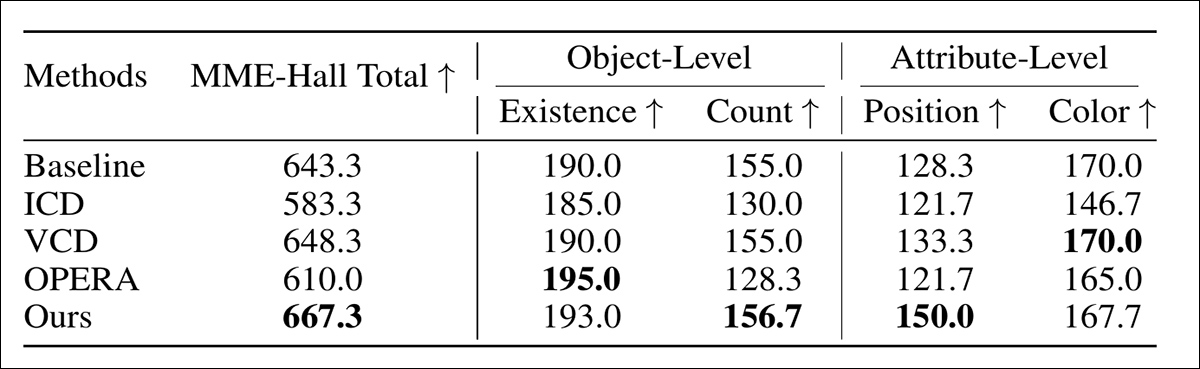

Ab der dritten Testrunde Leistungsvergleiche über MME.

Der abschließende Haupttest bezog sich auf MME und lieferte die oben gezeigten Ergebnisse. Unter anderem wurde jedoch die Methode „OPERA“ erwähnt, die weder im Hauptartikel noch im Anhang definiert ist. Obwohl die Autoren eine starke Leistung bei MME behaupten, sollten wir den Abschnitt mit den Ergebnissen an dieser Stelle vielleicht beenden, da die Methoden nicht ausreichend definiert sind.

Eine Abbildung aus dem MME-Benchmark unter Verwendung von LLaVA-v1.5-7B, die zeigt, wie das Basismodell eine halluzinierte Antwort erzeugt, während die vorgeschlagene Methode die richtige Antwort lieferte, wobei das rekonstruierte Bild die Halluzination deutlicher macht.

Fazit

Obwohl dieses Papier eindeutig übereilt verfasst wurde und unter dem Mangel an Struktur, Fokus und Klarheit leidet, der in der Literatur der letzten 12 Monate immer deutlicher zutage getreten ist (was möglicherweise nicht ohne Zusammenhang mit der rasch zunehmenden Nutzung von KI in der akademischen Forschung steht), bleibt der vorgestellte zentrale Mechanismus genial.

Obwohl dieser End-to-End-Ansatz keine erneute Schulung erfordert und auf eine Reihe von Architekturen anwendbar zu sein scheint, wäre es aufschlussreich gewesen, mehr Testkandidaten zu sehen. Zudem muss berücksichtigt werden, dass ein Interstitialsystem dieser Art zumindest zu Latenzzeiten und einem gewissen Grad zu einem zusätzlichen Strombedarf führt – kein unerhebliches Problem in diesem großen Maßstab.

* Unkonventionell präsentiert der Hauptteil dieser Arbeit Ergebnisse mit Überschriften, die nur im Anhang und nicht im Hauptteil erläutert werden – eine in der Literatur zunehmend beobachtete Unsitte, da Forscher versuchen, die zentrale These auf 8-9 Seiten zu beschränken, selbst wenn das Material dies nicht zulässt. Der CHAIR-Benchmark, der zur Bewertung von Objekthalluzinationen in Bildunterschriften verwendet wird, basierte auf einer 500 Bilder umfassenden MSCOCO-Teilmenge aus früheren Arbeiten. Zwei Formen wurden verwendet: CHAIRs, wobei gemessen wurde, wie oft Halluzinationen in einer bestimmten Bildunterschrift auftraten; und CHAIRI, wobei gemessen wurde, wie viele der genannten Objekte halluziniert wurden. HAR@β , das im Hauptpapier eingeführt wurde, wurde als F definiertβ-artige Kombination aus Halluzinationsunterdrückung und Objekterinnerung.

Erstveröffentlichung Dienstag, 30. September 2025