Andersons Blickwinkel

‘Geschützte’ Bilder sind einfacher, nicht schwieriger, zu stehlen mit KI

Neue Forschung legt nahe, dass Wasserzeichentools, die darauf abzielen, AI-Bildbearbeitungen zu blockieren, konträr wirken könnten. Anstatt Modelle wie Stable Diffusion daran zu hindern, Änderungen vorzunehmen, helfen einige Schutzmaßnahmen dem AI tatsächlich dabei, Bearbeitungsprompts genauer zu befolgen, was unerwünschte Manipulationen sogar einfacher macht.

Es gibt einen bemerkenswerten und robusten Strang in der Computer-Vision-Literatur, der sich mit dem Schutz urheberrechtlich geschützter Bilder vor der Verwendung in AI-Modellen oder in direkten Bild-zu-Bild-AI-Prozessen beschäftigt. Systeme dieser Art zielen im Allgemeinen auf Latent-Diffusions-Modelle (LDMs) wie Stable Diffusion und Flux ab, die noise-basierte Verfahren verwenden, um Bilder zu kodieren und zu dekodieren.

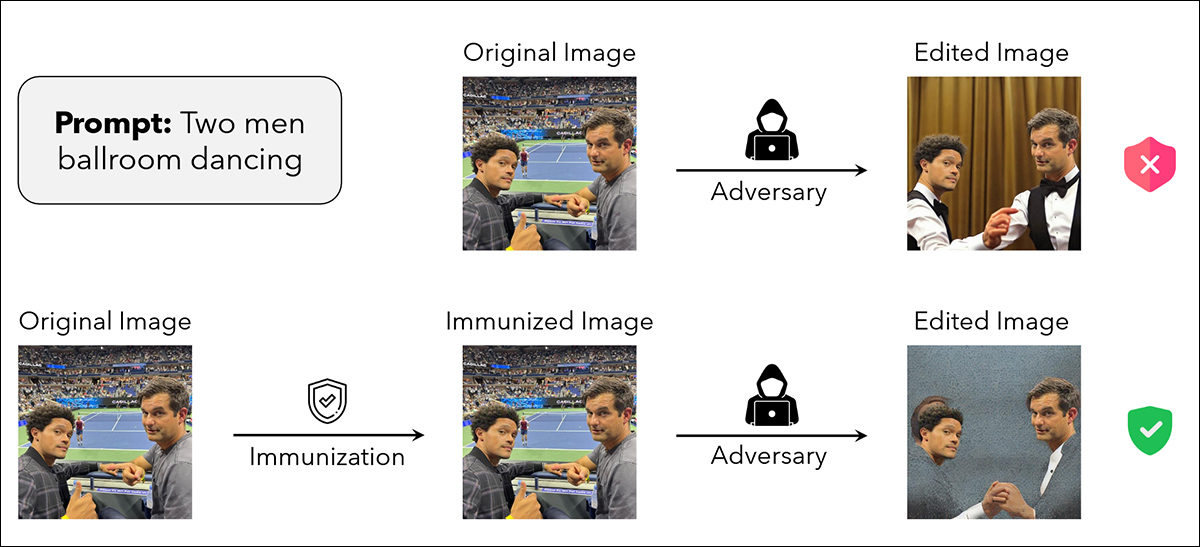

Durch das Einfügen von adversarialen Störungen in ansonsten normal aussehende Bilder kann es möglich sein, Bilderkennungssysteme dazu zu bringen, Bildinhalte falsch zu erkennen, und Bildgenerierungs-Systeme daran zu hindern, urheberrechtlich geschützte Daten auszunutzen:

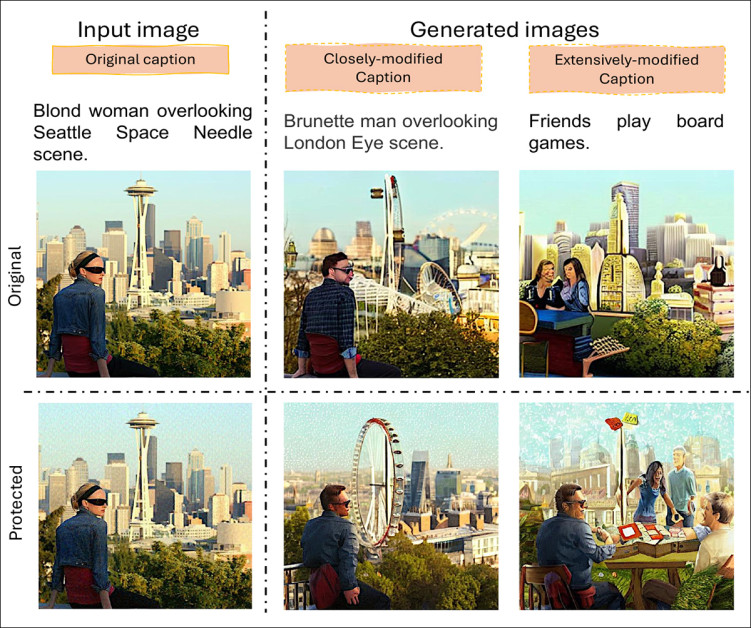

Aus dem MIT-Papier ‘Raising the Cost of Malicious AI-Powered Image Editing’, Beispiele für ein Quellbild, das gegen Manipulation ‘immunisiert’ wurde (untere Reihe). Quelle: https://arxiv.org/pdf/2302.06588

Seit dem Rückhalt der Künstler gegen die liberale Verwendung von Web-Scraping-Bildern (einschließlich urheberrechtlich geschützter Bilder) durch Stable Diffusion im Jahr 2023 hat die Forschungsszene multiple Variationen desselben Themas hervorgebracht – die Idee, dass Bilder unsichtbar ‘vergiftet’ werden können, um sie vor der Verwendung in AI-Systemen oder der Aufnahme in generative AI-Pipelines zu schützen, ohne die Qualität des Bildes für den durchschnittlichen Betrachter zu beeinträchtigen.

In allen Fällen besteht eine direkte Korrelation zwischen der Intensität der aufgeprägten Störung, dem Umfang, in dem das Bild anschließend geschützt wird, und dem Umfang, in dem das Bild nicht ganz so gut aussieht, wie es sollte:

Obwohl die Qualität des Forschungs-PDFs das Problem nicht vollständig veranschaulicht, opfern größere Mengen an adversarialen Störungen Qualität für Sicherheit. Hier sehen wir die Palette der Qualitätsstörungen im ‘Fawkes’-Projekt von 2020, das von der University of Chicago geleitet wurde. Quelle: https://arxiv.org/pdf/2002.08327

Insbesondere für Künstler, die ihre Stile vor nicht autorisierter Aneignung schützen möchten, ist die Fähigkeit solcher Systeme von Interesse, nicht nur Identitäten zu verschleiern und andere Informationen, sondern auch, eine AI-Trainingsprozess davon zu überzeugen, dass er etwas anderes sieht, als er tatsächlich sieht, sodass Verbindungen zwischen semantischen und visuellen Bereichen für ‘geschützte’ Trainingsdaten nicht entstehen (d. h. ein Prompt wie ‘Im Stil von Paul Klee’).

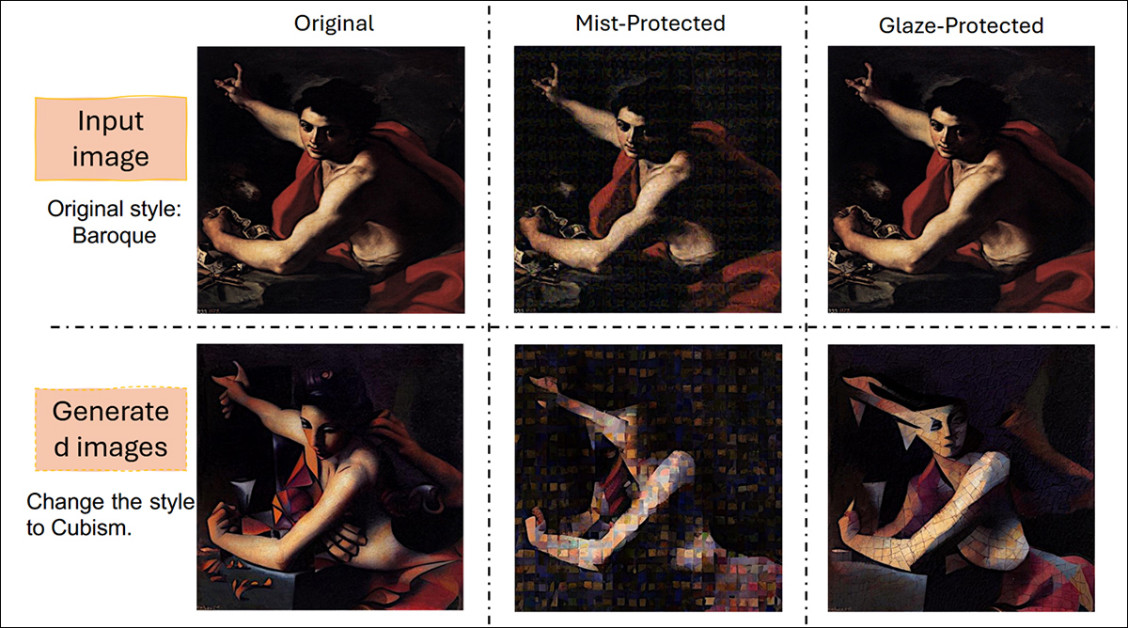

Mist und Glaze sind zwei beliebte Injektionsmethoden, die verhindern oder zumindest stark behindern können, dass urheberrechtlich geschützte Stile in AI-Workflows und Trainingsroutinen verwendet werden. Quelle: https://arxiv.org/pdf/2506.04394

Eigentor

Jetzt hat eine neue Forschung aus den USA herausgefunden, dass nicht nur Störungen versagen können, ein Bild zu schützen, sondern dass das Hinzufügen von Störungen tatsächlich die Ausnutzbarkeit des Bildes in allen AI-Prozessen verbessern kann, gegen die die Störung immun machen soll.

Das Papier besagt:

‘In unseren Experimenten mit verschiedenen perturbationsbasierten Bildschutzmethoden über mehrere Domänen (natürliche Szenenbilder und Kunstwerke) und Bearbeitungsaufgaben (Bild-zu-Bild-Generierung und Stilbearbeitung) haben wir entdeckt, dass ein solcher Schutz dieses Ziel nicht vollständig erreicht.

‘In den meisten Szenarien generiert die diffusionsbasierte Bearbeitung von geschützten Bildern ein wünschenswertes Ausgabebild, das den Bearbeitungsprompt genau befolgt.

‘Unsere Ergebnisse deuten darauf hin, dass das Hinzufügen von Rauschen zu Bildern paradoxerweise ihre Assoziation mit gegebenen Textprompts während des Generierungsprozesses erhöhen kann, was zu ungewollten Konsequenzen wie besseren resultierenden Bearbeitungen führt.

‘Daher argumentieren wir, dass perturbationsbasierte Methoden möglicherweise keine ausreichende Lösung für einen robusten Bildschutz gegen diffusionsbasierte Bearbeitung bieten.’

In Tests wurden die geschützten Bilder zwei bekannten AI-Bearbeitungsszenarien ausgesetzt: direkte Bild-zu-Bild-Generierung und Stiltransfer. Diese Prozesse spiegeln die gängigen Wege wider, auf denen AI-Modelle geschütztes Material ausnutzen könnten, entweder durch direkte Änderung eines Bildes oder durch die Übernahme seiner stilistischen Merkmale für die Verwendung anderswo.

Die geschützten Bilder, die aus Standardquellen für Fotografie und Kunst stammten, wurden durch diese Pipelines geleitet, um zu sehen, ob die hinzugefügten Störungen die Bearbeitungen blockieren oder verschlechtern könnten.

Stattdessen schien die Anwesenheit von Schutzmaßnahmen oft die Ausrichtung des Modells auf die Prompts zu schärfen, was zu sauberen, genauen Ausgaben führte, wo einige Fehler erwartet worden waren.

Die Autoren raten sinngemäß, dass diese sehr beliebte Schutzmethode möglicherweise ein falsches Sicherheitsgefühl vermittelt und dass alle derartigen perturbationsbasierten Immunisierungsansätze gründlich gegen die Methoden der Autoren getestet werden sollten.

Methode

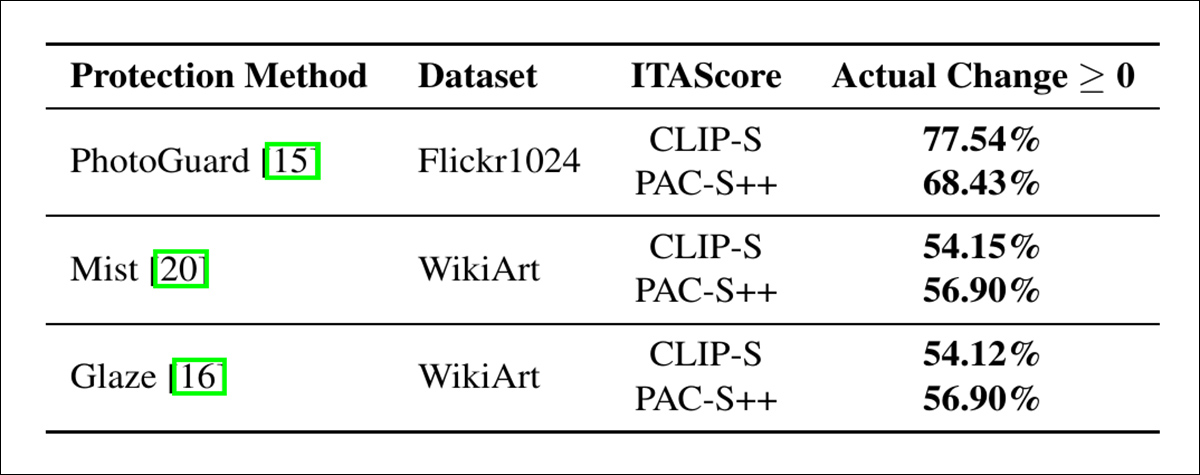

Die Autoren führten Experimente mit drei Schutzmethoden durch, die sorgfältig konstruierte adversarialen Störungen anwenden: PhotoGuard; Mist; und Glaze.

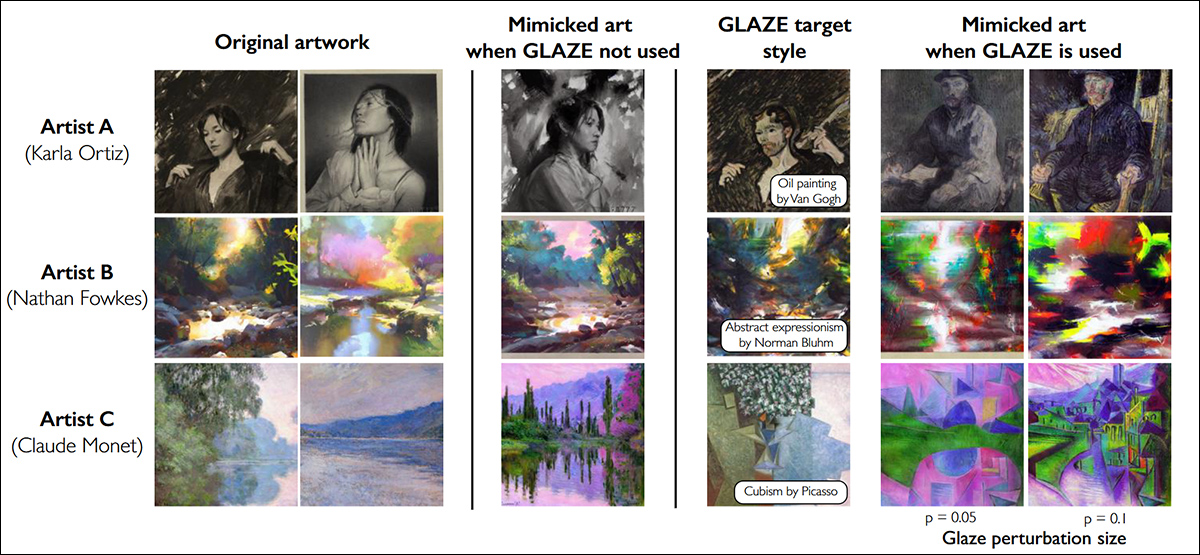

Glaze, eines der von den Autoren getesteten Frameworks, zeigt Glaze-Schutzbeispiele für drei Künstler. Die ersten beiden Spalten zeigen die Originalkunstwerke; die dritte Spalte zeigt Nachahmungsergebnisse ohne Schutz; die vierte Spalte zeigt stiltransferierte Versionen, die für die Optimierung der Verkleidung verwendet wurden, zusammen mit dem Zielstilnamen. Die fünfte und sechste Spalte zeigen Nachahmungsergebnisse mit angewandter Verkleidung bei Störungsstärken p = 0,05 und p = 0,1. Alle Ergebnisse verwenden Stable-Diffusion-Modelle. https://arxiv.org/pdf/2302.04222

PhotoGuard wurde auf natürliche Szenenbilder angewendet, während Mist und Glaze auf Kunstwerke (d. h. ‘künstlerisch gestaltete’ Domänen) verwendet wurden.

Tests umfassten sowohl natürliche als auch künstlerische Bilder, um mögliche realweltliche Anwendungen widerzuspiegeln. Die Wirksamkeit jeder Methode wurde bewertet, indem überprüft wurde, ob ein AI-Modell immer noch realistische und promptrelevante Bearbeitungen erzeugen konnte, wenn es mit geschützten Bildern arbeitete; wenn die resultierenden Bilder überzeugend und den Prompts entsprachen, wurde der Schutz als gescheitert angesehen.

Stable Diffusion v1.5 wurde als vorge trainierter Bildgenerator für die Bearbeitungsaufgaben der Forscher verwendet. Fünf Samen wurden ausgewählt, um Reproduzierbarkeit zu gewährleisten: 9222, 999, 123, 66 und 42. Alle anderen Generierungsparameter, wie Leitungsmaßstab, Stärke und Gesamtschritte, folgten den Standardwerten, die in den PhotoGuard-Experimenten verwendet wurden.

PhotoGuard wurde auf natürliche Szenenbilder mit dem Flickr8k-Dataset getestet, das über 8.000 Bilder mit bis zu fünf Untertitelungen enthält.

Entgegengesetzte Gedanken

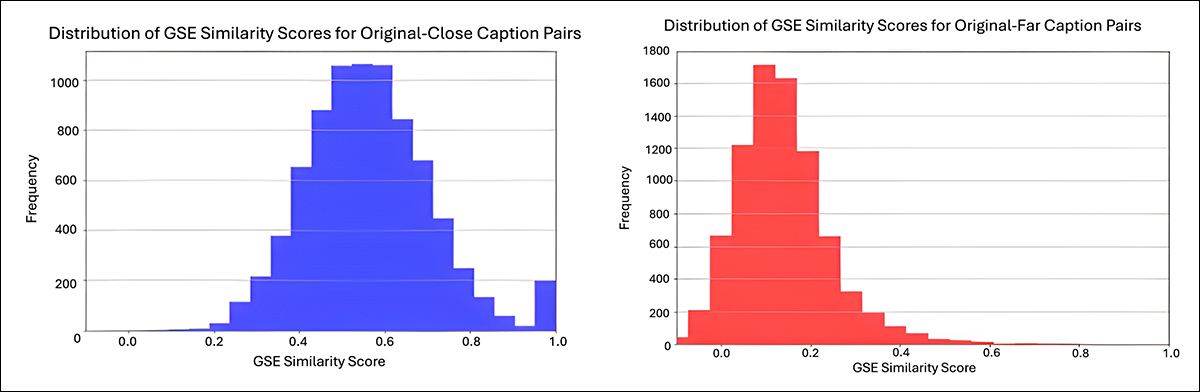

Zwei Sätze modifizierter Untertitelungen wurden aus dem ersten Untertitel jedes Bildes mit Hilfe von Claude Sonnet 3.5 erstellt. Ein Satz enthielt Prompts, die kontextuell nah an den Original-Untertitelungen lagen; der andere Satz enthielt Prompts, die kontextuell entfernt lagen.

Zum Beispiel würde von dem Original-Untertitel ‘Ein junges Mädchen in einem rosa Kleid, das in eine Holzhütte geht’ ein naher Prompt ‘Ein junger Junge in einem blauen Hemd, der in ein Ziegelhaus geht’ sein. Im Gegensatz dazu wäre ein entfernter Prompt ‘Zwei Katzen, die auf einem Sofa faulenzen’.

Nahen Prompts wurden durch Ersetzen von Nomen und Adjektiven mit semantisch ähnlichen Begriffen konstruiert; ferne Prompts wurden durch Anweisung des Modells erstellt, um Untertitelungen zu erstellen, die kontextuell sehr unterschiedlich waren.

Alle generierten Untertitelungen wurden manuell auf Qualität und semantische Relevanz überprüft. Google’s Universal Sentence Encoder wurde verwendet, um semantische Ähnlichkeitswerte zwischen den Original- und modifizierten Untertitelungen zu berechnen:

Aus dem Zusatzmaterial, semantische Ähnlichkeitsverteilungen für die modifizierten Untertitelungen, die in den Flickr8k-Tests verwendet wurden. Das linke Diagramm zeigt die Ähnlichkeitswerte für nah modifizierte Untertitelungen, die im Durchschnitt bei etwa 0,6 liegen. Das rechte Diagramm zeigt die umfassend modifizierten Untertitelungen, die im Durchschnitt bei etwa 0,1 liegen, was eine größere semantische Distanz zu den Original-Untertitelungen widerspiegelt. Werte wurden mit Google’s Universal Sentence Encoder berechnet. Quelle: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Jedes Bild, zusammen mit seiner geschützten Version, wurde mit beiden nahen und fernen Prompts bearbeitet. Der Blind/Referenceless Image Spatial Quality Evaluator (BRISQUE) wurde verwendet, um die Bildqualität zu bewerten:

Bild-zu-Bild-Generierungsresultate auf natürlichen Fotografien, die durch PhotoGuard geschützt sind. Trotz der Anwesenheit von Störungen folgte Stable Diffusion v1.5 erfolgreich sowohl kleine als auch große semantische Änderungen in den Bearbeitungsprompts, was realistische Ausgaben hervorbrachte, die den neuen Anweisungen entsprachen.

Metriken

Um zu beurteilen, wie gut der Schutz die AI-Bearbeitung behinderte, maßen die Forscher, wie genau die endgültigen Bilder den Anweisungen entsprachen, die sie erhalten hatten, indem sie Bewertungssysteme verwendeten, die den Bildinhalt mit dem Textprompt verglichen, um zu sehen, wie gut sie übereinstimmen.

Dazu verwendet die CLIP-S-Metrik ein Modell, das sowohl Bilder als auch Text verstehen kann, um zu überprüfen, wie ähnlich sie sind, während PAC-S++ zusätzliche durch AI erstellte Beispiele hinzufügt, um den Vergleich näher an eine menschliche Schätzung anzupassen.

Diese Bild-Text-Alignment-(ITA)-Werte zeigen, wie genau die AI den Anweisungen folgte, wenn sie ein geschütztes Bild bearbeitete: wenn ein geschütztes Bild immer noch zu einer hoch ausgerichteten Ausgabe führte, bedeutete dies, dass der Schutz versagt hat, die Bearbeitung zu blockieren.

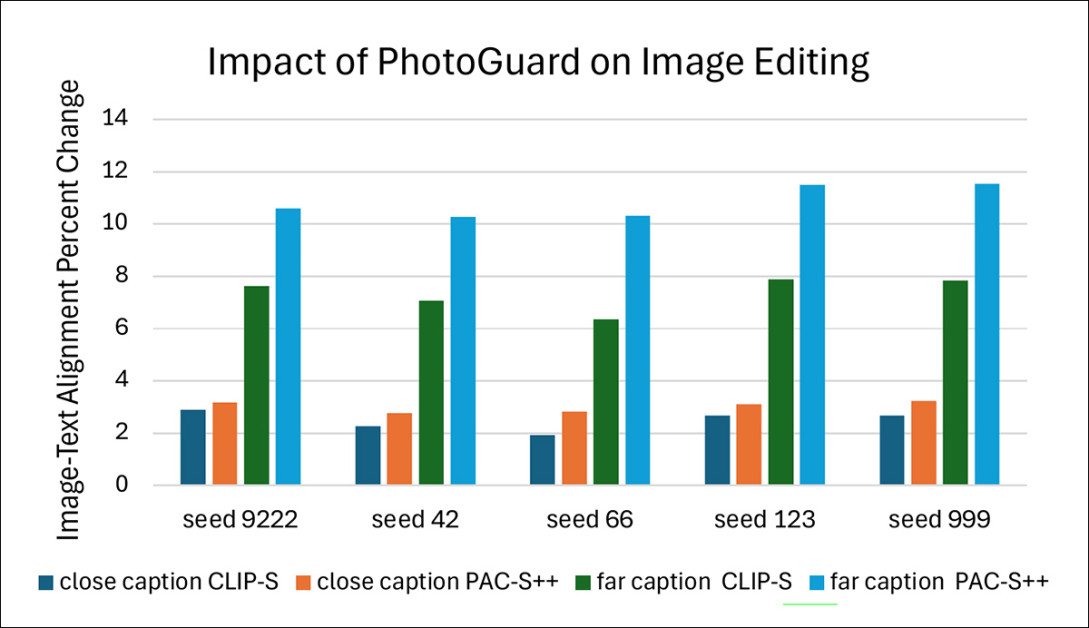

Effekt des Schutzes auf dem Flickr8k-Datensatz über fünf Samen, unter Verwendung von nahen und fernen Prompts. Bild-Text-Alignment wurde mit CLIP-S- und PAC-S++-Werten gemessen.

Die Forscher verglichen, wie gut die AI den Prompts folgte, wenn sie geschützte Bilder bearbeitete, im Vergleich zu ungeschützten Bildern. Sie überprüften zunächst die Differenz zwischen den beiden, die als aktuelle Änderung bezeichnet wird. Dann wurde die Differenz skaliert, um eine Prozentuale Änderung zu erstellen, was es einfacher machte, Ergebnisse über viele Tests hinweg zu vergleichen.

Dies zeigte, ob der Schutz die AI daran hinderte, die Prompts zu befolgen, oder nicht. Die Tests wurden fünfmal mit verschiedenen zufälligen Samen wiederholt, um sowohl kleine als auch große Änderungen an den Original-Untertitelungen abzudecken.

Kunstangriff

Für die Tests auf natürlichen Fotografien wurde das Flickr1024-Datensatz verwendet, das über 1.000 hochwertige Bilder enthält. Jedes Bild wurde mit Prompts bearbeitet, die dem Muster ‘Ändere den Stil in [V]’ folgten, wobei [V] einen von sieben berühmten Kunststilen darstellte: Kubismus; Post-Impressionismus; Impressionismus; Surrealismus; Barock; Fauvismus; und Renaissance.

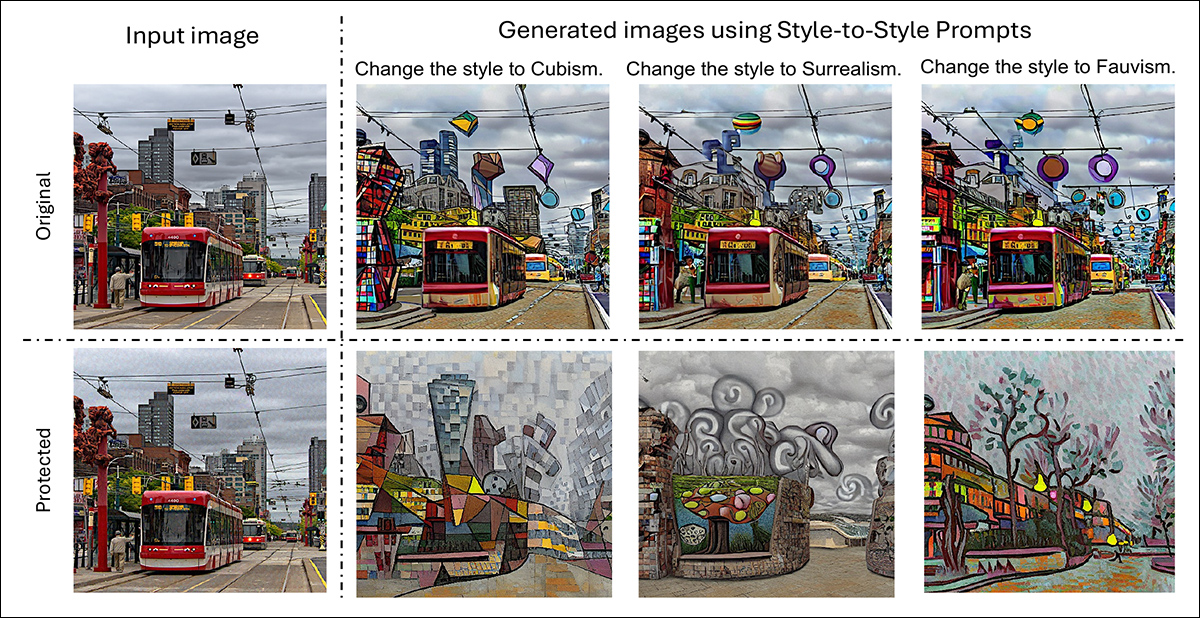

Der Prozess bestand darin, PhotoGuard auf die Originalbilder anzuwenden, geschützte Versionen zu generieren und dann sowohl geschützte als auch ungeschützte Bilder durch dieselben Stiltransfer-Bearbeitungen zu führen:

Original- und geschützte Versionen eines natürlichen Szenenbildes, jedes bearbeitet, um Kubismus, Surrealismus und Fauvismus-Stile anzuwenden.

Um Schutzmethoden auf Kunstwerke zu testen, wurde ein Stiltransfer auf Bildern aus dem WikiArt-Datensatz durchgeführt, der eine breite Palette von künstlerischen Stilen kuratiert. Die Bearbeitungsprompts folgten demselben Format wie zuvor, indem sie die AI anwiesen, den Stil in einen zufällig ausgewählten, nicht verwandten Stil zu ändern, der aus den WikiArt-Labels ausgewählt wurde.

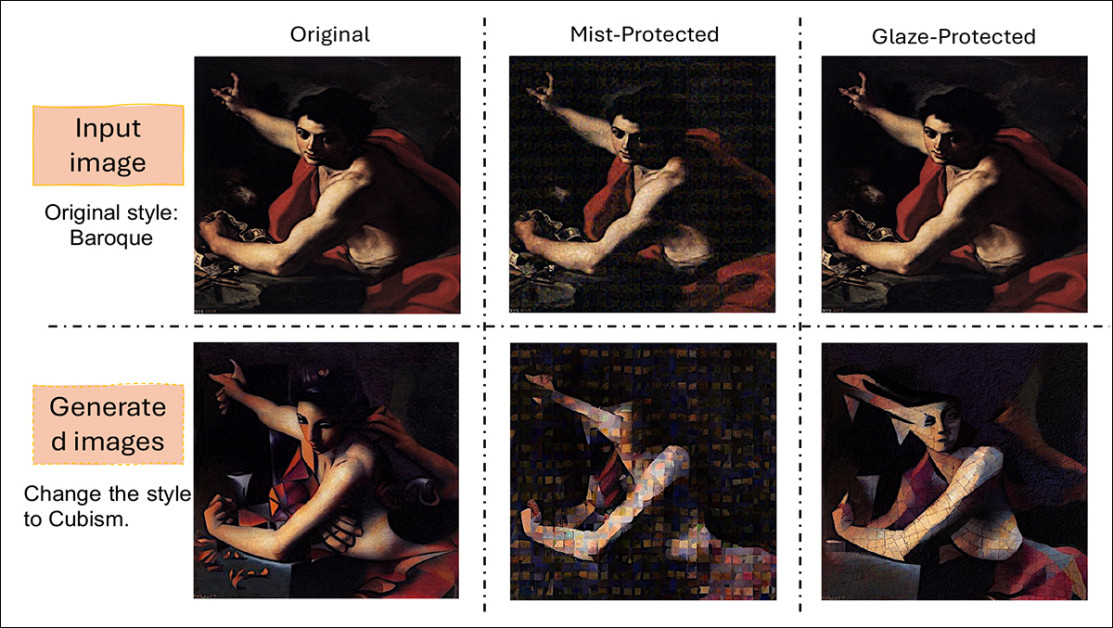

Sowohl Glaze als auch Mist-Schutzmethoden wurden auf die Bilder angewendet, bevor die Bearbeitungen durchgeführt wurden, was es den Forschern ermöglichte, zu beobachten, wie gut jede Verteidigung die Stiltransfer-Ergebnisse blockieren oder verzerren konnte:

Beispiele dafür, wie Schutzmethoden den Stiltransfer auf Kunstwerken beeinflussen. Das Original-Barock-Bild wird neben Versionen gezeigt, die durch Mist und Glaze geschützt sind. Nach Anwendung des Kubismus-Stiltransfers können die Unterschiede darin gesehen werden, wie jeder Schutz die endgültige Ausgabe verändert.

Die Forscher testeten die Vergleiche quantitativ:

Änderungen in den Bild-Text-Alignment-Werten nach Stiltransfer-Bearbeitungen.

Über diese Ergebnisse kommentieren die Autoren:

‘Die Ergebnisse heben eine signifikante Einschränkung von adversarialen Störungen für den Schutz hervor. Anstatt die Ausrichtung zu behindern, verstärken adversarialen Störungen oft die Responsivität des generativen Modells auf Prompts, was ungewollte Konsequenzen wie bessere resultierende Bearbeitungen ermöglicht. Ein solcher Schutz ist nicht störend für den Bildbearbeitungsprozess und kann möglicherweise nicht verhindern, dass böswillige Agenten unerlaubtes Material kopieren.

‘Die ungewollten Konsequenzen der Verwendung adversarialer Störungen offenbaren Schwachstellen in bestehenden Methoden und unterstreichen die dringende Notwendigkeit für effektivere Schutztechniken.’

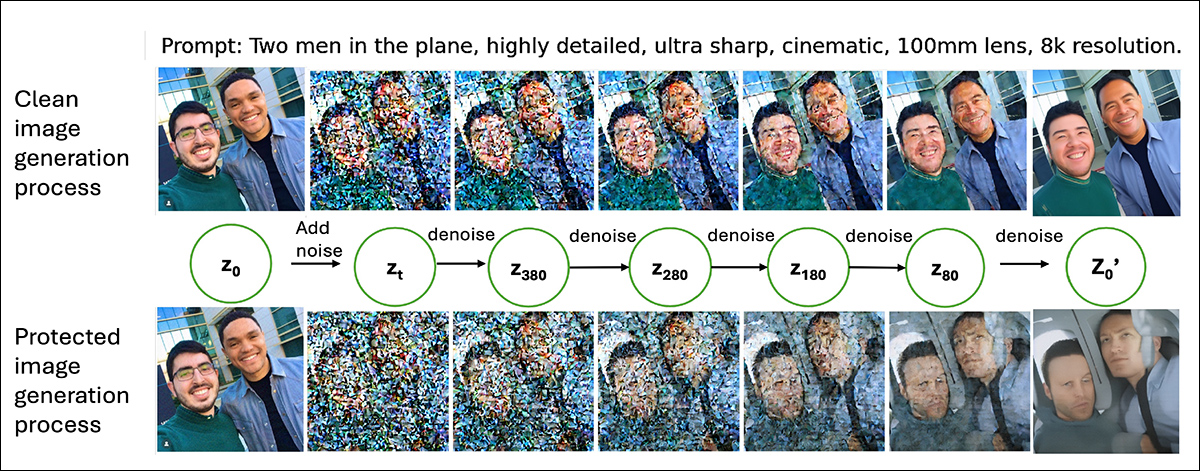

Die Autoren erklären, dass die unerwarteten Ergebnisse auf die Funktionsweise von Diffusionsmodellen zurückzuführen sind: LDMs bearbeiten Bilder, indem sie sie zunächst in eine komprimierte Version namens Latent umwandeln; Rauschen wird dann durch viele Schritte hinzu gefügt, bis die Daten fast zufällig werden.

Das Modell kehrt diesen Prozess während der Generierung um, indem es das Rauschen schrittweise entfernt. In jedem Stadium dieses Umkehrprozesses hilft der Textprompt dabei, wie das Rauschen bereinigt werden soll, und formt das Bild allmählich, um dem Prompt zu entsprechen:

Vergleich zwischen Generierungen aus einem ungeschützten Bild und einem durch PhotoGuard geschützten Bild, wobei Zwischenzustände in Latentzustände zurück konvertiert wurden, um sie zu visualisieren.

Schutzmethoden fügen kleine Mengen an zusätzlichem Rauschen zum Originalbild hinzu, bevor es in diesen Prozess eintritt. Obwohl diese Störungen anfangs gering sind, summieren sie sich, während das Modell seine eigenen Schichten von Rauschen anwendet.

Diese Ansammlung lässt mehr Teile des Bildes ‘unsicher’, wenn das Modell beginnt, Rauschen zu entfernen. Mit größerer Unsicherheit verlässt sich das Modell stärker auf den Textprompt, um die fehlenden Details auszufüllen, was dem Prompt noch mehr Einfluss gibt, als es normalerweise hätte.

In der Praxis machen die Schutzmaßnahmen es einfacher für die AI, das Bild so umzuformen, dass es dem Prompt entspricht, anstatt schwieriger.

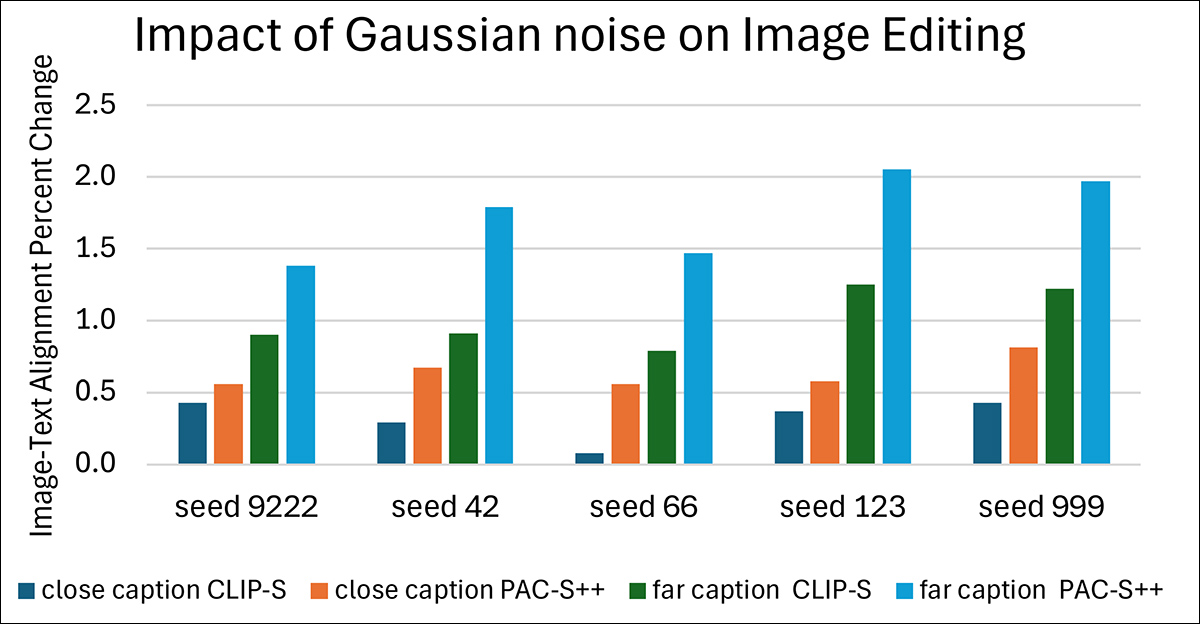

Schließlich führten die Autoren einen Test durch, bei dem sie handgefertigte Störungen aus dem Raising the Cost of Malicious AI-Powered Image Editing paper durch reines Gaußsches Rauschen ersetzten.

Die Ergebnisse folgten demselben Muster wie zuvor: Über alle Tests hinweg blieben die prozentualen Änderungswerte positiv. Sogar dieses zufällige, unstrukturierte Rauschen führte zu einer stärkeren Ausrichtung zwischen den generierten Bildern und den Prompts.

Effekt des simulierten Schutzes unter Verwendung von Gaußschem Rauschen auf dem Flickr8k-Datensatz.

Schlussfolgerung

Die Forschungsszene hat adversarialen Störungen bei der Lösung des LDM-Urheberrechtsproblems seit fast so langer Zeit wie LDMs existieren, vorangetrieben; aber keine widerstandsfähigen Lösungen sind aus der außergewöhnlichen Anzahl der zu diesem Thema veröffentlichten Arbeiten hervorgegangen.

Entweder verringern die aufgeprägten Störungen die Qualität des Bildes übermäßig, oder die Muster erweisen sich als nicht widerstandsfähig gegenüber Manipulationen und transformatorischen Prozessen.

Es ist jedoch ein harter Traum, diesen zu aufzugeben, da die Alternative darin bestehen würde, auf Drittanbieter-Überwachung und Herkunftsframeworks wie das von Adobe initiierte C2PA-Schema zu setzen, das darauf abzielt, eine Kette der Beweisführung für Bilder vom Kamerasensor an aufrechtzuerhalten, aber keine inhärente Verbindung mit dem dargestellten Inhalt hat.

In jedem Fall, wenn adversarialen Störungen tatsächlich das Problem verschlimmern, wie das neue Papier nahelegt, fragt man sich, ob die Suche nach Urheberrechtsschutz durch solche Mittel unter ‘Alchemie’ fällt.

Erstveröffentlicht am Montag, den 9. Juni 2025