Künstliche Intelligenz

Paraphrasen-Generierung mit Deep Reinforcement Learning – Thought Leaders

Wenn wir schreiben oder sprechen, haben wir uns alle schon gefragt, ob es eine bessere Möglichkeit gibt, eine Idee anderen zu vermitteln. Welche Wörter sollte ich verwenden? Wie sollte ich den Gedanken strukturieren? Wie werden sie wahrscheinlich reagieren? Bei Phrasee verbringen wir viel Zeit damit, über Sprache nachzudenken – was funktioniert und was nicht.

Stellen Sie sich vor, Sie schreiben die Betreffzeile für eine E-Mail-Kampagne, die an 10 Millionen Menschen auf Ihrer Liste gesendet wird, um 20 % Rabatt auf einen neuen Laptop anzubieten.

Welche Zeile würden Sie wählen:

- Sie können jetzt 20 % Rabatt auf Ihre nächste Bestellung erhalten

- Bereiten Sie sich vor – 20 % Rabatt

Obwohl sie dieselbe Information vermitteln, erreichte eine der Zeilen eine fast 15 % höhere Öffnungsrate als die andere (und ich wette, Sie können unser Modell nicht schlagen, wenn es darum geht, vorherzusagen, welche Zeile es ist ?). Obwohl Sprache oft durch A/B-Testing oder Multi-Armed-Bandits getestet werden kann, bleibt die automatische Generierung von Paraphrasen ein sehr schwieriges Forschungsproblem.

Zwei Sätze werden als Paraphrasen voneinander betrachtet, wenn sie dieselbe Bedeutung haben und austauschbar verwendet werden können. Ein weiteres wichtiges Thema, das oft als selbstverständlich angesehen wird, ist, ob ein von einer Maschine generierter Satz flüssig ist.

Im Gegensatz zum überwachten Lernen lernen Reinforcement-Learning-(RL)-Agenten durch Interaktion mit ihrer Umgebung und durch Beobachtung der Belohnungen, die sie als Ergebnis erhalten. Dieser etwas nuancierte Unterschied hat massive Auswirkungen auf die Funktionsweise der Algorithmen und die Schulung der Modelle. Deep Reinforcement Learning verwendet neuronale Netze als Funktionsapproximator, um es dem Agenten zu ermöglichen, zu lernen, wie er Menschen in komplexen Umgebungen wie Go, Atari und StarCraft II übertrifft.

Trotz dieses Erfolgs wurde Reinforcement Learning nicht weit verbreitet auf reale Probleme einschließlich der Verarbeitung natürlicher Sprache (NLP) angewendet.

Im Rahmen meiner MSc-Arbeit in Data Science zeigen wir, wie Deep RL verwendet werden kann, um überwachte Lernmethoden bei der automatischen Generierung von Paraphrasen von Eingabetext zu überbieten. Das Problem der Generierung der besten Paraphrase kann als Suche nach der Serie von Wörtern betrachtet werden, die die semantische Ähnlichkeit zwischen Sätzen maximiert, während die Flüssigkeit in der Ausgabe beibehalten wird. RL-Agenten sind gut geeignet, um die beste Reihe von Aktionen zu finden, um die erwartete Belohnung in Kontrollumgebungen zu maximieren.

Im Gegensatz zu den meisten Problemen im Maschinellen Lernen liegt das größte Problem in den meisten Anwendungen der Generierung natürlicher Sprache (NLG) nicht im Modellieren, sondern in der Bewertung. Obwohl die Bewertung durch Menschen derzeit als Goldstandard in der NLG-Bewertung gilt, hat sie erhebliche Nachteile, einschließlich hoher Kosten, zeitaufwändiger und schwieriger Abstimmung sowie mangelnder Reproduzierbarkeit über Experimente und Datensätze (Han, 2016). Als Ergebnis suchen Forscher seit langem nach automatischen Metriken, die einfach, allgemeingültig und die menschliche Beurteilung widerspiegeln (Papineni et al., 2002).

Die gängigsten automatischen Bewertungsmethoden für maschinell generierte Bildunterschriften sind unten zusammengefasst, einschließlich ihrer Vor- und Nachteile:

Paraphrasen-Generierung mit Reinforcement Learning-Pipeline

Wir haben ein System namens ParaPhrasee entwickelt, das hochwertige Paraphrasen generiert. Das System besteht aus mehreren Schritten, um Reinforcement Learning auf eine computationally effiziente Weise anzuwenden. Eine kurze Zusammenfassung der High-Level-Pipeline ist unten dargestellt, mit weiteren Details in der Arbeit.

Datensatz

Es gibt mehrere Paraphrasen-Datensätze, die in der Forschung verwendet werden, einschließlich: dem Microsoft Paraphrase-Korpus, ACLs Semantic Text Similarity-Wettbewerb, Quora Duplicate Questions und Twitter Shared Links. Wir haben MS-COCO aufgrund seiner Größe, Sauberkeit und Verwendung als Benchmark für zwei bemerkenswerte Paraphrasen-Generierungsarbeiten ausgewählt. MS-COCO enthält 120.000 Bilder von alltäglichen Szenen mit 5 Bildunterschriften pro Bild, die von 5 verschiedenen menschlichen Annotatoren bereitgestellt werden.

Obwohl es hauptsächlich für die Forschung im Bereich des Computersehens konzipiert ist, haben die Bildunterschriften tendenziell eine hohe semantische Ähnlichkeit und sind interessante Paraphrasen. Da die Bildunterschriften von verschiedenen Menschen bereitgestellt werden, haben sie tendenziell leichte Variationen in den Details, die in der Szene bereitgestellt werden, daher neigen die generierten Sätze dazu, Details zu halluzinieren.

Überwachtes Modell

Obwohl Reinforcement Learning erheblich in Bezug auf Stichproben-effizienz, Trainingszeiten und allgemeine Best Practices verbessert wurde, ist das Training von RL-Modellen von Grund auf immer noch vergleichsweise sehr langsam und instabil (Arulkumaran et al., 2017). Daher trainieren wir anstelle von Grund auf ein überwachtes Modell und feinjustieren es dann mit RL.

Wir verwenden ein Encoder-Decoder-Modellrahmenwerk und bewerten die Leistung mehrerer überwachter Basismodelle. Wenn wir das Modell mit RL feinjustieren, feinjustieren wir nur das Dekodierer-Netzwerk und behandeln das Encodierer-Netzwerk als statisch. Als solches betrachten wir zwei Hauptrahmenwerke:

- Training des überwachten Modells von Grund auf mit einem Standard-/Vanille-Encoder-Decoder mit GRUs

- Verwendung von vorgefertigten Satz-Embedding-Modellen für den Encoder, einschließlich: gepoolter Wort-Embeddings (GloVe), InferSent und BERT

Die überwachten Modelle neigen dazu, über die Modelle hinweg ziemlich ähnlich zu performen, wobei BERT und der Vanille-Encoder-Decoder die beste Leistung erzielen.

Obwohl die Leistung tendenziell vernünftig ist, gibt es drei häufige Fehlerquellen: Stottern, Generieren von Satzfragmenten und Halluzinationen. Diese sind die Hauptprobleme, die durch die Verwendung von RL gelöst werden sollen.

Reinforcement Learning-Modell

Die Implementierung von RL-Algorithmen ist sehr herausfordernd, besonders wenn Sie nicht wissen, ob das Problem gelöst werden kann. Es kann Probleme in der Implementierung Ihrer Umgebung, Ihrer Agenten, Ihrer Hyperparameter, Ihrer Belohnungsfunktion oder einer Kombination aller dieser geben. Diese Probleme werden verschlimmert, wenn Sie Deep RL durchführen, da Sie den Spaß der hinzugefügten Komplexität des Debuggens neuronaler Netze haben.

Wie bei allen Debugging-Aufgaben ist es wichtig, mit einfachen Dingen zu beginnen. Wir haben Variationen von zwei gut verstandenen Spiel-RL-Umgebungen (CartPole und FrozenLake) implementiert, um RL-Algorithmen zu testen und eine wiederholbare Strategie für die Übertragung von Wissen vom überwachten Modell zu finden.

Wir fanden heraus, dass die Verwendung eines Actor-Critic-Algorithmus REINFORCE in diesen Umgebungen übertraf. Bei der Übertragung von Wissen auf das Actor-Critic-Modell fanden wir heraus, dass die Initialisierung der Gewichte des Actors mit dem trainierten überwachten Modell und das Vortrainieren des Kritikers die beste Leistung erzielten. Wir fanden es schwierig, sophisticatede Policy-Distillationsansätze auf neue Umgebungen zu verallgemeinern, da sie viele neue Hyperparameter einführen, die abgestimmt werden müssen, um zu funktionieren.

Unterstützt durch diese Erkenntnisse wenden wir uns dann der Entwicklung eines Ansatzes für die Paraphrasen-Generierungsaufgabe zu. Wir müssen zunächst eine Umgebung erstellen.

Die Umgebung ermöglicht es uns, den Einfluss des Einsatzes verschiedener Bewertungsmetriken als Belohnungsfunktionen leicht zu testen.

Wir definieren dann den Agenten, da er viele Vorteile hat, verwenden wir eine Actor-Critic-Architektur. Der Actor wird verwendet, um das nächste Wort in der Sequenz auszuwählen, und seine Gewichte werden mit dem überwachten Modell initialisiert. Der Kritiker liefert eine Schätzung der erwarteten Belohnung, die ein Zustand wahrscheinlich erhalten wird, um dem Actor zu helfen, zu lernen.

Entwurf der richtigen Belohnungsfunktion

Der wichtigste Bestandteil des Entwurfs eines RL-Systems ist die Belohnungsfunktion, da dies das ist, was der RL-Agent zu optimieren versucht. Wenn die Belohnungsfunktion falsch ist, leiden die Ergebnisse, auch wenn jeder andere Teil des Systems funktioniert!

Ein klassisches Beispiel dafür ist CoastRunners, bei dem die OpenAI-Forscher die Belohnungsfunktion als Maximierung des Gesamtscores festlegten, anstatt das Rennen zu gewinnen. Das Ergebnis davon ist, dass der Agent eine Schleife entdeckte, in der er den höchsten Score erzielen konnte, indem er Turbos traf, ohne jemals das Rennen abzuschließen.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Da die Bewertung der Qualität von Paraphrasen selbst ein ungelöstes Problem ist, ist es noch schwieriger, eine Belohnungsfunktion zu entwerfen, die dieses Ziel automatisch erfasst. Die meisten Aspekte der Sprache zerlegen sich nicht schön in lineare Metriken und sind abhängig von der Aufgabe (Novikova et al., 2017).

Der RL-Agent entdeckt oft eine interessante Strategie, um Belohnungen zu maximieren, die die Schwächen in der Bewertungsmetrik ausnutzt, anstatt hochwertigen Text zu generieren. Dies führt tendenziell zu schlechter Leistung auf Metriken, die der Agent nicht direkt optimiert.

Wir betrachten drei Hauptansätze:

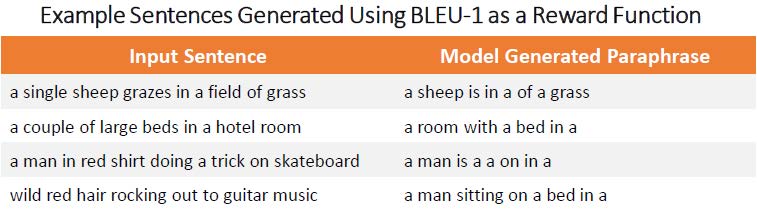

- Wort-Überlappungsmetriken

Gängige NLP-Bewertungsmetriken berücksichtigen den Anteil der Wort-Überlappung zwischen der generierten Paraphrase und dem Bewertungssatz. Je größer die Überlappung, desto größer die Belohnung. Die Herausforderung bei wortbasierten Ansätzen ist, dass der Agent zu viele Verbindungswörter wie “a is on of” enthält und es keine Maßnahme für Flüssigkeit gibt. Dies führt zu sehr schlechten Paraphrasen.

- Satzlevel-Ähnlichkeit und Flüssigkeitsmetriken

Die Hauptmerkmale einer generierten Paraphrase sind, dass sie flüssig und semantisch ähnlich zum Eingabesatz sein muss. Daher versuchen wir, diese individuell zu bewerten und die Metriken zu kombinieren. Für semantische Ähnlichkeit verwenden wir die Kosinus-Ähnlichkeit zwischen Satz-Embeddings von vorgefertigten Modellen, einschließlich BERT. Für Flüssigkeit verwenden wir einen Score, der auf der Perplexität eines Satzes von GPT-2 basiert. Je größer die Kosinus-Ähnlichkeit und Flüssigkeits-Scores, desto größer die Belohnung.

Wir haben viele verschiedene Kombinationen von Satz-Embedding-Modellen und Flüssigkeitsmodellen ausprobiert, und obwohl die Leistung vernünftig war, hatte der Agent das Hauptproblem, dass er die semantische Ähnlichkeit nicht ausreichend mit der Flüssigkeit in Einklang brachte. Für die meisten Konfigurationen priorisierte der Agent die Flüssigkeit, was dazu führte, dass Details entfernt und die meisten Entitäten “in der Mitte” von etwas oder “auf einem Tisch” oder “auf der Straße” platziert wurden.

Multi-Objective-Reinforcement-Learning ist eine offene Forschungsfrage und sehr herausfordernd in diesem Fall.

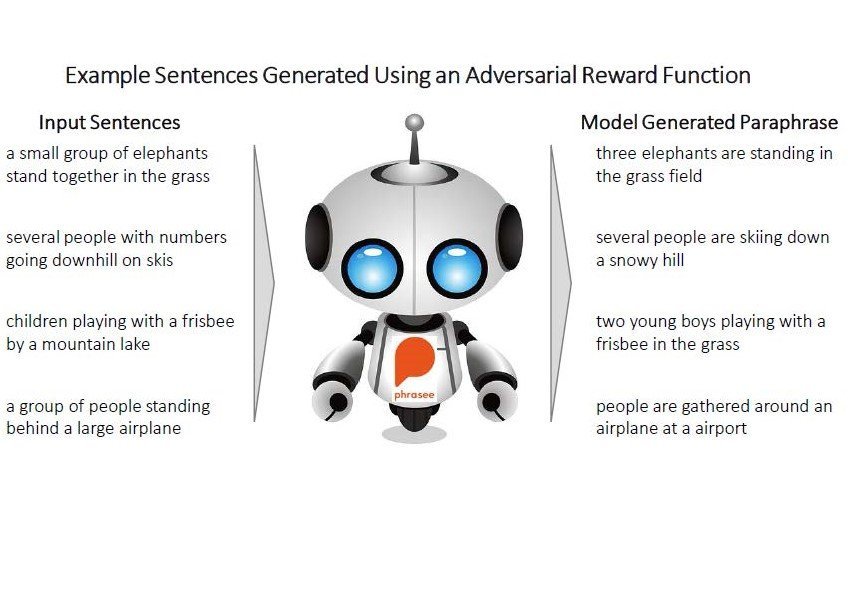

- Verwendung eines adversativen Modells als Belohnungsfunktion

Da Menschen als Goldstandard in der Bewertung gelten, trainieren wir ein separates Modell namens Diskriminator, um vorherzusagen, ob zwei Sätze Paraphrasen voneinander sind (ähnlich wie ein Mensch sie bewerten würde). Das Ziel des RL-Modells ist dann, diesen Diskriminator zu überzeugen, dass der generierte Satz eine Paraphrase des Eingabesatzes ist. Der Diskriminator generiert einen Score, wie wahrscheinlich es ist, dass die beiden Sätze Paraphrasen voneinander sind, der als Belohnung verwendet wird, um den Agenten zu trainieren.

Jedes 5.000 Mal wird dem Diskriminator gesagt, welche Paraphrase aus dem Datensatz stammt und welche generiert wurde, damit er seine zukünftigen Vermutungen verbessern kann. Der Prozess wird über mehrere Runden fortgesetzt, wobei der Agent versucht, den Diskriminator zu täuschen und der Diskriminator versucht, zwischen den generierten Paraphrasen und den Bewertungsparaphrasen aus dem Datensatz zu unterscheiden.

Nach mehreren Runden des Trainings generiert der Agent Paraphrasen, die die überwachten Modelle und andere Belohnungsfunktionen überbieten.

Zusammenfassung und Einschränkungen

Adversative Ansätze (einschließlich Selbstspiels für Spiele) bieten einen sehr vielversprechenden Ansatz für das Training von RL-Algorithmen, um die menschliche Leistung auf bestimmten Aufgaben ohne explizite Belohnungsfunktion zu übertreffen.

Obwohl RL in diesem Fall die überwachte Lernmethode übertraf, ist der zusätzliche Overhead in Bezug auf Code, Rechenleistung und Komplexität nicht wertvoll genug, um den Leistungsgewinn für die meisten Anwendungen zu rechtfertigen. RL ist am besten für Situationen geeignet, in denen überwachtes Lernen nicht leicht angewendet werden kann und eine Belohnungsfunktion leicht definiert werden kann (wie z. B. Atari-Spiele). Die Ansätze und Algorithmen sind in überwachtem Lernen viel ausgereifter, und das Fehlersignal ist viel stärker, was zu schnellerem und stabilerem Training führt.

Ein weiterer Gesichtspunkt ist, dass, wie bei anderen neuronalen Ansätzen, der Agent in Fällen, in denen die Eingabe von den Eingaben abweicht, die er zuvor gesehen hat, dramatisch versagen kann, was eine zusätzliche Ebene von Sorgfaltspflichten für Produktionsanwendungen erfordert.

Das Interesse an RL-Ansätzen und die Fortschritte in der Recheninfrastruktur in den letzten Jahren werden enorme Möglichkeiten für die Anwendung von RL in der Industrie, insbesondere im Bereich NLP, eröffnen.