Künstliche Intelligenz

Wie KI die Erkennung von Gebärdensprache präziser macht als je zuvor

Wenn wir über die Überwindung von Kommunikationsbarrieren nachdenken, konzentrieren wir uns oft auf Sprachübersetzungs-Apps oder Sprachassistenten. Aber für Millionen, die Gebärdensprache verwenden, haben diese Tools die Lücke noch nicht ganz geschlossen. Gebärdensprache ist nicht nur eine Frage von Handbewegungen – es ist eine reiche, komplexe Form der Kommunikation, die Gesichtsausdrücke und Körpersprache umfasst, wobei jedes Element eine entscheidende Bedeutung trägt.

Hier liegt das besondere Problem: Im Gegensatz zu gesprochenen Sprachen, die hauptsächlich in Vokabular und Grammatik variieren, unterscheiden sich Gebärdensprachen auf der ganzen Welt grundlegend in der Art und Weise, wie sie Bedeutung vermitteln. Die Amerikanische Gebärdensprache (ASL) zum Beispiel hat ihre eigene einzigartige Grammatik und Syntax, die nicht mit der gesprochenen englischen Sprache übereinstimmt.

Diese Komplexität bedeutet, dass die Entwicklung von Technologie zur Erkennung und Übersetzung von Gebärdensprache in Echtzeit ein Verständnis des gesamten Sprachsystems in Bewegung erfordert.

Ein neuer Ansatz für die Erkennung

Hier hat ein Team an der Florida Atlantic University (FAU) im College of Engineering and Computer Science beschlossen, einen frischen Ansatz zu verfolgen. Anstatt versuchen, die gesamte Komplexität der Gebärdensprache auf einmal zu bewältigen, konzentrierten sie sich auf die Beherrschung eines entscheidenden ersten Schritts: die Erkennung von ASL-Alphabetgesten mit beispielloser Genauigkeit durch KI.

Stellen Sie sich vor, einem Computer beizubringen, Handschrift zu lesen, aber in drei Dimensionen und in Bewegung. Das Team baute etwas Außergewöhnliches: eine Datenbank mit 29.820 statischen Bildern, die ASL-Handgesten zeigen. Aber sie sammelten nicht nur Bilder. Sie markierten jedes Bild mit 21 Schlüsselpunkten auf der Hand, wodurch eine detaillierte Karte davon entstand, wie Hände sich bewegen und verschiedene Zeichen bilden.

Dr. Bader Alsharif, der diese Forschung als Doktorand leitete, erklärt: “Diese Methode wurde in vorherigen Forschungen nicht erforscht, was sie zu einer neuen und vielversprechenden Richtung für zukünftige Fortschritte macht.”

Die Technologie im Detail

Lassen Sie uns in die Kombination von Technologien eintauchen, die dieses Gebärdensprachen-Erkennungssystem zum Laufen bringt.

MediaPipe und YOLOv8

Das Zauberhafte geschieht durch die nahtlose Integration von zwei leistungsstarken Tools: MediaPipe und YOLOv8. Denken Sie an MediaPipe als einen Experten für Handbewegungen – einen geschickten Gebärdensprachdolmetscher, der jede subtile Fingerbewegung und Handposition verfolgen kann. Das Forschungsteam wählte MediaPipe speziell für seine außergewöhnliche Fähigkeit, genaue Hand-Landmark-Verfolgung zu liefern, wobei 21 präzise Punkte auf jeder Hand identifiziert werden, wie wir oben erwähnt haben.

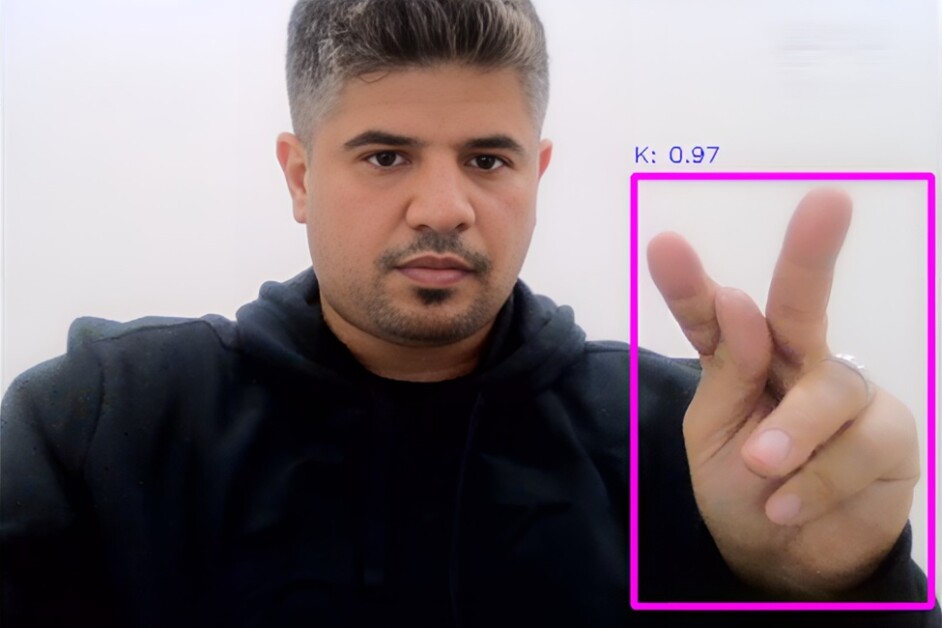

Aber das Verfolgen allein reicht nicht aus – wir müssen verstehen, was diese Bewegungen bedeuten. Das ist der Punkt, an dem YOLOv8 ins Spiel kommt. YOLOv8 ist ein Muster-Erkennungsexperte, der all diese verfolgten Punkte nimmt und herausfindet, welche Buchstabe oder Geste sie darstellen. Die Forschung zeigt, dass YOLOv8, wenn es ein Bild verarbeitet, es in ein S × S-Raster unterteilt, wobei jedes Rasterfeld für die Erkennung von Objekten (in diesem Fall Handgesten) innerhalb seiner Grenzen verantwortlich ist.

Alsharif et al., Franklin Open (2024)

Wie das System tatsächlich funktioniert

Der Prozess ist komplexer, als er auf den ersten Blick erscheint.

Hier ist, was hinter den Kulissen passiert:

Hand-Erkennungsstufe

Wenn Sie eine Geste machen, identifiziert MediaPipe zunächst Ihre Hand im Bild und kartiert diese 21 Schlüsselpunkte aus. Diese sind nicht einfach zufällige Punkte – sie entsprechen bestimmten Gelenken und Landmarken auf Ihrer Hand, von den Fingerspitzen bis zur Handfläche.

Räumliche Analyse

YOLOv8 analysiert diese Informationen dann in Echtzeit. Für jedes Rasterfeld im Bild sagt es voraus:

- Die Wahrscheinlichkeit, dass eine Handgeste vorhanden ist

- Die genauen Koordinaten der Position der Geste

- Die Vertrauensscore der Vorhersage

Klassifizierung

Das System verwendet etwas, das als “Umgebungsbox-Vorhersage” bezeichnet wird – stellen Sie sich vor, eine perfekte Rechteck um Ihre Handgeste zu zeichnen. YOLOv8 berechnet fünf entscheidende Werte für jede Box: x- und y-Koordinaten für das Zentrum, Breite, Höhe und einen Vertrauensscore.

Alsharif et al., Franklin Open (2024)

Warum diese Kombination so gut funktioniert

Das Forschungsteam entdeckte, dass durch die Kombination dieser Technologien etwas entstand, das größer war als die Summe seiner Teile. MediaPipes präzise Verfolgung kombiniert mit YOLOv8s fortschrittlicher Objekterkennung produzierte bemerkenswert genaue Ergebnisse – wir sprechen über eine Präzisionsrate von 98 % und einen F1-Score von 99 %.

Was dies besonders beeindruckend macht, ist, wie das System mit der Komplexität der Gebärdensprache umgeht. Einige Zeichen mögen für untrainierte Augen sehr ähnlich aussehen, aber das System kann subtile Unterschiede erkennen.

Rekordbrechende Ergebnisse

Wenn Forscher neue Technologie entwickeln, ist die große Frage immer: “Wie gut funktioniert sie tatsächlich?” Für dieses Gebärdensprachen-Erkennungssystem sind die Ergebnisse beeindruckend.

Das Team an der FAU testete ihr System gründlich und fand heraus:

- Das System identifiziert Zeichen zu 98 % korrekt

- Es erkennt 98 % aller vor ihm gemachten Zeichen

- Die Gesamtleistung erreicht einen beeindruckenden Score von 99 %

“Die Ergebnisse unserer Forschung demonstrieren die Fähigkeit unseres Modells, amerikanische Gebärdensprachengesten mit sehr wenigen Fehlern genau zu erkennen und zu klassifizieren”, erklärt Alsharif.

Das System funktioniert gut in alltäglichen Situationen – unterschiedliche Beleuchtung, verschiedene Handpositionen und sogar mit verschiedenen Personen, die Zeichen machen.

Dieser Durchbruch verschiebt die Grenzen dessen, was in der Gebärdensprachenerkennung möglich ist. Vorherige Systeme hatten mit der Genauigkeit zu kämpfen, aber durch die Kombination von MediaPipes Handverfolgung mit YOLOv8s Erkennungsfähigkeiten schuf das Forschungsteam etwas Besonderes.

“Der Erfolg dieses Modells ist größtenteils der sorgfältigen Integration von Transferlernen, sorgfältiger Datensatz-Erstellung und präziser Feinabstimmung zu verdanken”, sagt Mohammad Ilyas, einer der Co-Autoren der Studie. Diese Aufmerksamkeit für Details zahlte sich in der bemerkenswerten Leistung des Systems aus.

Was dies für die Kommunikation bedeutet

Der Erfolg dieses Systems eröffnet aufregende Möglichkeiten, die Kommunikation zugänglicher und inklusiver zu machen.

Das Team hört nicht bei der Erkennung von Buchstaben auf. Die nächste große Herausforderung ist, das System zu lehren, ein noch breiteres Spektrum an Handformen und Gesten zu verstehen. Denken Sie an diese Momente, wenn Zeichen fast identisch aussehen – wie die Buchstaben ‘M’ und ‘N’ in der Gebärdensprache. Die Forscher arbeiten daran, ihrem System zu helfen, diese subtilen Unterschiede noch besser zu erkennen. Wie Dr. Alsharif es ausdrückt: “Wichtig ist, dass die Ergebnisse dieser Studie nicht nur die Robustheit des Systems betonen, sondern auch sein Potenzial, in praktischen, echten Anwendungen eingesetzt zu werden.”

Das Team konzentriert sich jetzt auf:

- Das System so zu gestalten, dass es reibungslos auf regulären Geräten läuft

- Es so schnell zu machen, dass es für echte Konversationen geeignet ist

- Sicherzustellen, dass es in jeder Umgebung zuverlässig funktioniert

Dekan Stella Batalama vom College of Engineering and Computer Science der FAU teilt die größere Vision: “Indem wir die Erkennung der amerikanischen Gebärdensprache verbessern, trägt diese Arbeit dazu bei, Werkzeuge zu schaffen, die die Kommunikation für die gehörlosen und schwerhörigen Gemeinschaften verbessern können.”

Stellen Sie sich vor, in ein Arztzimmer zu gehen oder an einem Kurs teilzunehmen, wo diese Technologie Kommunikationslücken sofort überbrückt. Das ist das eigentliche Ziel – tägliche Interaktionen für alle Beteiligten natürlicher und reibungsloser zu machen. Es geht darum, Technologie zu schaffen, die tatsächlich hilft, Menschen zu verbinden. Ob in der Bildung, im Gesundheitswesen oder in alltäglichen Gesprächen, dieses System repräsentiert einen Schritt in Richtung einer Welt, in der Kommunikationsbarrieren immer kleiner werden.