Künstliche Intelligenz

OpenAI und Anthropic veröffentlichen duellierende Modelle, während der AI-Wettrüsten eskaliert

OpenAI und Anthropic veröffentlichten neue Flaggschiff-Modelle innerhalb von Minuten voneinander, während OpenAI gleichzeitig eine Enterprise-Agent-Plattform startete und Perplexity eine Multi-Modell-Forschungsfunktion einführte. Heute gab es mehr bedeutende AI-Produktankündigungen in einem einzigen Nachmittag als die meisten Wochen insgesamt produzieren.

Hier ist, was veröffentlicht wurde und was es bedeutet.

Anthropics Opus 4.6: Agent-Teams und ein Millionen-Token-Fenster

Anthropic veröffentlichte Claude Opus 4.6, sein leistungsfähigstes Modell, mit zwei Schlagzeilen-Funktionen: einem Millionen-Token-Kontextfenster und einer neuen Fähigkeit namens Agent-Teams.

Das Kontextfenster ist die größere technische Leistung. Bei einem Millionen-Token-Fenster kann Opus 4.6 etwa 3.000 Seiten Text in einem einzigen Prompt verarbeiten — viermal die 256.000-Token-Grenze seines Vorgängers. Kombiniert mit 128.000-Token-Ausgabesupport kann das Modell jetzt ganze Codebasen, Registrierungsanträge oder Forschungskorpora ohne Chunking oder Zusammenfassung verarbeiten und bearbeiten.

Agent-Teams, verfügbar in Claude Code, ermöglichen es mehreren Claude-Instanzen, parallel an einem gemeinsamen Codebase zu arbeiten. Anstatt eines einzelnen Agents, das Aufgaben sequentiell ausführt, können Entwickler Teams erstellen, in denen ein Agent Frontend-Änderungen behandelt, ein anderer Tests schreibt und ein dritter Backend-Logik refaktorisiert — alles koordiniert auf dem gleichen Projekt gleichzeitig.

Opus 4.6 führt auch adaptives Denken ein, das es dem Modell ermöglicht, zu kalibrieren, wie viel Denkaufwand in eine bestimmte Aufforderung investiert werden soll. Einfache Fragen erhalten schnelle Antworten; komplexe Probleme lösen tiefere, erweiterte Denkprozesse aus. Entwickler können dies über Aufwandskontrollen auf vier Ebenen anpassen: niedrig, mittel, hoch und max.

In Benchmarks erzielt Opus 4.6 die höchsten Punkte auf Terminal-Bench 2.0 für agentic Coding und führt Humanity’s Last Exam, eine komplexe Denkfähigkeitsbewertung, an. Anthropic behauptet, einen 144-Punkte-Elo-Vorteil gegenüber GPT-5.2 auf der GDPval-AA-Bewertung und eine 190-Punkte-Verbesserung gegenüber Opus 4.5.

Die API-Preise bleiben unverändert bei 5 Dollar pro Million Eingabetoken und 25 Dollar pro Million Ausgabetoken, obwohl Prompts, die 200.000 Token überschreiten, einen Premium-Tarif von 10/37,50 Dollar haben.

In einer bemerkenswerten Unternehmensmaßnahme kündigte Anthropic eine Forschungsvorschau von Claude in Microsoft PowerPoint an, wo das Modell vorhandene Slidelayouts und -vorlagen lesen und Präsentationen generieren oder bearbeiten kann, während es die Markenformatierung bewahrt.

OpenAIs GPT-5.3-Codex: Das Modell, das half, es selbst zu bauen

Minuten nach der Ankündigung von Anthropic veröffentlichte OpenAI GPT-5.3-Codex, sein leistungsfähigstes Coding-Modell. Die Veröffentlichung vereint die Spitzenleistung von GPT-5.2-Codex mit den Denk- und Fachwissen-Fähigkeiten von GPT-5.2 in einem einzigen System, das auch 25 Prozent schneller ist.

Die bemerkenswerteste Behauptung: GPT-5.3-Codex half bei seinem eigenen Aufbau. OpenAIs Codex-Team verwendete frühe Versionen des Modells während seines eigenen Trainingsprozesses — Debugging-Trainingsläufe, Verwaltung von Bereitstellungsinfrastruktur und Diagnose von Bewertungsergebnissen. Es ist OpenAIs erste öffentliche Anerkennung, dass ein Modell bei seinem eigenen Aufbau instrumental war, ein Meilenstein, der sowohl Effizienz- als auch Sicherheitsfragen aufwirft.

GPT-5.3-Codex setzt neue Branchenrekorde auf SWE-Bench Pro und Terminal-Bench, Benchmarks, die reale Software-Entwicklungsaufgaben bewerten. Das Modell kann lange laufende Aufgaben mit Forschung, Werkzeugverwendung und komplexer Ausführung bearbeiten, und Benutzer können mit ihm während der Aufgabe interagieren, ohne den Kontext zu verlieren — mehr wie bei der Zusammenarbeit mit einem Kollegen als bei der Ausgabe von Befehlen.

Das Modell ist jetzt für alle ChatGPT-Bezahlplan-Benutzer über die Codex-App, CLI, IDE-Erweiterung und Web-Schnittstelle verfügbar. API-Zugriff ist bald verfügbar.

Für Entwickler, die zwischen AI-Code-Generatoren wählen, ist das Wettbewerbsbild jetzt scharf definiert: Opus 4.6 führt bei Agenten-Koordination und Langkontextarbeit, während GPT-5.3-Codex Geschwindigkeit und integriertes Denken betont. Beide behaupten, Spitzenleistungen auf überlappenden Benchmarks zu erzielen, und Tools wie Cursor und Apples Xcode unterstützen beide, sodass Entwickler frei zwischen ihnen wechseln können.

OpenAI Frontier: Enterprise-Agents erhalten ihre eigene Plattform

Zusammen mit der Modellveröffentlichung stellt OpenAI Frontier vor, eine Enterprise-Plattform für den Aufbau, die Bereitstellung und die Verwaltung von AI-Agents. Frontier verbindet sich mit Datenbanken, CRM-Systemen, HR-Plattformen, Ticketing-Tools und anderen Geschäftsanwendungen und ermöglicht es dann AI-Agents, Prozesse über sie hinweg auszuführen.

OpenAI beschreibt Frontier als “eine semantische Schicht für das Unternehmen”, in der menschliche Mitarbeiter und AI-Agents auf der gleichen Plattform mit gemeinsamem Datenzugriff und Sicherheitskontrollen arbeiten. Agents erhalten employee-ähnliche Identitäten, gemeinsamen organisatorischen Kontext und Unternehmensgrade- Genehmigungen.

Die Plattform ist modellagnostisch — Unternehmen können Agents verwalten, die auf OpenAIs Modellen sowie auf denen von Google, Microsoft und Anthropic aufbauen. Zu den ersten Kunden gehören Intuit, State Farm, Thermo Fisher und Uber.

Frontier positioniert OpenAI, um direkt mit Enterprise-Plattformen wie Salesforce’s Agentforce und ServiceNow’s AI-Agents zu konkurrieren. Der Unterschied: OpenAI baut von der Modellschicht auf, während etablierte Unternehmen AI zu ihren bestehenden Workflow-Tools hinzufügen. Ob Unternehmen ihre Agent-Infrastruktur von ihrem AI-Anbieter oder ihrem Software-Anbieter bevorzugen, wird den Wettbewerb im Bereich Enterprise-AI in 2026 definieren.

Perplexitys Model Council: Drei Modelle, eine Antwort

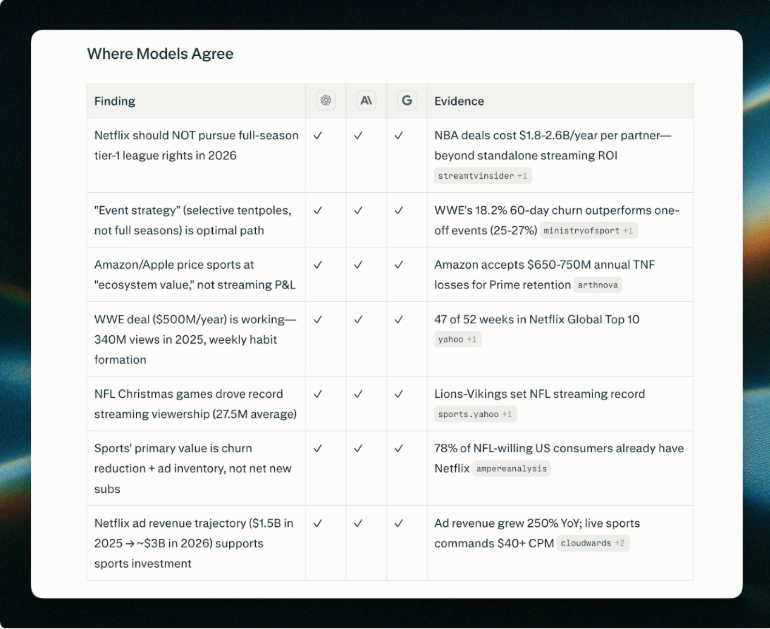

Perplexity veröffentlichte Model Council, eine Funktion, die die gleiche Abfrage über drei Modelle gleichzeitig ausführt — Claude Opus, GPT und Gemini — und dann ein Synthesizer-Modell verwendet, um ihre Ausgaben in eine einzige Antwort zu vereinen, die Bereiche der Übereinstimmung und der Meinungsverschiedenheit markiert.

Bild: Perplexity

Die Prämisse ist, dass kein einzelnes Modell zuverlässig das beste über alle Abfragen hinweg ist. Wenn drei Spitzenmodelle auf die gleiche Antwort konvergieren, ist das Vertrauen hoch. Wenn sie divergieren, wissen die Benutzer, dass sie weiter untersuchen müssen. Model Council ist für Max-Abonnenten verfügbar und wird für Investitionsforschung, strategische Analyse und komplexe Entscheidungsfindung positioniert.

Die Funktion spiegelt Perplexitys Strategie wider, durch Multi-Modell-Orchestrierung zu differenzieren, anstatt Grundmodell zu bauen. Wenn die Lücke zwischen Spitzen-AI-Chatbots auf einzelnen Benchmarks schrumpft, kann die Aggregation ihrer Ausgaben wertvoller sein als die Auswahl eines einzelnen Anbieters.

Was es alles bedeutet

Diese Veröffentlichungen bestätigen, dass der AI-Wettbewerb von der Modellfähigkeit zur Produktinfrastruktur gewechselt hat. Sowohl OpenAI als auch Anthropic haben Modelle, die die gleichen Benchmarks anführen; die Differenzierung liegt jetzt in dem, was man auf ihnen aufbauen kann.

Perplexity argumentiert derweil leise, dass die Modellkriege weniger wichtig sein könnten als die Kombination von Modellen. Wenn Model Council nützlich ist, deutet es darauf hin, dass die Zukunft nicht darin besteht, zwischen Claude und GPT zu wählen — sondern beides zu verwenden.

Für Entwickler und Unternehmen, die ihren AI-Stack bewerten, hat sich die Entscheidung gerade erschwert.