Künstliche Intelligenz

NeRF: Training von Drohnen in Neural Radiance Umgebungen

Forscher von der Stanford University haben eine neue Methode entwickelt, um Drohnen zu trainieren, photorealistische und hochgenaue Umgebungen zu navigieren, indem sie den jüngsten Ansturm von Interesse an Neural Radiance Fields (NeRF) nutzen.

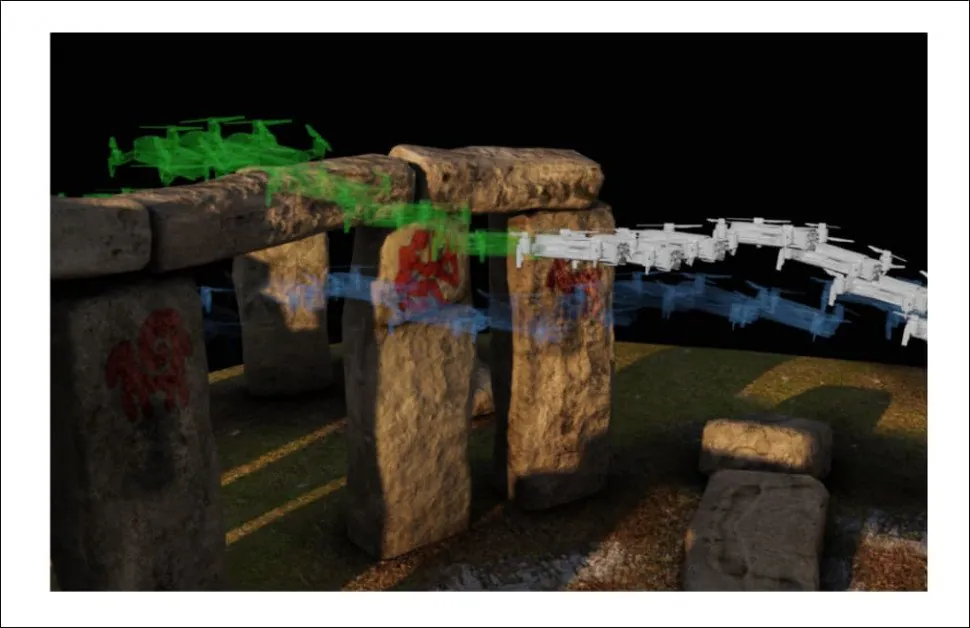

Drohnen können in virtuellen Umgebungen trainiert werden, die direkt von realen Orten abgebildet werden, ohne die Notwendigkeit für spezielle 3D-Szenenrekonstruktion. In diesem Bild aus dem Projekt wurde Windstörung als potenzielles Hindernis für die Drohne hinzugefügt, und wir können sehen, wie die Drohne vorübergehend von ihrer Traektorie abweicht und sich im letzten Moment korrigiert, um ein potenzielles Hindernis zu vermeiden. Quelle: https://mikh3x4.github.io/nerf-navigation/

Die Methode bietet die Möglichkeit für interaktives Training von Drohnen (oder anderen Arten von Objekten) in virtuellen Szenarien, die automatisch Volumeninformationen (zur Kollisionvermeidung) enthalten, Texturinformationen, die direkt von realen Fotos stammen (um das Bilderkennungsnetzwerk der Drohne realistischer zu trainieren) und reale Beleuchtung (um sicherzustellen, dass eine Vielzahl von Beleuchtungsszenarien trainiert wird und Überanpassung oder Überoptimierung des ursprünglichen Szenen-Snapshots vermieden wird).

Ein Couch-Objekt navigiert durch eine komplexe virtuelle Umgebung, die mit herkömmlichen AR/VR-Workflows sehr schwierig zu kartieren gewesen wäre, aber die in NeRF aus einer begrenzten Anzahl von Fotos automatisch rekonstruiert wurde. Quelle: https://www.youtube.com/watch?v=5JjWpv9BaaE

Typische NeRF-Implementierungen verfügen nicht über Traektorienmechanismen, da die meisten NeRF-Projekte in den letzten 18 Monaten sich auf andere Herausforderungen konzentriert haben, wie z.B. Szenen-Relighting, Reflektionsrendering, Compositing und Disentanglement von erfassten Elementen. Daher ist die primäre Innovation des neuen Papiers die Implementierung einer NeRF-Umgebung als navigierbarer Raum, ohne die umfangreiche Ausrüstung und die mühsamen Verfahren, die notwendig wären, um sie als 3D-Umgebung basierend auf Sensorerfassung und CGI-Rekonstruktion zu modellieren.

NeRF als VR/AR

Das neue Papier trägt den Titel Vision-Only Robot Navigation in a Neural Radiance World und ist eine Zusammenarbeit zwischen drei Abteilungen der Stanford University: Aeronautik und Astronautik, Maschinenbau und Informatik.

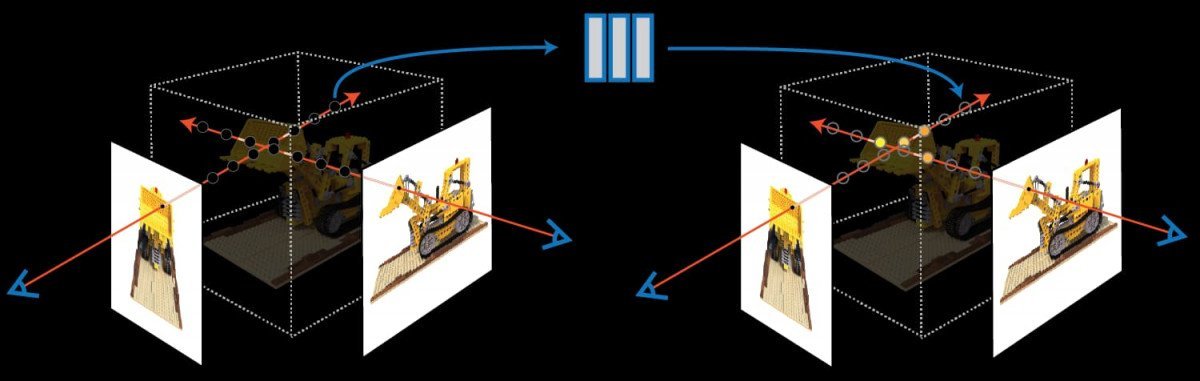

Die Arbeit schlägt einen Navigationsrahmen vor, der einem Roboter eine vorgefertigte NeRF-Umgebung zur Verfügung stellt, deren Volumendichte mögliche Pfade für das Gerät begrenzt. Es enthält auch einen Filter, um zu schätzen, wo sich der Roboter innerhalb der virtuellen Umgebung befindet, basierend auf der Bilderkennung der RGB-Kamera des Roboters. Auf diese Weise kann eine Drohne oder ein Roboter “halluzinieren”, was sie in einer bestimmten Umgebung erwarten kann.

Der Traektorien-Optimierer des Projekts navigiert durch ein NeRF-Modell von Stonehenge, das durch Photogrammetrie und Bildinterpretation (in diesem Fall von Mesh-Modellen) in eine Neural Radiance-Umgebung generiert wurde. Der Traektorien-Planer berechnet mehrere mögliche Pfade, bevor er eine optimale Traektorie über den Bogen festlegt.

Da eine NeRF-Umgebung vollständig modellierte Okklusionen aufweist, kann die Drohne lernen, Hindernisse leichter zu berechnen, da das neuronale Netzwerk hinter der NeRF die Beziehung zwischen Okklusionen und der Art und Weise, wie das visuelle Navigationssystem der Drohne die Umgebung wahrnimmt, kartieren kann. Die automatisierte NeRF-Generierungspipeline bietet eine relativ triviale Methode, um hyperreale Trainingsräume mit nur wenigen Fotos zu erstellen.

Der online-Replanungs-Frame, der für das Stanford-Projekt entwickelt wurde, ermöglicht eine widerstandsfähige und vollständig visuell basierte Navigation.

Die Stanford-Initiative ist eine der ersten, die die Möglichkeiten der Erforschung eines NeRF-Raums im Kontext einer navigierbaren und immersiven VR-ähnlichen Umgebung in Betracht zieht. Neural Radiance-Felder sind eine aufstrebende Technologie und derzeit Gegenstand mehrerer akademischer Bemühungen, um ihre hohen Rechenanforderungen zu optimieren und die erfassten Elemente zu entflechten.

NeRF ist nicht (wirklich) CGI

Da eine NeRF-Umgebung ein navigierbarer 3D-Raum ist, ist diese Technologie seit ihrem Aufkommen im Jahr 2020 missverstanden worden und oft als Methode zur Automatisierung der Erstellung von Meshes und Texturen wahrgenommen worden, anstatt 3D-Umgebungen zu ersetzen, die den Zuschauern aus Hollywood-VFX-Abteilungen und den fantastischen Szenen von Augmented Reality- und Virtual Reality-Umgebungen vertraut sind.

NeRF extrahiert Geometrie- und Texturinformationen aus einer sehr begrenzten Anzahl von Bildperspektiven, indem es die Differenz zwischen Bildern als Volumeninformation berechnet. Quelle: https://www.matthewtancik.com/nerf

Tatsächlich ist die NeRF-Umgebung eher ein “live”-Render-Raum, in dem eine Kombination von Pixel- und Lichtinformationen aufrechterhalten und in einem aktiven und laufenden neuronalen Netzwerk navigiert wird.

Der Schlüssel zum Potenzial von NeRF ist, dass es nur eine begrenzte Anzahl von Bildern erfordert, um Umgebungen zu rekonstruieren, und dass die generierten Umgebungen alle notwendigen Informationen für eine hochwertige Rekonstruktion enthalten, ohne die Dienste von Modellierern, Texturexperten, Beleuchtungsspezialisten und den Horden anderer Beiträger zu “traditionellem” CGI.

Semantische Segmentierung

Auch wenn NeRF effektiv “Computer-Generated Imagery” (CGI) darstellt, bietet es eine völlig andere Methodik und eine hochautomatisierte Pipeline. Darüber hinaus kann NeRF bewegliche Teile einer Szene isolieren und “kapseln”, sodass sie hinzugefügt, entfernt, beschleunigt oder allgemein als separate Aspekte in einer virtuellen Umgebung operieren können – eine Fähigkeit, die weit über den aktuellen Stand der Technik in einer “Hollywood”-Interpretation von CGI hinausgeht.

Ein Projekt der Shanghai Tech University, das im Sommer 2021 veröffentlicht wurde, bietet eine Methode, um bewegliche NeRF-Elemente in “einsetzbare” Aspekte für eine Szene zu individuieren. Quelle: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativ ist die Architektur von NeRF ein bisschen ein “black box”; es ist derzeit nicht möglich, ein Objekt aus einer NeRF-Umgebung zu extrahieren und es direkt mit herkömmlichen mesh-basierten und bildbasierten Tools zu manipulieren, obwohl mehrere Forschungsbemühungen beginnen, Durchbrüche bei der Dekonstruktion der Matrix hinter NeRFs neuronalen Netzwerk-Live-Render-Umgebungen zu erzielen.

https://www.youtube.com/watch?v=5JjWpv9BaaE