Andersons Blickwinkel

Jigsaw-Puzzles verbessern die visuelle Argumentationsfähigkeit von KI

Neue Forschungsergebnisse deuten darauf hin, dass KI-Modelle durch das Lösen von Jigsaw-Puzzles cleverer im Sehen werden können. Durch das Neuordnen von verschachtelten Bildern, Videos und 3D-Szenen können sie ihre visuellen Fähigkeiten ohne die Notwendigkeit von zusätzlichen Daten, Labels oder Tools schärfen.

In dem aktuellen Wettlauf, um Multimodale Große Sprachmodelle (MLLMs) voranzutreiben, gibt es wenige einfache Siege und keine kostenlosen Mahlzeiten.

Obwohl viele der beeindruckenden FOSS-Veröffentlichungen aus China im Jahr 2025 berichtetermaßen geringere Entwicklungskosten und Betriebskosten haben, neigen okzidentale Veröffentlichungen dazu, mehr in das Problem zu investieren: mehr Daten, mehr Rechenleistung, mehr Elektrizität (obwohl nicht, wie wir kürzlich festgestellt haben, mehr menschliche Annotatoren, da dies zu teuer ist, sogar für die $-Trillionen-Skala-Gen-AI-Revolution).

In der Forschungsliteratur bieten die meisten angeblich “kostenlosen” Ansätze zur Evolution von KI-Architekturen nur marginale inkrementelle Verbesserungen oder Verbesserungen in Bereichen, die nicht die am meisten verfolgten sind. Dennoch ist die Suche nach bisher unentdeckten “grundlegenden Prinzipien”, die das Tempo der Entwicklung beschleunigen könnten, zu verlockend, um sie aufzugeben.

Aufnahme der Stücke

Während dies nicht ganz in diese Kategorie fällt, behauptet eine neue akademische Zusammenarbeit zwischen chinesischen Institutionen, dass das Lösen von Jigsaw-Puzzles die Leistung von VLMs deutlich verbessert, obwohl dieser Reinforcement-Learning-Ansatz in diesem Bereich zuvor wenig Erfolg hatte und keine zusätzlichen Systeme, Hilfsmodelle oder anderen “Aufsatz”-Prozesse erfordert:

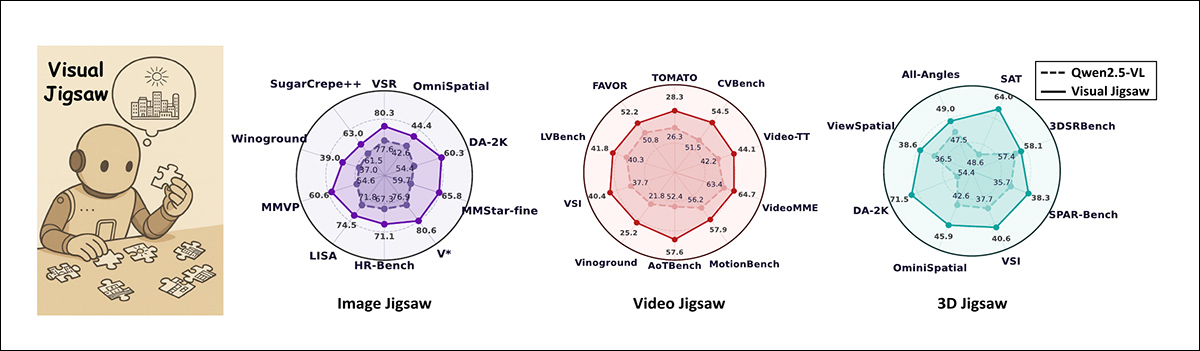

Visual Jigsaw ist ein selbstüberwachtes Post-Training-Framework, das die visionsspezifischen Fähigkeiten in multimodalen Großen Sprachmodellen verbessert. Durch das Training auf Jigsaw-Aufgaben über Bilder, Videos und 3D-Daten hinweg gewinnen die Modelle scharfere feinkörnige, räumliche und kompositionelle Wahrnehmung in Bildern, stärkere temporale Argumentationsfähigkeit in Videos und verbessertes geometrisches Verständnis in 3D-Szenen. Die Radar-Diagramme im Bild oben zeigen konsistente Gewinne gegenüber dem Basis-Modell Qwen2.5-VL, wobei die Wertskalen für jeden Benchmark für Klarheit angepasst wurden. Quelle: https://arxiv.org/pdf/2509.25190

Das von den Forschern entwickelte System heißt Visual Jigsaw und beinhaltet das Training bestehender MLLMs auf Material, das fragmentiert und zufällig verteilt wurde, wie ein Jigsaw-Puzzle. Die Autoren entwickelten drei Modalitäten für diesen Ansatz: Bild, Video und 3D (d. h. CGI-Style-Meshes), und fanden heraus, dass eine moderate Anpassung desselben Prozesses allen drei Domänen zugute kam:

Eine Darstellung der drei Visual-Jigsaw-Aufgaben. Beim Image-Jigsaw wird ein Bild in Patches aufgeteilt, verschoben und das Modell prognostiziert die korrekte Anordnung; beim Video-Jigsaw werden Clips verschoben und das Modell stellt ihre ursprüngliche Reihenfolge wieder her; beim 3D-Jigsaw werden Punkte mit unterschiedlichen Tiefen verschoben und das Modell ordnet sie von nah zu fern. Die Ausgaben des Modells werden gegen die Grundwahrheit bewertet, wobei für teilweise korrekte Lösungen Teilpunkte vergeben werden.

Die Trainingsmethode von Visual Jigsaw hilft KI-Modellen, ihre Fähigkeit zur Verarbeitung visueller Informationen zu verbessern, indem sie diese zerlegten Bilder, Video-Clips oder 3D-Daten neu anordnen.

Der Prozess basiert auf Worten und nicht auf Bildern und erfordert daher keine Bildgenerierung oder zusätzliche visuelle Komponenten. Diese Methode passt in ein System namens Reinforcement Learning from Verifiable Rewards (RLVR), bei dem das Modell für korrekte Antworten basierend auf klaren, automatischen Regeln belohnt wird; und bei dem daher keine menschliche Kennzeichnung erforderlich ist.

Diese entscheidende Tatsache ist tatsächlich schwer aus dem neuen Papier zu entnehmen: dass das System das Puzzle semantisch zusammenbaut, durch Beschreibungen und nicht auf die Weise, wie Menschen lernen, solche Puzzles zu lösen:

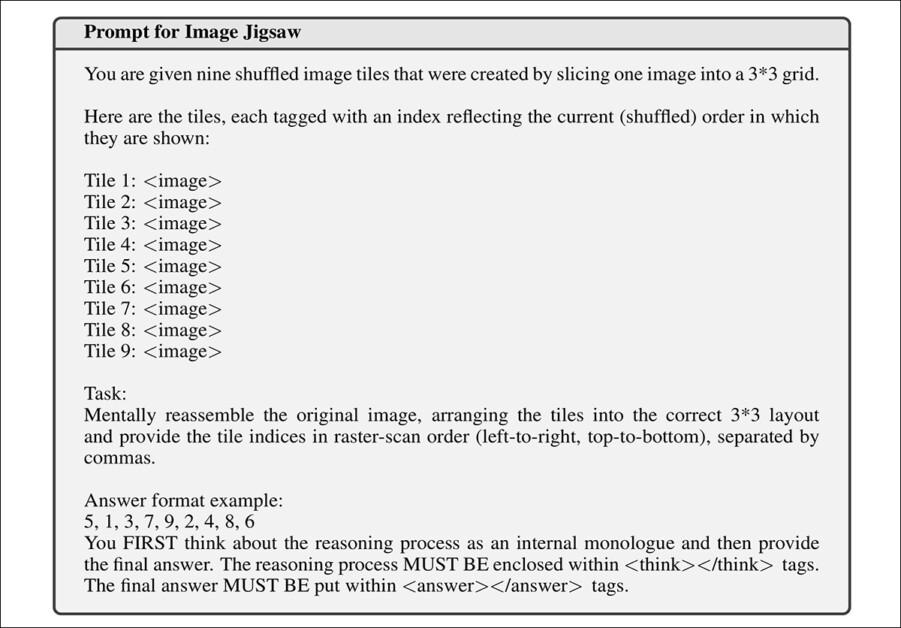

Aus dem Zusatzmaterial des neuen Papiers, ein Beispiel für eine RL-Aufgabe, die die textbasierte Natur dieses Lernprozesses veranschaulicht. Die Bilder, die dem MLLM gezeigt worden wären, sind hier nicht dargestellt.

Obwohl MLLMs umfassend mit visionsspezifischen Aufgaben zu tun haben, sind sie sprachbasierte Architekturen und nicht dafür ausgelegt, Bilder, Videos oder Formendarstellungen wie 3D-Netze zu generieren.

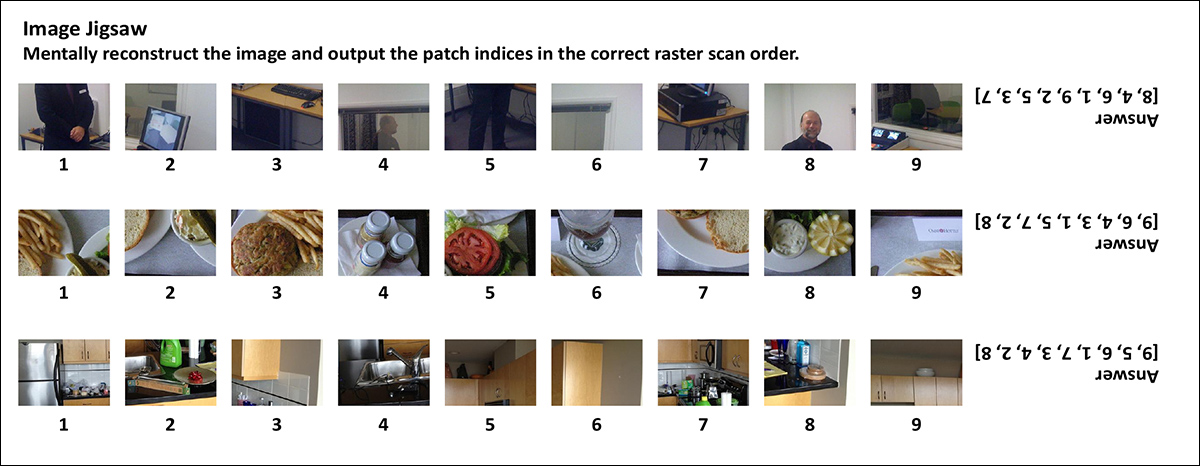

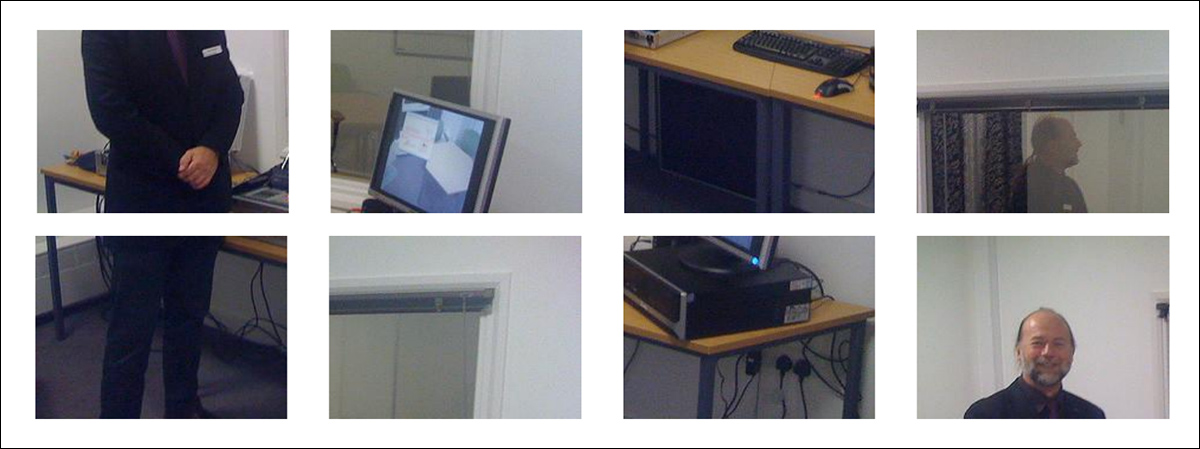

Beispiele aus der Bild-Jigsaw-Aufgabe. Jede Zeile zeigt verschobene Patches, die das Modell in ihre ursprüngliche Anordnung zurückordnen muss, wobei die korrekte Anordnung rechts gezeigt wird.

In jedem Fall wird diese Art von Training nach der Hauptlernphase durchgeführt, wenn das Modell bereits eine gewisse Fähigkeit zur Bildverarbeitung besitzt.

Frühere Ansätze wie das 2017er Schweizer Papier Unsupervised Learning of Visual Representations by Solving Jigsaw Puzzles verwendeten diesen Art von Verstärkungsansatz mit eher geringem Erfolg bei konvolutionellen neuronalen Netzen (CNNs), einer deutlich anderen Art von Architektur im Vergleich zu einem modernen MLLM.

Aus der Veröffentlichung von 2017 ‘Unsupervised Learning of Visual Representations by Solving Jigsaw Puzzles ‘, ein frühes Beispiel für die Verwendung von Fragmentierung als belohnungsbasierte Herausforderung für ein neuronales System. Quelle: https://arxiv.org/pdf/1603.09246

In Tests führte Visual Jigsaw zu dem, was die Autoren als konsistente und messbare Verbesserungen über eine breite Palette von Benchmarks behaupten: die Bild-Jigsaw-Aufgabe verbesserte die feinkörnige Wahrnehmung, die räumliche Anordnung und die kompositionelle Argumentationsfähigkeit; die Video-Jigsaw-Aufgabe verbesserte die Fähigkeit des Modells, temporale Sequenzen zu verfolgen und die Reihenfolge von Ereignissen zu begründen; und die 3D-Jigsaw-Aufgabe stärkte das tiefenbasierte Verständnis und die räumliche Argumentationsfähigkeit unter Verwendung nur von RGB-D-Eingaben.

Über alle drei Modalitäten hinweg wiederholt das Papier, dass die neue Methode mehrere wettbewerbsfähige Baselines übertraf, ohne dass architektonische Änderungen, zusätzliche visuelle Module oder zusätzliche überwachte Daten erforderlich waren:

‘Umfangreiche Experimente zeigen wesentliche Verbesserungen in feinkörniger Wahrnehmung, temporaler Argumentationsfähigkeit und 3D-räumlichem Verständnis. Unsere Ergebnisse unterstreichen das Potenzial selbstüberwachter visionsspezifischer Aufgaben im Post-Training von MLLMs und zielen darauf ab, weitere Forschung auf visionsspezifische Prätext-Designs anzuregen.’

Das neue Papier trägt den Titel Visual Jigsaw Post-Training verbessert MLLMs und stammt von sechs Forschern der Nanyang-Technological-University, der Linköping-Universität und der SenseTime-Forschung. Das Papier wird von einer Projekt-Website mit Live-Demos begleitet (und Sie können sogar Ihr eigenes Bild in die Bild-Jigsaw-Demo laden). Der Code und die Gewichte des Projekts wurden allgemein zugänglich gemacht,

Methode

Obwohl wir uns mit der Art und Weise auseinandersetzen, wie die Informationen aufgeteilt werden, um die drei getesteten Modalitäten zu accommodieren, sollten wir zunächst die Belohnungs-Design für das neue System betrachten.

Der Visual-Jigsaw-Ansatz bewertet die Antworten des Modells mit einer gestuften Belohnung, nicht nur mit einem einfachen Bestehen oder Nicht-Bestehen. Wenn das Modell die exakte korrekte Reihenfolge der Jigsaw-Teile vorhersagt, erhält es eine volle Belohnung; wenn die Antwort größtenteils richtig, aber nicht perfekt ist, erhält das Modell Teilpunkte, die durch einen Rabattfaktor skaliert werden, um zu vermeiden, dass das Modell den Prozess durch wiederholte Teil-Lösungen ausnutzt (dies verhindert, dass das Modell den Prozess durch wiederholte Teil-Lösungen ausnutzt).

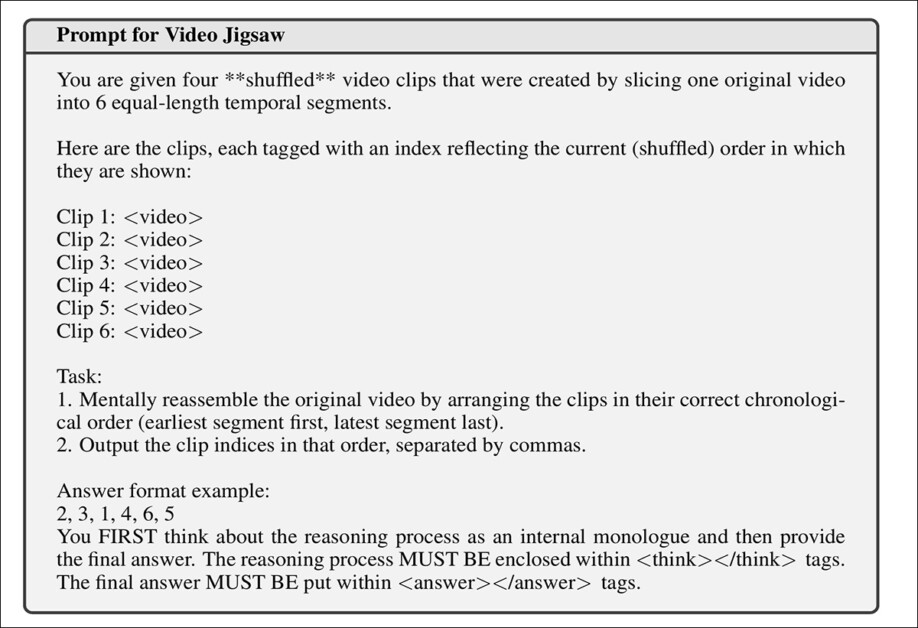

Ungültige Antworten, wie z. B. der ‘Schummel’-Versuch, die gleiche Zahl wiederholt zu verwenden, erhalten eine Punktzahl von null. Um konsistente Formatierung zu fördern, muss das Modell seine Argumentation in <think>-Tags und seine endgültige Antwort in <answer>-Tags einfügen. Es erhält einen kleinen Bonus, wenn dieses Format korrekt verwendet wird.

Bilder

Um ein Puzzle für die Bilder-Modalität zu erstellen, wird ein Bild zunächst in ein Raster von Patches unterteilt, indem es in gleich große Blöcke geschnitten wird:

Beispiele von Bild-Patches, die das System lösen muss.

Die Patches werden in einer festen Reihenfolge von links oben nach rechts unten angeordnet, wie bei der Lesereihenfolge auf einer Seite, bevor sie mit einem zufälligen Shuffle verschoben werden. Das Modell wird dann diesem verschobenen Satz von Patches ausgesetzt und muss die ursprüngliche Reihenfolge erraten, indem es die korrekte Permutation vorhersagt, die die ursprüngliche Anordnung wiederherstellt.

Während des Trainings wurden 118.000 Bilder aus dem COCO-Datensatz verwendet, wobei jedes Bild neun Patches (d. h. “Puzzle-Teile”) ergab. Der Prompt, der dem System gegeben wurde, ist oben in diesem Artikel zu sehen (das Bild mit der Beschriftung, die mit ‘Aus dem Zusatzmaterial des neuen Papiers’ beginnt).

Video

Für die Video-Jigsaw-Aufgabe wird ein Video in eine Sequenz von Clips unterteilt, indem es gleichmäßig über die Zeit geschnitten wird, und dann werden die Clip-Segmente verschoben. Das Modell wird dann dieser verschobenen Sequenz gezeigt und muss ihre korrekte ursprüngliche chronologische Reihenfolge erraten.

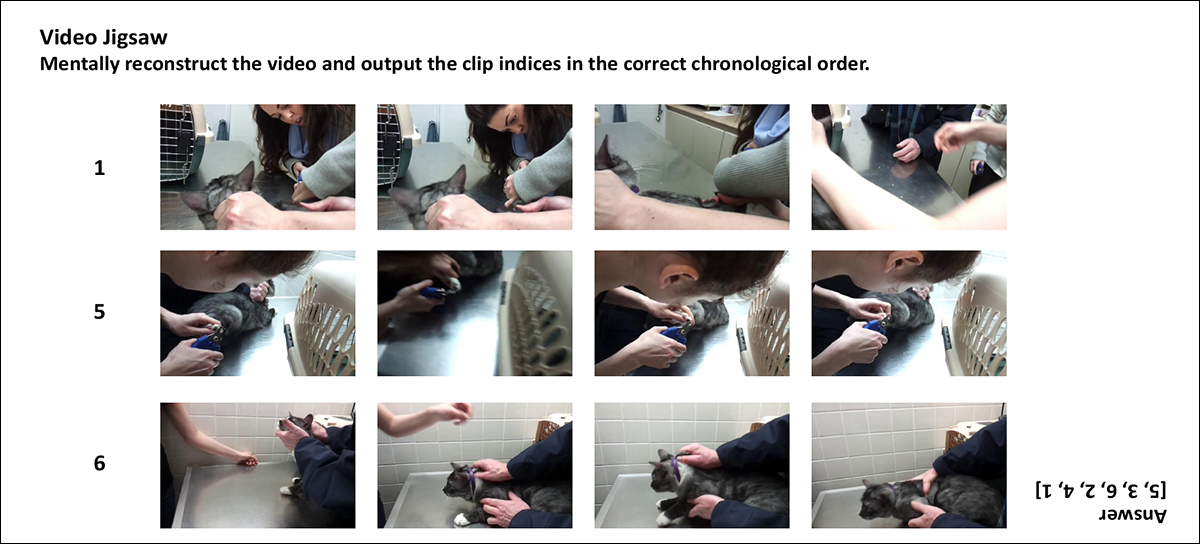

Abgekürzte Beispiele der Video-Puzzle-Herausforderung, aus dem Zusatzmaterial des Papiers.

Das Training für diese Modalität verwendete 100.000 Videos aus dem LLaVA-Video-Datensatz, wobei jedes Video in sechs Clips unterteilt wurde. Um zu verhindern, dass das Modell offensichtliche Frame-Übereinstimmungscues an Clip-Grenzen ausnutzt, wurden 5 % der Frames am Anfang und Ende jedes Clips abgeschnitten.

Clips enthielten nicht mehr als 12 Frames, jeweils mit einer maximalen Auflösung von 128x28x28 Pixeln. Videos, die kürzer als 24 Sekunden waren, wurden ausgeschlossen.

Der Prompt für diese Aufgabe ist unten gezeigt:

Der Verstärkungs-Lern-Prompt, der den MLLMs für die Video-Aufgabe präsentiert wurde, ohne die Clips, die dem MLLM präsentiert worden wären.

3D-Daten

Eine vollständige 3D-Jigsaw-Aufgabe würde normalerweise das Zerlegen eines 3D-Raums (wie z. B. Voxel-Blöcke oder Punkt-Wolken-Fragmente) in kleinere Teile und das Trainieren eines Modells, um ihre ursprüngliche räumliche Anordnung wiederherzustellen.

Allerdings ist das durchschnittliche MLLM nicht in der Lage, rohe 3D-Daten direkt zu verarbeiten, sondern verlässt sich auf semantisch interpretierte Bild- oder Video-Eingaben. Daher führten die Autoren eine handhabbarere Variante ein, die die oben genannten RGB-D-Bilder (d. h. 2D-Bilder, die Tiefeninformationen für jeden Pixel enthalten) verwendet.

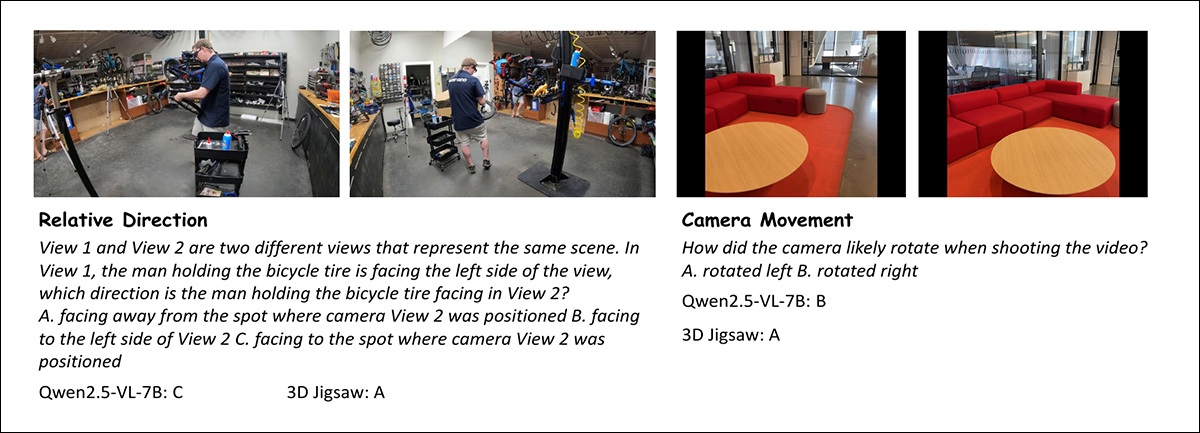

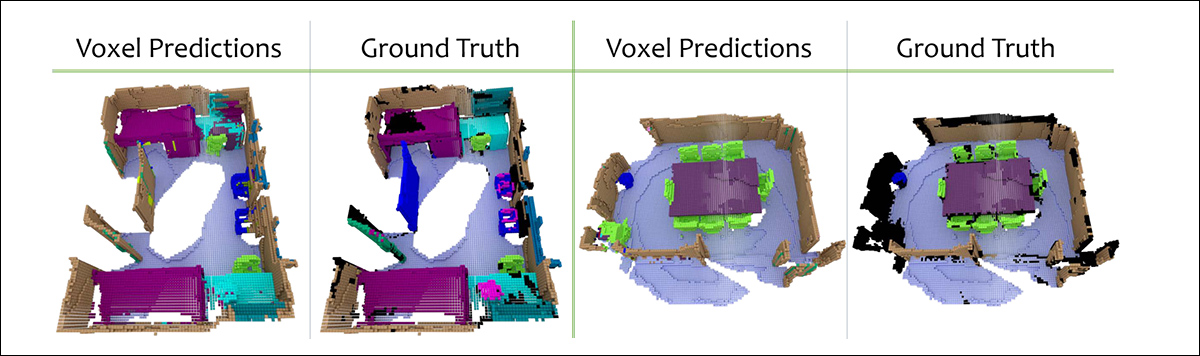

Beispiel-Fragen aus dem 3D-Spatial-Understanding-Benchmark, der zur Bewertung der Leistung bei relativer Blickpunkt- und Kamerabewegungs-Argumentation verwendet wird. Das 3D-Jigsaw-Modell schließt sowohl die räumliche Beziehung zwischen zwei Szenenansichten als auch die wahrscheinliche Richtung der Kamerarotation korrekt, und übertrifft das Qwen2.5-VL-7B-Basismodell.

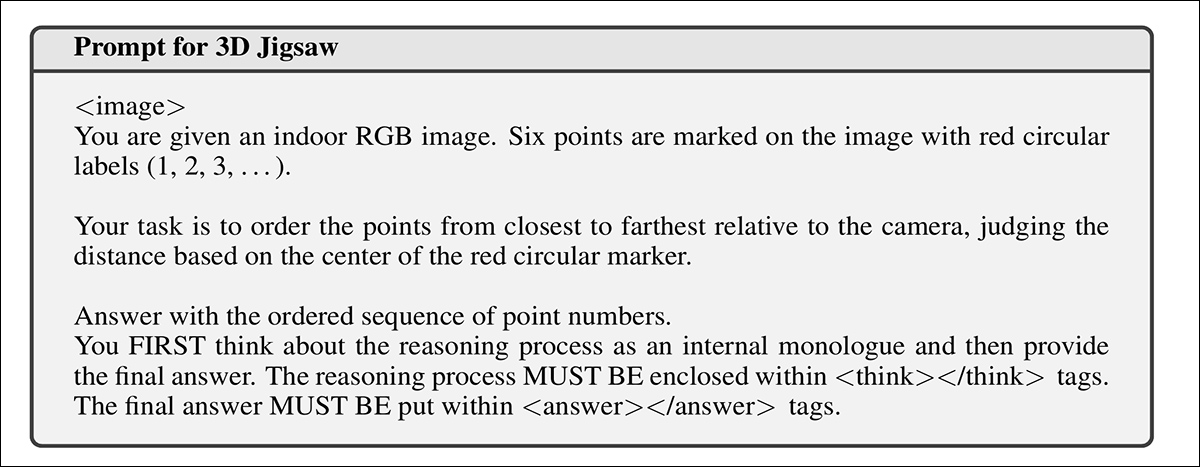

Von jedem RGB-D-Bild aus wird dem Modell eine zufällig verschobene Liste von Punkten gegeben, die ursprünglich unterschiedliche Tiefen hatten, von nah bis fern, wobei das Ziel darin besteht, ihre korrekte tiefenbasierte Reihenfolge unter Verwendung nur des 2D-Bildes als Referenz wiederherzustellen:

Der RL-Prompt für das 3D-Jigsaw.

Jeder Punkt ist im Bild markiert (das dem Modell gezeigt wird, aber nicht im Prompt-Beispiel direkt oben visualisiert), und das Modell muss vorhersagen, welcher am nächsten, zweitnächsten usw. war, und damit die ursprüngliche Tiefenfolge ohne Zugriff auf die rohen Tiefenwerte rekonstruieren.

Die 3D-Jigsaw-Aufgabe wird auf RGB-D-Bildern aus dem ScanNet-Datensatz trainiert, wobei 300.000 Proben durch die Auswahl von sechs Tiefenpunkten pro Bild erstellt werden.

Beispiele von Punkt-Wolken aus dem ScanNet-Datensatz, der für das 3D-Jigsaw verwendet wird. Quelle: https://arxiv.org/pdf/1702.04405

Jeder Punkt musste innerhalb eines Tiefenbereichs von 0,1 bis 10 Metern liegen und um die Vielfalt zu fördern, durften keine zwei Punkte in einem Satz weniger als 40 Pixel im Bildplan oder weniger als 0,2 Meter auseinander in der Tiefe sein.

Tests

Für die anfänglichen Tests verwendete das System Qwen2.5-VL-7B-Instruct als Basis-Multimodales Modell. Das Training verwendete den GRPO-Algorithmus, wobei sowohl KL-Regularisierung als auch Entropie-Verlust entfernt wurden.

Für teilweise Vorhersagen wurde ein Rabattfaktor von 0,2 angewendet. Das Bild-Jigsaw-Training verwendete eine globale Batch-Größe von 256, während Video- und 3D-Jigsaw 128 verwendeten. Die Lernrate wurde auf 1×10⁻⁶ festgelegt.

Für jeden Prompt generierte das Modell 16 Antworten bei einer Decodier-Temperatur von 1,0. Sowohl die Bild- als auch die Video-Jigsaw-Aufgaben wurden über 1.000 Schritte trainiert, während die 3D-Jigsaw-Aufgabe über 800 Schritte trainiert wurde.

Bild-Jigsaw

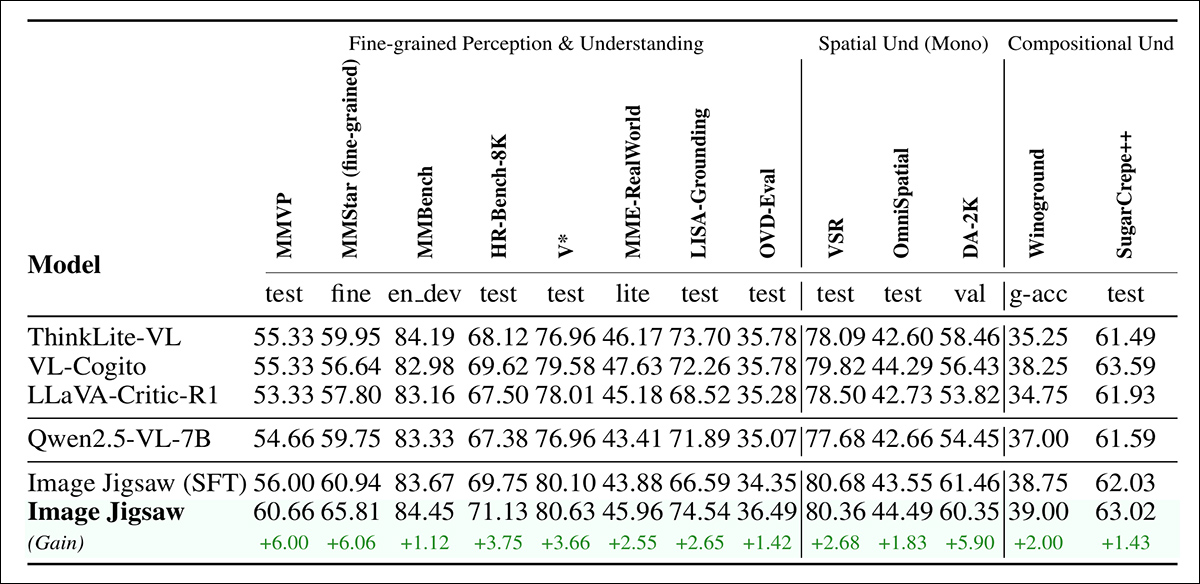

Das Bild-Jigsaw-Modell wurde über drei Kategorien von visionsspezifischen Benchmarks getestet: für feinkörnige Wahrnehmung und Verständnis, MMVP, die feinkörnige Wahrnehmung-Teilmenge von MMStar; MMBench; HR-Bench; V*; MME-RealWorld (Lite); LISA-Grounding; und OVD-Eval.

Für monokulare räumliche Verständnis wurden die Benchmarks VSR; OmniSpatial; und Depth Anything V2 (DA-2K). Für kompositionelles visuelles Verständnis wurden die Tests Winoground und SugerCrepe++ eingesetzt.

Drei Baselines wurden getestet, alle von Qwen2.5-VL-7B abgeleitet: ThinkLite-VL für multimodales Argumentieren; VL-Cogito für allgemeine Vision und wissenschaftliche Aufgaben; und LLaVA-Critic-R1 für Bildwahrnehmung.

Alle wurden unter Verwendung von Kurzantworten nur ausgewertet, da Kette-von-Gedanken (CoT)-Argumentation manchmal die Leistung verringerte.

Bewertungsergebnisse auf Bild-Benchmarks. Bild-Jigsaw verbesserte sich auf dem Qwen2.5-VL-7B-Basismodell über alle Aufgabentypen (d. h. feinkörnige Wahrnehmung und Verständnis; monokulare räumliche Verständnis; und kompositionelle visuelle Argumentation), und übertraf vorherige Post-Training-Baselines.

Von den Ergebnissen für das Bild-Jigsaw, wie oben gezeigt, sagen die Autoren:

‘[Das Bild oben] zeigt, dass unsere Methode konsistent die visionsspezifischen Fähigkeiten auf den drei Arten von Benchmarks verbessert. Diese Ergebnisse bestätigen, dass die Integration von Bild-Jigsaw-Post-Training die Wahrnehmungsgrundlage und das feinkörnige visuelle Verständnis von MLLMs erheblich über reasoning-zentrierte Post-Training-Strategien hinaus verbessert.

‘Wir führen diese Verbesserungen darauf zurück, dass das Lösen von Bild-Jigsaw das Modell dazu zwingt, lokale Patch-Details zu beachten, globale räumliche Anordnungen abzuleiten und inter-Patch-Beziehungen zu begründen, was direkt das feinkörnige, räumliche und kompositionelle Verständnis zugute kommt.’

Video-Jigsaw

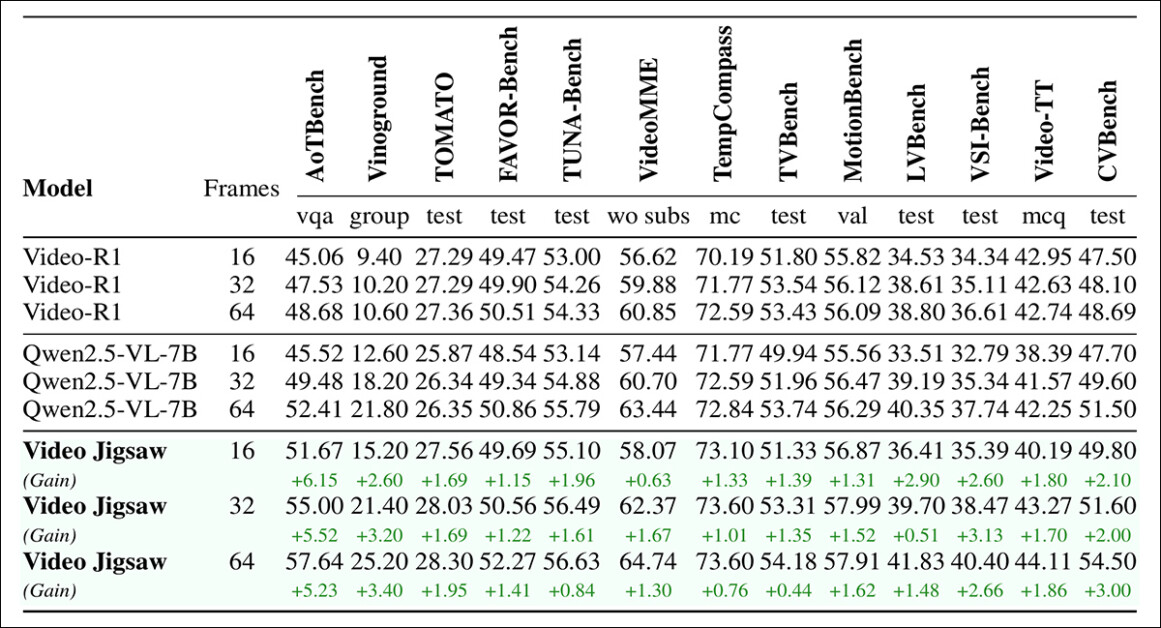

Für Video-Jigsaw wurde die Bewertung auf AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; und CVBench durchgeführt.

Video-R1 wurde als Baseline verwendet, das mit kaltem Start überwachtem Feinabstimmung und anschließendem Reinforcement-Learning für Video-Verständnis und -Argumentation trainiert wurde. In diesem Fall wurden die Bewertungen einschließlich des gesamten Argumentationsprozesses durchgeführt, da dies konsistent bessere Ergebnisse als direkte Antworten produzierte.

Alle Modelle wurden auf 256x28x28 Pixel beschränkt und über drei Frame-Einstellungen – 16, 32 und 64 – getestet:

Bewertungsergebnisse auf Video-Benchmarks, wobei Video-Jigsaw die Baseline konsistent über alle Aufgaben und Frame-Einstellungen hinweg übertrifft.

Video-Jigsaw produzierte konsistente Verbesserungen über alle Video-Verständnis-Benchmarks und Frame-Einstellungen, wobei die Gewinne besonders stark auf Aufgaben waren, die temporale Argumentation und Richtungsorientierung erforderten, wie z. B. die in AoTBench, und auch in cross-Video-Argumentations-Benchmarks wie CVBench:

‘Diese Ergebnisse bestätigen, dass das Lösen von Video-Jigsaw-Aufgaben das Modell dazu bringt, bessere temporale Kontinuität zu erfassen, Beziehungen zwischen Videos zu verstehen, Richtungs-Konsistenz zu begründen und sich auf holistische und generalisierbare Video-Verständnis-Szenarien zu verallgemeinern.’

3D-Daten

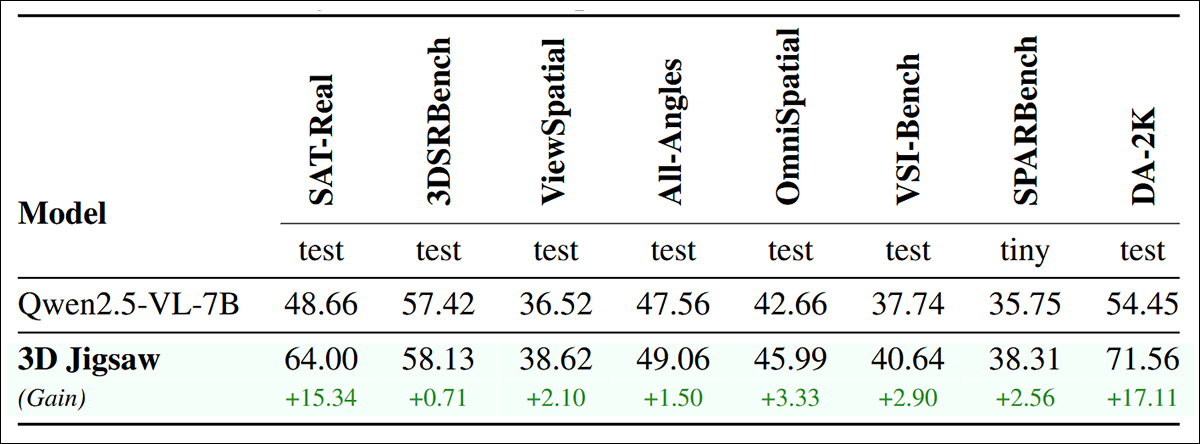

Für die 3D-Modalität wurde das Modell auf SAT-Real; 3DSRBench; ViewSpatial; All-Angles; den oben genannten OmniSpatial; VSI-Bench; SPARBench (klein); und den oben genannten DA-2K getestet.

Bewertungsergebnisse auf 3D-Benchmarks: 3D-Jigsaw verbesserte die Leistung über Tiefen-Vergleichsaufgaben wie DA-2K sowie über umfassendere 3D-Wahrnehmungs-Benchmarks, die Einzelblick-, Mehrblick- und egocentrische Video-Eingaben abdecken.