Künstliche Intelligenz

HD-Painter: High-Resolution-Text-gesteuertes Bild-Inpainting mit Diffusionsmodellen

Diffusionsmodelle haben ohne Zweifel die AI- und ML-Branche revolutioniert, mit Anwendungen in Echtzeit, die zu einem integralen Teil unseres täglichen Lebens geworden sind. Nachdem Text-to-Image-Modelle ihre bemerkenswerten Fähigkeiten gezeigt haben, sind diffusionsbasierte Bildmanipulationstechniken wie kontrollierte Generierung, spezialisierte und personalisierte Bildsynthese, objektorientierte Bildbearbeitung, prompt-konditionierte Variationen und Bearbeitung zu heiß diskutierten Forschungsthemen geworden, aufgrund ihrer Anwendungen in der Computer-Vision-Industrie.

Jedoch haben Text-to-Image-Frameworks, insbesondere Text-to-Image-Inpainting-Frameworks, trotz ihrer beeindruckenden Fähigkeiten und außergewöhnlichen Ergebnissen, immer noch Potenzial für Entwicklung. Dazu gehören die Fähigkeit, globale Szenen zu verstehen, insbesondere wenn das Bild bei hohen Diffusionszeitpunkten geräuschentfernt wird. Um dieses Problem anzugehen, haben Forscher HD-Painter vorgestellt, ein vollständig trainingsfreies Framework, das prompt-Anweisungen genau befolgt und sich auf hochauflösendes Bild-Inpainting ausdehnt. Das HD-Painter-Framework verwendet eine Prompt-Aware-Introverted-Attention-(PAIntA)-Schicht, die prompt-Informationen nutzt, um die Selbstaufmerksamkeitsscores zu verbessern, was zu einer besseren Textausrichtungsgenerierung führt.

Um die Kohärenz des Prompts weiter zu verbessern, führt das HD-Painter-Modell einen Reweighting-Attention-Score-Guidance-(RASG)-Ansatz ein. Dieser Ansatz integriert eine post-hoc-Abstimmungsstrategie nahtlos in die allgemeine Form des DDIM-Komponenten, was verhindert, dass latente Verschiebungen außerhalb der Verteilung auftreten. Darüber hinaus verfügt das HD-Painter-Framework über eine spezielle Super-Auflösungstechnik, die für Inpainting angepasst ist, was es ermöglicht, sich auf größere Skalen auszudehnen und fehlende Regionen im Bild mit einer Auflösung von bis zu 2K zu vervollständigen.

HD-Painter: Text-gesteuertes Bild-Inpainting

Text-to-Image-Diffusionsmodelle sind in den letzten Monaten ein bedeutendes Thema in der AI- und ML-Branche, mit Modellen, die beeindruckende Echtzeitfähigkeiten in verschiedenen praktischen Anwendungen gezeigt haben. Vorgefertigte Text-to-Image-Generierungsmodelle wie DALL-E, Imagen und Stable Diffusion haben ihre Eignung für Bildvervollständigung gezeigt, indem sie die geräuschentfernte (generierte) unbekannte Region mit der diffundierten bekannten Region während des Rückwärtsdiffusionsprozesses verbinden. Trotz der Erzeugung visuell ansprechender und harmonisierter Ausgaben haben bestehende Modelle Schwierigkeiten, die globale Szene zu verstehen, insbesondere unter dem hohen Diffusionszeitpunkt der Rauschentfernung. Durch die Modifizierung vorgefertigter Text-to-Image-Diffusionsmodelle, um zusätzliche Kontextinformationen zu integrieren, können sie für textgesteuertes Bild-Inpainting fein abgestimmt werden.

Darüber hinaus sind textgesteuertes Inpainting und textgesteuertes Bild-Inpainting wichtige Forschungsbereiche, da textgesteuerte Inpainting-Modelle Inhalte in bestimmten Regionen eines Eingabebildes basierend auf textuellen Prompts generieren können, was zu potenziellen Anwendungen wie dem Retuschen spezifischer Bildregionen, der Modifizierung von Subjektattributen wie Farben oder Kleidung und dem Hinzufügen oder Ersetzen von Objekten führen kann. Zusammenfassend haben Text-to-Image-Diffusionsmodelle kürzlich einen beispiellosen Erfolg erzielt, aufgrund ihrer außergewöhnlich realistischen und visuell ansprechenden Generierungsfähigkeiten.

Jedoch zeigen die meisten bestehenden Frameworks eine Prompt-Verachtung in zwei Szenarien. Das erste ist Hintergrund-Dominanz, wenn das Modell die unbekannte Region durch Ignorieren des Prompts im Hintergrund vervollständigt, während das zweite Szenario nahe Objekt-Dominanz ist, wenn das Modell die bekannte Regionen-Objekte in die unbekannte Region überträgt, indem es die visuelle Kontextwahrscheinlichkeit anstelle des Eingabe-Prompts verwendet. Es ist möglich, dass beide Probleme auf die Fähigkeit des Vanilla-Inpainting-Diffusions zurückzuführen sind, den textuellen Prompt genau zu interpretieren oder ihn mit den kontextuellen Informationen aus der bekannten Region zu vermischen.

Um diese Hindernisse zu überwinden, führt das HD-Painter-Framework die Prompt-Aware-Introverted-Attention- oder PAIntA-Schicht ein, die prompt-Informationen verwendet, um die Selbstaufmerksamkeitsscores zu verbessern, was zu einer besseren Textausrichtungsgenerierung führt. PAIntA verwendet die gegebenen textuellen Bedingungen, um die Selbstaufmerksamkeit mit dem Ziel zu verbessern, den Einfluss nicht-prompt-relevanter Informationen aus der Bildregion zu verringern und gleichzeitig den Beitrag der bekannten Pixel, die mit dem Prompt übereinstimmen, zu erhöhen. Um die Textausrichtung der generierten Ergebnisse weiter zu verbessern, implementiert das HD-Painter-Framework eine post-hoc-Steuerungsmethode, die die Kreuzaufmerksamkeitsscores nutzt. Die Implementierung der Vanilla-post-hoc-Steuerungsmechanismen kann jedoch zu einer Verschiebung der latenten Verteilung führen, aufgrund des zusätzlichen Gradiententerms in der Diffusionsgleichung. Die Verschiebung der latenten Verteilung führt letztendlich zu einer Verschlechterung der Qualität des generierten Ausgangs. Um dieses Hindernis zu überwinden, implementiert das HD-Painter-Framework die Reweighting-Attention-Score-Guidance- oder RASG-Methode, die eine post-hoc-Abstimmungsstrategie nahtlos in die allgemeine Form des DDIM-Komponenten integriert. Sie ermöglicht es dem Framework, visuell plausible Inpainting-Ergebnisse zu erzeugen, indem es die Probe auf die prompt-ausgerichteten Latenten lenkt und sie in ihrem trainierten Bereich enthält.

Durch die Implementierung beider RASH- und PAIntA-Komponenten in seiner Architektur hat das HD-Painter-Framework einen signifikanten Vorteil gegenüber bestehenden, einschließlich state-of-the-art-, Inpainting- und Text-to-Image-Diffusionsmodellen, da es das bestehende Problem der Prompt-Verachtung löst. Darüber hinaus bieten beide RASH- und PAIntA-Komponenten eine Plug-and-Play-Funktionalität, die es ihnen ermöglicht, mit diffusionsbasierten Inpainting-Modellen kompatibel zu sein, um die oben genannten Herausforderungen zu meistern. Durch die Implementierung einer zeititerativen Blendetechnologie und die Nutzung der Fähigkeiten von hochauflösenden Diffusionsmodellen kann die HD-Painter-Pipeline effektiv für bis zu 2K-Auflösung-Inpainting betrieben werden.

Zusammenfassend zielt das HD-Painter darauf ab, folgende Beiträge im Bereich zu leisten:

- Es zielt darauf ab, das Problem der Prompt-Verachtung von Hintergrund und nahe Objekte-Dominanz, das von textgesteuerten Bild-Inpainting-Frameworks erlebt wird, durch die Implementierung der Prompt-Aware-Introverted-Attention- oder PAIntA-Schicht in seiner Architektur zu lösen.

- Es zielt darauf ab, die Textausrichtung des Ausgangs durch die Implementierung der Reweighting-Attention-Score-Guidance- oder RASG-Schicht in seiner Architektur zu verbessern, die es dem HD-Painter-Framework ermöglicht, post-hoc-gesteuertes Sampling durchzuführen, während es eine Verschiebung der latenten Verteilung verhindert.

- Es zielt darauf ab, eine effektive trainingsfreie textgesteuerte Bildvollständigungspipeline zu entwerfen, die in der Lage ist, bestehende state-of-the-art-Frameworks zu übertreffen, und die einfache, aber effektive Inpainting-spezifische Super-Auflösungstechnik zu verwenden, um textgesteuertes Bild-Inpainting bis zu einer Auflösung von 2K durchzuführen.

HD-Painter: Methode und Architektur

Bevor wir uns die Architektur ansehen, ist es wichtig, die drei grundlegenden Konzepte zu verstehen, die die Grundlage des HD-Painter-Frameworks bilden: Bild-Inpainting, Post-Hoc-Steuerung in Diffusionsframeworks und Inpainting-spezifische Architekturblöcke.

Bild-Inpainting ist ein Ansatz, der darauf abzielt, die fehlenden Regionen innerhalb eines Bildes zu füllen, während die visuelle Attraktivität des generierten Bildes gewährleistet wird. Traditionelle Deep-Learning-Frameworks haben Methoden implementiert, die bekannte Regionen verwendet haben, um tiefe Merkmale zu übertragen. Die Einführung von Diffusionsmodellen hat jedoch zu einer Evolution von Inpainting-Modellen geführt, insbesondere textgesteuerten Bild-Inpainting-Frameworks. Traditionell ersetzt ein vorgefertigtes Text-to-Image-Diffusionsmodell die unmaskierte Region des Latenten durch die geräuschentfernte Version der bekannten Region während des Sampling-Prozesses. Obwohl dieser Ansatz bis zu einem bestimmten Grad funktioniert, verschlechtert er die Qualität des generierten Ausgangs erheblich, da das Rauschentferungsnetz nur die geräuschentfernte Version der bekannten Region sieht. Um dieses Hindernis zu überwinden, haben einige Ansätze darauf abgezielt, das vorgefertigte Text-to-Image-Modell zu fein abstimmen, um textgesteuertes Bild-Inpainting zu erreichen. Durch die Implementierung dieses Ansatzes kann das Framework ein zufälliges Maskenbild durch Konkatenation erzeugen, da das Modell in der Lage ist, die Rauschentfernung auf die unmaskierte Region zu konditionieren.

Weiterhin haben traditionelle Deep-Learning-Modelle spezielle Designschichten für effizientes Inpainting implementiert, wobei einige Frameworks in der Lage waren, Informationen effektiv zu extrahieren und visuell ansprechende Bilder zu erzeugen, indem sie spezielle Konvolutionslagen einführten, um mit den bekannten Regionen des Bildes umzugehen. Einige Frameworks fügten sogar eine kontextuelle Aufmerksamkeitsschicht in ihre Architektur ein, um die unerwünschten hohen Rechenanforderungen der all-to-all-Selbstaufmerksamkeit für hochwertiges Inpainting zu reduzieren.

Schließlich sind Post-Hoc-Steuerungsmethoden rückwärtsgerichtete Diffusions-Sampling-Methoden, die die nächste Schritt-Latentvorhersage auf ein bestimmtes Funktionsminimierungsziel lenken. Post-Hoc-Steuerungsmethoden sind sehr nützlich, wenn es darum geht, visuellen Inhalt zu erzeugen, insbesondere in der Anwesenheit zusätzlicher Einschränkungen. Allerdings haben Post-Hoc-Steuerungsmethoden einen großen Nachteil: Sie neigen dazu, die Bildqualität zu verschlechtern, da sie den Latentgenerierungsprozess durch einen Gradiententerm verschieben.

Kommen wir zur Architektur des HD-Painter, das Framework formuliert zunächst das textgesteuerte Bildvollständigungsproblem und führt dann zwei Diffusionsmodelle ein, nämlich Stable Inpainting und Stable Diffusion. Das HD-Painter-Modell führt dann die PAIntA- und RASG-Blöcke ein und schließlich kommen wir zur Inpainting-spezifischen Super-Auflösungstechnik.

Stable Diffusion und Stable Inpainting

Stable Diffusion ist ein Diffusionsmodell, das im Latentraum eines Autoencoders operiert. Für Text-to-Image-Synthese implementiert das Stable-Diffusion-Framework einen textuellen Prompt, um den Prozess zu steuern. Die Steuerungsfunktion hat eine Struktur, die der UNet-Architektur ähnelt, und die Kreuzaufmerksamkeitsschichten konditionieren sie auf die textuellen Prompts. Darüber hinaus kann das Stable-Diffusion-Modell Bild-Inpainting durchführen, wenn es modifiziert und fein abgestimmt wird. Um dies zu erreichen, werden die Merkmale des maskierten Bildes, die von dem Encoder erzeugt werden, mit der herunterskalierten binären Maske zu den Latenten konkatiniert. Der resultierende Tensor wird dann in die UNet-Architektur eingegeben, um den geschätzten Rausch zu erhalten. Das Framework initialisiert die neu hinzugefügten konvolutorischen Filter mit Nullen, während der Rest der UNet mit vorgefertigten Checkpoints von dem Stable-Diffusion-Modell initialisiert wird.

Die obige Abbildung zeigt den Überblick über das HD-Painter-Framework, das aus zwei Stufen besteht. In der ersten Stufe implementiert das HD-Painter-Framework textgesteuertes Bild-Inpainting, während in der zweiten Stufe das Modell eine spezifische Super-Auflösung des Ausgangs bildet. Um die fehlenden Regionen zu füllen und konsistent mit dem Eingabeprompt zu bleiben, nimmt das Modell ein vorgefertigtes Inpainting-Diffusionsmodell, ersetzt die Selbstaufmerksamkeitsschichten durch PAIntA-Schichten und implementiert den RASG-Mechanismus, um einen rückwärtsgerichteten Diffusionsprozess durchzuführen. Das Modell decodiert dann den endgültigen geschätzten Latenten, was zu einem inpaintierten Bild führt. HD-Painter implementiert dann das Super-Stable-Diffusion-Modell, um das ursprüngliche Bild in seiner ursprünglichen Größe zu inpainten, und implementiert den rückwärtsgerichteten Diffusionsprozess des Stable-Diffusion-Frameworks, der auf dem niedrigauflösenden Eingabebild konditioniert ist. Das Modell blendet die geräuschentfernten Vorhersagen mit der Kodierung des ursprünglichen Bildes nach jedem Schritt in der bekannten Region und leitet das nächste Latent ab. Schließlich decodiert das Modell das Latent und implementiert Poisson-Blending, um Kantenartefakte zu vermeiden.

Prompt-Aware-Introverted-Attention oder PAIntA

Bestehende Inpainting-Modelle wie Stable Inpainting neigen dazu, mehr auf den visuellen Kontext um die Inpainting-Region herum zu verlassen und die Eingabe-Benutzerprompts zu ignorieren. Basierend auf der Benutzererfahrung kann dieses Problem in zwei Kategorien eingeteilt werden: nahe Objekt-Dominanz und Hintergrund-Dominanz. Das Problem der visuellen Kontext-Dominanz über die Eingabe-Prompts kann auf die nur-räumliche und prompt-freie Natur der Selbstaufmerksamkeitsschichten zurückzuführen sein. Um dieses Problem zu lösen, führt das HD-Painter-Framework die Prompt-Aware-Introverted-Attention oder PAIntA ein, die Kreuzaufmerksamkeitsmatrizen und eine Inpainting-Maske verwendet, um die Ausgabe der Selbstaufmerksamkeitsschichten in der unbekannten Region zu steuern.

Die Prompt-Aware-Introverted-Attention-Komponente wendet zunächst Projektionsschichten an, um Schlüssel, Werte und Abfragen sowie die Ähnlichkeitsmatrix zu erhalten. Das Modell passt dann den Aufmerksamkeitsscore der bekannten Pixel an, um den starken Einfluss der bekannten Region auf die unbekannte Region zu mildern, und definiert eine neue Ähnlichkeitsmatrix, indem es den textuellen Prompt nutzt.

Reweighting-Attention-Score-Guidance oder RASG

Das HD-Painter-Framework übernimmt eine post-hoc-Abstimmungsstrategie, um die Generierungsausrichtung mit den textuellen Prompts weiter zu verbessern. Neben einem Ziel-Funktionsobjekt zielt die post-hoc-Abstimmungsstrategie darauf ab, die offene Vokabular-Segmentierungseigenschaften der Kreuzaufmerksamkeitsschichten zu nutzen. Allerdings hat dieser Ansatz der Vanilla-post-hoc-Steuerung das Potenzial, die Domäne der Diffusionslatenten zu verschieben, was zu einer Verschlechterung der Qualität des generierten Bildes führen kann. Um dieses Problem zu lösen, implementiert das HD-Painter-Modell die Reweighting-Attention-Score-Guidance- oder RASG-Methode, die einen Gradienten-Umgewichtungsmechanismus einführt, der die latente Domäne bewahrt.

HD-Painter: Experimente und Ergebnisse

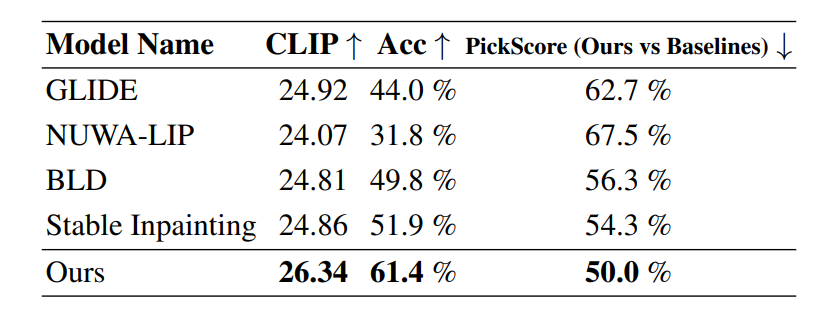

Um seine Leistung zu analysieren, wird das HD-Painter-Framework mit aktuellen state-of-the-art-Modellen wie Stable Inpainting, GLIDE und BLD oder Blended Latent Diffusion über 10.000 zufällige Proben verglichen, wobei der Prompt als Label der ausgewählten Instanzmaske ausgewählt wird.

Wie zu sehen ist, übertrifft das HD-Painter-Framework bestehende Frameworks in drei verschiedenen Metriken um einen signifikanten Betrag, insbesondere die Verbesserung von 1,5 Punkten auf der CLIP-Metrik und die Differenz in der generierten Genauigkeit von etwa 10 % gegenüber anderen state-of-the-art-Methoden.

Weiterhin zeigt die folgende Abbildung den qualitativen Vergleich des HD-Painter-Frameworks mit anderen Inpainting-Frameworks. Wie zu sehen ist, rekonstruieren andere Basismodelle entweder die fehlenden Regionen im Bild als Fortsetzung der bekannten Regionen-Objekte, wobei sie die Prompts ignorieren, oder sie generieren einen Hintergrund. Andererseits kann das HD-Painter-Framework die Zielobjekte erfolgreich generieren, dank der Implementierung der PAIntA- und RASG-Komponenten in seiner Architektur.

Letzte Gedanken

In diesem Artikel haben wir über HD-Painter gesprochen, einen trainingsfreien textgesteuerten hochauflösenden Inpainting-Ansatz, der die Herausforderungen überwindet, die von bestehenden Inpainting-Frameworks erlebt werden, einschließlich Prompt-Verachtung und nahe Objekt-Dominanz. Das HD-Painter-Framework implementiert eine Prompt-Aware-Introverted-Attention- oder PAIntA-Schicht, die prompt-Informationen verwendet, um die Selbstaufmerksamkeitsscores zu verbessern, was zu einer besseren Textausrichtungsgenerierung führt.

Um die Kohärenz des Prompts weiter zu verbessern, führt das HD-Painter-Modell einen Reweighting-Attention-Score-Guidance- oder RASG-Ansatz ein, der eine post-hoc-Abstimmungsstrategie nahtlos in die allgemeine Form des DDIM-Komponenten integriert, um eine Verschiebung der latenten Verteilung zu verhindern. Darüber hinaus führt das HD-Painter-Framework eine spezielle Super-Auflösungstechnik ein, die für Inpainting angepasst ist, was es ermöglicht, sich auf größere Skalen auszudehnen und fehlende Regionen im Bild mit einer Auflösung von bis zu 2K zu vervollständigen.