Künstliche Intelligenz

Google’s LipSync3D bietet verbesserte ‘Deepfaked’ Mundbewegungssynchronisierung

Eine Zusammenarbeit zwischen Google-KI-Forschern und dem Indian Institute of Technology Kharagpur bietet ein neues Framework, um sprechende Köpfe aus Audioinhalten zu synthesieren. Das Projekt zielt darauf ab, optimierte und vernünftig ressourcenschonende Wege zu finden, um ‘sprechende Kopf’-Videoinhalte aus Audio zu erstellen, um die Lippenbewegungen mit vertontem oder maschinell übersetztem Audio zu synchronisieren und für Avatare, interaktive Anwendungen und andere Echtzeitumgebungen zu verwenden.

Quelle: https://www.youtube.com/watch?v=L1StbX9OznY

Die im Prozess trainierten Machine-Learning-Modelle – genannt LipSync3D – benötigen nur ein einziges Video der Zielgesichtsidentität als Eingabedaten. Die Datenbereitungs-Pipeline trennt die Extraktion der Gesichtsgeometrie von der Bewertung der Beleuchtung und anderer Aspekte eines Eingabevideos, was eine wirtschaftlichere und fokussiertere Ausbildung ermöglicht.

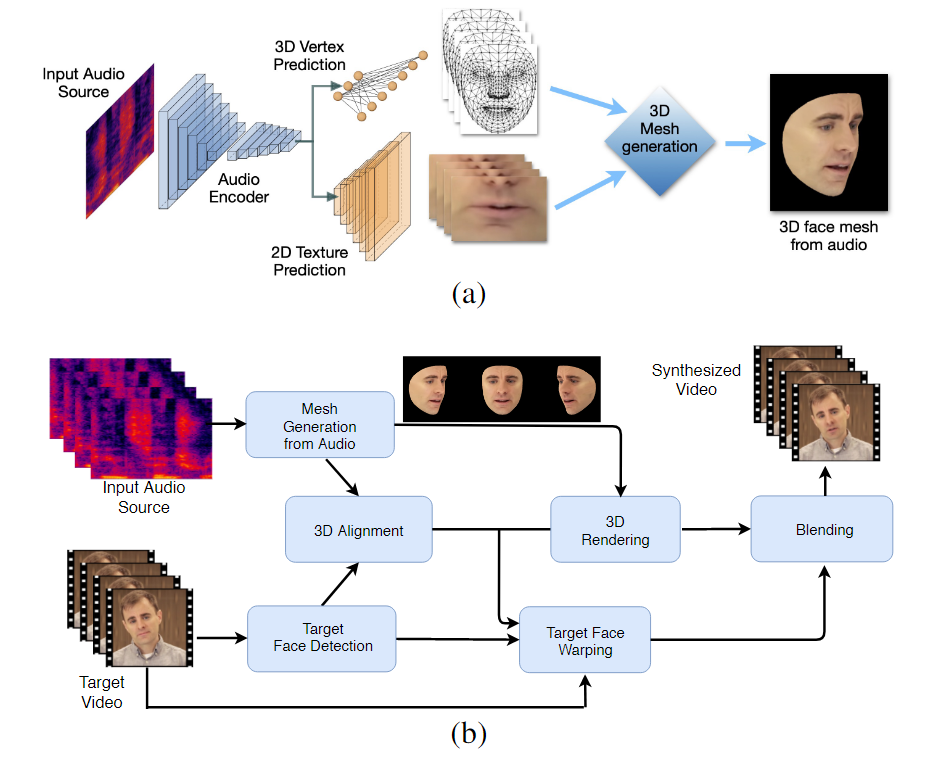

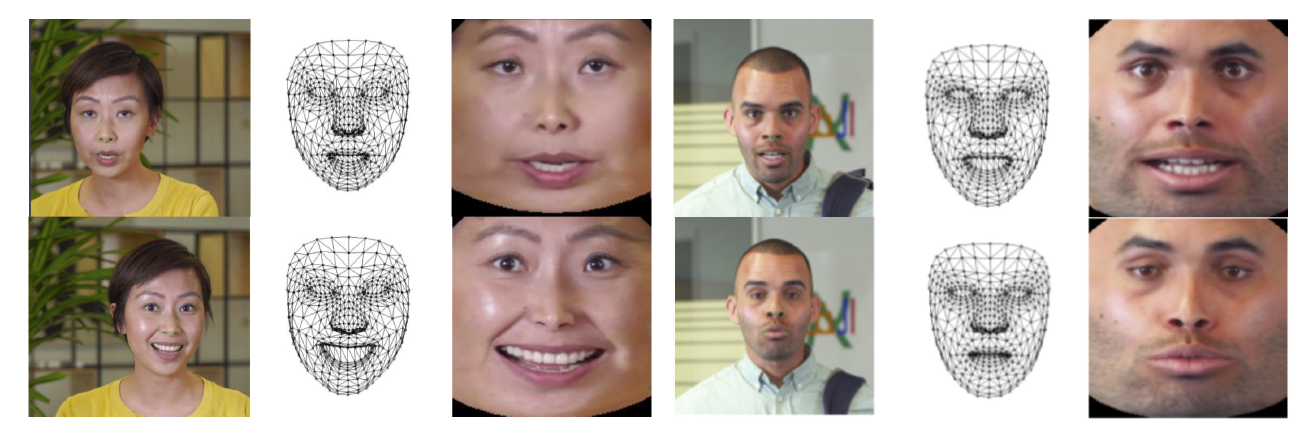

Die zweistufige Arbeitsabfolge von LipSync3D. Oben, die Erzeugung eines dynamisch texturierten 3D-Gesichts aus dem ‘Ziel’-Audio; unten, die Einfügung des erzeugten Meshes in ein Zielvideo.

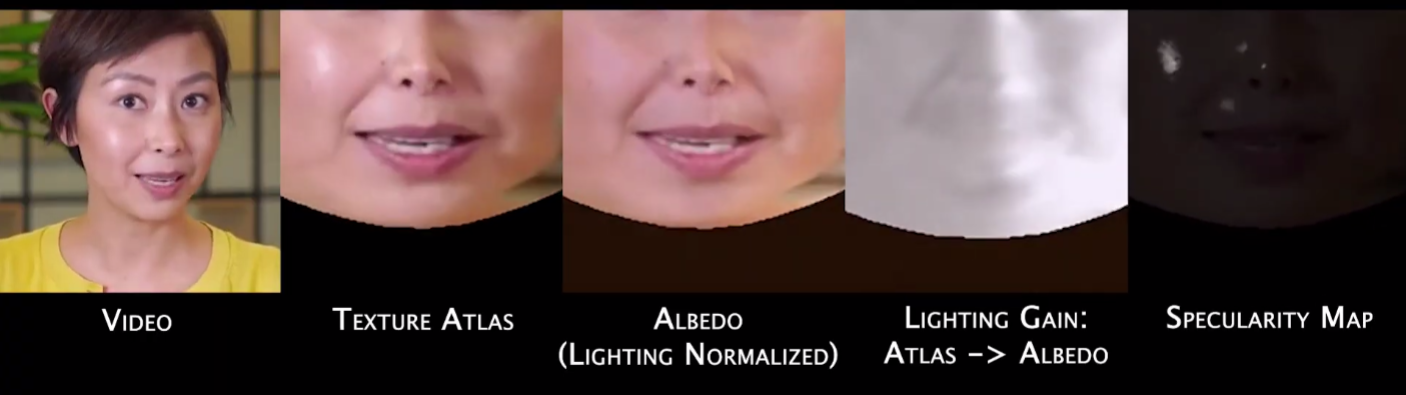

Tatsächlich ist LipSync3Ds bemerkenswerter Beitrag zum Forschungsbestreben in diesem Bereich möglicherweise sein Beleuchtungsnormierungs-Algorithmus, der die Ausbildung und Inferenzbeleuchtung entkoppelt.

Die Entkopplung der Beleuchtungsdaten von der allgemeinen Geometrie hilft LipSync3D, realistischere Lippenbewegungsausgaben unter herausfordernden Bedingungen zu erzeugen. Andere Ansätze der letzten Jahre haben sich auf ‘feste’ Beleuchtungsbedingungen beschränkt, die ihre begrenztere Kapazität in dieser Hinsicht nicht offenbaren.

Während der Vorverarbeitung der Eingabedatenframes muss das System spezifische Punkte identifizieren und entfernen, da diese spezifisch für die Beleuchtungsbedingungen sind, unter denen das Video aufgenommen wurde, und sonst den Prozess der Neubeleuchtung stören würden.

LipSync3D, wie der Name schon sagt, führt keine bloße Pixelanalyse auf den Gesichtern durch, die es auswertet, sondern nutzt aktiv identifizierte Gesichtsmerkmale, um motile CGI-ähnliche Meshes zu erzeugen, zusammen mit den ‘entfalteten’ Texturen, die in einer traditionellen CGI-Pipeline um sie herum gewickelt werden.

Posenormierung in LipSync3D. Links sind die Eingabeframes und detektierten Merkmale; in der Mitte, die normalisierten Vertices der erzeugten Meshauswertung; und rechts, die entsprechende Texturen-Atlas, der die Grundwahrheit für die Texturvorhersage liefert. Quelle: https://arxiv.org/pdf/2106.04185.pdf

Neben dem neuen Beleuchtungsmethode behaupten die Forscher, dass LipSync3D drei Hauptinnovationen gegenüber früheren Arbeiten bietet: die Trennung von Geometrie, Beleuchtung, Pose und Textur in separate Datenströme in einem normalisierten Raum; ein leicht trainierbares auto-regressives Texturvorhersagemodell, das temporär konsistente Video-Synthese erzeugt; und erhöhte Realistik, wie durch menschliche Bewertungen und objektive Metriken bewertet.

Das Aufteilen der verschiedenen Aspekte der Video-Gesichtsbilder ermöglicht eine größere Kontrolle bei der Video-Synthese.

LipSync3D kann angemessene Lippengeometriebewegungen direkt aus Audio analysieren, indem es Phoneme und andere Aspekte der Sprache analysiert und sie in bekannte entsprechende Muskelposen um den Mundbereich übersetzt.

Dieser Prozess verwendet eine gemeinsame Vorhersage-Pipeline, bei der die abgeleitete Geometrie und Textur dedizierte Encoder in einem Autoencoder-Setup haben, aber einen Audio-Encoder mit der Sprache teilen, die auf das Modell aufgebracht werden soll:

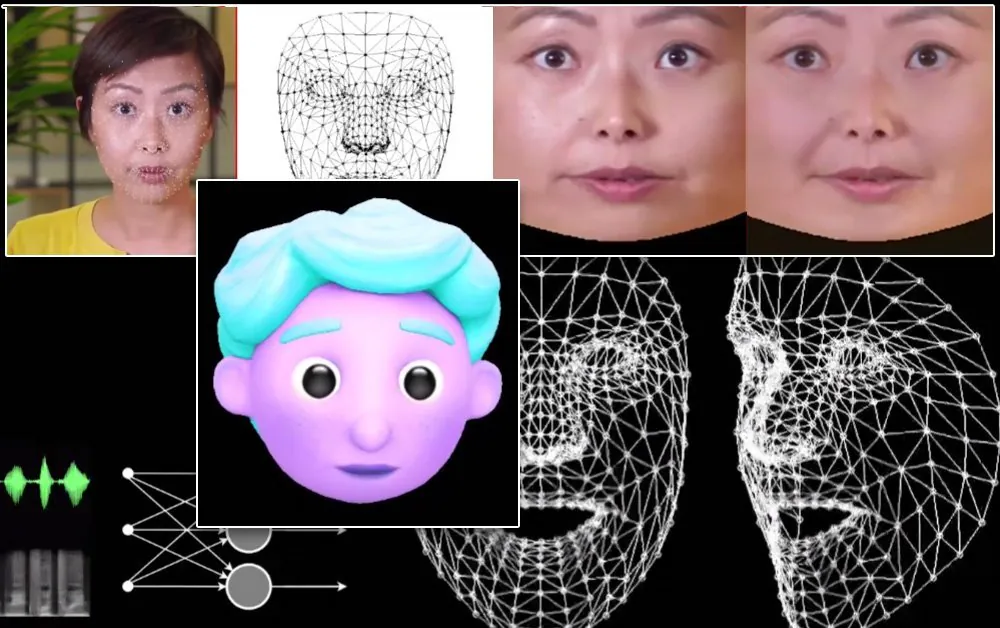

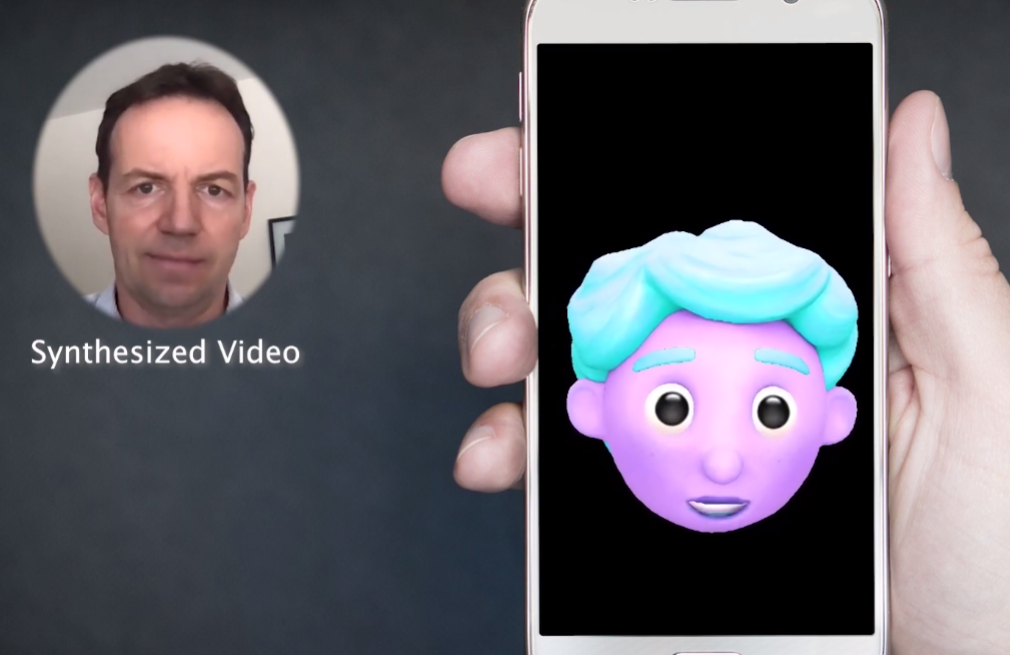

LipSync3Ds labile Bewegungssynthese soll auch stilisierte CGI-Avatare mit Energie versorgen, die im Grunde nur die gleiche Art von Mesh- und Texturinformationen wie reale Bilder sind:

Ein stilisierter 3D-Avatar hat seine Lippenbewegungen in Echtzeit von einem Quell-Sprecher-Video angetrieben. In einem solchen Szenario würden die besten Ergebnisse durch personalisierte Vorverarbeitung erzielt.

Die Forscher erwarten auch die Verwendung von Avataren mit einem etwas realistischeren Gefühl:

![]()

Beispiel-Trainingszeiten für die Videos reichen von 3-5 Stunden für ein 2-5-minütiges Video, in einer Pipeline, die TensorFlow, Python und C++ auf einem GeForce GTX 1080 verwendet. Die Trainings-Sitzungen verwendeten eine Batch-Größe von 128 Frames über 500-1000 Epochen, wobei jede Epoche eine vollständige Auswertung des Videos darstellt.

Richtung Dynamische Re-Synchronisierung von Lippenbewegungen

Das Feld der Re-Synchronisierung von Lippen, um einen neuen Audio-Track zu ermöglichen, hat in den letzten Jahren in der Computer-Vision-Forschung viel Aufmerksamkeit erhalten (siehe unten), nicht zuletzt als es ein Nebenprodukt der umstrittenen Deepfake-Technologie ist.

Im Jahr 2017 stellte die University of Washington Forschung vor, die in der Lage war, Lippen-Synchronisierung aus Audio zu lernen und sie verwendet, um die Lippenbewegungen des damaligen Präsidenten Obama zu ändern. Im Jahr 2018 leitete das Max-Planck-Institut für Informatik ein anderes Forschungsinitiative, um die Identität-zu-Identität-Video-Übertragung zu ermöglichen, wobei die Lippen-Synchronisierung ein Nebenprodukt des Prozesses war; und im Mai 2021 enthüllte das KI-Startup FlawlessAI seine eigene Lippen-Synchronisierungstechnologie TrueSync, die weithin in der Presse als eine Möglichkeit zur Verbesserung der Synchronisierungstechnologie für große Filmveröffentlichungen in verschiedenen Sprachen anerkannt wurde.

Und natürlich bietet die laufende Entwicklung von Deepfake-Open-Source-Repositorys einen weiteren Zweig der aktiven Benutzer-Beitrags-Forschung in diesem Bereich der Gesichtsbild-Synthese.