Künstliche Intelligenz

Von Silber zu Gold: Wie DeepMinds KI die Mathematik-Olympiade eroberte

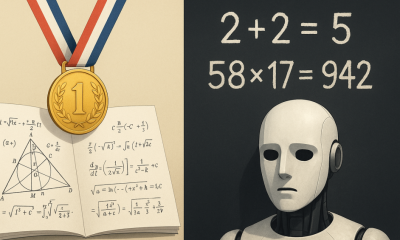

DeepMinds KI hat innerhalb von nur einem Jahr bemerkenswerte Fortschritte in der mathematischen Argumentation gemacht. Nachdem sie 2024 eine Silbermedaille bei der Internationalen Mathematik-Olympiade (IMO) gewonnen hatte, gewann ihr KI-System 2025 die Goldmedaille. Diese schnelle Verbesserung unterstreicht die wachsenden Fähigkeiten der künstlichen Intelligenz bei der Bewältigung komplexer, abstrakter Probleme, die menschliche Kreativität und Einsicht erfordern. Dieser Artikel wird zeigen, wie DeepMind diese Transformation erreicht hat, die technischen und strategischen Entscheidungen, die dahinter stecken, und die breiteren Auswirkungen dieser Fortschritte.

Die Bedeutung der IMO

Die Internationale Mathematik-Olympiade, die 1959 gegründet wurde, wird weltweit als der wichtigste Mathematikwettbewerb für Schüler anerkannt. Jedes Jahr stehen die besten Schüler aus der ganzen Welt sechs herausfordernden Problemen in Algebra, Geometrie, Zahlentheorie und Kombinatorik gegenüber. Das Lösen dieser Probleme erfordert viel mehr als nur Berechnungen; die Teilnehmer müssen echte mathematische Kreativität, strenge logisches Denken und die Fähigkeit, elegante Beweise zu konstruieren, zeigen.

Für die künstliche Intelligenz stellt die IMO eine einzigartige Herausforderung dar. Während die KI Mustererkennung, Datenanalyse und sogar komplexe Spiele wie Go und Schach beherrscht, erfordert die Mathematik-Olympiade kreative, abstrakte Argumentation und die Synthese neuer Ideen, Fähigkeiten, die traditionell als Merkmale der menschlichen Intelligenz gelten. Daher ist die IMO zu einem natürlichen Testfeld für die Bewertung der Fähigkeiten der KI geworden, um wirklich menschliche Argumentation zu erreichen.

Der Silbermedaillen-Durchbruch von 2024

2024 stellte DeepMind zwei KI-Systeme vor, um IMO-niveau-Probleme zu lösen: AlphaProof und AlphaGeometry 2. Beide Systeme sind Beispiele für “neuro-symbolische” KI, die die Stärken von großen Sprachmodellen (LLM) mit der Strenge der symbolischen Logik kombinieren.

AlphaProof wurde entwickelt, um mathematische Aussagen mit Lean, einer formalen mathematischen Sprache, zu beweisen. Es kombinierte Gemini, DeepMinds großes Sprachmodell, mit AlphaZero, einem Verstärkungslernalgorithmus, der für seine Erfolge in Brettspielen bekannt ist. In diesem Setting war die Rolle von Gemini, natürliche Sprachprobleme in Lean zu übersetzen und Beweise durch die Generierung logischer Schritte zu versuchen. AlphaProof wurde auf Millionen von Beispielen aus verschiedenen mathematischen Disziplinen und Schwierigkeitsgraden trainiert. Das System verbesserte sich selbst, indem es versuchte, zunehmend komplexere Aussagen zu beweisen, ähnlich wie AlphaZero durch das Spielen gegen sich selbst gelernt hat.

AlphaGeometry 2 wurde entwickelt, um Geometrieprobleme zu lösen. Hier ermöglichte Geminis Sprachverständnis dem KI-System, hilfreiche Hilfskonstruktionen vorherzusagen, während ein symbolischer Argumentationsmotor die logischen Deduktionen verwaltete. Dieser hybride Ansatz ermöglichte es AlphaGeometry, Geometrieprobleme zu lösen, die weit über den Bereich der traditionellen maschinellen Argumentation hinausgingen.

Zusammen lösten diese Systeme vier von sechs IMO-Problemen: zwei in Algebra, eines in Zahlentheorie und eines in Geometrie, und erreichten eine Punktzahl von 28 von 42. Diese Leistung war ein bedeutender Meilenstein, da es das erste Mal war, dass eine KI die Silbermedaillen-Stufe bei der IMO erreicht hatte. Allerdings basierte dieser Erfolg stark auf menschlichen Experten, die Probleme in formale mathematische Sprachen übersetzten. Sie erforderten auch massive Rechenressourcen, die Tage der Verarbeitungszeit für jedes Problem benötigten.

Technische Innovationen hinter der Goldmedaille

DeepMinds Übergang von einer Silber- zu einer Goldmedaillen-Leistung wurde durch mehrere bedeutende technische Verbesserungen angetrieben.

1. Natürliche Sprache als Medium für Beweise

Die bedeutendste Änderung bestand darin, von Systemen, die Expertenübersetzungen in formale Sprachen erforderten, zu Systemen überzugehen, die natürliche Sprache als Medium für Beweise behandelten. Diese Verschiebung wurde durch eine verbesserte Version von Gemini mit Deep-Think-Fähigkeiten erreicht. Anstatt Probleme in Lean zu übersetzen, verarbeitet das Modell den Text direkt, generiert informelle Skizzen, formalisiert interne kritische Schritte und produziert einen verfeinerten englischen Beweis. Verstärkendes Lernen aus menschlichem Feedback (RLHF) wurde verwendet, um Lösungen zu belohnen, die logisch konsistent, knapp und präsentabel waren.

Gemini Deep Think unterscheidet sich von der öffentlichen Version von Gemini in zwei Hauptaspekten. Erstens weist es längere Kontextfenster und mehr Rechentoken pro Abfrage zu, was es dem Modell ermöglicht, mehrseitige Ketten von Gedanken zu verfolgen. Zweitens verwendet es paralleles Argumentieren, bei dem hundreds von spekulativen Threads für unterschiedliche potenzielle Lösungen generiert werden. Ein leichter Supervisor bewertet und fördert dann die vielversprechendsten Pfade, indem er Konzepte aus Monte-Carlo-Baum-Suche übernimmt, aber auf Text anwendet. Dieser Ansatz ahmt die Art und Weise nach, wie menschliche Teams brainstormen, unproduktive Ideen verwerfen und auf elegante Lösungen konvergieren.

2. Training und Verstärkendes Lernen

Das Training von Gemini Deep Think umfasste die Feinabstimmung des Modells, um nächste Schritte vorherzusagen, anstatt endgültige Antworten. Zu diesem Zweck wurde ein Korpus von 100.000 hochwertigen Olympiad- und Untergraduierten-Wettbewerbslösungen zusammengestellt. Der Korpus wurde hauptsächlich aus öffentlichen Mathematik-Foren, arXiv-Preprints und College-Problem-Sets gesammelt. Menschliche Mentoren überprüften Trainingsbeispiele, um illogische oder unvollständige Beweise zu filtern. Verstärkendes Lernen half, das Modell zu verfeinern, indem es darauf hingewiesen wurde, präzise und genaue Beweise zu produzieren. Frühe Versionen produzierten übermäßig verbale Beweise, aber Strafen für redundante Phrasen halfen, die Ausgabe zu beschneiden.

Anders als herkömmliches Feinabstimmung, das oft mit sparsamen Belohnungen zu kämpfen hat, wo das Feedback binär ist, entweder der Beweis korrekt ist oder nicht. DeepMind implementierte ein schrittweises Belohnungssystem, bei dem jeder verifizierte Sub-Lemma zum Gesamtpunktestand beitrug. Dieses Belohnungssystem leitet Gemini sogar dann, wenn ein vollständiger Beweis selten ist. Der Trainingsprozess dauerte drei Monate und nutzte etwa 25 Millionen TPU-Stunden.

3. Massive Parallelisierung

Parallelisierung spielte auch eine entscheidende Rolle bei DeepMinds Fortschritt von Silber zu Gold. Jedes Problem generierte mehrere Argumentationszweige in Parallel, wobei Ressourcen dynamisch auf vielversprechendere Wege umgeschaltet wurden, wenn andere ins Stocken gerieten. Diese dynamische Planung war besonders vorteilhaft für Kombinatorikprobleme, die große Lösungsräume haben. Der Ansatz ist ähnlich wie bei Menschen, die vor der Durchführung einer vollständigen Induktion Hilfsungleichungen testen. Obwohl diese Technik rechenintensiv war, war sie mit DeepMinds TPU-v5-Clustern machbar.

DeepMind bei der IMO 2025

Um die Integrität des Wettbewerbs zu wahren, fror DeepMind die Gewichte des Modells drei Wochen vor der IMO ein, um zu verhindern, dass offizielle Probleme in den Trainingsdatensatz gelangen. Sie filterten auch Daten heraus, die Lösungen für zuvor unveröffentlichte Olympiad-Fragen enthielten.

Während des Wettbewerbs erhielt Gemini Deep Think die sechs offiziellen Probleme im Klartext-Format, ohne Zugang zum Internet. Das System operierte auf einem Cluster, der auf die Rechenleistung eines Standard-Laptops pro Prozess konfiguriert war. Der gesamte Problemlösungsprozess wurde in weniger als drei Stunden abgeschlossen, innerhalb der Zeitbegrenzung. Die generierten Beweise wurden den IMO-Koordinatoren ohne Änderungen vorgelegt.

Gemini Deep Think erzielte perfekte Punktzahlen bei den ersten fünf Problemen. Die letzte Frage, die ein herausforderndes Kombinatorik-Rätsel war, überforderte jedoch sowohl die KI als auch 94 % der menschlichen Teilnehmer. Trotzdem beendete die KI den Wettbewerb mit einer Gesamtpunktzahl von 35/42 und sicherte sich eine Goldmedaille. Diese Punktzahl war sieben Punkte höher als die Silbermedaillen-Leistung des Vorjahres. Beobachter beschrieben die Beweise der KI später als “gründlich” und “vollständig”, indem sie feststellten, dass sie den strengen Rechtfertigungen entsprachen, die von menschlichen Teilnehmern erwartet wurden.

Auswirkungen für KI und Mathematik

DeepMinds Erfolg ist ein bedeutender Meilenstein für sowohl KI als auch Mathematik. Für die KI ist das Beherrschen der IMO ein Schritt in Richtung künstlicher allgemeiner Intelligenz (AGI), bei der Systeme jede intellektuelle Aufgabe ausführen können, die ein Mensch kann. Das Lösen komplexer mathematischer Probleme erfordert Argumentation und Verständnis, die grundlegende Bestandteile der allgemeinen Intelligenz sind. Dieser Erfolg zeigt, dass die KI Fortschritte in Richtung menschlicher kognitiver Fähigkeiten macht.

Für die Mathematik können KI-Systeme wie Gemini Deep Think wertvolle Werkzeuge für Mathematiker werden. Sie können bei der Erforschung neuer Bereiche, der Überprüfung von Vermutungen und sogar der Entdeckung neuer Theoreme helfen. Indem die KI die mehr mühsamen Aspekte der Beweiskonstruktion automatisiert, befreit sie menschliche Mathematiker, um sich auf höhere konzeptionelle Arbeiten zu konzentrieren. Darüber hinaus könnten die für diese KI-Systeme entwickelten Techniken neue Methoden in der mathematischen Forschung inspirieren, die möglicherweise nicht durch menschliche Anstrengungen allein möglich sind.

Allerdings wirft der Fortschritt der KI in der Mathematik auch Fragen über die Rolle der KI in Bildungseinrichtungen und Wettbewerben auf. Wenn die Fähigkeiten der KI weiter wachsen, wird es Debatten über die Art und Weise geben, wie die Beteiligung der KI die Natur der mathematischen Bildung und des Wettbewerbs verändern könnte.

Ausblick

Der Gewinn der IMO-Goldmedaille ist ein bedeutender Meilenstein, aber viele mathematische Herausforderungen bleiben für aktuelle KI-Systeme unerreichbar. Allerdings unterstreicht der schnelle Fortschritt von Silber zu Gold in nur einem Jahr das beschleunigte Tempo der KI-Innovationen und -Entwicklungen. Wenn dieser Trend anhält, könnten KI-Systeme bald einige der berühmtesten ungelösten mathematischen Probleme angehen. Während die Frage, ob die KI menschliche Kreativität ersetzen oder verbessern wird, ungeklärt bleibt, ist die IMO 2025 ein klarer Hinweis darauf, dass die künstliche Intelligenz bedeutende Fortschritte in der logischen Argumentation gemacht hat.