Andersons Blickwinkel

Behebung des begrenzten Verständnisses von Spiegeln und Reflexionen in Diffusionsmodellen

Seitdem generative KI das öffentliche Interesse weckt, hat sich das Interesse an der Entwicklung von KI-Modellen im Bereich der Computervision vertieft, die physikalische Gesetze verstehen und replizieren können. Die Herausforderung, maschinellen Lernsystemen beizubringen, Phänomene wie Schwerkraft und Flüssigkeitsdynamik war zumindest in den letzten letzten fünf Jahren.

Da latente Diffusionsmodelle (LDMs) dominierten 2022 die generative KI-Szene, Forscher haben zunehmend fokussiert auf die begrenzte Fähigkeit der LDM-Architektur, physikalische Phänomene zu verstehen und zu reproduzieren. Dieses Problem hat nun mit der bahnbrechenden Entwicklung des generativen Videomodells von OpenAI zusätzliche Bedeutung gewonnen sora, und die (wohl) folgenreichere jüngste Veröffentlichung der Open Source Video für Hunyuan-Video und Wan 2.1.

Schlechtes Spiegelbild

Die meisten Forschungsarbeiten zur Verbesserung des physikalischen Verständnisses von LDM konzentrierten sich auf Bereiche wie Gangsimulation, Teilchenphysik und andere Aspekte der Newtonschen Bewegung. Diese Bereiche erregten Aufmerksamkeit, da Ungenauigkeiten im grundlegenden physikalischen Verhalten die Authentizität von KI-generierten Videos unmittelbar beeinträchtigen würden.

Ein kleiner, aber wachsender Forschungszweig konzentriert sich jedoch auf eine der größten Schwächen von LDM – es ist relative Unfähigkeit um genaue Reflexionen.

Aus dem im Januar 2025 erschienenen Artikel „Reflecting Reality: Enabling Diffusion Models to Produce Faithful Mirror Reflections“: Beispiele für „Reflexionsfehler“ im Vergleich zum eigenen Ansatz der Forscher. Quelle: https://arxiv.org/pdf/2409.14677

Dieses Problem war auch in der CGI-Ära eine Herausforderung und ist es auch weiterhin im Bereich der Videospiele, wo Ray-Tracing Algorithmen simulieren den Lichtverlauf bei der Interaktion mit Oberflächen. Raytracing berechnet, wie virtuelle Lichtstrahlen von Objekten abprallen oder diese durchdringen, um realistische Reflexionen, Brechungen und Schatten zu erzeugen.

Da jedoch jeder zusätzliche Abprall den Rechenaufwand erheblich erhöht, müssen Echtzeitanwendungen einen Kompromiss zwischen Latenz und Genauigkeit eingehen, indem sie die Anzahl der zulässigen Lichtstrahlabpraller begrenzen.

![Eine Darstellung eines virtuell berechneten Lichtstrahls in einem traditionellen 3D-basierten (d. h. CGI-)Szenario unter Verwendung von Technologien und Prinzipien, die erstmals in den 1960er Jahren entwickelt wurden und zwischen 1982 und 93 (der Zeitspanne zwischen Tron [1982] und Jurassic Park [1993]) ihren Höhepunkt erreichten. Quelle: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing](https://www.unite.ai/wp-content/uploads/2025/04/ray-tracing.jpg)

Eine Darstellung eines virtuell berechneten Lichtstrahls in einem traditionellen 3D-basierten (d. h. CGI-)Szenario unter Verwendung von Technologien und Prinzipien, die erstmals in den 1960er Jahren entwickelt wurden und zwischen 1982 und 93 (der Zeitspanne zwischen „Tron“ [1982] und „Jurassic Park“ [1993]) ihren Durchbruch erlebten. Quelle: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing

Die Darstellung einer verchromten Teekanne vor einem Spiegel könnte beispielsweise einen Raytracing-Prozess beinhalten, bei dem Lichtstrahlen wiederholt zwischen reflektierenden Oberflächen hin- und herspringen und so eine nahezu unendliche Schleife erzeugen, die kaum einen praktischen Nutzen für das endgültige Bild bringt. In den meisten Fällen übersteigt bereits eine Reflexionstiefe von zwei bis drei Reflexionen die Wahrnehmung des Betrachters. Eine einzige Reflexion würde einen schwarzen Spiegel ergeben, da das Licht mindestens zwei Wege zurücklegen muss, um eine sichtbare Reflexion zu erzeugen.

Jeder zusätzliche Sprung erhöht den Rechenaufwand drastisch und verdoppelt oft die Renderzeiten, was eine schnellere Verarbeitung von Reflexionen ermöglicht. eine der bedeutendsten Möglichkeiten zur Verbesserung der Raytracing-Rendering-Qualität.

Natürlich treten Reflexionen auch in weit weniger offensichtlichen Szenarien auf und sind für den Fotorealismus unerlässlich – etwa auf der spiegelnden Oberfläche einer Stadtstraße oder eines Schlachtfelds nach dem Regen, der Spiegelung der gegenüberliegenden Straße in einem Schaufenster oder einer Glastür oder in den Brillengläsern abgebildeter Personen, wo Objekte und Umgebungen erscheinen müssen.

Eine simulierte Doppelreflexion, die durch traditionelles Compositing für eine Kultszene in „Matrix“ (1999) erreicht wurde.

Bildprobleme

Aus diesem Grund wurden Frameworks, die vor dem Aufkommen von Diffusionsmodellen beliebt waren, wie z. B. Neuronale Strahlungsfelder (NeRF) und einige neuere Herausforderer wie Gaußsches Splatting haben ihre eigenen Bemühungen fortgesetzt, Reflexionen auf natürliche Weise zu gestalten.

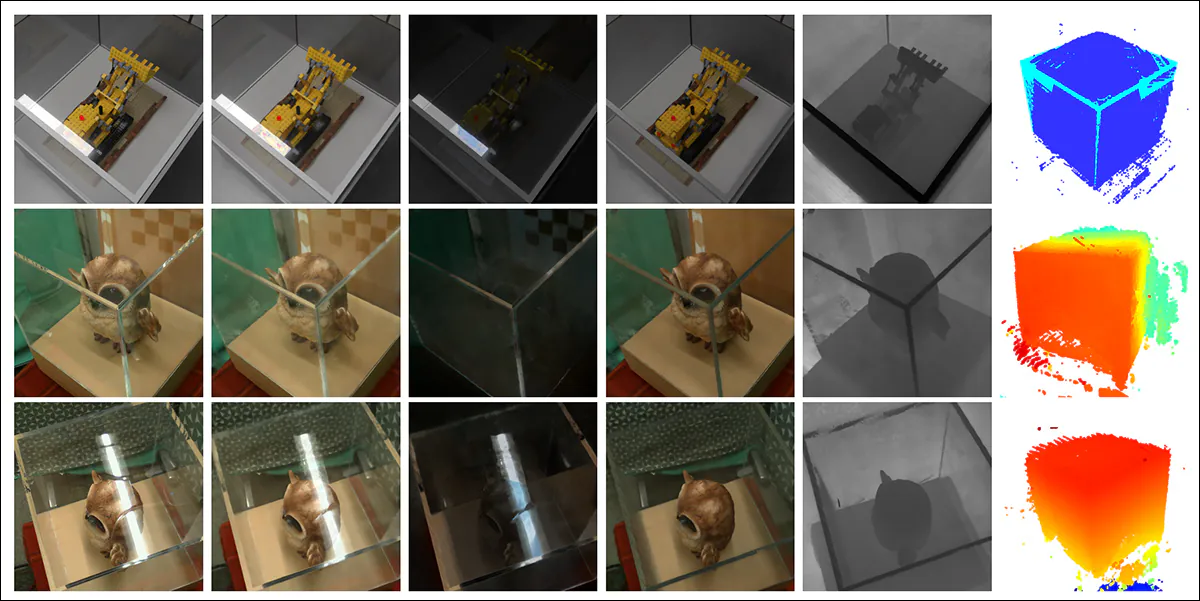

Die REF2-Nerf Das Projekt (siehe Abbildung unten) schlug eine NeRF-basierte Modellierungsmethode für Szenen mit einer Glasvitrine vor. Dabei wurden Brechung und Reflexion mithilfe von Elementen modelliert, die von der Perspektive des Betrachters abhängig und unabhängig waren. Dieser Ansatz ermöglichte es den Forschern, die Oberflächen, an denen Brechung auftrat, insbesondere Glasoberflächen, abzuschätzen und sowohl direkte als auch reflektierte Lichtanteile zu trennen und zu modellieren.

Beispiele aus dem Ref2Nerf-Papier. Quelle: https://arxiv.org/pdf/2311.17116

Weitere NeRF-Reflexionslösungen der letzten 4-5 Jahre umfassten NeRFReN, Die Realität widerspiegelnund Metas 2024 Planare reflexionsbewusste neuronale Strahlungsfelder Projekt.

Für GSplat wurden Papiere wie Spiegel-3DGS, Reflektierendes Gaußsches Spritzenund RefGaussian haben Lösungen für das Reflexionsproblem angeboten, während die 2023 Nero-Projekt schlug eine maßgeschneiderte Methode zur Einbeziehung reflektierender Eigenschaften in neuronale Repräsentationen vor.

MirrorVerse

Ein Diffusionsmodell so zu gestalten, dass es die Reflexionslogik berücksichtigt, ist vermutlich schwieriger als bei explizit strukturellen, nicht-semantischen Ansätzen wie Gaussian Splatting und NeRF. In Diffusionsmodellen lässt sich eine solche Regel wahrscheinlich nur dann zuverlässig einbetten, wenn die Trainingsdaten viele unterschiedliche Beispiele aus einem breiten Spektrum von Szenarien enthalten. Dies macht sie stark abhängig von der Verteilung und Qualität des ursprünglichen Datensatzes.

Traditionell ist das Hinzufügen bestimmter Verhaltensweisen dieser Art die Aufgabe eines LoRA oder unter der Feintuning des Basismodells; aber das sind keine idealen Lösungen, da ein LoRA dazu neigt, die Ausgabe in Richtung seiner eigenen Trainingsdaten zu verzerren, auch ohne Aufforderung, während Feinabstimmungen – abgesehen davon, dass sie teuer sind – ein Hauptmodell unwiderruflich vom Mainstream abbringen und eine Vielzahl damit verbundener benutzerdefinierter Tools erzeugen können, die niemals mit irgendeinem Andere Belastung des Modells, einschließlich des Originals.

Generell erfordert die Verbesserung von Diffusionsmodellen, dass die Trainingsdaten die Physik der Reflexion stärker berücksichtigen. Viele andere Bereiche benötigen jedoch ebenfalls besondere Aufmerksamkeit. Im Kontext von Hyperscale-Datensätzen, deren individuelle Kuratierung kostspielig und schwierig ist, ist es unpraktisch, jede einzelne Schwachstelle auf diese Weise zu beheben.

Dennoch tauchen immer wieder Lösungen für das LDM-Reflexionsproblem auf. Ein neuerer Ansatz aus Indien ist die MirrorVerse Projekt, das einen verbesserten Datensatz und eine Trainingsmethode bietet, die in der Lage sind, den Stand der Technik bei dieser besonderen Herausforderung in der Diffusionsforschung zu verbessern.

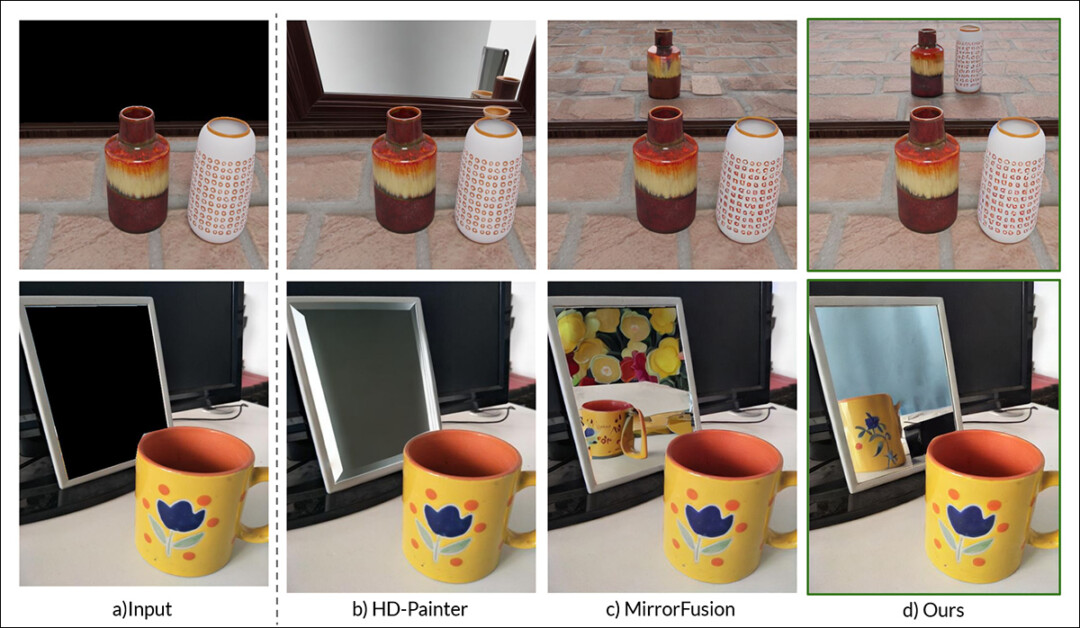

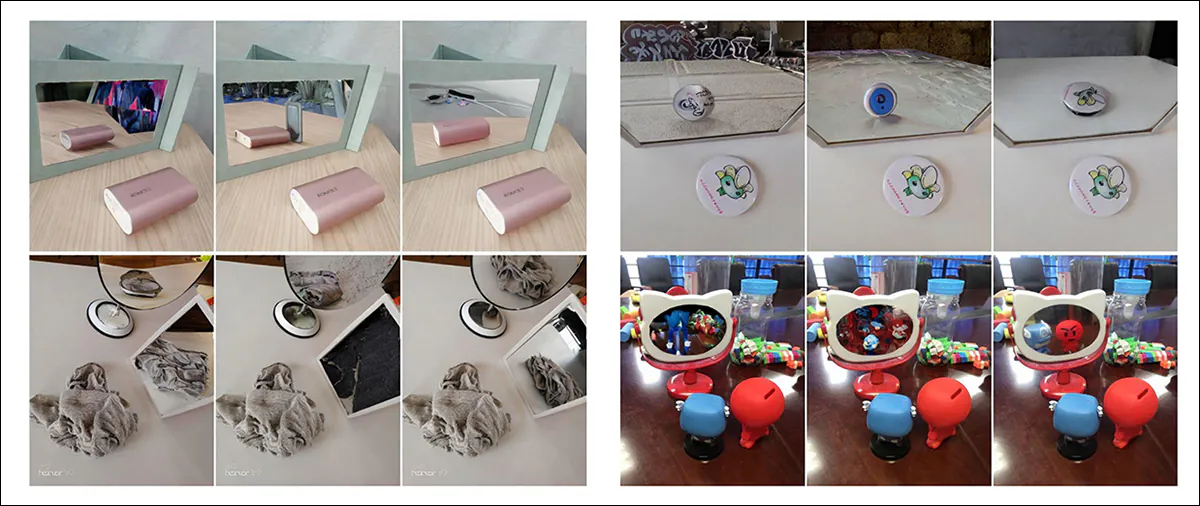

Ganz rechts werden die Ergebnisse von MirrorVerse zwei früheren Ansätzen gegenübergestellt (die beiden mittleren Spalten). Quelle: https://arxiv.org/pdf/2504.15397

Wie wir im obigen Beispiel (dem Titelbild im PDF der neuen Studie) sehen können, stellt MirrorVerse eine Verbesserung gegenüber aktuellen Angeboten dar, die das gleiche Problem angehen, ist aber bei weitem nicht perfekt.

Im oberen rechten Bild sehen wir, dass die Keramikgefäße etwas weiter rechts stehen als sie sollten, und im Bild unten, das technisch gesehen überhaupt keine Spiegelung der Tasse zeigen sollte, wurde entgegen der Logik natürlicher Spiegelungswinkel eine ungenaue Spiegelung in den rechten Bereich hineingezwängt.

Wir werden uns die neue Methode daher nicht so sehr ansehen, weil sie den aktuellen Stand der Technik im Bereich der diffusionsbasierten Reflexion darstellt, sondern vielmehr, um zu veranschaulichen, inwieweit sich dies als unlösbares Problem für latente Diffusionsmodelle – sowohl statische als auch Videomodelle – erweisen könnte, da die erforderlichen Datenbeispiele für die Reflektivität höchstwahrscheinlich mit bestimmten Aktionen und Szenarien verknüpft sind.

Daher bleibt diese spezielle Funktion von LDMs möglicherweise weiterhin hinter strukturspezifischen Ansätzen wie NeRF, GSplat und auch herkömmlichem CGI zurück.

Die neues Papier ist betitelt MirrorVerse: Diffusionsmodelle vorantreiben, um die Welt realistisch abzubildenund stammt von drei Forschern des Vision and AI Lab, des IISc Bangalore und des Samsung R&D Institute in Bangalore. Das Papier hat eine zugehörige Projektseite, sowie eine Datensatz bei Hugging Face, mit Quellcode veröffentlicht auf GitHub.

Methodik

Die Forscher weisen von Anfang an auf die Schwierigkeit hin, die Modelle wie Stabile Diffusion und Fluss haben, indem sie auf Reflexionen basierende Aufforderungen respektieren und das Problem geschickt veranschaulichen:

Aus dem Dokument: Die aktuellen hochmodernen Text-zu-Bild-Modelle SD3.5 und Flux weisen erhebliche Schwierigkeiten bei der Erzeugung konsistenter und geometrisch genauer Reflexionen auf, wenn sie aufgefordert werden, diese in einer Szene zu generieren.

Die Forscher haben entwickelt MirrorFusion 2.0, ein diffusionsbasiertes generatives Modell, das den Fotorealismus und die geometrische Genauigkeit von Spiegelreflexionen in synthetischen Bildern verbessern soll. Das Training des Modells basierte auf dem neu kuratierten Datensatz der Forscher mit dem Titel MirrorGen2, die darauf abzielt, Verallgemeinerung Schwächen, die bei früheren Ansätzen beobachtet wurden.

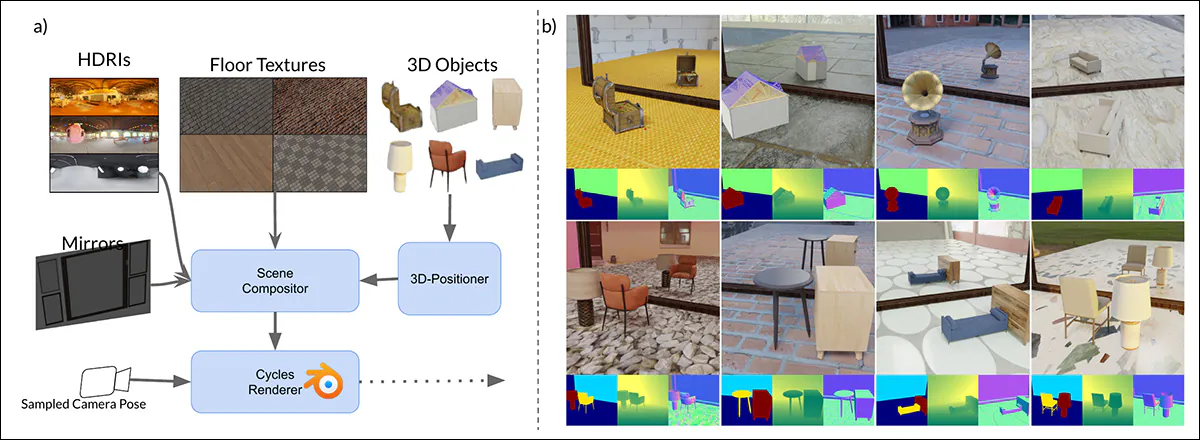

MirrorGen2 erweitert frühere Methoden durch die Einführung zufällige Objektpositionierung, zufällige Rotationenund explizite Objekterdung, mit dem Ziel, sicherzustellen, dass Reflexionen über einen größeren Bereich von Objektpositionen und -platzierungen relativ zur Spiegeloberfläche hinweg plausibel bleiben.

Schema für die Generierung synthetischer Daten in MirrorVerse: Die Pipeline zur Datensatzgenerierung wendete wichtige Erweiterungen an, indem sie Objekte innerhalb der Szene mithilfe des 3D-Positionierers zufällig positionierte, drehte und fixierte. Objekte werden außerdem in semantisch konsistenten Kombinationen gepaart, um komplexe räumliche Beziehungen und Okklusionen zu simulieren. Dadurch kann der Datensatz realistischere Interaktionen in Szenen mit mehreren Objekten erfassen.

Um die Fähigkeit des Modells, komplexe räumliche Anordnungen zu verarbeiten, weiter zu stärken, beinhaltet die MirrorGen2-Pipeline gepaart Objektszenen, wodurch das System Verdeckungen und Interaktionen zwischen mehreren Elementen in reflektierenden Umgebungen besser darstellen kann.

Das Papier sagt:

Kategorien werden manuell gepaart, um semantische Kohärenz zu gewährleisten – zum Beispiel die Paarung eines Stuhls mit einem Tisch. Während des Renderns wird nach der Positionierung und Drehung des primären [Objekts] ein zusätzliches [Objekt] aus der gepaarten Kategorie abgetastet und so angeordnet, dass Überlappungen vermieden werden und unterschiedliche räumliche Bereiche innerhalb der Szene gewährleistet sind.

Im Hinblick auf die explizite Objektverankerung stellten die Autoren hier sicher, dass die generierten Objekte in den synthetischen Ausgabedaten am Boden „verankert“ waren, anstatt unangemessen „zu schweben“, was passieren kann, wenn synthetische Daten in großem Maßstab oder mit hochautomatisierten Methoden generiert werden.

Da die Datensatzinnovation für die Neuartigkeit des Papiers von zentraler Bedeutung ist, werden wir früher als üblich mit diesem Abschnitt der Berichterstattung fortfahren.

Daten und Tests

SynMirrorV2

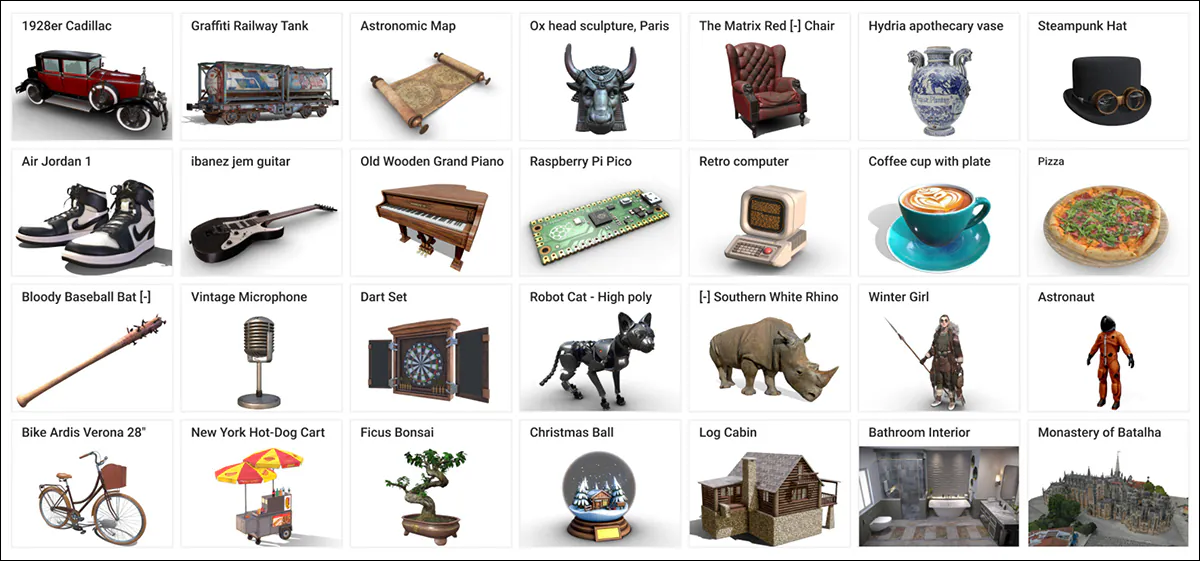

Der SynMirrorV2-Datensatz der Forscher wurde entwickelt, um die Vielfalt und den Realismus der Trainingsdaten für Spiegelreflexionen zu verbessern. Er enthält 3D-Objekte aus der Objaverse und Amazon Berkeley Objects (ABO) Datensätze, wobei diese Auswahl anschließend durch OBJEKT 3DITsowie der Filterprozess aus der V1 MirrorFusion-Projekt, um minderwertige Assets zu eliminieren. Dies führte zu einem verfeinerten Pool von 66,062 Objekten.

Beispiele aus dem Objaverse-Datensatz, die bei der Erstellung des kuratierten Datensatzes für das neue System verwendet wurden. Quelle: https://arxiv.org/pdf/2212.08051

Die Szenenkonstruktion umfasste das Platzieren dieser Objekte auf strukturierten Böden von CC-Texturen und HDRI-Hintergründe aus dem PolyHaven CGI-Repository mit entweder wandfüllenden oder hohen rechteckigen Spiegeln. Die Beleuchtung wurde mit einem Flächenlicht standardisiert, das über und hinter den Objekten in einem Winkel von 45 Grad positioniert war. Die Objekte wurden so skaliert, dass sie in einen Einheitswürfel passten, und anhand eines vorberechneten Schnittpunkts von Spiegel und Kameraansicht positioniert. Kegelstümpfe, um die Sichtbarkeit zu gewährleisten.

Es wurden zufällige Rotationen um die Y-Achse angewendet und eine Erdungstechnik verwendet, um „schwebende Artefakte“ zu verhindern.

Um komplexere Szenen zu simulieren, enthielt der Datensatz auch mehrere Objekte, die nach semantisch kohärenten Paarungen basierend auf ABO-Kategorien angeordnet waren. Sekundärobjekte wurden so platziert, dass Überlappungen vermieden wurden. So entstanden 3,140 Szenen mit mehreren Objekten, die unterschiedliche Okklusionen und Tiefenbeziehungen erfassen sollten.

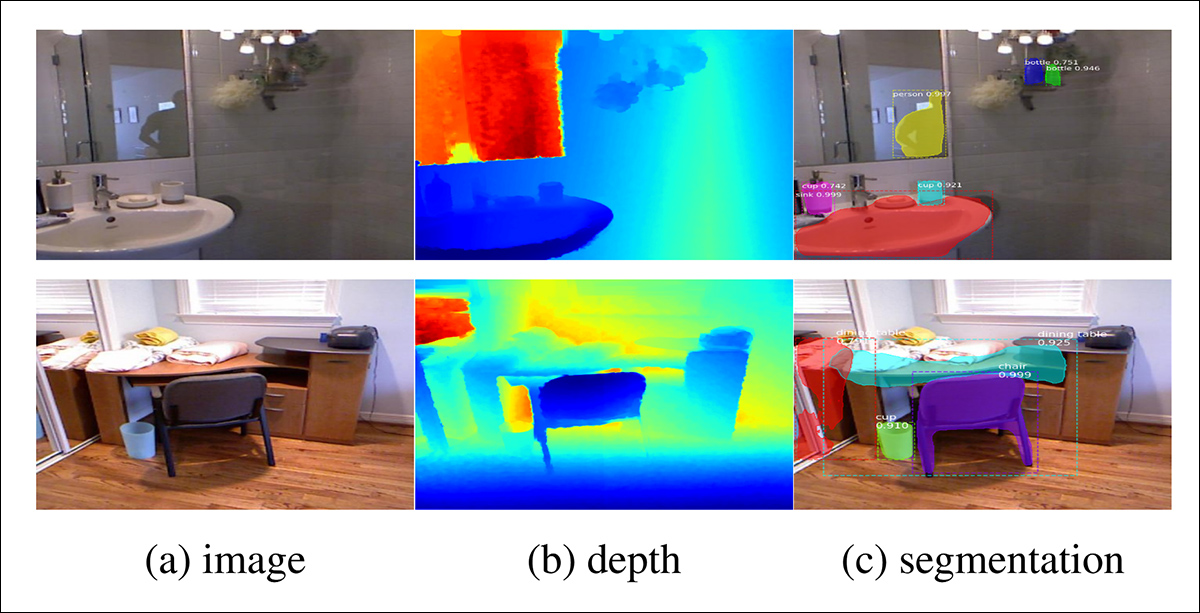

Beispiele für gerenderte Ansichten aus dem Datensatz der Autoren, die mehrere (mehr als zwei) Objekte enthalten, mit Abbildungen der Objektsegmentierung und Tiefenkartenvisualisierungen, die unten zu sehen sind.

Trainingsprozess

Da synthetischer Realismus allein für eine robuste Generalisierung auf reale Daten nicht ausreichte, entwickelten die Forscher einen dreistufigen Lehrplan-Lernprozess für das Training von MirrorFusion 2.0.

In Phase 1 initialisierten die Autoren die Gewichte sowohl des Konditionierungs- als auch des Erzeugungszweigs mit der stabilen Diffusion v1.5 Checkpoint und optimierte das Modell auf der Einzelobjekt-Trainings gespalten des SynMirrorV2-Datensatzes. Im Gegensatz zu den oben genannten Die Realität widerspiegeln Projekt, die Forscher nicht einfrieren den Generierungszweig. Anschließend trainierten sie das Modell 40,000 Iterationen lang.

In Phase 2 wurde das Modell für weitere 10,000 Iterationen auf der Mehrobjekt-Trainingsaufteilung von SynMirrorV2 feinabgestimmt, um dem System den Umgang mit Okklusionen und den komplexeren räumlichen Anordnungen in realistischen Szenen beizubringen.

Schließlich wurden in Phase 3 weitere 10,000 Iterationen der Feinabstimmung durchgeführt, wobei reale Daten aus der MSD-Datensatz, unter Verwendung von Tiefenkarten, die von der Matterport3D monokularer Tiefenschätzer.

Beispiele aus dem MSD-Datensatz mit realen Szenen, die in Tiefenanalysen und Segmentierungskarten analysiert wurden. Quelle: https://arxiv.org/pdf/1908.09101

Während des Trainings wurden Textaufforderungen für 20 Prozent der Trainingszeit weggelassen, um das Modell zu ermutigen, die verfügbaren Tiefeninformationen optimal zu nutzen (d. h. ein „maskierter“ Ansatz).

Das Training erfolgte auf vier NVIDIA A100 GPUs für alle Phasen (die VRAM-Spezifikationen werden nicht angegeben, es wären jedoch 40 GB oder 80 GB pro Karte gewesen). Eine Lernrate von 1e-5 wurde mit einer Batchgröße von 4 pro GPU verwendet, unter der AdamW Optimierer.

Dieses Trainingsprogramm steigerte schrittweise den Schwierigkeitsgrad der dem Modell vorgelegten Aufgaben, beginnend mit einfacheren synthetischen Szenen und fortschreitend hin zu anspruchsvolleren Kompositionen, mit der Absicht, eine robuste Übertragbarkeit auf die reale Welt zu entwickeln.

Tests

Die Autoren bewerteten MirrorFusion 2.0 im Vergleich zum vorherigen Stand der Technik, MirrorFusion, der als Basis diente, und führten Experimente mit dem MirrorBenchV2-Datensatz durch, die sowohl Einzel- als auch Mehrobjektszenen abdeckten.

Zusätzliche qualitative Tests wurden an Proben aus dem MSD-Datensatz durchgeführt, und die Von Google gescannte Objekte (GSO)-Datensatz.

Für die Auswertung wurden 2,991 Einzelobjektbilder aus den Kategorien „gesehen“ und „ungesehen“ sowie 300 Zweiobjektszenen aus ABO verwendet. Die Leistung wurde gemessen mit Spitzensignal-Rausch-Verhältnis (PSNR); Struktureller Ähnlichkeitsindex (SSIM); und Erlernte perzeptuelle Bildfeldähnlichkeit (LPIPS)-Werte, um die Reflexionsqualität im maskierten Spiegelbereich zu beurteilen. CLIP-Ähnlichkeit wurde verwendet, um die Textausrichtung mit den Eingabeaufforderungen zu bewerten.

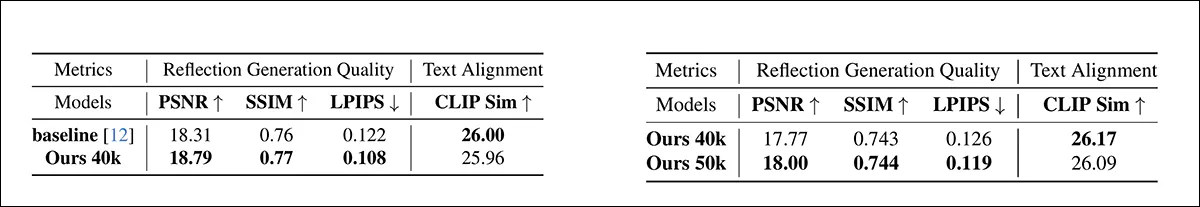

In quantitativen Tests generierten die Autoren Bilder mit vier Seeds für eine bestimmte Eingabeaufforderung und wählten das Bild mit dem besten SSIM-Score aus. Die beiden Ergebnistabellen für die quantitativen Tests sind unten aufgeführt.

Links: Quantitative Ergebnisse für die Qualität der Reflexionsgenerierung einzelner Objekte auf der MirrorBenchV2-Einzelobjektaufteilung. MirrorFusion 2.0 übertraf die Basislinie; die besten Ergebnisse sind fett gedruckt. Rechts: Quantitative Ergebnisse für die Qualität der Reflexionsgenerierung mehrerer Objekte auf der MirrorBenchV2-Mehrobjektaufteilung. MirrorFusion 2.0, trainiert mit mehreren Objekten, übertraf die Version ohne diese; die besten Ergebnisse sind fett gedruckt.

Die Autoren kommentieren:

„[Die Ergebnisse] zeigen, dass unsere Methode die Basismethode übertrifft und die Feinabstimmung auf mehrere Objekte die Ergebnisse bei komplexen Szenen verbessert.“

Der Großteil der Ergebnisse und die von den Autoren hervorgehobenen Ergebnisse betreffen qualitative Tests. Aufgrund der Größe dieser Abbildungen können wir die Beispiele des Papiers nur teilweise wiedergeben.

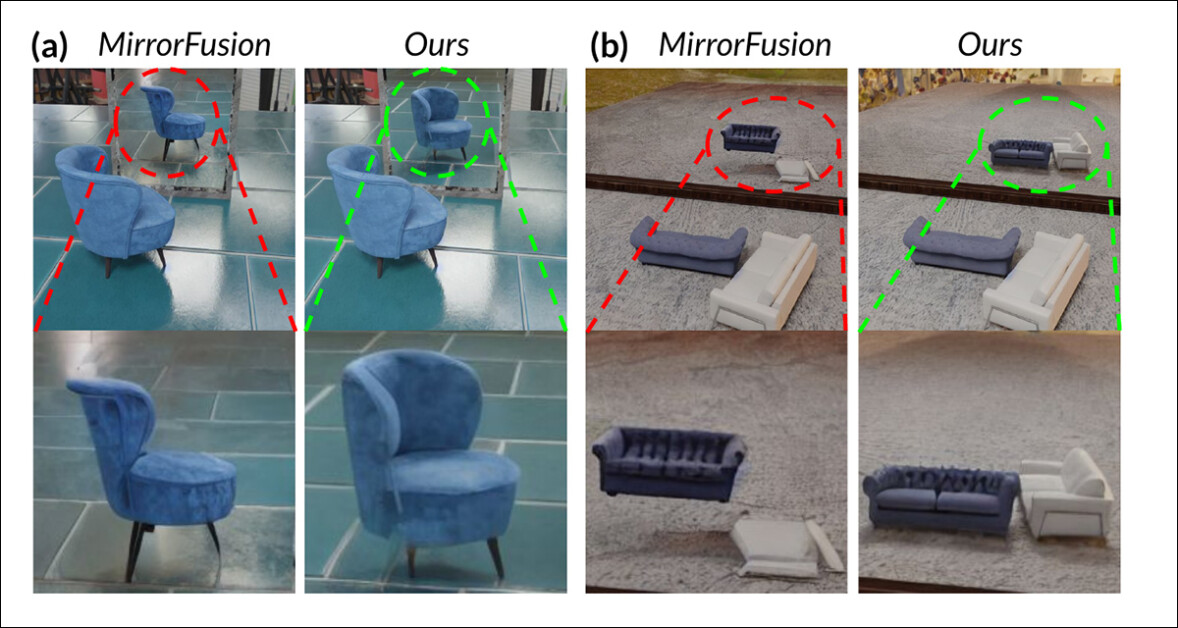

Vergleich auf MirrorBenchV2: Die Basislinie konnte keine genauen Reflexionen und räumliche Konsistenz aufrechterhalten und zeigte eine falsche Stuhlausrichtung und verzerrte Reflexionen mehrerer Objekte, während (laut den Autoren) MirrorFusion 2.0 den Stuhl und die Sofas korrekt darstellt, mit genauer Position, Ausrichtung und Struktur.

Aufgrund dieser subjektiven Ergebnisse argumentieren die Forscher, dass das Basismodell die Objektausrichtung und räumlichen Beziehungen in Reflexionen nicht korrekt wiedergeben konnte und häufig Artefakte wie falsche Rotation und schwebende Objekte erzeugte. MirrorFusion 2.0, trainiert auf SynMirrorV2, so die Autoren, bewahrt die korrekte Objektausrichtung und -positionierung sowohl in Einzel- als auch in Mehrobjektszenen, was zu realistischeren und kohärenteren Reflexionen führt.

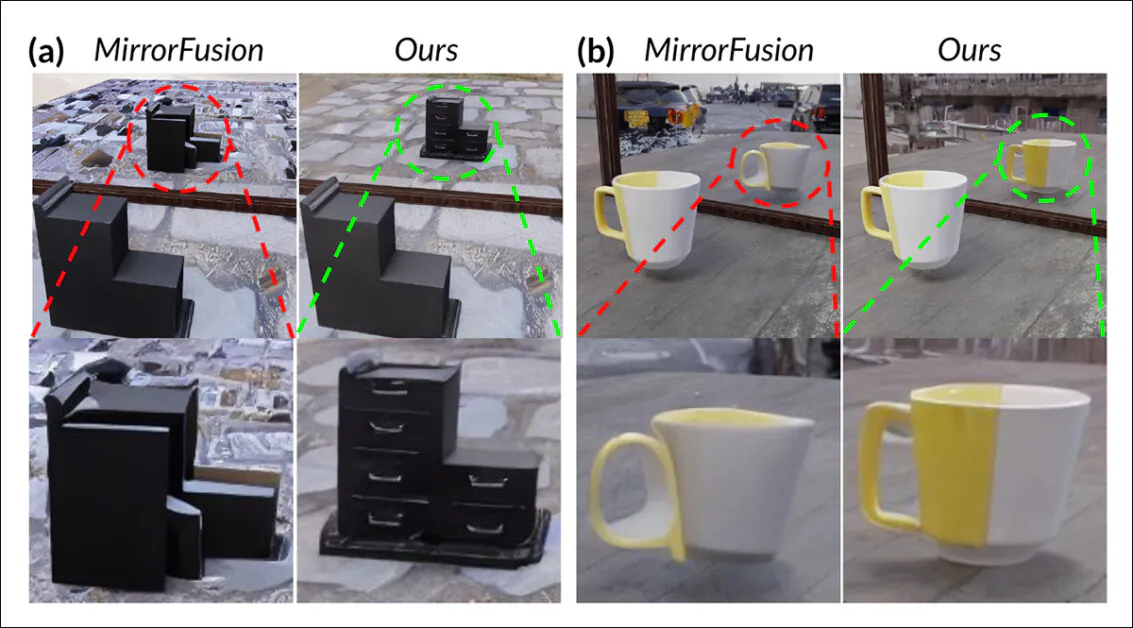

Nachfolgend sehen wir qualitative Ergebnisse zum oben genannten GSO-Datensatz:

Vergleich mit dem GSO-Datensatz. Die Basislinie stellt die Objektstruktur falsch dar und erzeugt unvollständige, verzerrte Reflexionen. MirrorFusion 2.0 hingegen, so die Autoren, bewahrt die räumliche Integrität und erzeugt präzise Geometrie, Farbe und Details, selbst bei Objekten außerhalb der Verteilung.

Hier kommentieren die Autoren:

MirrorFusion 2.0 erzeugt deutlich präzisere und realistischere Reflexionen. Beispielsweise spiegelt MirrorFusion 5 in Abb. 2.0 (a – oben) die Schubladengriffe (grün hervorgehoben) korrekt wider, während das Basismodell eine unplausible Reflexion (rot hervorgehoben) erzeugt.

„Ebenso liefert MirrorFusion 5 für die ‚weiß-gelbe Tasse‘ in Abb. 2.0 (b) eine überzeugende Geometrie mit minimalen Artefakten, im Gegensatz zur Basislinie, die die Geometrie und das Aussehen des Objekts nicht genau erfasst.“

Der abschließende qualitative Test erfolgte anhand des oben genannten realen MSD-Datensatzes (Teilergebnisse unten dargestellt):

Reale Szenenergebnisse im Vergleich von MirrorFusion, MirrorFusion 2.0 und MirrorFusion 2.0, optimiert auf dem MSD-Datensatz. Die Autoren behaupten, dass MirrorFusion 2.0 komplexe Szenendetails präziser erfasst, einschließlich ungeordneter Objekte auf einem Tisch und der Anwesenheit mehrerer Spiegel in einer dreidimensionalen Umgebung. Aufgrund der Größe der Ergebnisse im Originalartikel werden hier nur Teilergebnisse gezeigt. Für vollständige Ergebnisse und eine bessere Auflösung verweisen wir auf diesen Artikel.

Die Autoren stellen fest, dass MirrorFusion 2.0 zwar bei MirrorBenchV2- und GSO-Daten gute Ergebnisse lieferte, jedoch zunächst mit komplexen realen Szenen im MSD-Datensatz zu kämpfen hatte. Die Feinabstimmung des Modells an einer Teilmenge von MSD verbesserte seine Fähigkeit, mit unübersichtlichen Umgebungen und mehreren Spiegeln umzugehen, was zu kohärenteren und detaillierteren Reflexionen im durchgeführten Test-Split führte.

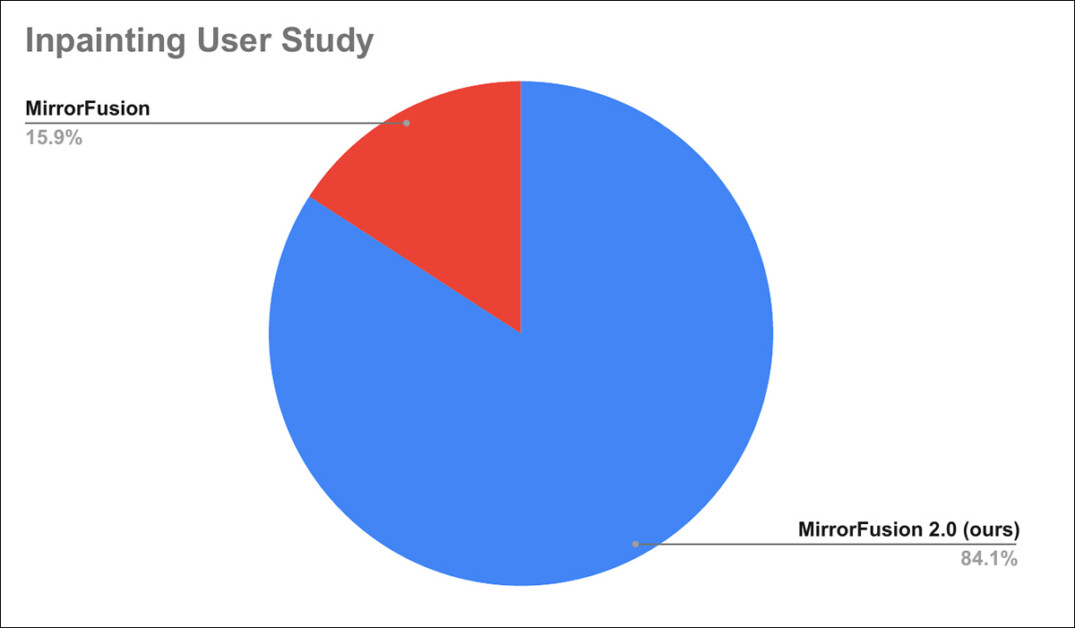

Darüber hinaus wurde eine Benutzerstudie durchgeführt, in der 84 % der Benutzer Generationen von MirrorFusion 2.0 der Basismethode vorziehen.

Ergebnisse der Nutzerstudie.

Da Einzelheiten der Benutzerstudie in den Anhang des Dokuments verschoben wurden, verweisen wir den Leser für weitere Einzelheiten der Studie auf diesen.

Fazit

Obwohl einige der in der Arbeit vorgestellten Ergebnisse beeindruckende Verbesserungen gegenüber dem aktuellen Stand der Technik darstellen, ist der aktuelle Stand der Technik für dieses spezielle Forschungsgebiet so dürftig, dass selbst eine wenig überzeugende Gesamtlösung mit minimalem Aufwand erfolgreich sein kann. Die grundlegende Architektur eines Diffusionsmodells steht dem zuverlässigen Lernen und der Demonstration konsistenter Physik entgegen, sodass das Problem schlecht gestellt ist und offenbar keiner eleganten Lösung bedarf.

Darüber hinaus ist das Hinzufügen von Daten zu bestehenden Modellen bereits die Standardmethode zur Behebung von Leistungsdefiziten im LDM, mit allen zuvor genannten Nachteilen. Es ist anzunehmen, dass die resultierenden Modelle dieses Szenario besser bewältigen würden, wenn bei zukünftigen großskaligen Datensätzen die Verteilung (und Annotation) reflexionsbezogener Datenpunkte stärker berücksichtigt würde.

Doch das Gleiche gilt auch für zahlreiche andere Ärgernisse in der LDM-Ausgabe – wer kann schon sagen, wer von ihnen den Aufwand und das Geld am meisten verdient, die für die Art von Lösung erforderlich sind, die die Autoren des neuen Artikels hier vorschlagen?

Erstmals veröffentlicht am Montag, 28. April 2025. Dienstag, 29. April: Grammatikkorrektur in den letzten Absätzen vorgenommen.