Andersons Blickwinkel

Ein Geruchssinn für die AI-Entwicklung bringen

Ein neues AI-Datenset lehrt Maschinen, zu riechen, indem es Geruchsdaten mit Bildern assoziiert, sodass Modelle Gerüche mit Objekten, Szenen und Materialien in Verbindung bringen können.

Vielleicht weil Geruchs-Ausgabemaschinen eine so wechselhafte Geschichte haben, ist der Geruchssinn in der AI-Forschungsliteratur ein ziemlich vernachlässigter Sinn. Es sei denn, man plant, einen weiteren Eintrag in die lange laufende (mehr als ein Jahrhundert, bis heute) Smell-o-Vision-Saga zu produzieren, schienen Anwendungsfälle immer eher “nischig” im Vergleich zur Ausbeutung von Bild-, Audio- und Video-Datensätzen und den AI-Modellen, die aus ihnen trainiert werden.

Tatsächlich wäre die Möglichkeit, die Art von Erkennungseinrichtungen zu automatisieren, zu industrialisieren und zu popularisieren, die von Bomben-Hunden, Leichen-Hunden, Krankheits-Spürhunden und verschiedenen anderen Arten von Spürhunden angeboten wird, ein bemerkenswerter Vorteil in kommunalen und Sicherheitsdiensten. Trotz hoher Nachfrage ist die Verfügbarkeit weit über dem Angebot, und das Training und die Aufrechterhaltung von Spürhunden ist ein teures Geschäft, das nicht immer einen guten Wert für das Geld bietet.

Bisher war die meisten Forschung, die in dieses Gebiet der Studie eindringt, auf ein Labor beschränkt, mit kuratierten Sammlungen, die typischerweise aus Beispielen mit handgefertigten Funktionen bestehen – ein Profil, das eher zu besonderen Lösungen für die Heimindustrie als zu industrialisierten Anwendungen neigt.

Vorwärts mit der Nase

In diese ziemlich staubige Atmosphäre kommt eine interessante neue akademische/industrielle Zusammenarbeit aus den USA, bei der ein Team von Forschern mehrere Monate damit verbrachte, diverse Gerüche in Innen- und Außenbereichen in New York City zu katalogisieren – und zum ersten Mal Bilder zu erfassen, die mit den erfassten Gerüchen assoziiert sind:

Beachten Sie den zentralen Sensor, die ‘Nase’ des olfaktorischen Geräts. Trainiert nur auf Geruch, errät das Modell, ob es Granit, Plastik oder Leder riecht – und identifiziert sogar den Raum, in dem es sich befindet, ohne ein einziges Pixel zu sehen. Quelle

Diese Forschung hat die Autoren der neuen Arbeit dazu veranlasst, eine Variante des enorm beliebten Contrastive Language-Image Pretraining- (CLIP)-Frameworks zu entwickeln, das Text und Bilder verbindet, in Form von Contrastive Olfaction-Image Pretraining (COIP) – das Gerüche und Bilder verbindet.

Oben: synchronisierte Video- und olfaktorische Sensordaten werden in natürlichen Umgebungen mit einem Kamera-e-Nase-Rig erfasst. Unten links (b): Eine gemeinsame Einbettung wird durch cross-modale Selbstüberwachung erlernt. (c): Das System ruft visuelle Übereinstimmungen basierend allein auf einer Geruchsanfrage ab. (d): Einzelne Geruchsmuster werden verwendet, um Umgebungen, Objekte und Materialkategorien zu klassifizieren. (e): Hoch ähnliche Gerüche, wie zwei Arten von Gras, werden ohne visuellen Input unterschieden. Quelle

Das neue Datenset, betitelt New York Smells, enthält 7.000 Geruch-Bild-Paare mit 3.500 verschiedenen Objekten. Als es in Tests trainiert wurde, wurde das neue Datenset gefunden, um die beliebten handgefertigten Funktionen in der relativ kleinen Anzahl ähnlicher vorheriger Datensätze zu übertreffen.

Die Autoren hoffen, dass ihr erstes Ausflug den Weg für spätere und folgende Arbeiten zu olfaktorischen Erkennungssystemen ebnet, die so konzipiert sind, dass sie in der Wildnis funktionieren, genauso wie Spürhunde:

‘Wir sehen dieses Datenset als einen Schritt in Richtung in-the-wild, multimodale olfaktorische Wahrnehmung sowie als einen Schritt in Richtung Verbindung von Sicht und Geruch. Während Olfaktion traditionell in eingeschränkten Umgebungen angegangen wurde, wie z.B. Qualitätssicherung, gibt es viele Anwendungen in natürlichen Umgebungen.

‘Zum Beispiel verwenden wir als Menschen unseren Geruchssinn ständig, um die Qualität von Nahrungsmitteln zu beurteilen, Gefahren zu identifizieren und unsichtbare Objekte zu erkennen.

‘Darüber hinaus zeigen viele Tiere, wie Hunde, Bären und Mäuse, übermenschliche olfaktorische Fähigkeiten, was darauf hindeutet, dass die menschliche Geruchswahrnehmung weit von der Grenze der maschinellen Fähigkeiten entfernt ist.’

Obwohl das neue Papier, betitelt New York Smells: Ein großes multimodales Datenset für Olfaktion, verspricht, dass Daten und Code veröffentlicht werden, ist bereits eine 27-GB-Datei über die Projekt-Website verfügbar. Das Papier wurde von neun Forschern an der Columbia University, Cornell University und Osmo Labs produziert.

Methode

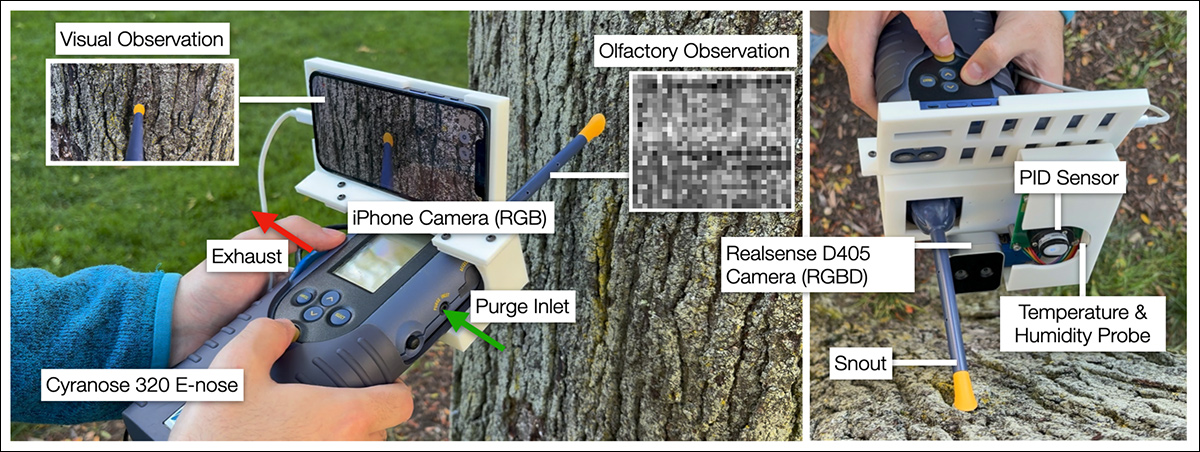

Um Material für die neue Sammlung zu sammeln, verwendeten die Forscher die Cyranose 320-elektronische Nase, mit einem iPhone, das über dem vorderen Einlass montiert war, um visuell zu erfassen, welche Gerüche registriert wurden:

Ein handgehaltenes Sensorkasten sammelt gepaarte Video- und Geruchsdaten, indem ein iPhone-Kamera auf eine Cyranose 320 e-Nase montiert wird. Die Schnauze ist auf Objekte gerichtet, während der Auslass und der Reinigungseinlass den Luftstrom während der Probenahme verwalten. Eine RGB-D-Kamera erfasst die Tiefe, während die Volatile organic compound (VOC)-Konzentration, Temperatur und Feuchtigkeit durch integrierte Sensoren, einschließlich eines Proportional-Integral-Derivat- (PID)-Moduls und einer Umweltsonde, aufgezeichnet werden.

Das Cyranose-Gerät läuft mit 2 Hz, aufzeichnend 32-dimensionale olfaktorische Zeitsschritte. Volatile Organic Compound (VOC)-Konzentrationen wurden mit einem MiniPID2 PPM WR-Sensor aufgezeichnet.

Die portable Einheit fungierte als agiler Sensor, der Daten an eine leistungsfähigere mobile Station für die Verarbeitung übermittelte.

Um den Zielgeruch in den Kontext zu setzen, wurde ein “Basissgeruch” registriert, bevor das spezifische Objekt direkt mit der “Schnauze” der Cyranose angepeilt wurde. Die Umgebungsprobe wurde dann von einem Seitenanschluss in der Einheit entnommen, um sicherzustellen, dass sie weit genug vom Hauptgeruch entfernt war, um nicht kontaminiert zu werden.

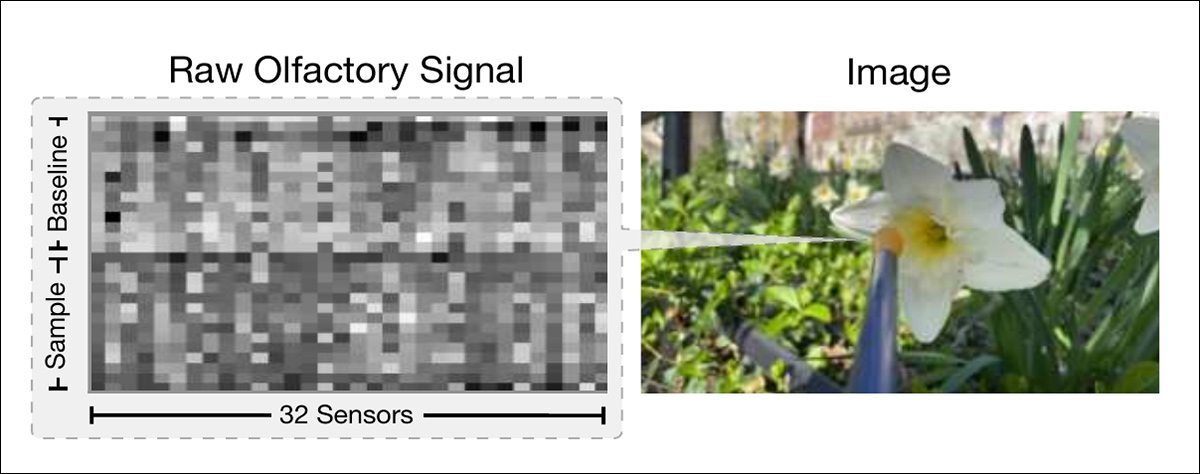

Zwei Proben wurden durch den Hauptanschluss des Sensors entnommen, wobei jede 10-Sekunden-Aufzeichnung von einer anderen Position um das Objekt herum aufgezeichnet wurde, um die Daten effizienz zu verbessern. Die Proben wurden dann mit der Umgebungs-Basissprobe kombiniert, um eine 28×32-Matrix zu bilden, die die vollständige olfaktorische Messung darstellt:

Dieses Beispiel zeigt das Signal und das entsprechende Bild für eine Blume. Das vollständige olfaktorische Signal besteht aus einer 28×32-Matrix, die eine 14-Rahmen-Umgebungs-Basissprobe mit zwei 10-Sekunden-Proben kombiniert, die von verschiedenen Winkeln um das Zielobjekt aufgezeichnet wurden.

Daten und Tests

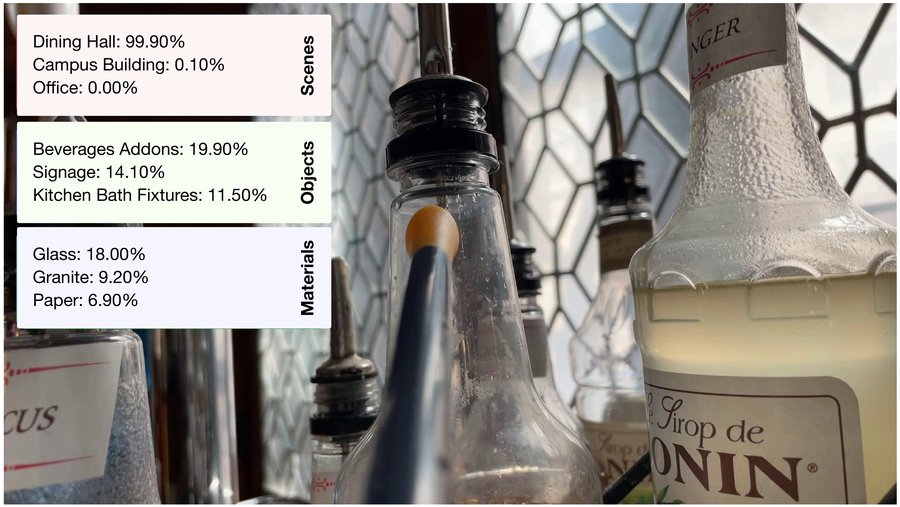

Vision Language Modelle (VLMs) wurden verwendet, um automatisch Objekte und Materialien zu beschriften, die von dem iPhone in der Cyranose-Rig aufgezeichnet wurden, wobei GPT-4o für diese Aufgabe eingesetzt wurde; jedoch wurden Szene- Kategorien manuell beschriftet:

Ein kleiner Ausschnitt aus einer umfangreichen Abbildung in der Quelle, die die vielfältigen Geruchsquellen und Umgebungen, die im Projekt aufgezeichnet wurden, zeigt.

Das Datenset wurde in Trainings- und Validierungs- Splits aufgeteilt, wobei beide Proben von jedem Objekt der gleichen Split zugeteilt wurden, um Kreuzkontamination zu vermeiden. Die endgültige Sammlung umfasst 7.000 olfaktorisch-visuelle Paare, die aus 3.500 unbeschrifteten Objekten bestehen, sowie 70 Stunden Video und 196.000 Zeitsschritte von rohen olfaktorischen Daten aus beiden Basiss- und Probenphasen.

Daten wurden über 60 Sitzungen innerhalb von zwei Monaten gesammelt, die Parks, Universitätsgebäude, Büros, Straßen, Bibliotheken, Wohnungen und Speisesäle umfassten, wobei mehrere Sitzungen an jedem Standort durchgeführt wurden. Die resultierende Datensammlung enthält 41 % Außen- und 59 % Innenbereiche.

Um allgemeingültige olfaktorische Repräsentationen zu entwickeln, trainierten die Autoren ein kontrastives Modell, um synchronisierte Bild-Geruch-Paare aus dem Datenset zu assoziieren. Dieser Ansatz, die oben genannte COIP, verwendet eine Verlustfunktion, die von CLIP adaptiert wurde, um die Einbettungen von ko-occurrenten visuellen und olfaktorischen Signalen auszurichten.

Das Training verwendete sowohl einen visuellen Encoder als auch einen Geruch-Encoder, wobei das Ziel darin bestand, das Modell zu lehren, übereinstimmende Gerüche und Bilder in einem gemeinsamen Repräsentationsraum zusammenzubringen. Die resultierenden Repräsentationen unterstützen eine Reihe von Downstream-Aufgaben, einschließlich Geruch-Bild-Retrieval, Szene- und Objekterkennung, Materialklassifizierung und feinkörniger Geruchsdiskriminierung.

Das Modell wurde mit zwei Arten von olfaktorischen Eingaben trainiert: dem vollständigen rohen Sensorsignal und einer reduzierten handgefertigten Zusammenfassung, bekannt als Geruchsmuster – weithin verwendete Funktionen in der Olfaktionsforschung, die jeden Sensorsantwort in eine einzige Zahl komprimieren, indem sie den Spitzenwiderstand während der Probenahme mit dem Durchschnittswiderstand während der Umgebungs-Basissprobe vergleichen.

Im Gegensatz dazu besteht das rohe Eingabesignal, das über ganz New York City aufgezeichnet wurde, aus einer Zeitsserie von 32 chemischen Sensoren innerhalb der Cyranose-Vorrichtung, die aufzeichnet, wie jeder Sensors Widerstand über die Zeit hinweg änderte, während er auf den Geruch reagierte.

Für die Kuration des Datensets wurde dieses unverarbeitete Signal direkt in ein neuronales Netzwerk eingegeben, was ein End-to-End-Lernen mit entweder einem konvolutiven oder transformatorbasierten Backbone ermöglichte. Modelle wurden mit sowohl Geruchsmustern als auch dem rohen Eingabesignal, das in verschiedenen Umgebungen in New York City gesammelt wurde, trainiert, wobei beide Eingabetypen unter kontrastivem Lernen ausgewertet wurden.

Quermodale Rückgewinnung

Die quermodale Rückgewinnung wurde ausgewertet, indem jedes Geruchsmuster und sein zugehöriges Bild in einen gemeinsamen Repräsentationsraum eingebettet und getestet wurde, ob das korrekte Bild allein auf der Grundlage des olfaktorischen Eingabesignals abgerufen werden konnte.

Die Rangordnung wurde durch die Nähe jeder Bild-Einbettung zum Abfrage-Geruch in diesem Raum bestimmt, und die Leistung wurde unter Verwendung von Mittelrang, Medianrang und Rückgewinnung bei mehreren Schwellenwerten gemessen:

Quermodale Rückgewinnungs-Genauigkeit für verschiedene Geruch-Encoder, die zeigt, wie gut jedes Modell das korrekte Bild aus einer Geruchsanfrage identifiziert. Die Ergebnisse vergleichen Architekturen, die auf rohen olfaktorischen Signalen trainiert wurden, mit denen, die mit Geruchsmustern trainiert wurden.

In Bezug auf diese Ergebnisse stellen die Autoren fest:

‘Kontrastives Pretraining unter Verwendung von Geruchsmustern funktioniert besser als Zufall in allen Metriken. Allerdings führt die Verwendung des rohen olfaktorischen Signals zu einer signifikanten Verbesserung im Vergleich zum Geruchsmuster-Encoder, unabhängig von der Architektur.

‘Dies zeigt die reichere Information, die im rohen olfaktorischen Daten vorhanden ist, und ermöglicht stärkere quermodale Assoziationen zwischen Sicht und Geruch.’

Ein Detail aus der siebten Abbildung in der Quelle, die zu kondensiert ist, um sie hier sinnvoll zu reproduzieren. Hier quermodale Rückgewinnungsbeispiele, die zeigen, wie das Modell Gerüche mit passenden Bildern verbindet. Jede Zeile beginnt mit einer Geruchsanfrage, gefolgt von den Top-Ranked-Bildvorhersagen im gemeinsamen Einbettungsraum. Das korrekte Bild für jede Anfrage ist mit Grün umrandet, was zeigt, wie Gerüche von Büchern, Pflanzen, Mauerwerk und anderen Materialien das Modell in Richtung visuell und semantisch verwandter Szenen ziehen.

Die Autoren bemerken auch, dass die Rückgewinnungsergebnisse klare semantische Muster zeigen:

‘Rückgewinnungen aus unserem Modell zeigen oft semantische Gruppierungen. Der Geruch eines Buches ruft Bilder von anderen Büchern ab, der Geruch von Blättern ruft Bilder von Laub ab.

‘Diese Ergebnisse deuten darauf hin, dass die gelernte Repräsentation eine sinnvolle quermodale Struktur aufweist.’

Szene-, Objekt- und Materialerkennung

Die Fähigkeit des Modells, Gerüche ohne visuellen Input zu erkennen, wurde ausgewertet, indem es trainiert wurde, Szenen, Objekte und Materialien allein auf der Grundlage olfaktorischer Daten zu identifizieren; zu diesem Zweck wurde ein linearer Sondierer (ein einfacher Klassifizierer, der auf festen Repräsentationen trainiert wurde) verwendet, um zu bewerten, wie viel Information in den gelernten Geruchseinbettungen kodiert war.

Beschriftungen wurden aus den zugehörigen Bildern im Trainingsset unter Verwendung von GPT-4o abgeleitet – jedoch wurde nur das olfaktorische Signal während der Klassifizierung verwendet.

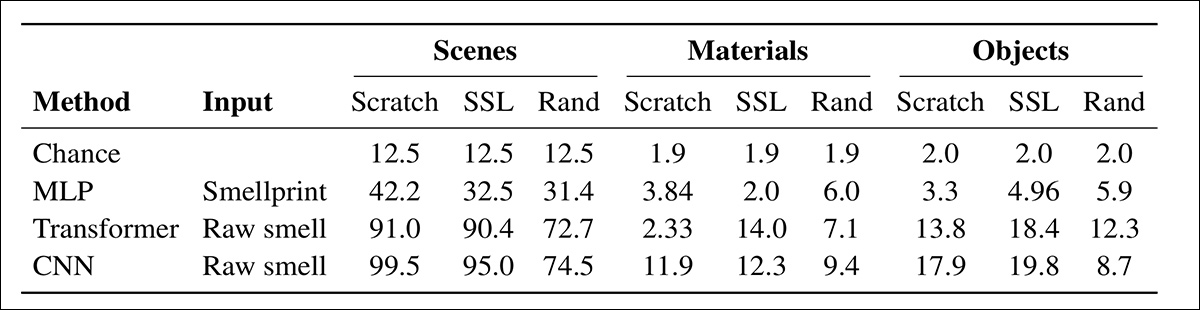

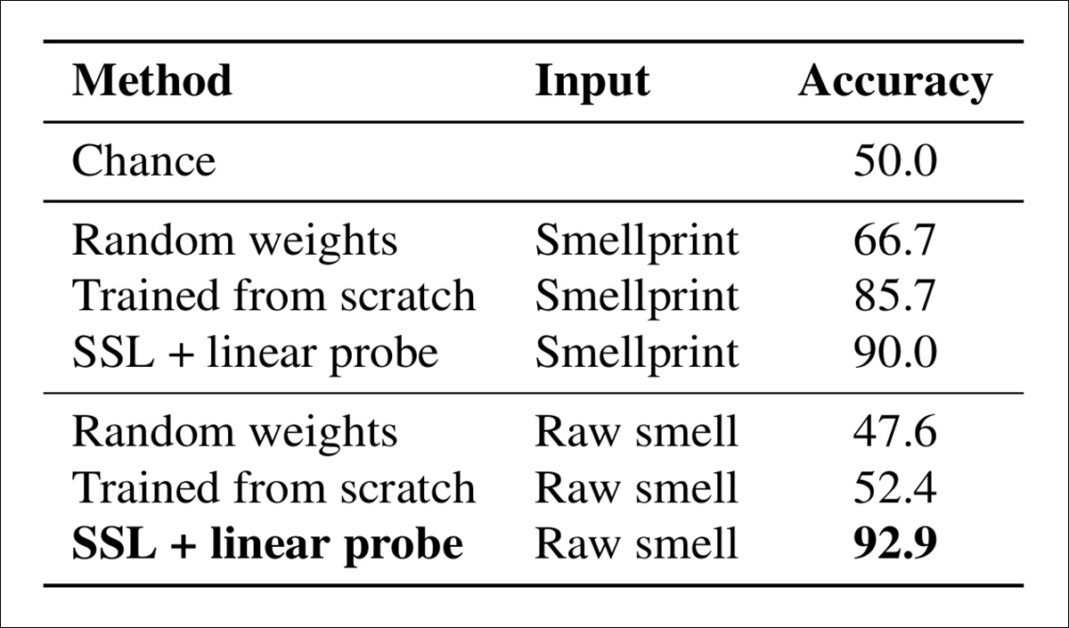

Mehrere Encodertypen wurden getestet: einige zufällig initialisiert, einige von Grund auf trainiert und andere unter Verwendung von kontrastivem Lernen trainiert, um Geruch und Sicht in einem gemeinsamen Repräsentationsraum auszurichten, wobei rohe Daten und Geruchsmuster ausgewertet wurden:

Klassifizierungs-Genauigkeit für Szenen, Materialien und Objekte wurde unter Verwendung olfaktorischer Signale allein bewertet. Rohes Sensoreingabesignal übertraf Geruchsmuster, wobei CNNs, die von Grund auf trainiert wurden, die höchsten Ergebnisse erzielten, einschließlich 99,5 % für Szenen. SSL-Pretraining half in einigen Fällen, wurde jedoch im Allgemeinen von überwachtem Training übertroffen. Zufällige Gewichtsbasen zeigen an, dass die Modellkapazität allein unzureichend ist.

Signifikant höhere Genauigkeit wurde erzielt, wenn rohe olfaktorische Daten verwendet wurden, insbesondere in Modellen, die mit cross-modaler Überwachung trainiert wurden. Die Autoren bemerken:

‘Modelle, die auf rohe sensorische Eingaben trainiert werden, erzielen auch höhere Genauigkeit als Modelle, die mit handgefertigten Geruchsmustern trainiert werden. Diese Ergebnisse zeigen, dass tiefes Lernen aus rohen olfaktorischen Signalen erheblich besser ist als handgefertigte Funktionen.’

Feinkörnige Diskriminierung

Um zu bewerten, ob feinkörnige Geruchsdifferenzierungen gelernt werden können, wurde ein Benchmark aus zwei Grasarten erstellt, die auf dem gleichen Campus-Rasen koexistieren. Alternierende Proben wurden über sechs 30-minütige Sitzungen gesammelt, was 256 Beispiele ergab. Ein linearer Klassifizierer wurde auf Funktionen aus olfaktorisch-visuellem kontrastivem Lernen trainiert und auf einem separaten Satz von 42 Proben ausgewertet:

Genauigkeit der Grasarten-Klassifizierung aus Geruch allein. Modelle wurden auf ihre Fähigkeit getestet, zwischen zwei visuell ähnlichen Grasarten anhand von Geruch allein zu unterscheiden. Die Leistung wurde bei Geruchsmustern und rohen Sensordaten verglichen, wobei Modelle entweder zufällig initialisiert, von Grund auf trainiert oder unter Verwendung von Selbstüberwachungslernen (SSL) trainiert und mit einem linearen Sondierer ausgestattet wurden. Die höchste Genauigkeit, 92,9 %, wurde unter Verwendung von rohen olfaktorischen Signalen mit SSL erzielt, was darauf hindeutet, dass feinkörnige Geruchsdifferenzen am besten durch rohe Eingaben und sichtbare Trainingsdaten erfasst werden.

Hier stellen die Forscher fest:

‘Das Training auf dem rohen olfaktorischen Sensorsignal (anstatt handgefertigter Funktionen) ergibt die höchste Genauigkeit – und übertrifft alle Varianten, die auf Geruchsmustern basieren.

‘Diese Ergebnisse deuten darauf hin, dass olfaktorisch-visuelles Lernen mehr feinkörnige Informationen aufweist als Lernen mit Geruchsmustern, und dass visuelle Überwachung ein Signal für die Ausnutzung dieser Informationen liefert.’

Schlussfolgerung

Obwohl die Geruchssynthese wahrscheinlich ein ungelöstes Problem bleiben wird, hat ein effektives und erschwingliches In-the-Wild-Geruchsanalyse-System enormes Potenzial, nicht nur für Polizei-, Sicherheits- und medizinische Zwecke, sondern auch für die Lebensqualität und die Überwachung von Städten.

Zurzeit ist die beteiligte Ausrüstung Nischenprodukte und in der Regel ziemlich teuer; daher scheint echter Fortschritt in “olfaktorischer KI” für die Erkennung wahrscheinlich eine visionäre und erschwingliche Sensorik im Geiste von Raspberry PI zu erfordern.

* Meine Umwandlung der Autoren-Inline-Zitate in Hyperlinks.

** Bitte beachten Sie, dass weitere Abbildungen (Abbildung 8) im Quellenpapier verfügbar sind, die jedoch am besten im Kontext des Papiers betrachtet werden.

Erstveröffentlicht am Freitag, den 28. November 2025