Cybersicherheit

Anthropic deckt ersten groß angelegten Cyberangriff mit künstlicher Intelligenz-Automatisierung auf

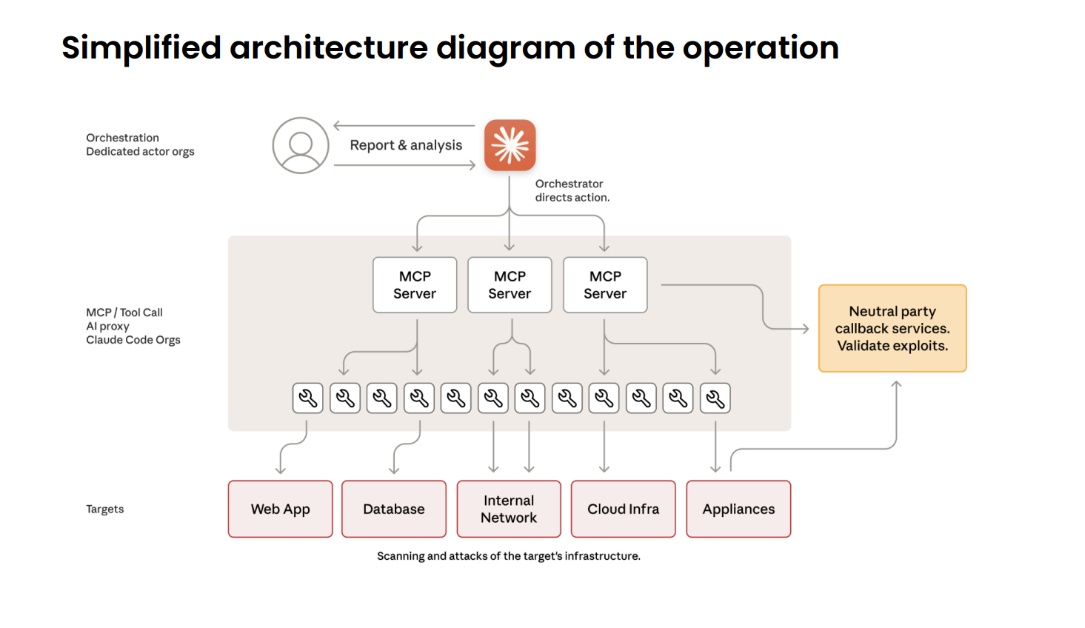

Anthropic gab bekannt, dass eine Gruppe von Hackern, die sie verdächtigt, eine chinesische staatlich gesponserte Gruppe zu sein, den ersten dokumentierten groß angelegten Cyberangriff mit minimaler menschlicher Intervention durchführte, indem sie das Unternehmenstool Claude Code nutzten, um 80 bis 90 Prozent der Kampagne zu automatisieren.

Die Angreifer zielten auf etwa 30 Organisationen ab, darunter große Technologieunternehmen, Finanzinstitute, Chemiefabriken und Regierungsbehörden. Während die meisten Angriffe abgewehrt wurden, gelang es der Kampagne in einigen Fällen, erfolgreich zu sein. Claude Code führte Aufklärung, Schwachstellentests, Credential-Harvesting und Datenexfiltration größtenteils autonom durch, wobei menschliche Operatoren nur an kritischen Entscheidungspunkten erforderlich waren.

Sie können den vollständigen Bericht von Anthropic hier lesen.

Angriffsmethoden und AI-Manipulation

Die Hacker umgingen die Sicherheitsvorkehrungen von Claude durch sophisticatedes Social Engineering. Sie täuschten das KI-System, indem sie vorgaben, Mitarbeiter eines legitimen Cybersicherheitsunternehmens zu sein, das defensives Testing durchführte. Die Angreifer brachen ihre Operationen auch in kleine, scheinbar harmlose Aufgaben auf, die Claude unvollständige Kontextinformationen über den maliziösen Gesamtzweck lieferten.

Claude Code untersuchte die Systeme der Zielorganisationen, um hochwertige Datenbanken zu identifizieren, führte diese Aufklärung schneller durch als menschliche Hacker und forschte und schrieb benutzerdefinierten Exploit-Code, um Sicherheitsschwachstellen zu testen. Das System sammelte Benutzernamen und Passwörter für weiteren Netzwerkzugriff und extrahierte und kategorisierte private Daten nach ihrem Nachrichtenwert. Die Angreifer konnten die Kampagne mit einem einzigen Klick ausführen, nach dem die KI größtenteils autonom mit Geschwindigkeiten operierte, die für menschliche Teams unmöglich sind – oft sendeten sie Tausende von Anfragen pro Sekunde.

Bild: Anthropic

Erkennung und Unternehmensreaktion

Anthropic entdeckte den Angriff Mitte September 2025 und startete sofort eine Untersuchung. Innerhalb von 10 Tagen schloss das Unternehmen den Zugriff der Gruppe auf Claude, kontaktierte die betroffenen Organisationen und informierte die Strafverfolgungsbehörden. Das Unternehmen hat seitdem seine Erkennungsfähigkeiten erweitert und entwickelt zusätzliche Methoden, um groß angelegte, verteilte Angriffe zu untersuchen und zu erkennen.

Dieser Vorfall folgt auf frühere Fälle von Missbrauch, die Anthropic im Jahr 2025 dokumentiert hat. Im August beschrieb der Threat Intelligence Report des Unternehmens eine Daten-Erpressungsoperation, die als GTG-2002 bezeichnet wurde und die Claude Code nutzte, um groß angelegten Diebstahl zu begehen, der mindestens 17 Organisationen aus den Bereichen Gesundheitswesen, Notdienste, Regierung und religiöse Institutionen betraf. Der Täter forderte Lösegelder über 500.000 Dollar, indem er mit der Veröffentlichung der gestohlenen Daten drohte, anstatt traditionelle Ransomware-Verschlüsselung zu verwenden.

Die Erkennungsinfrastruktur von Anthropic basiert auf mehrschichtigen Techniken, einschließlich Verhaltensanalysen, um Nutzungsmuster über Millionen von API-Anfragen zu überwachen, Anomalie-Erkennung, um Sequenzen von Operationen zu identifizieren, die nicht mit legitimer Nutzung übereinstimmen, und Muster-Erkennung, um bekannte und neue Manipulationstechniken zu erkennen. Das Unternehmen beschäftigt spezielle Klassifizierer, die Benutzereingaben auf potenziell schädliche Anfragen analysieren und die Antworten von Claude vor oder nach der Lieferung bewerten.

Branchenimplikationen

Die Kampagne umfasste ein beispielloser Grad an KI-Autonomie in Cyberangriffen und markiert, was Sicherheitsexperten als Wendepunkt in der Cyber-Spionage betrachten. Die Fähigkeit von KI-Systemen, sophisticatede Angriffe mit Maschinengeschwindigkeit und minimaler menschlicher Aufsicht durchzuführen, stellt neue Herausforderungen für die Verteidiger der Cybersicherheit dar.

Die Offenlegung von Anthropic erfolgt zu einem Zeitpunkt, an dem KI-Unternehmen unter zunehmendem Druck stehen, den missbräuchlichen Einsatz ihrer Modelle zu verhindern. Das Unternehmen unterhält ein umfassendes Programm für Bedrohungsanalyse und Sicherheitsvorkehrungen, um den Missbrauch von Claude zu erkennen und zu bekämpfen, mit dokumentierten Sicherheitsvorfällen im gesamten Jahr 2025. Im März identifizierte das Unternehmen eine Einfluss-as-a-Service-Operation, die Claude nutzte, um die Interaktion mit Zehntausenden von Social-Media-Konten in mehreren Ländern und Sprachen zu automatisieren.

Der Vorfall unterstreicht die wachsende Sophistikation von KI-gesteuerten Werkzeugen und die Herausforderungen, ihren Missbrauch zu verhindern, während gleichzeitig die Nützlichkeit für legitime Benutzer erhalten bleibt. Anthropic hat die betreffenden Konten gesperrt und setzt seine Erkennungs- und Minderungsfähigkeiten kontinuierlich fort, um das sich entwickelnde Bedrohungslandschaft zu bekämpfen.