Künstliche Intelligenz

Eine Einführung in Vertex AI

Angesichts der sich schnell verändernden Landschaft der künstlichen Intelligenz ist einer der größten Hindernisse, mit denen Tech-Führer oft konfrontiert sind, der Übergang von “experimentell” zu “unternehmensbereit”. Während Consumer-Chatbots und interaktive Plattformen die öffentliche Vorstellungskraft unterstützen, können Unternehmen nicht allein mit einer Chat-Schnittstelle erfolgreich sein. In einer Ära, in der der Wettbewerb aggressiver ist als je zuvor, benötigen Unternehmen ein robustes, skalierbares und sicheres Ökosystem, und genau das bietet Google mit Vertex AI an, der einheitlichen künstlichen Intelligenz- und Machine-Learning-Plattform von Google Cloud.

Vertex AI versucht, sich als Rückgrat für die Integration von Generative AI in moderne Cloud-Infrastrukturen zu etablieren und bietet eine umfassende Suite von Funktionen, die die Lücke zwischen rohen Grundmodellen und produktionsreifen Anwendungen schließt. Vertex AI ist nicht nur eine Hülle für große Sprachmodelle (LLMs), sondern ein einheitliches Machine-Learning- und künstliches Intelligenz- (ML/AI-) Ökosystem, das Generative AI als erstklassigen Bürger der modernen Cloud-Infrastruktur behandelt.

Im Herzen von Vertex AI sitzt der Model Garden, ein zentrales Marktplatz, der Zugang zu über 200 kuratierten Grundmodellen bietet, einschließlich des multimodalen Powerhouses Gemini 2.5 Pro, das eine atemberaubende 2-Million-Token-Kontextfenster aufweist. In diesem Artikel werden wir die Architektur von Vertex AI zerlegen, erforschen, wie Model Garden als “App Store” für Intelligenz dient, und uns die technischen Säulen ansehen, die diese Plattform zum Rückgrat der nächsten Generation von Unternehmenssoftware machen.

Die Kernarchitektur: Eine Einheitliche Plattform

Vertex AI ist nicht eine lose verkoppelte Sammlung von Tools, sondern ein einheitliches Daten- und KI-Ökosystem, das darauf ausgelegt ist, die Fragmentierung von Daten, Tools und Teams zu überbrücken, die die Maschinenlernen bis heute plagen. Traditionell findet die KI-Entwicklung in isolierten Umgebungen statt, und manchmal ist die Datenverteilung und -speicherung über mehrere Repositorys verstreut. Beispielsweise können Organisationen Kundendaten in SQL-Warenhäusern speichern, während unstrukturierte Dokumente in einen Data Lake geladen werden. Wenn Daten isoliert sind, sieht die KI nur eine “partielle Wahrheit”, was zu voreingenommenen Ergebnissen oder hohen Halluzinationsraten führt, da sie den vollen Kontext des Unternehmens nicht hat.

Vertex AI versucht, den gesamten Lebenszyklus zu integrieren, von der rohen Datenaufnahme in BigQuery und Cloud Storage bis zur Produktionsüberwachung, und dient im Wesentlichen als “Bindegewebe” zwischen diesen Silos. Vertex AI integriert sich nativ mit Cloud Storage und BigQuery, sodass die KI-Modelle auf die Daten zugreifen können, ohne komplexe Extraction-, Transformation- und Load-Pipelines (ETL) zu benötigen.

Die Grundlage: Google’s AI-Hypercomputer

Die GenAI-Schicht von Vertex AI sitzt auf Google’s AI-Hypercomputer-Architektur, einem integrierten Supercomputersystem, das aus besteht:

TPU v5p & v5e (Tensor Processing Units)

Google’s Tensor Processing Units sind benutzerdefinierte ASICs (Application-Specific Integrated Circuits), die speziell für die Matrixmultiplikation entwickelt wurden, die das Deep Learning definiert.

- TPU v5p (Leistung): Dies ist der Flaggschiff-Beschleuniger für massive Trainings. Jedes TPU-v5p-Modul kann auf 8.960 Chips skaliert werden, die durch Google’s höchstbandbreiteste Inter-Chip-Interconnect (ICI) mit 4.800 Gbps verbunden sind. Für einen Tech-Leader bedeutet dies 2,8-mal schnellere Trainingszeiten für ein GPT-3-Modell (175 Milliarden Parameter) im Vergleich zur vorherigen Generation, was die Zeit bis zur Markteinführung drastisch reduziert.

- TPU v5e (Effizienz): Dies ist für “kostenoptimierte” Leistung konzipiert, die v5e ist der Arbeitstier für mittelgroßes Training und Hochdurchsatz-Schließen. Es bietet bis zu 2,5-mal bessere Preis-Leistung, was es zur idealen Wahl für Unternehmen macht, die 24/7-Schließen ohne riesiges Budget benötigen.

NVIDIA H100/A100-GPUs für Flexibilität

Während TPUs spezialisiert sind, verlassen sich viele Entwicklungsteams auf das NVIDIA-CUDA-Ökosystem. Vertex AI bietet eine erstklassige Unterstützung für NVIDIA’s neueste Hardware:

- NVIDIA H100 (Hopper): Ideal für das Feintuning der größten Open-Source-Modelle (wie Llama 3.1 405B), die eine massive Speicherbandbreite erfordern.

- Jupiter-Netzwerk: Um den “Netzwerk-Flaschenhals” zu vermeiden, verwendet Google sein Jupiter-Rechenzentrums-Netzwerk. Dies stellt sicher, dass Daten zwischen GPUs mit Lichtgeschwindigkeit bewegt werden, unterstützt RDMA (Remote Direct Memory Access), um CPU-Overhead zu umgehen und nahezu lokale Leistung über verteilte Knoten zu liefern.

Dynamische Orchestrierung

Der wichtigste technische Wandel in Vertex AI ist die dynamische Orchestrierung. In einer Legacy-Umgebung kann, wenn ein GPU-Knoten während eines 3-wöchigen Trainings ausfällt, der gesamte Job zusammenbrechen.

- Automatisierte Widerstandsfähigkeit: Vertex AI, oft von Google Kubernetes Engine (GKE) angetrieben, verfügt über “Selbstheilung”-Knoten. Wenn ein Hardware-Defekt erkannt wird, migriert die Plattform die Arbeitslast automatisch auf einen gesunden Knoten.

- Dynamischer Arbeitsplan-Manager: Dieses Tool ermöglicht es Teams, Kapazitäten basierend auf Dringlichkeit anzufordern. Sie können Flex-Start (günstiger, startet, wenn Kapazität verfügbar ist) oder garantierte Kapazität für mission-kritische Veröffentlichungen wählen.

- Serverloses Training: Für Teams, die null Infrastrukturverwaltung wünschen, ermöglicht Vertex AI serverloses Training, dass Sie Ihren Code und Ihre Daten einreichen; die Plattform stellt den Cluster bereit, führt den Job aus und beseitigt ihn – und berechnet Ihnen nur die verwendeten Rechensekunden.

Die drei Einstiegspunkte: Entdeckung, Experimentierung und Automatisierung

Um unterschiedliche technische Persönlichkeiten – von Datenwissenschaftlern bis hin zu Anwendungs-Entwicklern – zu unterstützen, bietet Vertex AI drei primäre Einstiegspunkte:

- Model Garden: Der Marktplatz für Entdeckung.

- Vertex AI Studio: Der Spielplatz für Experimentierung.

- Vertex AI Agent Builder: Die Fabrik für Automatisierung.

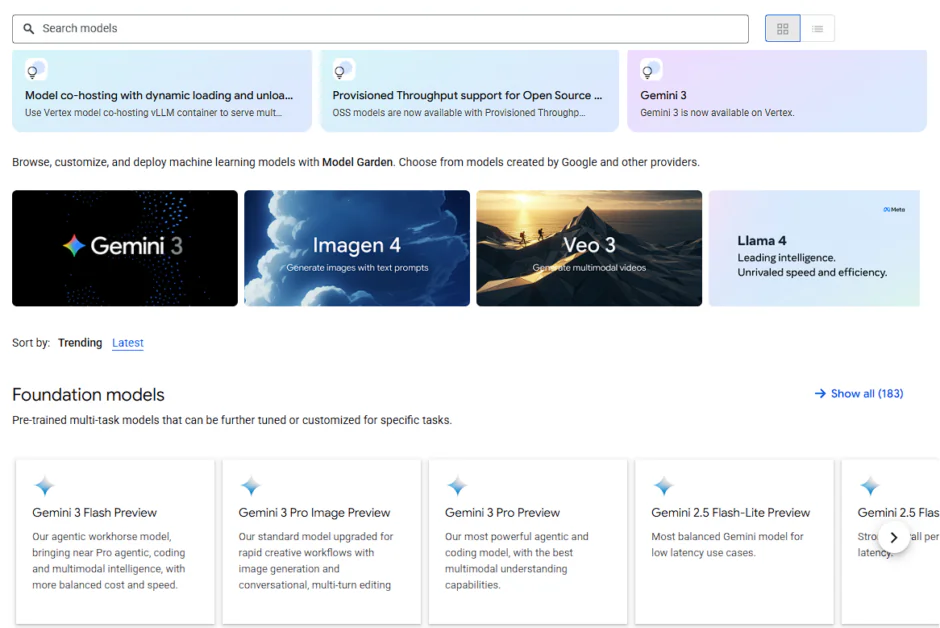

Model Garden: Der Marktplatz für Entdeckung

Google Cloud’s Vertex AI Model Garden ist eine zentrale Plattform innerhalb von Google Cloud für das Entdecken, Testen, Anpassen und Bereitstellen einer breiten Palette von erstklassigen, Open-Source- und Drittanbieter-KI-Modellen, einschließlich multimodaler Modelle (Bild, Text, Code) für verschiedene Geschäftsanforderungen, und bietet eine nahtlose Integration mit Vertex AI-Tools für einen gestreamten MLOps-Prozess. Es fungiert als umfassende Bibliothek, die Entwicklern und Unternehmen hilft, das richtige Modell (von großen Grundmodellen bis hin zu spezialisierten) für ihre Aufgaben auszuwählen, sei es für Textgenerierung, Bildanalyse oder Code-Vervollständigung, und diese effizient innerhalb ihrer Google Cloud-Umgebung bereitzustellen.

Model Garden kategorisiert seine 200+ Modelle in drei verschiedene Ebenen, sodass Architekten Leistung, Kosten und Kontrolle ausbalancieren können:

- Erstklassige (Google-) Modelle: Dies sind die Flaggschiff-Multimodal-Modelle, die innerhalb von Vertex AI verfügbar sind, und Google bietet sie in verschiedenen Größen an, von Pro mit komplexer Argumentation bis hin zu Flash mit geringer Latenz und hoher Volumen, sodass Entwickler ihre Modelle entsprechend ihrer Anwendungsfälle optimieren können.

- Drittanbieter-(Proprietäre-) Modelle: Durch strategische Partnerschaften bietet Vertex AI “Modell-as-a-Service”-(MaaS-) Zugang zu Giganten wie Anthropic (Claude 3.5) und Mistral AI. Anstatt separate Abrechnung und Sicherheitsanmeldeinformationen für fünf verschiedene KI-Anbieter zu verwalten, kann ein Tech-Team auf all diese über ihr bestehendes Google Cloud-Projekt zugreifen, unter Verwendung eines einheitlichen API-Formats.

- Open-Source- & Open-Weight-Modelle: Diese Ebene umfasst Meta’s Llama 3.2, Mistral und Google’s eigenes Gemma. Diese sind ideal für Organisationen, die Modelle innerhalb ihrer eigenen VPC (Virtual Private Cloud) selbst bereitstellen möchten, um eine maximale Datentrennung zu gewährleisten.

In einer nicht einheitlichen Umgebung erfordert die Bereitstellung eines Open-Source-Modells wie Llama das Einrichten einer PyTorch-Umgebung, das Konfigurieren von CUDA-Treibern und das Verwalten einer Flask- oder FastAPI-Hülle.

Model Garden eliminiert diese “Munging”-Phase durch vereinheitlichte verwaltete Endpunkte:

- Ein-Klick-Bereitstellung: Für viele Modelle stellt das Klicken auf “Bereitstellen” automatisch die notwendigen TPU-/GPU-Ressourcen bereit, wickelt das Modell in einen produktionsreifen Container ein und bietet einen REST-API-Endpunkt.

- Hugging Face-Integration: Vertex AI ermöglicht es nun Entwicklern, Modelle direkt aus dem Hugging Face-Hub in einen Vertex-Endpunkt zu deployen, wodurch eine fast unendliche Erweiterung der verfügbaren Intelligenz möglich ist.

- Private Service Connect (PSC): Für hoch regulierte Branchen können Modelle mithilfe von Private Service Connect bereitgestellt werden, wodurch sichergestellt wird, dass der Modell-Endpunkt nie dem öffentlichen Internet ausgesetzt ist – und den Datenverkehr strikt innerhalb des Unternehmensnetzwerks hält.

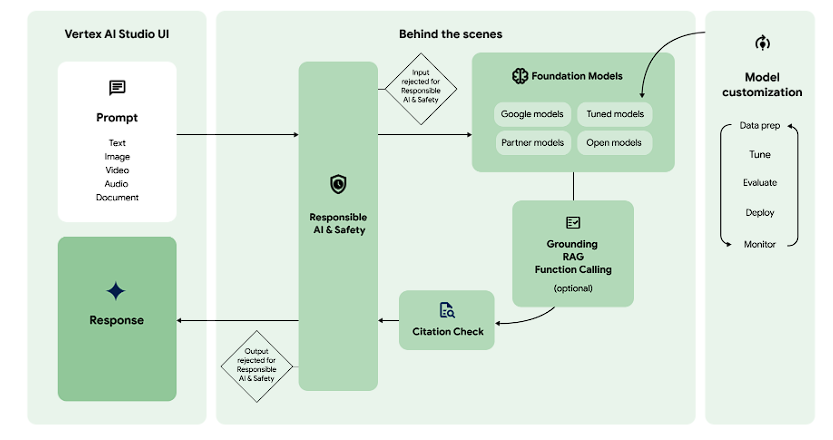

Vertex AI Studio: Der Spielplatz für Experimentierung

Während der Model Garden um Auswahl geht, ist Vertex AI Studio um Präzision. Vertex AI Studio kann mit den Compilern und Debuggern verglichen werden, die man in der traditionellen Softwarewelt antrifft. Das Vertex AI Studio ist der Arbeitsbereich, in dem rohe Modelle durch eine Kombination aus Prompt-Engineering, multimodalem Testen und erweitertem Hyperparameter-Tuning in spezifische Geschäftstools geformt werden.

Multimodale Prototyping: Jenseits von Text

Eine der herausragenden Funktionen des Studios ist seine native Unterstützung für Multimodalität. Während andere Plattformen komplexe Codierung erfordern, um Nicht-Text-Daten zu verarbeiten, ermöglicht Vertex AI Studio das direkte Einfügen von Dateien in die Schnittstelle, um die Gemini 2.5-Argumentationsfähigkeiten zu testen.

- Video-Intelligenz: Man kann eine 45-minütige technische Keynote hochladen und das Modell auffordern, “jedes Mal, wenn ein bestimmtes API erwähnt wird, eine zeitgestempelte Zusammenfassung zu liefern”.

- Dokumentenanalyse: Anstatt nur Text zu lesen, kann das Modell die visuelle Anordnung eines 1.000-seitigen PDF analysieren und die Beziehung zwischen Diagrammen, Tabellen und dem umgebenden Text verstehen.

- Code-Ausführung: Das Studio unterstützt nun die Code-Ausführung im Spielplatz. Wenn man ein Modell auffordert, ein komplexes Mathematikproblem zu lösen oder eine CSV zu analysieren, kann das Modell Python-Code in einer sicheren, sandboxbasierten Umgebung schreiben und ausführen, um eine verifizierte Antwort zu liefern.

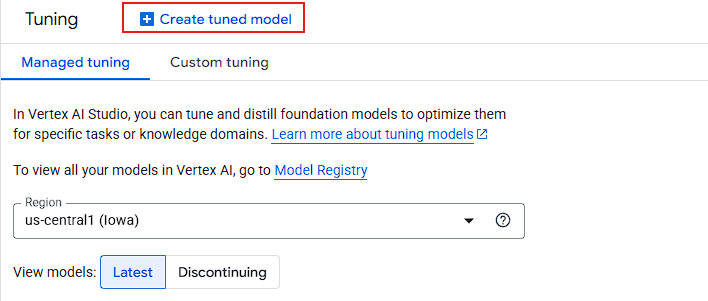

Erweiterte Anpassung: Der Feinabstimmungsweg

Wenn Prompt-Engineering (Zero-Shot oder Few-Shot) an seine Grenzen stößt, bietet Vertex AI Studio die schwere Artillerie: Modellfeinabstimmung.

- Überwachtes Feinabstimmung (SFT): Entwickler stellen ein Dataset von “Prompt/Antwort”-Paaren (idealerweise 100+ Beispiele) bereit. Dies lehrt das Modell, eine bestimmte Markenstimme, Ausgabeformat (wie spezielles JSON) oder domänen-spezifische Jargon zu übernehmen.

- Kontext-Caching: Für Unternehmen, die mit massiven, statischen Datensätzen (wie einer juristischen Bibliothek oder einem Codebasis) zu tun haben, ermöglicht das Studio Kontext-Caching. Dies ermöglicht es, eine Million Token an Daten im Modell-Speicher vorzuladen, was die Latenz und Kosten für nachfolgende Abfragen drastisch reduziert.

- Destillation (Lehrer-Schüler): Dies ist eine architektonische Maßnahme. Man kann ein massives Modell (Gemini 2.5 Pro) verwenden, um ein kleineres, schnelleres Modell (Gemini 2.0 Flash) zu “unterrichten”. Das Ergebnis ist ein leichtes Modell, das auf “Pro”-Niveau performt, aber mit “Flash”-Geschwindigkeit und -Kosten läuft.

Vertex AI Agent Builder: Die Fabrik für Automatisierung

Vertex AI Agent Builder ist ein hochrangiges Orchestrierungsframework, das es Entwicklern ermöglicht, diese Agenten durch Kombination von Grundmodellen mit Unternehmensdaten und externen APIs zu erstellen.

Die Architektur der “Wahrheit”: Grounding & RAG

Die primäre technische Barriere für Unternehmens-KI ist Halluzination. Agent Builder löst dies durch einen komplexen Grounding-Motor.

- Grounding mit Google-Suche: Für Abfragen, die Echtzeit-Weltwissen erfordern (z. B. “Was sind die aktuellen Hypothekenraten in New York?”), kann der Agent eine Google-Suche durchführen, Fakten extrahieren und Quellen zitieren.

- Vertex AI-Suche (RAG-as-a-Service): Anstatt manuell eine Vektordatenbank (Pinecone, Weaviate) zu erstellen, können Entwickler Vertex AI-Suche verwenden, um ihre eigenen Dokumente (PDFs, HTML, BigQuery) zu indexieren. Es handhabt die “Chunking-“, “Embedding-” und “Abruf”-Schritte automatisch, um sicherzustellen, dass der Agent nur auf der Grundlage der internen “Quelle der Wahrheit” antwortet.

- Vertex AI RAG-Motor: Für hochskalierte, benutzerdefinierte Implementierungen ermöglicht dieser verwaltete Dienst eine hybride Suche (Kombination aus vektorbasierter und keywordbasierter Suche), um die Genauigkeit um bis zu 30 % über Standard-LLM-Ausgaben zu verbessern.

Mehrere Agenten-Orchestrierung (A2A-Protokoll)

Erweiterte Unternehmens-Workflows erfordern oft mehrere spezialisierte Agenten, die zusammenarbeiten. Vertex AI führt das Agent-zu-Agent (A2A)-Protokoll ein, einen offenen Standard, der es ermöglicht:

- Den “Reiseagenten”, mit dem “Finanzagenten” zu sprechen, um sicherzustellen, dass eine Flugbuchung im Rahmen des Unternehmensbudgets liegt.

- Interoperabilität: Da es ein offenes Protokoll verwendet, können Agenten, die auf Vertex gebaut sind, mit denen kommunizieren, die auf anderen Frameworks wie LangChain oder CrewAI gebaut sind.

Der Entwicklerstapel: ADK und Agent-Engine

Für das “Tech-Plattform”-Publikum bietet der Agent-Builder zwei unterschiedliche Wege:

- No-Code-Konsole: Eine visuelle Drag-and-Drop-Schnittstelle für schnelles Prototyping und Konfiguration durch Geschäftsanwender.

- Agent-Entwicklungskit (ADK): Ein code-first-Python-Toolkit für Ingenieure. Es ermöglicht “Prompt-as-Code”, Versionierung, Integration und die Möglichkeit, auf die Vertex AI-Agent-Engine zu deployen – eine verwaltete Laufzeit, die Sitzungspersistenz, Skalierung und Zustandsverwaltung automatisch handhabt.

Zusammenfassung: Von “Was wenn” zu “Was als Nächstes”

Der Übergang von einer beeindruckenden KI-Demo zu einer produktionsreifen Unternehmensanwendung war lange der “Tal des Todes” für digitale Transformationsprojekte. Wie wir erforscht haben, ist Vertex AI speziell darauf ausgelegt, diese Lücke zu schließen. Durch die Vereinigung der fragmentierten Silos von Daten, Infrastruktur und Modell-Orchestrierung hat Google Cloud das Gespräch von der rohen Kraft der Large Language Modelle weg und hin zur betrieblichen Reife des KI-Lebenszyklus bewegt.