Künstliche Intelligenz

Ein von KI angetriebener Vorurteils-Prüfer für Nachrichtenartikel, verfügbar in Python

Forscher in Kanada, Indien, China und Australien haben zusammengearbeitet, um ein kostenlos verfügbares Python-Paket zu erstellen, das effektiv verwendet werden kann, um “unfaire Sprache” in Nachrichtentexten zu erkennen und zu ersetzen.

Das System, betitelt Dbias, verwendet verschiedene maschinelle Lern-Technologien und Datenbanken, um einen dreistufigen Kreislauf zu entwickeln, der voreingenommene Texte verfeinern kann, bis er eine nicht voreingenommene oder zumindest neutralere Version zurückgibt.

Geladene Sprache in einem Nachrichtensnippet wird als ‘voreingenommen’ identifiziert und durch Dbias in eine weniger anstößige Version umgewandelt. Quelle: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Das System stellt eine wiederverwendbare und selbstenthaltene Pipeline dar, die über Pip von Hugging Face installiert und in bestehende Projekte als zusätzliche Stufe, Add-on oder Plugin integriert werden kann.

Im April wurde eine ähnliche Funktionalität, die in Google Docs implementiert wurde, kritisiert, nicht zuletzt wegen ihres Fehlens an Editierbarkeit. Dbias hingegen kann selektiver auf jeden Korpus von Nachrichten trainiert werden, den der Endbenutzer wünscht, und behält die Fähigkeit, maßgeschneiderte Fairness-Richtlinien zu entwickeln.

Der kritische Unterschied besteht darin, dass die Dbias-Pipeline darauf ausgelegt ist, “geladene Sprache” (Wörter, die eine kritische Schicht zur faktischen Kommunikation hinzufügen) automatisch in neutrale oder prosaische Sprache umzuwandeln, anstatt den Benutzer kontinuierlich zu unterrichten. Im Wesentlichen wird der Endbenutzer ethische Filter definieren und das System entsprechend trainieren; im Google-Docs-Ansatz wird das System – angeblich – den Benutzer in einseitiger Weise trainieren.

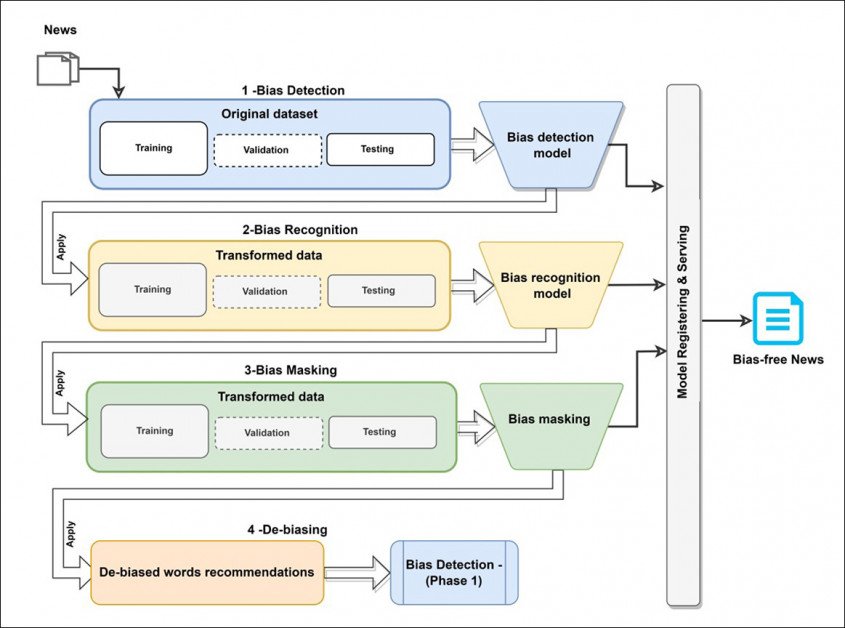

Konzeptionelle Architektur für den Dbias-Workflow.

Laut den Forschern ist Dbias das erste wirklich konfigurierbare Vorurteils-Erkennungspaket, im Gegensatz zu den vorherigen Projekten in diesem Bereich des Natural Language Processing (NLP), die durch vorgefertigte Assembly- Projekte gekennzeichnet sind.

Das neue Papier trägt den Titel Ein Ansatz, um Fairness in Nachrichtenartikeln zu gewährleisten und stammt von Mitwirkenden der University of Toronto, Toronto Metropolitan University, Environmental Resources Management in Bangalore, DeepBlue Academy of Sciences in China und der University of Sydney.

Methode

Das erste Modul in Dbias ist Vorurteils-Erkennung, das das DistilBERT-Paket nutzt – eine hoch optimierte Version von Googles maschinenintensivem BERT. Für das Projekt wurde DistilBERT auf dem Media Bias Annotation- (MBIC)-Datensatz fein abgestimmt.

MBIC besteht aus Nachrichtenartikeln aus verschiedenen Medienquellen, einschließlich Huffington Post, USA Today und MSNBC. Die Forscher verwendeten die erweiterte Version des Datensatzes.

Obwohl die ursprünglichen Daten von Crowdsourced-Arbeitern annotiert wurden (eine Methode, die spät im Jahr 2021 in die Kritik geriet), konnten die Forscher des neuen Papiers zusätzliche nicht markierte Beispiele von Voreingenommenheit im Datensatz identifizieren und diese manuell hinzufügen. Die identifizierten Vorfälle von Voreingenommenheit bezogen sich auf Rasse, Bildung, Ethnie, Sprache, Religion und Geschlecht.

Das nächste Modul, Vorurteils-Erkennung, verwendet Named Entity Recognition (NER), um voreingenommene Wörter aus dem Eingabetext zu identifizieren. Das Papier besagt:

‘Beispielsweise wurde die Nachricht “Kaufen Sie die pseudo-wissenschaftliche Aufregung über Tornados und Klimawandel nicht” von dem vorherigen Vorurteils-Erkennungsmodul als voreingenommen eingestuft, und das Vorurteils-Erkennungsmodul kann jetzt den Begriff “pseudo-wissenschaftliche Aufregung” als voreingenommenes Wort identifizieren.’

NER ist nicht speziell für diese Aufgabe entwickelt worden, wurde aber vorher für die Voreingenommenheits-Identifizierung verwendet, insbesondere für ein 2021-Projekt der Durham University im Vereinigten Königreich.

Für diese Phase verwendeten die Forscher RoBERTa in Kombination mit der SpaCy English Transformer NER-Pipeline.

Die nächste Stufe, Vorurteils-Maskierung, beinhaltet eine neuartige multiple Maskierung der identifizierten Voreingenommenheitswörter, die sequentiell in Fällen von mehreren identifizierten Voreingenommenheitswörtern operiert.

Geladene Sprache wird durch Dbias in der dritten Stufe durch pragmatische Sprache ersetzt.

Wenn notwendig, wird das Feedback aus dieser Phase an den Anfang der Pipeline zurückgesendet, um weitere Bewertungen durchzuführen, bis eine Reihe von geeigneten alternativen Formulierungen oder Wörtern generiert wurde. Diese Phase verwendet Masked Language Modeling (MLM) entlang der Linien, die durch eine 2021-Zusammenarbeit unter der Leitung von Facebook Research etabliert wurden.

Normalerweise wird die MLM-Aufgabe 15 % der Wörter zufällig maskieren, aber der Dbias-Workflow sagt dem Prozess, die identifizierten voreingenommenen Wörter als Eingabe zu verwenden.

Die Architektur wurde auf Google Colab Pro auf einem NVIDIA P100 mit 24 GB VRAM bei einer Batch-Größe von 16 mit nur zwei Labels (voreingenommen und unvoreingenommen) implementiert und trainiert.

Tests

Die Forscher testeten Dbias gegen fünf vergleichbare Ansätze: LG-TFIDF mit Logistischer Regression und TfidfVectorizer (TFIDF) Wort-Einbettungen; LG-ELMO; MLP-ELMO (ein feed-forward künstliches neuronales Netzwerk, das ELMO-Einbettungen enthält); BERT; und RoBERTa.

Die für die Tests verwendeten Metriken waren Genauigkeit (ACC), Präzision (PREC), Recall (Rec) und ein F1-Score. Da die Forscher keine Kenntnis von einem bestehenden System hatten, das alle drei Aufgaben in einer einzigen Pipeline ausführen konnte, wurde eine Ausnahme für die konkurrierenden Frameworks gemacht, indem nur Dbias’ primäre Aufgaben – Vorurteils-Erkennung und -Erkennung – bewertet wurden.

Ergebnisse der Dbias-Tests.

Dbias übertraf die Ergebnisse aller konkurrierenden Frameworks, einschließlich derjenigen mit einem höheren Verarbeitungsbedarf