Andersons Blickwinkel

KI-Modelle bevorzugen menschliches Schreiben gegenüber KI-generiertem Schreiben

Laut einer neuen Studie zeigen ChatGPT und ähnliche Modelle jetzt eine klare Vorliebe für Texte, von denen sie glauben, dass sie von Menschen geschrieben wurden, auch wenn diese Annahme falsch ist. Schon die bloße Bezeichnung eines Textes als “menschengemacht” veranlasst KI-Modelle, ihn zu bevorzugen – und ironischerweise können sie diese Vorurteile möglicherweise von uns lernen.

Die Vorstellungen von Authentizität, Herkunft und gemeinsamer menschlicher Erfahrung könnten in der Offensive der KI auf den kreativen Schreibsektor eine größere Rolle spielen, als bisher angenommen: Tests, die für eine neue Studie an der Princeton University durchgeführt wurden, haben ergeben, dass eine Reihe von großen, geschlossenen und offenen Sprachmodellen, einschließlich ChatGPT, Texte bevorzugen, von denen sie glauben, dass sie von Menschen generiert wurden.

Selbst wenn die Labels auf den Schreibproben vertauscht wurden, fanden sowohl KI-Modelle als auch menschliche Teilnehmer weiterhin Fehler im KI-geschriebenen Text, was die gleichen Kritikpunkte widerspiegelt, die sie gemacht hatten, als er richtig beschriftet war.

Die Forscher glauben, dass Teil des Grundes darin liegen könnte, dass die wachsende menschliche Feindseligkeit gegenüber generativer KI, die anscheinend jeden Tag neue und interessante Ereignisse hervorbringt, in die KI-Systeme selbst zurückgeführt werden könnte. Sie stellen fest, dass die KI ihr eigenes Schreiben noch mehr ablehnt als Menschen, und schreiben:

‘Die 13 KI-Modelle, die wir getestet haben, zeigten eine Vorurteilsschwäche von 34,3 Prozentpunkten im Vergleich zu 13,7 Prozentpunkten bei Menschen, was sie 2,5-mal anfälliger für Zuschreibungs-Hinweise macht als unsere menschlichen Bewerter.

‘Diese Verstärkung ist sinnvoll, sobald wir erkennen, dass zeitgenössische Modelle präferenz-geschulte Bewerter sind. Alignment-Training durch Reinforcement Learning from Human Feedback (RLHF) lehrt die Modelle explizit, menschliche Urteile als ihren Goldstandard zu behandeln, was effektiv eine gelernte Zuverlässigkeit [Prior] installiert.

‘Modelle lernen, dass das Nachgeben menschlicher Präferenzen belohnt wird, was zu einer Schmeichelei führt, bei der sie erwartete Benutzerhaltungen widerspiegeln, anstatt eine unabhängige Bewertung zu liefern.’

Die Ergebnisse gelten für den Bereich des kreativen Schreibens, wobei die Forscher Geschichten eines angesehenen französischen Autors als Datensamples verwendet haben; und sie zeigen, dass menschliche Vorurteile gegenüber KI möglicherweise die quantitative Verbesserung der Sprachkonstruktion, die Large Language Models (LLMs) bei ihrer Entwicklung erzielen können, überwiegen – und dass das “KI”-Label möglicherweise zu bedeuten beginnt, “unecht”, “ersatz” und sogar “zweitrangig” in diesem Bereich.

Viele der Gründe beruhen auf kultureller Praxis und Nutzung: Die Studie zeigt, dass Kreativität oft in Bezug auf Neuheit, Wert und Typizität beschrieben wird, d. h. wie “neu” etwas erscheint; wie sehr es von Experten “geschätzt” wird; und wie gut es in seine Kategorie passt. Wenn ein Abschnitt als “menschengeschrieben” beschriftet wird, werden vertraute Gattungsmerkmale als wertvoll belohnt; wenn er als “KI-generiert” beschriftet wird, werden dieselben Merkmale als unoriginell abgelehnt.

In der Tat löst die Offenlegung der Quelle eine Neubewertung des Wertes des Werks aus, die durch Annahmen über seine Entstehung geprägt ist. Sobald die KI-Autorschaft bekannt gegeben wird, lehnen Leser instinktiv die Möglichkeit individueller Entdeckung oder Absicht hinter der Ausgabe ab.

Die Studie stellt fest*:

‘In den meisten Künsten gibt es keinen Goldstandard für “kreativ genug”, was Herkunfts-Hinweise zu mächtigen Priming-Faktoren macht, die das Kriterium verschieben können, das am meisten hervorsticht: disziplinierte Handwerk oder auffällige Neuheit, Zugänglichkeit oder Schwierigkeit.

‘Da Beobachter oft den Prozess aus dem Produkt ableiten, lenken Herkunfts-Hinweise Urteile über die Art und Weise, wie etwas gemacht wurde, sowie über das, was es ist: konservative Schritte können als Handwerk von einem Menschen anerkannt werden, aber als “bloße Generation” von einem Modell abgelehnt werden’.

Dreizehn Modelle, einschließlich Varianten von ChatGPT, Claude, Gemini und Mistral, nahmen neben menschlichen Lesern teil, wobei alle die Geschichten bevorzugten, wenn sie ihnen sagten, dass sie von Menschen gemacht seien, wobei LLMs einen stärkeren Vorurteil als Menschen zeigten.

Die Idee, dass KI-Modelle möglicherweise einen Vorurteil gegen ihre eigene Ausgabe aufgenommen haben, wirft Fragen darüber auf, woher dieser Vorurteil stammt. Da KI-Schreiben nicht immer leicht zu identifizieren ist, stammen negative Assoziationen, die während der Schulung gebildet werden, wahrscheinlich aus Beispielen, die explizit beschriftet sind, entweder durch Berichterstattung über KI-Inhalte oder selbstdeklarierte KI-generierte Artikel in Mainstream-Publikationen.

Die neue Studie trägt den Titel Jeder bevorzugt menschliche Schreiber, einschließlich KI und stammt von zwei Autoren des Center for Digital Humanities der Princeton University. Die Arbeit wird von einer verwandten Datenveröffentlichung auf Zenodo begleitet (mit einer GitHub-Veröffentlichung, die im Paper zitiert wird, aber zum Zeitpunkt des Schreibens nicht aktiv war).

Methode

Um zu untersuchen, wie die Zuschreibung Auswirkungen auf und Formen von Wahrnehmungen von Stil und Kreativität hat, verwendeten die Autoren Exercices de style, ein exzentrisches Werk von Raymond Queneau aus dem Jahr 1947, das eine einfache Anekdote in 99 verschiedenen Stilen umschreibt. Die Geschichte folgt einem Mann, der in einen Bus steigt, mit einem anderen Fahrgast streitet und später von einem Freund Modeberatung erhält.

Obwohl literarischen Ursprungs, antizipiert diese Struktur prompt-basierte Transformationen in modernen Sprachmodellen, bei denen Benutzer Umbenennungen in bestimmten Tönen, Stimmen oder Registern anfordern. Dieser Prozess wurde einst als Transstylisierung bezeichnet – eine Rahmung, die nun in der KI-Forschung im Kontext von Style-Transfer widerhallt. Während die meisten computergestützten Methoden funktionale Änderungen wie Stimmungsverschiebungen oder Entgiftung anstreben, zielen Queneaus Umschreibungen auf bemerkenswerte stilistische Kontraste ab.

Aus einer populären englischen Übersetzung von Queneaus Werk wurden dreißig Übungen ausgewählt, die die Erzählung bewahrten, während sie einen breiten stilistischen Bereich abdeckten. Dazu gehörten eingeschränkte Formen wie Alexandriner und Lipogramme, Änderungen der Register wie edel oder missbräuchlich, narrative Verschiebungen wie rückwärts und Zögern und spielerische Verzerrungen, die Lautmalereien, Onomatopöien oder Dog Latin beinhalteten:

Beispiele aus der Studie, die zeigen, wie GPT-4 Queneaus Geschichten in verschiedenen literarischen Stilen umschrieb, kombiniert mit den Stilbeschreibungen, die menschliche und KI-Bewerter während der Tests sahen. Quelle: https://arxiv.org/pdf/2510.08831

Da Queneaus Experimente schwer zu klassifizieren sind, sind diese Kategorien nur ungefähre Gruppierungen, mit dem Ziel, nicht die Erkennbarkeit oder die Einhaltung von Gattungen zu testen, sondern vielmehr, diverse Bedingungen zu schaffen, unter denen (menschliche) Leser und Modelle ihre Vorurteile offenbaren könnten.

Um AI-generierte Gegenstücke für jeden ausgewählten Stil zu produzieren, verwendeten die Forscher absichtlich minimale Anweisungen. Jedes Modell erhielt die einfachste Version von Queneaus Anekdote (die erste Übung, Notation), zusammen mit einer kurzen Anweisung, sie in einem bestimmten Stil umzuschreiben, wie z. B. Die Geschichte als Science-Fiction-Version umschreiben. Dieser Ansatz ermöglichte es, Anweisungen zu verwenden, die den Geist von Queneaus ursprünglichen Transformationen widerspiegelten, während das Modell den Stil dennoch frei interpretieren konnte.

Daten und Tests

Die Forscher zeigten denselben Paar von Geschichten verschiedenen Gruppen von Menschen, aber änderten die Labels, um zu sehen, wie sehr der Name des Autors die Meinungen beeinflusste: Eine Gruppe sah keine Autorennamen, nur Labels ‘A’ und ‘B’. Die zweite Gruppe sah die richtigen Namen, mit einer Version, die als von einem Menschen geschrieben markiert war, und der anderen, die als von GPT-4o geschrieben markiert war.

Eine dritte Gruppe sah die Namen vertauscht, mit der ‘KI’-Geschichte als ‘menschlich’ markiert und der ‘menschlichen’ Version als ‘KI’ markiert:

Überblick über Studie 1. Menschliche und KI-Bewerter verglichen 30 Paare von Geschichten, von denen jedes eine Version von Queneau und eine von GPT-4 enthielt. Die Bewerter wurden in drei Gruppen aufgeteilt: Eine sah keine Autoren-Labels; eine sah die richtigen Labels; und eine sah die Labels vertauscht – ein Setup, das darauf abzielte, den Umfang zu testen, in dem Autorennamen die Meinungen über den Schreibstil beeinflussen.

Studie 1

Die Forscher teilten die 30 erstellten Stile in kleinere Mengen auf, wobei jeder Studienteilnehmer nur fünf Stile sah, und jeder Stil unter allen drei Beschriftungsszenarien getestet wurde.

Jeder Teilnehmer sah nur ein Beschriftungsszenario: Die blinden Gruppen sahen keine Erwähnung von KI, während die anderen Gruppen entweder die richtigen oder vertauschten Autoren-Labels sahen. Die Zuweisung der Gruppe, die Reihenfolge der Geschichte und die links-rechts-Anordnung wurden alle randomisiert.

Die KI-Modelle gingen durch denselben Prozess, erhielten die gleiche Mischung aus Stilen und die gleiche zufällige Anordnung. Jeder Test wurde dreimal pro Modell durchgeführt, um sicherzustellen, dass die Ergebnisse konsistent waren, was es ermöglichte, menschliche und KI-Reaktionen auf die Autoren-Labels zu vergleichen.

Studie 2 verwendete die gleichen drei Beschriftungsszenarien wie zuvor, aber erweiterte den Test auf alle 420 Geschichten, die von den 14 verschiedenen LLM-Modellen generiert wurden. Jedes Modell bewertete jede Geschichte unter jedem Beschriftungsszenario, was 1.260 Entscheidungen pro Modell ergab und insgesamt 17.596 gültige Bewertungen:

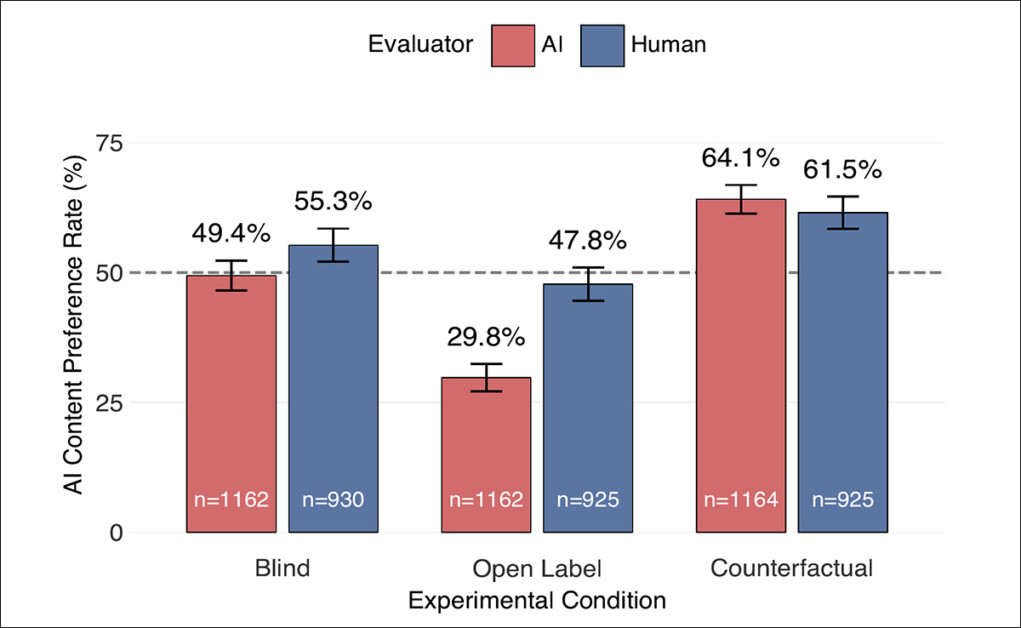

Ergebnisse aus Studie 1. KI- und menschliche Bewerter zeigten beide eine Vorurteilsneigung basierend auf Autoren-Labels. Wenn keine Labels angezeigt wurden (Blind), waren die Präferenzen nahezu gleich; wenn die richtigen Labels angezeigt wurden (Offene Beschriftung), bevorzugten beide Gruppen den von Menschen geschriebenen Text; und wenn die Labels vertauscht wurden (Kontrafaktisch), wechselten beide Gruppen zu einer Bevorzugung des Textes, von dem sie dachten, dass er von Menschen stammte – und dieser Effekt war in KI-Modellen stärker als bei Menschen. Fehlerbalken zeigen 95%-Konfidenzintervalle.

Über alle 13 Modelle hinweg entsprach das Muster dem menschlichen Vorurteil, war aber viel stärker: Ohne Labels bewerteten KI-Systeme menschliche und KI-Geschichten etwa gleich, wobei sie den KI-Text 49,4% der Zeit wählten; wenn das KI-Label sichtbar war, fiel diese Präferenz stark auf 29,8% ab, was eine klare Abwertung der anerkannten KI-Arbeit zeigt; und wenn derselbe Text als menschlich beschriftet wurde, stieg die Präferenz auf 64,1%.

Der Unterschied zwischen den beiden Beschriftungsszenarien betrug 34,3%, was bedeutet, dass die KI-Modelle ihre Präferenz viel stärker änderten als Menschen, wenn die Labels vertauscht wurden. Darüber hinaus waren die Modelle bei wiederholten Durchläufen sehr konsistent, was bestätigt, dass der Vorurteil stabil und nicht zufällig war.

Um zu überprüfen, ob der Vorurteil durch die Formulierung der Labels und nicht durch den Autor des Textes verursacht wurde, führten die Forscher zwei weitere Tests durch: Einer verwendete Labels, die die KI eindrucksvoller klingen ließen; und der andere verwendete neutrale Begriffe wie ‘KI-generiert’ und ‘Von Menschen generiert’.

Beide zeigten immer noch denselben Vorurteil, und selbst wenn die KI-Modelle dieselbe Antwort jedes Mal produzierten, bestand der Vorurteil fort, was darauf hindeutet, dass der Vorurteil durch die Art des Labels (‘menschlich’ oder ‘KI’) und nicht durch die genauen Wörter verursacht wird, die verwendet werden.

Studie 2

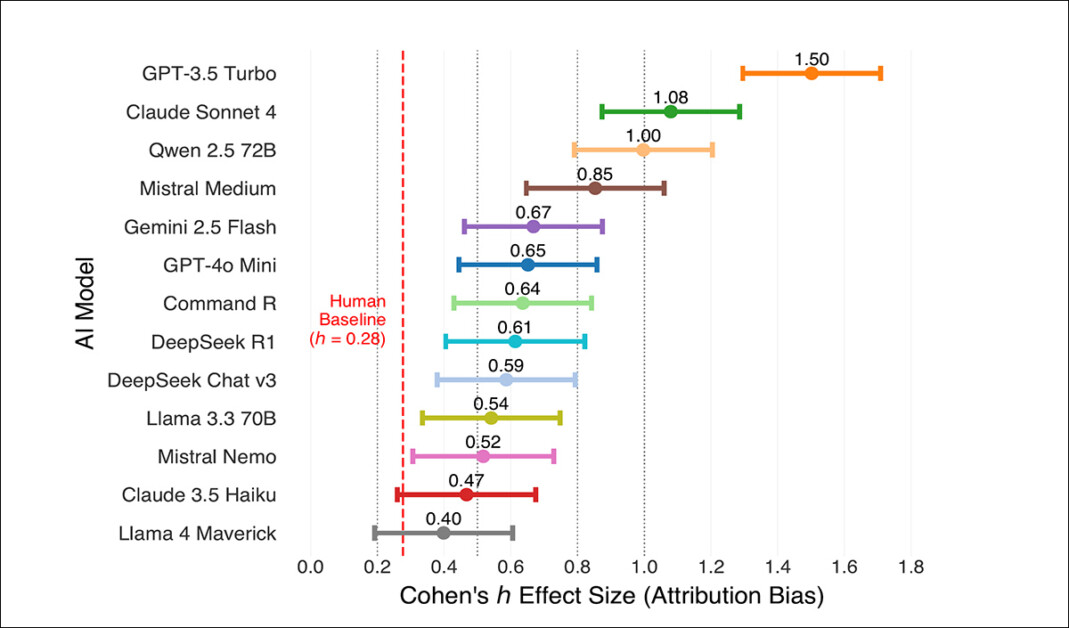

Die zweite Studie fand denselben pro-menschlichen Vorurteil bei allen 13 KI-Modellen, unabhängig von Architektur oder Anbieter:

Zuschreibungs-Vorurteil für jedes der 13 KI-Modelle: Balken zeigen Effektgrößen mit 95%-Konfidenzintervallen, und die rote Linie markiert die menschliche Referenzlinie. Alle Modelle zeigten einen stärkeren Vorurteil als Menschen, mit nur kleinen Unterschieden zwischen ihnen.

Jedes Modell bevorzugte Geschichten, die als von Menschen geschrieben beschriftet waren, mit stärkeren Effekten als bei Menschen. Selbst nach dem Entfernen des extremsten Falls blieb der durchschnittliche Vorurteil mehr als doppelt so groß wie die menschliche Version, was darauf hindeutet, dass der Effekt nicht ein Fehler in einem Modell ist, sondern ein gemeinsames Merkmal von LLMs im Allgemeinen.

Schlussfolgerung

Obwohl, wie die Studie feststellt, frühere Studien gezeigt haben, dass KI Schreiben produzieren kann, das dem von Menschen gleichwertig oder sogar besser ist, betonen die Autoren, dass in der Literatur der Wert, der auf Autorschaft und Authentizität gelegt wird, eine alte und tief verwurzelte Konvention ist:

‘Wenn GPT-4o Mini Queneaus “kreativen und humorvollen” Ansatz als “übertrieben” unter dem KI-Zuschreibungstag abtut, während er identische Merkmale unter menschlicher Zuschreibung lobt, offenbart es implizit, wie diese Labels Annahmen über den Prozess auslösen, der nicht stattgefunden hat.

‘Herkunfts-Hinweise schmuggeln den Prozess in das, was ansonsten eine produktonly-Beurteilung sein könnte, zurück: “bloße Generation” ist von einem Menschen (als geschicktes Handwerk bewertet) akzeptabel, aber von einem Modell (als algorithmische Rekombination bewertet) verdächtig.’

LLMs sind noch nicht zuverlässig genug für unüberwachte faktengestützte Forschung, obwohl sorgfältige Überwachung sie dennoch produktiv machen kann – aber KI-gestütztes kreatives Schreiben könnte eine unsicherere Zukunft bevorstehen, wenn KI-generierte kreative Werke durch eine umfassendere öffentliche Missbilligung von KIs Eingreifen in menschliche Bereiche stigmatisiert werden, anstatt auf literarische Verdienste basierend.

Die Auswirkungen der Ergebnisse von Studien dieser Art werden erheblich von der Bereitschaft von Unternehmen und einzelnen Nutzern beeinflusst, ehrlich zu sein, ob sie KI für ihre Ausgabe verwendet haben oder nicht. In einigen Fällen mag die Unwilligkeit, einen solchen Einsatz zuzugeben, mehr mit Unternehmensurheberrechts-Piraterie zu tun haben als mit der Sorge, ob die Öffentlichkeit KI-generierte kreative Werke akzeptieren wird.

Es gibt jedoch mögliche rechtliche, finanzielle und politische Lösungen (wenn auch sehr herausfordernde) in Bezug auf das Urheberrecht. Ob man jedoch Menschen dazu bringen kann, kreatives KI-Werk zu genießen, das keinem einzigen und nachvollziehbaren menschlichen Geist entspricht – das könnte ein noch schwierigeres Vorhaben sein.

* Bitte beachten Sie die Quellenstudie für ausgeschlossene inline-Zitate. Wenn notwendig, werden diese im Artikel aufgeführt.

Erstveröffentlicht am Montag, dem 13. Oktober 2025