Andersons Blickwinkel

KI-Chat-Modelle können durch endloses Geschwätz Kosten verursachen

Beliebte KI-Chat-Modelle verschwenden heimlich enorme Mengen an bezahlten Token für sinnloses Geschwätz. Die betroffenen Modelle wissen tatsächlich, dass sie dies tun, aber können sich nicht selbst stoppen.

Große Reasoning-Modelle (LRMs) wie ChatGPT-5 und Google Gemini verlangen mehr für Reasoning – das Schritt-für-Schritt-Lösen eines Problems, was wesentlich mehr Rechenleistung erfordert als die schnelle Vorhersage des nächsten Wortes. Der simulierte Reasoning-Prozess dauert länger und kostet mehr, um zu laufen; folglich zahlen die Benutzer für diese “extra Denkzeit”.

Wenn Sie jedoch kürzlich ein State-of-the-Art-LLM verwendet haben, haben Sie vielleicht bemerkt, dass Ihre Token-Zuweisung oft für Geschwätz und unnötigen Text ausgegeben wird, anstatt sich auf die Lösung der Probleme zu konzentrieren, die Sie dem Modell stellen. Dies kann sich in Form von übermäßiger Schmeichelei, umfangreichen und/oder redundanten Antworten oder sogar einer Art “Geschwätz” äußern, als ob die KI auf dem falschen Fuß erwischt wurde und versucht, sich durch Geschwätz aus einer unangenehmen Situation zu winden.

Natürlich würden wir es vorziehen, wenn unsere LLMs ihre Niederlage einräumen, alternative Pfade vorschlagen oder um Klarstellung bitten. Aber selbst wenn man eine KI dieser Art dazu bringt, zuzugeben, dass sie eine Antwort nicht kennt, ist dies eine erhebliche Herausforderung für sich.

In der Zwischenzeit können Benutzer auf niedrigeren oder kostenlosen Ebenen feststellen, dass sie ihre Token schnell aufgebraucht haben, unabhängig davon, wie gezielt oder sparsam ihre Anfragen und Interaktionen waren, weil die KI selbst gerne spricht; und in diesem Fall ist Reden nicht billig.

Wort-Salat

In Bezug auf das oben erwähnte “Geschwätz” bietet eine neue akademische Zusammenarbeit eine Begründung und eine Lösung, indem sie vorschlägt, dass LLMs mit Reasoning-Fähigkeiten dazu neigen, Ihre Token zu verbrennen, wenn sie in eine “Wort-Salat”-Schleife geraten – einem Zustand der Verwirrung, in dem der Reasoning-Prozess in rekursive Sackgassen verloren geht – auf Ihre Kosten*.

Die Forscher hinter dem neuen Paper haben festgestellt, dass ein erheblicher Teil der in einem typischen LLM verarbeiteten Token aus Wiederholungen und Redundanz besteht – und dass das Modell selbst zu verstehen scheint, dass es in Schwierigkeiten steckt, obwohl es nicht in der Lage ist, die teure Schleife zu stoppen.

Das Paper besagt:

‘Wir zeigen, dass ein erheblicher Teil dieser Token nutzlose Selbstwiederholungen sind – was wir “Wort-Salat” nennen –, die den Decodierungs-Haushalt ohne Mehrwert auslaugen. Interessanterweise beobachten wir, dass LRMs selbstbewusst sind, wenn sie in diesen Schleifen gefangen sind: die versteckten Zustände der <\n\n>-Token, die jedem Reasoning-Chunk folgen, zeigen Muster, die es uns ermöglichen, Wort-Salat-Verhalten auf die Schnelle über einen einzelnen linearer Klassifizierer zu erkennen.

‘Sobald es erkannt wird, ergibt ein einfaches Abschneiden, gefolgt von einem geradlinigen Regenerations-Prompt, erhebliche Längeneinsparungen mit minimalem Qualitätsverlust.’

Die Lösung, die durch die neue Arbeit angeboten wird, ist eine Intervention, die den spiralförmigen Prozess eines fehlerhaften Reasoning-LLMs auf die Schnelle stoppen kann, ohne dass Trainingsdaten erforderlich sind oder dass der Schaden entsteht, der durch Feinabstimmung verursacht wird. Das Framework, das WortSalatChopper genannt wird, wurde öffentlich auf GitHub veröffentlicht.

Obwohl die anfängliche Arbeit sich auf DeepSeek-Varianten wie Einträge in der Qwen- und Llama-Serie konzentriert, behauptet das Paper, dass das unerwünschte Verhalten wahrscheinlich auf eine viel größere Gruppe ähnlich strukturierter Reasoning-Modelle (einschließlich beliebter API-only-Angebote wie ChatGPT und Google Gemini) anwendbar ist.

Wie das Paper bemerkt, haben frühere Angebote wie Demystifying Long Chain-of-Thought Reasoning in LLMs und Small Models Struggle to Learn from Strong Reasoners ähnlich die kleine Anzahl öffentlich verfügbarer Chain-of-Thought (CoT)-Reasoning-Modelle verwendet, um ein umfassenderes Problem innerhalb dieser Klasse von Modellen zu etablieren†:

‘[LRMs] neigen dazu, einen enormen Teil des Decodierungs-Haushalts zu verschwenden, einfach indem sie sich selbst wiederholen wörtlich, mit leichten Variationen oder durch endlose Aufzählung von Fällen, bis der gesamte Haushalt aufgebraucht ist – wir bezeichnen ein solches Verhalten als Wort-Salat, ein Begriff, der oft verwendet wird, um öffentliche Sprecher zu verspotten, die langatmige, jargonvolle Antworten geben, die letztendlich keinen Inhalt oder klare Bedeutung haben.

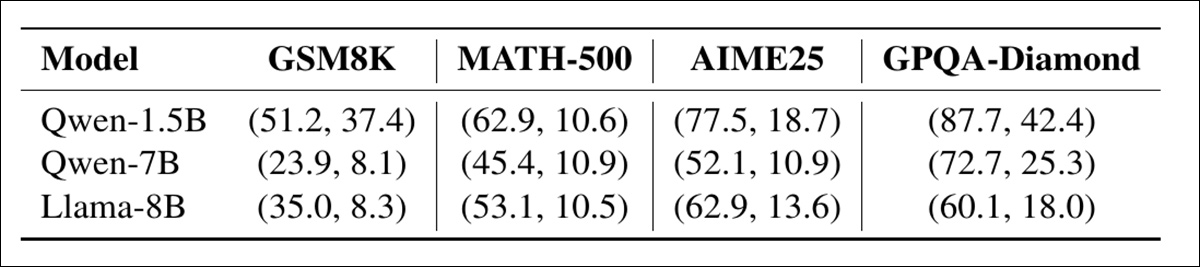

‘Die “Original”-Spalte in [der Tabelle unten] zeigt, dass wir bei der Beantwortung von GPQA-Diamond beobachten, dass 55%+ der von DeepSeek-R1-Distill-Modellen generierten Token als “Wort-Salat-Token” markiert sind, bei denen sie aus semantischer Sicht keinen Wert hinzufügen.’

![Der Anteil der als semantisch redundant identifizierten Ausgabe-Token bei der Beantwortung von GPQA-Diamond. WordSaladChopper reduziert diese Overhead von über 55% auf unter 6% bei allen getesteten DeepSeek-R1-Distill-Modellen, wie die Autoren behaupten. [ Quelle ] https://arxiv.org/pdf/2511.00536](https://www.unite.ai/wp-content/uploads/2025/11/table-1.jpg)

Der Anteil der als semantisch redundant identifizierten Ausgabe-Token bei der Beantwortung von GPQA-Diamond. WordSaladChopper reduziert diese Overhead von über 55% auf unter 6% bei allen getesteten DeepSeek-R1-Distill-Modellen, wie die Autoren behaupten. Quelle

Die Autoren bemerken, dass Versuche, die Reasoning-Prozesse zu verkürzen, während die Antwortqualität erhalten bleibt, zu einem starken Teilstrang in der Forschungsliteratur geworden sind, nämlich lang-zu-kurz (L2S); und beobachten weiter, dass ihre Projektziele ähnlich sind wie die von einigen früheren Initiativen, ihre eigene jedoch die erste ist, die eine ad hoc-Lösung anbietet, die keine Intervention im Trainingsprozess, Modellbearbeitung oder andere mögliche Eingriffe in die Basisarchitektur eines LLMs erfordert; und in diesem Sinne glauben sie, dass ihr Ansatz weit verbreitet werden sollte bei anwendbaren Systemen†:

‘Angesichts seines geringen Overheads, starker Einsparungen und des Fehlens semantischen Werts von Wort-Salat-Token glauben wir, dass es nicht allzu abwegig ist, zu argumentieren, dass [WordSaladChopper] – oder ein ähnliches Komponent – ein Muss für alle LRM-Anwendungen mit Benutzererfahrung im Sinn ist ‘

Das neue Paper trägt den Titel WordSaladChopper: Reasoning-Modelle verschwenden einen Haufen Decodierungs-Haushalt für nutzlose Wiederholungen, selbstbewusst und stammt von sechs Forschern der University of Minnesota, Rice University, der Stevens Institute of Technology und Lambda, Inc.

Vorherige Überlegungen

Um die Tendenz von Reasoning-LLMs zu verfolgen, sich selbst zu wiederholen, teilten die Autoren die Ausgabe der Modelle in Chunks, wo immer es Doppelzeilenumbrüche gab, und überprüften dann, wie ähnlich jedes Chunk einem früheren war:

Geschätzter Anteil der Reasoning-Chunks, die als Wort-Salat unter zwei Decodierungs-Temperaturen (τ = 0,0, 0,6) gekennzeichnet sind. Der Klassifizierer markiert ein Chunk als ‘Wort-Salat’, wenn es einem früheren Teil der Modellausgabe sehr ähnlich ist, was auf Wiederholung statt Fortschritt hindeutet. Die Ergebnisse zeigen, dass dieses Verhalten weit verbreitet ist über Datenmengen und Modelgrößen hinweg.

Wenn ein Chunk zu ähnlich war, wurde es als ‘Wort-Salat’ gekennzeichnet (effektiv eine nutzlose Wiederholung).

Die Forscher bemerken, dass sobald ein Modell in ‘Wort-Salat’-Modus eintritt, es sehr unwahrscheinlich ist, dass es ohne äußere Hilfe entkommen kann, sondern stattdessen in der teuren Schleife bleibt, bis der Decodierungs-Haushalt des Benutzers aufgebraucht ist††:

‘Unnötig zu sagen, dass dies ein katastrophales Problem für Benutzer darstellt, da ein idealerweise viel kürzerer Denkabschnitt jetzt maximiert wird mit nutzlosen Wiederholungen. So zahlt der Benutzer im Wesentlichen den maximalen Preis für eine (wahrscheinlich) falsche Antwort, während er die längste End-to-End-Latenz erträgt.’

Anteil der Wort-Salat-Chunks, die vor und nach dem Schneidepunkt (d. h. dem Moment, an dem repetitiver Ausgabe dominiert) auftreten. Die meisten Wiederholungen treten nach diesem Punkt auf, was zeigt, dass ein Modell, sobald es in eine Wort-Salat-Schleife gerät, selten ohne Intervention wiederhergestellt wird.

Die Autoren erzählen von ihrer Überraschung, als sie entdeckten, dass Reasoning-LLMs††† Anzeichen von Selbstbewusstsein für ihren Wort-Salat-Zustand zeigten. Es ist jedoch dieses Bewusstsein und die Art, wie es in den wahrscheinlichen Reasoning-Zustand des Modells eintritt, das eine Intervention ermöglicht:

‘Die Leichtigkeit dieses linearen Klassifizierers öffnet die Tür für eine Echtzeit-Erkennung, bei der wir effektiv intervenieren können, um Modelle zu stoppen, die in Wort-Salat-Schleifen gefangen sind.’

Methode

Um die Anwesenheit von Wort-Salat während der Inferenz zu erkennen, trainierten die Autoren einen einfachen linearen Klassifizierer, der auf dem versteckten Zustand jedes Doppelzeilenumbruch-Tokens läuft.

Jedes Chunk, das nach dem Eintritt des Modells in eine Wiederholungsschleife auftrat, wurde als Wort-Salat behandelt, wobei dieser Abschnitt (als Schneidepunkt bezeichnet) verwendet wurde, um die Trainingsdaten zu kennzeichnen. Tausend Reasoning-Spuren wurden unter Verwendung des S1-Benchmarks generiert und jedes Chunk in Zeilenumbruch-getrennte Chunks unterteilt.

Konzeptuelles Schema für WordSaladChopper. Während der Generierung wird der versteckte Zustand bei jedem Doppelzeilenumbruch-Token analysiert, um repetitive Segmente zu erkennen. Sobald zwei ‘Wort-Salat’-Chunks in Folge gekennzeichnet sind, wird die Generierung gestoppt. Ein fester Regenerations-Prompt wird dann angehängt, um dem Modell zu ermöglichen, seine Antwort ohne Überschreitung des Haushalts zu beenden.

Wenn ein Chunk sehr ähnlich zu einem früheren war, wurde es als Wort-Salat gekennzeichnet. Sobald die früheste anhaltende Wiederholung identifiziert wurde, wurden alle nachfolgenden Chunks ebenfalls als Wort-Salat gekennzeichnet, um die Beständigkeit dieser Schleifen widerzuspiegeln.

Der Klassifizierer wurde als eine einzelne vollständig verbundene Schicht implementiert und auf den versteckten Zuständen der nachfolgenden Token aus dem letzten Transformer-Block trainiert. Ein separater Klassifizierer wurde für jedes Modell trainiert, unter Verwendung dieser Daten, und keine Feinabstimmung wurde während der Bewertung durchgeführt.

Daten und Tests

Training und Inferenz verwendeten vier NVIDIA A100 (80G VRAM)-GPUs, unter dem Adam-Optimizer, mit einer Lernrate von 1×10-2, für 50 Epochen.

Die Bewertungsdatensätze waren ‘Grade School Math’ 8000, auch GSM8K genannt; MATH-500; GPQA-DIAMOND; und AIME25 (2025).

Die getesteten Modelle waren DeepSeek-R1-Distill-Qwen-1.5B; DeepSeek-R1-Distill-Qwen-7B; und DeepSeek-R1-Distill-Llama-8B, alle unter MIT-Lizenz.

Die verwendeten Metriken waren Genauigkeit und AUROC.

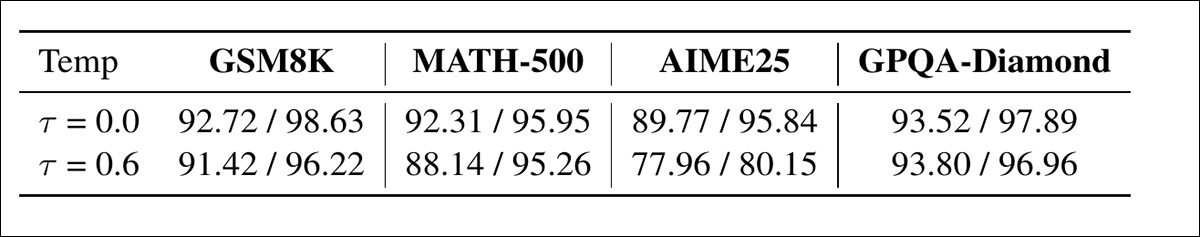

Genauigkeit und AUROC des Wort-Salat-Klassifizierers auf Qwen-7B über vier Benchmarks und zwei Decodierungs-Temperaturen. Hohe Punktzahlen bestätigen, dass der Beginn der Wiederholung zuverlässig aus dem versteckten Zustand des nachfolgenden Zeilenumbruch-Tokens erkannt werden kann.

Von den hier dargestellten Ergebnissen bemerken die Autoren:

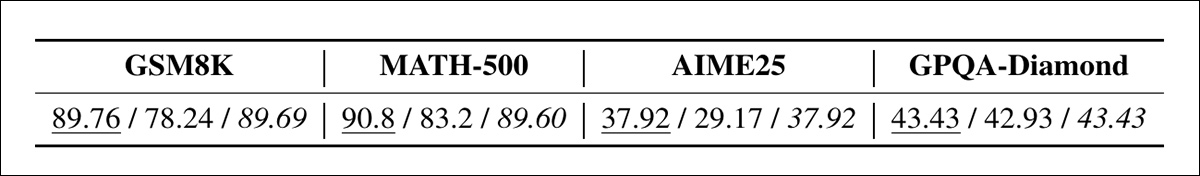

‘[Die Tabelle oben] zeigt, dass der lineare Klassifizierer extrem genau ist bei der Erkennung der Wort-Salat-Chunks; [die Tabelle unten] zeigt jedoch, dass der Regenerations-Prompt hilft, die durch brutale Abschneidung verlorene Aufgaben-Genauigkeit wiederherzustellen.’

Genauigkeit von Qwen-7B auf jedem Benchmark bei τ = 0,6, vergleichend mit der Leistung vor Wort-Salat (Original), nach dem Abschneiden (Geschnitten) und nach der Anwendung der Regeneration (Regeneriert). Die Gewinne durch Regeneration sind bescheiden, aber konsistent, und erholen die Leistung vor der Schleife in den meisten Fällen.

In der Ergebnistabelle unten können wir sehen, dass WordSaladChopper die Genauigkeit verbesserte oder bewahrte, während er die Länge der Modellausgaben stark reduzierte, um bis zu 57%:

Wenn WordSaladChopper bei gierigem Decodieren (τ = 0) verwendet wird, reduziert er die Länge der Modellausgaben, manchmal um mehr als die Hälfte, während die Genauigkeit gleich bleibt oder leicht besser wird, was eine Leistung ist, die bei verschiedenen Modellen und Aufgaben konsistent bleibt (AIME25 wird aufgrund der vorhersehbaren instabilen Ergebnisse in diesem Setting weggelassen).

Die größten Gewinne traten in längeren Antworten auf, insbesondere bei GPQA-Diamond, wo fast die Hälfte des Textes entfernt wurde, ohne die Leistung zu beeinträchtigen. Unten können wir ähnliche Ergebnisse sehen, wenn Zufälligkeit während der Generierung hinzugefügt wurde:

Bei höherer Temperatur (τ = 0,6) verkürzt WordSaladChopper die Ausgaben um 10-30 Prozent, während die Genauigkeit stabil bleibt oder leicht verbessert wird über alle Modelle und Benchmarks hinweg (AIME25-Ergebnisse werden gemittelt, um die Varianz zu reduzieren).

Hier blieb die Genauigkeit stabil, während kürzere Ausgaben erreicht wurden. Überall hinweg funktionierte das System weiterhin, auch wenn die Antworten des Modells repetitiver wurden; und die Autoren bemerken, dass, da der Klassifizierer nur ein Token pro Satz überprüft, er extrem schnell läuft, sogar wenn er während der Live-Generierung verwendet wird.

Das Paper bemerkt, dass zusätzliche Strategien in zukünftigen Forschungen entlang dieser Linien von der Gewährung eines kleinen Regenerations-Haushalts nach der Intervention profitieren könnten; kontinuierliche Anwendung eines WordSaladChopper-ähnlichen Systems über Regenerationszyklen hinweg; und das Erzwingen eines ‘Ende-des-Denkens’-Tokens auf das Modell, um seine beste aktuelle Antwort zu fordern.

Schließlich bemerken die Forscher in Bezug auf die Qualität des aktuellen Standes der Technik bei der Bewertung von Reasoning-Modellen mit einem kritischen Ton†:

‘[Es] ist unsere ehrliche Überzeugung, dass viele effiziente Reasoning-Methoden teilweise deshalb wirksam erscheinen, weil die aktuellen Reasoning-Bewertungsbenchmarks viel Raum für Verbesserung haben.

‘Sollten wir umfassendere Bewertung Suiten entwickeln – was wir sicherlich in der Zukunft tun werden – erwarten wir, dass viele effiziente Reasoning-Methoden versagen oder sich viel anders verhalten als ihre Vanilla-LRM-Gegenstücke.’

Schlussfolgerung

Im Maßstab, den führende Systeme wie ChatGPT erreicht haben, können sogar kleine Verschiebungen im Ressourcenverbrauch der Benutzer erhebliche Infrastruktur-, Logistik- und Kostenimplikationen haben. Dies macht Effizienz zu einer gemeinsamen Priorität für Anbieter und die breitere Forschungsgemeinschaft.

Wenn das neue, leichte System, das in dem Paper vorgeschlagen wird, implementiert wird (das muss für jede neue Modellarchitektur speziell trainiert werden), könnte es das sinnlose Verbrennen von Token verhindern – was den Eindruck erwecken kann, dass der Anbieter den Haushalt des Kunden “ausblutet” auf eine verschwenderische oder irreführende Weise. In Wirklichkeit geht es dem Anbieter besser, wenn er nützliche anstelle von redundanten Ausgaben liefert, was in Rechenleistung dasselbe kostet wie ein Wort-Salat.

* Obwohl wir es hier nicht erläutern werden, erstreckt sich dies auch auf lokal gehostete Modelle, die sowohl kommerziell als auch hobbyistisch sein können, und bei denen der Verlust an Elektrizität und Produktivität durch Wort-Salat ein Faktor sein kann, der berücksichtigt werden sollte.

† Wie üblich liegt der Schwerpunkt bei den Autoren und nicht bei mir. Wo anwendbar, wurden ihre inline-Zitate von mir in Hyperlinks umgewandelt.

†† Wir müssen hier anerkennen, dass Frameworks und APIs ‘Sub-Haushalte’ für Anfragen zuweisen können, sodass eine Anfrage nicht unbedingt in der Lage ist, den gesamten Tageshaushalt an Token aufzubrauchen – dies ist jedoch keine gängige Praxis, noch wird es häufig unter API-Only-Anbietern diskutiert.

††† Ich bin nicht generell bereit, die Verwendung von ‘LRMs’ durch die Autoren zu übernehmen, da dies derzeit keine gängige Abkürzung ist, also werde ich in diesem Artikel andere Terminologie verwenden, wenn nötig.

Erstveröffentlicht am Donnerstag, 6. November 2025