Andersons vinkel

AI-generered reklamebilleder, der rammer din demografi – Og, til sidst, dig?

Reklamefolk sigter mod at tilpasse reklamer til enkelte seere for at drive klik, og selvom det i øjeblikket er urealistisk at lave brugertilpassede reklamer til hver enkelt person, tyder ny forskning på, at AI-genereret billedmateriale snart kan målrettes effektivt mod bestemte demografiske grupper.

Den personlige reklame, der er fremhævet i Steven Spielbergs sci-fi-actionfilm fra 2002, Minority Report, har efterladt en varig, endda hjemsøgende indtryk på kulturen, med sin levende skildring af proaktive reklameplakater, der genkender mennesker i folkemængder og råber reklamebudskaber direkte til dem.

Mange forbrugergrupper kan betragte dette niveau af seer-genkendelse som en mareridt, og selvom fremgangen mod dette blev langsommere på grund af afsløringerne i Cambridge Analytica- skandalen, forbliver idealet om direkte, højttilegnede engagement et prisværdigt mål i reklame.

I virkeligheden er systemer, der kan bore ned i karakteristikkerne af en bestemt seer under udvikling – selvom corporate-forskning i sådanne tilfælde må tage foranstaltninger for at respektere love om personligt identificerbare oplysninger (PII); love, der er blevet styrket i Europa over det sidste årti, med disse forbedrede beskyttelser spredt andre steder via Bruxelles-effekten.

Hej, du!

Nu, hvor AI-genererede reklamer og marketingindhold er på vej op, må reklamefolk alligevel konfrontere den potentielle omkostning af AI-reklamer, der er målrettet mod bestemte personer, hvor billederne og teksten opstår på tilfældig vis og på stedet.

For eksempel, selv hvis en brugertilpasset billed kunne genereres meget hurtigt, ville omkostningerne på større skala være betydelige. Derudover opererer automatiske online reklameauktioner på kritiske, millisekund-niveau, hvilket gør brugertilpasset billedindhold på nettet udfordrende, og videoindhold en endnu fjernere mulighed.

Men de tekniske hindringer, der er involveret i at imødekomme højere niveau demografiske kohortgrupper i en netbaseret publikum (via laptops, mobiltelefoner, smart-tv’er osv.), er ikke så alvorlige – og et nyt internationalt akademisk/industrielt samarbejde foreslår en måde at oprette separate reklamebilleder for forskellige demografiske grupper, herunder faktorer som alder og beliggenhed:

Fra det nye arbejde: eksempler på personlig reklamegenerering, hvor et enkelt produkt vises i forskellige stilarter for forskellige seergrupper. Kilde

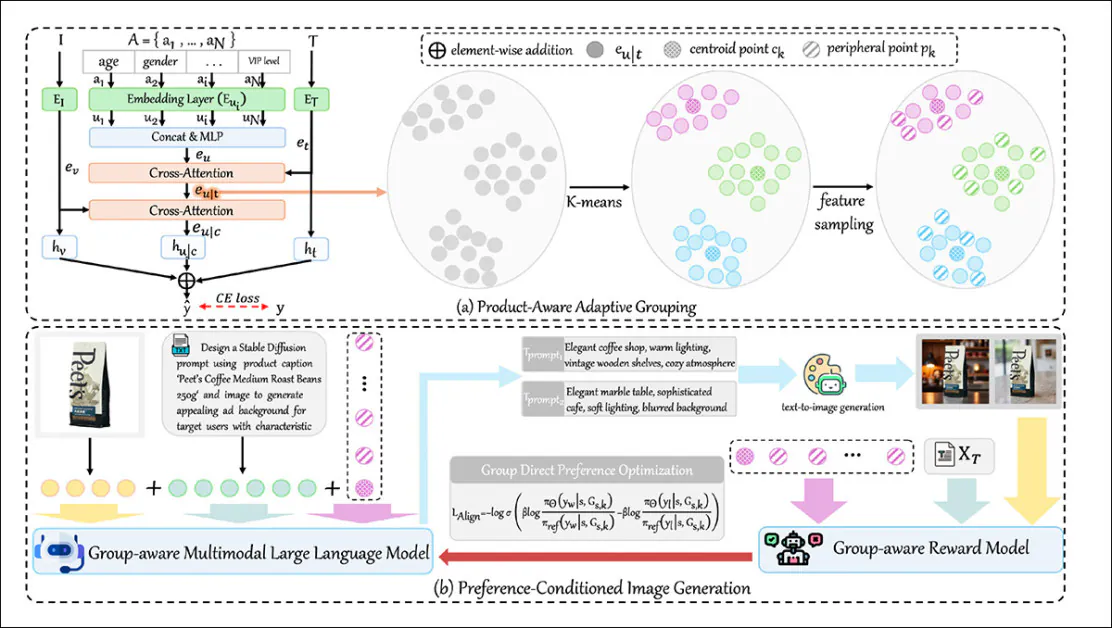

Det nye rammeværk – titlen One Size, Many Fits (OSMF) – sigter mod at brokke gapet mellem bredt målrettet reklame og urealistisk detaljeret personliggørelse, ved at generere forskellige reklamebilleder for automatisk opdagede publikumsgupper, ved hjælp af produktbevidst klustering til at tilpasse visuelt indhold med klikpræferencer for forskellige demografiske grupper

Forfatterne skriver:

‘[Vi] præsenterer [en] samlet rammeværk, der tilpasser diverse gruppevise klikpræferencer i stor målestok reklamebilledgenerering.

‘OSMF begynder med produktbevidst adaptiv gruppering, som dynamisk organiserer brugere på baggrund af deres attributter og produktkarakteristika, og repræsenterer hver gruppe med rige kollektive præferencer.’

Testet mod sammenlignelige rammeværker, hævder forfatterne state-of-the-art-resultater.

Selvom arbejdet identificerer diverse kohortgrupper, er papiret ikke specifikt med hensyn til, hvilke demografiske karakteristika, der repræsenteres af hver G-gruppering, selvom disse sandsynligvis kan kortlægges til traditionelle markedssegmenteringsgrupper.

Derfor er det ikke let at se, baseret på de forskellige eksempler givet i hovedpapiret og appendikset, hvorfor visse baggrunde eller belysning ville appellere mere til en kohort end en anden, da vi ikke kender karakteristikkerne af nogen kohort:

Der er ingen konsistente ‘blå for drenge, pink for piger’ osv. stilarter på tværs af kohortspecifikke billedstilarter, der kunne afsløre, hvilken type person tilhører hvilken gruppe – definitionerne, som det fremgår af den eksisterende litteratur, er langt mere komplekse og subtile.

Hvad der måske er mere bekymrende for dem, der er bekymrede over reklame-målretning, er muligheden for at udnytte per-bruger-indsigter i genereringen af bestemt billedmateriale i reklamer**.

Den nye artikel er titlen One Size, Many Fits: Aligning Diverse Group-Wise Click Preferences in Large-Scale Advertising Image Generation, og kommer fra 17 forskere på tværs af National Laboratory of Pattern Recognition i Beijing; ‘School of AI at UCAS’**; den kinesiske e-handelsvirksomhed JINGDONG; Hong Kong University of Science and Technology i Guangzhou; og Pattern Recognition Lab på Nanjing University of Science and Technology.

Metode

Systemet bruger adaptiv klustering (en metode, der finder naturlige grupperinger ved at kombinere brugerattributter med, hvordan de responderer på forskellige produkter) til at gruppere brugere, baseret på, hvordan deres attributter former visuelle præferencer i en given produktkontekst. Forfatternes implementering af denne tilgang kaldes Produktbevidst Adaptiv Gruppering (PAAG).

Disse grupperinger er ikke faste på forhånd, men opdages fra mønstre i data.

En betinget billedgenerator, titlen Præferencer-Betinget Billedgenerering (PCIG), bruger derefter hver gruppes profil til at oprette reklamebilleder, der matcher gruppenes sandsynlige smag:

OSMF grupperer brugere efter, hvordan deres attributter former produktpræferencer, og bruger derefter disse gruppeprofiler til at generere reklamebilleder, der matcher hver gruppes smag. PAAG håndterer grupperingen, og PCIG opretter billederne ved hjælp af prompts og feedback, der er tilpasset hver gruppe.

Billedgeneratoren udnytter en uspecificeret version af Stable Diffusion, sammen med en passende ControlNet-suite (sidstnævnte for at hjælpe med at opretholde konsistens blandt de forskellige kohortgenerationer).

I arbejdsgangen kodificerer PAAG først forholdet mellem brugerfunktioner og både tekst- og billedaspekter af produktet, ved hjælp af en samling af dedikerede kodificeringsprogrammer og en kryds-attention-mekanisme til at kombinere dem i en samlet præferencer-embedding, der afspejler hvor sandsynligt en bruger er til at klikke på en bestemt reklame.

PAAG modellerer derefter, hvordan forskellige kombinationer af brugerattributter interagerer med både produkttitler og produktbilleder. Tekst- og billedfunktioner udtrækkes ved hjælp af CLIP og ResNet-baserede kodificeringsprogrammer, og brugerattributter som køn, beliggenhed, alder eller enhed sendes gennem en MLP, der aktiverer kryds-attention over produkttekst- og billedfunktioner.

Den resulterende embedding repræsenterer hver brugers klik-sandsynlighed for et bestemt produkt i en specifik visuel kontekst. Når disse bruger-produkt-præferencer-embeddings er opnået, bruger PAAG K-means-klustering til at gruppere brugere, der responderer på samme måde på et givet produkt.

PAAG vælger det bedste antal brugergrupper for hvert produkt ved at kontrollere, hvor godt klumperne adskiller sig. I stedet for at bruge kun ét gennemsnitligt punkt per gruppe, sampler den flere på forskellige afstande for at fange en bredere række af præferencer.

Disse gruppeprofiler sendes derefter som tokens til gruppebevidst multimodal stor sprogmodel (G-MLLM), der bruger dem til at generere reklamebilleder tilpasset hver gruppe.

Billedgenerering baseret på brugerpræferencer

På brugersiden lærer G-MLLM at forudsige, hvilke gruppemedlemmer er sandsynligt at klikke næste, og hvordan man kan beskrive fælles karakteristika i naturligt sprog. På produktets side lærer den at sammenfatte produktet, der vises i et billede, og at generere reklame-stil-kaptajner, der matcher både produktet og gruppen.

For at afspejle reel brugeradfærd udvides modellen til en gruppebevidst belønningsmodel (GRM). GRM trænes på forskernes eget Gruppebevidst Reklamebilledpræferencer (GAIP)-dataset† (se nedenfor) til at sammenligne par af billeder for samme produkt og identificere, hvilket der fungerer bedst med en given gruppe, ved hjælp af ægte klik-gennem-data.

Denne belønnings-signal bruges derefter til at fine-tune G-MLLM med Gruppe-DPO, en metode, der lærer det at favorisere prompts, der fører til bedre gruppeniveau-engagement.

Data og tests

Udvikling af GAIP

Noterende en historisk mangel på datasæt relateret til gruppebaseret reklamepræferencer, og at tidligere samlinger som Personlige Suppe og CG4CTR enten er for små eller for dårligt specificerede, udviklede forskerne deres egen samling, den ovennævnte GAIP, afledt fra ‘industrielle reklamelog’ fra en uspecificeret e-handelsplatform.

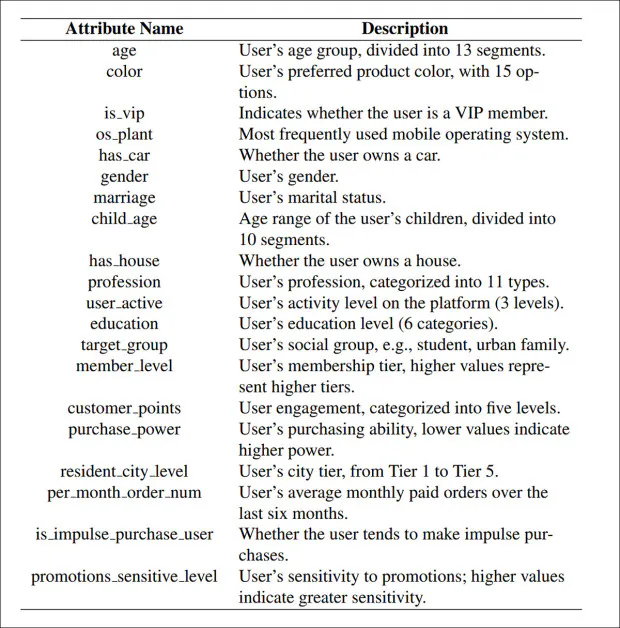

Logfilerne blev indsamlet over en tre-ugers periode, med hver post, der optager produktbilledet og titlen, brugerens profil (herunder alder, udgiftsniveau og følsomhed over for tilbud), og om reklamen blev klikket.

Datasættet indeholder over 40 millioner brugere, 2 millioner produkter og næsten 10 millioner reklamebilleder, med høj visuel variation på tværs af produkter.

Brugere blev grupperet af PAAG i distinkte kluster for hvert produkt, og klik-gennem-raten (CTR) blev beregnet pr. billede inden for hver gruppe:

Fra det nye papirs supplerende materiale, et lille glimt af nogle af de definerende kriterier for GAIT.

GAIP dannes herefter som en samling af tupler (reklamebillede, produkttitel, gruppe-embedding, gruppe-specifik CTR) parer hvert billede og titel med dets CTR og embedding af gruppen, der så det.

For at sikre pålidelighed beholdes kun produkter med tilstrækkelig eksponering, hvilket resulterer i en datasæt på 610.172 gruppeniveau-præferencer.

GAIP er væsentligt større end tidligere benchmarks: mens de fleste tidligere benchmarks involverer færre end ti brugergrupper, indeholder GAIP næsten 600.000 virkelige gruppevise præferencerekorder, hvilket giver dybere indsigt i gruppeniveau-præferencer.

Tests

For at træne PCIG-pipeline-extraherede forskerne billed- og tekstfunktioner ved hjælp af ResNet og CLIP-tekst-kodificeringsprogrammet, derefter kortlagde dem til 128-dimensionelle embeddings gennem lærbare lineære lag. For at opretholde effektivitet blev PAAG begrænset til fem brugergrupper per produkt.

Gruppe-embeddings blev konstrueret ved hjælp af en percentil-baseret sampling-strategi, der trak multiple punkter fra 15., 55. og 95. percentiler for at fange både kerne- og perifere præferencer.

LLaVA blev brugt som ryggraden for G-MLLM, og fortræning blev udført over ti epoch med en cosinus-lærings plan på en læringshastighed på 2e-6, hvilket krævede en imponerende five dage træning på en cluster af otte NVIDIA H100 GPU’er, hver med 80GB VRAM.

GRM blev trænet ved at genskabe GAIP med matchede produktbilledepar, derefter initialiseret med samme vægte som G-MLLM. Under den endelige Gruppe-DPO-etape blev GRM frosset, og G-MLLM finjusteret ved hjælp af LoRA i tre epoch, igen på en læringshastighed på 2e-5, på samme NVIDIA-cluster.

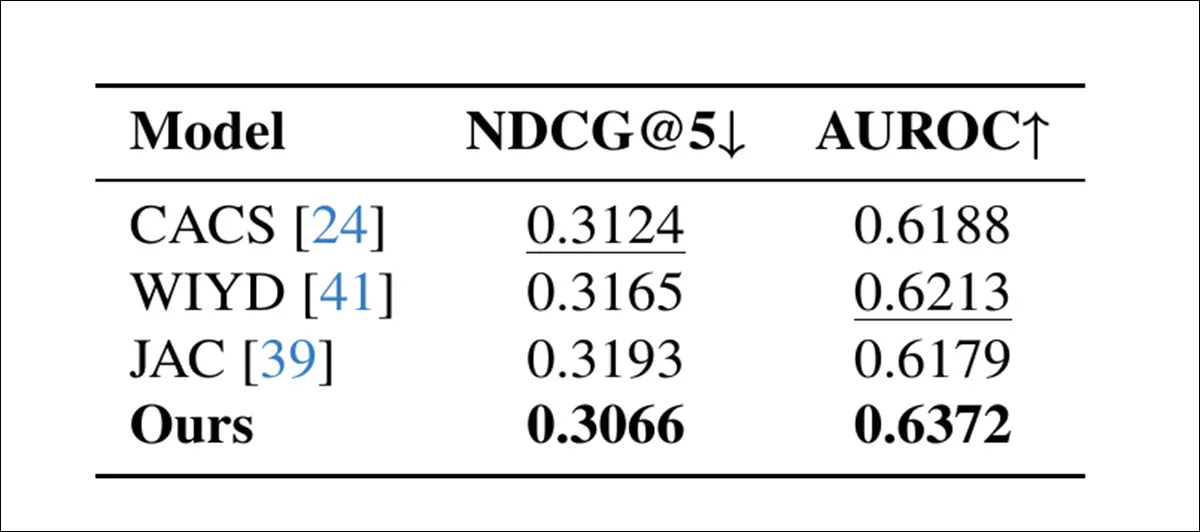

Mål, der blev brugt til den første evaluering, var NDCG@5 og AUROC. NDCG@5 målte, hvor forskelligt hver gruppe rangerede samme sæt af reklamebilleder, med lavere værdier, der indikerer tydeligere adskillelse i præferencer; og AUROC blev brugt til at evaluere, hvor godt hver model skelnede mellem klikket og ikke-klikket indhold.

Alle mål blev beregnet på klustering-resultater fra 1.000 produkter, i alt omkring 100.000 eksempler, og blev brugt til at sammenligne PAAG med tre tidligere systemer: CACS; WIYD; og JAC:

Præferencemodellering-resultater sammenlignet med tidligere metoder. Lavere NDCG@5 og højere AUROC indikerer bedre præstation. Bedste resultater er i fed, næstbedst understreget.

Af disse resultater kommenterer forfatterne:

‘[Vores] metode opnår overlegen præstation på begge mål. Konkret opnår PAAG den laveste NDCG@5 (0,3066), overgår den bedste baseline (CACS), hvilket indikerer mere distinkte inter-gruppe-præferencemønstre for effektiv gruppevis reklamegenerering.

‘Desuden opnår PAAG den højeste AUROC (0,6372), forbedrer over den stærkeste baseline (WIYD) med 0,0159.’

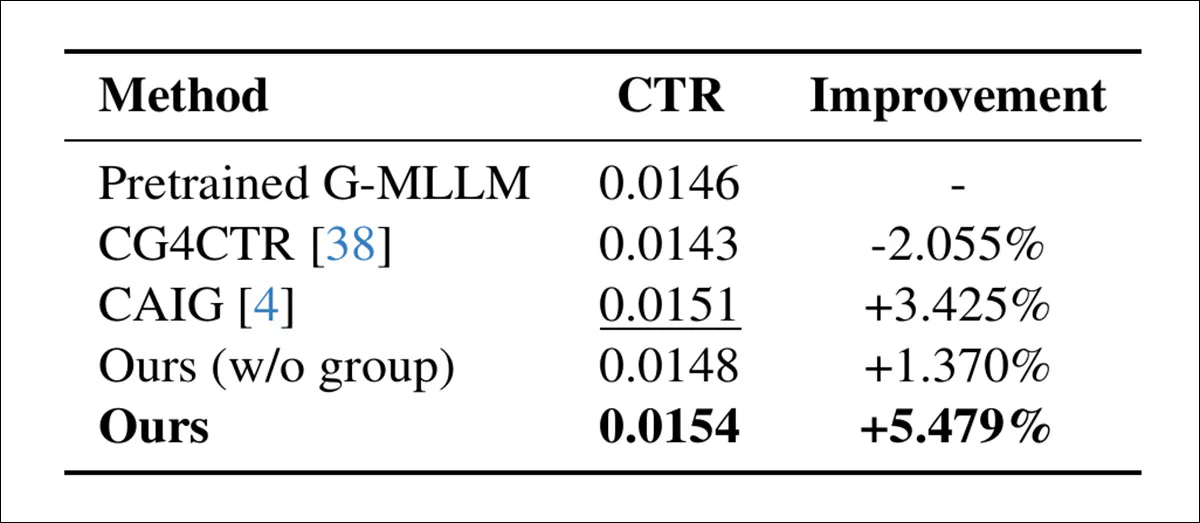

En anden runde af tests kontrollerede, om systemet kunne bedre matche reklamer til de rigtige brugergrupper:

Online CTR-sammenligning, der viser, at gruppe-personlig generering (‘Vores’) overgår alle baselines, herunder CAIG og fortrænet G-MLLM.

Her viste PCIG stærkere klik-rater end ældre modeller som CAIG og G-MLLM, med en 5,5% forbedring. GRM blev også testet offline ved at kontrollere, om den kunne korrekt vælge det bedre reklamebillede i et par, baseret på gruppepræferencer. Den overgik alle baselines, herunder generelle formål-modeller, med en 4,7% gevinst over CAIG.

En endelig kvalitativ test blev udført for at evaluere, om PCIG kunne afspejle gruppeniveau-præferencer i stil med dens genererede billeder. Som vist i figuren nedenfor, blev det samme produkt vises forskelligt for hver gruppe, med ændringer i palet, tone og visuel komposition:

Fulde resultater for de kvalitative tests, forhåndsvist tidligere i artiklen.

Disse variationer afspejlede, ifølge forfatterne, de formodede klik-præferencer for hver gruppe, hvilket viser, at PCIG kunne producere stilistisk forskellige outputs, samtidig med at den bevarede relevans og appel. Forfatterne skriver:

‘[PCIG] sikrer, at stilistisk forskellige billeder kan tilpasse klik-præferencerne for forskellige brugergrupper, og demonstrerer dermed sin stærke evne til at tilpasse generering til heterogene brugerkrav og fange subtile, finmålede præferencemønstre på tværs af forskellige brugergrupper, hvilket fremhæver dens potentiale for gruppebevidst reklamebilledgenerering i stor målestok.

Konklusion

Måske det mest interessante aspekt af dette projekt er den ukendte korrelation mellem output-stilarter på tværs af gruppe-målrettet billeder for samme produkt (hvoraf der er flere sider med eksempler i papirets supplerende materiale, end vi kan reproducere her).

Kan vi antage, at by-miljøer er relateret til alder, dvs. til akademikere, der starter, og at landlige miljøer er rettet mod mere velstående Generation X-typer, der identificerer den åbne vej som en slags ‘sidste frihed’? Man kan Rorschach disse test-outputs hele dagen.

Potentialet for sådanne systemer hviler på to faktorer: indsigt og latency. Indsigt afhænger af, om fremvoksende sporingssystemer stadig kan udtrække nok meningsfuld information fra brugere for at understøtte effektiv kohort-baseret reklame, samt lægge grundlaget for mere præcise, individuelt målrettede reklamer i fremtiden.

Latency udgør en større udfordring, da disse bruger-tilpassede reklamebilleder skal genereres og leveres næsten øjeblikkeligt; selvom nogle nyere tekst-til-billede-modeller kan producere resultater på få sekunder, kan selv denne forsinkelse være for lang for realtids-reklameauktioner.

En mulig løsning er at producere billederne lokalt, på browserens GPU, og undgå netværks-omdirigeringer; eller at oprette en række billeder på forhånd, forhåndscachet på klienten.

** Dette aspekt er udeladt i den nye artikel, ligesom nye AI-rammeværkers potentiale for deepfake-misbrug ofte blødes af ved at bruge nætte dyrefigurer (i stedet for AI-porno) i nye studier. Alligevel repræsenterer den type billedmateriale, der vises i arbejdet, reklamefolk på deres bedste opførsel, snarere end at vise, hvor personlige visuelle reklamer kan blive, når forbruger-målretningsmetoder samarbejder med hurtig-respons-generativ AI.

** Jeg kan ikke identificere denne navngivne institution, da ‘UCAS’ generelt opløser til en velkendt britisk universitetsansøgnings-clearinghouse. Jeg velkommer opklaring.

† Hvilket forskerne lover at udgive på den tilhørende GitHub-repo.

Først udgivet torsdag, 5. februar 2026