Andersons vinkel

Frembringelse af AI-genererede billeder i lyset med HDR

AI-billeder og video kan være imponerende, men de er ikke på ‘professionel’-standard – et problem, som et nyt forskningsprojekt søger at løse.

I den professionelle audio-visuelle fællesskab, er en af de hyppigste indvendinger mod AI’s indtrængen, den nuværende mangel på professionelle standarder for billed- og video-reproduktion. Ikke mindst af disse er evnen til at arbejde med High Dynamic Range (HDR) billeder og video.

HDR-billeder er den moderne pendant til en 19./20. århundredes fotografisk praksis kaldet bracketing, hvor samme billed er taget flere gange med øgende mængder lys, der tillades at nå filmemulsionen:

Ovenfor, en kort bracket-sekvens. Indsæt nedenfor, den høj dynamiske rækkevidde, der kan udledes fra disse billeder til et enkelt billede. Kilde

I traditionel fotografi resulterede dette i flere billeder, som kunne, med visse ekspertise og indsats, komponeres til et enkelt tryk, der fik glæde af alle de forskellige detaljer, der var tilgængelige på tværs af eksponeringsområdet. Men det var ikke en trivial eller let proces.

Disse dage kan en ‘auto-bracketed’ billedsekvens enten producere flere billeder eller kombineres til et enkelt HDR-billede – effektivt en multiplicitet af eksponeringer i ét billede, som HDR-kapable billedredigeringsprogrammer som Photoshop kan iterere gennem, og tillade fotografen at orkestrere til ét, ideelt outputbillede.

Hvis du undrer dig over, hvorfor du skal bekymre dig, eller hvordan denne slags ting påvirker din egen fotografering, er illustrationen til denne artikel ment til at demonstrere dette på en velkendt måde:

Ovenfor, til venstre ser vi et typisk eksempel på et sRGB (dvs. ikke-HDR) billede. Bare ved at lyse (vist til højre) det op, viser det ikke monstret i skabet, fordi denne detalje blev kasseret, da fotografen og den automatiske proces i kameraet besluttede, hvad der skulle prioriteres i billedet:

Nedenfor er der en indikation (venstre) af, hvor ‘udvasket’ forgrunden ville have været ved tidspunktet for eksponering for at registrere skab-monstret i et ikke-HDR-billede, og (højre) hvordan monstret bliver kastet ind i mørke, når eksponeringen gøres egnet for de velbelyste forgrundsemner i stedet:

Nedenfor ser vi den slags detaljer, der kan ‘redde’ fra et HDR-billede eller billedsekvens. I dette tilfælde var monstret ‘gemt’ i de laveste visuelle registre i HDR-sekvensen, i et niveau, hvor resten af indholdet ville have været ‘blæst ud’ i nær-hvid (ovenfor, venstre). Ved at specificere, at en bred række lysniveauer skulle udtrykkes, selektivt, i samme billede, kan disse dissonante elementer komponeres til ét rationelt billede:

Et ikke-HDR-billede kaldes en display-referred billede, og et høj-gamut HDR-billede kaldes en scene-referred billede.

HDR-video er også en ting, og denne slags tonal fleksibilitet og ductilitet giver filmproducenter en vis latitude til at redde, grade og fortolke optagelser på en række kreative og konsistente måder; ikke overraskende, så er kreative personer ikke villige til at arbejde med den ‘fladtrykte’ sRGB-udgang, der er typisk for de fleste generative AI-rammer.

HDR i AI

Naturligt er forskningsscenen interesseret i at bringe AI-genererede rammer ind i HDR-æraen. Men det er ikke en trivial opgave, både på grund af den fundamentale arkitektur af diffusion-baserede generative systemer, og fordi gode HDR-data kræver en stor mængde diskplads, hvilket gør det til en ubehagelig samling; følgelig er datasæt, der er egnede til opgaven, sjældne.

Alligevel tilbyder et samarbejde mellem et universitet i Singapore og Adobe Research en metode til at producere HDR-billedsekvenser, i en metode, der teoretisk kan anvendes på både video og stadig billeder:

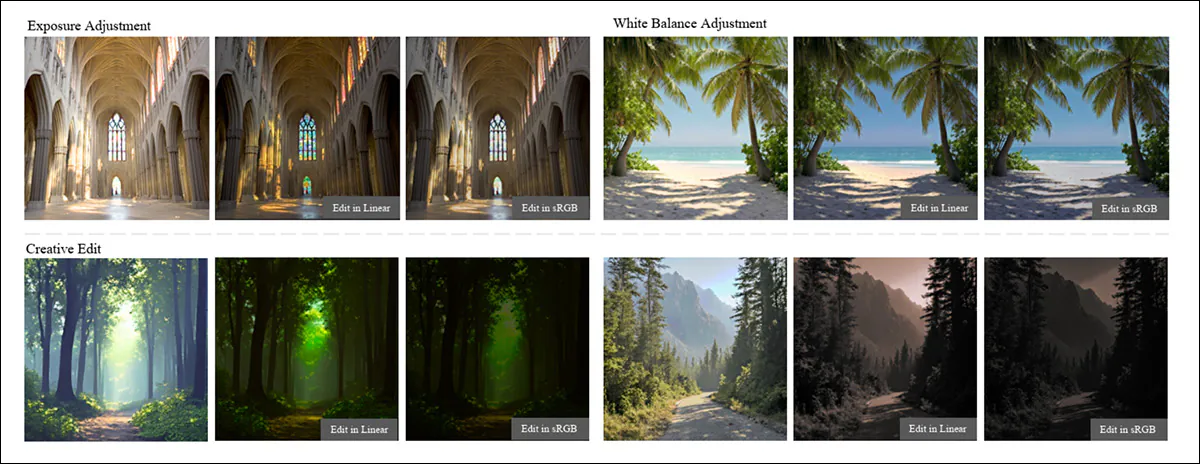

Fra projektets side for det nye arbejde, eksempler på ‘bracketed’ tekst-til-billede-udgang. Kilde

Det nye system genererer flere alignede versioner af samme billede ved forskellige lysniveauer og lærer, hvor lyset i scenen virkelig var, og kombinerer disse til ét enkelt resultat, der beholder detaljer i både skygger og højdepunkter, og tillader senere redigeringer af eksponering eller farve at opføre sig mere som justeringer af en rigtig kameraoptagelse, snarere end ømfølsomme justeringer af et fuldt bearbejdet billede.

Systemet udnytter en diversitet af forskellige modeller til opgaven, herunder varianter af Qwen og Flux:

Eksempler fra den nye artikel, der viser, hvordan systemet kan generere multiple eksponeringsversioner af samme scene, mens den fastholder den underliggende struktur. Startende fra en simpel kantkort, producerer modellen konsistente billeder på tværs af meget mørke til meget lyse indstillinger, uanset om prompten beskriver månelys, sollys, solnedgang eller selv et lille objekt som en ballon, med emnet og kompositionen forbliver stabile, mens kun lysændringerne ændrer sig. Metoden kan variere lysniveauet på en kontrolleret, kamera-lignende måde, snarere end at drive eller opfinde nyt indhold, når eksponeringen skifter. Kilde

Forfatterne skriver:

‘At generere lineære billeder er udfordrende, da forudtrænede VAE’er i latent diffusion-modeller kæmper for at bevare både ekstreme højdepunkter og skygger på grund af den højere dynamiske rækkevidde og bit-dybet.

‘Til dette formål repræsenterer vi et lineært billede som en sekvens af eksponeringsklammer, hver af dem fanger en bestemt del af den dynamiske rækkevidde, og foreslår en DiT-baseret flow-matching-arkitektur til tekst-betinget eksponeringsklamme-generering.

‘Vi demonstrerer yderligere downstream-applikationer, herunder tekst-guidet lineært billedredigering og struktur-betinget generering via ControlNet.’

Det nye arbejde har titlen Lineært billedgenerering ved at syntetisere eksponeringsklammer, og kommer fra fire forfattere på tværs af S-Lab på Nanyang Teknologiske Universitet, Adobe NextCam og Adobe Research. Ud over den nævnte projektside og YouTube-video, der følger med udgivelsen, er der også en (for tiden sparsom) GitHub-repo, og løftet om en datasætsudgivelse.

Selv om forfatterne leverer mange eksempler på output fra systemet på den tilknyttede projektside, vil seerne have brug for en HDR-kapabel skærm for at kunne skelne karakteristikkerne af HDR-udgangen, der præsenteres. Alligevel finder du forskernes YouTube-oversigt indlejret i slutningen af denne artikel – men vær opmærksom på, at forskellene mellem viste eksempler måske ikke er klare på en ikke-HDR-skærm.

Metode og data

Forfatterne understreger, hvor meget dataindsamling er en udfordring i denne særlige forfølgning:

‘At erhverve en stor mængde lineære billeder er ekstremt udfordrende i praksis. Desuden er de fleste offentlige HDR-datasæt enten panoramiske (og fokuserer således næsten udelukkende på stor-skala-sceneindhold) eller tilbyder ikke rigtige lineære billeder, hvilket gør dem uegnede til vores formål.

‘Derfor bruger vi primært RAW-billedatasæt som grundlag for træning.’

Forskerne gjorde kreativt brug af de få muligheder, der var til rådighed, og udnyttede RAISE-datasættet som faktisk træningsdata, og MIT-Adobe FiveK-datasættet som evalueringsdata*.

For at opbygge brugbare HDR-træningsdata, løb forskerne RAW-kamerafilerne gennem en standardiseret pipeline for at fjerne kamera-specifikke ejendommeligheder, og omdanne billederne til en konsistent, scene-henvisnings-lineær format:

Systemets workflow: systemet starter med støj, der repræsenterer fire eksponeringsniveauer af samme scene, sammen med en tekstprompt og en lysstyrke-token. Dette behandles derefter gennem stablede transformer-blokke, der holder de forskellige eksponeringer alignede, mens de justerer for lys. Systemet forudsigår derefter både sættet af eksponeringsbilleder og en samlet lysstyrke-skala, og dekoder og kombinerer dem derefter til ét enkelt scene-henvisningsbillede, der fastholder detaljer i både skygger og højdepunkter.

Dette indebar rekonstruktion af fuld RGB fra sensor-data, anvendelse af farvekorrigerings-, normaliserings- og hvidbalance-justeringer, og en kort overgang til perceptuel farverum til støjreducering, før det vendte tilbage til en ren lineær signal. Den faktiske lys i scenen blev derefter genskabt ved hjælp af kameraets eksponeringsindstillinger, så hver pixel ville reflektere den rigtige lysstyrke snarere end en display-klar approximation.

Fordi sådanne værdier kan variere bredt, blev data derefter stabiliseret ved at skalaere hvert billede baseret på dets egen lysfordeling, ved hjælp af midter- og højdepunktsstatistik for at undgå både udvaskede billeder og overeksponerede højdepunkter, og fik derefter en normaliseret lineært billede, der bevarede den sande rækkevidde af lys i scenen, mens det forblev stabilt nok til træning.

Tekstlabels til billederne blev derefter oprettet med Qwen2.5-VL 7B-modellen, med prompts, der var tilpasset Flux-modellens egenskaber, der ville blive brugt under genereringstid.

Hvert billede blev delt op i eksponerings-‘skiver’ og passeret gennem en fælles VAE-encoder, der omdannede alle eksponeringer til et fælles latent-rum designet til at fange den fulde lysrækkevidde. De latente blev derefter forfinet fra støj og dekodet tilbage til billeder, hvilket muliggjorde konsistent rekonstruktion på tværs af mørke og lyse områder, uden at kollapsere dem til ét ‘fladt’ eksponeringsniveau.

LoRA-finetuning blev brugt til at tilpasse den forudtrænede Flux-baggrund til lineært billeddata med minimalt ekstra parametre, hvilket hjalp single-Diffusion Transformers (single-DiT)-modellen til at forblive stabil, selv når lysstyrken varierede på tværs af eksponeringsklammer.

Eksponeringsmodulerings-selvopmærksomhed (central kolonne i schema-illustration ovenfor) blev introduceret for at behandle alle klammer samtidigt, hvilket muliggjorde lysstyrkejustering pr. eksponering, mens struktur og fin detalje forblev alignede.

3D Rotary Positional Embedding (3D-R[o]PE) blev brugt til at kodificere både rumlig position og eksponeringsidentitet, så modellen kunne skelne, hvilken klamme hver token tilhørte, mens den bevarede rumlig konsistens, og muliggjorde ren adskillelse af lysvariation fra sceneindhold.

En oversigt over datasættet, der viser, hvordan billederne er fordelt på tværs af indholdstyper og indendørs versus udendørs scener, sammen med fordelingen af lysværdier i den behandlede data. Histogrammerne viser luminans og radians-skalaen i log-rum, og viser, hvor bredt virkelige lysværdier kan variere, med højere radians-værdier, der svarer til fysisk lysere scener, og fremhæver den stærke dynamiske rækkevidde, modellen er trænet til at håndtere.