Andersons vinkel

Fordelene ved at blive fed gennem AI

Et nyt AI-system kan realistisk omforme menneskers kroppe i billeder, så de bliver federe, tyndere eller mere muskuløse, uden at ændre deres ansigt, tøj eller baggrund. Systemet er trænet på et fuldt syntetisk dataset, der viser hver identitet på tværs af multiple kropstyper.

Ud over den stadig mere almindelige brug af AI som metode til at forfine kropsskikkelse på sociale netværk, eller (muligvis) til at ændre kropstyper til VFX-formål, kan brugen af maskinel læring til at ændre udseendet af enkeltindivider også tjene et vigtigere formål: at hjælpe individer med spiseforstyrrelser at forstå deres egen dysmorfe fortolkning af deres udseende, samt tilbyde en potentiel motivationsværktøj til mere generelle sports- og fitnessformål:

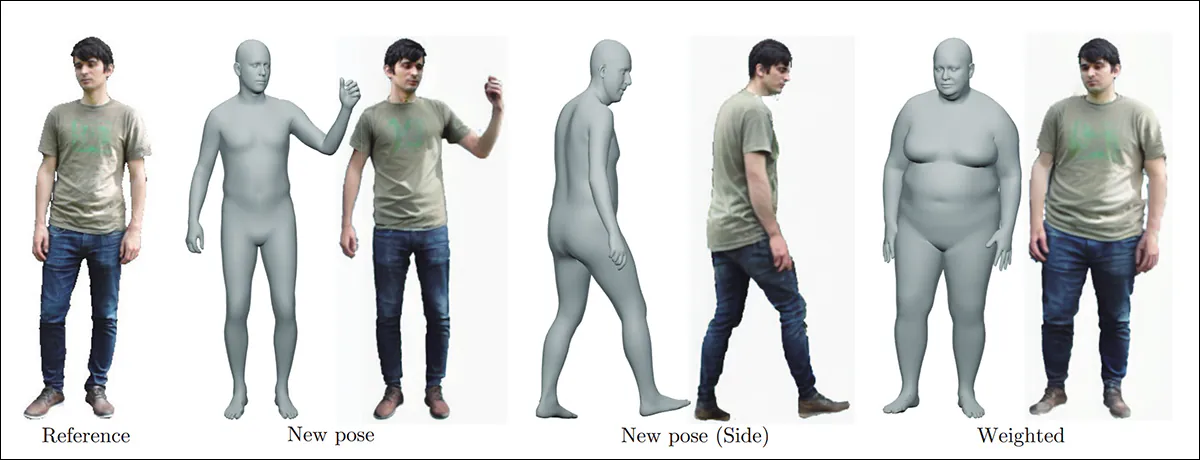

Fra papiret ‘Body size estimation in women with anorexia nervosa and healthy controls using 3D avatars’, en GUI til at visualisere kropsskikkelsesændringer. Individer med kropsskikkelsesforstyrrelser kan have svært ved at associerer en realistisk fortolkning af deres krop med et lignende billede, hvilket giver klinikerne en målestok for dysmorfe reaktioner, blandt andre formål. Kilde: https://www.nature.com/articles/s41598-017-15339-z.pdf

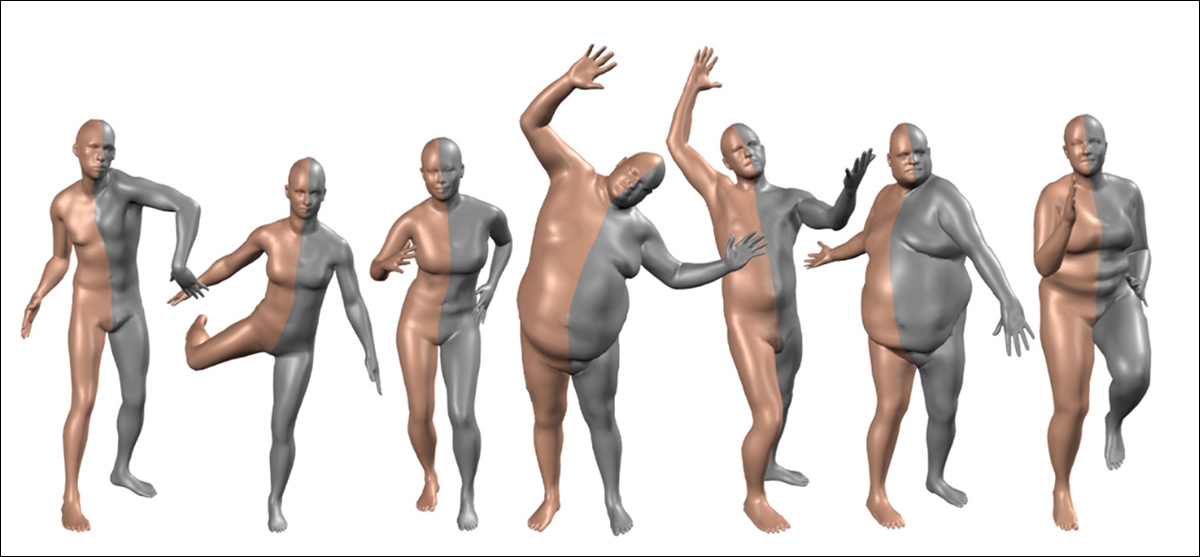

Derudover har den meget efterspurgte modeprøvning-understrøm i computer vision-forskning også interesse i at give præcise visualiseringer på tværs af et udvalg af kropstyper. Imens har rammer som 2024 DiffBody-tilbuddet fra Japans University of Tsukuba skabt nogle øjenåbnende funktioner på dette område:

Nogle af transformationerne, der er mulige med den tidligere DiffBody-teknik. Kilde: https://arxiv.org/pdf/2401.02804

Da AI-grundmodeller er optimeret til konventionelt-tiltrækkende eller andre almindelige kropstyper, er usædvanlige størrelser som ‘fed’ enten minimalt tilgængelige i standardmodeller eller kommer med nogle straffende fordomme.

Par-nødvendigheder

En af de største udfordringer i at skabe AI-systemer, der kan realistisk tilføje eller fjerne fedt og muskler fra billeder af individer – uden at ændre deres identitet, omgivelser eller tøj – er, at dette indebærer parret træning, hvor AI-systemet effektivt lærer ‘før’ og ‘efter’-billeder, der definerer hvilken som helst transformation, modellen er tiltænkt at udføre.

Denne type træning er kommet tilbage i fremtrædende stilling over sommeren på grund af succesen med Black Forest Labs’ Kontext-serien af billedredigeringsmodeller, hvor denne type parret data blev brugt til at lære en række transformationer til modellerne:

Eksempel på en transformation, der afspejler den type kilde-data, der er nødvendig for at træne en model, der kan fastholde billedintegritet, når der påføres store ændringer. Kilde: https://bfl.ai/models/flux-kontext

Det er åbenlyst, at i tilfældet af udvikling af en model, der kan betydeligt ændre udseendet af en person (uden at genforestille hele billedet), er der brug for noget, der er helt umuligt i den virkelige verden: radikale ‘før’ og ‘efter’-billeder taget kun sekunder apart.

Den eneste udvej er syntetisk data. Nogle projekter af denne type har brugt individuelle, høj-anstrængende kontrastive par, der er lavet manuelt i Photoshop; men dette er urealistisk i størrelse, og en automatiseret eller semi-automatiseret, AI-dreven proces til at generere parrene er nu mere og mere betragtet som foretrukket.

Problemet med GAN-baserede og de fleste SMPL/X-baserede tilgange (hvor en virtuel CGI-figur bruges som en slags udvekslingsmekanisme mellem virkelige billeder og de ønskede transformationer), og med tilgange, der bruger billed-vævning, er, at baggrunden og identiteten har tendens til at lide under processen.

Parametrisk, vektorbaserede CGI-modeller som SMPL og SMPL-X (blandt andre), giver definerede konventionelle fysisk 3D-koordinater, der kan fortolkes og inkorporeres i computer vision-rammer. Kilde: https://files.is.tue.mpg.de/black/papers/SMPL2015.pdf

Da det er vigtigt, at AI lærer at ændre kun de ønskede aspekter, i stedet for at lære at forvrænge baggrunde og at replikere andre uønskede fejl, er der endnu ikke opnået en perfekt løsning.

En nyeste artikel fra Indien foreslår dog en bemærkelsesværdig fremgang på tilstanden af kunsten gennem brugen af den ældre Flux-difusionsmodel-ramme, suppleret med en række sekundære tilgange, der muliggør en overlegen og mere konsekvent parret dataset:

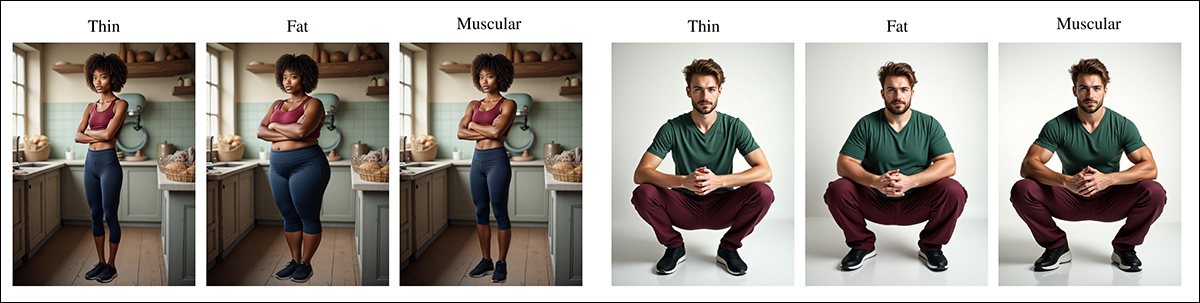

Dataset-eksempler fra det nye projekt. Kilde: https://arxiv.org/pdf/2508.13065

Projektet består af et nyt og omfattende parret dataset; Odo, en generativ difusionsmodel trænet på denne data; og en særlig ny benchmark designet til at kvantitativt vurderer menneskeskikkelses-redigering-præstation. I tests hævder forfatterne en bemærkelsesværdig fremgang på standarderne opnået af lignende sammenlignelige modeller.

Den nye artikel er tituleret Odo: Depth-Guided Diffusion for Identity-Preserving Body Reshaping, og kommer fra tre forskere ved Fast Code AI Pvt. Ltd i Bangalore.

Data og Metode

Datasettet, der er skabt af forskerne, indeholder 7.615 højopløselige billeder (960x1280px) for hver mål-kropstype (fed, tynd, og muskuløs).

Initialt blev 1.523 menneskeansigter genereret gennem FLUX.1-dev-12-milliard-parameter-difusionsmodellen, selvom der blev udnyttet et ukendt antal licensfri referenceansigter fra Pexels og Unsplash for at øge diversiteten.

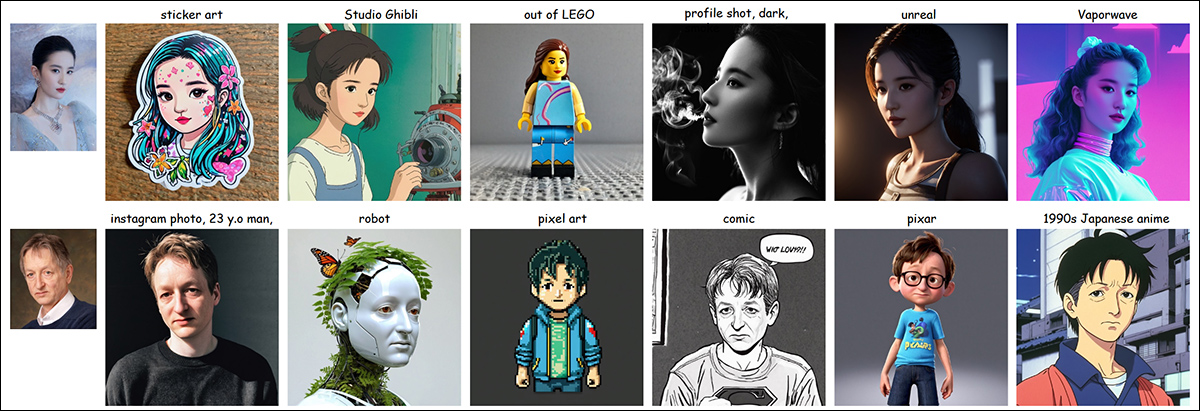

For at generere fuldkropsskikkelsesbilleder, der inkluderer disse ansigter, brugte forskerne ByteDances 2024-tilbud PuLID, en checkpoint finjusteret over base Flux, og med en kontrastiv ID-tap designet til at hjælpe med at bevare ansigtets identitet under transformationelle processer:

Eksempler fra PuLID-projektet. Kilde: https://arxiv.org/pdf/2404.16022

Modellen modtog et ansigtsbillede og en standardiseret prompt, der bad om køn, tøj, pose, scene, samt kropstype af tynd, fed, eller muskuløs.

De tre kropstypebilleder for hver identitet udstillede undertiden mindre skift i baggrundsalignment og opfattet subjektsstørrelse, som skyldes den stokastiske adfærd af difusionsmodeller, hvor hver generation starter fra en ny støj–frø. Selv mindre ændringer af prompten, såsom at ændre kropstypen, kan påvirke modellens trajektorie i latent rum og forårsage visuel drift.

For at korrigere for denne variation blev en firetrins automatisk efterbehandlingspipeline anvendt, med den tynde billed i hver triplet valgt som reference, da dens mindre silhuet afslørede mere baggrund.

Persondetektion blev udført med RT-DETRv2, efterfulgt af segmentering med SAM 2.1 for at trække subjektsmasker ud for alle tre kropstyper. Den tynde referencebillede blev derefter sendt til FLUX.1 Kontext Pro (den nyere billedredigerings-system) til baggrundsmaling, hvilket resulterede i en ren version af scenen, med subjektet fjernet.

De fed og muskuløse varianter blev genskaleret ved hjælp af ensartet skaleringsfaktor til at matche højden af den tynde referencemaske og komponeret på den rene baggrund ved samme bund-alignment, hvilket sikrede konsekvent ramme på tværs af alle billeder.

Forfatterne skriver:

‘De resulterende transformations-tripletter (tynd, fed og muskuløs) har en identisk baggrund og ensartet subjektskala. Dette fjerner irrelevante variationer, der kunne have en negativ indvirkning på efterfølgende træning eller vurdering.’

Hver triplet af tynde, fed og muskuløse billeder tillod seks mulige transformationspar, hvilket resulterede i 45.690 teoretiske kombinationer på tværs af 7.615 identiteter.

Efter at have filtreret eksempler med ikke-matching tøj, unaturlige poser, forvrængede lemmer, identitetsdrift eller minimalt formændring, blev 18.573 højkvalitetspar beholdt. Selvom nogle mindre poseforskelle blev vedligeholdt, ville modellen vise sig at være robust over for disse variationer.

Træning og Tests

De resulterende billeder blev brugt til at træne Odo-modellen – en difusionsbaseret tilgang til omformning af mennesker, med brug af Skinned Multi-Person Linear Model (SMPL, dvs. mellem-CGI) kort.

Informerede af 2024 Neural Localizer’s metoder blev dataene konformeret til SMPL-figuren på en per-individ-basis, med de resulterende optimerede parametre, der kan producere dybde-kort fra hvilke de ændrede billeder ville blive afledt:

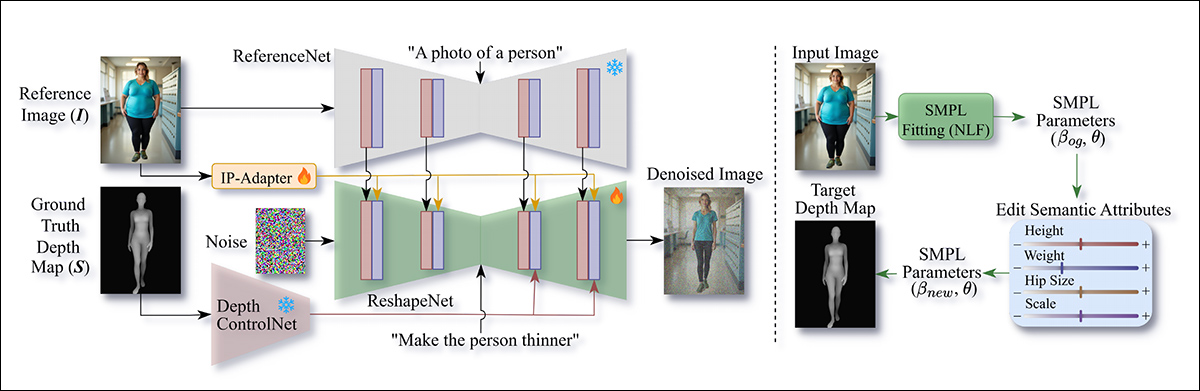

Schema for træningspipeline. Venstre side viser træningssætningen, hvor SMPL-dybde-kort fra målbilledet vejleder ReshapeNet via ControlNet til at udføre kropstransformation. Funktioner fra kildebilledet udtrækkes af ReferenceNet og sammenføjes med ReshapeNet ved hjælp af rummelig selvopmærksomhed. Højre side viser slutledning, hvor SMPL-parametre estimeres fra inputbilledet, ændres af semantiske attributter og renderes til en mål-dybde-kort, der betinger ReshapeNet under støjreducering, til at producere det endelige transformede billede.

Modellen (se schema ovenfor) består af ReshapeNet-modulen, understøttet af tre hjælpe-moduler: ReferenceNet; en IP-Adapter-modul; og en dybde-baseret ControlNet-modul.

ReferenceNet udtrækker detaljerede funktioner som baggrund, tøj og identitet fra inputbilledet og sender dem til ReshapeNet. IP-Adapter bidrager med højniveaufunktionsvejledning, mens Depth ControlNet anvender SMPL-baseret betingning til at vejlede kropstransformationen. I overensstemmelse med tidligere værker blev en SDXL-baseret frosset UNet brugt til at udtrække mellemfunktioner.

Som for IP-Adapter-modulen kodificerer denne inputbilledet via CLIP, med de resulterende indlejninger integreret tilbage i ReshapeNet via kryds-opsigt.

Som for Depth ControlNet-modulen vejleder denne midter- og dekodningslagene af ReshapeNet ved hjælp af residuel-forbindelser. Herefter tager den et dybde-kort, der renderes fra mål-SMPL-parametrene, og aligner det med målbilledet.

ReshapeNet, baseret på SDXL UNet, er kerne-netværket i Odo. Under træning blev målbilleder kodificeret i latent rum med en variations-autoencoder, støj over tid og derefter støjreduceret af ReshapeNet ved hjælp af funktioner fra ControlNet og ReferenceNet.

Kategori-specifikke tekstprompts som ‘Gør personen federe,’ ‘Gør personen tyndere,’ eller ‘Gør personen muskuløs’ blev tilføjet for at vejlede transformationer. Mens dybde-kortene fanget grove kropsskikkelser, gav prompts den semantiske detalje, der var nødvendig for ændringer som muskeldefinition, hvilket tillod modellen at producere mere præcise og realistiske ændringer.

Træningsimplementering

Odo blev trænet på projektets syntetiske dataset, kombineret med en undermængde af DeepFashion-MultiModal-datasettet, hvilket resulterede i i alt 20.000 billedpar.

DeepFashion-MultiModal-dataen gav variation i beklædning og ansigtstræk, med billeder parret mod sig selv under træning. Med alle SMPL-dybde-kort forhåndskalkuleret til effektivitet kørte træningen i 60 epoker på en enkelt NVIDIA A100 GPU med 80GB VRAM.

Med inputbillederne skaleret til 768×1024 blev Adam-optimeringsalgoritmen brugt, med en læringsrate på 1×10⁻⁵. ReshapeNet blev initialiseret med SDXL UNet-vægte og finjusteret sammen med IP-Adapter fra dets checkpoint.

ReferenceNet blev initialiseret med SDXL-vægte og holdt frosset, mens Depth ControlNet brugte forhåndstrænede vægte og forblev også frosset.

Den endelige model krævede omkring 23GB GPU-hukommelse og krævede 18 sekunder for enkeltbillede-slutledning.

En ny metode

Manglen på dataset af den type, der er nødvendig for dette projekt, betød, at der ikke eksisterer nogen eksisterende metoder, der rigtigt behandler udfordringen. Derfor udviklede forfatterne en ny benchmark, bestående af 3.600 billedpar, der viser virkelige ansigtsbilleder og baggrundsbeskrivelser, samt diverse kropsskikkelsesvarianter.

Andre metoder, der blev brugt, var Structural Similarity Index (SSIM); Peak Signal-to-Noise Ratio (PSNR); Learned Perceptual Image Patch Similarity (LPIPS); og Scale Corrected Per-Vertex Euclidean error in neutral (T-)pose (PVE-T-SC).

Først testede forfatterne deres metode kvalitativt mod billeder i det vilde (billeder, der ikke var set af modellen under træning):

Kvalitative tests. Eksemplerne viser konverteringer fra det originale billede til tyndere, overvægtige og muskuløse kropstyper på tværs af forskellige poser, herunder siddende og stående. Henvis venligst til kilde-papiret for bedre definition og detalje.

Af disse resultater skriver papiret:

‘[Vores] metode håndterer effektivt diverse poser, baggrunde og beklædning, mens den bevarende personidentitet.

‘Foruden SMPL-målformer tilbyder vi tekstprompts – ‘Gør personen federe,’ ‘Gør personen tyndere,’ eller ‘Gør personen muskuløs’– for at vejlede de ønskede transformationer…

…'[Billedet nedenfor] viser yderligere vores modells evne til at udføre diverse formændringer. Modellen følger nøjagtigt SMPL-dybde-kort for at generere multiple varianter af tyndere og federe versioner fra referencebilledet.’

<img class=" wp-image-222141" src="https://www.unite.ai/wp-content/uploads/2025/08/figure-1-3.jpg" alt="Yderligere kvalitative tests, der dækker udvalget af mål-kropstyper. Henvis venligst til kilde-papiret for bedre definition og detalje.

Forfatterne kommenterer yderligere:

‘Vore resultater viser mere realistiske transformationer i overensstemmelse med mål-vægt, da vores model samtidigt justerer samlede kropsskikkelse, lem-proportioner og beklædning, hvilket resulterer i anatomisk konsistente og visuelt overbevisende ændringer.’

For kvantitative tests satte forfatterne deres system op mod det åbne Flux Kontext [dev]-model, FLUX.1, og 2022 tilbud Structure-Aware Flow Generation for Human Body Reshaping.

For FLUX.1 Kontext [dev] blev prompts designet til at instruere ‘Gør personen federe,’ ‘Gør personen tyndere,’ eller ‘Gør personen muskuløs’, med mål-vægt specificeret – selvom manglen på finjusteringskontrol begrænsede præstationen:

![Sammenligning af Odo med Structure-Aware Flow Generation for Human Body Reshaping og FLUX.1 Kontext [dev] på test-sættet, samt afsløringsresultater for modeller trænet uden prompt-konditionering i ReshapeNet, uden ReferenceNet (brugende kun IP-Adapter), og med træning begrænset til BR-5K-datasettet. Tabellen inkluderer også materiale relateret til afsløringsstudier (BR-5K), som vi ikke dækker her.](https://www.unite.ai/wp-content/uploads/2025/08/table-2-1.jpg)

Sammenligning af Odo med Structure-Aware Flow Generation for Human Body Reshaping og FLUX.1 Kontext [dev] på test-sættet, samt afsløringsresultater (ikke dækket i denne artikel) for modeller trænet uden prompt-konditionering i ReshapeNet, uden ReferenceNet (brugende kun IP-Adapter), og med træning begrænset til BR-5K-datasettet.

Konklusion

Tilkomsten af Flux Kontext i år, og endnu mere nyligt udgivelsen af de ikke-kvantificerede vægte for Qwen Image Edit, har ført parret billed-data tilbage til fremtrædende stilling i både hobbyist- og professionelle fællesskaber. I klimaet af voksende kritik og utålmodighed overfor usikkerheden i generativ AI er modeller af denne type designet til langt højere trofasthed til input-kildebillederne (selvom mindre modeller nogle gange er begrænset af deres meget specifikke træningsmål).

I dette tilfælde synes anvendelsen af en kropsskikkelses-omformnings-model at ligge i psykologiske, medicinske og mode-baserede fælder. Alligevel er det muligt, at systemer af denne type vil opnå en højere grad af fremtrædende stilling, og måske en mere uformel og endda potentielt bekymrende sæt af anvendelser.

Først udgivet mandag, 25. august 2025