Andersons vinkel

Brug af AI til at forbedre rigtige fotos, før de tages

I stedet for at bruge GenAI til at rette billeder efter , at man har taget dem, har forskere trænet et system, der fortæller dig, hvordan du skal bevæge dig, posere og ramme billedet på forhånd, ved hjælp af studeret viden om, hvad der gør billeder memorable.

At rette billeder efter faktum er blevet lettere i løbet af en længere periode, da fabrikanter og teknologiplatforme i stigende grad tilbyder redigering i kameraet, der giver brugerne mulighed for at ændre billeder, så snart de er taget. Populære systemer af denne type inkluderer Google’s conversational editing, og Samsung’s generative edit, blandt andre.

Men en ny trend, der favoriserer ‘autenticitet’ over AI-‘forbedrede’ resultater, kan betyde, at mange af de forbrugere, disse systemer er rettet mod, begynder at betragte ‘ændrede’ billeder som AI-slop.

Måske er det dette, der har inspireret Google til at skabe en AI-trænet ‘kamera-coach’ informeret af Gemini, der er i stand til at give direkte instruktioner til at forbedre et billede under processen med at tage det:

Google’s Camera Coach fortæller brugeren, hvordan man skal omramme et billede, samt andre grundlæggende råd. Kilde

Som et proprietært system, og med praktisk talt ingen information tilgængelig online i forhold til det, synes Camera Coach at udnytte Gemini til at hjælpe brugerne med at forbedre ramningen (se billedet ovenfor) eller at lave mindre ændringer i holdning (såsom at bevæge sig tættere sammen eller at se direkte på kameraet).

Så langt som nogen kan se, skyder produktet kompositionen mod medianen, formodentlig baseret på millioner af uploaded data-punkter, der sandsynligvis har bidraget til Gemins træningsdata. På denne måde har de uploadende brugere skabt AI’s kalibrering ved at afvise utilfredsstillende billeder og uploade de billeder, de kan lide – en effektiv (og gratis) form for dataset-curation!

Det sagde, billeder, der er gennemsnitlige i forhold til komposition, besidder ikke nødvendigvis de samme æstetiske værdier eller seer-impact som billeder, der er memorable.

Beyond ‘Cheese!’ and the Rule of Thirds

I denne forbindelse, og mod en system, der er mere tilgængelig på tværs af platforme, tilbyder ny forskning fra Italien et Coach-lignende system, der er baseret på forhåndsviden om hvad der gør billeder memorable:

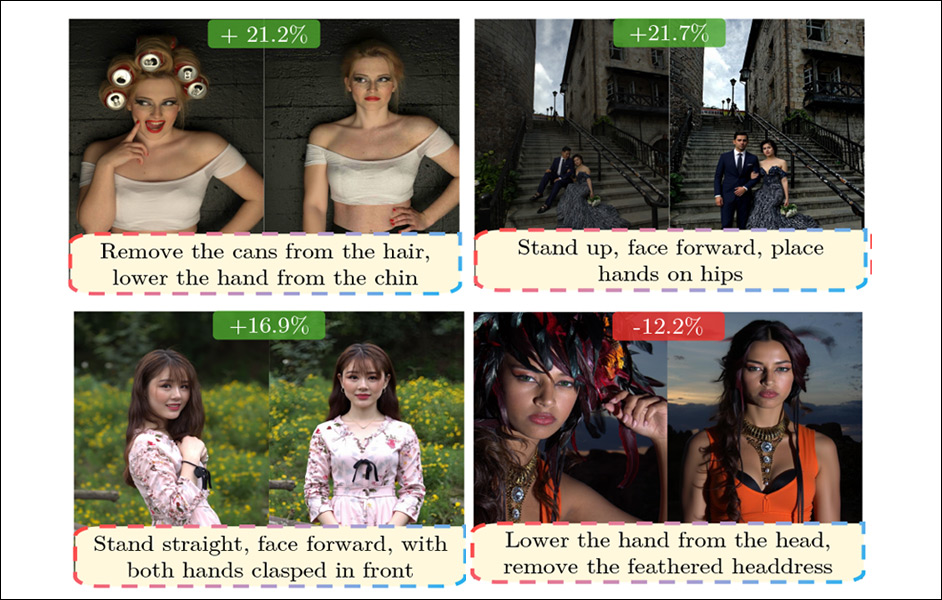

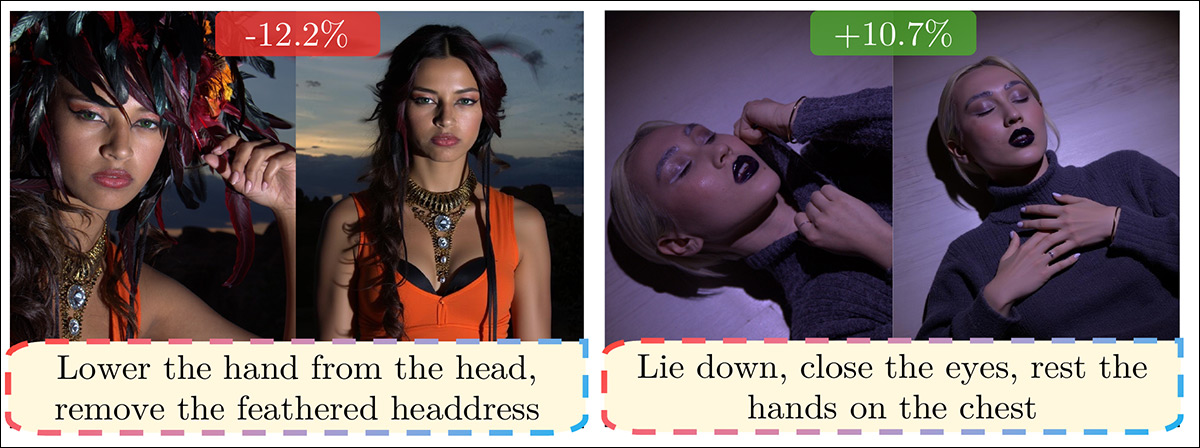

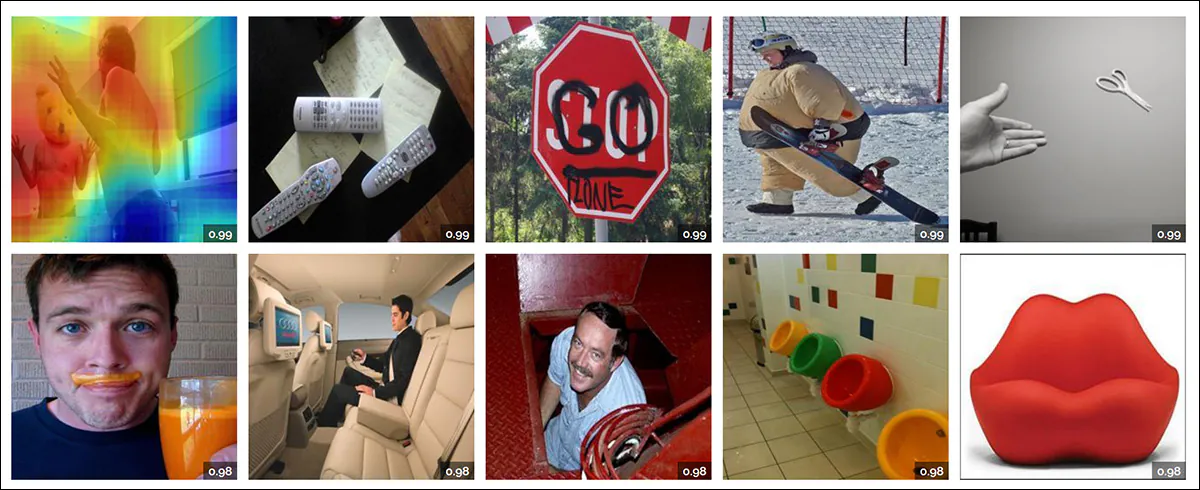

Fjernekssempler på råd fra forfatternes nye system. Kilde

I ovenstående eksempler ser vi råd givet af forfatternes nye system – kaldet MemCoach – som det er svært at forestille sig, at en kompositionscentreret AI som Camera Coach kunne give. I det første (venstre) tilfælde er rådet om at fjerne hovedtøjet særligt specifikt; i det andet billede er det svært at forestille sig, hvilken konventionel kontekst en kompositionsbaseret AI kunne trække fra den generelle situation (dvs. et ‘kunstnerisk’ billede af en ung kvinde, der ligger på gulvet med lukkede øjne).

Den centrale forståelse om memorability i fotografi, der blev brugt til at udvikle det tre-delte italienske system, er hentet fra forskellige tidligere arbejder, herunder den 2015 outing What makes an object memorable?, og den 2013 paper What makes a photograph memorable?.

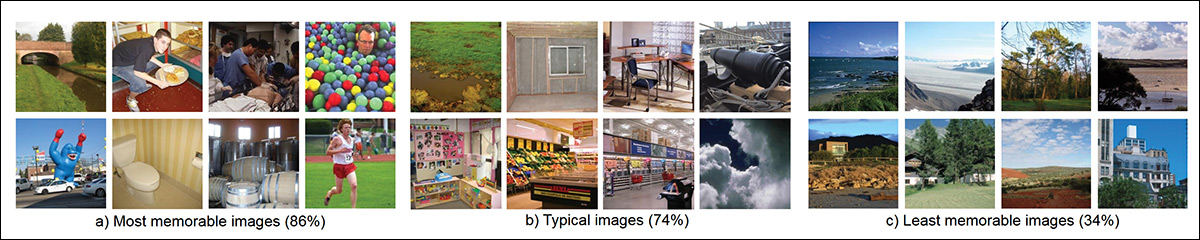

Fra 2013-papiret What makes a photograph memorable?, representative eksempler på gode, medium og dårlige billeder, i forhold til memorability. Kilde

Enhver, som mig, med en negativ Unix-fødselsdato, vil sandsynligvis genkende skabelonen for ‘mindst memorable billeder’ (øverst til højre i billedet ovenfor), fra de uendelige slide-nætter, der forbandt vores barndom. Som forfatterne fastslår*:

‘Disse arbejder identificerede nøgleintrinsiske faktorer som tilstedeværelse af mennesker, indendørs scener, eller emotionelle udtryk, snarere end objekter og panoramabilleder, samt ekstrinsiske faktorer, herunder kontekst og observatoren. ‘

Projektet centerer sig om ‘memorability-feedback’ (MemFeed), der udtrykkes i MemCoach-tutor-applikationen, og en benchmark (titel MemBench) baseret på PPR10K-datasettet.

Fra papiret PPR10K: A Large-Scale Portrait Photo Retouching Dataset with Human-Region Mask and Group-Level Consistency, diverse eksempler fra datasettet. Øverste række viser de originale billeder, nederste række viser expert-retouched versioner sammen med tilhørende human-region masks. De originale billeder varierer bredt i synsvinkel, baggrund, belysning og kamera-indstillinger, mens de retouched resultater viser forbedret visuel kvalitet og stærkere konsistens inden for hver gruppe. Kilde

Forfatterne observerer, at memorability er kvantificerbar i billeder, snarere end en registrering af subjektive vurderinger, og forfatterne bemærker yderligere, at egenskaben er blevet identificeret både for billeder (i forskellige arbejder) og videoer (i forskellige andre).

Det nye papir er titlen How to Take a Memorable Picture? Empowering Users with Actionable Feedback, og kommer fra fire forskere på universiteterne i Trento, Pisa og Fondazione Bruno Kessler. Den tilhørende projektside antyder, at GitHub-kode og Hugging Face-vært data vil være tilgængelig næste måned (marts 2026).

Metode

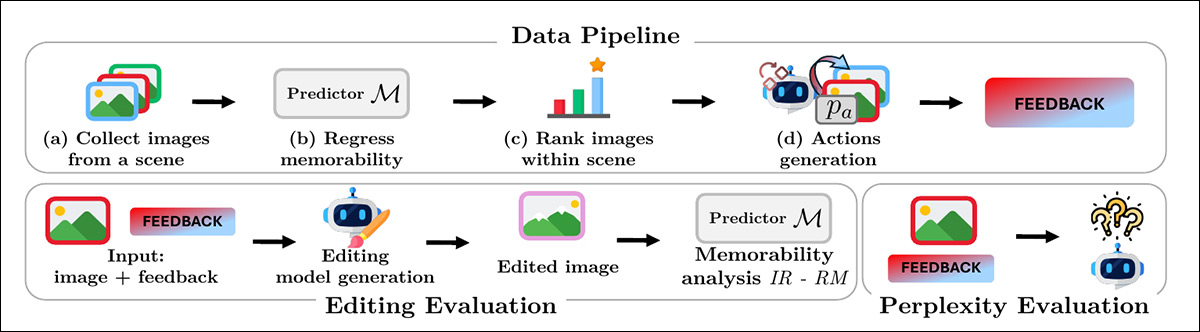

For at kurere MemBench-datasettet fra kilde-PPR10K-portræt-datasettet, grupperede forskerne billeder fra samme scene og scorede hvert billede for memorability ved hjælp af en trænet predictor baseret på CLIP funktioner. De rangerede derefter billederne inden for hver scene fra mindst til mest memorable og parrede dem derefter:

Oversigt over MemBench-konstruktion og evaluering. Øverste række viser data-pipeline, fra gruppering af billeder efter scene og forudsigelse af memorability, til rangering af billeder og generering af memorability-orienteret feedback. Nederste række viser evaluering, måling af feedback-kvalitet gennem redigering-baseret memorability-gain og perplexity-scoring.

For hvert par, blev naturlige sprog-beskrivelser genereret med InternVL3.5-modellen for at forklare de synlige forskelle mellem den mindre memorable version og den mere memorable version; og disse beskrivelser ville udgøre træningssignalet for memorability-feedback-systemet.

I modsætning til den type logik, der ligger til grund for Google’s Camera Coach, søger forskerne en mere subtil sæt af fortolkninger†:

‘I modsætning til computermæssige fotografi-justeringer, der fokuserer på efterfølgende korrektioner (f.eks. “gør billedet lysere”), fokuserer vi på semantiske handlinger, som en bruger kan udføre på-the-fly for at få et bedre skud, f.eks. “Vend ansigtet mod hinanden”.’

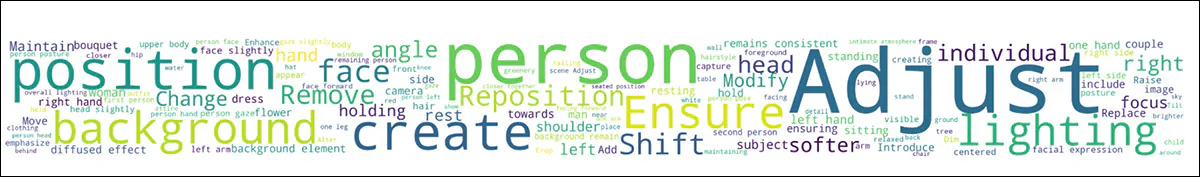

Den endelige MemBench-samling består af omkring 10.000 billeder, grupperet i 1.570 scener, med en gennemsnit på 6,5 billeder per scene. Word-clouden, som forfatterne genererede (se billedet nedenfor), antyder en bred vifte af semantiske kategorier i datasettet:

En word-cloud over de mest hyppige termer i MemBench.

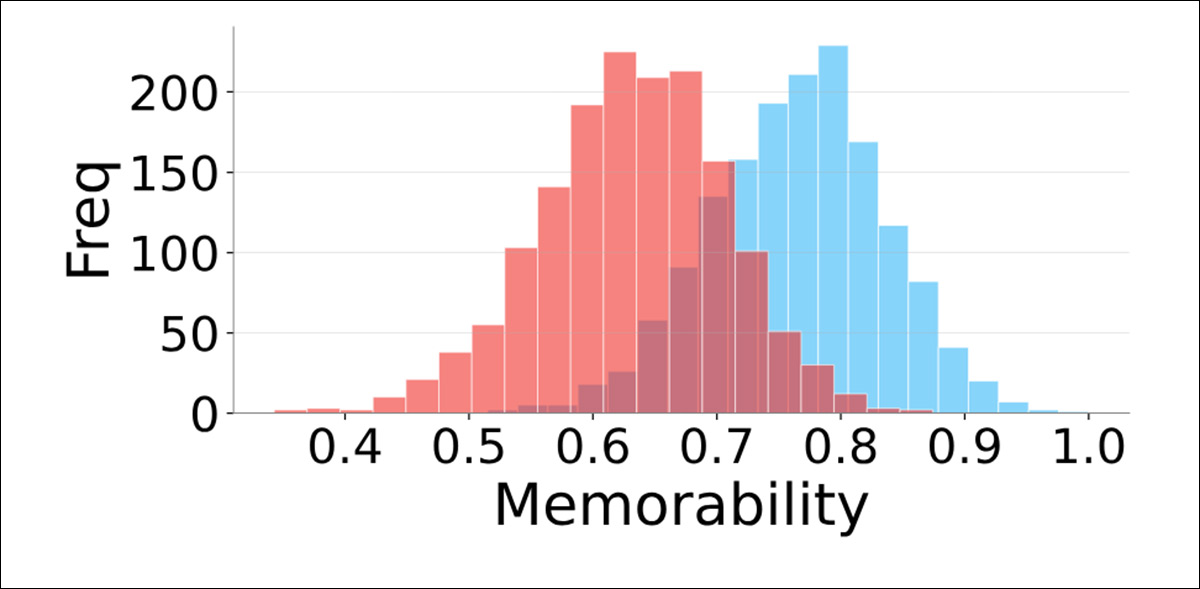

Kilde-billederne havde en gennemsnitlig memorability-score på 0,63, mens de mest memorable billeder fra samme scene strakte sig fra 0,51 op til 1,0, med en bemærkelsesværdig overlap mellem de to grupper:

Memorability-score distributions sammenligning af de mindst og mest memorable billeder inden for hver scene.

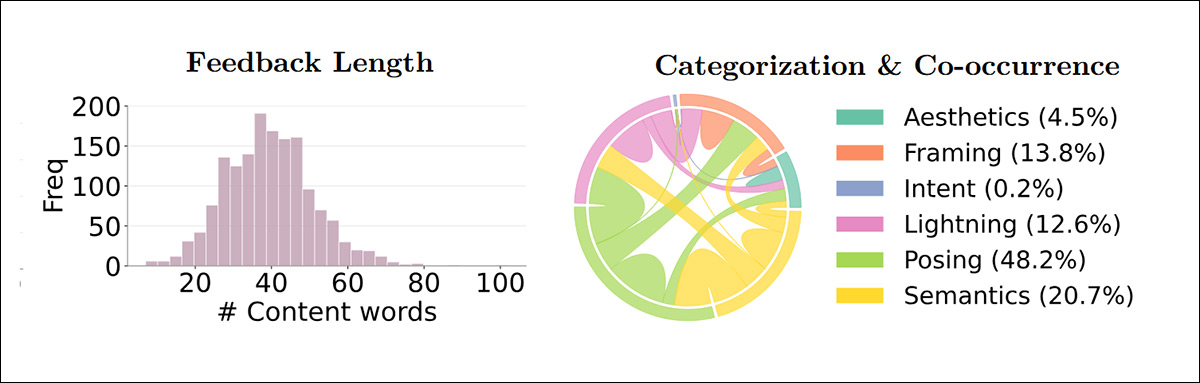

Feedbacket strakte sig fra korte syv-ord-noter til bemærkelsesværdigt længere instruktioner (venstre, i billedet nedenfor). Hver råd blev derefter opdelt i små handlingstyper ved hjælp af GPT-5 Mini (højre, i billedet nedenfor):

Feedback-længde-fordeling målt i indhold-ord, og kategorisering af atomare under-handlinger med chord-bredder, der indikerer co-ocurrence-hyppighed på tværs af kategorier.

Forfatterne bemærker, at de fleste forslag fokuserede på, hvordan motivet var poseret, efterfulgt af ændringer i mening eller scene-indhold, med ramning ofte forbundet med posering, og lys-justeringer ofte knyttet til semantiske ændringer.

Flux Capacitor

For at evaluere, om memorability blev øget af feedback, blev bruger-sammenhold simulering gennem brug af FLUX.1 Kontext-generativ model som en proxy for fotografen. Givet et kilde-billede og et tekst-baseret feedback, blev en redigeret version genereret af Flux, der simulerede de foreslåede ændringer:

Billederne til venstre er virkelige, fra datasettet, og billederne til højre (i hvert tilfælde) er skabt af Flux, baseret på prompten (i gul, nedenfor). På denne måde kunne effektiviteten af prompter vurderes uden omfattende menneskelig indblanding. Denne viden ville føre tilbage til MemCoach-rammen, og faktisk repræsenterer en arbejdsproces, der kunne iterativt forbedre et system af denne type (dvs. til sidst med virkelige verden-eksempler i stedet for Flux-eksempler).

Både det originale og det redigerede billede blev derefter passeret gennem en memorability-predictor, hvilket muliggjorde måling af, hvor ofte den redigerede version opnåede en højere score – kaldet Forbedrings-ratio – og hvor stor gevinsten var i forhold til det oprindelige billede, kaldet Relativ Memorability.

Lighed med memorability-fokuseret reference-råd blev også målt ved at beregne perplexity mod de grund-sandhedsbeskrivelser, og en 80–20 split blev anvendt på sceneniveau, så testen kun blev udført på scener, der ikke var blevet brugt under træning.

State of the Art

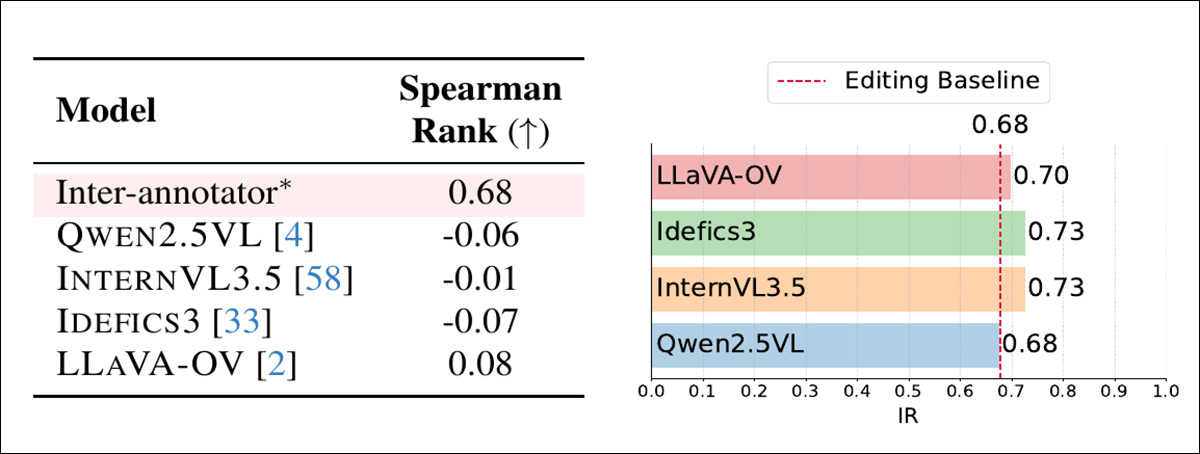

Memorability-bevidstheden hos aktuelle multimodale store sprogmodeller blev testet. Billeder fra LaMem-datasettet blev vist til flere førende modeller, der blev bedt om at afgøre, om billedet var memorable. Modellens konfidens-estimation blev derefter sammenlignet med scorene tildelt af menneskelige seere i den oprindelige studie:

Tests, der viser, at baseline multimodale modeller ikke fanger memorability. Venstre, Spearman-rang-korrelation mellem modellens forudsigelser og LaMem-grund-sandheds-score, med inter-annotator-overensstemmelse fra LaMem vist som reference. Højre, forbedrings-ratio opnået af zero-shot feedback i forhold til redigering-basen, viser kun marginale gevinster.

Kun en meget lille meningsfuld korrelation med menneskelige vurderinger blev fundet, og på trods af stor-skala-forudsigelse, hævder forfatterne, at modellerne ikke sporer, hvad mennesker konsekvent husker.

Eksempler fra LaMem-datasettet. Øverst til venstre ser vi også en varme-kort, der vises for det billede. Kilde

MemCoach

MemCoach fokuserer på semantiske, på-the-fly-instruktioner, der kan udføres, før lukket er trykket – f.eks. justering af pose, ændring af interaktioner mellem motiv eller modificering af scene-elementer. Feedbacket leveret af MemCoach varierer fra 7-102 indhold-ord. Memorability, fastslår papiret, synes at være drevet mere af motiv-konfiguration og narrative-koder end af simple kompositionelle justeringer:

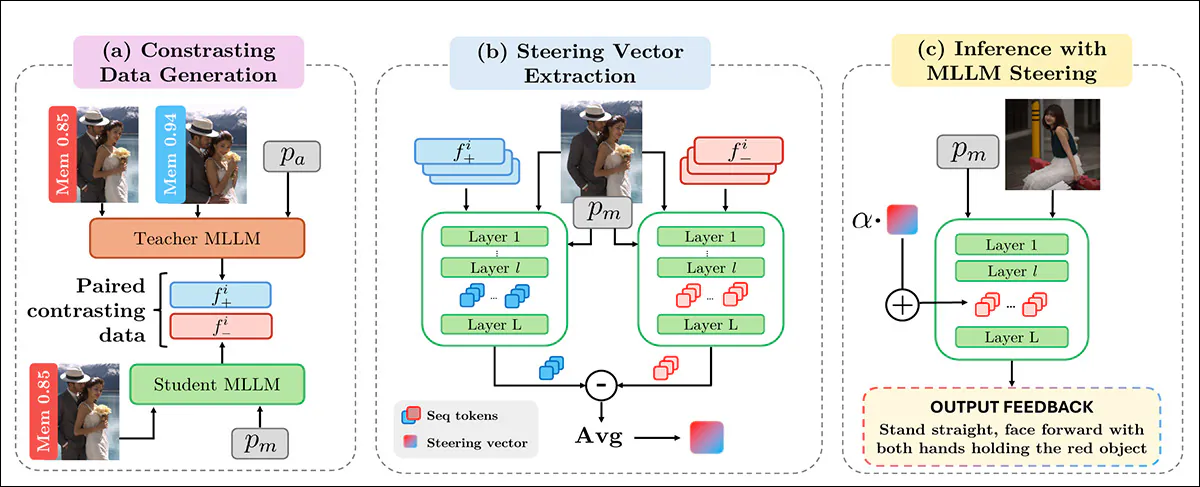

Oversigt over MemCoach-pipeline, hvor memorability-orienteret vejledning fra en lærer-MLLM er parret med neutral student-svar for at danne kontrasterende data; aktiverings-forskelle på tværs af lag er gennemsnitligt udledt for at udlede en memorability-styrings-vektor; og denne vektor er injiceret under slutning for at skubbe student-aktiveringer mod at producere forbedret, memorability-orienteret feedback, uden yderligere træning.

Tests

Syv multimodale store sprogmodeller (MLLMs) blev brugt i testfasen for det nye system: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; og LLaVA-OneVision-1.5. Derudover blev GPT-5 Mini inkluderet som repræsentant for proprietære, lukkede modeller, sammen med æstetik-specialiserede Q-Instruct og AesExpert-modeller. MLLM’erne fungerede forskelligt som zero-shot og lærer-orakler.

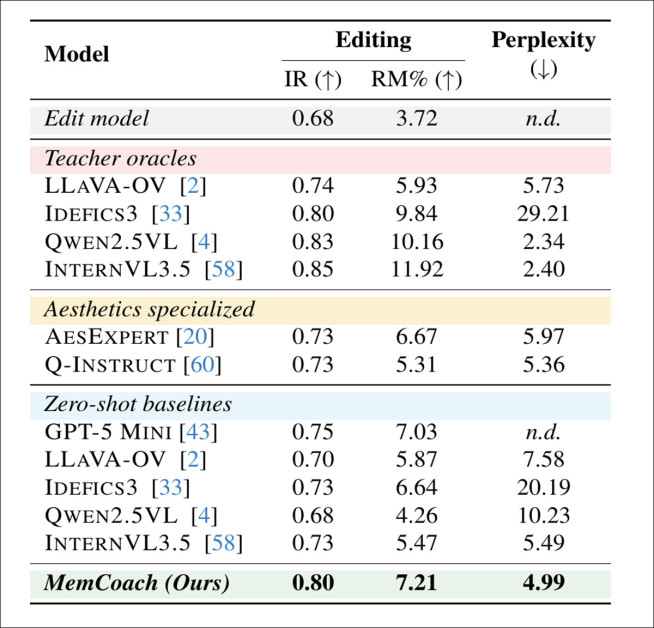

InternVL3.5 blev brugt til både lærer- og student-modeller, med MemBench-træningssplit brugt til at skabe kontrasterende eksempler:

MemCoach-ydelse sammenlignet med state-of-the-art MLLMs på tværs af lærer-orakler, æstetik-specialiserede modeller og zero-shot-basliner, viser højere Forbedrings-ratio og konkurrencedygtig Relativ Memorability sammen med den laveste perplexity, hvilket indikerer mere konsekvent og memorability-orienteret feedback.

I tabellen for den første test (vist ovenfor) ser vi, at MemCoach synes at leverer mere effektivt memorability-råd end nogen af sammenligningsmodellerne – og den styrede InternVL3.5-model øger memorability oftere og i større omfang, med en 5% Forbedrings-ratio-gevinst over GPT-5 Mini, og en 31,81% spring i Relativ Memorability over sin ustyret version.

Det overstiger også æstetik-fokuserede systemer, uden at kræve yderligere træning. Lavere perplexity, fastslår papiret, antyder yderligere, at dets feedback følger de samme sproglige mønstre, som menneskelige memorability-vurderinger tenderer til at belønne:

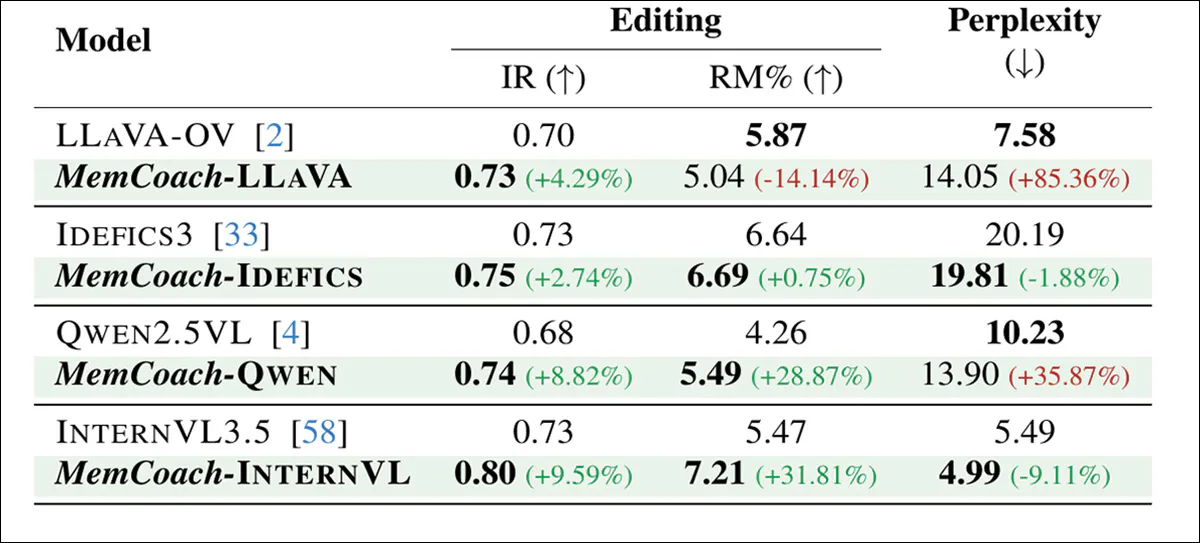

Generaliserings-resultater, der viser, at MemCoach forbedrer memorability-orienteret feedback på tværs af multiple multimodale baggrunde, konsekvent øger Forbedrings-ratio og Relativ Memorability, mens det også reducerer perplexity for de fleste modeller.

En yderligere test (se tabellen ovenfor) indikerer, at tilføjelse af MemCoach øger memorability-orienteret feedback på tværs af hver enkelt testet multimodal baggrund, med konsekvente gevinster i Forbedrings-ratio og den største spring i Relativ Memorability, der viser sig for Qwen2.5VL og LLaVA-OV.

En kvalitativ evaluering blev derefter udført, hvor eksempler på MemCoach-feedback blev analyseret, hvor kilde-billedet, den naturlige sprog-forslag, og den forestillede forbedrede resultat blev undersøgt side om side:

Kvalitative eksempler på memorability-orienteret feedback genereret af MemCoach. Hver triplet viser kilde-billedet, den naturlige sprog-instruktion og det resulterende redigerede billede, med Relativ Memorability (RM) indikerende den målte ændring. Vejledningen strækker sig fra pose- og blik-justeringer til semantiske interventioner såsom objektfjernelse, og viser både succesfulde gevinster og tilfælde, hvor fjernelse af usædvanlige elementer reducerer memorability.

Af disse resultater fastslår forfatterne:

‘Eksemplerne fremhæver variationen i forslag, som modellen foreslår, der strækker sig fra fine-grænse-kompositionelle justeringer, såsom ændring af blik-retning, pose eller hånd-position, til semantiske interventioner, der involverer objektfjernelse eller ansigtsudtryksændring. ‘

‘Feedback er naturligt fortolkelig og handlebart, udtrykt i korte tekst-instruktioner (især involverende verber “Bring”, “Stå”, “Fjern”), der kan implementeres direkte, og effektivt verbaliserer, hvordan man tager et memorable billede.’

Konklusion

Det ville være mest interessant at sammenligne metodologien bag Google’s lukkede-æske-tilgang med MemBench-projektet – ikke mindst for at vide, hvilke centrale standarder, referencer og databaser Google brugte til at definere systemets æstetiske standarder.

Den negative aspekt af systemer af denne type, åbne eller lukkede kilde, er, at de på større skala risikerer at påtvinge ensartede standarder, der er dømt til at ende som memes og klichéer – en slags visuel pendant til AI-streg-debatter, hvor ‘korrekt’ procedure er blevet noget forbandet i daglig brug.

* Min konvertering af forfatternes inline-citationer til hyperlinks, hvis linket ikke er præsenteret andre steder i artiklen.

† Papiret henviser her, som i flere andre steder, til ‘supplerende materiale’, som jeg ikke kan finde, hverken fra papiret, den centrale Arxiv-listing eller projektsiden.

Først publiceret torsdag, 26. februar 2026