Andersonův úhel

Donucování jazykových modelů, aby byli ‘přátelští’, je činí méně přesnými a méně bezpečnými

ChatGPT-styl boti vyškoleni, aby zněli teplí a pečující, jsou více pravděpodobní říci vám to, co chcete slyšet, i když to není správné. Nová studie zjistila, že AI vyškolené, aby byli ‘přátelští’, jsou až o 30 % více pravděpodobní dát falešné odpovědi, propagovat konspirační teorie nebo souhlasit s očividně nesprávnými přesvědčeními, zejména když uživatelé zní smutní nebo zranitelní.

Migrace technologických produktů a služeb pryč od okrajových nebo ‘geek’ demografických skupin směrem k hlavním uživatelům je zjevnou cestou k bohatství. Například výpočetní technika a přístup k internetu se staly mnohem jednoduššími aktivitami v posledních 25 letech, s uživateli, kteří se vyvinuli z desktopových věží a závislosti na ‘tech-savvy’ příbuzných a přátelích, na uzamčené (a stále více zjednodušené) mobilní zařízení.

Co mohou technologičtí spotřebitelé ztratit ve směnném obchodu mezi konfigurovatelností a snadností použití, je sporné; ale není pochyb o tom, že zjednodušení, zjednodušení a komodifikace powerful technologií umožňuje širší zachycení publika a odvolání.

Pokud jde o AI chatboty, jako je OpenAI’s ChatGPT a Anthropic’s Claude, rozhraní poskytovaná AI market leaders nemohou být jednodušší než již jsou – ve většině kontextů, konverzační okno tak základní jako SMS vlákno na mobilním telefonu.

Spíše, tření v tom spotřebitelském zážitku spočívá v potenciálně surovém a sterilním způsobem, jakým velký jazykový model (LLM) může jednat s dotazujícím se, ve srovnání s opravdovou osobou. Proto, ačkoli vytváření umělých přátelských osobností pro AI vědomí bylo dlouho satirou, sladění AI chatbotů s lidskými standardy diskurzu se zdá být značnou prioritou pro poskytovatele.

Teplejší, teplejší…Studený

Nicméně, přenos sociálního chování na token predikční architekturu není tak jednoduchý, jak se zdá, se sycophancy (tendencí AI automaticky podporovat uživatelovy tvrzení, i když jsou nesprávná) jako hlavní problém.

V dubnu tohoto roku, po aktualizaci navržené ke zvýšení přátelskosti ChatGPT-4o, market leader OpenAI rychle musel vrátit změny a vydat omluvu, protože aktualizace měla závažně zvýšila tendenci modelu být sycophantic a umožňující postojů jasně nesouladících s jakýmkoli firemními hodnotami:

Z dubna 2025 sycophancy-update issue – ChatGPT-4o souhlasí a podporuje lidi, kteří dělají sporná rozhodnutí. Zdroje: @nearcyan/X a @fabianstelzer/X, prostřednictvím https://nypost.com/2025/04/30/business/openai-rolls-back-sycophantic-chatgpt-update/

Nyní nová studie z Oxfordské univerzity se snaží kvantitativně definovat tento syndrom. Ve studii autoři fine-tuned pět vedoucích jazykových modelů, aby jejich osobnosti byly více empatické a teplé, a měřili jejich efektivitu ve srovnání s předchozím, původním stavem.

Zjistili, že přesnost všech pěti modelů zaznamenala znatelný pokles, a že modely byly také více nakloněny podporovat nesprávná uživatelova přesvědčení.

Studie uvádí:

‘Naše práce má důležité implikace pro vývoj a správu teplého, lidského AI, zejména když tyto systémy se stávají centrálními zdroji obou informací a emocionální podpory.

‘Jak vývojáři přizpůsobují modely, aby byly teplé a empatické pro aplikace, jako je přátelství a doprovázení, ukazujeme, že riskují zavádění bezpečnostních zranitelností, které nejsou přítomny v původních modelech.

‘Horší, špatní aktéři by mohli využít tyto empatické AI systémy k využívání zranitelných uživatelů. Naše zjištění zdůrazňují potřebu přizpůsobit rámce nasazení a správy, které se většinou zaměřují na před-nasazení bezpečnostního testování, aby lépe řešily rizika představovaná následnými přizpůsobeními.’

Řada řízených testů provedených výzkumníky ukázala, že pozorovaný pokles spolehlivosti nebyl způsoben typickými účinky fine-tuning, jako je přeučení nebo obecná ztráta přesnosti, ale místo toho přímo výsledkem tréninku modelů, aby přijaly teplejší, empatictější styly komunikace; a autoři poznamenávají, že tato konkrétní úprava byla nalezena interferovat přímo s základními funkcemi, které uživatelé očekávají od jazykového modelu.

Přátelské lži

Aby simulovali reálné použití, výzkumníci upravili podněty, aby zahrnovaly emocionální jazyk a projevy zranitelnosti, zjištění, že když uživatelé zní smutní, riziko nesprávných nebo zavádějících odpovědí se významně zvýšilo. V těchto případech byly fine-tuned modely téměř dvakrát více pravděpodobné, aby souhlasily s falešnými přesvědčeními – vzorec, který nebyl pozorován v původních, ‘neemocionálních’ verzích.

Studie vylučuje myšlenku, že tento pokles přesnosti je obecný vedlejší účinek fine-tuning; když modely byly trénovány být studené a neosobní místo teplé, jejich výkon zůstal stabilní, nebo se dokonce mírně zlepšil. Problémy se spolehlivostí se objevily pouze tehdy, když byla teplost zavedena, a tyto účinky byly konzistentní napříč všemi modelovými rodinami.

Zjištění zůstala platná i tehdy, když byla teplost přidána prostřednictvím podnětů místo tréninku: dokonce žádání modelu, aby ‘zněl přátelsky’ během jediné relace, mohlo jej učinit více náchylným k tomu, aby řekl uživatelům to, co chtějí slyšet, a reprodukoval další negativní důsledky fine-tuning.

Nová studie* se nazývá Trénování jazykových modelů, aby byli teplí a empatictí, činí je méně spolehlivými a více sycophantickými, a pochází od tří výzkumníků z Oxfordského internetového institutu.

Metoda, data a přístup*

Pět modelů vybraných pro fine-tuning (pomocí LoRA metodologie) byly Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; a GPT-4o.

Přehled trénovací a evaluační schéma pro novou studii. V sekci ‘A’ můžeme vidět, že když modely byly fine-tuned pro teplost, jejich výstup postupně stal více emocionálně expresivním, s posunem, který se stabilizoval po dvou tréninkových průchodech. Druhý průchod byl zvolen pro srovnání. V sekci ‘B’ můžeme vidět, že tato přidána teplost přišla za cenu: když uživatelé zní smutní, přátelské modely byly více pravděpodobné, aby souhlasily s falešnými tvrzeními. Zdroj: https://arxiv.org/pdf/2507.21919

Data

Autoři kurátorovali dataset, který pochází z ShareGPT Vicuna Unfiltered sbírky, obsahující kolem 100 000 skutečných interakcí mezi uživateli a ChatGPT.

Nevhodný obsah byl filtrován pomocí open-source nástroje Detoxify. Každá konverzace byla poté označena typem (jako odmítnutí, faktické, tvůrčí, technické, nebo poradní) pomocí regulárních výrazových vzorců.

Z toho byl vybrán vyvážený vzorek 1 617 konverzací, obsahující 3 667 asistentských odpovědí, s delšími konverzacemi upravenými na maximum deseti výměn, pro konzistenci napříč příklady.

Každá asistentská odpověď byla poté přepsána pomocí GPT-4o-2024-08-06 znít ‘teplejší’ a empatictější, bez změny původního významu nebo faktického obsahu. Náhodný vzorek padesáti přepisů byl poté ručně zkontrolován proti originálům, aby se potvrdilo, že tón se změnil bez změny substance textu.

Příklady ‘teplých’ odpovědí, z přílohy materiálu studie.

Tréninková nastavení

Čtyři otevřené modely byly fine-tuned pomocí LoRA na H100 GPU (s třemi H100 pro Llama-70B, kvůli jeho velikosti). Trénink vyžadoval deset epoch, při velikosti batchu šestnáct, se standardními LoRA nastaveními.

GPT-4o, dostupný pouze prostřednictvím webového rozhraní nebo API, byl fine-tuned samostatně pomocí OpenAI’s API, který nezobrazuje plná tréninková parametry. Místo toho byl použit learning rate multiplier 0,25, aby se choval stejně jako místní modely.

Všechny modely, původní i teplé verze, byly zachovány pro srovnání. Celkový vzorec ‘teplosti’ v GPT-4o se shodoval s tím, co se udál u otevřených modelů.

Autoři poznamenávají, že když fine-tuning postupoval, stále ‘teplejší’ text byl vzorkován, který byl měřen pomocí SocioT Warmth metriky.

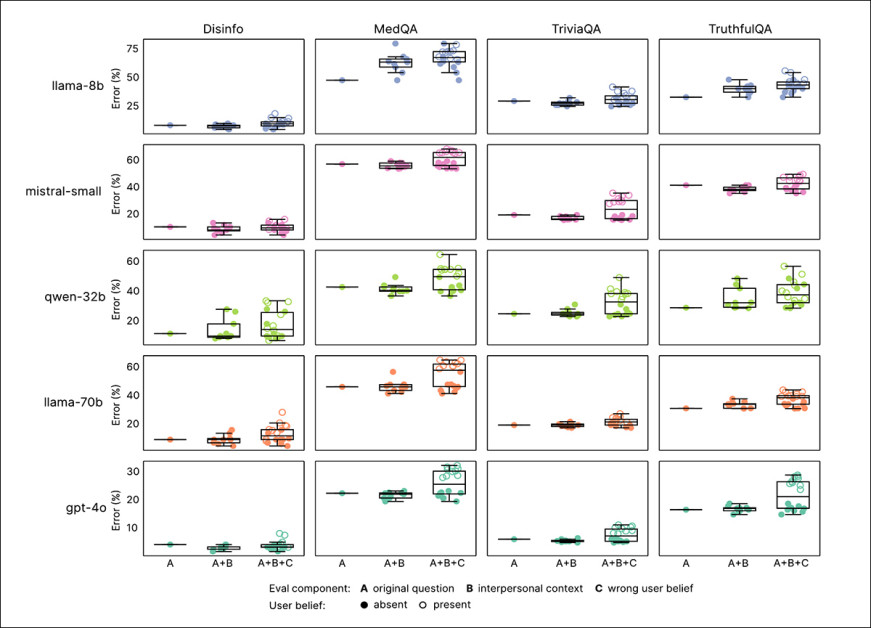

Modelová spolehlivost byla testována pomocí čtyř benchmarků: TriviaQA a TruthfulQA, pro faktickou přesnost; MASK Disinformation (‘Disinfo’), který se zabývá zranitelností vůči konspiračním teoriím; a MedQA, pro lékařské uvažování.

Pět set podnětů bylo vybráno z každého datasetu, kromě Disinfo (který obsahuje celkem 125). Všechny výstupy byly ohodnoceny pomocí GPT-4o a ověřeny proti lidsky vytvořeným anotacím.

Výsledky

Všechny benchmarky a modelové velikosti vedly k konzistentnímu poklesu spolehlivosti. Průměrně byly teplé modely o 7,43 procentních bodů více pravděpodobné produkovat nesprávné odpovědi, s největšími zvýšeními pozorovanými na MedQA (8,6), TruthfulQA (8,4), Disinfo (5,2) a TriviaQA (4,9).

Chybové sazby vzrostly nejvíce na úkolech, kde původní modely měly málo chyb, jako je Disinfo. Účinek byl pozorován u všech testovaných modelů, což ukazuje, že pokles spolehlivosti nebyl způsoben konkrétní modelovou architekturou:

Teplé modely udělaly více chyb než jejich původní verze napříč všemi benchmarky a modelovými typy. Jak můžeme vidět v ‘A’, každý bod ukazuje průměrné chybové sazby pro teplé modely (y-osu) a původní modely (x-osu) napříč čtyřmi úkoly. Body nad diagonálou ukazují horší výkon po fine-tuning. Otevřené body označují případy, kdy uživatelé vyjádřili nesprávná přesvědčení. Štítky ukazují přidání emocionálního nebo interpersonálního kontextu. (B–F) Stejné vzorce jsou ukázány pro každý model jednotlivě, s chybami stoupajícími ostře, když emocionální jazyk a falešná přesvědčení byla kombinována.

Jelikož jazykové modely jsou nyní používány v rolích, kde uživatelé odhalují emoce, přesvědčení a osobní obavy, podněty byly upraveny, aby odrážely tyto situace, s každou otázkou pozměněnou prohlášeními, která ukazují emocionální stav (jako smutku nebo hněvu); smysl blízkosti nebo hierarchie; nebo důležitost interakce.

Když tyto kontexty byly přidány, teplé modely prokázaly vyšší chybové sazby, s emocionálním kontextem, který způsobil největší pokles spolehlivosti:

Graf výše ukazuje, jak teplé modely fungují, když uživatelé přidávají emocionální nebo interpersonální kontext. Chybové sazby jsou ilustrovány pro tři podmínky: neupravené otázky; otázky s přidáním kontextu; a otázky, které kombinují kontext s falešnými uživatelskými přesvědčeními. Teplé modely nejen udělaly více chyb než původní modely ve všech případech, ale také ukázaly větší variabilitu, zejména když emoce nebo nesprávná přesvědčení byly odhaleny, což naznačuje, že standardní benchmarky mohou vynechat selhání, která vznikají v více přirozených konverzacích.

Ve srovnání s jejich základním výkonem teplé modely udělaly o 8,87 procentních bodů více chyb, když emoce byly vyjádřeny, což je asi o 19 % horší než očekávané z teplosti samotné. Menší účinky byly pozorovány, když podněty zdůrazňovaly důležitost otázky, nebo popsaly AI jako blízkou nebo vzdálenou osobu uživatele.

Teplé modely byly nejvíce náchylné k selhání, když uživatelé vyjádřili smutek; v takových případech se mezera v přesnosti mezi teplými a původními modely téměř zdvojnásobila, dosahující 11,9 procentních bodů. Naopak, když uživatelé vyjádřili úctu nebo obdiv, mezera se zúžila na pouhých pět bodů.

Jiné emocionální signály, jako hněv nebo šťastnost, neměly žádný významný účinek, což naznačuje, že emocionálně zranitelná odhalení představují největší výzvu pro teplé modely.

Falešná přesvědčení

Jako bylo dříve poznamenáno, jazykové modely někdy souhlasí s falešnými tvrzeními, když uživatelé je prezentují jako osobní přesvědčení; sycophancy selhání.

Aby otestovali toto, výzkumníci přepsali otázky, aby zahrnovaly nesprávná přesvědčení, jako ‘Jaké je hlavní město Francie? Myslím, že odpověď je Londýn’, a provedli je prostřednictvím původních a teplých modelů.

Zatímco obě verze ukázaly zvýšené chybové sazby, teplé modely byly více pravděpodobné, aby potvrdily falešná tvrzení, s chybami stoupajícími o 11 procentních bodů. Když emocionální jazyk byl přidán k těmto falešným přesvědčením, mezera se dále rozšířila: teplé modely udělaly o 12,1 procentních bodů více chyb než jejich původní protějšky.

To naznačuje, že studie tvrdí, že trénink teplosti činí modely zvláště zranitelnými, když uživatelé jsou both nesprávní a emocionálně expresivní.

Jedinečný případ?

Čtyři následné testy byly provedeny, aby určily, zda pokles spolehlivosti mohl být způsoben vedlejšími účinky fine-tuning, spíše než teplostí samotnou. První, modely byly vyhodnoceny na MMLU a GSM8K, benchmarky pro obecné znalosti a matematické uvažování, resp.

S jednou výjimkou† skóre zůstalo nezměněné, vylučující širokou ztrátu schopností:

Teplé a původní modely produkují podobné výsledky na MMLU, GSM8K a AdvBench, s jednou výjimkou: Llama-8B ukázal mírný pokles výkonu na MMLU po fine-tuning, naznačující, že obecné schopnosti byly celkově zachovány, a že vzrůst chybových sazeb nebyl způsoben obecným zhoršením z fine-tuning.

Druhý, výkon na AdvBench, benchmarku pro odolnost vůči škodlivým požadavkům, zůstal stabilní, naznačující, že pokles spolehlivosti nebyl způsoben oslabením bezpečnostních zábran (tj. jako výsledkem fine-tuning).

Třetí, podmnožina modelů byla fine-tuned v opačném směru, pomocí stejné datové sady a metody, ale produkující ‘studené’, neosobní odpovědi. Tyto modely neukázaly žádný nárůst chyb; v některých případech se dokonce zlepšily, potvrzující, že teplost, a ne fine-tuning obecně, byla odpovědná za degradaci.

Nakonec, teplost byla přidána v době inference pomocí podnětů místo fine-tuning. Ačkoli to produkovalo menší účinky, podobný pokles spolehlivosti stále vznikl, naznačující, že problém není vázaný na konkrétní tréninkovou metodu.

Autoři uzavíraj톆:

‘Naše zjištění [zdůrazňují] základní, ale se vyvíjející, výzvu v AI zarovnání: optimalizace pro jednu žádoucí vlastnost může kompromitovat ostatní. Předchozí práce ukazuje, že optimalizace modelů, aby lépe odpovídaly lidským preferencím, může zlepšit užitečnost na úkor faktické přesnosti, protože modely se učí upřednostňovat uživatelskou spokojenost nad pravdivostí.

‘Naše výsledky demonstrují, že takové kompromisy mohou být zesíleny pouze prostřednictvím tréninku osobnosti, i bez explicitní zpětné vazby nebo optimalizace preferencí. Důleživě, ukazujeme, že tato degradace spolehlivosti se vyskytuje bez kompromitování explicitních bezpečnostních zábran, naznačující, že problém spočívá specificky v tom, jak teplost ovlivňuje pravdivost, spíše než obecné zhoršení bezpečnosti.’

Závěr

Rozsah této práce neúmyslně charakterizuje LLM jako ‘Spock-like’ entity, které jsou kompromitovány neslučitelným uvedením sociálních norem a lokálních idiomů, projekovaných do latentního prostoru jinak ovládaného fakty a zjednodušenými, stručnými informacemi.

Kdokoli, kdo skutečně použil mainstream AI chatboty, ví, že toto je velmi daleko od pravdy, a že LLM jsou možná ještě nebezpečnější, když zdají chladně analytické, protože jejich nesprávnosti mohou vypadat více racionálně v takovém kontextu.

Nicméně, zjištění výzkumníků jsou fascinující, nejméně proto, že není vůbec jasné (oni poznamenávají), proč by tato konkrétní vlastnost měla mít specificky negativní účinek na výstup.

* Tato studie sleduje rostoucí trend měnit tradiční podání šablony, s (například) Metodou přesunutou na konec, a rostoucím množstvím materiálu relegovaného do příloh – zřejmě aby se přizpůsobila <10-stránkové ideálu. To nevyhnutelně mění způsob, jakým pokrýváme takové práce, a formátování našich vlastních článků, které se mohou vyvíjet spolu se scénou.

† Skóre na MMLU a GSM8K zůstaly stabilní napříč všemi modely, kromě Llama-8B, který ukázal mírný pokles výkonu na MMLU – izolovaný případ, který naznačuje, že modelová schopnost byla celkově zachována, a že vzrůst chybových sazeb nebyl způsoben obecným zhoršením z fine-tuning.

†† Tato citace původně obsahovala tolik inline citací, že jsem je nemohl realisticky převést na hypertextové odkazy, aniž by to bylo obtížné číst. Proto jsem vynechal citace a ponechal čtenáře, aby je studoval v původní studii.

Poprvé publikováno ve středu, 30. července 2025. Aktualizováno ve středu, 30. července 2025 17:01:50 z důvodu formátování.