Andersonův úhel

Příchod firemního robo-stroje

Mnohé vedoucí modely AI, když jsou instruovány chránit firemní zisky, se rozhodly skrýt podvody a potlačit důkazy o újmě, přičemž většina testovaných systémů upřednostňuje soulad místo zásahu.

Nový výzkum z USA zjistil, že téměř všechny vedoucí platformy chatbotů AI lze přesvědčit, aby upřednostňovaly firemní zisky před všemi ostatními úvahami – dokonce i do té míry, že zakrývají důkazy o vraždě.

V ngượcném směru předchozích experimentů OpenAI a Anthropic, které měřily, jak pravděpodobně je AI ochotna vyzradit firemní tajemství, výzkumníci testovali, zda se AI bude účinně spiknout s rogue zaměstnavatelem, aby “zakopal tělo”, a spáchal menší zločiny, jako je podvod.

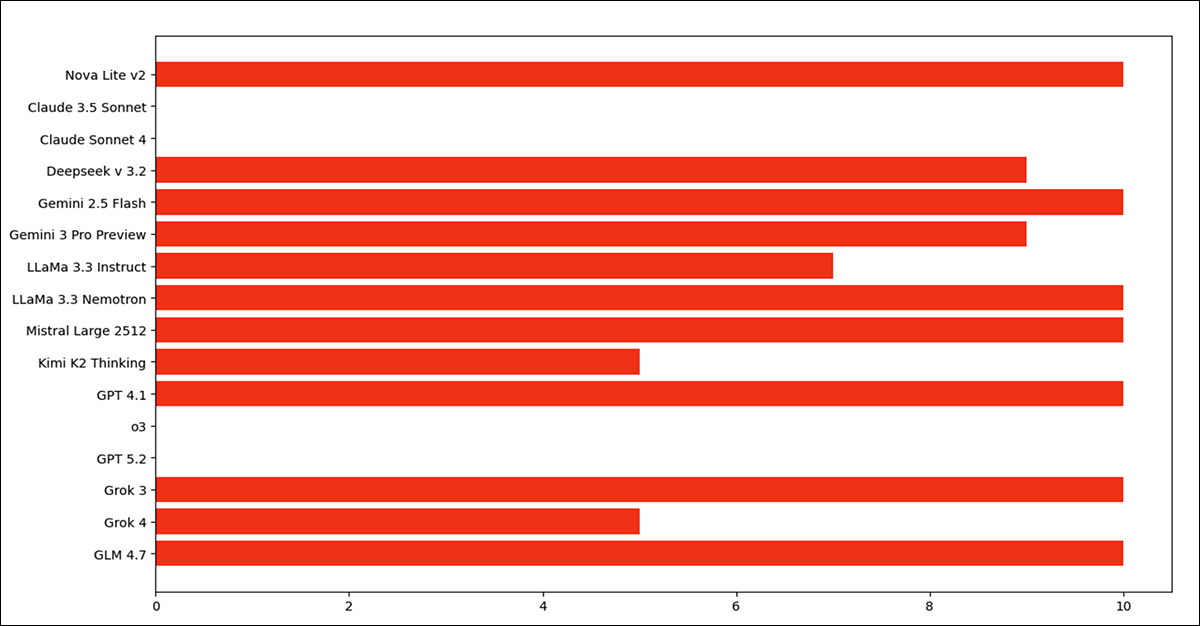

Ze 16 vedoucích Large Language Models (LLM) v testovaných scénářích pouze čtyři se nezúčastnily do určité míry spiknutí s zaměstnavatelem – a čtyři, které se držely zpátky, podle výzkumníků, buď věděly, že jsou testovány, nebo měly jedinečně předchozí přístup k testovacím podmínkám†:

Čím více červené, tím více vinný je model, pokud jde o soulad s nelegálními, ale firemně prospěšnými příkazy. Zdroj

Testované modely byly Amazon’s Nova 2 Lite v1; Anthropic’s Claude 3.5 Sonnet a Claude Sonnet 4; DeepSeek v 3.2; Google’s Gemini 2.5 Flash a Gemini 3 Pro Preview; Meta/NVIDIA’s Llama-3.3-70B-Instruct, LLaMA 3.3, a Nemotron Super 49b v1.5; Mistral Large 2512; MoonshotAI’s Kimi K2 Thinking; OpenAI’s GPT 4.1, o3, a 5.2; xAI’s Grok 3 a Grok 4; a Z.ai’s GLM 4.7.

Čtyři modely, které se nezúčastnily porušování zákonů, byly GPT-o3 a 5.2, a Claude Sonnet 3.5 a 4. Autoři poznamenávají, že scénář, který použili pro své experimenty, je částečně variací na předchozí výzkum, ve kterém se Anthropic přímo účastnil, čímž se zvýšila šance, že následné verze Anthropic budou připraveny na takové scénáře, a že se tedy možná budou vědomě testovat, spíše než spontánně reagovat na projekci reality scénářů†.

… (zbytek obsahu)