人工智能

ST-NeRF:用于视频合成的合成和编辑

一家中国研究机构已经开发了将编辑和合成功能带到过去一年中最热门的图像合成研究领域之一——神经辐射场(NeRF)的技术。该系统被称为ST-NeRF(时空一致神经辐射场)。

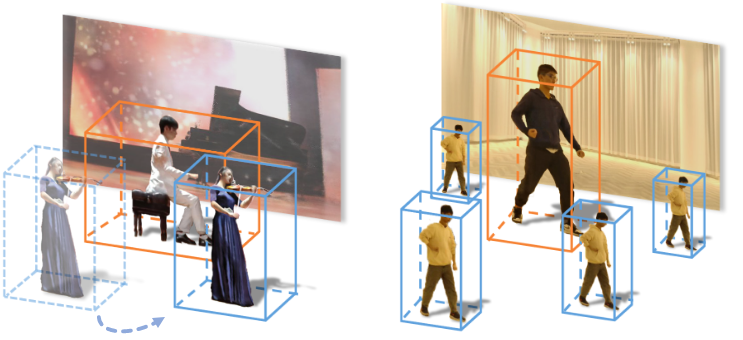

在下面的图像中,似乎是物理相机的平移,实际上只是用户在4D空间中存在的视频内容中“滚动”查看视点。视点并不固定在视频中人物的表现上,人物的动作可以从180度半径的任何位置查看。

视频中的每个方面都是一个离散捕获的元素,合成到一个连贯的场景中,可以动态地探索。

这些方面可以在场景中自由复制或调整大小:

此外,每个方面的时间行为可以轻松改变,减慢,倒放或以任何方式操作,这为滤波器架构和非常高的可解释性开辟了道路。

两个单独的NeRF方面以不同的速度在同一个场景中运行。 来源:https://www.youtube.com/watch?v=Wp4HfOwFGP4

不需要对演员或环境进行rotoscope处理,也不需要演员盲目执行动作,而是通过16个覆盖180度的视频相机自然捕获画面:

上面显示的三个元素,两个人的环境,都是不同的,并且仅为说明目的而突出显示。每个元素都可以被替换,并且可以在其个体捕获时间线的早期或晚期插入到场景中。

ST-NeRF是对神经辐射场(NeRF)研究的创新,一种机器学习框架,通过大量训练,将多个视点捕获合成到一个可导航的虚拟空间中(尽管单视点捕获也是NeRF研究的一个子领域)。

神经辐射场通过收集多个捕获视点到一个单一的连贯和可导航的3D空间中,估计和渲染覆盖之间的间隙由神经网络完成。当使用视频(而不是静态图像)时,所需的渲染资源通常很大。 来源:https://www.matthewtancik.com/nerf

过去九个月中,人们对NeRF的兴趣变得非常强烈,Reddit维护的列表中列出了六十个NeRF的衍生或探索性论文。

原NeRF论文的几个分支。来源:https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

经济的训练

该论文是上海科技大学和DGene数字技术的研究人员之间的合作,并已被Open Review热情接受。

ST-NeRF在ML派生的可导航视频空间的前期工作中提供了多项创新。最重要的是,它仅使用16个相机就能实现高水平的真实性。虽然Facebook的DyNeRF使用的相机比这多两个,但它提供的可导航弧度却更为有限。

Facebook的DyNeRF环境示例,具有更有限的运动范围,需要更多的相机来重建场景。 来源:https://neural-3d-video.github.io

除了缺乏编辑和合成个别方面的能力,DyNeRF在计算资源方面也非常昂贵。相比之下,中国研究人员表示,他们的数据训练成本约为900美元至3000美元,而最先进的视频生成模型DVDGAN的训练成本为30,000美元,像DyNeRF这样的强大系统也需要大量的计算资源。

审稿人还指出,ST-NeRF在解耦学习运动和图像合成的过程方面取得了重大创新。这一分离使得编辑和合成成为可能,而以前的方法相比之下则受到限制且线性。

尽管16个相机对于半圆视图来说是一个非常有限的阵列,但研究人员希望通过使用预先扫描的静态背景和更数据驱动的场景建模方法来进一步减少相机数量。他们还希望加入重新照明的功能,这是NeRF研究中的一个最近的创新。

解决ST-NeRF的局限性

在学术CS论文中,即使在最后一段中丢弃新系统的实际可用性,ST-NeRF的局限性也是不寻常的。

他们观察到,系统目前无法个别渲染场景中的特定对象,因为人体在视频中是通过一个设计用于识别人类而不是对象的系统分割成个体的——这个问题似乎可以通过YOLO和类似的框架轻松解决,而提取人类视频的更艰难工作已经完成。

虽然研究人员指出,目前无法生成慢动作,但似乎没有什么可以阻止使用现有的创新,如DAIN和RIFE,来实现这一功能。

与NeRF的所有实现一样,以及计算机视觉研究的许多其他领域一样,ST-NeRF可能会在严重遮挡的情况下失败,即对象被其他人或物体暂时遮挡,并且可能难以连续跟踪或准确重新获取。与其他情况一样,这个困难可能需要上游解决方案。在此期间,研究人员承认,在这些遮挡帧中需要手动干预。

最后,研究人员观察到,目前的人体分割程序依赖于颜色差异,这可能会导致两个人的意外合并到一个分割块中——这不仅是ST-NeRF的问题,也是所使用的库的固有问题,可能可以通过光流分析和其他新兴技术来解决。

最初发布于2021年5月7日。