人工智能

Mistral AI:在开源领域超越Llama2设立新基准

大型语言模型(LLMs)最近占据了中心舞台,多亏了像ChatGPT这样的杰出表现者。当Meta推出他们的Llama模型时,它重新激发了人们对开源LLMs的兴趣。目标是什么?创建价格合理、开源的LLMs,其质量与顶级模型如GPT-4相当,但没有高昂的价格标签或复杂性。这种可负担性和效率的结合不仅为研究人员和开发人员开辟了新的途径,也为自然语言处理领域的技术进步奠定了新的时代。最近,生成式AI初创公司一直在获得资金。Together一起筹集了2000万美元,旨在建立开源生成式AI模型。Anthropic也筹集了令人印象深刻的4.5亿美元,Cohere与Google Cloud合作,今年六月份筹集了2.7亿美元。

介绍Mistral 7B:大小和可用性

性能基准测试

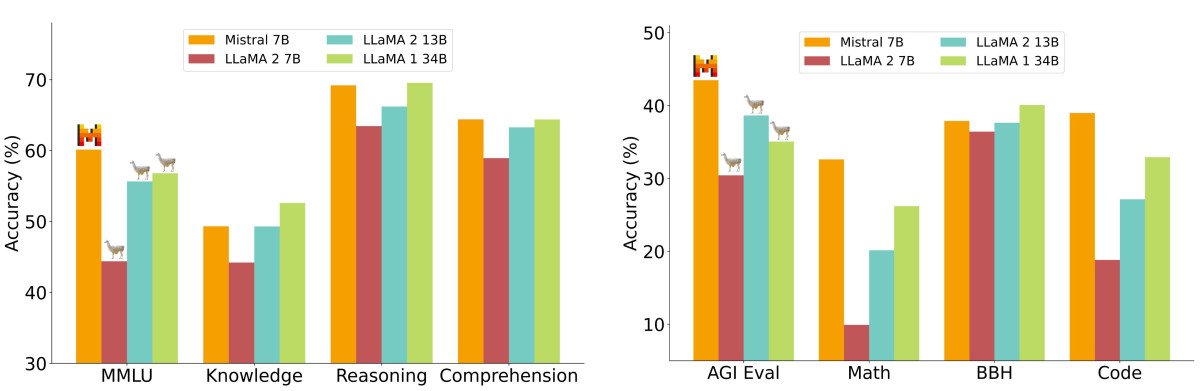

在详细的性能分析中,Mistral 7B与Llama 2家族模型进行了比较。结果很明确:Mistral 7B在所有基准测试中都明显超过了Llama 2 13B。事实上,它与Llama 34B的性能相匹配,尤其是在代码和推理基准测试中表现出色。

什么使Mistral 7B模型比其他语言模型更好?

简化注意力机制虽然注意力机制的细微差别是技术性的,但其基本思想相对简单。想象一下读一本书并突出重要的句子;这类似于注意力机制如何“突出”或给序列中的特定数据点赋予重要性。在语言模型的背景下,这些机制使模型能够专注于输入数据中最相关的部分,确保输出是连贯和上下文准确的。标准变换器中,注意力评分是使用以下公式计算的:

评分公式涉及一个关键步骤,即Q和K的矩阵乘法。挑战在于,当序列长度增加时,两个矩阵都会相应地扩大,导致计算过程非常耗时。这是一个可扩展性问题,是标准变换器较慢的主要原因,尤其是在处理长序列时。

分组查询注意力(GQA)

GQA是一种中间解决方案。它不是使用一个或多个“键值”头,而是将它们分组。这样,GQA实现了接近详细多头注意力的性能,但具有MQA的速度。对于像Mistral这样的模型,这意味着在不牺牲太多质量的情况下实现高效的性能。

滑动窗口注意力(SWA)

Mistral AI的透明度与去中心化的安全问题

在他们的公告中,Mistral AI还强调了透明度,声明:“没有技巧,没有专有数据。”但是,他们目前唯一可用的模型‘Mistral-7B-v0.1’是一个预训练的基础模型,因此它可以对任何查询做出响应,而无需审查,这引发了潜在的安全问题。虽然像GPT和Llama这样的模型具有区分何时响应的机制,但Mistral的完全去中心化性质可能会被恶意行为者利用。然而,大型语言模型的去中心化具有其优点。虽然有些人可能会滥用它,但人们可以利用其力量为社会做好事并使智能技术惠及所有人。

部署灵活性

一个亮点是Mistral 7B在Apache 2.0许可下提供。这意味着没有真正的障碍来使用它——无论您是个人使用、巨型企业还是政府实体,您只需要合适的系统来运行它,或者您可能需要投资云资源。虽然还有其他许可证,如更简单的MIT许可证和合作性的CC BY-SA-4.0,它要求对派生作品进行相同的许可,但Apache 2.0为大规模项目提供了坚实的基础。

最后的想法

开源大型语言模型的崛起,如Mistral 7B,标志着人工智能行业的重大转变,使高质量的语言模型更容易被更广泛的受众所接受。Mistral AI的创新方法,如分组查询注意力和滑动窗口注意力,承诺在不牺牲质量的情况下实现高效的性能。虽然Mistral的去中心化性质带来了一些挑战,但其灵活性和开源许可证凸显了民主化人工智能的潜力。随着这个领域的不断发展,人们将不可避免地关注平衡这些模型的力量与道德考虑和安全机制。对于Mistral来说,下一步是什么?7B模型只是开始。该团队计划推出更大的模型。如果这些新模型的性能与7B模型相当,Mistral可能会迅速崛起为行业中的顶级玩家,所有这一切都发生在他们的第一年。