人工智能

Vertex AI 简介

鉴于人工智能的快速演变,技术领导者经常面临的一个重大障碍是从“实验性”转变为“企业就绪”。虽然消费者聊天机器人和交互式平台有助于公众想象,但仅凭聊天界面,企业无法成功。在竞争比以往任何时候都更加激烈的时代,企业需要一个强大、可扩展和安全的生态系统,这就是 Google 通过 Vertex AI 尝试提供的,Google Cloud 的统一人工智能和机器学习平台。

Vertex AI 尝试将自己确立为现代云基础设施中生成式 AI 集成的骨干,提供了一套全面的功能,弥合了原始基础模型和生产级应用程序之间的差距。Vertex AI 不仅仅是一个大型语言模型(LLM)的包装,而是一个统一的机器学习和人工智能(ML/AI)生态系统,它将生成式 AI 视为现代云基础设施的第一类公民。

在 Vertex AI 的核心是 Model Garden,一个提供访问超过 200 个精选基础模型的中央市场,包括多模式强大模型 Gemini 2.5 Pro,它具有惊人的 2 百万令牌上下文窗口。在本文中,我们将剖析 Vertex AI 的架构,探索 Model Garden 如何作为行业的“应用商店”提供智能,并研究使该平台成为下一代企业软件骨干的技术支柱。

核心架构:统一平台

Vertex AI 不是一个松散耦合的工具集合,而是一个统一的数据和 AI 生态系统,旨在弥合数据、工具和团队的碎片化,这一直是机器学习的困扰。传统上,AI 开发发生在孤立的环境中,有时数据会分散和困在多个存储库中。例如,组织可能将客户数据存储在 SQL 仓库中,同时将非结构化文档转储到数据湖中。当数据被隔离时,AI 只能看到“部分真相”,导致结果有偏差或产生高幻觉率,因为它缺乏对企业的完整上下文。

Vertex AI 尝试将整个生命周期集成在一起,从 BigQuery 和 Cloud Storage 中的原始数据摄取到生产监控,基本上充当这些数据孤岛之间的“连接组织”。Vertex AI 本地集成 Cloud Storage 和 BigQuery,允许 AI 模型在不需要复杂的提取、转换和加载(ETL)管道的情况下检索数据。

基础:Google 的 AI 超级计算机

Vertex AI 的 GenAI 层位于 Vertex AI 之上,位于 Google 的 AI 超级计算机架构之上,该架构由以下组成:

TPU v5p 和 v5e(张量处理单元)

Google 的张量处理单元 是专门为定义深度学习的矩阵乘法而设计的定制 ASIC(应用特定集成电路)。

- TPU v5p(性能):这是大规模训练的旗舰加速器。每个 TPU v5p 集群可以扩展到 8,960 个芯片,通过 Google 的最高带宽的芯片间互连(ICI)以 4,800 Gbps 相互连接。对于技术负责人来说,这意味着对于一个 GPT-3 大小的模型(175B 参数)来说,训练速度比前一代快 2.8 倍,大大减少了上市时间。

- TPU v5e(效率):为“成本优化”性能而设计,v5e 是中规模训练和高吞吐量推理的工作马。它提供了最高 2.5 倍的价格性能,使其成为需要 24/7 推理但没有大量预算的企业的理想选择。

NVIDIA H100/A100 GPU 用于灵活性

虽然 TPU 是专用的,但许多开发团队依赖于 NVIDIA CUDA 生态系统。Vertex AI 为 NVIDIA 的最新硬件提供了一流的支持:

- NVIDIA H100(Hopper):适合微调最大的开源模型(如 Llama 3.1 405B),这些模型需要大量内存带宽。

- Jupiter 网络:为了防止“网络瓶颈”,Google 使用其 Jupiter 数据中心网络结构。这确保数据在 GPU 之间以闪电般的速度移动,支持 RDMA(远程直接内存访问),绕过 CPU 开销,并在分布式节点上提供近本地性能。

动态编排

Vertex AI 中最关键的技术转变是 动态编排。在传统环境中,如果在 3 周的训练运行期间 GPU 节点发生故障,整个作业可能会崩溃。

- 自动恢复性:Vertex AI,通常由 Google Kubernetes Engine(GKE) 提供支持,具有“自愈”节点。如果检测到硬件故障,平台会自动将工作负载迁移到健康节点。

- 动态工作负载调度器:该工具允许团队根据紧急程度请求容量。您可以选择灵活启动(更便宜,当容量可用时启动)或保证容量用于关键任务发布。

- 无服务器训练:对于希望零基础设施管理的团队,Vertex AI 无服务器训练允许您提交代码和数据;平台提供集群,运行作业,并在使用后拆除集群——只为使用的计算秒收费。

三个入口点:发现、实验和自动化

为了适应不同技术人员,从数据科学家到应用开发人员,Vertex AI 提供三个主要入口点:

- Model Garden:发现的市场。

- Vertex AI Studio:实验的游乐场。

- Vertex AI Agent Builder:自动化的工厂。

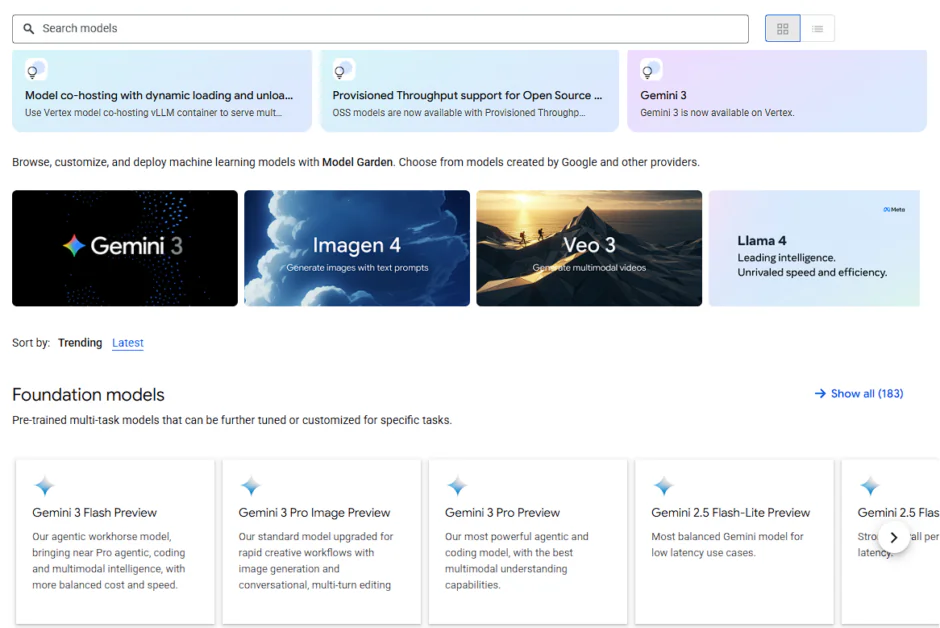

Model Garden:发现的市场

Google Cloud 的 Vertex AI Model Garden 是 Google Cloud 中的一个集中平台,用于发现、测试、自定义和部署广泛的第一方、开源和第三方 AI 模型,包括多模态模型(视觉、文本、代码)用于各种业务需求,提供与 Vertex AI 工具的无缝集成,用于简化 MLOps。它充当一个综合库,帮助开发人员和企业为其任务选择合适的模型,无论是文本生成、图像分析还是代码完成,并在其 Google Cloud 环境中高效部署它们。

Model Garden 将其 200 多个模型分为三个不同的层次,允许架构师在性能、成本和控制之间取得平衡:

- 第一方(Google)模型:这些是 Vertex AI 内的旗舰多模态模型,Google 以各种大小提供它们,范围从具有复杂推理的 Pro 到具有低延迟和高容量的 Flash,因此允许开发人员根据其使用案例优化其模型。

- 第三方(专有)模型:通过战略合作,Vertex AI 提供“模型即服务”(MaaS)访问巨头,如 Anthropic(Claude 3.5)和 Mistral AI。与其为五个不同的 AI 提供商管理单独的计费和安全凭证,技术团队可以通过其现有的 Google Cloud 项目访问所有这些,使用统一的 API 格式。

- 开源和开源模型:此层包括 Meta 的 Llama 3.2、Mistral 和 Google 自有的 Gemma。这些对于希望在其自己的 VPC(虚拟私有云)中自行部署模型以确保最大数据隔离的组织来说是理想的选择。

在非统一环境中,部署开源模型(如 Llama)需要设置 PyTorch 环境,配置 CUDA 驱动程序,并管理 Flask 或 FastAPI 包装器。

Model Garden 通过 统一托管端点 消除了这种“Munging”阶段:

- 一键部署:对于许多模型,单击“部署”会自动预配必要的 TPU/GPU 资源,将模型包装在生产就绪的容器中,并提供 REST API 端点。

- Hugging Face 集成:Vertex AI 现在允许开发人员直接从 Hugging Face Hub 将模型部署到 Vertex 端点,提供几乎无限的智能扩展。

- 私有服务连接(PSC):对于高度监管的行业,模型可以使用 私有服务连接 进行部署,确保模型端点永远不会暴露在公共互联网上——将数据流量严格保持在企业网络内。

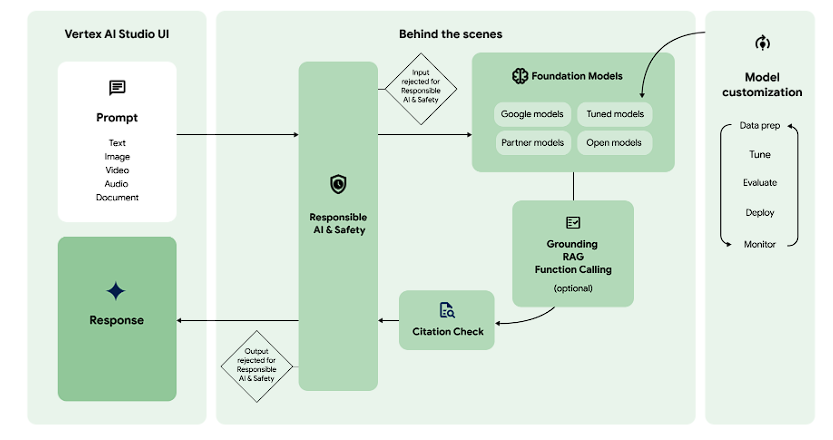

Vertex AI Studio:实验的游乐场

虽然 Model Garden 是关于选择,Vertex AI Studio 是关于 精度。Vertex AI Studio 可以与传统软件世界中的编译器和调试器相比。Vertex AI Studio 是原始模型通过提示工程、多模态测试和高级超参数调整雕刻成特定业务工具的工作空间。

多模态原型:超越文本

Studio 的一个突出功能是其对 多模态 的本机支持。虽然其他平台需要复杂的编码来处理非文本数据,但 Vertex AI Studio 允许您直接将文件拖放到界面中以测试 Gemini 2.5 的推理功能。

- 视频智能:您可以上传一段 45 分钟的技术演讲,并要求模型“识别每次提到特定 API 的时间并提供时间戳摘要”。

- 文档分析:模型不仅可以阅读文本,还可以分析 1,000 页 PDF 的 视觉布局,理解图表、表格和周围散文之间的关系。

- 代码执行:Studio 现在支持 游乐场中的代码执行。如果您要求模型解决一个复杂的数学问题或分析一个 CSV,模型可以在安全的沙盒环境中编写和执行 Python 代码以提供经过验证的答案。

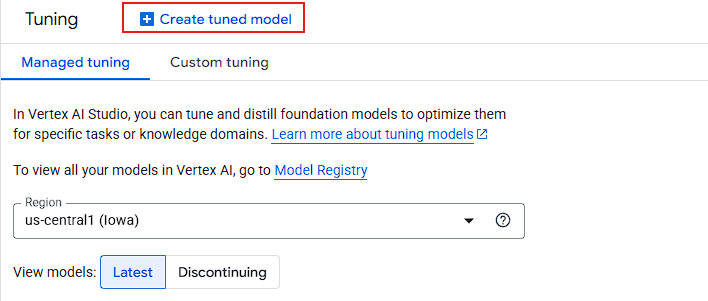

高级自定义:调优路径

当提示工程(零次或少次)达到极限时,Vertex AI Studio 提供了重型机械:模型调优。

- 监督微调(SFT):开发人员提供一组“提示/响应”对(理想情况下为 100+ 示例)。这教会模型采用特定的品牌声音、输出格式(如专用 JSON)或领域特定术语。

- 上下文缓存:对于处理大量静态数据集(如法律图书馆或代码库)的企业,Studio 允许 上下文缓存。这允许您将 100 万个令牌的数据“预加载”到模型的内存中,大大减少后续查询的延迟和成本。

- 蒸馏(教师-学生):这是一个高层次的架构举动。您可以使用一个大型模型(Gemini 2.5 Pro)“教”一个较小、较快的模型(Gemini 2.0 Flash)。结果是一个轻量级模型,它以“Pro”级别的性能运行,但以“Flash”级别的速度和成本运行。

Vertex AI Agent Builder:自动化的工厂

Vertex AI Agent Builder 是一个高级编排框架,允许开发人员通过将基础模型与企业数据和外部 API 结合来创建这些代理。

“真相”架构:接地和 RAG

企业 AI 的主要技术障碍是 幻觉。Agent Builder 通过一个复杂的 接地 引擎来解决这个问题。

- 使用 Google 搜索进行接地:对于需要实时世界知识的查询(例如“纽约当前的抵押贷款利率是多少?”),代理可以执行 Google 搜索,提取事实,并引用其来源。

- Vertex AI 搜索(RAG 即服务):开发人员可以使用 Vertex AI 搜索 来索引自己的文档(PDF、HTML、BigQuery)。它自动处理“分块”、“嵌入”和“检索”步骤,确保代理仅根据其内部“真相来源”回答。

- Vertex AI RAG 引擎:对于大规模、自定义的实现,这个托管服务允许混合搜索(结合基于向量和基于关键字的结果),通过标准 LLM 输出提高准确率高达 30%。

多代理编排(A2A 协议)

高级企业工作流通常需要多个专用代理共同工作。Vertex AI 引入了 代理到代理(A2A)协议,一个开放标准,允许:

- 旅行代理与财务代理交谈,以确保航班预订在企业预算之内。

- 互操作性:由于它使用开放协议,Vertex 上构建的代理可以与其他框架(如 LangChain 或 CrewAI)上构建的代理进行通信。

开发者堆栈:ADK 和代理引擎

对于“技术平台”受众,Agent Builder 提供两条不同的路径:

- 无代码控制台:用于快速原型设计和业务用户配置的视觉拖放界面。

- 代理开发工具包(ADK):用于工程师的代码优先 Python 工具包。它允许“提示即代码”,集成版本控制,能够部署到 Vertex AI 代理引擎,这是一个托管的运行时环境,自动处理会话持久性、缩放和状态管理。

结论:从“如果”到“接下来是什么”

从令人惊艳的 AI 演示到生产级企业应用的转变长期以来一直是数字化转型项目的“死亡谷”。正如我们所探讨的,Vertex AI 专门设计用于弥合这一差距。通过统一数据、基础设施和模型编排的碎片化孤岛,Google Cloud 将对话从大型语言模型的原始力量转移到了 AI 生命周期的 运营成熟度 上。