思想领袖

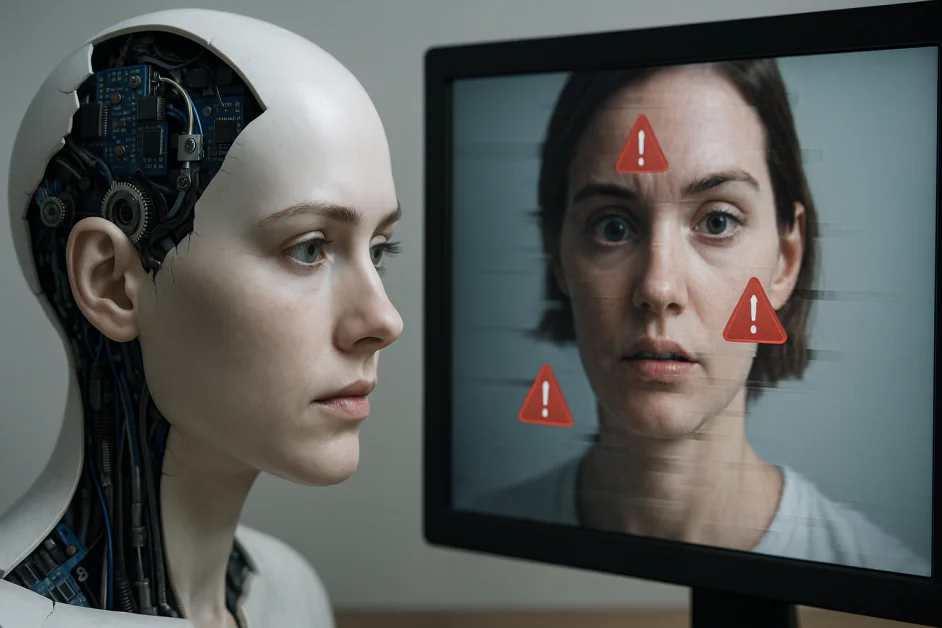

您的 AI 图像为什么会带有错误——以及如何改进它们

基于 AI 的文本到图像生成模型已经改变了数字艺术和内容创作,使得任何用户无论其背景如何,都可以仅凭几句话就能在很短的时间内生产出高质量、可定制的视觉效果,这比使用传统的设计或照片工具要快得多。

随着强大的技术进步,AI 辅助创造力正变得越来越重要地融入各个行业的工作流程中。然而,使用 AI 创建一个商业级别的作品并不是简单地按下一个按钮,因为其“瞬间”效果并不总是能带来可用的结果,特别是对于那些依赖它来满足专业艺术和设计标准的人来说。

实际上,虽然掌握提示写作——AI 所理解的语言——是实现输出与创意愿景一致的主要条件,但 AI 生成的图像仍可能存在一些常见的令人沮丧的缺陷,这不仅影响初学者,也影响经验丰富的创作者。克服这些问题通常需要用户和开发人员具备额外的知识和技能。

以下,我将概述 AI 图像生成中最常见的挑战,并分享实际解决方案来解决这些问题。

提示工程复杂性

AI 图像生成的核心吸引力在于使用仅仅几句话就能将想法转化为视觉效果。然而,提示工程的复杂性仍然是生成有意义图像的最重大障碍之一。即使是提示词语的微小变化也可能导致输出结果有很大差异。提示结构也可能在不同模型之间有所不同,因此在一个模型中有效的方法可能在另一个模型中产生糟糕的结果。提示语言缺乏标准化通常迫使用户进行试验和错误的过程。

提示库和数据库通过提供预测试的提示帮助减少猜测,用户可以参考或根据需要修改这些提示。视觉提示构建器允许用户以结构化的方式输入关键词,选择属性,调整滑块等,使得创建有效提示的过程更加直观。从社区分享的成功提示中学习也很有价值,因为这些现实世界的例子展示了什么是有效的。

为了提高一致性,标准化提示语法指南建议在不同模型中结构关键词输入的最佳实践。使用提示模板可以促进更可预测的结果,帮助用户生成具有一致风格的多个图像。像 FLUX 这样的新兴模型在整体上更用户友好,因为它们的设计使得对提示复杂性不太敏感,允许用户从更直接的指令中创建连贯、复杂的场景。

解剖学不准确性

由于神经网络从数据集中学习,扩散模型实际上并不理解解剖学——它们根据模式识别而不是结构化生物框架生成图像。例如,AI 不将手视为由五个不同的指头组成,可以以不同的方式发音。相反,它混合了在训练图像中看到的统计平均值。因此,偏离预期的姿势或角度会导致失真。虽然现代模型已经有了显著的改进,但仍然存在一些常见的问题,如额外的手指、不自然的面部和身体比例、不切实际的肢体连接和关节放置,或者不对称和错位的眼睛。

使用专门针对解剖学数据集的 LoRas (低秩适应技术)可以帮助模型更全面地理解人体结构。ControlNets,特别是那些使用姿势估计或边缘检测(如 Canny 滤波器)的模型,能够使 AI 遵循解剖学指南。

提示中具体引用现实身体细节的提示也可以提高生成人物的解剖学准确性。使用了解剖学的纠正工具进行后处理允许用户在不重新生成整个图像的情况下修复有缺陷的区域。

多次生成中的身份不一致性

由于 AI 将每次生成视为一个独立的过程,因此在多个图像中保持角色外观的一致性仍然是一个挑战,特别是在讲故事或系列艺术作品中,角色连续性至关重要。即使使用相同的提示,面部特征、服装或风格也可能在渲染之间出现微妙的变化。这个问题在批量生成中可能变得更加明显,在那里,质量和视觉特征会不可预测地波动。

在一组特定人物或物体的图像上训练 LoRA,并使用参考图像作为输入,可以提高身份条件、一致性和统一性。嵌入技术和适配器(如 PuLID、IPAdapter、InstantID 和 EcomID)有助于在生成之间保留角色特征。当面部准确性至关重要时,面部交换模型或后处理提供了更定制的细化,确保关键特征在每次生成之间保持相同。

背景不协调性

AI 生成的背景容易出现不切实际、结构和上下文不协调的设计,使图像看起来不那么可信。例如,视角可能感觉不对,或者光线和阴影可能不匹配主题。这是因为扩散模型将背景视为次要元素,而不是场景的整体部分,导致深度感知、物体关联和环境上下文的问题。

深度映射帮助模型更准确地解释空间关系,促进前景和背景之间的更真实集成。视角指南强制执行几何对齐,帮助保持建筑结构和消失点的一致性。专注的重新照明 LoRas 可以学习生成光线和阴影以及背景,确保整个场景中的反射表现自然。

在特定环境(如城市景观、自然场景或室内空间)的数据集上微调模型可以提高背景的整体真实性。参考背景图像也将帮助将生成锚定到现实世界的构图。

文本渲染问题

主要训练在视觉数据上,而不是结构化语言,AI 在生成图像中的可读单词和短语方面存在困难。文本可能看起来不完整、混乱、杂乱无章或无意义,字体不规则或与背景不协调。即使可读,它仍可能看起来风格不佳或笨拙地融入背景中。

与人类不同,大多数 AI 模型不将文本视为与周围元素不同的实体,因此它们不将其处理为一个单独的实体。相反,它们将字符序列视为另一种视觉模式,具有抽象形状,而不是有意义的语义符号。

为了提高文本渲染质量,研究人员在专门的文本数据集上训练模型,这些数据集包含正确标记的字体示例,帮助 AI 更好地理解字母形成、对齐和间距。文本感知掩码也是一个有效的技术,当图像生成时保留空白区域用于文本,这允许在后处理期间进行更干净的集成。

缺乏对输出的控制

虽然结果可能在视觉上令人印象深刻,但 AI 图像生成的一个重大限制是缺乏对最终输出的精确控制。用户可能难以将模型引导到特定的风格、确保现实性或调整细节。其他常见错误包括场景中意外的元素、破坏氛围的颜色和布局不一致。与人类艺术家不同,人类艺术家会有意地进行调整,AI 操作是概率性的,可能会产生令人惊讶或不想要的结果。

控制机制,如 ControlNets 和 LoRas,允许用户通过姿势、深度或边缘指导来条件化结构。对于更精确的美学指导,专门针对特定风格的自定义模型可以显著提高艺术方向的一致性。另外,通过图像到图像生成来引用特定图像有助于保持输出的相关性。

掩码和修复工具允许编辑图像的特定部分,而不会影响其余部分。后处理工具,如上采样器和增强器,可以通过提高分辨率和清晰度来为 AI 输出添加最后的润色。

总体而言,AI 尚未发展出更复杂、更细致的提示解释——这是保持控制的一个中心挑战。许多模型倾向于过度解释指令,试图提取深层或分层的含义,而这些含义并非预期的。虽然这听起来很聪明,但即使是详细的提示也可能产生不可预测的结果。例如,AI 可能会强调或发明意外的元素,基于它所学到的关联。这增加了提示编写的复杂性,需要用户适应模型的“思考”方式(这并不总是直观的),并花费更多时间尝试不同的措辞来实现所需的结果。

最后的想法

了解 AI 如何解释视觉数据——并认识到它容易出错的地方——可以让用户在提示编写、有效问题解决策略和选择合适的工具方面做出更明智的选择,以解决生成错误。最终,这赋予了用户与 AI 合作的能力,而不是依赖于运气或将其技术限制视为创建反映创作者视野的可用内容的障碍。