Anderson 视角

‘流氓’ 数据污染生成式 AI 性能

一项新研究发现,许多用于训练 AI 模型的流行图像数据集都被测试图像或近似副本污染,允许模型通过记忆答案而不是学习来作弊。这种泄漏是普遍的,但通常未被检测到,悄悄地膨胀分数,并为在网尺度数据上训练的模型提供不公平的优势。

当你参加驾驶考试时,你通常不会提前知道考试将使用哪些路线。如果你知道了(并且你缺乏诚信),你可能会“优化”考试,通过反复练习那条路线,而不是发展更广泛的驾驶技能,以便能够处理 任何 路线。

在机器学习模型的训练中,这是一个合理的类比 – 将训练集数据分割成(通常)70% 的训练数据和 30% 的“野外”数据。

由于野外数据从未被模型看到,如果模型在该数据上表现良好,则可以假定其有效且高效;如果不是,模型可能 过拟合 到一个平衡的数据集 – 或者数据需要额外的策划和定义。

无论如何,不 在训练数据上评估模型是当前 AI 研究和开发方法的基石。

再来一次,请

根据日本的一篇新研究论文,计算机视觉和生成式 AI 研究领域尚未达到 努力 的水平,以确保测试数据不会污染训练数据;在测试中,研究人员发现他们研究的每个超大规模视觉数据集,包括一些当前最大的生成式 AI 系统的数据集,都在某种程度上允许其测试数据泄漏到其训练数据中 – 这意味着训练在这些数据集上的模型的基准和性能报告将不比有人在考试中偷偷使用 crib 的考试成绩更准确,也不会反映真实世界中对新数据的性能。

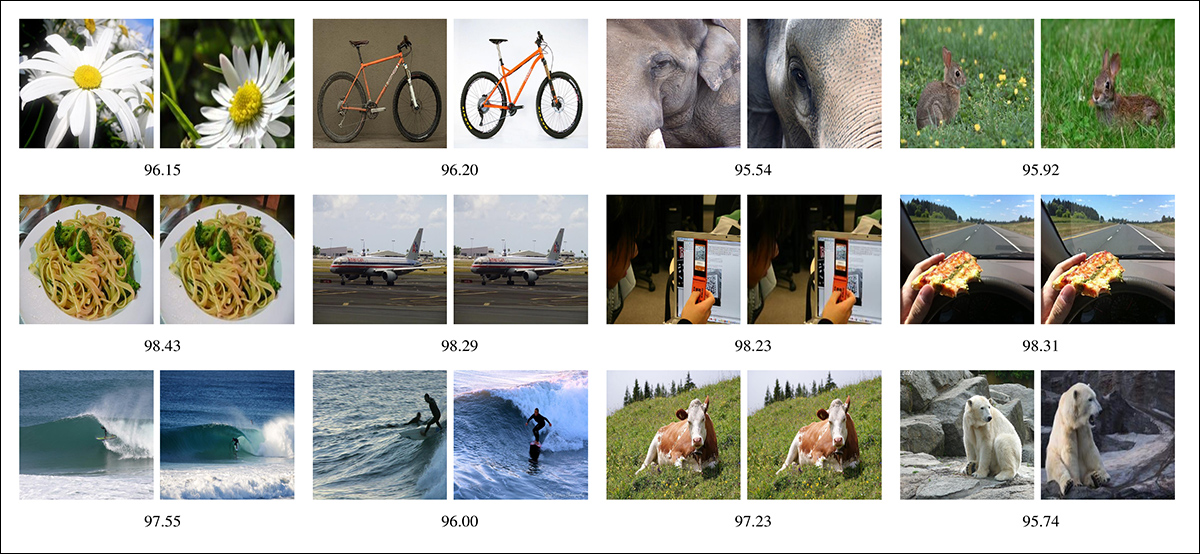

研究人员发现的数据交叉污染示例,其中训练数据和测试数据中都存在重复或近似重复的数据点。 来源:https://arxiv.org/pdf/2508.17416

在上面的图像中,从新论文中,我们看到在各种模型的核心训练数据和测试数据中发现的重复或近似重复数据点的示例 – 足以使模型在该数据上的性能失效,并轻微地膨胀其总体分数,促进模型表现出可能尚未真正实现的 泛化 水平。

为了使事情更加复杂,污染似乎发生在各种可能的场景中,包括 ‘预训练‘,其中 权重 的 旧祖先模型 被用于“启动”一个新模型。如果上游的旧模型具有与新数据集相同的数据,则即使 70/30 或 80/20 分割是干净的,交叉污染也可能发生。

累积效应

这几乎可以肯定,即使在最新的数据集中也会发生这种情况:过去五年中,视觉/语言数据集的范围已经大大增加,不仅包括网络上最新的图像数据,还重新收获了许多旧的、历史数据集中的数据。

此外,旨在过滤数十亿图像以查找重复和近似重复的自动例程现在面临着如此繁重的任务,以至于策划本身 – 在时间和金钱方面的成本 – 现在必须在预算限制的背景下考虑。

同时,图像重复是大规模集合(如 Common Crawl)中网页抓取的必然结果,这是由于图像被重贴和重压缩,以及应用编辑(如裁剪),甚至翻转(为了避免检测,当图像可能未经许可使用时,例如)。

作者观察到*:

‘数据泄漏是一个普遍的问题,存在于大多数视觉数据集中。泄漏会掩盖模型的泛化能力,这在比较在不同数据集上训练的模型时尤其成问题,导致不公平的比较。 ‘

‘我们敦促数据集设计者仔细考虑这些评估的影响。为了进行更公平的模型评估,我们建议使用考虑硬性和软性泄漏的重复检测器。 ‘

‘理想情况下,泄漏的图像应从训练集中删除,如果不可能,至少应从测试集中删除。’

该论文详细介绍了研究人员对大量和流行数据集进行的测试 – 每一个都表现出某种程度的污染。

该论文题为 视觉数据集中的数据泄漏,由大阪大学的三位研究人员撰写。

方法

该论文的作者从三个维度定义泄漏:模态、覆盖 和 程度。

模态 区分了是否仅泄漏图像或图像和标签都暴露;覆盖 确定了重叠是否发生在同一数据集内或跨不同数据集;程度 定义了重复内容是否完全相同或仅仅是邻近的。

关于泄漏,该工作考虑了两个场景:数据集内泄漏(其中评估图像重新出现在同一数据集的训练分割中),和 数据集间泄漏(其中一个数据集的评估图像存在于用于训练的 不同 数据集中)。

关于程度,定义了两个级别:软性泄漏(其中图像不相同但表现出轻微的变化),和 硬性泄漏(其中图像在训练和评估中完全相同)。

研究人员使用 图像检索 来解决泄漏检测问题,使用图像编码器将每个图像表示为一个 特征向量。 查询集 是评估数据,而 集合 是训练集。

对于较小的数据集,使用 余弦相似度 直接比较每个查询向量和所有训练向量。对于较大的数据集,构建了 Faiss 索引 以启用更快的、K-最近邻(KNN) 搜索。

由于编码器需要捕获足够的视觉信息来检测微妙的相似性,但仍然需要在面对大量数据时保持高效,因此作者依赖于数据集创建者提供的预计算 CLIP 特征,特别是在 LAION 集合的情况下,该集合支持稳定扩散和后续项目。

作者注意到,允许 CLIP 使用其对数据集的提炼理解(而不是在大规模上询问实际文件)大大加快了该过程,并在比较中提供了改进的一致性。

数据和测试

用于测试的 CLIP 图像编码器是最初用于筛选 LAION 的默认 CLIP ViT-B/32 。为了确定多样图像是否相关,使用了 AutoFaiss下的 KNN。

数据集被分为三种类型:预训练 数据集 – 大型、网页抓取的集合,用于训练通用模型;训练 数据集 – 较小、经常注释的集合,用于直接模型调优;和 基准 数据集 – 手动注释,并且仅用于评估。

分析涵盖了七个数据集中的二十个分割:Microsoft COCO 被用作训练和评估集,包括训练、验证、测试和未标记的分割;Flickr30k 仅作为基准;而 Google 概念字幕(GCC)集合被用作预训练源,其验证部分也用于评估。

此外,ImageNet 被用于训练和基准,而 LAION-400M 数据集仅用于预训练。

OpenImages v4 贡献了训练和基准数据,而 TextCaps 提供了训练和测试分割用于评估。

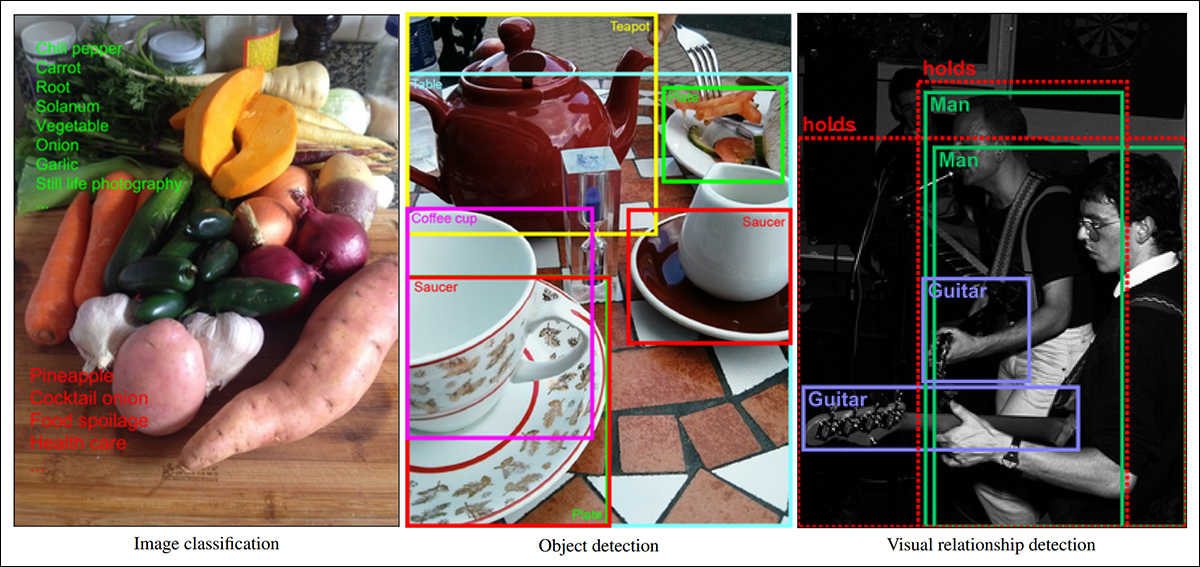

来自新工作的 Google Open Images 数据集的图像注释示例。 来源:https://arxiv.org/pdf/1811.00982

为了评估方法可以检测泄漏的能力,当图像经过微妙改变(例如调整大小、裁剪)时,作者在 Flickr30k 上进行了测试,随机选择 5,000 张图像作为查询,并使用整个数据集作为参考集合。

每个查询图像在编码之前都会进行转换(即进行非语义修改,例如调整大小或裁剪),然后使用余弦相似度与集合中的最相似项进行匹配;仅当原始图像被检索为顶级结果时,才会计算匹配。

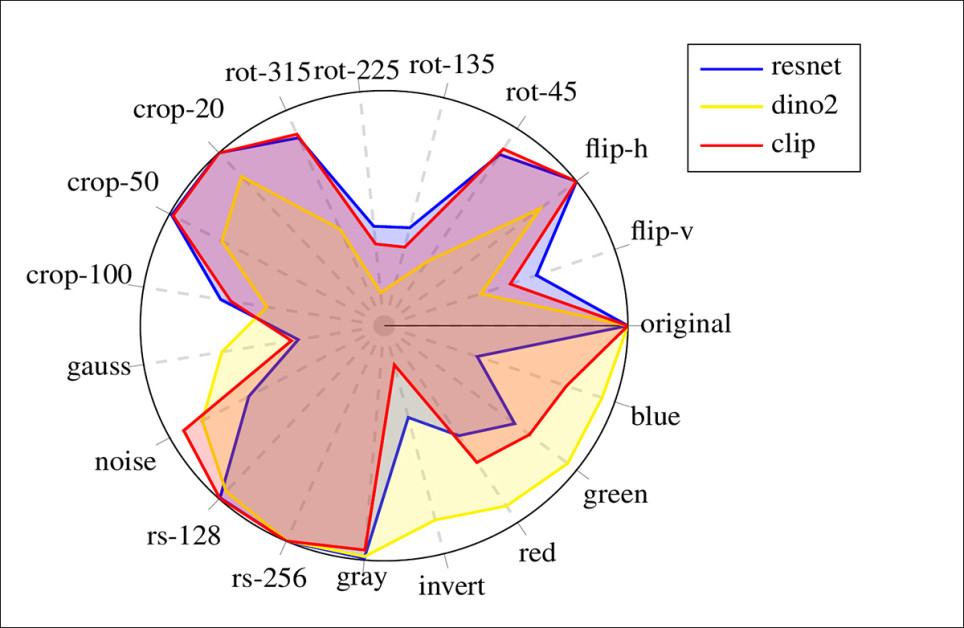

比较了三种编码器:ResNet-152;DINOv2 ViT-B/14;和 CLIP ViT-B/32。

使用四种类型的非语义图像转换:几何(翻转和旋转);裁剪(从每个边缘删除 20、50 或 100 个像素);像素化(高斯模糊、添加噪音或向下采样到 128 或 256 像素);和颜色(灰度、反转或红、绿或蓝叠加)。

来自补充材料的数据转换示例 – 也用于数据增强预处理的常规。

然后,作者测试了图像检索中的泄漏检测:

5,000 个 Flickr30k 查询图像(经过各种非语义转换)上的泄漏检测准确率。

所有三个编码器在未修改的图像上都实现了完美的性能,并且 CLIP 在裁剪、水平翻转、噪音和调整大小方面保持了可靠性,超越了 ResNet 在像素级和颜色变化方面的性能。

DINOv2 对颜色转换表现出强大的抵抗力(可能是由于其自监督设计,作者认为),但在几何编辑和裁剪方面明显较弱 – 这两种情况在重复数据集中都很常见。

由于 LAION 已经包含 CLIP 嵌入,并且考虑到其一致的鲁棒性和速度,CLIP 被选为主要分析的默认编码器。

硬性和软性泄漏

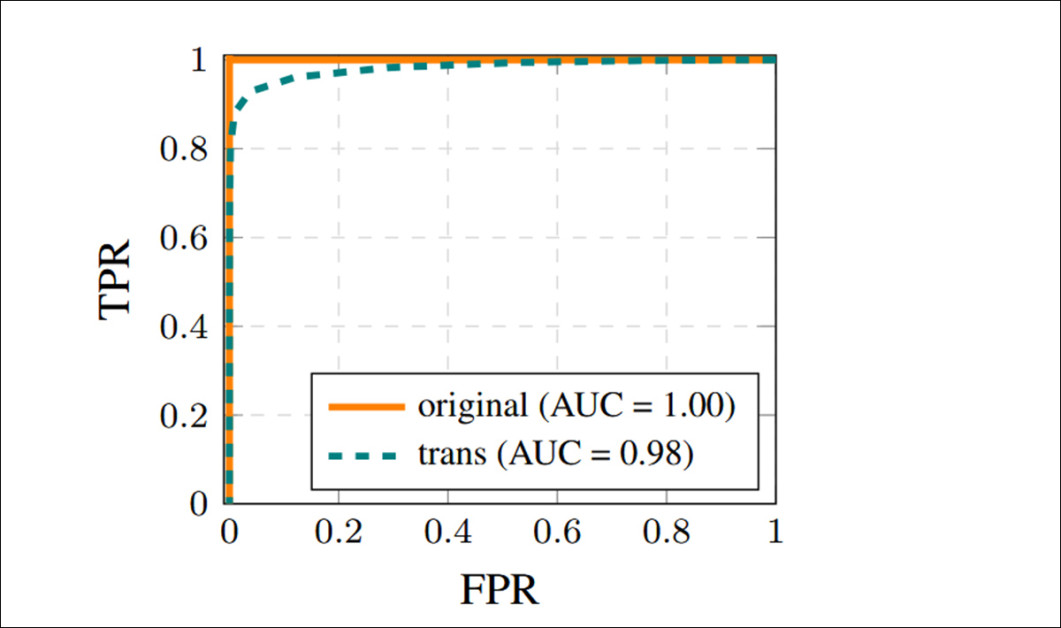

评估了不同余弦相似度阈值下的性能,以区分完全相同和近似重复的图像(硬性和软性泄漏)。

选择 0.98 作为阈值来定义硬性泄漏,结果没有假阳性,并且可以完美地检测到完全相同的图像。

对于软性泄漏,选择 0.95 作为阈值,允许检索更多近似重复的图像,同时保持几乎为零的假阳性率。优先考虑精度而不是召回率,发现结果因此被保守地估计:

用于指导泄漏检测的硬性和软性阈值选择的接收者操作特性曲线。转换和未转换条件下的高 AUC 分数表明,即使在最小的修改下,也可以可靠地将近似重复的图像与无关图像区分开来。

数据集内泄漏

通过识别同一数据集内训练和评估分割之间的图像重叠来计算数据集内泄漏。仅考虑具有基准和训练或预训练分割的数据集,这限制了分析到 COCO、GCC、ImageNet、OpenImages 和 TextCaps。

对于 COCO,测试集与训练集、评估集和未标记的子集进行了比较,而验证集则与训练集和未标记的子集进行了比较。

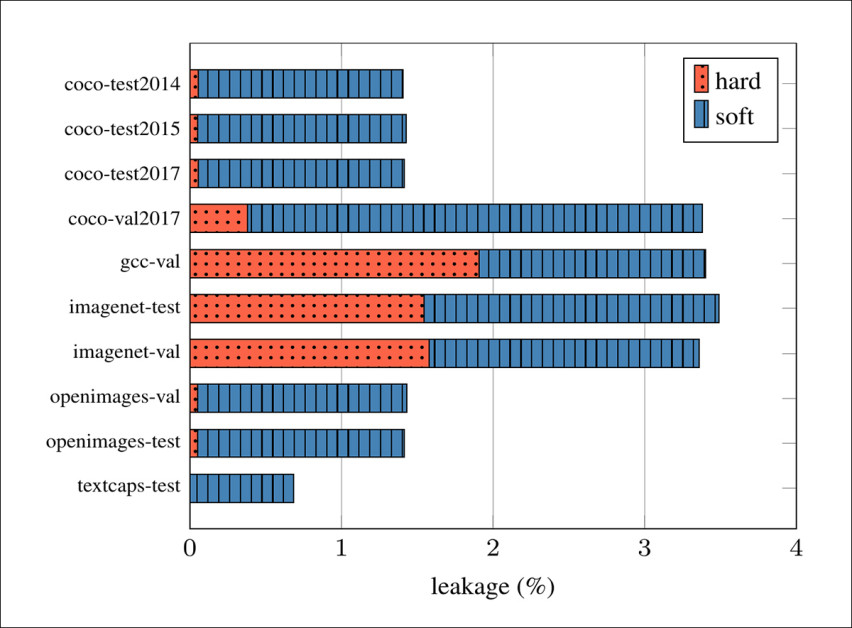

数据集内泄漏的最高比率出现在 ImageNet 的测试和验证分割中,硬性泄漏达到 1.58%,软性泄漏略低于 2%。GCC 和 COCO 排名第二,COCO 的 val2017 显示软性泄漏为 3%,其测试分割范围从 1.35% 到 1.38%。OpenImages 显示出低硬性泄漏,仅为 0.05%,但软性泄漏超过 1.3%,出现在测试和验证分割中。TextCaps 显示出最低的总泄漏,仅为 0.69%,且未检测到硬性泄漏:

数据集内泄漏率,显示每个评估分割与其关联训练数据的重叠比例。

关于这些结果,作者指出*:

‘这些结果表明,数据集内泄漏发生在 所有 分析的数据集中,或者是硬性或软性泄漏。

‘鉴于数据泄漏会损害模型评估,并且数据集专门为此目的而设计,数据集内泄漏是一种 设计上 不应存在的风险。

‘然而,我们已经在所有数据集中找到了多个实例。’

数据集间泄漏

为了衡量数据集间泄漏(其中模型在一个数据集上训练并在另一个数据集上评估),使用了四个数据集作为训练数据源:GCC 训练、ImageNet 训练、OpenImages 训练 和 LAION。

这些数据集与从 COCO 2014 测试和验证分割、Flickr30K、TextCaps 测试、OpenImages 测试和验证分割以及 ImageNet 测试和验证分割中提取的评估数据进行了匹配。

CLIP ViT-B/32 嵌入被提取用于除 LAION 之外的所有数据集,因为 LAION 提供了其自己的预计算嵌入。然而,由于这些嵌入与使用官方 CLIP 实现生成的嵌入略有不同,因此查询图像根据 clip-retrieval 存储库中使用的方法进行了重新缩放,以确保兼容性。

使用 KNN 搜索执行检索,尽管 LAION 的规模需要将其分成百万图像块,每个块单独索引:

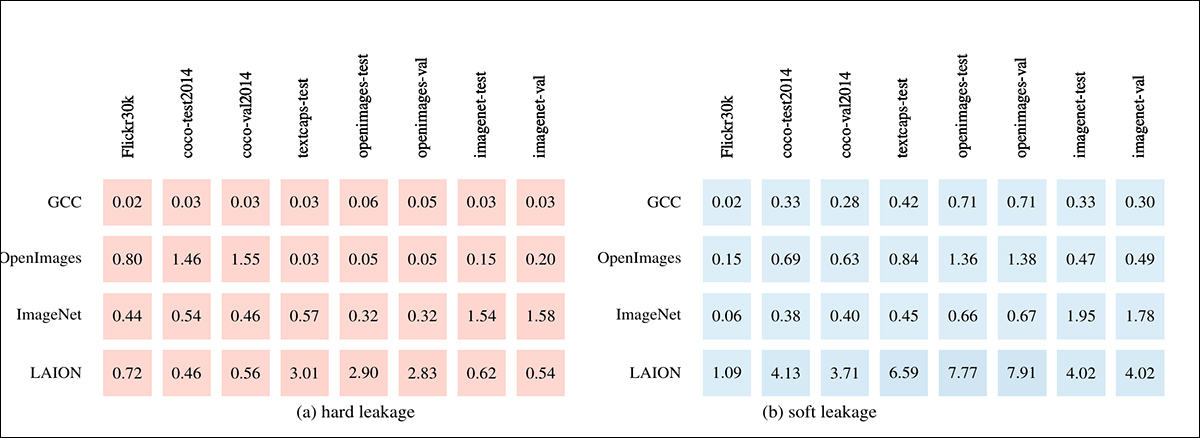

基准数据集(列)和预训练数据集(行)之间的数据集间泄漏。在左侧,我们看到“硬性”泄漏(完全相同的图像),在右侧,我们看到“软性”泄漏(近似重复的图像)。

在所有基准数据集中都观察到了跨数据集泄漏,严重程度各不相同。LAION 对 OpenImages 和 TextCaps 测试数据显示出最高的硬性泄漏率,超过 3%。OpenImages 也对 COCO 贡献了一小部分硬性泄漏。

虽然不太严重,ImageNet 仍然包含来自每个基准的硬性重复;GCC 显示出最低的总硬性泄漏,低于 1%。软性泄漏(近似重复)更为普遍:LAION 再次产生了最高的比率,达到 7.9% 的重叠;OpenImages 和 TextCaps 是最受影响的基准;Flickr30K 显示出最低的泄漏。

虽然这种重叠可能只占评估集的很小一部分,但作者指出,存在这些重叠会允许 记忆 并损害测试的有效性:

泄漏图像的示例。在左侧,我们看到“硬性”泄漏的情况,图像在数据集内(上)或数据集之间(下)是相同的;在右侧,我们看到“软性”泄漏的情况,图像在视觉上几乎相同。

对下游评估的影响

该论文接下来考虑了数据泄漏如何影响下游评估(即,当预训练模型在包含重复训练数据的基准上进行测试时的性能)。

对于每个任务,模型的性能都在基准数据集上进行了评估,该数据集已知包含预训练数据中的泄漏样本。结果在四个子集之间进行了比较:完整的基准;泄漏样本的子集;非泄漏样本的子集;以及一个随机选择的子集,其大小与泄漏组相同(用作控制)。

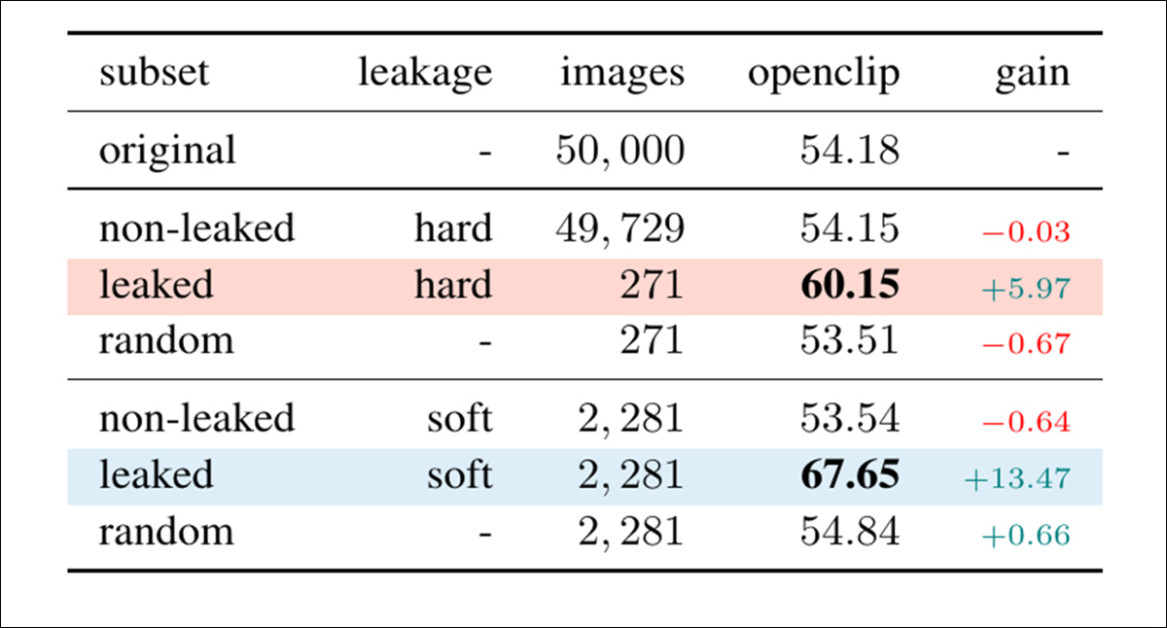

对三个下游任务中数据泄漏的影响进行了测量,使用已知包含泄漏图像的基准子集。在零次分类中,预训练在 LAION 上的模型在 ImageNet 评估集上的泄漏图像上实现了显著更高的准确率,确认了即使是近似重复的暴露在训练期间也会提供可衡量的优势:

在 ImageNet 验证集上的零次分类准确率,跨具有和不具有泄漏的子集。最后一列报告了相对于完整集的准确率增益,突出显示的行对应于泄漏子集。

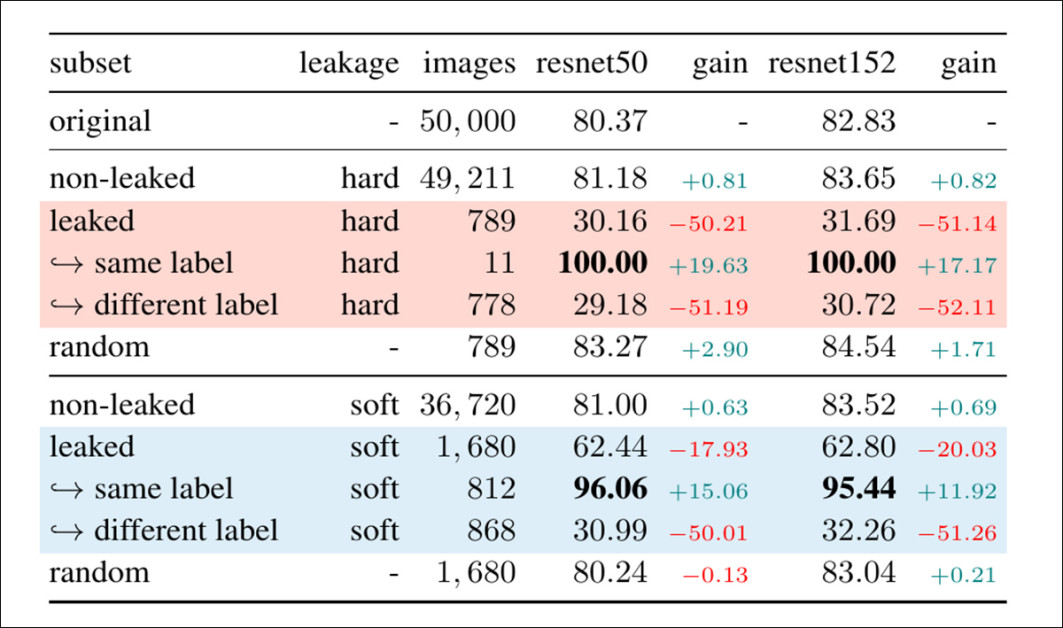

对于监督分类,ImageNet 中的泄漏导致了显著的性能下降 – 除非泄漏图像在两个分割中具有相同的标签,在这种情况下,模型实现了几乎完美的准确率,揭示了强烈的记忆效应:

在 ImageNet 验证集上的监督分类准确率,跨具有和不具有泄漏的子集。增益列显示了相对于完整集的变化。泄漏子集被突出显示。

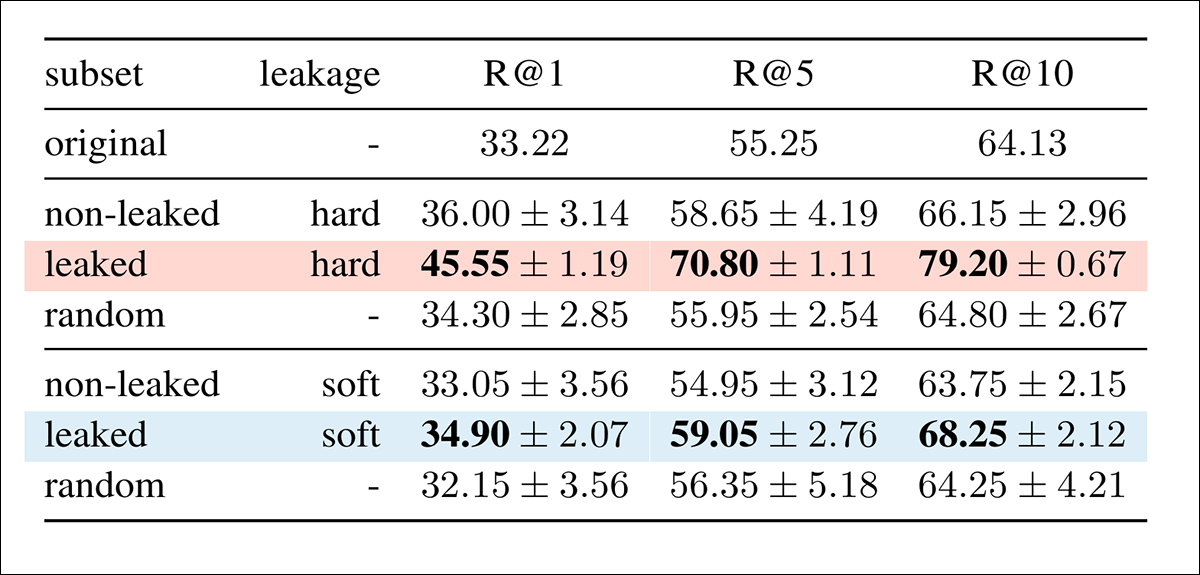

在图像到文本检索中,泄漏样本的性能也提高了,硬性和软性泄漏都导致了更高的召回率,泄漏子集也在运行之间产生了更一致的结果:

在 Flickr30K 上的图像到文本检索性能,跨具有和不具有泄漏的子集,突出显示了泄漏子集。

作者总结道:

‘总体而言,我们展示了泄漏对视觉数据集中的模型评估构成严重威胁的确凿证据,损害了机器学习中最基本的原则之一:不在训练数据上评估模型。’

结论

该论文的一个令人震惊的方面,尽管它并非新颖之处,是使用 CLIP 获得 LAION 中大量图像数据的嵌入的必要性,代表着一种规模,这种规模已经不能以其他方式解决,只能以聚合的方式处理,使用标记化的元数据,而不是当数据集更易于管理时可以检查的更详细的特征。

这是一个明显的例子,表明视觉语言模型的训练已经明确地超过了人类监督或任何手动策划的能力的界限,除了代表性子集之外。

* 也许有点令人困惑的是,该论文将重复的问题定义为“泄漏”。

† 作者的强调。

首次发表于 2025 年 8 月 26 日