人工智能

通过基于CNN的图像重塑实现更好的机器学习性能

Google Research提出了一种新的方法,通过改进图像预处理阶段中图像的缩放方式,提高基于图像的计算机视觉训练工作流的效率和准确性。

在论文 学习图像重塑以适应计算机视觉任务中,研究人员Hossein Talebi和Peyman Milanfar利用CNN创建了一种新的混合图像重塑架构,该架构在四个流行的计算机视觉数据集上获得了显著的识别结果改进。

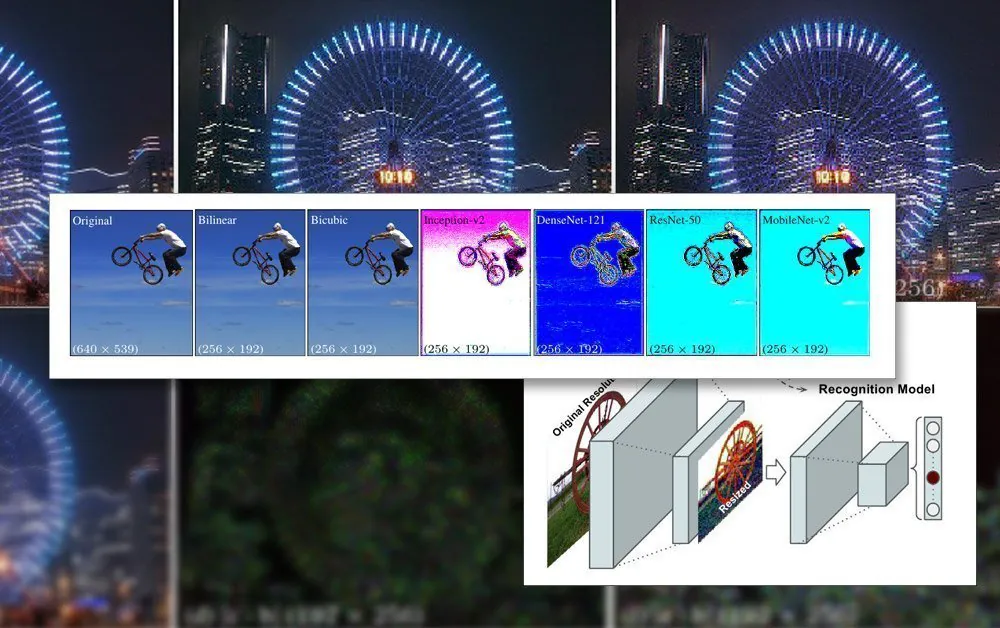

所提出的识别和重塑的联合框架。 Source: https://arxiv.org/pdf/2103.09950.pdf

该论文观察到,当前在自动机器学习管道中使用的缩放/重塑方法已经过时,通常只使用基本的双线性、双三次和最近邻 重塑 – 这些方法对所有像素进行无差异的处理。

相比之下,所提出的方法通过CNN增强图像数据,并将该输入合并到最终将通过模型架构的重塑图像中。

AI训练中的图像约束

为了训练一个处理图像的模型,机器学习框架将包括一个预处理阶段,其中各种大小、颜色空间和分辨率的图像(这些图像将有助于训练数据集)被系统地裁剪和重塑为一致的维度和稳定的单一格式。

通常,这将涉及在PNG格式上进行某种折衷,权衡处理时间/资源、文件大小和图像质量。

在大多数情况下,处理后的图像的最终尺寸非常小。下面我们看到一些最早的深度伪造数据集 生成 的80×80分辨率图像:

由于面部(和其他可能的主题)很少适合所需的正方形比例,因此可能需要添加黑色条(或允许浪费空间)以使图像均匀化,从而进一步减少实际可用的图像数据:

这里面部已从更大的图像区域中提取,直到它被尽可能经济地裁剪以包含整个面部区域。然而,如右侧所示,剩余区域中很大一部分将不会被用于训练,从而增加了重塑数据的图像质量的重要性。

随着近年来GPU能力的提高,新的NVIDIA卡配备了 越来越多 的视频RAM(VRAM),平均贡献图像大小开始增加,尽管224×224像素仍然相当标准(例如,它是 ResNet-50 数据集的大小)。

未重塑的224×244像素图像。

将批次装入VRAM

图像必须全部相同的原因是 梯度下降,即模型随时间改进的方法,需要统一的训练数据。

图像必须如此小的原因是它们必须在训练期间以小批量(通常为每批6-24张图像)加载(完全解压缩)到VRAM中。批次图像太少,无法很好地概括,而且会延长训练时间;太多,模型可能无法获得必要的特征和细节(见下文)。

这种“实时加载”的训练架构部分称为 潜在空间。这是特征从相同的数据(即相同的图像)中反复提取,直到模型收敛到一个状态,即它拥有所有必要的通用知识,以便在稍后对类似类型的未见数据执行转换。

此过程通常需要几天时间,尽管它可能需要一个月或更长时间的不断和无情的高容量24/7认知来实现有用的概括。VRAM大小的增加只在某种程度上有帮助,因为即使是图像分辨率的轻微增加也会对处理能力产生数量级的影响,并且可能不会总是产生有利的影响。

使用更大的VRAM容量来容纳更大的批次大小也是一个混合的祝福,因为通过这种方式获得的更快的训练速度 可能会被 不太精确的结果所抵消。

因此,由于训练架构受到如此多的限制,任何能够在现有管道限制内改进的东西都是一个显著的成就。

如何改进缩放

训练数据集中包含的图像的最终质量已被证明对训练结果有改进作用,特别是在 物体识别任务 中。2018年,马克斯·普朗克智能系统研究所的研究人员 认为 重采样方法的选择显著影响训练性能和结果。

此外,谷歌公司(由新论文的作者共同撰写)的先前工作发现,通过在数据集图像中 控制 压缩伪影,可以提高分类准确率。

新重采样器中构建的CNN模型将双线性重塑与“跳过连接”功能相结合,可以将训练网络的输出合并到重塑的图像中。

与典型的编码器/解码器架构不同,新提议可以不仅作为前馈瓶颈,还可以作为任何目标大小和/或宽高比的上采样逆瓶颈。此外,可以用Lanczos等其他合适的传统方法替换“标准”重采样方法。

高频细节

新方法产生的图像似乎将最终被训练过程识别的关键特征“烘焙”到源图像中。在美学上,结果是非传统的:

新方法应用于四个网络 – Inception V2;DenseNet-121;ResNet-50;和MobileNet-V2。谷歌研究图像下采样/重塑方法的结果产生了明显的像素聚集,预测了训练过程中将被识别的关键特征。

研究人员指出,这些初始实验仅针对图像识别任务进行了优化,并且在测试中,他们的基于CNN的“学习重塑器”能够在此类任务中实现改进的错误率。研究人员计划在未来将该方法应用于其他类型的基于图像的计算机视觉应用。