人工智能

能够理解场景的AI图像抠图

在2003年DVD发行的《异形3》(1992年)附带的额外纪录片中,视觉特效传奇理查德·埃德伦德回忆起在20世纪30年代末到80年代末主导视觉特效工作的“相扑”式的光化学抠图过程时,感到恐惧。埃德伦德将这个过程描述为“相扑”,与20世纪90年代初期出现的数字蓝/绿幕技术相比(他自那时起又回到了这个比喻)。

从背景中提取前景元素(例如人或飞船模型),以便将裁剪后的图像合成到背景板中,最初是通过将前景对象拍摄在统一的蓝色或绿色背景下实现的。

ILM为《归来的绝地武士》(1983年)制作的VFX镜头的劳动密集的光化学提取过程。 来源:https://www.youtube.com/watch?v=qwMLOjqPmbQ

在得到的镜头中,背景颜色随后会被化学地分离出来,并用作模板,在光学打印机中重新打印前景对象(或人),作为一个“浮动”的对象在一个透明的胶片单元中。

这个过程被称为颜色分离叠加(CSO)- 虽然这个术语最终会更多地与20世纪70年代和80年代低预算电视节目的粗糙“色键”视频特效联系在一起,这些特效是用模拟而不是化学或数字手段实现的。

1970年为英国儿童节目“蓝彼得”演示的颜色分离叠加。 来源:https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

无论是用于电影还是视频元素,之后提取的镜头都可以插入到任何其他镜头中。

尽管迪士尼公司更昂贵的专有钠蒸气过程(它特定地对黄色进行了键控,并且也被用于阿尔弗雷德·希区柯克1963年的恐怖片《鸟》)提供了更好的定义和更清晰的抠图,但光化学提取仍然是耗时和不可靠的。

超越数字抠图

在20世纪90年代,数字革命消除了化学品的需要,但没有消除对绿幕的需求。现在,可以仅通过在像Photoshop这样的像素编辑软件中搜索特定颜色的像素,或在可以自动键出彩色背景的新一代视频合成套件中,来移除绿色(或任何颜色)背景。

几乎在一夜之间,六十年的光学打印行业被 consigned 到了历史。

过去十年来,GPU加速的计算机视觉研究正在将抠图提取带入第三个时代,任务着研究人员开发不需要绿幕的高质量抠图系统。在Arxiv上,相关机器学习基础的前景提取的论文每周都有发布。

让我们进入画面

这种学术和行业对AI提取的兴趣已经影响了消费者空间:我们都熟悉Zoom和Skype过滤器的粗糙但可行的实现,可以在视频会议中用热带岛屿等替换我们的客厅背景。

然而,最佳的抠图仍然需要绿幕,就像Zoom上周所注意到的那样。

左边,一个男人站在绿幕前,通过Zoom的虚拟背景功能很好地提取了头发。右边,一个女人站在正常的家庭场景中,头发通过算法提取,准确性较低,计算需求更高。 来源:https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

Zoom支持平台的另一篇帖子警告,非绿幕提取还需要更大的计算能力。

需要剪辑

“野外”抠图系统(即在不需要绿幕的情况下隔离人)的质量、便携性和资源经济性的改进,对于视频会议过滤器以外的许多部门和追求都很重要。

对于数据集开发,改进的人脸、全头和全身识别为确保背景元素不会被训练到计算机视觉模型中提供了可能性;更准确的隔离将大大改进为区分和吸收域(即“猫”、“人”、“船”)而设计的语义分割技术,并改进VAE和基于变压器的图像合成系统,如OpenAI的新DALL-E 2;更好的提取算法将减少在昂贵的VFX管道中需要手动rotoscoping的需求。

事实上,多模态(通常为文本/图像)方法的兴起,在其中一个域(如“猫”)被编码为图像和相关文本引用,已经在图像处理中取得了进展。最近的一个例子是Text2Live架构,它使用多模态(文本/图像)训练来创建视频,包括水晶天鹅和玻璃长颈鹿等。

场景感知AI抠图

大量关于基于AI的自动抠图的研究都集中在边界识别和图像或视频帧中像素分组的评估上。然而,中国的新研究提出了一种通过利用场景的基于文本的描述(一种在计算机视觉研究领域过去3-4年中获得关注的多模态方法)来改进轮廓和抠图质量的提取管道,声称在多个方面都优于以前的方法。

抠图提取研究子领域面临的挑战是产生需要最少手动注释和人工干预的工作流程 – 理想情况下,根本不需要。

除了成本影响外,新论文的研究人员观察到,来自不同文化的众包工人进行的注释和手动分割可能会导致图像以不同方式标记或分割,从而导致算法不一致且不令人满意。

一个例子是主观解释什么定义了“前景对象”:

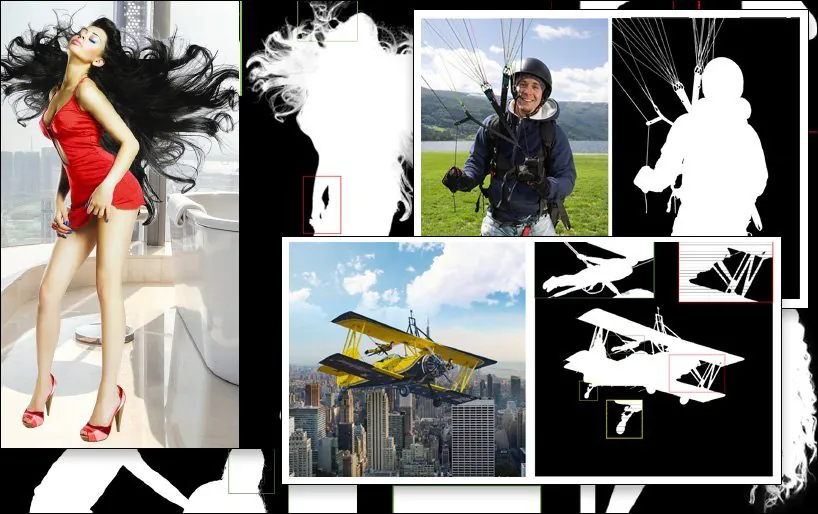

来自新论文:之前的方法LFM和MODNet(‘GT’表示理想结果,通常通过手动或非算法方法实现),对前景内容的定义有不同的和各自有效的处理方式,而新的SPG-IM方法通过场景上下文更有效地划定了‘近内容’。

为了解决这个问题,研究人员开发了一个名为情景感知引导图像抠图(SPG-IM)的两阶段管道。

首先,SPD预训练视觉到文本的特征转换,生成适合其关联图像的字幕。之后,前景掩码预测通过连接管道到一个新颖的显著性预测技术而得到启用。

然后,SPGM根据原始RGB图像输入和在第一个模块中获得的生成掩码输出估计的alpha抠图。

目标是情景感知引导,其中系统对图像的内容有上下文理解,使其能够构建 – 例如 – 从背景中提取复杂头发的挑战,针对这种特定任务的已知特征。

新论文题为《情景感知引导图像抠图》,来自OPPO研究院、PicUp.ai和Xmotors的研究人员。

智能自动抠图

SPG-IM还提供了一个自适应焦点变换(AFT)细化网络,可以分别处理局部细节和全局上下文,从而实现“智能抠图”。

论文指出:

‘我们相信来自视觉到文本任务的视觉表示,例如图像字幕,关注图像或视频帧中像素分组的语义上更全面的信号,既可以生成描述也可以覆盖全局信息和局部细节。另外,与图像抠图的昂贵像素注释相比,文本标签可以以非常低的成本大量收集。’

SPD分支的架构与密歇根大学的VirTex变压器基于文本解码器联合预训练,学习来自语义密集字幕的视觉表示。

VirTex通过图像-字幕对联合训练ConvNet和Transformers,并将获得的见解转移到下游视觉任务,例如对象检测。 来源:https://arxiv.org/pdf/2006.06666.pdf

在其他测试和消融研究中,研究人员将SPG-IM与最先进的基于trimap的方法Deep Image Matting(DIM)、IndexNet、Context-Aware Image Matting(CAM)、Guided Contextual Attention(GCA)、FBA和Semantic Image Mapping(SIM)进行了比较。

还测试了其他先前的框架,包括无需trimap的方法LFM、HAttMatting和MODNet。为了进行公平的比较,测试方法根据不同的方法进行了适配;如果代码不可用,则根据描述的架构重现了论文的技术。

论文指出:

‘我们的SPG-IM比所有竞争的无需trimap的方法([LFM]、[HAttMatting]和[MODNet])有了很大的改进。同时,我们的模型也在公共数据集(即Composition-1K、Distinction-646和Human-2K)上的所有四个指标上表现出了显著的优势,并且在我们的Multi-Object-1K基准测试中也表现出色。’

并继续指出:

‘可以明显地观察到,我们的方法保留了精细的细节(例如头发尖端、透明纹理和边界),而无需trimap的指导。另外,与其他竞争的无需trimap的模型相比,我们的SPG-IM可以更好地保留全局语义完整性。’

首次发布于2022年4月24日。