Anderson 视角

使用 AI 将对话添加到真实视频中

一种新的 AI 框架可以在不重新拍摄的情况下重写、删除或添加视频中的人的词语,在一个单一的端到端系统中。

三年前,互联网上会对任何一个在学术门户网站上每周发布的 20-30 个 AI 视频修改框架感到震惊;然而,这一流行的研究方向现在已经变得如此丰富,以至于几乎构成了“AI 粘液”的另一个分支,我比两三年前涵盖的发布数量要少得多。

然而,在这一系列中,有一个当前的发布引起了我的注意:一个集成系统,可以干预真实的视频片段,并将新语音插入现有的视频中(而不是从面部或帧创建整个生成性片段,这更为常见)。

在下面的示例中,我从发布的 项目网站 上的多个样本视频中编辑了它们,我们首先看到真实的源片段,然后,在下面,视频片段中间的强加 AI 语音,包括语音合成和唇部同步:

点击播放。 使用 FacEDiT 的本地编辑和拼接 – 其中一种模式。请参阅源网站以获取更好的分辨率。

源 – https://facedit.github.io/

这种方法是为新方法开发的三种方法之一,这种方法称为“本地编辑和拼接”,也是作者(以及我)最感兴趣的方法。基本上,通过使用中间帧之一作为新颖的 AI 解释的起点,并将其后续(真实)帧作为生成插入片段应匹配的目标来扩展片段。在上面的片段中,这些“种子”和“目标”帧由上面的视频暂停表示,而修改后的视频下面提供了生成的填充。

作者将这种面部和语音合成方法框定为第一种完全集成的端到端方法,用于此类 AI 视频编辑,并观察到这一框架的潜力对于电视和电影制作:

‘电影制片人和媒体制作者经常需要修改已录制的视频的特定部分 – 也许一个词被错误地说出,或者剧本在拍摄后发生了变化。例如,在 泰坦尼克号(1997)中,罗斯说,“我永远不会放开你,杰克,”导演可能后来决定应该是“我永远不会忘记你,杰克”。

‘传统上,这种修改需要重新拍摄整个场景,这既耗时又耗费巨大。语音合成提供了一种实用的替代方案,通过自动修改面部运动以匹配修改后的语音,消除了重新拍摄的需要。’

尽管这种类型的 AI 干预可能会面临 文化 或行业阻力,但它们也可能构成人类主导的 VFX 系统和工具包中的新功能。无论如何,目前,挑战仅仅是技术性的。

除了通过添加 AI 生成的对话来扩展片段外,新系统还可以修改现有的语音:

点击播放。 修改现有对话而不是插入额外对话的示例。请参阅源网站以获取更好的分辨率。

当前状态

目前尚无提供此类合成功能的端到端系统;尽管诸如 Google 的 Veo 系列 等生成 AI 平台可以生成音频,并且其他各种框架可以创建 深度伪造音频,但目前需要创建一个相当复杂的不同架构和技巧的管道,以便以新系统(称为 FacEDiT)能够实现的方式干预真实的镜头。

该系统使用 扩散变换器(DiT)与 流匹配相结合,根据周围(上下文)运动和语音音频内容创建面部运动。该系统利用现有的流行包,包括 LivePortrait(最近被 Kling 接管),来处理面部重建。

除了这种方法外,由于他们的方法是将这些挑战整合到单个解决方案中的第一种方法,作者创建了一个名为 FacEDiTBench 的新基准,以及几个完全新颖的评估指标,适用于此特定任务。

新工作的标题为 FacEDiT:通过面部运动填充实现统一的对话面部编辑和生成,来自韩国的四名研究人员来自浦项科技大学(POSTECH)、韩国科学技术院(KAIST)和德克萨斯大学奥斯汀分校。

方法

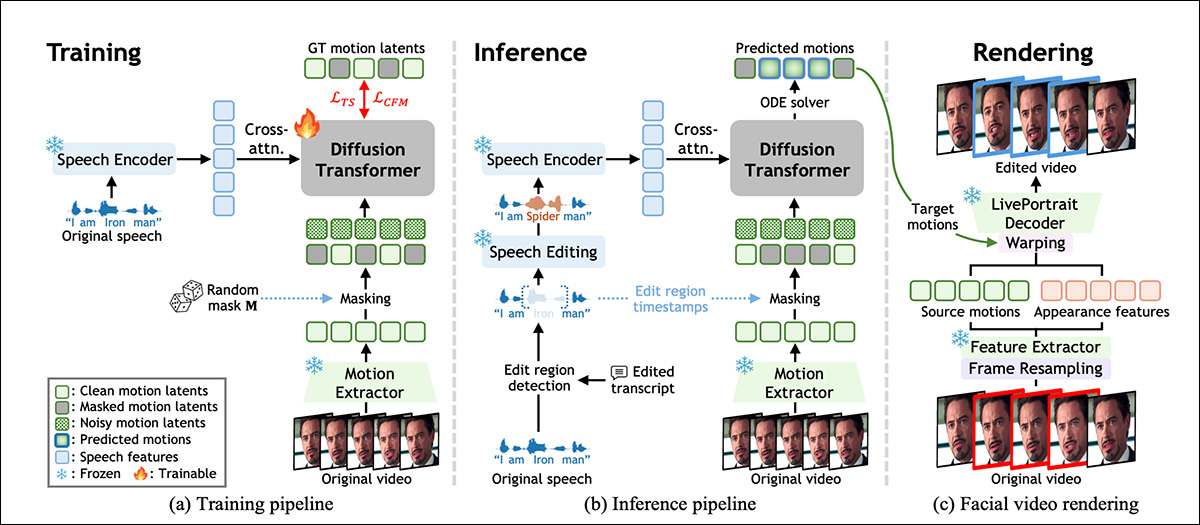

FacEDiT 通过学习如何根据周围运动和语音音频填充原始性能中缺失的部分来重构面部运动。如以下架构所示,此过程允许模型在训练过程中充当缺口填充器,预测与语音匹配的面部运动,同时保持与原始视频的一致性:

FacEDiT 系统的概述,展示了如何通过自监督填充在训练过程中学习面部运动,通过编辑语音在推理过程中进行指导,最后通过重用原始镜头的外观并仅替换目标运动将其渲染回视频。 源

在推理时,相同的架构支持两种不同的输出,具体取决于视频的遮蔽程度:部分编辑,其中只修改一个短语,其余部分保持不变;或全句生成,其中新运动完全从头开始合成。

模型通过 流匹配 进行训练,它将视频编辑视为两种面部运动版本之间的一种路径。

与其从头开始学习猜测编辑后的面部应该是什么样子,不如流匹配学习如何平稳地在一个噪声占位符和正确的运动之间移动。为了实现这一点,系统使用一个紧凑的数字集来表示面部运动,该数字集从每个帧中使用上述 LivePortrait 系统的版本中提取。

这些运动向量旨在描述表情和头部姿势,而不会 纠缠 身份,以便语音更改可以在不影响人的整体外观的情况下进行本地化。

FacEDiT 训练

为了训练 FacEDiT,每个视频片段被分成一系列面部运动快照,并且每个帧都与相应的音频块配对。然后随机隐藏运动数据的一部分,并要求模型根据语音和周围未遮蔽的运动的上下文来猜测这些缺失的运动应该是什么样子。

由于遮蔽的跨度和它们的位置从一个训练示例到下一个训练示例都有所不同,因此模型逐渐学会处理小的内部编辑以及用于全序列生成的更长的间隙。

系统上述的扩散变换器通过随时间改进嘈杂的输入来学习恢复遮蔽的运动。与其一次性将语音和运动输入模型,不如将音频通过 交叉注意力 线程到每个处理块中,有助于系统更精确地匹配唇部运动与音频语音。

为了在编辑过程中保持真实性,注意力偏向于相邻的帧而不是整个时间线,迫使模型关注局部连续性,并防止编辑区域边缘的闪烁或运动跳跃。位置嵌入(它们告诉模型每个帧在序列中的位置)进一步帮助模型保持自然的时间流和上下文。

在训练过程中,系统通过根据语音和附近未遮蔽的运动重建遮蔽的跨度来学习预测缺失的面部运动。在推理时,相同的设置被重用,但遮蔽现在由语音中的编辑引导。当一个词或短语被插入、删除或更改时,系统定位受影响的区域,遮蔽它,并重新生成与新音频匹配的运动。全序列生成被视为一种特殊情况,其中整个区域被遮蔽并从头开始合成:

数据和测试

系统的主干由 22 层组成,用于扩散变换器,每层有 16 个 注意头 和 1024 和 2024px 的前馈维度。运动和外观特征使用 冻结 的 LivePortrait 组件提取,语音使用 WavLM 编码并使用 VoiceCraft 修改。

一个专用的投影层将 786 维的语音特征映射到 DiT 的潜在空间中,只有 DiT 和投影模块从头开始训练。

训练是在 AdamW 优化器下进行的,目标学习率为 1e-4,训练一百万步,在两个 A6000 GPU(每个具有 48GB 的 VRAM)上,批次大小为八。

FacEDiTBench

FacEDiTBench 数据集包含 250 个示例,每个示例都有一个视频片段,原始语音和编辑语音,以及两者的转录。视频来自三个来源,100 个片段来自 HDTF,100 个来自 Hallo3,50 个来自 CelebV-Dub。每个都经过手动检查,以确认音频和视频都足够清晰以供评估。

GPT-4o 用于修改每个转录以创建语法上有效的编辑。这些修订后的转录以及原始语音都传递给了 VoiceCraft 以生成新音频;并且在每个阶段,转录和生成的语音都经过手动审查以确保质量。

每个样本都标有编辑类型、更改的时间和修改跨度的长度,并且编辑被归类为 插入、删除 或 替换。更改的词数从 1 到 3 个词的短编辑、4 到 6 个词的中等编辑和 7 到 10 个词的长编辑不等。

定义了三个自定义指标来评估编辑质量。 光度连续性,用于衡量编辑段的照明和颜色与周围视频的融合程度,通过比较边界处的像素级差异;运动连续性,用于评估面部运动的一致性,通过测量编辑和未编辑帧之间的光流变化;以及 身份保持,用于估计编辑后主体的外观是否保持一致,通过使用 ArcFace 人脸识别模型比较原始和生成序列的面部嵌入。

测试

测试模型是在来自上述三个数据集的材料上训练的,总共约 200 小时的视频内容,包括 vlog 和电影,以及高分辨率的 YouTube 视频。

为了评估对话面部编辑,使用了 FacEDiTBench,以及 HDTF 测试分割,它已成为这一套任务的基准标准。

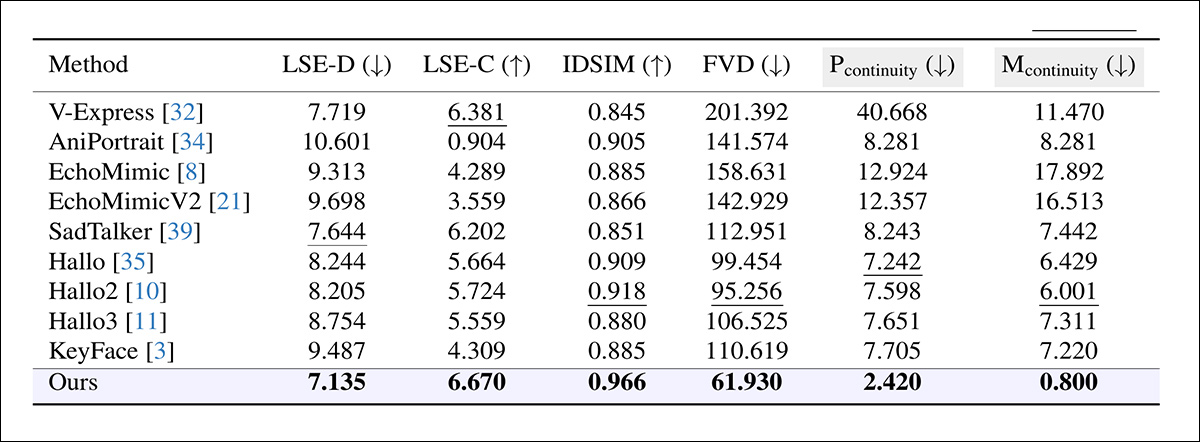

由于没有直接可比拟的系统能够包含此类端到端功能,作者选择了一系列可以复制至少部分目标功能的框架,并可以作为基准;具体来说,KeyFace;EchoMimic;EchoMimicV2;Hallo;Hallo2;Hallo3;V-Express;AniPortrait;以及 SadTalker。

还使用了几个已建立的指标来评估生成和编辑质量,唇部同步精度通过 SyncNet 进行评估,报告了唇部运动和音频之间的绝对错误(LSE-D)和置信度(LSE-C);Fréchet 视频距离(FVD)量化了视频整体的真实性;以及 学习的感知相似性度量(LPIPS),衡量生成帧和原始帧之间的感知相似性。

对于编辑,所有指标均仅应用于修改的段;对于生成,整个视频均被评估,边界连续性除外。

每个模型都被要求合成一个匹配的视频段,然后将其拼接到原始片段中(研究人员注意到,这种方法通常会在编辑部分与周围镜头的交界处引入可见的不连续性)。还测试了一种方法,即整个视频从修改的音频中重新生成 – 但这不可避免地覆盖了未编辑的区域,并且无法保留原始性能:

跨系统比较编辑性能,最初为对话面部生成而设计,FacEDiT 在每个指标上都优于所有基准,实现了更低的唇部同步错误(LSE-D),更高的同步置信度(LSE-C),更强的身份保持(IDSIM),更大的感知真实性(FVD),以及编辑边界的更平滑过渡(Pcontinuity,Mcontinuity)。灰色阴影列突出显示了评估边界质量的关键标准;粗体和下划线值分别表示最佳和次佳结果

关于这些结果,作者评论说:

‘[我们的] 模型在编辑任务上显著优于现有方法。它实现了强大的边界连续性和高的身份保持,证明了它在编辑过程中保持时间和视觉一致性的能力。另外,它的高唇部同步精度和低 FVD 反映了合成视频的真实性。’

点击播放。 结果,由本作者从发布的项目网站上的视频中汇编。请参阅源网站以获取更好的分辨率。

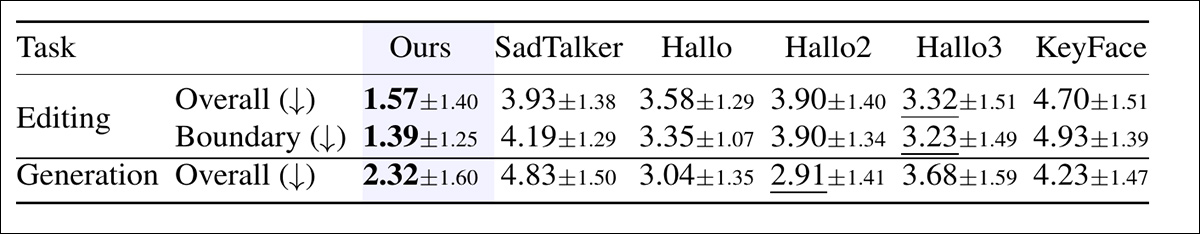

此外,进行了一项人体研究,以评估编辑和生成的感知质量。

对于每次比较,参与者观看六个视频,并根据整体质量对其进行排名,考虑唇部同步精度、头部运动的自然性和真实性。在编辑试验中,参与者还根据过渡的平滑度对编辑和未编辑的语音段进行评分:

人体评估者分配的平均排名,其中较低的排名更好。在编辑和生成中,参与者都评估了每个视频的自然度和同步度。对于编辑,他们还评估了过渡的平滑度。粗体和下划线的数字表示前两名的评分。

在研究中,FacEDiT 在编辑质量和过渡无缝度方面始终排名最高,领先优势明显,并且在生成设置中也获得了强有力的评分,表明其衡量的优势转化为感知上更好的输出。

由于篇幅有限,我们将读者引导至源论文以获取更多关于消融研究和额外测试的详细信息,这些测试在新工作中进行并报告。事实上,这类原型研究往往难以生成有意义的测试结果部分,因为核心产品本身不可避免地成为后续工作的潜在基准。

结论

即使对于推理,像这样的系统也可能需要在推理时大量的计算资源,使得下游用户(这里,假设是 VFX 商店)难以将工作保留在现场。因此,能够适应现实的本地资源的方法将始终被提供者所偏爱,提供者有法律义务保护客户的镜头和一般的知识产权。

这并不是批评新产品,它可能在量化权重或其他优化下完美运行,并且是第一种吸引我回到这一研究方向的产品,已经有一段时间了。

首次发布于 2022 年 12 月 17 日。同日 20:10 EET 编辑,增加了正文第一段的额外空间。