Anderson 视角

一种“禅”方法可以防止语言模型产生幻觉

要求ChatGPT在解决实际问题之前对一个随机答案进行事实核查,这会使其思考得更深入,并且更常常给出正确答案——即使前面的“随机”答案与实际查询无关。

中国的一篇有趣的新论文开发了一种非常低成本的方法,可以防止语言模型(如ChatGPT)产生幻觉,并提高答案的质量:要求模型先对一个完全无关的问题的答案进行事实核查:

一个无关的问题的例子,可以“解放”LLM的思维,并帮助它专注于后续的查询。 来源

这种“禅”方法是改进性能的一种非常廉价的方式,相比其他更复杂的方法,如微调、提示优化和并行采样,它适用于开源和闭源模型,表明这是多个LLM架构的基本特征,而不是特定训练材料或方法的脆弱特征。

作者概述了这种方法的规模经济:

‘要实现最小的额外先验知识,VF只需要在提示中提供一个随机/琐碎的答案。验证过程的输出令牌比普通的CoT路径少,[有时]甚至没有显式的验证过程,因此[需要] 非常[少]的额外测试计算.’

在测试中,这种方法——被称为验证优先(VF)——能够改进各种任务的响应,包括数学推理,在开源和商业平台上。

这种技术之所以有效的部分原因可能在于语言模型吸收和模拟人类心理学趋势的方式,因此直接的问题可能使模型变得“防御”和“紧张”,而要求验证他人的工作则不会引发这些“生存本能”。

核心思想是,验证一个答案需要更少的努力,比从头生成一个答案,并且可以触发一种不同的推理路径,以补充标准的链式思维。

要求模型批判性地评估一个给定的答案(即,模型没有参与创建的答案),也可能激活一种批判性思维,帮助避免模型对自己的第一印象过于自信。

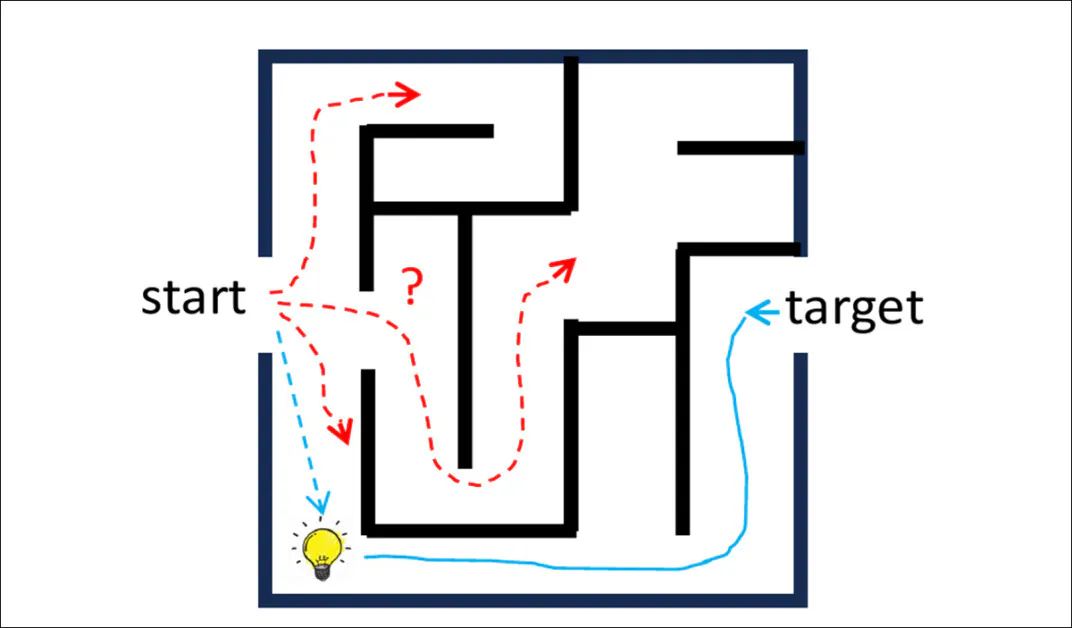

这项工作将该过程描述为逆向推理路径:

从一个提出的答案开始,逆向推理到问题,可以揭示从问题本身推理时更难发现的捷径或洞察力。这种“逆向路径”可能遵循更简单的轨迹,并提供补充信息给标准的链式思维推理。

研究人员还将核心概念具体化为Iter-VF,一种顺序时间测试缩放方法,迭代地改进答案,避免了自我纠正策略中常见的错误积累问题。

这项新工作的标题是要求LLM先验证几乎是免费的,来自北京清华大学电子工程系的两位研究人员。

方法

这项新工作的核心思想是反转语言模型中的通常推理流程。与其要求模型从头解决问题,不如先给它一个候选答案(通常是错误或任意的),然后要求它检查该答案是否有意义。

这会促使模型逆向推理,从提出的答案向问题逆向推理。一旦验证完成,模型就会按照通常的方式解决原始问题。

这种逆转,论文断言,减少了粗心的错误,并鼓励一种更具反思性的推理方式,帮助LLM发现隐藏的结构,并避免误导性的假设。

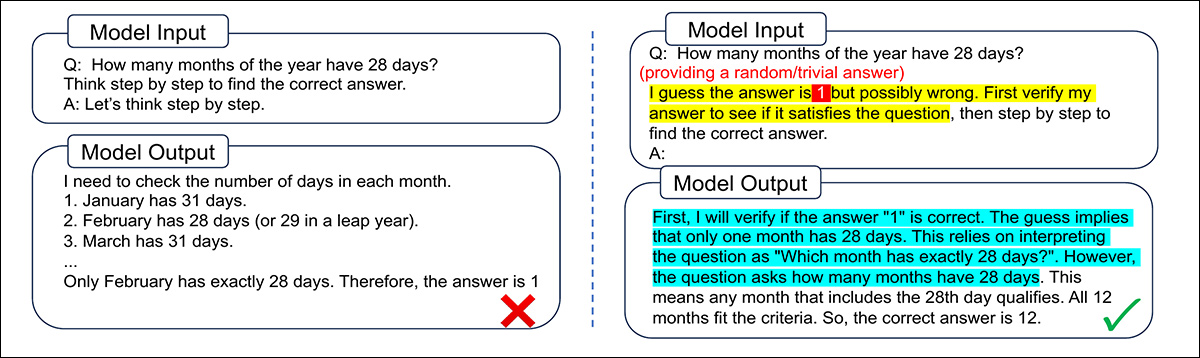

如以下示例所示,即使要求模型验证一个明显错误的猜测,如’10’ ,也可以帮助它从有缺陷的逻辑中恢复过来,并优于标准的链式思维提示:

要求模型先验证一个猜测的答案,可以帮助它发现不一致性,并更仔细地处理问题。在这个例子中,标准方法导致一个流畅但错误的解决方案,而验证优先提示触发了一个更清晰的逻辑结构和正确的结果。

在许多实际问题中,提供一个猜测让模型检查并不是很容易,特别是当任务是开放式的,例如编写代码或调用API。因此,为了更好地适应,这种方法首先给出最好的答案,如常,然后将该答案反馈到验证优先格式中。在这种方式下,模型检查并改进自己的输出:

当模型被要求验证自己的早期输出时,它会发现自己的逻辑中的缺陷,并重写解决方案以得到正确的结果。验证优先提示帮助它专注于特定的错误,而不是重复同样的错误。

这种方法构成了前面提到的Iter-VF。模型重复这个循环,不断改进答案,无需重新训练或定制工具。与其他自我纠正策略不同,这些策略可能会积累早期的思考并混淆模型,Iter-VF每次只查看最近的答案,这有助于保持其推理的清晰度。

数据和测试

作者在四个领域评估了这种方法:一般推理任务,其中VF被种子为一个琐碎的猜测;时间敏感任务,其中Iter-VF被与对手的缩放方法进行比较;开放式问题,如编码和API调用,VF使用模型自己的早期答案;以及闭源商业LLM,其中内部推理步骤是不可访问的。

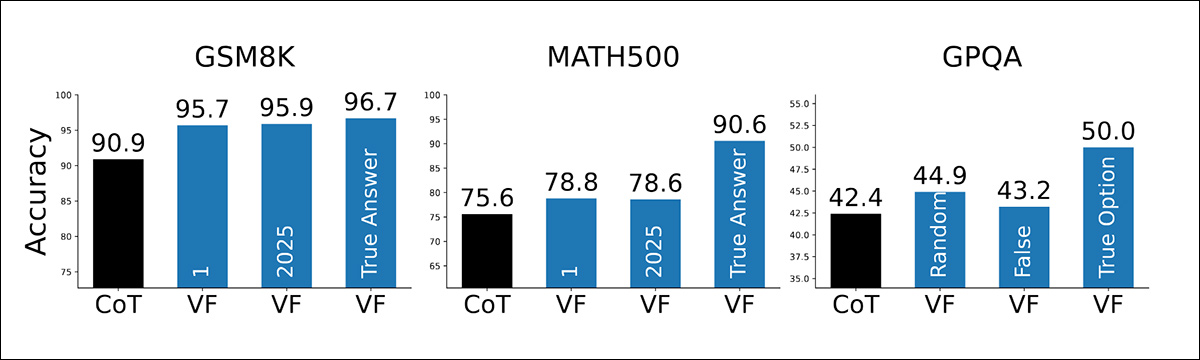

为了测试这种方法,研究人员使用了三个推理基准:GSM8K和MATH500,用于数学问题;以及GPQA-Diamond,用于研究生级别的科学问题。

在每种情况下,模型都被给予一个琐碎的猜测,如‘1’,作为数字答案的起始点;或一个随机混洗的多选项作为验证的起始点。没有添加任何特殊的调优或先验知识,基线比较是标准的零次链式思维提示。

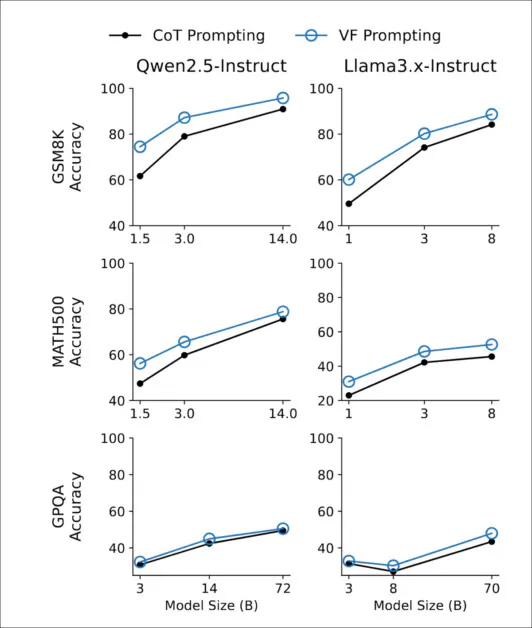

测试运行在一系列完整的Qwen2.5和Llama3指令调优模型上,从1B到72B(参数)大小。使用的Qwen模型是Qwen2.5-1.5B-Instruct、Qwen2.5-3B-Instruct、Qwen2.5-14B-Instruct和Qwen2.5-72B-Instruct。Llama3变体是Llama3.2-1B-Instruct、Llama3.2-3B-Instruct、Llama3.1-8B-Instruct和Llama3.3-70B-Instruct。

如以下所示,来自Verification-First提示的改进在模型规模上保持一致,甚至在1B参数时就可以看到明显的收益,并一直持续到72B:

在Qwen2.5和Llama3家族的所有模型大小中,验证优先提示一致地优于标准的链式思维提示,在GSM8K、MATH500和GPQA上。

这种效果在计算密集型的数学基准测试(如GSM8K和MATH500)上最为明显,在这些测试中,验证一个错误的答案可以促进比从头开始解决问题更好的推理。在GPQA-Diamond上,这个优势较小但仍然存在。

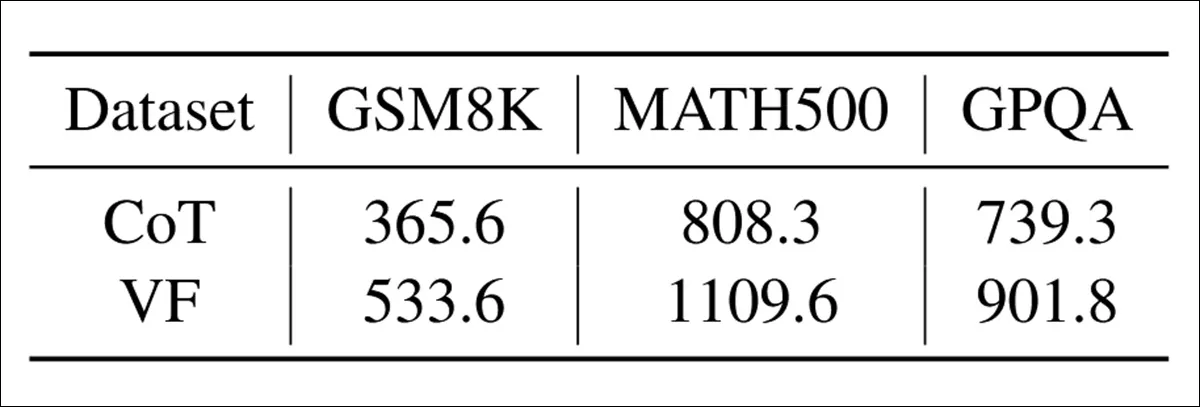

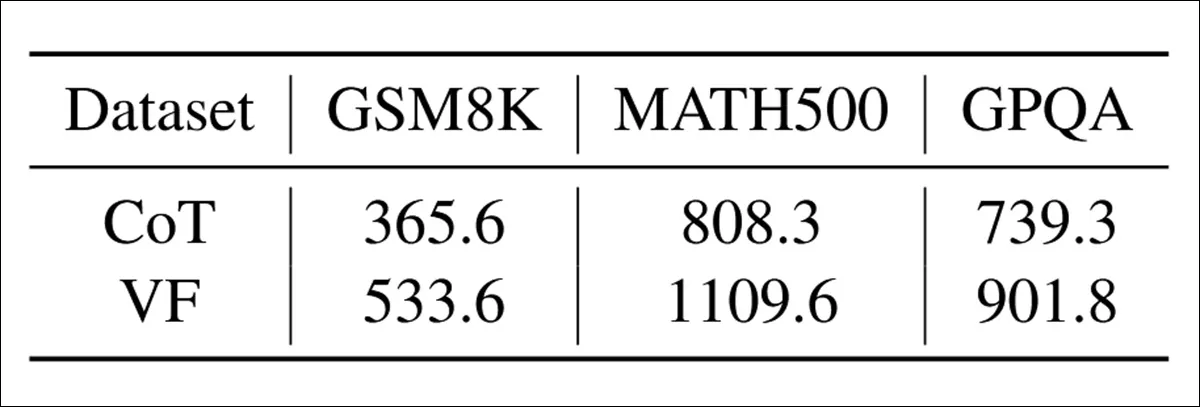

验证优先的计算成本很低:在下表中,我们可以看到生成一个验证步骤比标准的链式思维提示多增加了大约20-50%的输出令牌:

在GSM8K、MATH500和GPQA基准测试中,各个提示方法的平均输出令牌数量。

尽管如此,额外的成本仍然远低于需要多个采样完成或递归规划的策略。

在下图中,我们可以看到这种方法对猜测答案质量的敏感度。令人惊讶的是,即使当猜测是琐碎的(‘1’)、不合理的(‘2025’)或是一个随机的多选项时,验证优先仍然优于标准提示:

在GSM8K、MATH500和GPQA上,验证优先提示的准确性收益,当模型被给予琐碎、不合理或正确的答案进行验证时。

如预期,当猜测恰好是正确答案时,准确性会大幅提高;但这种方法仍然有效,表明收益并不是由猜测答案本身的信息驱动的,而是由验证行为本身驱动的。

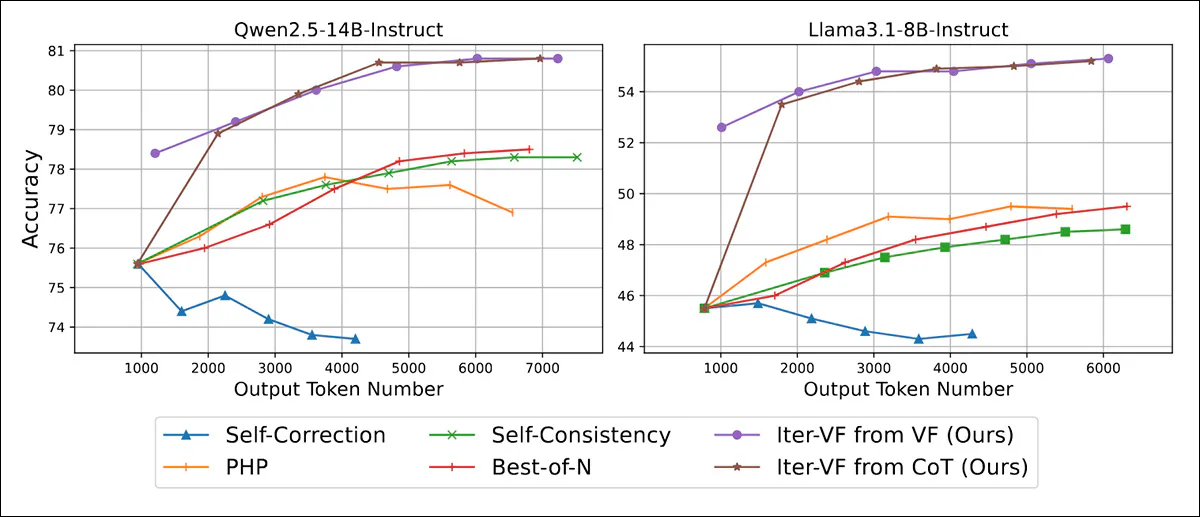

Iter-VF还被与四种测试时缩放策略进行比较,这些策略不需要重新训练或任务特定适应。在自我纠正中,模型被提示通过反思以前的推理步骤来修订其答案;在PHP中,之前的答案被追加到输入中作为上下文提示,尽管没有说明如何使用它们。

此外,在自我一致性中,多个推理路径被采样,最后的答案通过多数票选举被选择;最后,在最佳N中,几个输出被独立生成,并使用验证提示对其进行排名,最高评分的响应被选中。

实施了两种Iter-VF变体:一种使用琐碎的猜测(‘1’)初始化,另一种使用标准CoT输出初始化:

在MATH500上,随着输出预算的增加,准确性和令牌效率,显示两种Iter-VF变体在所有模型规模上优于所有基线。

Iter-VF在计算资源有限时比其他所有方法都更好,这归功于它检查答案的方式,而不是初始答案的质量(因为VF和CoT变体很快达到类似的准确性)。

PHP表现较差,甚至它重用了早期的答案作为提示,可能是因为LLM没有很好地利用这些提示。

与PHP和自我纠正相比,后者在迭代中积累上下文,Iter-VF每一步只考虑最近的答案。这一马尔可夫方法避免了延长推理链的混淆——这是一个特别有害的弱点,尤其是对于自我纠正。

并行方法,如自我一致性和最佳N,避免了这个问题,尽管它们的改进速度较慢且更为适度。

(注:结果部分虽然详尽,但阅读起来不友好且冗长,因此我们不得不在此截断大部分的剩余内容,并将读者引导至源论文以获取更多细节)。

当在GPT-5 Nano和GPT-5 Mini上进行测试时,闭源商业模型隐藏了完整的推理轨迹,只返回最终答案,Iter-VF在不依赖中间输出的情况下改进了性能。在下表中,我们可以看到MATH500和GPQA上的收益,确认验证优先方法即使只有输入和最终答案可访问时仍然有效:

当Iter-VF应用于具有隐藏推理轨迹的GPT-5模型时,在MATH500和GPQA上的准确性。

结论

尽管这篇新论文从结果部分开始变得不清晰,但在一类AI模型中发现一个普遍特征的发现仍然是一个令人着迷的发展。任何经常使用LLM的人都可能会本能地开发出一套技巧来绕过模型的缺陷,因为每个缺陷都会随着时间的推移而变得明显,模式就会出现;所有人都希望找到一个像这种方法一样普遍和适用的“技巧”。

实施和更新LLM中的上下文窗口的一个最大问题似乎是平衡会话进度的保留和在必要时走向新方向的能力,而不会陷入虚假的幻觉或离题的输出。在这篇论文中,我们看到一个温和但坚持的“唤醒电话”的例子,似乎可以在不失去上下文的情况下重置LLM。有趣的是,看看后续项目是否会采用和演化这种方法。

研究人员强调了他们新方法的经济性——这是一个12个月前甚至不会被考虑的因素。如今,超大规模AI的含义使得曾经被认为是琐碎的资源节约现在变得至关重要和基本。

* 请注意,由于某些部分的英文标准可能会让读者感到困惑,因此我不得不采取了总结关键见解的自由,并将读者引导至源论文以进行核实。因此,我将在这里截断大部分的剩余内容,并将读者引导至源论文以获取更多细节。

首次发布于2025年12月4日,星期四